Meilleurs outils ETL : sélection rapide

Les meilleurs outils ETL permettent aux équipes d’extraire automatiquement des données depuis plusieurs sources, de les nettoyer et de les formater, puis de les charger dans des entrepôts de données ou des systèmes analytiques pour obtenir des informations en temps réel. Cela facilite la création de jeux de données cohérents et fiables tout en réduisant le temps passé à manipuler manuellement les données et à maintenir les pipelines.

Les équipes commencent généralement à chercher des solutions ETL lorsqu’elles passent trop de temps à réparer des pipelines défaillants, à gérer des formats de données incompatibles ou à attendre des heures la mise à jour des rapports. Les processus manuels et les scripts anciens ne peuvent souvent pas suivre le rythme et le volume des données modernes, ce qui génère des retards, des erreurs et des tableaux de bord peu fiables.

J’ai travaillé avec des équipes d’ingénierie et d’analyse des données afin de mettre en place et d’optimiser des workflows ETL dans des environnements cloud et sur site, en testant les outils en termes de scalabilité, de flexibilité de transformation et de facilité d’intégration avec des stacks data modernes.

Dans ce guide, vous découvrirez quelles plateformes ETL rendent réellement vos opérations data plus rapides, plus fiables et plus simples à maintenir, sans ajouter de complexité inutile.

Why Trust Our Software Reviews

We’ve been testing and reviewing software since 2023. As tech leaders ourselves, we know how critical and difficult it is to make the right decision when selecting software.

We invest in deep research to help our audience make better software purchasing decisions. We’ve tested more than 2,000 tools for different tech use cases and written over 1,000 comprehensive software reviews. Learn how we stay transparent & our software review methodology.

Résumé de la sélection des meilleurs outils ETL

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Idéal pour l'intégration de feuilles de calcul avec des sources de données | Forfait gratuit disponible | À partir de 49 $/mois (facturé annuellement) | Website | |

| 2 | Idéal pour des pipelines de données d'entreprise fiables | Essai gratuit de 14 jours + Démo gratuite disponible | À partir de 239$/mois (facturé annuellement) | Website | |

| 3 | Idéal pour l'extraction de données multi-sources | Démo gratuite disponible | Tarification sur demande | Website | |

| 4 | Idéal pour de vastes transformations de données | démo gratuite disponible | À partir de 1 999 $/mois | Website | |

| 5 | Meilleure console de type glisser-déposer | Offre gratuite disponible | À partir de $0.60/mois (pour les activités peu fréquentes) | Website | |

| 6 | Meilleur outil ETL sans serveur | Formule gratuite disponible | Tarification sur demande | Website | |

| 7 | Idéal pour les extractions de données par lots | Essai gratuit sur demande | Tarifs sur demande | Website | |

| 8 | Idéal pour le stockage de grandes quantités de données | Not available | Gratuit | Website | |

| 9 | Idéal pour les intégrations | Essai gratuit avec forfaits payants | $0.7742 OCPU par heure | Website | |

| 10 | Idéal pour la combinaison des données | Pas d'essai gratuit | $1.913/heure (Entreprise) | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Avis sur les meilleurs outils ETL

Vous trouverez ci-dessous mes analyses détaillées des meilleurs outils ETL qui figurent dans cette sélection. Mes avis proposent un aperçu complet des principales fonctionnalités, des avantages et inconvénients, des intégrations ainsi que des cas d’usage idéaux pour chaque outil afin de vous aider à trouver le plus adapté à vos besoins.

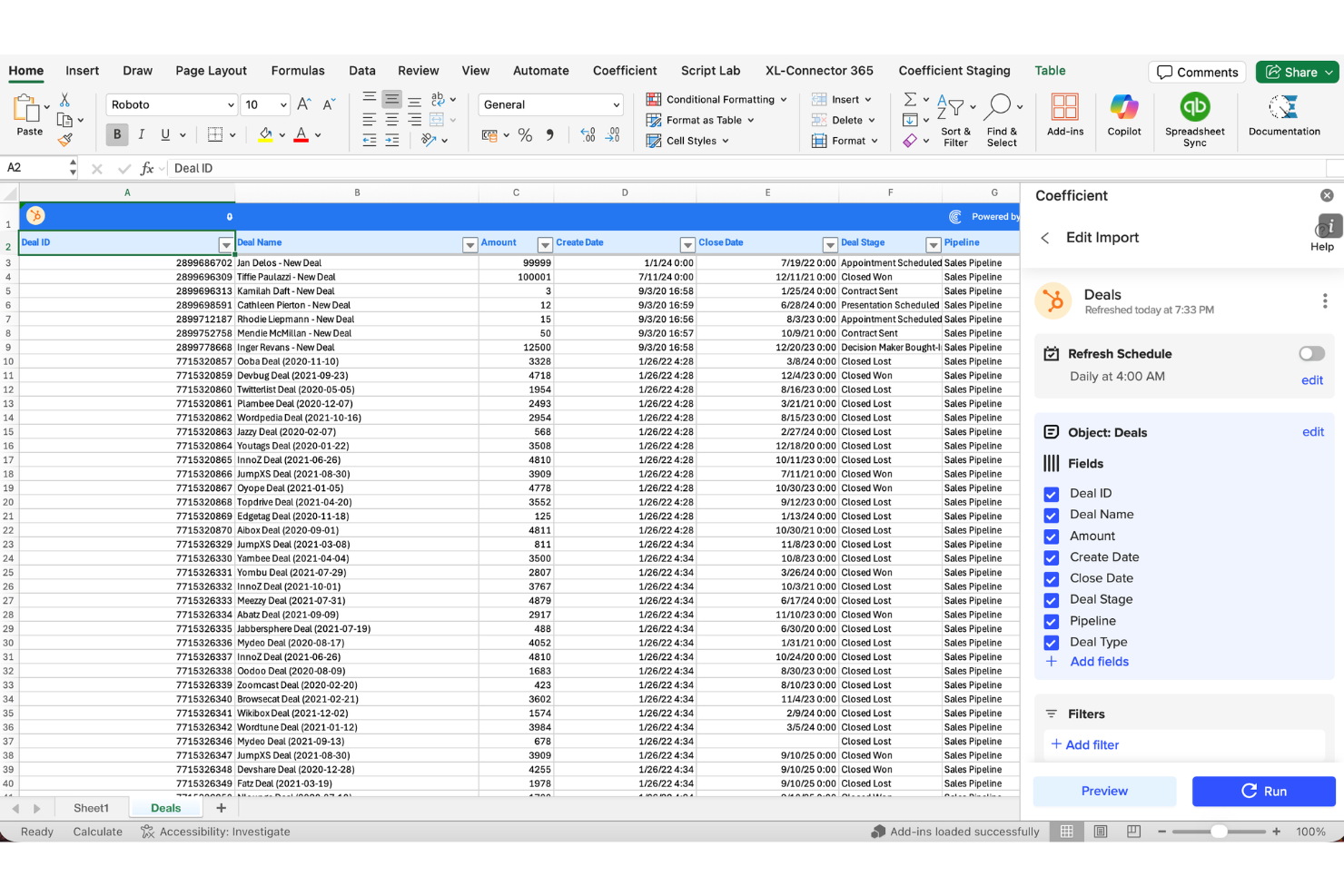

Idéal pour l'intégration de feuilles de calcul avec des sources de données

Pour les professionnels à la recherche de solutions ETL efficaces, Coefficient constitue un choix attrayant grâce à l'intégration de Google Sheets et Excel avec plus de 100 sources de données. Il séduit particulièrement les entreprises dans la finance, le marketing et les opérations liées aux revenus, où l'analyse de données en temps réel et l'automatisation sont essentielles. En éliminant le besoin de coder, Coefficient simplifie la création d'applications de données complexes, résolvant ainsi des défis tels que la gestion des données et l'amélioration de la productivité.

Pourquoi j'ai choisi Coefficient

J'ai choisi Coefficient pour sa capacité unique à connecter des feuilles de calcul à un large éventail de sources de données, ce qui est indispensable pour tout outil ETL. Ses fonctionnalités, comme la conservation des formules et la capture instantanée des données, se distinguent en permettant aux équipes de gérer et transformer les données sans effort. De plus, l'inclusion d'outils comme l'Assistant Google Sheets et le Générateur de requêtes SQL accompagne les utilisateurs dans la gestion de tâches complexes sans nécessiter de compétences techniques approfondies. Ces atouts font de Coefficient un atout précieux pour les entreprises souhaitant optimiser leurs flux de travail liés aux données.

Fonctionnalités clés de Coefficient

En plus de ses capacités d'intégration, Coefficient propose plusieurs fonctionnalités remarquables :

- Analyse de données en temps réel : Travaillez avec des données d'entreprise actualisées directement dans les feuilles de calcul.

- Tableaux de bord alimentés par l'IA : Créez des tableaux de bord dynamiques qui se mettent à jour automatiquement avec les dernières informations.

- Connexion à n'importe quelle API : Récupérez des données depuis des systèmes personnalisés ou internes sans créer de pipelines séparés.

- Création d'applications sans code : Concevez des applications de données comme des tableaux de suivi des commissions et des tableaux de bord marketing sans avoir à coder.

Intégrations Coefficient

Les intégrations incluent Salesforce, QuickBooks, Snowflake, HubSpot, Google Analytics, Slack, Stripe, Shopify, et plus encore.

Pros and Cons

Pros:

- Réduit les actualisations manuelles et les tâches de reporting répétitives

- Permet l'accès aux données métiers en temps réel sans pipelines complexes

- Prend en charge les intégrations préconfigurées et basées sur API

Cons:

- Moins approprié pour des infrastructures de données très spécialisées

- Mieux adapté aux flux de travail ETL orientés entreprise

Hevo est une plateforme d'intégration de données et d'ETL sans code conçue pour les entreprises souhaitant automatiser leurs pipelines de données. Elle soutient les entreprises en permettant des connexions à plus de 150 sources de données sans besoin de coder, améliorant ainsi l'efficacité de la gestion des données.

Pourquoi j'ai choisi Hevo : Conçue sur une architecture basée sur Kafka, Hevo fournit des données avec une faible latence, garantissant que vos analyses et décisions métier s'appuient sur les informations les plus récentes. Ce traitement en temps réel est essentiel pour les applications qui exigent des données actualisées. Avec plus de 150 connecteurs prêts à l'emploi, la plateforme facilite l'extraction et l'intégration de données provenant de divers environnements, soutenant les entreprises qui dépendent de sources multiples. De plus, Hevo détecte automatiquement le schéma de vos données sources et le réplique vers votre destination, maintenant ainsi la synchronisation de votre entrepôt de données même si la structure de la source évolue.

Fonctionnalités et intégrations clés de Hevo :

Les fonctionnalités comprennent des transformations de données avant et après le chargement, vous permettant de nettoyer, formater et standardiser vos données, soit avant leur arrivée dans l'entrepôt, soit après, afin de garantir qu'elles soient prêtes pour l'analyse. Hevo propose également une API REST, qui permet de l'intégrer à vos workflows existants et de déclencher des pipelines de façon programmatique.

Intégrations : incluent MongoDB, Google Analytics, Salesforce, HubSpot, Azure Synapse Analytics, BigQuery, Snowflake, Redshift, Mailchimp, Klaviyo, WordPress, Pipedrive et bien d'autres.

Pros and Cons

Pros:

- La plateforme prend en charge une large gamme de sources de données

- Synchronisation des données en temps réel

- Gestion automatisée des schémas et gestion des erreurs

Cons:

- Modifier les pipelines existants peut être complexe

- La tarification peut poser problème aux petites entreprises

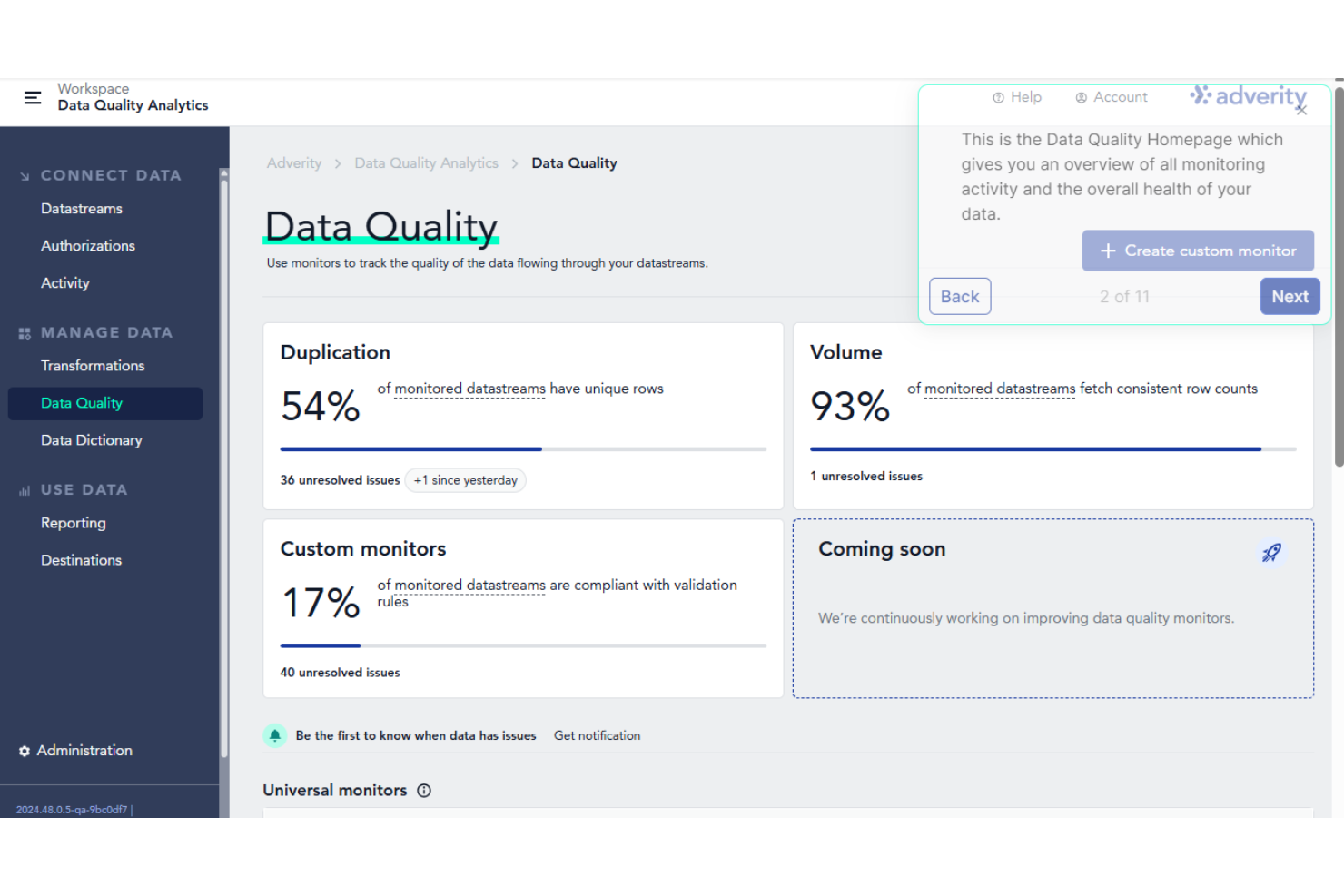

Adverity est une plateforme de données conçue pour aider les équipes à gérer et à comprendre leurs données. Elle propose des outils pour collecter, traiter et distribuer des données, visant à faciliter le travail des utilisateurs avec leurs informations.

Pourquoi j'ai choisi Adverity : J'ai choisi Adverity car il permet d'extraire des données de multiples sources, de les transformer selon vos propres règles, et de les charger vers les destinations de votre choix. Sa fonctionnalité de connexion permet de réunir toutes vos données, vous offrant une vue complète de ce avec quoi vous travaillez. La fonction de transformation est utile pour nettoyer et standardiser les données avant l'analyse, ce qui est essentiel dans tout flux de travail ETL. Vous pouvez également automatiser ces étapes afin d'assurer le bon fonctionnement des pipelines de données. Ces capacités en font une excellente solution pour les équipes souhaitant gérer les processus ETL plus efficacement.

Fonctionnalités et intégrations clés d'Adverity :

Fonctionnalités : la surveillance, qui aide les utilisateurs à suivre le statut et la qualité de leurs données. Cela permet d'identifier d'éventuels problèmes ou incohérences dans les données. De plus, la fonction de partage permet aux équipes de distribuer leurs données vers différentes destinations, facilitant la collaboration et l'analyse approfondie.

Les intégrations comprennent Google, Meta, TikTok, Google BigQuery, Looker Studio, Facebook Ads, Amazon Advertising, Hubspot, Salesforce, Amazon S3, Snowflake et Microsoft Azure.

Pros and Cons

Pros:

- Surveillance automatisée de la qualité des données

- Peut harmoniser les données provenant de diverses sources

- Permet de créer des tableaux de bord personnalisés

Cons:

- Certaines configurations peuvent nécessiter des connaissances techniques

- La configuration initiale peut prendre du temps

New Product Updates from Adverity

Adverity Enhances Connectors and Adds TikTok GMV Max

Adverity updates connectors for Amazon Ads, SmartNews Ads, Indeed, and monday.com, and introduces the TikTok GMV Max connector. These updates improve data accuracy, control, and performance across integrations. For more information, visit Adverity’s official site.

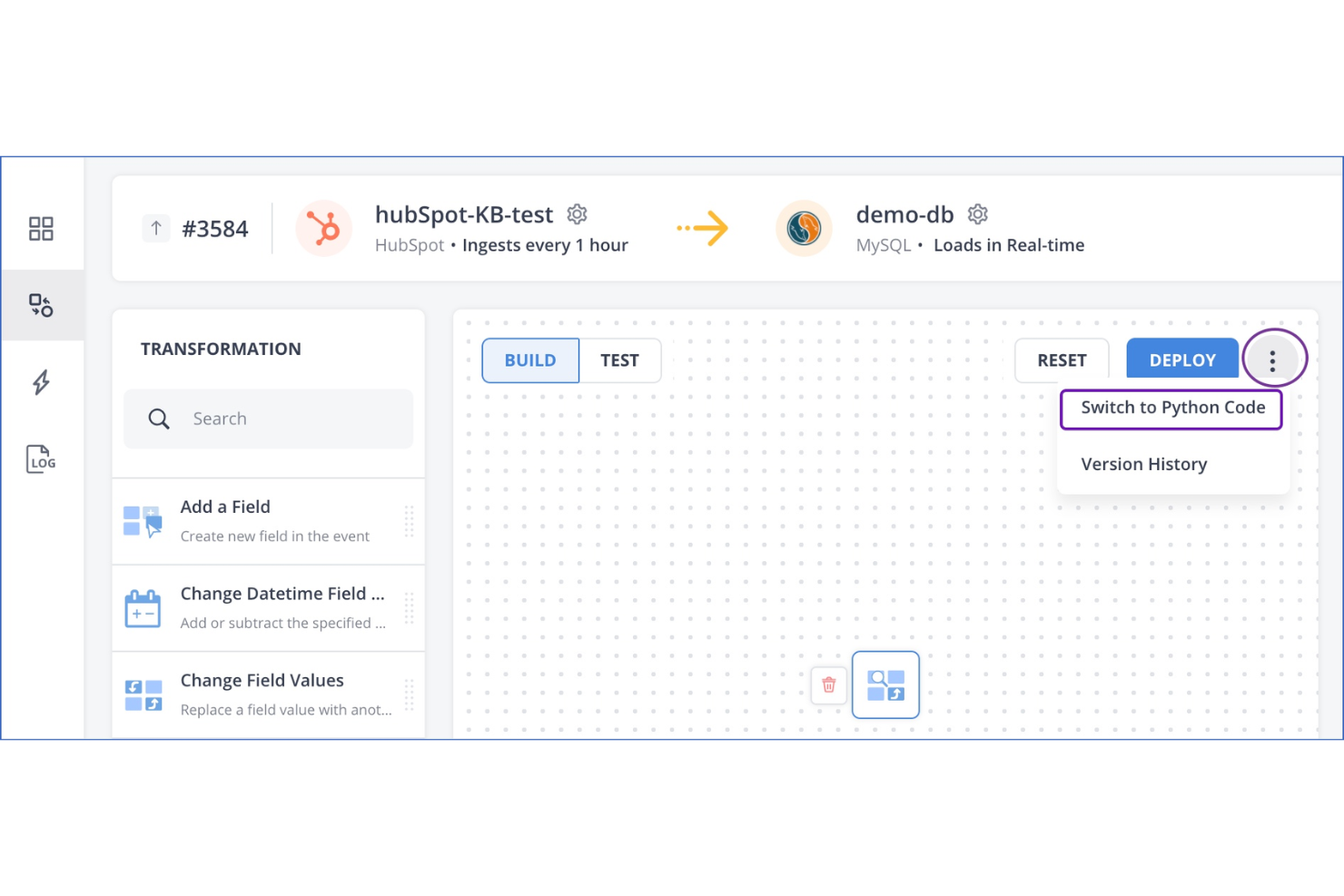

Integrate.io est une plateforme ETL basée sur le cloud conçue pour vous aider à organiser et préparer vos données pour l'analyse et l'intelligence d'affaires. Elle propose un environnement low-code qui simplifie la création et la gestion de pipelines à travers un large éventail de sources, y compris les bases de données relationnelles, les magasins NoSQL, les systèmes de fichiers, les stockages d'objets et les plateformes publicitaires.

Pourquoi j'ai choisi Integrate.io : Une des raisons pour lesquelles j'ai sélectionné Integrate.io est son support de plus de 220 transformations intégrées. Cette vaste bibliothèque permet à votre équipe d'effectuer des manipulations complexes de données sans écrire de code, ce qui facilite la préparation des données pour l'analyse. Sa couche de transformation low-code réduit également le besoin en SQL ou en scripts, offrant ainsi de la flexibilité tant pour les utilisateurs techniques que non techniques.

Fonctionnalités et intégrations remarquables d'Integrate.io

Fonctionnalités : prise en charge des cas d'usage ETL opérationnels, comme l'automatisation des intégrations bidirectionnelles avec Salesforce et le partage de fichiers B2B. Elle gère aussi les déploiements multi-cloud et multi-régions (États-Unis, UE, APAC), aidant ainsi les équipes distribuées à répondre aux besoins de performance et de conformité.

Intégrations : Salesforce, HubSpot, Google Analytics, Facebook Ads, Amazon Redshift, Google BigQuery, Amazon S3, Snowflake, MySQL, PostgreSQL, Microsoft Azure SQL Database et MongoDB.

Pros and Cons

Pros:

- Environnement low-code réduisant le besoin de scripts

- Fonctionnalités de sécurité avancées et respect des normes de conformité

- Accès à l’API REST pour l’automatisation

Cons:

- Peut tout de même nécessiter une courbe d’apprentissage pour les utilisateurs non techniques

- Des problèmes de performance peuvent survenir avec de grands volumes de données

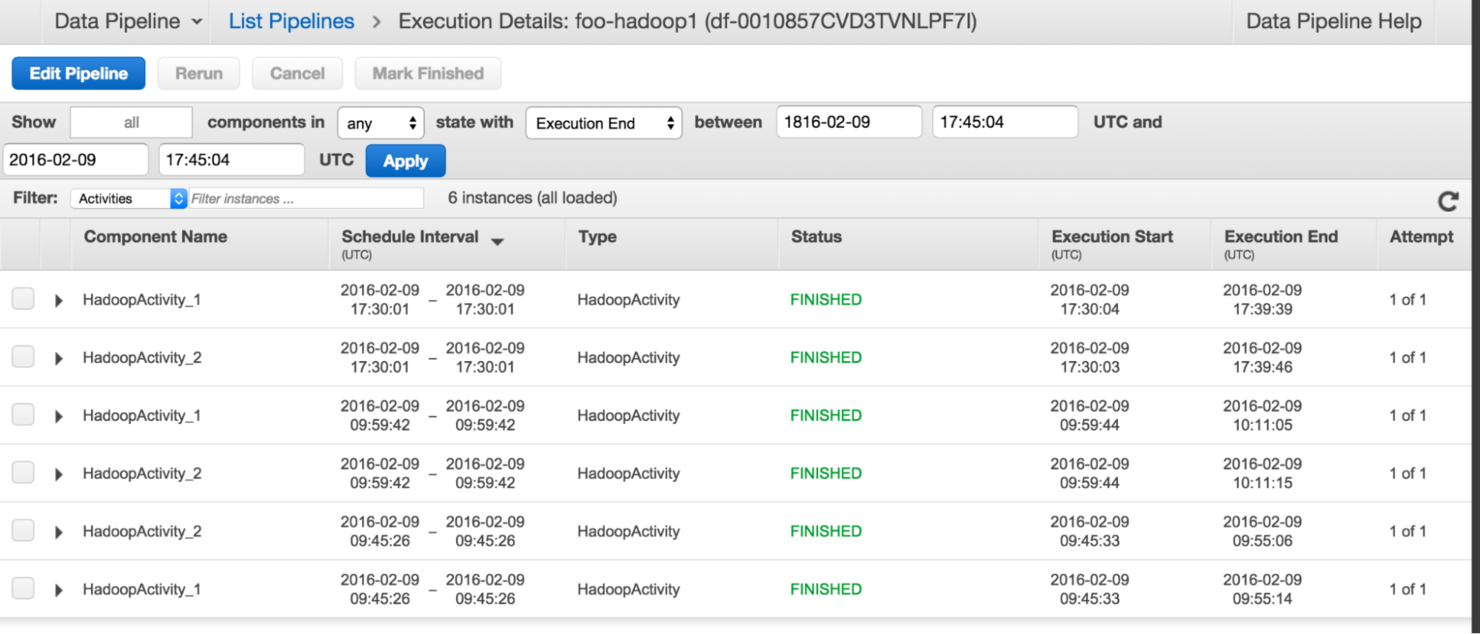

AWS Data Pipeline est un outil ETL géré qui vous permet de transférer des données entre les services AWS et d'autres ressources sur site. Il vous permet de spécifier les données à déplacer, de définir des tâches de transformation ou des requêtes, et de programmer l'exécution de ces transformations.

Pourquoi j'ai choisi AWS Data Pipeline : Ce que j'apprécie particulièrement avec AWS Data Pipeline, c'est sa console conviviale de type glisser-déposer, qui simplifie la création et la gestion des pipelines. L'outil propose également des fonctionnalités de tolérance aux pannes et de personnalisation, assurant ainsi des opérations fluides sur les pipelines de données.

Fonctionnalités phares et intégrations d'AWS Data Pipeline :

Les fonctionnalités d'AWS Data Pipeline qui m'ont marqué sont son interface de type glisser-déposer et sa grande tolérance aux pannes. Cette fonction rend la console particulièrement agréable à utiliser, tandis que la tolérance aux pannes supplémentaire permet de limiter l'impact des erreurs humaines.

Les intégrations disponibles pour AWS Data Pipeline incluent Redshift, SQL et DynamoDB. Ces connecteurs sont accessibles en tant qu'options préconfigurées sur la plateforme.

Pros and Cons

Pros:

- Console intuitive de type glisser-déposer simplifiant les processus

- Permet de spécifier les données que vous souhaitez déplacer

- Grande tolérance aux pannes et capacités de personnalisation

Cons:

- La gestion des données peut s'avérer chronophage

- Ne prend pas en charge les données tierces

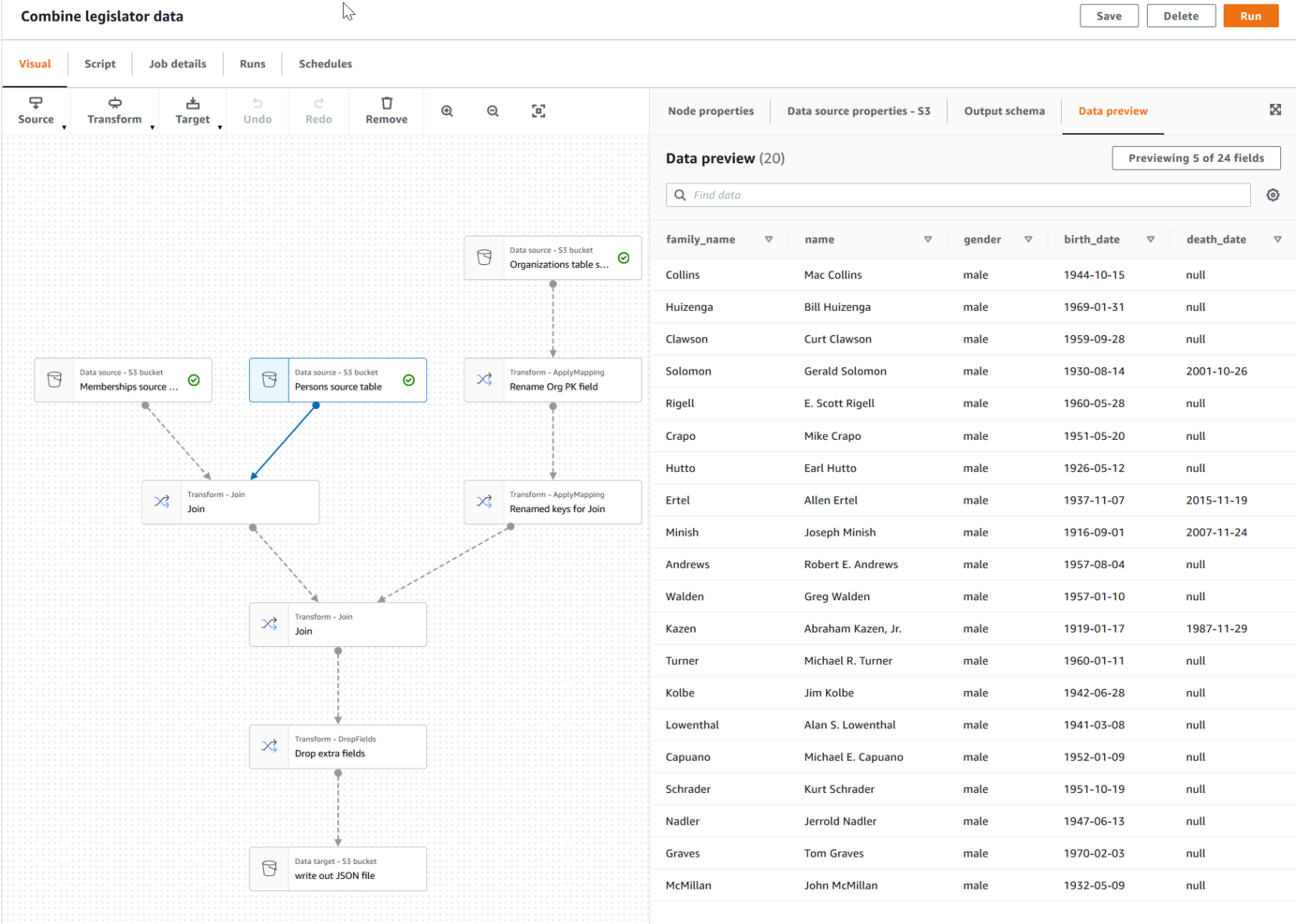

AWS Glue offre un accès à un service d'intégration de données sans serveur qui simplifie le processus de découverte, de préparation, de gestion et d'intégration des données provenant de différentes sources. Son interface visuelle vous permet de faciliter le chargement des données dans vos lacs de données, garantissant ainsi que les données sont facilement disponibles pour l'analyse.

Pourquoi j'ai choisi AWS Glue : J'ai choisi AWS Glue pour son accès à plus de 70 sources de données, tout en gérant efficacement vos données à l'aide d'un catalogue centralisé. Il peut même s'adapter, évoluer à la hausse ou à la baisse, en fonction des besoins actuels de votre organisation. Ce sont ces capacités qui font que je considère AWS Glue comme le meilleur outil ETL sans serveur de cette liste.

Fonctionnalités et intégrations remarquables d'AWS Glue :

Les fonctionnalités d'AWS Glue qui m'ont marqué sont son accès à de multiples magasins de données et sa capacité à construire des pipelines ETL complexes. Pouvoir exploiter différentes sources de données facilite la collecte de renseignements métier tandis que le développement de pipelines complexes permet d’obtenir des analyses plus approfondies.

Les intégrations pour AWS Glue incluent MySQL, Oracle, Redshift, Amazon S3 et bien d'autres. Tous ces connecteurs sont préinstallés lorsque vous choisissez la plateforme.

Pros and Cons

Pros:

- Les tâches échouées dans AWS Glue peuvent être récupérées

- Offre un filtrage des données défectueuses

- Maintenance et déploiement aisés

Cons:

- Manque de compatibilité avec des sources de données couramment utilisées

- Pas le meilleur choix pour les tâches ETL en temps réel

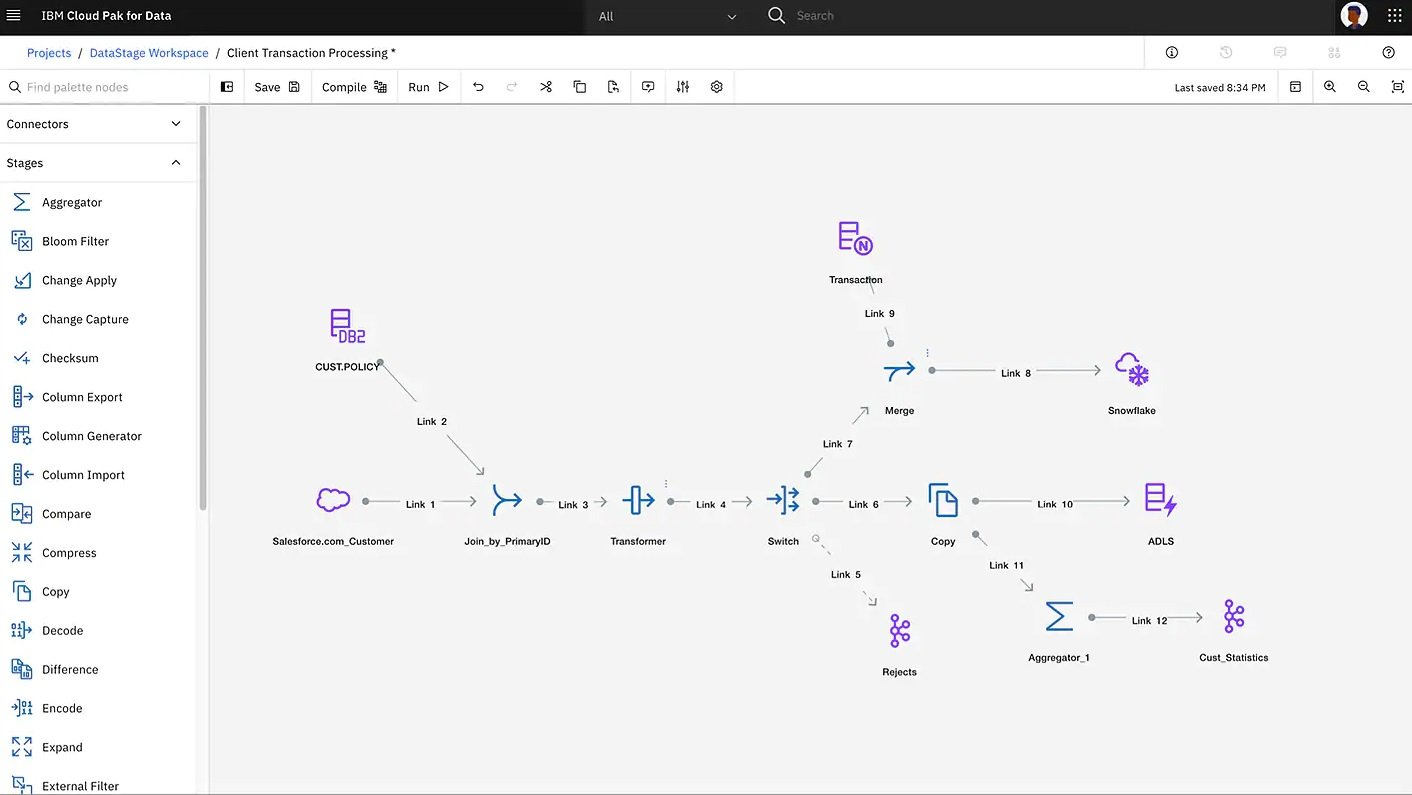

IBM DataStage est un outil ETL qui vous permet d'extraire, de transformer, d'appliquer des règles métier et de charger facilement les données dans toute cible souhaitée. Il dispose d'une version de base du logiciel que vous pouvez installer sur site et d'une mise à niveau qui vous permet de réduire le temps et les coûts d'intégration des données.

Pourquoi j'ai choisi IBM DataStage : J'ai choisi IBM DataStage car c'est un outil d'intégration qui excelle dans l'intégration de données provenant d'un large éventail de sources d'entreprise et externes. J'apprécie sa capacité à gérer le traitement et la transformation de gros volumes de données grâce à son approche évolutive de traitement en parallèle.

Fonctionnalités et intégrations remarquables d'IBM DataStage :

Les fonctionnalités d'IBM DataStage qui m'ont marqué sont la science des données et l'équilibrage de charge automatisé. J'ai constaté que sa fonctionnalité de science des données me permet de rapidement tirer des insights de mes données, tandis que l'équilibrage de charge automatisé m'aide à obtenir le meilleur rendement.

Les intégrations sont disponibles avec Amazon S3, Azure, BDFS, BigQuery et FTP Enterprise. Vous pouvez également vous connecter à des sources de données comme IBM Db2 Warehouse on Cloud et IBM Netezza et transférer des données. Toutes ces intégrations sont préconstruites dans la plateforme.

Pros and Cons

Pros:

- L'équilibrage de la charge permet d'exécuter les charges de travail plus rapidement

- Réduction des coûts de déplacement des données

- Accès aux services d'IA

Cons:

- Manque d'automatisation pour la gestion et la récupération des erreurs

- La modification des colonnes peut être fastidieuse

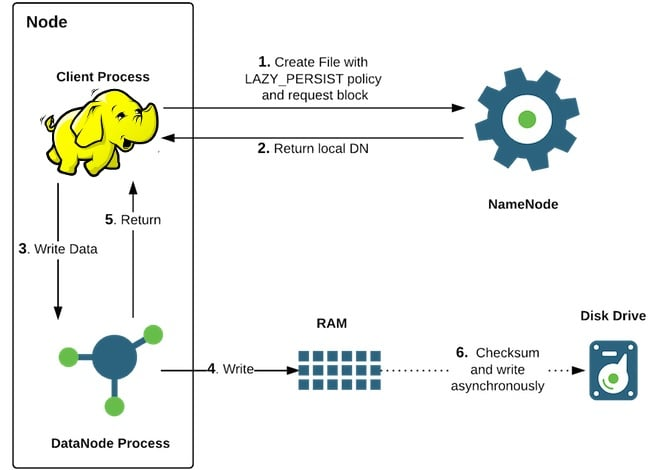

Hadoop est un outil ETL open source qui vous permet de stocker et de traiter des données. Au lieu de s’appuyer sur un seul ordinateur, ce logiciel vous permet de regrouper plusieurs appareils, ce qui permet une analyse rapide et un stockage de très grands volumes de données.

Pourquoi j’ai choisi Hadoop : J’ai choisi Hadoop car il offre un accès à une capacité de stockage étendue capable d’accueillir tout type de données. L’outil propose une puissance de traitement immense, vous permettant de gérer un nombre extraordinaire de tâches ou de jobs simultanés.

Fonctionnalités et intégrations phares de Hadoop :

Les fonctionnalités de Hadoop qui m’ont marqué sont la planification des jobs en cluster et l’accès aux bibliothèques Java courantes. J’ai constaté que ces fonctionnalités permettaient à la plateforme de traiter rapidement de grands ensembles de données, ce qui correspond bien à sa grande capacité de stockage.

Les intégrations pour Hadoop comprennent MySQL, PostgreSQL et Oracle. Tous ces connecteurs sont pré-intégrés à la plateforme.

Pros and Cons

Pros:

- Peut traiter simultanément d’énormes volumes de données

- Peut gérer tout type de jeu de données

- Outil ETL hautement évolutif

Cons:

- Le framework Java peut être facilement exploité

- Non adapté aux petits ensembles de données

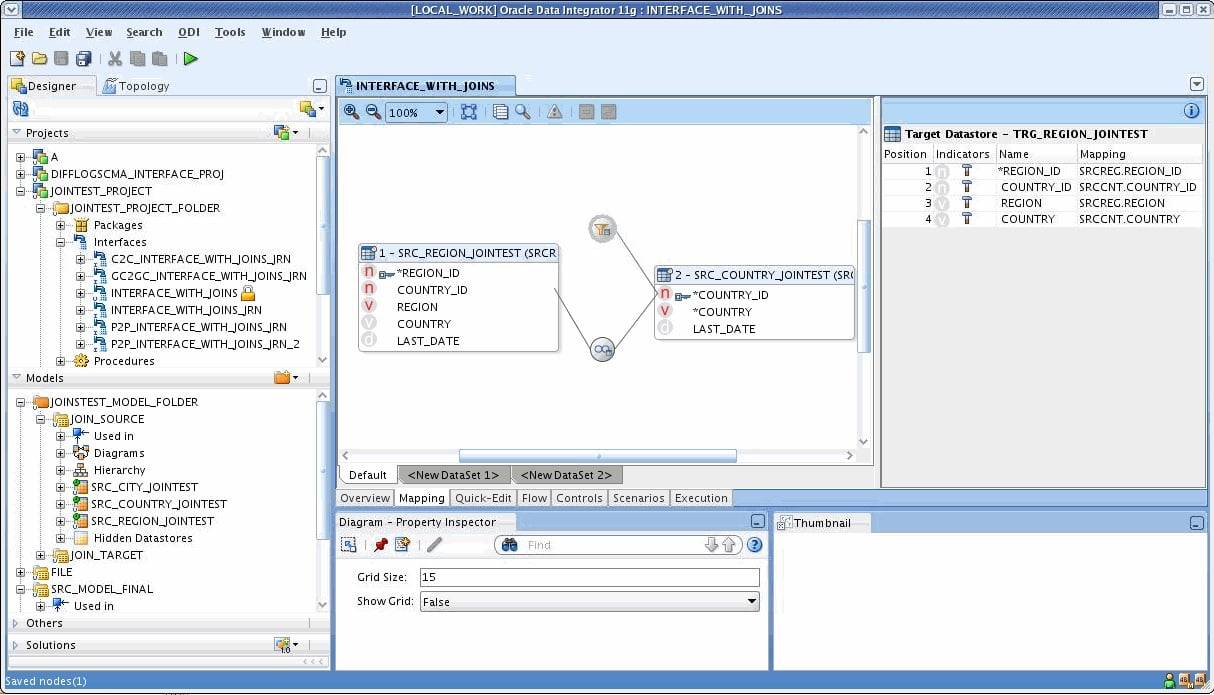

Oracle Data Integrator répond à divers besoins d'intégration de données. Il prend en charge aussi bien les chargements par lots à grande échelle avec des performances élevées que l'intégration en temps réel basée sur les événements, et même les services de données activés par SOA.

Pourquoi j'ai choisi Oracle Data Integrator : J'ai choisi Oracle Data Integrator car il offre une gamme de connecteurs préconfigurés qui permettent de lier facilement différentes bases de données. Il permet de se connecter aisément à Hadoop, EREP, CRM, XML, JSON, LDAP, JDBC et ODBC, dès l'installation.

Fonctionnalités et intégrations remarquables d’Oracle Data Integrator :

Les fonctionnalités d’Oracle Data Integrator qui m'ont marqué sont sa plateforme d'intégration active et sa capacité à permettre aux développeurs de créer leurs propres mappages via une logique métier standard. L'intégration active permet des intégrations de données basées sur les données, les événements et les services, tandis que la seconde donne la possibilité de produire du code pour une large variété de technologies de traitement de données.

Les intégrations sont disponibles avec des plateformes d’entrepôt de données telles qu’Oracle, Teradata, IBM DB2, Sybase et Exadata. Vous pouvez également l'utiliser avec d'autres technologies comme les ERP, XML et LDAP. Toutes ces intégrations sont préconfigurées dans la plateforme.

Pros and Cons

Pros:

- Architecture efficace qui utilise à la fois les serveurs source et cible

- Détecte automatiquement les données erronées avant l’insertion dans l’application

- Compatible avec toutes les plateformes, matériels et systèmes d'exploitation

Cons:

- Difficile à apprendre et nécessite une formation

- L’interface utilisateur peut être complexe

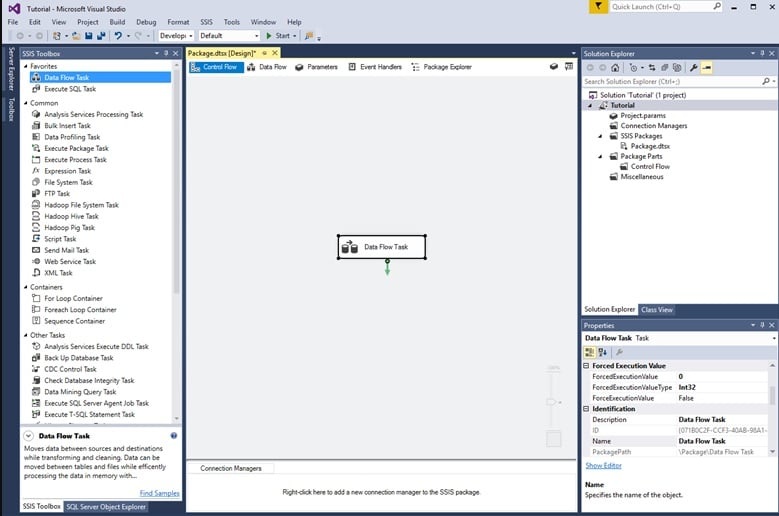

Microsoft SQL Server Integration Services, simplement appelé Microsoft SSIS, est un outil d'entreprise qui intègre, transforme et migre les données au sein de la base de données SQL Server de Microsoft. Il offre des fonctionnalités liées à l'intégration telles que l'analyse de données, le nettoyage, et l'exécution de processus ETL pour mettre à jour les entrepôts de données.

Pourquoi j'ai choisi Microsoft SSIS : Une des principales raisons pour lesquelles j'ai choisi SSIS est sa polyvalence, car il prend en charge divers types de bases de données comme SQL, DB2 et Oracle. Cette flexibilité permet aux utilisateurs de combiner des données provenant de différentes sources, tandis que son interface graphique facilite la réalisation des tâches d'entreposage et des transformations de données.

Fonctionnalités et intégrations remarquables de Microsoft SSIS :

Les fonctionnalités de Microsoft SSIS qui m'ont marqué sont ses outils graphiques et sa base de données catalogue intégrée. Les outils graphiques permettent de développer facilement des packages, tandis que la base de données catalogue SSIS facilite la gestion des projets, des paramètres et des environnements. J'ai également apprécié la possibilité d'importer des données issues de différentes sources et de les transformer selon vos besoins.

Des intégrations sont disponibles pour Microsoft SSIS avec ADO, DQS, Excel, FTP, HTTP, WMI, et plus encore. Ces connecteurs sont préinstallés sur la plateforme. Vous pouvez également télécharger d'autres types de gestionnaires de connexions depuis leur site internet.

Pros and Cons

Pros:

- Un outil ETL et de transformation de données flexible

- L’interface est facile à utiliser et à configurer

- Fournit aux utilisateurs de nombreuses fonctionnalités de documentation

Cons:

- Manque d'options d'intégration avec d'autres outils

- Compatible uniquement avec Microsoft Windows

Autres outils ETL

En plus de ceux ci-dessus, j’ai aussi sélectionné quelques autres outils ETL qui méritent d’être découverts :

- SAS Data Management

Idéal pour les grandes entreprises

- Fivetran

Meilleure connectivité de données

- Talend Open Studio

Meilleur temps de traitement des données

- Informatica PowerCenter

Idéal pour le parsing de formats de données avancés

- Pentaho Data Integration

Meilleure interface conviviale

- Stitch Data

Idéal pour les pipelines de données automatisés

Autres tests de logiciels IT

Si vous n'avez pas encore trouvé ce que vous cherchez ici, consultez ces outils proches de la gestion des API, que nous avons testés et évalués.

- Logiciels de supervision réseau

- Logiciels de supervision de serveurs

- Solutions SD-WAN

- Outils de supervision d’infrastructure

- Analyseurs de paquets réseau

- Outils de supervision applicative

Critères de sélection pour les outils ETL

Pour choisir les outils ETL, je me concentre sur leur fonctionnalité et sur la façon dont ils répondent à des besoins métiers spécifiques. Mes critères sont basés sur des recherches approfondies et une expérience pratique variée avec différentes solutions ETL. Voici un aperçu de ma méthodologie pour sélectionner les outils à inclure dans cette liste :

Fonctionnalités ETL de base : 25 % de la note totale

Pour figurer dans ma liste des meilleurs outils ETL, la solution devait répondre à un ou plusieurs des cas d’usage courants suivants :

- Intégration efficace de données depuis des sources diverses

- Transformations de données à grande échelle

- Automatisation des flux de données

- Traitement des données et analyses en temps réel

- Assurance qualité et conformité des données

Fonctionnalités distinctives supplémentaires : 25 % de la note totale

- Outils offrant une logique avancée de transformation des données, tels que la correspondance floue et les fonctionnalités d'apprentissage automatique pour la modélisation prédictive.

- Solutions dotées de nombreux connecteurs préconfigurés vers de nouvelles sources de données émergentes comme les appareils IoT ou les plateformes blockchain.

- Plateformes ETL fournissant des outils uniques de visualisation des données pour surveiller les flux et performances en temps réel.

- Approches innovantes en matière de gouvernance et conformité des données, garantissant que les données sont non seulement sécurisées mais aussi conformes aux normes réglementaires mondiales.

- Des exemples incluent des outils qui exploitent l'IA pour améliorer la vérification de la qualité des données ou des plateformes offrant des options de personnalisation approfondies permettant aux entreprises d’adapter l’outil à leurs besoins spécifiques.

Facilité d'utilisation : 10% du score total de pondération

- Interfaces qui simplifient les processus complexes, telles que la fonctionnalité glisser-déposer pour concevoir des pipelines de données.

- Conceptions de tableaux de bord claires et intuitives offrant un accès rapide aux fonctionnalités fréquemment utilisées.

- Design réactif adapté à différents appareils, permettant aux utilisateurs de gérer les tâches ETL en mobilité.

Intégration des utilisateurs : 10% du score total de pondération

- Disponibilité de supports de formation complets, tels que tutoriels vidéo, documentation et visites interactives du produit.

- Modèles et workflows préconfigurés pour aider les nouveaux utilisateurs à démarrer rapidement face aux défis et tâches courants de l’ETL.

- Accès au support client ou aux forums communautaires lors de l’intégration pour garantir une transition fluide et une résolution immédiate des problèmes.

Support client : 10% du score total de pondération

- Offre de divers canaux de support, incluant chat en direct, assistance téléphonique et email, pour s’adapter aux préférences des utilisateurs.

- Support proactif, tel que des suivis réguliers et des mises à jour sur les nouvelles fonctionnalités ou les meilleures pratiques.

- Une équipe d'assistance compétente et réactive, à même de répondre aux questions techniques et opérationnelles.

Rapport qualité/prix : 10% du score total de pondération

- Modèles de tarification transparents alignés avec les fonctionnalités et la scalabilité offertes.

- Considération de la valeur à long terme grâce à des formules flexibles évolutives selon les besoins de l'utilisateur.

- Essais gratuits ou démos permettant aux utilisateurs d’évaluer l’efficacité de l’outil avant tout engagement financier.

Avis clients : 10% du score total de pondération

- Notes constamment élevées dans les domaines clés des processus ETL, comme la fiabilité, les performances et la satisfaction des utilisateurs.

- Retours positifs sur la facilité d’utilisation et la réactivité du support client.

- Avis soulignant des cas d’usage réussis similaires aux besoins de l’acheteur, montrant la capacité de l’outil à résoudre des problèmes spécifiques.

Ce cadre d’évaluation garantit une analyse approfondie des outils ETL, en mettant l’accent aussi bien sur leurs fonctionnalités de base que sur les aspects additionnels qui les distinguent sur le marché, tels que les outils d’automatisation des tests ETL. Il prend en compte l’ensemble des préoccupations des acheteurs, depuis l’intégration initiale jusqu’à la valeur à long terme, afin de s’assurer que l’outil ETL sélectionné réponde non seulement à vos besoins immédiats en gestion des données, mais accompagne également la croissance et la complexité futures.

Comment choisir les outils ETL

Au moment de présélectionner, tester et sélectionner vos outils ETL, tenez compte des points suivants :

- Quel problème essayez-vous de résoudre - Commencez par identifier la lacune fonctionnelle de gestion du pipeline ETL que vous cherchez à combler afin de clarifier les fonctionnalités et caractéristiques essentielles que l'outil doit offrir.

- Qui devra l’utiliser - Pour évaluer les coûts et les besoins, réfléchissez aux personnes qui utiliseront l'outil et au nombre de licences nécessaires. Il faut déterminer si seul le service data en aura besoin ou si l’ensemble de l’organisation nécessitera un accès. Une fois ce point éclairci, demandez-vous si vous privilégiez la facilité d’utilisation pour tous ou la rapidité pour vos utilisateurs techniques avancés.

- Avec quels autres outils il doit fonctionner - Précisez les outils que vous remplacez, ceux qui restent et ceux avec lesquels vous devrez intégrer. Cela peut inclure votre infrastructure ETL existante, diverses sources de données et votre ensemble technologique général. Vous devrez peut-être également décider si les outils devront s'intégrer entre eux ou, au contraire, si vous pouvez remplacer plusieurs outils par une solution ETL centralisée.

- Quels résultats sont importants - Évaluez quels résultats l’outil doit fournir pour être jugé efficace. Réfléchissez aux capacités que vous souhaitez acquérir ou améliorer, et comment vous mesurerez le succès. Vous pouvez comparer les fonctionnalités des outils ETL indéfiniment, mais si vous ne vous concentrez pas sur les résultats à obtenir, vous risquez de perdre un temps précieux.

- Comment il s’intégrera dans votre organisation - Évaluez les solutions en les replaçant dans vos flux de travail et votre méthodologie ETL. Analysez ce qui fonctionne bien et les points problématiques à corriger. Gardez à l’esprit que chaque entreprise est différente — ce n’est pas parce qu’un outil est populaire qu’il sera adapté à votre organisation.

Tendances des outils ETL

Dans mes recherches, j’ai consulté de nombreux communiqués produits, actualités, et journaux de version publiés par différents éditeurs d’outils ETL. Voici quelques-unes des tendances émergentes que je surveille de près :

- Traitement des données en temps réel : De plus en plus d’outils ETL évoluent du traitement par lots vers le traitement en temps réel, ce qui aide les entreprises à prendre des décisions plus rapides grâce à des données actualisées.

- Transformation des données par l’IA : Certains éditeurs ajoutent des capacités d’intelligence artificielle pour automatiser des tâches complexes de transformation des données, réduisant ainsi le besoin de codage manuel.

- Surveillance de la qualité des données : Les outils ETL commencent à intégrer des contrôles de validation et de qualité des données, permettant aux équipes d’identifier les erreurs et incohérences avant qu’elles n’impactent les systèmes en aval.

- ETL en libre-service : Les éditeurs cherchent à rendre les outils ETL plus accessibles, afin que des équipes métiers ne disposant pas d’expertise technique puissent gérer l'extraction et la transformation des données.

- Prise en charge hybride et multi-cloud : Avec la généralisation de l’utilisation de plusieurs plateformes cloud, les outils ETL s’adaptent pour offrir un meilleur support des environnements hybrides et multi-cloud.

Qu’est-ce qu’un outil ETL ?

Les outils ETL sont des logiciels qui permettent de déplacer des données issues de différentes sources, de les nettoyer, les formater et de les charger dans un système où elles pourront être exploitées. Ils sont utilisés par des ingénieurs data, des analystes et des équipes informatiques qui doivent préparer les données pour des rapports, des tableaux de bord ou du machine learning.

Des fonctionnalités telles que l’extraction des données, la définition de règles de transformation et la planification automatisée permettent de réduire le travail manuel, de corriger les erreurs et d’assurer la disponibilité des données quand elles sont nécessaires. Ces outils facilitent la manipulation des données sans avoir à tout développer de zéro.

Fonctionnalités des outils ETL

Voici quelques-unes des fonctionnalités les plus importantes que je recherche lors de l’évaluation des outils d’extraction, de transformation et de chargement (ETL) :

- Interface utilisateur intuitive (UI) : Une interface facile à utiliser et à comprendre simplifie la création et la gestion des processus ETL. Elle permet aux utilisateurs, quel que soit leur niveau de compétence technique, de travailler efficacement avec les données.

- Connectivité et intégration : La capacité à se connecter à un large éventail de sources et de destinations de données. Cette fonctionnalité est essentielle pour les entreprises qui collectent des données de plusieurs sources et doivent garantir une intégration transparente à travers les plateformes.

- Capacités de transformation des données : Des fonctionnalités puissantes de transformation de données permettent de convertir facilement les données au format requis. Ceci est vital pour préparer les données précisément pour l’analyse et le reporting.

- Automatisation et planification : Les outils proposant des fonctionnalités d’automatisation et de planification permettent d’exécuter les processus ETL à des moments prédéterminés ou en réponse à des déclencheurs spécifiques. Cela réduit l’intervention manuelle et garantit que les données sont toujours à jour.

- Scalabilité : La capacité à évoluer à la hausse ou à la baisse en fonction du volume de données et des besoins de calcul. Lorsque le volume de données augmente, un outil ETL évolutif peut gérer des charges accrues sans compromettre les performances.

- Traitement en temps réel : La prise en charge du traitement des données en temps réel permet aux entreprises de prendre des décisions basées sur les données les plus récentes. Ceci est crucial pour les applications sensibles au facteur temps nécessitant des données à la minute près.

- Qualité des données et nettoyage : Les fonctionnalités qui prennent en charge le nettoyage des données et garantissent la qualité sont essentielles. Elles aident à identifier et corriger les erreurs ou incohérences dans les données, assurant que seules des données fiables sont utilisées pour l’analyse.

- Sécurité : Des fonctionnalités de sécurité robustes, telles que le chiffrement des données et le contrôle d’accès, protègent les informations sensibles contre les accès non autorisés. La sécurité est incontournable pour être en conformité avec les réglementations et protéger les données de l’entreprise.

- Surveillance et journalisation : La capacité de surveiller les processus ETL en temps réel et de journaliser les activités pour disposer de pistes d’audit. Cela aide à résoudre les problèmes et garantit la transparence des opérations de données.

- Support et communauté : Un support client de qualité et une communauté d’utilisateurs active peuvent grandement aider à résoudre les problèmes et partager les bonnes pratiques. Ceci est bénéfique pour l’apprentissage continu et pour surmonter les défis liés à la gestion des pipelines ETL.

Avantages des outils ETL

Les outils ETL jouent un rôle crucial dans le paysage actuel des entreprises axées sur les données, permettant aux organisations de gérer efficacement d’importants volumes de données provenant de diverses sources. Ces outils simplifient le processus d’extraction des données, leur transformation au format utilisable, puis leur chargement dans un entrepôt ou autre solution de stockage de données. Voici cinq principaux avantages des outils ETL pour les utilisateurs et les organisations :

- Efficacité accrue : les outils ETL automatisent les processus d’extraction, de transformation et de chargement des données, réduisant considérablement le temps et l’effort nécessaires par rapport aux processus manuels. Cette automatisation permet aux entreprises de traiter rapidement de grands volumes de données, améliorant ainsi la productivité et l’efficacité opérationnelle.

- Amélioration de la qualité des données : en proposant des fonctions de nettoyage et de validation des données, les outils ETL contribuent à garantir l’exactitude et la fiabilité des informations. Une meilleure qualité des données se traduit par de meilleures décisions et peut considérablement réduire les coûts liés aux erreurs et inexactitudes.

- Scalabilité renforcée : les outils ETL sont conçus pour traiter des volumes de données variables, allant de petits ensembles à de très grands volumes, sans compromettre les performances. Cette évolutivité accompagne la croissance des entreprises, qui peuvent ainsi s’adapter à l’augmentation des volumes sans refonte complète de leur infrastructure de traitement des données.

- Intégration de données issues de multiples sources : les outils ETL peuvent extraire des données de sources variées, incluant bases de données, services cloud et applications, puis les consolider dans un référentiel unique. Cette capacité d’intégration permet aux entreprises d’obtenir une vision globale de leurs opérations, renforçant ainsi les capacités d’analyse et de reporting.

- Sécurité accrue des données : de nombreux outils ETL intègrent des fonctionnalités de sécurité avancées, telles que le chiffrement et le contrôle des accès, afin de protéger les informations sensibles lors des traitements. Cette sécurité renforcée aide les organisations à respecter la réglementation sur la protection des données et à se prémunir contre les violations de données.

Coûts & tarification des outils ETL

Lorsqu’on se lance dans le choix d’outils ETL, il est essentiel pour les acheteurs de logiciels, en particulier ceux qui ont peu ou pas d’expérience, de comprendre les différentes options de plans et de tarification disponibles. Les prix et les offres varient fortement en fonction des fonctionnalités, de l’évolutivité, du support et d’autres facteurs.

Tableau comparatif des plans pour les outils ETL

Voici un aperçu détaillé des options de plans courants pour les outils ETL, afin de vous aider à prendre une décision éclairée conforme aux besoins de votre organisation et à vos contraintes budgétaires.

| Type de plan | Prix moyen | Fonctionnalités courantes | Idéal pour |

|---|---|---|---|

| Gratuit | $0 | Accès aux fonctionnalités ETL de base, traitement de volumes de données limités, support communautaire. | Petites entreprises ayant des besoins d'intégration de données minimes, développeurs individuels, amateurs de solutions open source |

| Basique | $500 - $2,000 / mois | Fonctionnalités ETL standards, prise en charge de multiples sources de données, support par email, capacités de transformation de données basiques. | Startups, petites et moyennes entreprises avec des besoins croissants en données, organisations avec des ressources informatiques limitées |

| Professionnel | $2,001 - $10,000 / mois | Transformations de données avancées, traitement des données en temps réel, capacité de volumes de données plus élevés, support client prioritaire. | Entreprises de taille moyenne avec des exigences complexes en matière d'intégration de données, grandes entreprises disposant de multiples sources et formats de données |

| Entreprise | $10,001+ / mois | Solutions ETL personnalisées, support dédié, volume de données illimité, fonctionnalités de sécurité avancées, accès API. | Grandes entreprises avec de très gros volumes de données, besoins complexes d'intégration, exigences élevées en matière de sécurité |

FAQ sur les outils ETL

Vous trouverez ci-dessous les réponses aux questions les plus fréquemment posées sur les outils ETL :

Comment mettez-vous en œuvre un outil ETL ?

Comment les outils ETL garantissent-ils la sécurité des données ?

Les outils ETL peuvent-ils gérer de gros volumes de données ?

Combien coûtent les outils ETL ?

Comment optimiser les performances ETL ?

Comment choisir l'outil ETL adapté à vos besoins ?

Et après ?

Si vous êtes en train de rechercher des outils ETL, contactez gratuitement un conseiller SoftwareSelect pour des recommandations personnalisées.

Vous remplissez un formulaire et discutez rapidement afin de préciser vos besoins. Vous recevrez ensuite une liste restreinte de logiciels à examiner. Ils vous accompagneront même tout au long du processus d'achat, y compris lors des négociations de prix.