Meilleures solutions ETL en bref

Voici ma sélection des meilleurs outils ETL :

Les meilleurs outils ETL aident les équipes à extraire automatiquement des données depuis plusieurs sources, à les nettoyer et à les formater, puis à les charger dans des entrepôts de données ou des systèmes d’analytique, pour obtenir des informations en temps réel. Ils facilitent la gestion de jeux de données fiables et cohérents, tout en réduisant le temps consacré à la manipulation manuelle des données et à la maintenance fastidieuse des pipelines.

Les équipes se mettent généralement à rechercher des solutions ETL lorsqu’elles passent trop de temps à réparer des pipelines défaillants, à gérer des formats de données incompatibles ou à attendre des heures que les rapports se mettent à jour. Les processus manuels et les scripts hérités ne peuvent souvent plus suivre la cadence et le volume actuels des données, ce qui entraîne des retards, des erreurs et des tableaux de bord peu fiables.

J’ai accompagné des équipes d’ingénierie de la donnée et d’analytique pour implémenter et optimiser des workflows ETL, sur le cloud comme sur site, en testant les outils pour leur scalabilité, la flexibilité de leurs transformations et la facilité d’intégration dans des architectures data modernes.

Dans ce guide, vous découvrirez quelles plateformes ETL permettent réellement d’accélérer, de fiabiliser et de simplifier vos opérations de données, sans ajouter de complexité inutile.

Table of Contents

Why Trust Our Software Reviews

Résumé des meilleures solutions ETL

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Idéal pour intégrer des feuilles de calcul avec des sources de données | Offre gratuite + démo gratuite disponible | À partir de 49 $/mois (facturé annuellement) | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6 -

Pulumi

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8

Avis sur les meilleurs outils ETL

Vous trouverez ci-dessous mes résumés détaillés des meilleurs outils ETL ayant intégré ma sélection. Mes avis présentent un aperçu complet des fonctionnalités clés, avantages et inconvénients, intégrations et cas d’usage recommandés pour chaque outil, afin de vous aider à trouver celui qui vous convient le mieux.

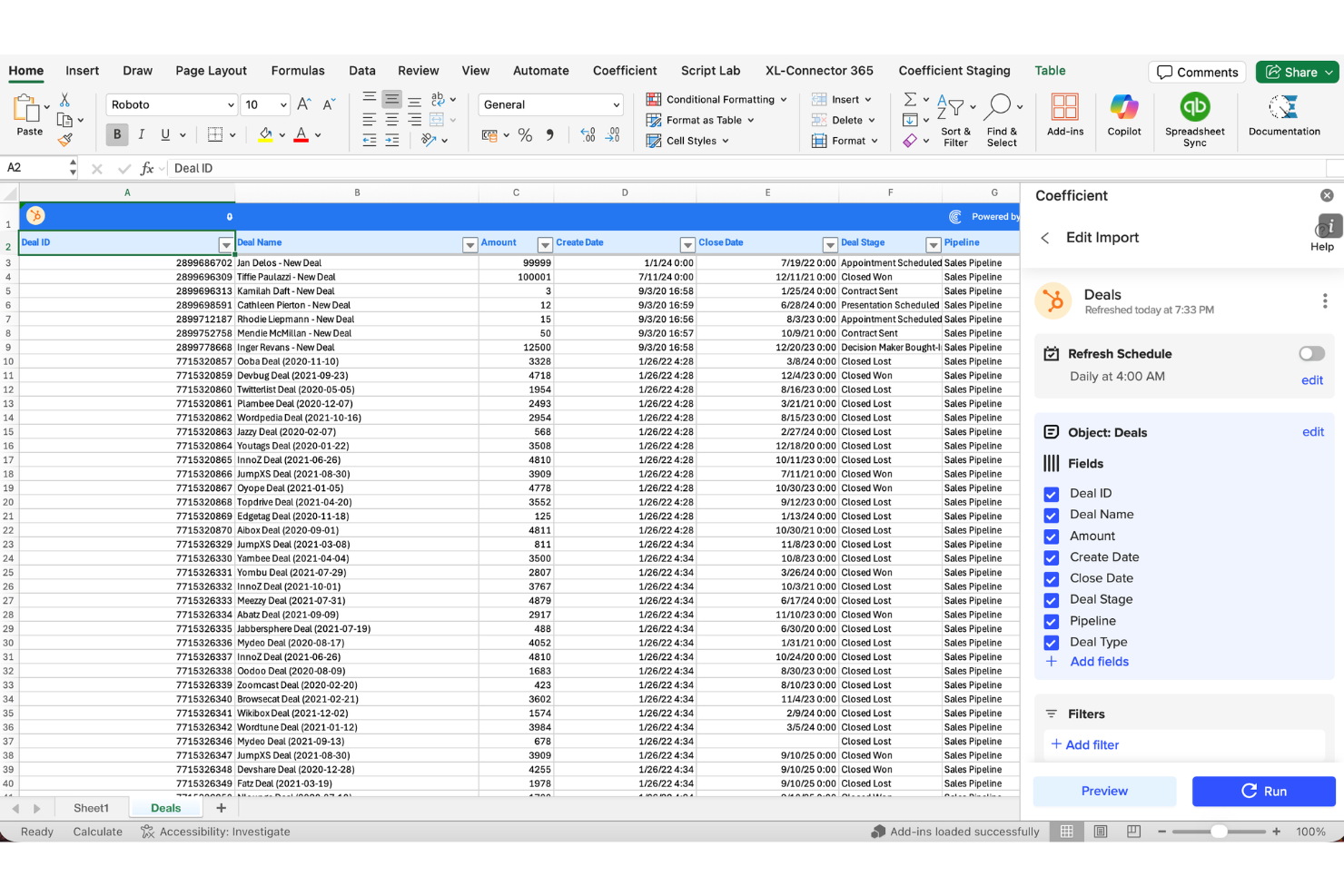

Pour les professionnels à la recherche de solutions ETL efficaces, Coefficient est un choix convaincant en intégrant Google Sheets et Excel à plus de 100 sources de données. Il s'adresse particulièrement aux entreprises des secteurs de la finance, du marketing et des opérations de revenus, où l'analyse de données en temps réel et l'automatisation sont essentielles. En éliminant le besoin de coder, Coefficient simplifie la création d'applications de données complexes, répondant ainsi aux défis de la gestion des données et de l'amélioration de la productivité.

Pourquoi j'ai choisi Coefficient

J'ai choisi Coefficient pour sa capacité unique à connecter des feuilles de calcul à un large éventail de sources de données, une fonctionnalité essentielle pour tout outil ETL. Ses fonctionnalités, telles que la conservation des formules et la création d'instantanés de données, se démarquent en permettant aux équipes de gérer et transformer les données sans effort. De plus, l'intégration d'outils comme Google Sheets Assistant et SQL Query Builder accompagne les utilisateurs dans des tâches de données complexes, sans nécessiter de compétences techniques approfondies. Ces atouts font de Coefficient un allié précieux pour les entreprises cherchant à optimiser leurs flux de données.

Principales caractéristiques de Coefficient

En plus de ses capacités d'intégration, Coefficient propose plusieurs fonctionnalités remarquables :

- Analyse de données en direct : Cette fonctionnalité permet à votre équipe de travailler avec des données en temps réel directement dans les feuilles de calcul.

- Tableaux de bord alimentés par l'IA : Créez des tableaux de bord dynamiques qui se mettent à jour automatiquement avec les dernières données et insights.

- Enrichissement automatisé des données : Améliorez la qualité et la profondeur des données sans intervention manuelle, économisant du temps et réduisant les erreurs.

- Création d'applications sans code : Développez des applications de données telles que des outils de suivi des commissions et des tableaux de bord marketing sans écrire la moindre ligne de code.

Intégrations de Coefficient

Les intégrations incluent Salesforce, QuickBooks, Snowflake, HubSpot, Google Analytics, Slack, Stripe, Shopify et bien d'autres.

Pros and Cons

Pros:

- Actualisations automatiques des données

- Permet la mise à jour de CRM en masse

- Préservation native des formules personnalisées dans les feuilles

Cons:

- Limité aux plateformes de type feuille de calcul

- Manque d'options de personnalisation avancées

Autres évaluations de logiciels IT

Si vous n’avez pas encore trouvé ce que vous cherchez, consultez ces outils liés à la gestion d’API, que nous avons testés et analysés.

- Logiciels de supervision réseau

- Logiciels de supervision de serveurs

- Solutions SD-WAN

- Outils de supervision d’infrastructure

- Analyseurs de paquets (Packet Sniffer)

- Outils de supervision applicative

Critères de sélection pour les outils ETL

Pour sélectionner des outils ETL, j’accorde une attention particulière à leurs fonctionnalités et à leur adéquation selon les cas d’usage envisagés. Mes critères reposent sur de nombreuses recherches personnelles et sur une expérience pratique approfondie avec différentes solutions ETL. Voici un aperçu de ma méthodologie pour choisir les outils à inclure dans ma sélection :

Fonctionnalités essentielles des outils ETL : 25 % de la note totale

Pour figurer dans ma sélection des meilleurs outils ETL, la solution devait couvrir au moins un des cas d’usage courants suivants :

- Intégration efficace des données à partir de sources hétérogènes

- Transformations de données à grande échelle

- Automatisation des workflows de données

- Traitement des données et analytique en temps réel

- Garantie de la qualité des données et conformité réglementaire

Fonctionnalités complémentaires remarquables : 25 % de la note totale

- Outils proposant des logiques avancées de transformation de données, telles que la correspondance approximative et des capacités d'apprentissage automatique pour la modélisation prédictive.

- Solutions avec de nombreux connecteurs préintégrés vers de nouvelles sources de données émergentes, comme les appareils IoT ou les plateformes blockchain.

- Plateformes ETL qui proposent des outils uniques de visualisation des données pour surveiller en temps réel les flux et la performance des données.

- Approches innovantes en matière de gouvernance et de conformité des données, garantissant non seulement la sécurité des données mais aussi leur conformité aux normes réglementaires mondiales.

- Parmi les exemples figurent des outils qui exploitent l’IA pour améliorer les contrôles de qualité des données ou des plateformes offrant des options de personnalisation poussées permettant aux entreprises d'adapter l'outil à leurs besoins spécifiques.

Facilité d'utilisation : 10 % du score de pondération total

- Interfaces simplifiant les processus complexes, comme la fonctionnalité glisser-déposer pour la conception des pipelines de données.

- Tableaux de bord clairs et intuitifs offrant un accès rapide aux fonctionnalités les plus utilisées.

- Design réactif adapté à tous les types d’appareils, permettant de gérer les tâches ETL en mobilité.

Embarquement : 10 % du score de pondération total

- Disponibilité de supports de formation complets, tels que des tutoriels vidéo, de la documentation et des visites interactives du produit.

- Modèles et workflows préconfigurés pour aider les nouveaux utilisateurs à se lancer rapidement sur les défis ETL courants.

- Accès à l’assistance client ou à des forums communautaires lors de l’intégration, pour assurer une transition fluide et une résolution immédiate des problèmes.

Support client : 10 % du score de pondération total

- Proposition de multiples canaux d’assistance (chat en direct, téléphone, e-mail) pour répondre aux préférences de chacun.

- Support proactif avec des suivis réguliers et des mises à jour sur les nouvelles fonctionnalités ou les meilleures pratiques.

- Une équipe de support compétente et réactive, capable de répondre aux questions techniques et opérationnelles.

Rapport qualité/prix : 10 % du score de pondération total

- Modèles de tarification transparents, en adéquation avec les fonctionnalités et l'évolutivité proposées.

- Pérennité via des plans flexibles, adaptés à l’évolution des besoins des utilisateurs.

- Essais gratuits ou démonstrations permettant d’évaluer l’efficacité de l’outil avant tout engagement financier.

Avis clients : 10 % du score de pondération total

- Notes constamment élevées sur les aspects fondamentaux des processus ETL, tels que la fiabilité, la performance et la satisfaction utilisateur.

- Retours positifs sur la facilité d’utilisation et la réactivité du support.

- Avis mettant en avant des cas d’utilisation réussis similaires à ceux de l’acheteur, ce qui indique la capacité de l’outil à résoudre des problématiques spécifiques.

Ce référentiel de critères permet d’évaluer les outils ETL de façon exhaustive, en se concentrant sur leurs fonctionnalités essentielles ainsi que sur les atouts qui les démarquent sur le marché, comme les outils d’automatisation de tests ETL. Il couvre l’ensemble des préoccupations des acheteurs, de la prise en main à la valeur sur le long terme, afin que l’outil ETL retenu réponde à vos besoins actuels en gestion des données et accompagne également la croissance et la complexité future.

Comment choisir des outils ETL

Pendant la présélection, l’essai et le choix des outils ETL, prenez en compte les éléments suivants :

- Quel problème essayez-vous de résoudre - Commencez par identifier le manque de fonctionnalités de gestion de pipeline ETL que vous souhaitez combler afin de clarifier les fonctionnalités et caractéristiques que l’outil doit fournir.

- Qui devra l'utiliser - Pour évaluer le coût et les besoins, réfléchissez à qui utilisera l’outil et combien de licences seront nécessaires. Il faut déterminer si cela concernera seulement le service data ou toute l’entreprise. Une fois cela clarifié, demandez-vous si vous souhaitez privilégier la simplicité d’utilisation pour tous ou la rapidité pour vos utilisateurs techniques expérimentés.

- Avec quels autres outils il doit fonctionner - Précisez quels outils vous remplacez, lesquels resteront en place, et avec quels outils il faudra s’intégrer. Cela peut inclure votre infrastructure ETL existante, diverses sources de données, et l’ensemble de votre stack technologique. Il sera peut-être utile aussi de déterminer si les outils devront fonctionner ensemble ou si un outil ETL consolidé pourra remplacer plusieurs outils.

- Quels résultats sont importants - Réfléchissez au résultat que l’outil doit atteindre pour être considéré comme un succès. Pensez à la capacité que vous souhaitez acquérir ou améliorer, et à la manière dont vous mesurerez le succès. Vous pouvez comparer les fonctionnalités des outils ETL indéfiniment, mais si vous ne réfléchissez pas aux résultats recherchés, vous risquez de perdre beaucoup de temps précieux.

- Comment il fonctionnerait dans votre organisation - Analysez les solutions par rapport à vos processus et à votre méthodologie ETL. Évaluez ce qui fonctionne bien, et les points problématiques qui doivent être adressés. Rappelez-vous que chaque entreprise est différente — ce n’est pas parce qu’un outil est populaire qu’il sera nécessairement adapté à votre organisation.

Tendances dans les outils ETL

Au cours de mes recherches, j’ai consulté de nombreuses mises à jour produits, communiqués de presse et journaux de versions de différents fournisseurs d’outils ETL. Voici quelques tendances émergentes que je surveille :

- Traitement des données en temps réel : De plus en plus d’outils ETL passent du traitement par lots au traitement en temps réel, permettant aux entreprises de prendre des décisions plus rapidement sur la base de données actualisées.

- Transformation des données assistée par l’IA : Certains fournisseurs ajoutent des capacités d’intelligence artificielle pour automatiser des tâches complexes de transformation des données, réduisant ainsi le besoin de codage manuel.

- Surveillance de la qualité des données : Les outils ETL commencent à intégrer la validation et le contrôle de qualité des données, permettant aux équipes de détecter les erreurs et incohérences avant qu’elles n’affectent les systèmes en aval.

- ETL en libre-service : Les éditeurs cherchent à rendre les outils ETL plus conviviaux afin que les équipes métier, même sans expertise technique, puissent gérer l’extraction et la transformation des données.

- Compatibilité hybride et multi-cloud : Avec l’essor des environnements multi-cloud, les outils ETL s’adaptent en offrant un meilleur support aux architectures hybrides et multi-cloud.

Que sont les outils ETL ?

Les outils ETL sont des logiciels qui servent à transférer des données depuis différentes sources, à les nettoyer et à les formater, puis à les charger dans un système où elles pourront être utilisées. Ils sont utilisés par les ingénieurs data, les analystes et les équipes informatiques qui doivent préparer les données pour du reporting, des tableaux de bord ou de l’apprentissage automatique.

Des fonctionnalités telles que l’extraction de données, les règles de transformation et la planification automatisée permettent de réduire le travail manuel, de corriger les erreurs et de garantir que les données soient prêtes lorsqu’on en a besoin. Ces outils facilitent la gestion des données sans avoir à tout développer soi-même.

Fonctionnalités des outils ETL

Voici quelques-unes des fonctionnalités les plus importantes que je recherche lors de l’évaluation d’outils d’extraction, de transformation et de chargement (ETL) :

- Interface utilisateur intuitive : Une interface facile à utiliser et à comprendre simplifie la création et la gestion des processus ETL. Elle permet aux utilisateurs ayant différents niveaux d’expertise technique de travailler efficacement avec les données.

- Connectivité et intégration : La capacité de se connecter à un large éventail de sources et destinations de données. Cette fonctionnalité est essentielle pour les entreprises qui collectent des données provenant de multiples sources et doivent garantir une intégration sans faille entre les plateformes.

- Capacités de transformation des données : De puissantes fonctions de transformation de données permettent de convertir facilement les données dans le format requis. Cela est vital pour préparer les données avec précision pour l’analyse et le reporting.

- Automatisation et planification : Les outils qui proposent des fonctions d’automatisation et de planification permettent aux processus ETL de s’exécuter à des moments prédéfinis ou en réponse à des déclencheurs spécifiques. Cela réduit l’effort manuel et garantit que les données sont toujours à jour.

- Évolutivité : La capacité à ajuster l'échelle en fonction du volume de données et des besoins en calcul. À mesure que les volumes de données augmentent, un outil ETL évolutif peut gérer des charges accrues sans compromettre les performances.

- Traitement en temps réel : Le support du traitement des données en temps réel permet aux entreprises de prendre des décisions sur la base des informations les plus récentes. C’est crucial pour les applications sensibles au temps, où des données actualisées à la minute près sont nécessaires.

- Qualité des données et nettoyage : Les fonctionnalités qui soutiennent le nettoyage des données et garantissent leur qualité sont essentielles. Elles permettent d’identifier et de corriger les erreurs ou incohérences dans les données, assurant que seules des données fiables soient utilisées pour l’analyse.

- Sécurité : Des fonctionnalités de sécurité robustes, incluant le chiffrement des données et des contrôles d’accès, protègent les informations sensibles contre les accès non autorisés. La sécurité est incontournable pour la conformité réglementaire et la protection des données métiers.

- Surveillance et journalisation : La capacité à surveiller les processus ETL en temps réel et à journaliser les activités pour assurer un suivi d’audit. Ceci est utile pour résoudre les problèmes et garantir la transparence des opérations de données.

- Support et communauté : Un support client de qualité et une communauté d’utilisateurs active peuvent grandement aider à résoudre les problèmes et à partager les meilleures pratiques. Cela est bénéfique pour l’apprentissage continu et pour surmonter les défis dans la gestion des pipelines ETL.

Bénéfices des outils ETL

Les outils ETL jouent un rôle crucial dans le paysage commercial moderne axé sur les données, permettant aux organisations de gérer efficacement de vastes volumes de données provenant de diverses sources. Ces outils rationalisent le processus d’extraction des données, de leur transformation en un format exploitable et de leur chargement dans un entrepôt de données ou autres solutions de stockage. Voici cinq principaux bénéfices des outils ETL pour les utilisateurs et les organisations :

- Efficacité accrue : Les outils ETL automatisent le processus d’extraction, de transformation et de chargement des données, réduisant considérablement le temps et l’effort requis par rapport aux processus manuels. Cette automatisation permet aux entreprises de traiter rapidement de grands volumes de données, améliorant la productivité et l’efficacité opérationnelle.

- Amélioration de la qualité des données : En proposant des fonctions de nettoyage et de validation des données, les outils ETL contribuent à garantir l’exactitude et la fiabilité des données. Une meilleure qualité des données entraîne une prise de décision plus pertinente et permet de réduire significativement les coûts liés aux erreurs et aux inexactitudes.

- Évolutivité renforcée : Les outils ETL sont conçus pour gérer des volumes de données variés, des petits aux très grands ensembles, sans nuire aux performances. Cette évolutivité accompagne la croissance de l’entreprise car les organisations peuvent facilement s’adapter à l’augmentation des volumes sans devoir revoir toute leur infrastructure de traitement de données.

- Intégration de données provenant de sources multiples : Les outils ETL peuvent extraire des données de sources diverses, telles que les bases de données, les services cloud ou les applications, et les consolider dans un référentiel unique. Cette capacité d’intégration permet aux entreprises d’obtenir une vue globale de leurs activités, renforçant leurs capacités d’analyse et de reporting.

- Sécurité accrue des données : De nombreux outils ETL incluent des fonctionnalités de sécurité avancées, comme le chiffrement et les contrôles d’accès, pour protéger les données sensibles tout au long du processus de gestion. Cette sécurité renforcée aide les organisations à se conformer aux réglementations sur la protection des données et à se prémunir contre les violations de données.

Coûts et tarification des outils ETL

Lorsqu’on s’aventure dans le domaine des outils ETL, il est essentiel pour les acheteurs de logiciels, en particulier ceux qui ont peu ou pas d’expérience, de comprendre les différentes formules et options de tarification existantes. Les prix et formules peuvent varier considérablement selon les fonctionnalités, l’évolutivité, le support et d’autres facteurs.

Tableau comparatif des formules pour les outils ETL

Vous trouverez ci-dessous un aperçu détaillé des principales formules disponibles pour les outils ETL, pour vous aider à prendre une décision éclairée correspondant à vos besoins organisationnels et à vos contraintes budgétaires.

| Type de plan | Prix moyen | Fonctionnalités courantes | Idéal pour |

|---|---|---|---|

| Gratuit | $0 | Accès aux fonctionnalités ETL de base, traitement de volumes de données limités, support communautaire. | Petites entreprises ayant des besoins minimaux en intégration de données, développeurs individuels, passionnés de l’open source |

| Basique | $500 - $2,000 / mois | Fonctionnalités ETL standard, prise en charge de multiples sources de données, assistance par email, capacités de transformation de données basiques. | Startups, petites à moyennes entreprises avec des besoins croissants en données, organisations aux ressources informatiques limitées |

| Professionnel | $2,001 - $10,000 / mois | Transformations de données avancées, traitement des données en temps réel, capacité de traitement de volumes de données plus importants, support client prioritaire. | Entreprises de taille moyenne avec des besoins complexes en intégration de données, sociétés disposant de multiples sources et formats de données |

| Entreprise | $10,001+ / mois | Solutions ETL sur mesure, support dédié, volume de données illimité, fonctionnalités de sécurité avancées, accès API. | Grandes entreprises avec des volumes de données massifs, besoins complexes en intégration de données, exigences élevées en matière de sécurité |

FAQ sur les outils ETL

Voici les réponses aux questions les plus fréquemment posées sur les outils ETL :

Comment mettez-vous en œuvre un outil ETL ?

Comment les outils ETL garantissent-ils la sécurité des données ?

Les outils ETL peuvent-ils gérer de gros volumes de données ?

Quel est le coût des outils ETL ?

Comment améliorer la performance d’un ETL ?

Comment choisir l’outil ETL adapté à vos besoins ?

Et maintenant ?

Si vous êtes en train de rechercher des outils ETL, contactez gratuitement un conseiller SoftwareSelect pour des recommandations personnalisées.

Vous remplissez un formulaire et effectuez un court entretien pour leur exposer les détails de vos besoins. Ensuite, vous recevrez une liste restreinte de logiciels à examiner. Ils vous accompagnent même tout au long du processus d'achat, jusqu'à la négociation des prix.