Beste ETL-Tools Kurzliste

Hier ist meine Kurzliste der besten ETL-Tools:

Die besten ETL-Tools helfen Teams dabei, Daten automatisch aus verschiedenen Quellen zu extrahieren, sie zu bereinigen und zu formatieren und in Data Warehouses oder Analysesysteme zu laden, um Erkenntnisse in Echtzeit zu gewinnen. Sie erleichtern es, konsistente und genaue Datensätze zu pflegen, während sie den manuellen Aufwand für Datenaufbereitung und wiederholte Wartung von Pipelines reduzieren.

Teams beginnen meist nach ETL-Lösungen zu suchen, wenn sie zu viel Zeit damit verbringen, fehlerhafte Pipelines zu reparieren, mit nicht übereinstimmenden Datenformaten zu kämpfen oder stundenlang auf aktualisierte Berichte zu warten. Manuelle Prozesse und Altskripte können mit dem heutigen Datenvolumen oder der Frequenz oft nicht mehr mithalten, was zu Verzögerungen, Fehlern und unzuverlässigen Dashboards führt.

Ich habe mit Data-Engineering- und Analytik-Teams zusammengearbeitet, um ETL-Workflows in Cloud- und On-Premises-Umgebungen zu implementieren und zu optimieren und dabei Tools auf Skalierbarkeit, Flexibilität bei der Datenumwandlung und einfache Integration mit modernen Datenplattformen getestet.

In diesem Leitfaden erfährst du, welche ETL-Plattformen deine Datenprozesse tatsächlich schneller, zuverlässiger und einfacher zu warten machen, ohne unnötige Komplexität hinzuzufügen.

Why Trust Our Software Reviews

Beste ETL-Tools Zusammenfassung

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Am besten geeignet zur Integration von Tabellen mit Datenquellen | Kostenloser Plan + kostenlose Demo verfügbar | Ab $49/Monat (jährliche Abrechnung) | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6 -

Pulumi

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8

Beste ETL-Tools Testberichte

Nachfolgend findest du meine ausführlichen Zusammenfassungen der besten ETL-Tools, die es auf meine Kurzliste geschafft haben. Meine Bewertungen bieten dir einen detaillierten Einblick in die wichtigsten Funktionen, Vor- u0026 Nachteile, Integrationen und idealen Anwendungsfälle der jeweiligen Tools, damit du das für dich beste findest.

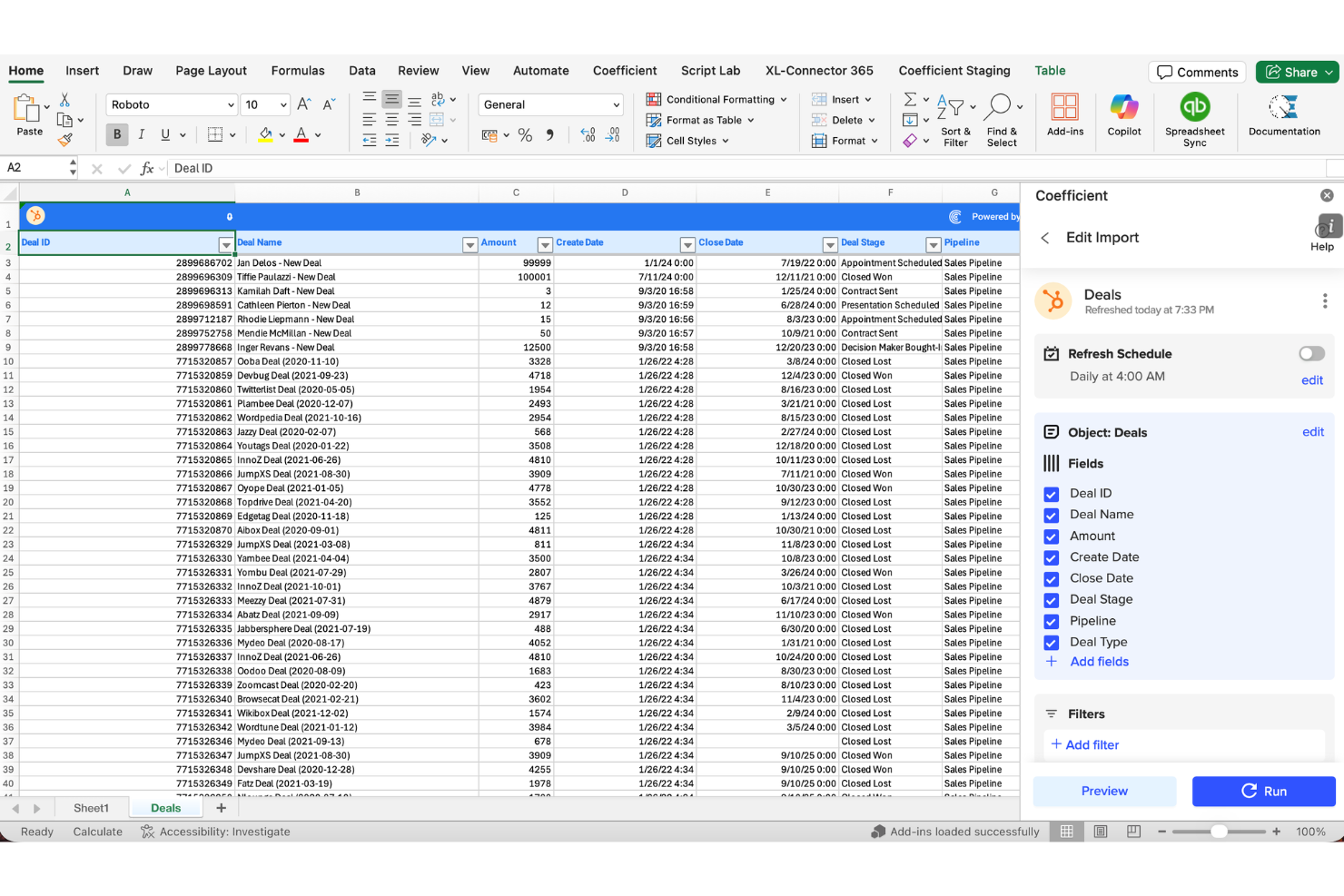

Für Fachleute, die effiziente ETL-Lösungen suchen, bietet Coefficient eine überzeugende Wahl, indem es Google Sheets und Excel mit über 100 Datenquellen integriert. Besonders attraktiv ist es für Unternehmen in den Bereichen Finanzen, Marketing und Umsatzmanagement, wo Echtzeit-Datenanalyse und Automatisierung entscheidend sind. Da keine Programmierkenntnisse erforderlich sind, vereinfacht Coefficient die Erstellung komplexer Datenanwendungen und löst Herausforderungen wie Datenmanagement und Produktivitätssteigerung.

Warum ich Coefficient ausgewählt habe

Ich habe Coefficient wegen seiner einzigartigen Fähigkeit gewählt, Tabellenkalkulationen mit einer Vielzahl von Datenquellen zu verbinden – ein Muss für jedes ETL-Tool. Funktionen wie das Bewahren von Formeln und das Erstellen von Datensnapshots ermöglichen es Teams, Daten mühelos zu verwalten und zu transformieren. Hinzu kommen Werkzeuge wie der Google Sheets Assistant und der SQL Query Builder, die Nutzer bei der Bewältigung komplexer Datenaufgaben unterstützen, ohne dass umfangreiches technisches Fachwissen erforderlich ist. Diese Fähigkeiten machen Coefficient zu einer wertvollen Ressource für Unternehmen, die ihre Daten-Workflows optimieren möchten.

Wichtige Funktionen von Coefficient

Neben den Integrationsmöglichkeiten bietet Coefficient mehrere bemerkenswerte Funktionen:

- Echtzeit-Datenanalyse: Mit dieser Funktion kann Ihr Team direkt in Tabellen mit aktuellen Daten arbeiten.

- KI-gestützte Dashboards: Erstellen Sie dynamische Dashboards, die sich automatisch mit den neuesten Daten aktualisieren.

- Automatisierte Datenanreicherung: Verbessern Sie die Qualität und Tiefe Ihrer Daten ohne manuellen Aufwand, sparen Sie Zeit und reduzieren Sie Fehler.

- No-Code-Anwendungserstellung: Entwickeln Sie Datenanwendungen wie Provisions-Tracker und Marketing-Dashboards, ohne eine einzige Codezeile schreiben zu müssen.

Coefficient Integrationen

Zu den Integrationen gehören Salesforce, QuickBooks, Snowflake, HubSpot, Google Analytics, Slack, Stripe, Shopify und viele mehr.

Pros and Cons

Pros:

- Automatische Datenaktualisierungen

- Ermöglicht Massenaktualisierungen im CRM

- Native Bewahrung benutzerdefinierter Tabellenformeln

Cons:

- Beschränkt auf tabellenbasierte Plattformen

- Fehlende umfangreiche Anpassungsoptionen

Weitere IT-Software-Bewertungen

Falls du hier noch nicht das passende gefunden hast, schau dir diese Tools im Bereich API-Management an, die wir getestet und bewertet haben.

- Netzwerküberwachungssoftware

- Serverüberwachungssoftware

- SD-WAN-Lösungen

- Infrastruktur-Monitoring-Tools

- Paket-Sniffer

- Anwendungsüberwachungstools

Auswahlkriterien für ETL-Tools

Bei der Auswahl von ETL-Tools konzentriere ich mich auf deren Funktionalität und darauf, wie gut sie bestimmte Anwendungsfälle abdecken. Meine Kriterien basieren auf umfangreicher eigener Recherche und praktischer Erfahrung mit verschiedenen ETL-Lösungen. Hier ein Überblick über meine Methodik zur Auswahl der Tools für diese Liste:

Kernfunktionen von ETL-Tools: 25% der Gesamtbewertung

Um auf meiner Liste der besten ETL-Tools zu erscheinen, musste die Lösung einen oder mehrere der folgenden Anwendungsfälle unterstützen:

- Effiziente Datenintegration aus unterschiedlichen Quellen

- Skalierbare Datenumwandlung

- Automatisierte Daten-Workflows

- Echtzeit-Datenverarbeitung und Analysen

- Sicherstellung von Datenqualität und Compliance

Besondere Zusatzfunktionen: 25% der Gesamtbewertung

- Tools, die erweiterte Datenumwandlungslogik bieten, wie unscharfes Matching und maschinelles Lernen für prädiktive Modellierung.

- Lösungen mit umfangreichen vorgefertigten Konnektoren zu neuen und aufkommenden Datenquellen wie IoT-Geräten oder Blockchain-Plattformen.

- ETL-Plattformen, die einzigartige Datenvisualisierungstools bereitstellen, um Datenflüsse und Leistung in Echtzeit zu überwachen.

- Innovative Ansätze für Daten-Governance und Compliance, die dafür sorgen, dass Daten nicht nur sicher, sondern auch globalen Vorschriften entsprechen.

- Beispiele hierfür sind Tools, die KI nutzen, um Datenqualitätsprüfungen zu verbessern, oder Plattformen, die eine tiefgehende Anpassung ermöglichen, sodass Unternehmen das Tool auf ihre spezifischen Anforderungen zuschneiden können.

Benutzerfreundlichkeit: 10 % der Gesamtbewertung

- Oberflächen, die komplexe Prozesse vereinfachen, wie Drag-and-Drop-Funktionalität zur Gestaltung von Datenpipelines.

- Klare, intuitive Dashboard-Designs, die schnellen Zugriff auf häufig genutzte Funktionen bieten.

- Responsives Design, das auf verschiedenen Geräten zuverlässig funktioniert und es ermöglicht, ETL-Aufgaben auch unterwegs zu verwalten.

Onboarding: 10 % der Gesamtbewertung

- Verfügbarkeit umfassender Schulungsmaterialien wie Video-Tutorials, Dokumentationen und interaktiver Produkttouren.

- Vorlagen und vorkonfigurierte Workflows, die neuen Nutzer:innen helfen, gängige ETL-Herausforderungen und -Aufgaben schnell zu meistern.

- Zugang zu Kundensupport oder Community-Foren während der Einarbeitungsphase, um einen reibungslosen Einstieg und sofortige Problemlösung zu ermöglichen.

Kundensupport: 10 % der Gesamtbewertung

- Verschiedene Support-Kanäle, darunter Live-Chat, Telefonsupport und E-Mail, um unterschiedlichste Nutzerpräferenzen zu berücksichtigen.

- Proaktiver Support, zum Beispiel durch regelmäßige Check-ins und Updates zu neuen Funktionen oder Best Practices.

- Ein kompetentes und reaktionsschnelles Support-Team, das bei technischen und betrieblichen Fragen unterstützt.

Preis-Leistungs-Verhältnis: 10 % der Gesamtbewertung

- Transparente Preismodelle, die zu den angebotenen Funktionen und der Skalierbarkeit passen.

- Berücksichtigung des langfristigen Nutzens durch flexible Tarife, die mit den Anforderungen der Nutzer:innen mitwachsen.

- Kostenlose Testphasen oder Demos, die ermöglichen, die Wirksamkeit des Tools vor einer finanziellen Verpflichtung zu prüfen.

Kundenbewertungen: 10 % der Gesamtbewertung

- Durchgehend hohe Bewertungen in für ETL-Prozesse entscheidenden Bereichen wie Zuverlässigkeit, Leistung und Nutzerzufriedenheit.

- Positives Feedback zur Benutzerfreundlichkeit und zur Reaktionsfähigkeit des Kundensupports.

- Bewertungen, die erfolgreiche Anwendungsfälle beschreiben, die den Anforderungen der Käufer:innen entsprechen und zeigen, dass das Tool spezifische Probleme lösen kann.

Dieses Kriterien-Framework stellt sicher, dass ETL-Tools umfassend bewertet werden – mit Fokus auf ihre Kernfunktionen und zusätzliche Merkmale, mit denen sie sich auf dem Markt abheben, wie etwa Automatisierungstools für ETL-Tests. Es deckt das gesamte Spektrum der Käuferinteressen ab, von der Ersteinführung bis hin zum langfristigen Nutzen, sodass das gewählte ETL-Tool nicht nur die aktuellen Anforderungen im Datenmanagement erfüllt, sondern auch zukünftiges Wachstum und wachsende Komplexität unterstützt.

Wie Sie ETL-Tools auswählen

Während Sie ETL-Tools auswählen, testen und bewerten, sollten Sie Folgendes berücksichtigen:

- Welches Problem versuchen Sie zu lösen - Beginnen Sie damit, die Lücke im ETL-Pipeline-Management zu identifizieren, die Sie schließen möchten, um die benötigten Funktionen und Merkmale des Tools zu klären.

- Wer wird es nutzen müssen - Um Kosten und Anforderungen zu bewerten, überlegen Sie, wer das Tool nutzen wird und wie viele Lizenzen Sie benötigen. Sie müssen ermitteln, ob lediglich die Datenabteilung oder das gesamte Unternehmen Zugriff benötigt. Sobald das klar ist, lohnt es sich zu überlegen, ob Sie Benutzerfreundlichkeit für alle oder Geschwindigkeit für Ihre technischen Power-User priorisieren möchten.

- Mit welchen anderen Tools es zusammenarbeiten muss - Stellen Sie klar, welche Tools ersetzt werden, welche bleiben und mit welchen Tools integriert werden muss. Dies könnte Ihre bestehende ETL-Infrastruktur, verschiedene Datenquellen und Ihren gesamten Technik-Stack umfassen. Sie müssen auch entscheiden, ob die Tools integriert werden müssen oder ob Sie mehrere Tools durch ein konsolidiertes ETL-Tool ersetzen können.

- Welche Ergebnisse wichtig sind - Überlegen Sie, welches Ergebnis das Tool liefern muss, damit es als Erfolg gilt. Denken Sie darüber nach, welche Fähigkeiten Sie gewinnen oder verbessern möchten und wie Sie den Erfolg messen werden. Sie könnten ETL-Tools bis ins kleinste Detail vergleichen – wenn Sie aber nicht die gewünschten Ergebnisse im Blick haben, verschwenden Sie womöglich viel wertvolle Zeit.

- Wie es in Ihrem Unternehmen funktioniert - Betrachten Sie die Lösungen im Zusammenhang mit Ihren Arbeitsabläufen und Ihrer ETL-Methodik. Prüfen Sie, was gut läuft und welche Bereiche Probleme verursachen, die angegangen werden müssen. Denken Sie daran: Jedes Unternehmen ist anders – gehen Sie nicht davon aus, dass ein beliebtes Tool auch für Ihr Unternehmen geeignet ist.

Trends bei ETL-Tools

Während meiner Recherche habe ich zahlreiche Produktupdates, Pressemitteilungen und Changelogs verschiedener ETL-Tool-Anbieter ausgewertet. Hier sind einige der aufkommenden Trends, die ich beobachte:

- Echtzeit-Datenverarbeitung: Immer mehr ETL-Tools wechseln von Batch- zu Echtzeitdatenverarbeitung, was Unternehmen hilft, schnellere Entscheidungen auf Basis aktueller Daten zu treffen.

- KI-gestützte Daten-Transformation: Einige Anbieter integrieren KI-Funktionen, um komplexe Aufgaben bei der Datenumwandlung zu automatisieren, wodurch der Bedarf an manueller Programmierung sinkt.

- Datenqualitätsüberwachung: ETL-Tools beginnen, integrierte Datenvalidierung und Qualitätsprüfungen anzubieten, sodass Teams Fehler und Inkonsistenzen erkennen können, bevor sie nachgelagerte Systeme beeinflussen.

- Self-Service-ETL: Anbieter konzentrieren sich darauf, ETL-Tools benutzerfreundlicher zu gestalten, sodass auch Geschäftsanwender ohne technisches Fachwissen Daten extrahieren und transformieren können.

- Hybrid- und Multi-Cloud-Unterstützung: Da immer mehr Unternehmen mehrere Cloud-Plattformen nutzen, passen ETL-Tools ihre Unterstützung für hybride und Multi-Cloud-Umgebungen an.

Was sind ETL-Tools?

ETL-Tools sind Softwarelösungen, die dabei helfen, Daten aus verschiedenen Quellen zu übertragen, sie zu bereinigen und zu formatieren und in ein System zu laden, in dem sie genutzt werden können. Sie werden von Dateningenieuren, Analysten und IT-Teams eingesetzt, die Daten für Berichte, Dashboards oder Machine Learning vorbereiten müssen.

Funktionen wie Datenextraktion, Transformationsregeln und automatische Zeitplanung helfen, manuelle Arbeit zu reduzieren, Fehler zu beheben und sicherzustellen, dass die Daten rechtzeitig verfügbar sind. Mit diesen Tools wird die Arbeit mit Daten erheblich vereinfacht, ohne dass alles von Grund auf neu entwickelt werden muss.

Funktionen von ETL-Tools

Hier sind einige der wichtigsten Funktionen, auf die ich achte, wenn ich Extract, Transform und Load (ETL) Tools bewerte:

- Intuitive Benutzeroberfläche (UI): Eine benutzerfreundliche und leicht verständliche Oberfläche vereinfacht die Erstellung und Verwaltung von ETL-Prozessen. Sie ermöglicht es Nutzern mit unterschiedlichen technischen Kenntnissen, effizient mit Daten zu arbeiten.

- Konnektivität und Integration: Die Fähigkeit, eine breite Palette von Datenquellen und -zielen anzubinden. Diese Funktion ist entscheidend für Unternehmen, die Daten aus verschiedenen Quellen sammeln und eine nahtlose Integration über Plattformen hinweg sicherstellen müssen.

- Daten-Transformation: Leistungsstarke Funktionen zur Datenumwandlung ermöglichen die Konvertierung von Daten in das gewünschte Format mit Leichtigkeit. Dies ist unerlässlich, um Daten präzise für Analysen und Berichte vorzubereiten.

- Automatisierung und Zeitplanung: Werkzeuge mit Automatisierungs- und Zeitplanungsfunktionen ermöglichen, dass ETL-Prozesse zu festgelegten Zeiten oder als Reaktion auf bestimmte Auslöser ausgeführt werden. Dies verringert den manuellen Aufwand und stellt sicher, dass Daten stets aktuell sind.

- Skalierbarkeit: Die Fähigkeit, je nach Datenvolumen und Rechneranforderungen hoch- oder herunterzuskalieren. Mit wachsendem Datenvolumen kann ein skalierbares ETL-Tool größere Lasten bewältigen, ohne Kompromisse bei der Leistung einzugehen.

- Echtzeitverarbeitung: Die Unterstützung der Datenverarbeitung in Echtzeit ermöglicht es Unternehmen, Entscheidungen auf Basis der aktuellsten Daten zu treffen. Dies ist bei zeitkritischen Anwendungen, bei denen stets aktuelle Daten benötigt werden, unerlässlich.

- Datenqualität und -bereinigung: Funktionen, die die Datenbereinigung unterstützen und die Qualität sicherstellen, sind essenziell. Sie helfen dabei, Fehler oder Inkonsistenzen in den Daten zu identifizieren und zu korrigieren, sodass für die Analyse nur verlässliche Daten genutzt werden.

- Sicherheit: Robuste Sicherheitsfunktionen wie Datenverschlüsselung und Zugriffskontrollen schützen sensible Informationen vor unbefugtem Zugriff. Sicherheit ist unverzichtbar zur Einhaltung gesetzlicher Vorschriften und zum Schutz der Unternehmensdaten.

- Überwachung und Protokollierung: Die Möglichkeit, ETL-Prozesse in Echtzeit zu überwachen und Aktivitäten für Audit-Trails zu protokollieren. Dies unterstützt die Fehlerbehebung und sorgt für Transparenz bei Datenoperationen.

- Support und Community: Ein guter Kundensupport und eine aktive Nutzercommunity helfen maßgeblich bei der Lösung von Problemen und dem Austausch von Best Practices. Dies ist vorteilhaft für kontinuierliches Lernen und das Überwinden von Herausforderungen beim Management von ETL-Pipelines.

Vorteile von ETL-Tools

ETL-Tools spielen eine entscheidende Rolle in der modernen, datengetriebenen Geschäftswelt und ermöglichen es Organisationen, große Datenmengen effizient zu verwalten, die aus unterschiedlichen Quellen stammen. Diese Tools vereinfachen den Prozess des Extrahierens von Daten, der Umwandlung in ein nutzbares Format und des Ladens in ein Data Warehouse oder andere Speicherlösungen. Hier sind fünf Hauptvorteile von ETL-Tools für Nutzer und Organisationen:

- Gesteigerte Effizienz: ETL-Tools automatisieren das Extrahieren, Transformieren und Laden von Daten und reduzieren den Zeit- und Arbeitsaufwand im Vergleich zu manuellen Prozessen erheblich. Diese Automatisierung ermöglicht es Unternehmen, große Datenmengen schnell zu verarbeiten und verbessert so Produktivität und operative Effizienz.

- Verbesserte Datenqualität: Durch Funktionen zur Datenbereinigung und -validierung tragen ETL-Tools zur Genauigkeit und Zuverlässigkeit von Daten bei. Eine höhere Datenqualität führt zu besseren Entscheidungen und kann die durch Fehler und Ungenauigkeiten entstehenden Kosten deutlich senken.

- Erhöhte Skalierbarkeit: ETL-Tools sind dafür konzipiert, mit unterschiedlich großen Datenmengen umzugehen – von kleinen bis zu sehr großen Datensätzen – ohne Leistungseinbußen. Diese Skalierbarkeit unterstützt das Wachstum des Unternehmens, da Organisationen ihre Datenverarbeitung problemlos an steigende Volumina anpassen können, ohne die Infrastruktur komplett umstellen zu müssen.

- Datenintegration aus mehreren Quellen: ETL-Tools können Daten aus diversen Quellen – etwa Datenbanken, Cloud-Diensten oder Anwendungen – extrahieren und in einem zentralen Speicher zusammenführen. Diese Integrationsfähigkeit verschafft Unternehmen einen ganzheitlichen Überblick über ihre Aktivitäten und stärkt Analytik wie Berichterstattung.

- Erhöhte Datensicherheit: Viele ETL-Tools verfügen über leistungsstarke Sicherheitsmechanismen wie Verschlüsselung und Zugriffskontrollen, um sensible Informationen während der Datenverarbeitung zu schützen. Die gesteigerte Datensicherheit hilft Unternehmen, Datenschutzvorgaben einzuhalten und sich vor Datenpannen zu schützen.

Kosten & Preise für ETL-Tools

Wenn Sie sich in die Welt der ETL-Tools wagen, ist es für Softwarekäufer – besonders für Einsteiger – entscheidend, die verschiedenen Preis- und Tarifoptionen zu verstehen. Preise und Tarife können je nach Funktionsumfang, Skalierbarkeit, Support und weiteren Faktoren stark variieren.

Tarifvergleichstabelle für ETL-Tools

Nachfolgend finden Sie einen detaillierten Überblick über gängige Tarifoptionen für ETL-Tools, um Ihnen dabei zu helfen, eine fundierte Entscheidung zu treffen, die zu Ihren Unternehmensanforderungen und Ihrem Budget passt.

| Tarifart | Durchschnittlicher Preis | Hauptfunktionen | Am besten geeignet für |

|---|---|---|---|

| Kostenlos | $0 | Zugriff auf grundlegende ETL-Funktionalitäten, begrenzte Datenverarbeitungsmenge, Community-Support. | Kleine Unternehmen mit minimalem Bedarf an Datenintegration, einzelne Entwickler, Open-Source-Enthusiasten |

| Basis | $500 - $2,000 / Monat | Standard-ETL-Funktionen, Unterstützung mehrerer Datenquellen, E-Mail-Support, grundlegende Daten-Transformation. | Start-ups, kleine bis mittelständische Unternehmen mit wachsendem Datenbedarf, Organisationen mit begrenzten IT-Ressourcen |

| Professionell | $2,001 - $10,000 / Monat | Erweiterte Daten-Transformationen, Echtzeit-Datenverarbeitung, höhere Datenvolumenkapazität, priorisierter Kundensupport. | Mittelständische Unternehmen mit komplexen Datenintegrationsanforderungen, Unternehmen mit mehreren Datenquellen und -formaten |

| Enterprise | $10,001+ / Monat | Individuelle ETL-Lösungen, dedizierter Support, unbegrenztes Datenvolumen, erweiterte Sicherheitsfunktionen, API-Zugang. | Große Unternehmen mit riesigen Datenmengen, komplexen Datenintegrationsanforderungen, hohem Sicherheitsbedarf |

ETL-Tools FAQ

Nachfolgend finden Sie die Antworten auf die am häufigsten gestellten Fragen zu ETL-Tools:

Wie implementiert man ein ETL-Tool?

Wie gewährleisten ETL-Tools die Datensicherheit?

Können ETL-Tools große Datenmengen verarbeiten?

Wie viel kosten ETL-Tools?

Wie kann man die ETL-Performance verbessern?

Wie wähle ich das richtige ETL-Tool für meine Anforderungen?

Wie geht es weiter?

Wenn Sie gerade ETL-Tools recherchieren, kontaktieren Sie einen SoftwareSelect-Berater für kostenlose Empfehlungen.

Sie füllen ein Formular aus und führen ein kurzes Gespräch, in dem Ihre spezifischen Anforderungen geklärt werden. Anschließend erhalten Sie eine Liste mit geeigneter Software zur Auswahl. Die Berater unterstützen Sie sogar über den gesamten Kaufprozess hinweg – auch bei Preisverhandlungen.