Liste restreinte des meilleurs outils DataOps

Les meilleurs outils DataOps aident les équipes à concevoir, surveiller et gérer des pipelines de données qui délivrent réellement des résultats fiables. Ils automatisent les contrôles qualité, assurent le suivi de la traçabilité et offrent de la visibilité sur les workflows afin que les données circulent de façon sécurisée et efficace de la source à la destination.

Si vous avez déjà perdu des heures à déboguer des jobs ETL échoués avec des messages d’erreur imprécis, jonglé avec des systèmes cloisonnés qui ne s’intègrent pas, ou affronté un audit de conformité sans suivi clair de la traçabilité, vous savez à quel point de mauvaises opérations de données peuvent perturber vos activités. Ces difficultés ralentissent la livraison, augmentent les risques et minent la confiance dans les données sur lesquelles s’appuie votre entreprise.

J’ai collaboré avec des ingénieurs data et des équipes produits dans des environnements SaaS en forte croissance, en évaluant les plateformes dans des conditions réelles où la performance, la sécurité et l’auditabilité ne sont pas négociables. J’ai testé des outils à travers des environnements de développement, de pré-production et de production afin de distinguer ceux qui ne font que promettre des solutions de ceux qui réduisent réellement les frictions et améliorent la fiabilité.

Dans ce guide, vous découvrirez quelles plateformes DataOps apportent des informations exploitables, réduisent le bruit et aident votre équipe à avancer plus vite en toute confiance.

Pourquoi faire confiance à nos avis logiciels

Nous testons et évaluons des logiciels de développement SaaS depuis 2023. En tant qu’experts techniques, nous savons à quel point il est critique et difficile de prendre la bonne décision lors du choix d’un logiciel. Nous investissons dans une recherche approfondie pour aider notre audience à prendre de meilleures décisions d’achat logiciel.

Nous avons testé plus de 2 000 outils pour différents cas d’utilisation SaaS et rédigé plus de 1 000 avis logiciels détaillés. Découvrez comment nous restons transparents et consultez notre méthodologie d’évaluation logicielle.

Résumé des meilleurs outils DataOps

Ce tableau comparatif résume les détails de tarification de mes meilleurs choix d’outils DataOps pour vous aider à trouver celui qui convient à votre budget et à vos besoins métier.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Idéal pour l’orchestration de pipelines de données | Démo gratuite disponible | Tarifs sur demande | Website | |

| 2 | Idéal pour la gestion de la confidentialité des données | Offre gratuite disponible | À partir de 150 $/mois (facturé annuellement) | Website | |

| 3 | Idéal pour la collaboration sur les flux de travail SQL | Essai gratuit de 21 jours | À partir de $199/utilisateur/an (facturé annuellement) | Website | |

| 4 | Idéal pour l'automatisation de la préparation des données | Non | $5,195/utilisateur/an (soit environ $433/utilisateur/mois) | Website | |

| 5 | Idéal pour l'analyse de données à grande échelle | Non | $99/user/month | Website | |

| 6 | Idéal pour l'intégration hybride des données | Non | $1/user/hour pour les activités de déplacement de données | Website | |

| 7 | Idéal pour l’intégration des données à grande échelle en entreprise | Non | Tarification sur demande | Website | |

| 8 | Idéal pour des requêtes de type SQL | Not available | Gratuit | Website | |

| 9 | Idéal pour la recherche et l'analyse de données | Non | $16/user/month | Website | |

| 10 | Idéal pour la gestion des flux de données en temps réel | Not available | Gratuit | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Avis sur les meilleurs outils DataOps

Voici mes résumés détaillés des meilleurs outils DataOps ayant intégré ma sélection. Mes avis offrent un regard approfondi sur les fonctionnalités clés, les avantages et inconvénients, les intégrations et les cas d’utilisation idéaux de chaque outil pour vous aider à trouver celui qui vous convient le mieux.

Idéal pour l’orchestration de pipelines de données

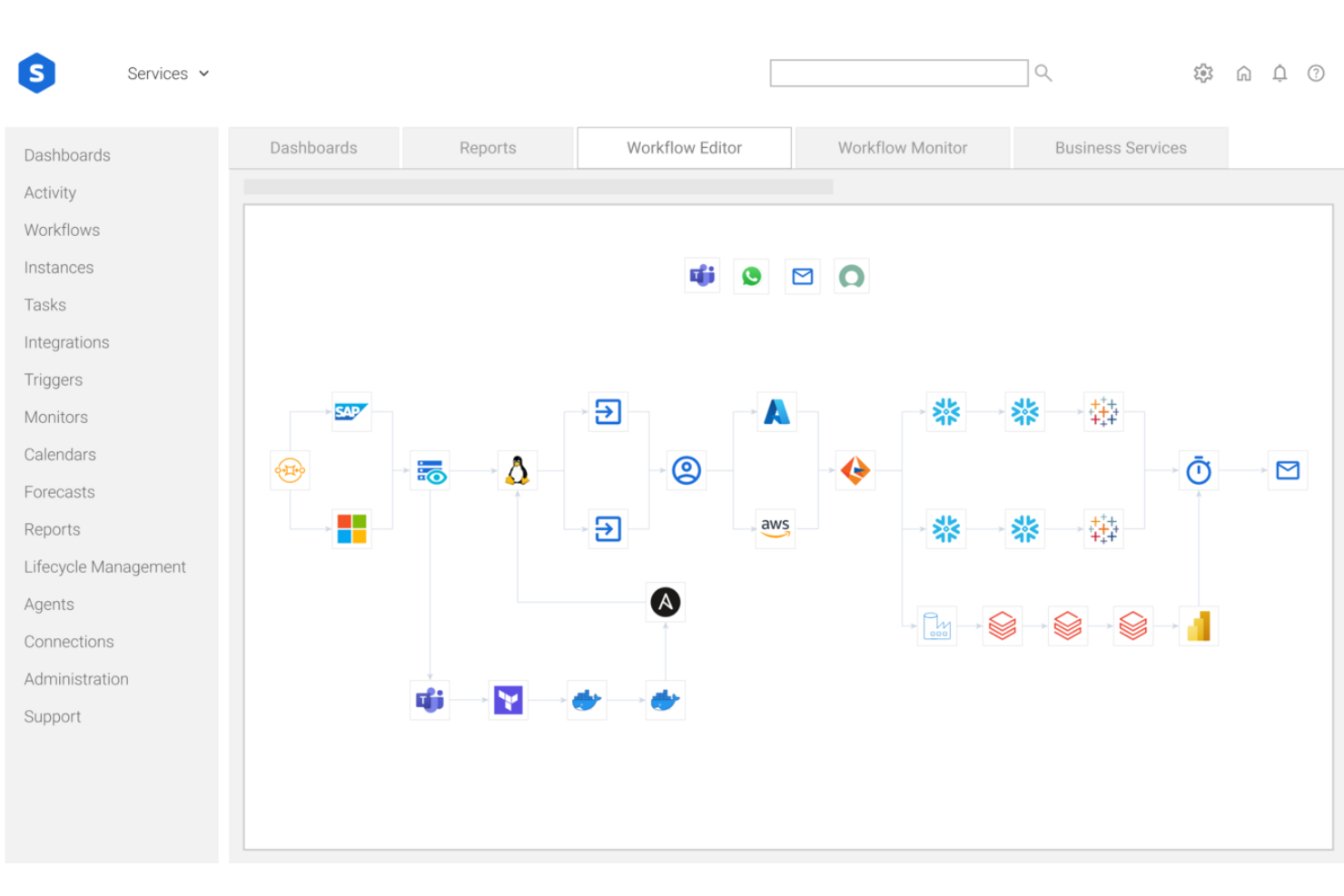

Stonebranch Universal Automation Center offre une solution fiable pour les équipes informatiques souhaitant optimiser leurs opérations de données. Conçu pour les professionnels de l'informatique et les entreprises qui cherchent à rationaliser leurs flux de données, il répond à la complexité des environnements informatiques hybrides en orchestrant sans couture les pipelines de données et en automatisant les workflows sur différentes plateformes. Avec son interface conviviale, l’outil convient particulièrement aux équipes désireuses de réduire la supervision manuelle et d'améliorer l'efficacité opérationnelle.

Pourquoi j'ai choisi Stonebranch Universal Automation Center

J'ai choisi Stonebranch Universal Automation Center pour ses capacités uniques d'orchestration de pipelines de données, un aspect crucial du DataOps. L'automatisation informatique hybride en temps réel de la plateforme permet à votre équipe de gérer des workflows complexes à la fois sur le cloud et sur site. Son automatisation pilotée par les événements garantit que les workflows s’exécutent en réponse à des déclencheurs de données spécifiques, renforçant ainsi l’agilité opérationnelle. Ces fonctionnalités sont adaptées aux besoins des services informatiques qui souhaitent optimiser la gestion des données et rationaliser les processus sans une intervention manuelle importante.

Fonctionnalités clés de Stonebranch Universal Automation Center

En plus de l’orchestration de pipelines de données, Stonebranch Universal Automation Center propose :

- Transfert de fichiers géré : Contrôle de manière sécurisée le flux de données à travers différents environnements, y compris les transferts de fichiers B2B.

- Automatisation de l’infrastructure et des services : Gère de façon transparente les ressources informatiques, réseau et stockage.

- Analytique et observabilité : Offre des capacités avancées de reporting et de prédiction afin d'améliorer les niveaux de service.

Intégrations de Stonebranch Universal Automation Center

Les intégrations incluent Amazon Web Services (AWS), SAP, ServiceNow, Red Hat, Google Cloud, Kubernetes, Microsoft, Docker et Informatica.

Pros and Cons

Pros:

- Supervision avancée sur les mainframes et les environnements cloud

- Des capacités d’automatisation complètes pour des processus IT variés

- La haute disponibilité et les capacités de basculement améliorent la fiabilité

Cons:

- Les utilisateurs signalent une documentation peu adaptée aux débutants

- Disponibilité cloud et évolutivité limitées par rapport aux alternatives

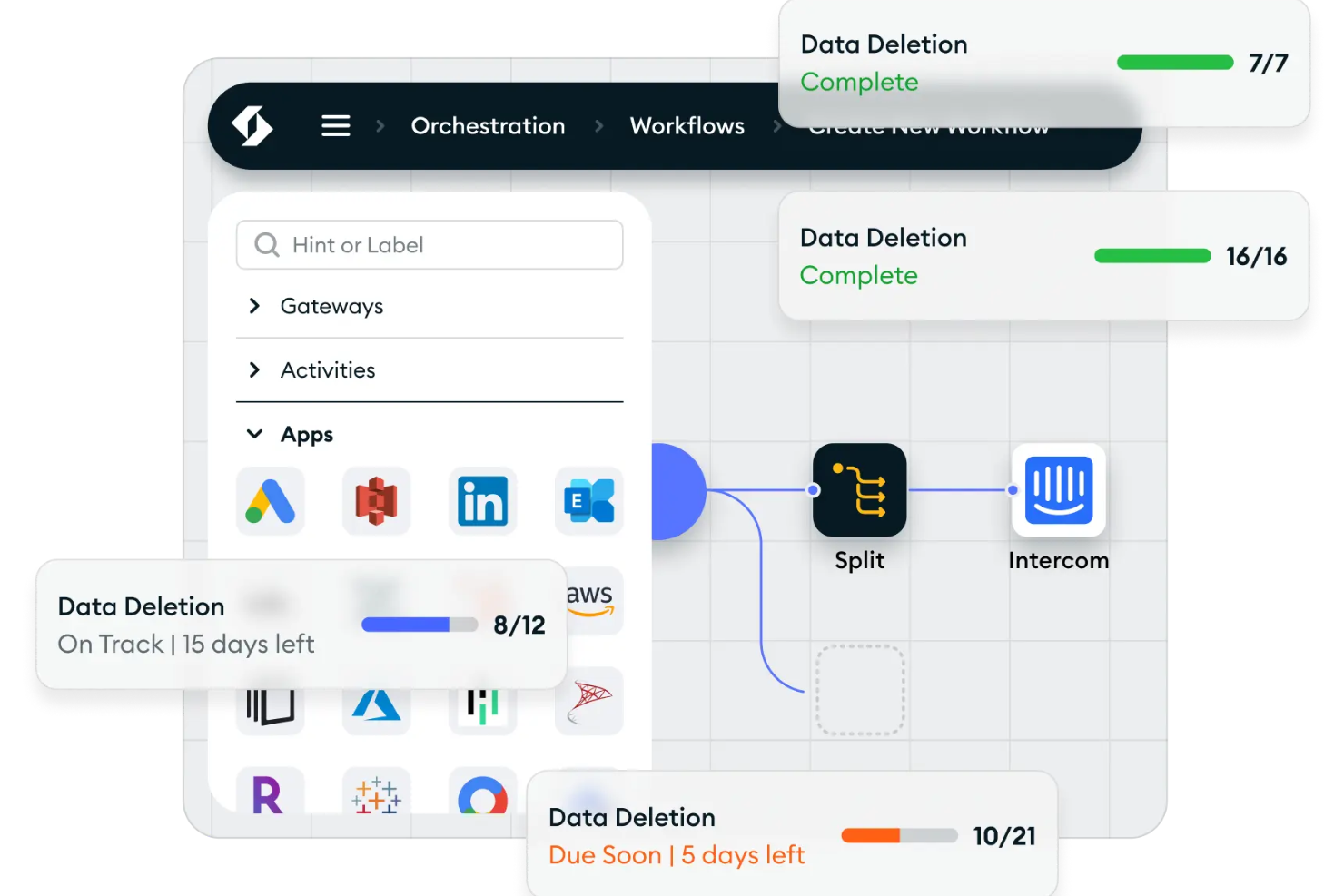

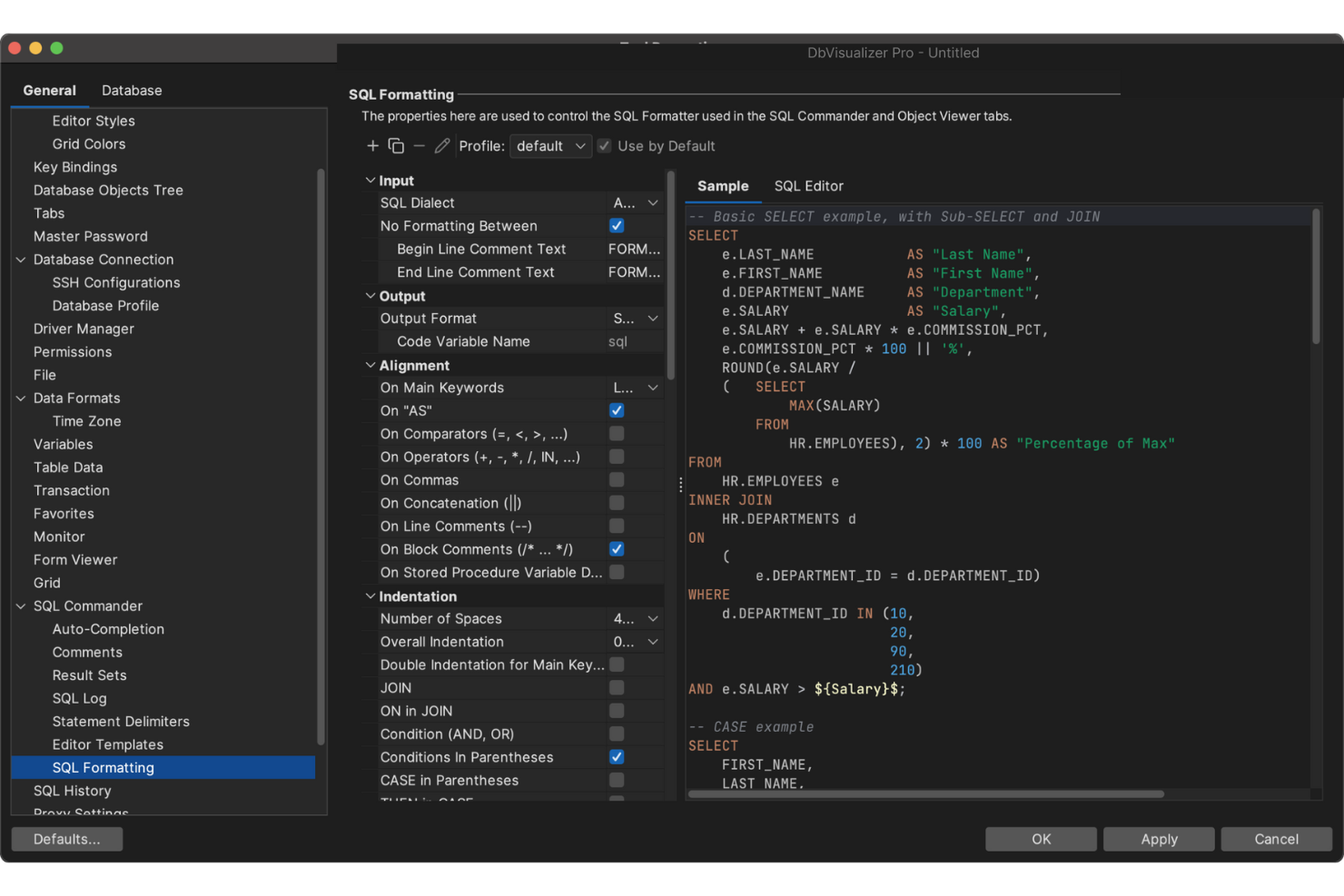

Ketch est un logiciel de gestion de la confidentialité des données conçu pour les entreprises soucieuses de conformité et de protection de la vie privée des utilisateurs. Il s’adresse aux professionnels du juridique, du marketing et de la technologie en proposant des outils tels que la gestion des consentements et la cartographie des données.

Pourquoi j’ai choisi Ketch : Il se concentre sur la conformité aux réglementations telles que le RGPD et la CCPA. Ketch automatise les processus de confidentialité, notamment l’automatisation des demandes des personnes concernées (DSR) et les évaluations des risques, ce qui fait gagner du temps à votre équipe. Vous bénéficiez également de bannières de confidentialité personnalisables pour renforcer les relations avec les clients. Sa capacité à s’intégrer à plus de 1 000 systèmes apporte une grande flexibilité, en faisant une excellente option pour les entreprises axées sur la confidentialité.

Fonctionnalités et intégrations phares :

Fonctionnalités : modèles de confidentialité personnalisables, outils d’évaluation des risques et workflows automatisés. Ketch permet de gérer facilement les consentements et les demandes de personnes concernées, améliorant ainsi la productivité en réduisant les tâches manuelles. La plateforme propose également une interface conviviale qui facilite le déploiement et l’intégration des utilisateurs.

Intégrations : Salesforce, HubSpot, Marketo, Microsoft Dynamics, Google Analytics, Adobe Experience Cloud, Amazon Web Services, Oracle, SAP et Workday.

Pros and Cons

Pros:

- Renforce la relation client

- Compatible avec plus de 1 000 intégrations

- Déploiement et intégration rapides

Cons:

- Options de personnalisation limitées

- Nécessite des mises à jour réglementaires continues

New Product Updates from Ketch

Ketch Expands Marketing Preference Management Capabilities

Ketch expands Marketing Preference Management, introducing capabilities for unifying consent, preferences, and zero-party data across systems. This update enables teams to activate customer data more effectively for personalized and compliant marketing. For more information, visit Ketch’s official site.

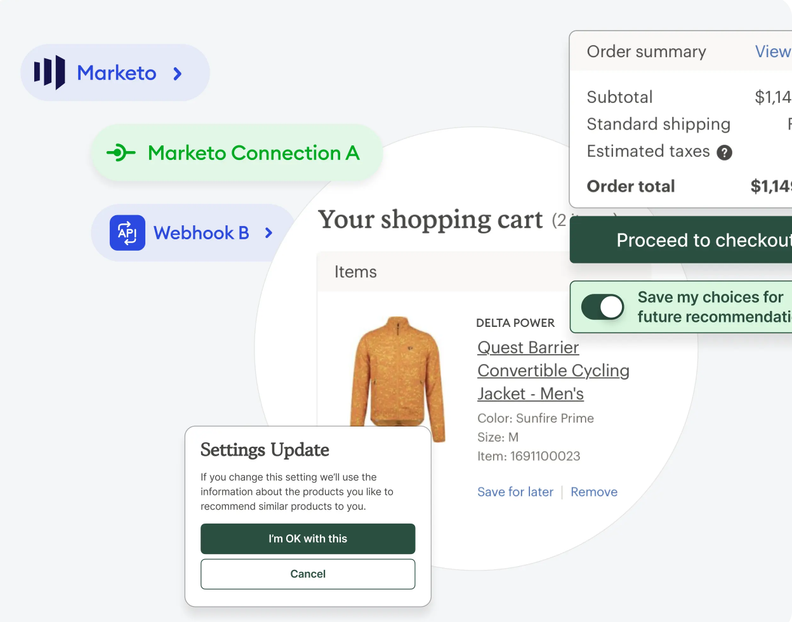

Pour les équipes à la recherche d'une solution DataOps fiable, DbVisualizer propose une plateforme polyvalente répondant à divers besoins en gestion de bases de données. Elle est idéale pour les professionnels des données de tous secteurs nécessitant un outil unifié pour gérer des bases complexes. Grâce à des fonctionnalités telles que l'édition SQL avancée et la visualisation robuste des données, DbVisualizer répond aux défis de l'intégration et de la gestion des données, en faisant un atout précieux pour optimiser les flux de travail de données.

Pourquoi j'ai choisi DbVisualizer

J'ai choisi DbVisualizer car ses outils SQL prêts pour les flux de travail s'adaptent parfaitement à la manière dont les équipes DataOps itèrent, valident et promeuvent les changements à travers les environnements. Vous pouvez collaborer sur des scripts SQL avec la gestion de version intégrée, ce qui facilite le suivi des mises à jour, le travail en branches et le maintien d'une piste d'audit claire des transformations. Les plans d'exécution visuels aident votre équipe à évaluer les performances des requêtes avant que les changements ne soient appliqués, réduisant ainsi les perturbations dans les pipelines. J'apprécie également le fait que vous puissiez automatiser l'exécution des scripts en dehors de l'interface utilisateur grâce à

Fonctionnalités clés de DbVisualizer

J'apprécie aussi que DbVisualizer propose :

- Exploration des données : Permet de parcourir et gérer facilement des structures de données complexes dans vos bases de données.

- Édition en ligne : Offre la possibilité de modifier directement les données dans les tables, simplifiant ainsi la manipulation des données.

- Gestion en ligne de commande : Prend en charge l'exécution de scripts et les tâches de gestion via une interface en ligne de commande, renforçant l'automatisation.

- Exportation/Importation de données : Facilite le transfert de données dans divers formats, favorisant une intégration et un partage des données sans faille.

Intégrations DbVisualizer

Les intégrations incluent DB2, MariaDB, SQL Server, MySQL, PostgreSQL, Oracle, Apache Derby, H2, SQLite et Sybase.

Pros and Cons

Pros:

- Accent mis sur la représentation visuelle des données pour une compréhension plus claire

- Éditeur SQL avancé avec fonctions telles que suggestions automatiques et mise en forme

- Prend en charge plusieurs types de bases de données, offrant une gestion polyvalente

Cons:

- Les ensembles de données volumineux peuvent parfois affecter les performances

- Les nouveaux utilisateurs peuvent rencontrer une courbe d'apprentissage légère

New Product Updates from DbVisualizer

DbVisualizer Adds AI Assistant and New Database Support

DbVisualizer introduces an AI assistant, OS-native file chooser support, and new database compatibility with Impala and Neo4j. These updates help users write SQL faster, simplify file handling, and expand database connectivity. For more information, visit DbVisualizer’s official site.

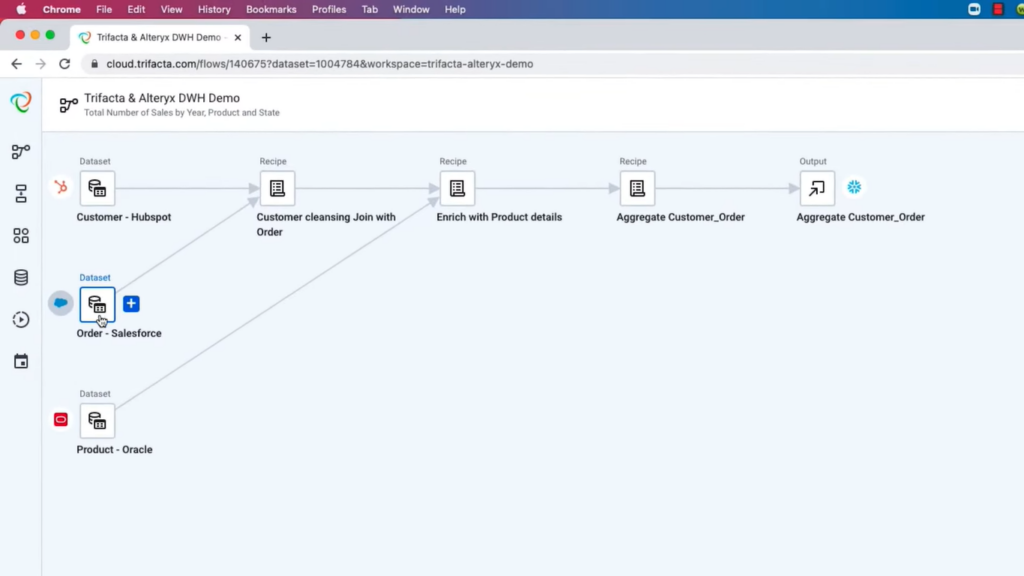

Alteryx est une plateforme d'analyse de données qui aide les utilisateurs à préparer, fusionner et analyser des données provenant de diverses sources. Elle propose des solutions à la fois sur ordinateur et dans le cloud, adaptées aux professionnels qui souhaitent automatiser les flux de travail liés aux données et obtenir des analyses efficaces.

Pourquoi j'ai choisi Alteryx : Vous pouvez automatiser les tâches répétitives de préparation des données grâce à l'interface glisser-déposer d'Alteryx. Elle propose plus de 300 outils sans code et à faible code, permettant à votre équipe de nettoyer, transformer et enrichir les données sans écrire de code. La plateforme prend en charge les données structurées et non structurées, vous permettant de gérer des ensembles de données variés. De plus, Alteryx propose des recommandations optimisées par l'IA pour améliorer vos flux de travail.

Fonctionnalités et intégrations remarquables :

Les fonctionnalités incluent des outils d'analyse géospatiale, permettant à votre équipe de réaliser des analyses basées sur la localisation. Vous pouvez également utiliser des fonctionnalités intégrées d'apprentissage automatique pour créer des modèles prédictifs sans connaissances approfondies en codage. Par ailleurs, Alteryx prend en charge le traitement des données en temps réel, vous permettant de prendre des décisions en fonction de données actuelles.

Les intégrations incluent des connexions avec Salesforce, Snowflake, Amazon Redshift, Google BigQuery, Microsoft Azure, Tableau, Power BI, Oracle, SAP et Databricks.

Pros and Cons

Pros:

- Propose des recommandations de workflow pilotées par IA

- Automatise des tâches complexes de préparation de données

- Gère les données structurées et non structurées

Cons:

- Possibilités limitées de visualisation des données

- Nécessite des licences séparées pour certaines fonctionnalités

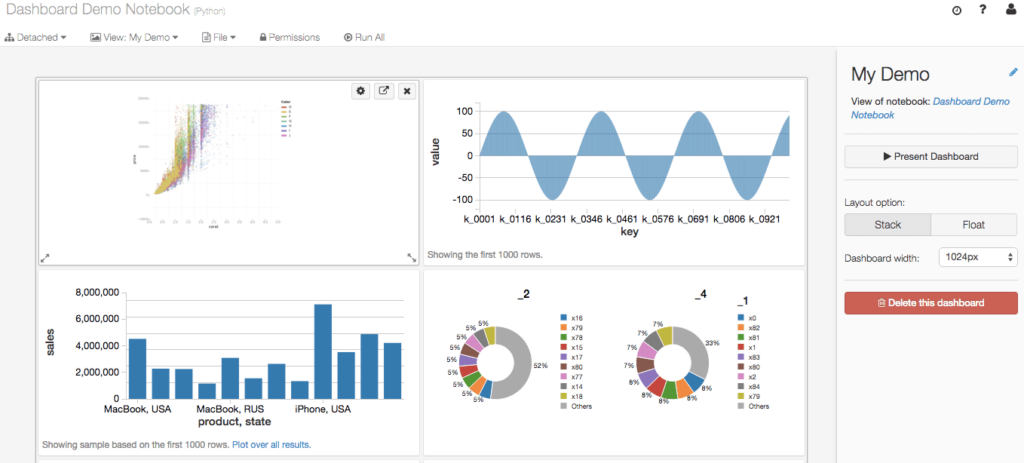

Databricks est une plateforme de données et d'IA conçue pour les entreprises, destinée aux ingénieurs, scientifiques et analystes de données. Elle propose des fonctionnalités de traitement des données, d'analytique et d'apprentissage automatique.

Pourquoi j'ai choisi Databricks : Elle excelle dans l’analyse de données à grande échelle, offrant des notebooks collaboratifs et Delta Lake pour la fiabilité des données. Votre équipe peut bénéficier de ses outils avancés d'apprentissage automatique, renforçant les capacités d’analyse. Le support robuste de la plateforme pour Apache Spark garantit un traitement efficace des données volumineuses. Son intégration flexible avec les principaux fournisseurs de cloud comme AWS, Azure et Google Cloud accroît son attrait pour les opérations à grande échelle.

Fonctionnalités et intégrations remarquables :

Fonctionnalités incluent des notebooks collaboratifs qui favorisent le travail d’équipe et l’innovation. Delta Lake assure la fiabilité et la cohérence des données, ce qui est crucial pour les tâches de big data. Les capacités d'apprentissage automatique de la plateforme permettent à votre équipe de concevoir et de déployer des modèles efficacement.

Intégrations incluent Apache Spark, AWS, Azure, Google Cloud, Tableau, Power BI, Snowflake, MongoDB, Looker et Qlik.

Pros and Cons

Pros:

- Intégrations cloud flexibles

- Prise en charge du traitement des big data

- Outils avancés d'apprentissage automatique

Cons:

- Structure tarifaire complexe

- Problèmes de performance occasionnels

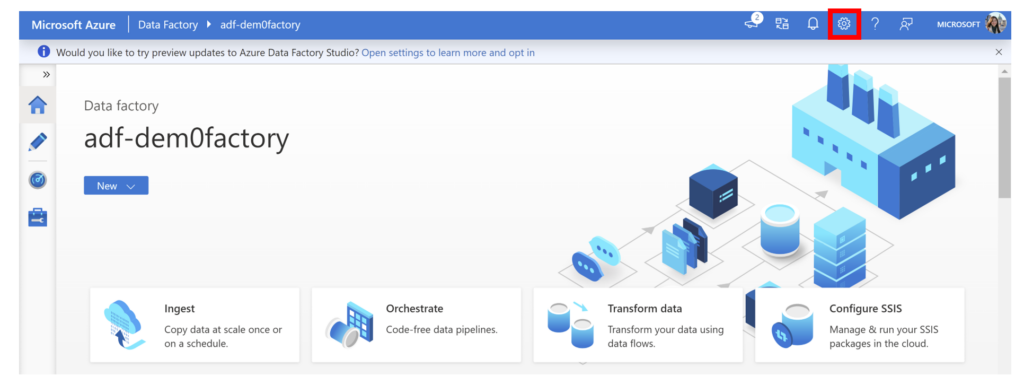

Azure Data Factory est un service d'intégration de données basé sur le cloud, destiné aux ingénieurs et analystes de données. Il facilite la création, la planification et l'orchestration des flux de travail de données, prenant en charge aussi bien les sources de données cloud que locales.

Pourquoi j'ai choisi Azure Data Factory : Il excelle dans l'intégration hybride des données, permettant à votre équipe de connecter des environnements de données variés. L'interface de type glisser-déposer simplifie la création de flux de travail complexes. Vous pouvez utiliser la planification intégrée pour automatiser le déplacement des données, réduisant ainsi les tâches manuelles. Les capacités de surveillance en temps réel offrent une visibilité sur les processus de données, améliorant l'efficacité opérationnelle.

Fonctionnalités et intégrations remarquables :

Les fonctionnalités incluent une interface intuitive de glisser-déposer pour concevoir des pipelines de données. Les outils de planification intégrés permettent d'automatiser les flux de données, ce qui permet de gagner du temps et des efforts. La surveillance en temps réel fournit une visibilité sur les opérations, aidant à identifier et résoudre rapidement les problèmes.

Les intégrations incluent Azure Blob Storage, Azure SQL Database, Azure Synapse Analytics, Amazon S3, Google BigQuery, Oracle, SAP, Salesforce, Teradata et IBM Db2.

Pros and Cons

Pros:

- Interface glisser-déposer facile d'utilisation

- Prise en charge d'environnements de données variés

- Capacités de surveillance en temps réel

Cons:

- Complexité de la configuration initiale

- Fonctionnalités hors ligne limitées

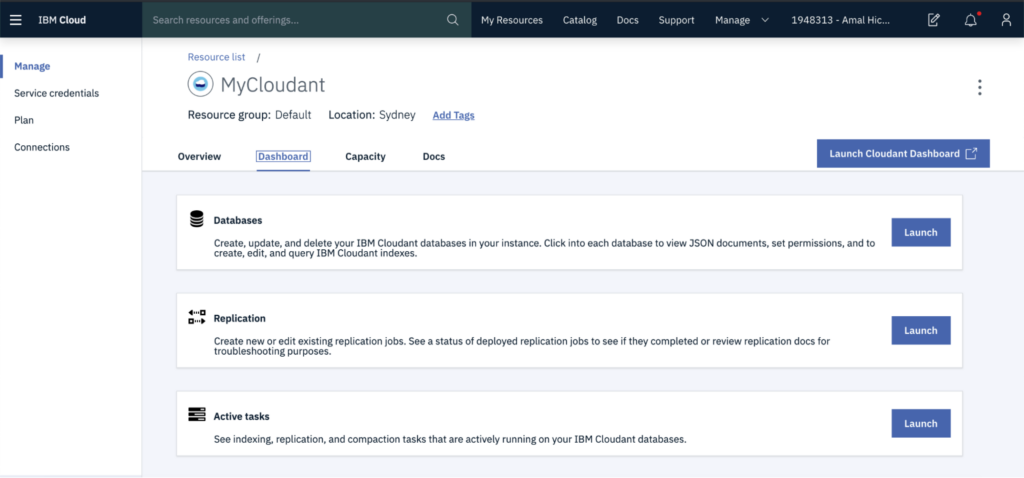

La plateforme DataOps d’IBM est conçue pour les grandes entreprises, destinée aux professionnels de l’informatique et aux ingénieurs en données. Elle met l’accent sur l’intégration, la gouvernance et la qualité des données, garantissant que vos opérations de données sont efficaces et fiables.

Pourquoi j’ai choisi IBM : Elle se distingue dans l’intégration de données d’entreprise, en proposant des outils comme le catalogage des données et la gouvernance. Vous pouvez automatiser les flux de travail, ce qui aide à maintenir la qualité des données dans toute votre organisation. La fonctionnalité de traçabilité (data lineage) de la plateforme offre de la transparence, vous permettant de suivre les sources et les transformations des données. Sa capacité de mise à l’échelle convient parfaitement aux grandes entreprises ayant besoin de gérer efficacement d’importantes quantités de données.

Fonctionnalités clés & intégrations :

Fonctionnalités incluent le catalogage des données pour vous aider à organiser vos actifs de données. Les outils de gouvernance de la plateforme assurent la conformité avec les réglementations sur les données. Des contrôles automatisés de la qualité des données permettent de garantir l’intégrité de vos ensembles de données.

Intégrations incluent IBM Cloud, AWS, Azure, Google Cloud, Hadoop, Apache Spark, Oracle, SAP, Salesforce et Tableau.

Pros and Cons

Pros:

- Outils complets de gouvernance des données

- Gestion des opérations de données à grande échelle

- Contrôles automatisés de la qualité

Cons:

- Peut présenter une courbe d’apprentissage importante

- Options de personnalisation limitées

Apache Hive est une solution d'entreposage de données principalement destinée aux analystes et ingénieurs de données. Elle permet d'interroger et de gérer de grands ensembles de données stockés dans un stockage distribué.

Pourquoi j'ai choisi Apache Hive : Il propose des requêtes de type SQL, ce qui est idéal pour les utilisateurs familiers avec SQL. L'intégration de l'outil avec Hadoop le rend adapté à l'analyse efficace de grands ensembles de données. Apache Hive prend en charge divers formats de données, offrant à votre équipe une flexibilité dans la gestion des données. Sa capacité à gérer facilement des requêtes complexes en fait un choix fiable pour les entreprises axées sur les données.

Fonctionnalités et intégrations remarquables :

Fonctionnalités : incluent un langage de requête similaire à SQL, ce qui simplifie l'apprentissage et l'adoption. Il prend en charge l'indexation pour améliorer les performances des requêtes, rendant la récupération des données plus rapide. Apache Hive propose également le partitionnement, ce qui aide à gérer et à interroger efficacement de grands ensembles de données.

Intégrations : incluent Hadoop, HDFS, HBase, Amazon S3, Azure Blob Storage, Google Cloud Storage, Apache Spark, Apache Pig, Apache Tez et Apache Ranger.

Pros and Cons

Pros:

- Langage de requête similaire à SQL

- Prend en charge les requêtes de données complexes

- Gère efficacement de grands ensembles de données

Cons:

- Pas idéal pour l'analyse en temps réel

- Les performances varient selon la taille des données

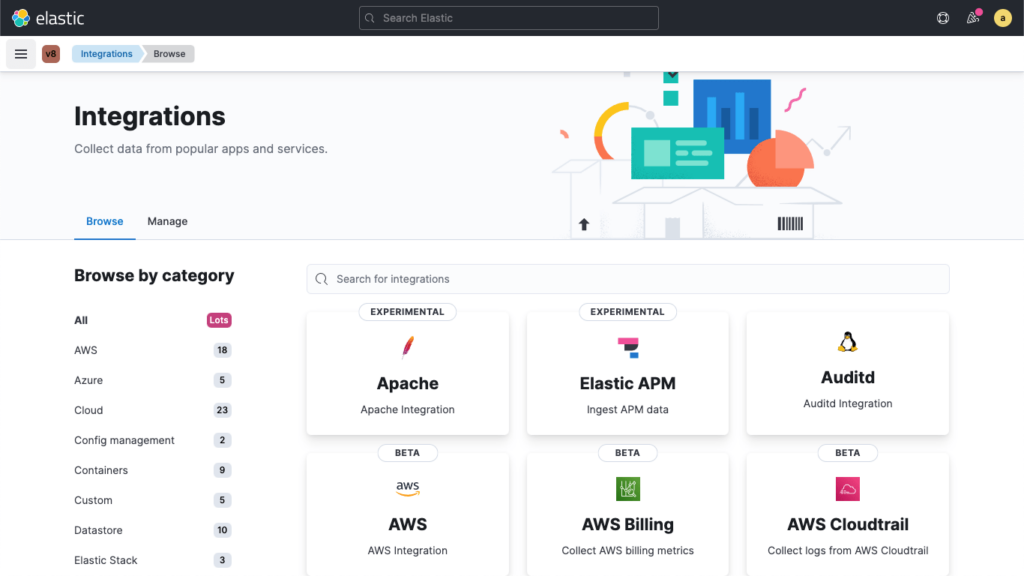

Elastic est un moteur de recherche et d'analyse open source qui fournit des informations en temps réel à partir de vos données. Sa fonction principale est de stocker, rechercher et analyser d'énormes volumes de données rapidement et presque en temps réel. Cela rend Elastic particulièrement performant pour les tâches de recherche et d'analyse de données en temps réel.

Pourquoi j'ai choisi Elastic :

J'ai choisi Elastic en raison de ses capacités de recherche à grande vitesse et de son aptitude à gérer efficacement de vastes ensembles de données. Ses puissantes fonctionnalités de recherche, associées à ses capacités d'analyse en temps réel, permettent à Elastic de se distinguer des autres outils.

Sur la base de ces capacités, j'ai estimé qu'Elastic est le meilleur outil pour la recherche et l'analyse de données en temps réel.

Fonctionnalités et intégrations remarquables :

Parmi les fonctionnalités figurent la recherche en texte intégral, la recherche distribuée et l'analyse en temps réel. Sa fonctionnalité d'agrégation en temps réel et à plusieurs niveaux aide les utilisateurs à explorer et à analyser leurs données de manière plus intuitive.

Les intégrations comprennent de nombreux outils de collecte et de visualisation de données, notamment Logstash pour la centralisation des journaux et Kibana pour la visualisation des données.

Pros and Cons

Pros:

- Fournit des résultats de recherche rapides et efficaces

- Peut gérer de grands ensembles de données

- Flexible avec les formats de données

Cons:

- Configurer et optimiser Elastic pour des cas d'utilisation spécifiques peut être complexe

- Bien que la pile Elastic de base soit gratuite, les fonctionnalités avancées sont payantes

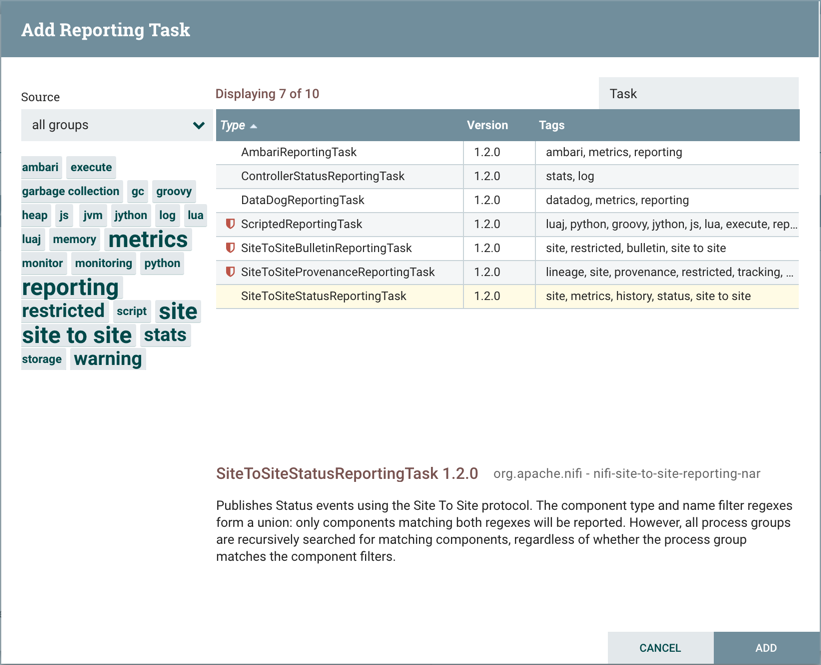

Apache NiFi est une plateforme logistique de données intégrée pour automatiser le déplacement de données entre des systèmes disparates. Elle offre un contrôle en temps réel qui la rend réactive aux flux de big data hautement volatils, ce qui en fait le choix idéal pour l'ingestion et le streaming de données en temps réel.

Pourquoi j'ai choisi Apache NiFi :

J'ai choisi Apache NiFi pour ses capacités de routage et de transformation de données à haute vitesse. Son architecture unique permet de suivre les données en temps réel et de créer des flux de données dynamiques et réactifs. Ces fonctionnalités marquantes sont la raison pour laquelle je considère qu'Apache NiFi est le meilleur choix pour l'ingestion et le streaming de données en temps réel.

Fonctionnalités et intégrations remarquables :

Fonctionnalités : interface web hautement configurable, traçabilité des données depuis leur origine jusqu'à leur consommation (provenance des données), et capacité de mise à l'échelle flexible.

Intégrations : HTTP, AMQP, HDFS et base de données via JDBC.

Pros and Cons

Pros:

- Contrôle en temps réel des flux de données

- Capacités étendues de routage et de transformation des données

- Open-source et personnalisable

Cons:

- La configuration et la mise en place peuvent être complexes

- Absence de support direct par un fournisseur en raison de sa nature open-source

Autres outils DataOps

Voici quelques alternatives DataOps supplémentaires qui n’ont pas intégré ma sélection, mais qui méritent tout de même votre attention :

- RightData

Idéal pour les tests et la validation des données

- StreamSets

Idéal pour le mouvement de données en temps réel

- HighByte

Idéal pour l'intégration de données industrielles

- DataKitchen

Idéal pour l'orchestration DataOps

- Badook

Idéal pour la surveillance de la qualité des données

Critères de sélection des outils DataOps

Pour sélectionner les meilleurs outils DataOps de cette liste, j’ai pris en compte les besoins fréquents des acheteurs et les difficultés courantes telles que les problèmes d’intégration des données et le maintien de la qualité des données. J’ai également utilisé le cadre suivant pour garantir une évaluation structurée et équitable :

Fonctionnalités fondamentales (25 % du score total)

Pour figurer dans cette sélection, chaque solution devait répondre à ces cas d’usage communs :

- Intégration et transformation des données

- Gestion de la qualité des données

- Automatisation des workflows

- Traitement des données en temps réel

- Conformité et gouvernance

Fonctionnalités supplémentaires remarquables (25 % du score total)

Pour affiner davantage la sélection, j’ai également recherché des fonctionnalités uniques, telles que :

- Flux de données personnalisables

- Suivi avancé de la traçabilité des données

- Fonctionnalités d'apprentissage automatique

- Détection d'anomalies en temps réel

- Architecture évolutive

Facilité d’utilisation (10% du score total)

Pour évaluer la facilité d’utilisation de chaque système, j’ai pris en compte les éléments suivants :

- Interface utilisateur intuitive

- Facilité de navigation

- Tableaux de bord personnalisables

- Courbe d’apprentissage minimale

- Design adaptatif

Onboarding (10% du score total)

Pour évaluer l’expérience d’onboarding de chaque plateforme, j’ai considéré les points suivants :

- Disponibilité de vidéos de formation

- Découvertes produit interactives

- Documentation complète

- Accès à des webinaires

- Chatbots d’assistance

Support client (10% du score total)

Pour évaluer les services de support client offerts par chaque éditeur de logiciel, j’ai pris en compte les critères suivants :

- Support disponible 24h/24 et 7j/7

- Options de support multi-canaux

- Équipe de support qualifiée

- Délais de réponse rapides

- Disponibilité de forums communautaires

Rapport qualité/prix (10% du score total)

Pour mesurer le rapport qualité/prix de chaque plateforme, j’ai analysé les critères suivants :

- Tarification compétitive

- Abonnements flexibles

- Structure tarifaire transparente

- Disponibilité d’essais gratuits

- Rapport coût-bénéfice

Avis clients (10% du score total)

Pour mieux comprendre la satisfaction des clients, voici les points que j’ai examinés lors de la lecture des avis :

- Notes globales de satisfaction

- Points de douleur fréquemment mentionnés

- Éloges sur certaines fonctionnalités

- Retours sur le support client

- Fréquence des mises à jour et améliorations

Comment choisir des outils DataOps

Il est facile de se perdre dans de longues listes de fonctionnalités et des structures tarifaires complexes. Pour vous aider à rester concentré tout au long de votre processus de sélection logiciel, voici une liste de facteurs à garder à l’esprit :

| Facteur | À considérer |

| Scalabilité | Assurez-vous que l’outil puisse évoluer selon vos besoins. Recherchez des fonctionnalités qui prennent en charge de grands ensembles de données et une croissance du nombre d’utilisateurs. |

| Intégrations | Vérifiez la compatibilité avec vos systèmes existants. Assurez-vous qu’il prend en charge les API, bases de données et applications tierces déjà utilisées. |

| Personnalisation | Évaluez la capacité de l’outil à s’adapter à vos processus. Cherchez la possibilité de personnaliser tableaux de bord, flux de travail et rapports. |

| Facilité d’utilisation | Examinez l’interface utilisateur et la courbe d’apprentissage. Votre équipe doit le trouver intuitif et facile à adopter rapidement. |

| Budget | Évaluez le coût total, frais cachés inclus. Comparez les formules pour vérifier leur adéquation à vos contraintes budgétaires. |

| Sécurité | Analysez les fonctionnalités de sécurité de l’outil. Assurez-vous qu’il respecte les normes de protection et propose un chiffrement des données. |

| Support | Vérifiez la disponibilité de l’assistance client. Recherchez une aide 24h/24 et 7j/7, de la documentation et des ressources de formation. |

| Performance | Testez la rapidité et la fiabilité. L’outil doit traiter les données efficacement, sans latence. |

Tendances des outils DataOps

Au cours de mes recherches, j’ai analysé de nombreuses mises à jour produits, communiqués de presse et journaux de versions issus des éditeurs d’outils DataOps. Voici quelques tendances émergentes que je surveille de près :

- Analyses pilotées par l'IA : De plus en plus d'outils utilisent l'intelligence artificielle pour fournir des analyses prédictives et des informations. Cela aide les équipes à anticiper les problèmes et à optimiser les processus. Des éditeurs comme Alteryx intègrent l'IA pour renforcer les capacités d'analyse de données.

- Traitement des données en temps réel : La demande pour le traitement des données en temps réel est en augmentation. Cela permet aux entreprises de prendre des décisions plus rapidement à partir d'informations actualisées. Des outils comme StreamSets sont spécialisés dans le déplacement de données en temps réel pour répondre à ce besoin.

- Amélioration de la gouvernance des données : Les entreprises mettent l'accent sur des fonctionnalités renforcées de gouvernance de données. Cela garantit la conformité aux réglementations ainsi qu'une meilleure qualité des données. La plateforme DataOps d'IBM propose de solides outils de gouvernance pour répondre à ces préoccupations.

- Fonctionnalités en libre-service : On observe un mouvement vers l'autonomisation des utilisateurs non techniques grâce à des options en libre-service. Ceci rend les tâches liées aux données plus accessibles à toutes les équipes. Talend ajoute régulièrement des fonctionnalités en libre-service pour simplifier l'intégration des données.

- Architectures cloud-native : De plus en plus d'outils sont conçus pour les environnements cloud. Cela offre une plus grande flexibilité et une meilleure évolutivité aux entreprises qui gèrent de grands volumes de données. Azure Data Factory illustre parfaitement cette tendance avec ses services d'intégration de données en mode cloud-native.

Que sont les outils DataOps ?

Les outils DataOps sont des solutions logicielles conçues pour automatiser et améliorer les processus de gestion des données. Les ingénieurs de données, analystes et professionnels IT utilisent généralement ces outils pour améliorer la qualité, la gouvernance et l'intégration des données.

Le traitement en temps réel, les analyses pilotées par l’IA et le libre-service contribuent à optimiser les flux de travail, garantir la conformité et rendre la donnée accessible. Associées à des outils de surveillance des données performants, ces solutions augmentent l'efficience et la précision dans les opérations sur les données, permettant aux entreprises de prendre de meilleures décisions.

Fonctionnalités des outils DataOps

Lorsque vous choisissez des outils DataOps, gardez un œil sur les fonctionnalités clés suivantes :

- Traitement des données en temps réel : Permet une analyse immédiate des données afin que les entreprises puissent prendre rapidement des décisions sur la base d'informations actuelles.

- Analyses pilotées par l'IA : Fournissent des analyses prédictives aidant les équipes à anticiper les problèmes et optimiser les processus de données.

- Gouvernance des données : Garantit la conformité aux réglementations ainsi que le maintien de la qualité des données à travers l'ensemble des opérations.

- Fonctionnalités en libre-service : Permettent aux utilisateurs non techniques de gérer les tâches de données de façon autonome, ce qui accroît l’accessibilité.

- Architecture cloud-native : Offre flexibilité et évolutivité pour la gestion de grands ensembles de données dans des environnements cloud.

- Flux de travail automatisés : Rationalisent la gestion des tâches liées aux données, réduisant ainsi l’effort manuel et minimisant les erreurs.

- Tableaux de bord personnalisables : Permettent à chaque utilisateur d’adapter la visualisation des données selon ses besoins pour mieux comprendre les informations.

- Suivi de la traçabilité des données : Apporte de la transparence en affichant l’origine et la transformation des données, ce qui garantit leur exactitude.

- Support de l'intégration : Facilite la circulation fluide des données entre différents systèmes et applications, renforçant ainsi la compatibilité.

- Gestion des erreurs : Identifie et résout rapidement les problèmes pour limiter les perturbations dans le traitement des données.

Avantages des outils DataOps

La mise en œuvre d’outils DataOps offre de nombreux avantages à votre équipe et à votre entreprise. Voici ceux auxquels vous pouvez vous attendre :

- Meilleure qualité des données : Les flux de travail automatisés et la gouvernance des données garantissent que vos données sont exactes et fiables.

- Prise de décision plus rapide : Le traitement des données en temps réel permet à votre équipe d’agir immédiatement sur les nouvelles informations.

- Meilleure conformité : Des fonctions avancées de gouvernance des données aident votre entreprise à répondre facilement aux exigences réglementaires.

- Accessibilité accrue : Les outils de catalogage de données dotés de fonctionnalités en libre-service permettent aux utilisateurs non techniques de prendre en main les tâches liées aux données, élargissant ainsi l’accès.

- Évolutivité : L’architecture cloud-native accompagne la croissance de vos données sans sacrifier les performances.

- Réduction des interventions manuelles : Les workflows automatisés et la gestion des erreurs limitent les tâches répétitives et libèrent du temps pour vos équipes.

- Meilleure collaboration : Les tableaux de bord personnalisables et les analyses en temps réel favorisent le travail d’équipe et la prise de décision informée.

Coûts et tarification des outils DataOps

La sélection des outils DataOps nécessite une compréhension des différents modèles de tarification et des plans disponibles. Les coûts varient selon les fonctionnalités, la taille de l'équipe, les modules complémentaires et plus encore. Les plateformes populaires vont des solutions cloud natives aux alternatives à Databricks spécialisées dans l'analytique unifiée et les workflows de machine learning. Le tableau ci-dessous résume les plans courants, leurs prix moyens et les fonctionnalités typiques incluses dans les solutions DataOps :

Tableau comparatif des plans pour les outils DataOps

| Type de plan | Prix moyen | Fonctionnalités courantes |

| Plan gratuit | $0 | Intégration de données de base, stockage limité et support communautaire. |

| Plan personnel | $10-$30/utilisateur/mois | Intégration de données, analytique de base, automatisation limitée et support par e-mail. |

| Plan entreprise | $50-$100/utilisateur/mois | Analytique avancée, automatisation, gouvernance des données et support prioritaire. |

| Plan entreprise avancé | $150-$300/utilisateur/mois | Intégrations personnalisées, automatisation complète, sécurité renforcée et support dédié. |

Outils DataOps : FAQ

Voici quelques réponses aux questions courantes sur les outils DataOps :

Quelles sont les considérations importantes pour mettre en œuvre DataOps ?

Pour mettre en place DataOps, vous devez constituer des équipes transverses pour favoriser la collaboration entre data engineers, développeurs et analystes. Choisissez les outils adaptés à vos besoins et établissez des processus clairs pour votre équipe. Automatisez les tâches répétitives afin de gagner du temps, puis surveillez et améliorez constamment vos processus.

Quels sont les trois pipelines de DataOps ?

DataOps implique généralement trois types de pipelines : Production, Développement et Environnement. Chacun a un rôle spécifique dans la gestion des flux de données. Les pipelines Production traitent les données en direct, les pipelines Développement sont dédiés au test et à la construction, et les pipelines Environnement gèrent les configurations. Comprendre ces pipelines permet d’orchestrer des workflows efficaces.

En quoi DataOps diffère-t-il de DevOps ?

Alors que DevOps vise à unifier les équipes de développement et d’exploitation pour la livraison logicielle, DataOps cherche à supprimer les silos entre producteurs et consommateurs de données. L’objectif est de rendre les données plus accessibles et utiles. DataOps mise sur la collaboration entre toutes les équipes liées aux données pour améliorer leur gestion et leur utilisation.

Quels sont les avantages clés de l'automatisation des tâches DataOps ?

L’automatisation des tâches DataOps peut fortement améliorer l’efficacité en réduisant le travail manuel. Ces outils Database DevOps assurent la cohérence des processus de données et aident à maintenir leur qualité. L’automatisation permet aussi à votre équipe de se concentrer sur les missions stratégiques, ce qui accroît la productivité et accélère la prise de décision.

Comment les outils DataOps soutiennent-ils la gouvernance des données ?

Les outils DataOps offrent des fonctionnalités pour appliquer les politiques de gouvernance des données. Ils donnent de la visibilité sur les processus de données, facilitant le respect des réglementations. En retraçant la traçabilité et en fournissant des pistes d’audit, ces outils garantissent l’intégrité des données et leur transparence dans l’entreprise.

Pourquoi le traitement des données en temps réel est-il important dans DataOps ?

Le traitement des données en temps réel permet à vos équipes d’accéder aux informations les plus récentes et facilite une prise de décision rapide. Cela répond aux besoins dynamiques de l’entreprise grâce à des analyses à jour. Cette capacité est essentielle dans les secteurs où la réactivité face au marché et la compétitivité exigent une actualité parfaite des données.

Et ensuite ?

Accélérez la croissance de votre SaaS et développez vos compétences en leadership.

Abonnez-vous à notre newsletter pour recevoir les dernières analyses des CTO et des futurs leaders technologiques.

Nous vous aiderons à évoluer plus intelligemment et à diriger plus efficacement grâce à des guides, ressources et stratégies partagés par les meilleurs experts !