Beste ETL-Tools: Unsere Auswahl

Die besten ETL-Tools helfen Teams, Daten automatisch aus verschiedenen Quellen zu extrahieren, sie zu bereinigen und zu formatieren und anschließend in Data Warehouses oder Analysesysteme zu laden – für Echtzeit-Einblicke. So erleichtern sie die Pflege konsistenter, präziser Datensätze und reduzieren manuellen Aufwand sowie wiederkehrende Wartung von Datenpipelines.

Meistens suchen Teams nach ETL-Lösungen, wenn sie zu viel Zeit mit der Reparatur fehlerhafter Pipelines, widersprüchlichen Datenformaten oder langen Wartezeiten für aktualisierte Berichte verbringen. Manuelle Prozesse und Alt-Skripte können mit dem Datenvolumen und der Frequenz moderner Umgebungen oft nicht mehr Schritt halten – Verzögerungen, Fehler und unzuverlässige Dashboards sind die Folge.

Ich habe mit Datenengineering- und Analyse-Teams zusammengearbeitet, um ETL-Workflows in Cloud- und On-Premises-Umgebungen zu implementieren und zu optimieren und dabei Tools auf Skalierbarkeit, Flexibilität bei Transformationen und Integrationsfähigkeit in moderne Daten-Stacks getestet.

In diesem Leitfaden erfahren Sie, welche ETL-Plattformen Ihre Datenprozesse tatsächlich schneller, zuverlässiger und wartungsfreundlicher machen – ohne zusätzliche Komplexität zu schaffen.

Why Trust Our Software Reviews

We’ve been testing and reviewing software since 2023. As tech leaders ourselves, we know how critical and difficult it is to make the right decision when selecting software.

We invest in deep research to help our audience make better software purchasing decisions. We’ve tested more than 2,000 tools for different tech use cases and written over 1,000 comprehensive software reviews. Learn how we stay transparent & our software review methodology.

Zusammenfassung: Beste ETL-Tools

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Am besten geeignet für die Integration von Tabellenkalkulationen mit Datenquellen | Kostenloser Plan verfügbar | Ab $49/Monat (jährliche Abrechnung) | Website | |

| 2 | Am besten geeignet für zuverlässige Unternehmens-Datenpipelines | 14-tägige kostenlose Testversion + kostenlose Demo verfügbar | Ab $239/Monat (jährliche Abrechnung) | Website | |

| 3 | Am besten geeignet für die Extraktion von Daten aus mehreren Quellen | Kostenlose Demo verfügbar | Preis auf Anfrage | Website | |

| 4 | Am besten geeignet für umfangreiche Datenumwandlungen | kostenlose Demo verfügbar | Ab $1.999/Monat | Website | |

| 5 | Beste Drag-and-Drop-Konsole | Kostenloser Plan verfügbar | Ab $0,60/Monat (für Aktivitäten mit niedriger Frequenz) | Website | |

| 6 | Bestes serverloses ETL-Tool | Kostenloser Plan verfügbar | Preis auf Anfrage | Website | |

| 7 | Am besten geeignet für die Batch-Datenextraktion | Kostenlose Testversion auf Anfrage | Preis auf Anfrage | Website | |

| 8 | Am besten geeignet für große Datenspeicherung | Not available | Kostenlos | Website | |

| 9 | Am besten für Integrationen | Kostenlose Testversion mit kostenpflichtigen Tarifen | $0.7742 OCPU pro Stunde | Website | |

| 10 | Am besten geeignet für die Kombination von Daten | Keine kostenlose Testversion | $1.913/Stunde (Enterprise) | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Bewertungen: Beste ETL-Tools

Nachfolgend finden Sie meine detaillierten Zusammenfassungen der besten ETL-Tools aus meiner Auswahl. In den Bewertungen gebe ich einen genauen Überblick über die wichtigsten Funktionen, Vor- & Nachteile, Integrationen und ideale Anwendungsszenarien jedes Tools – damit Sie die passende Lösung für sich finden.

Am besten geeignet für die Integration von Tabellenkalkulationen mit Datenquellen

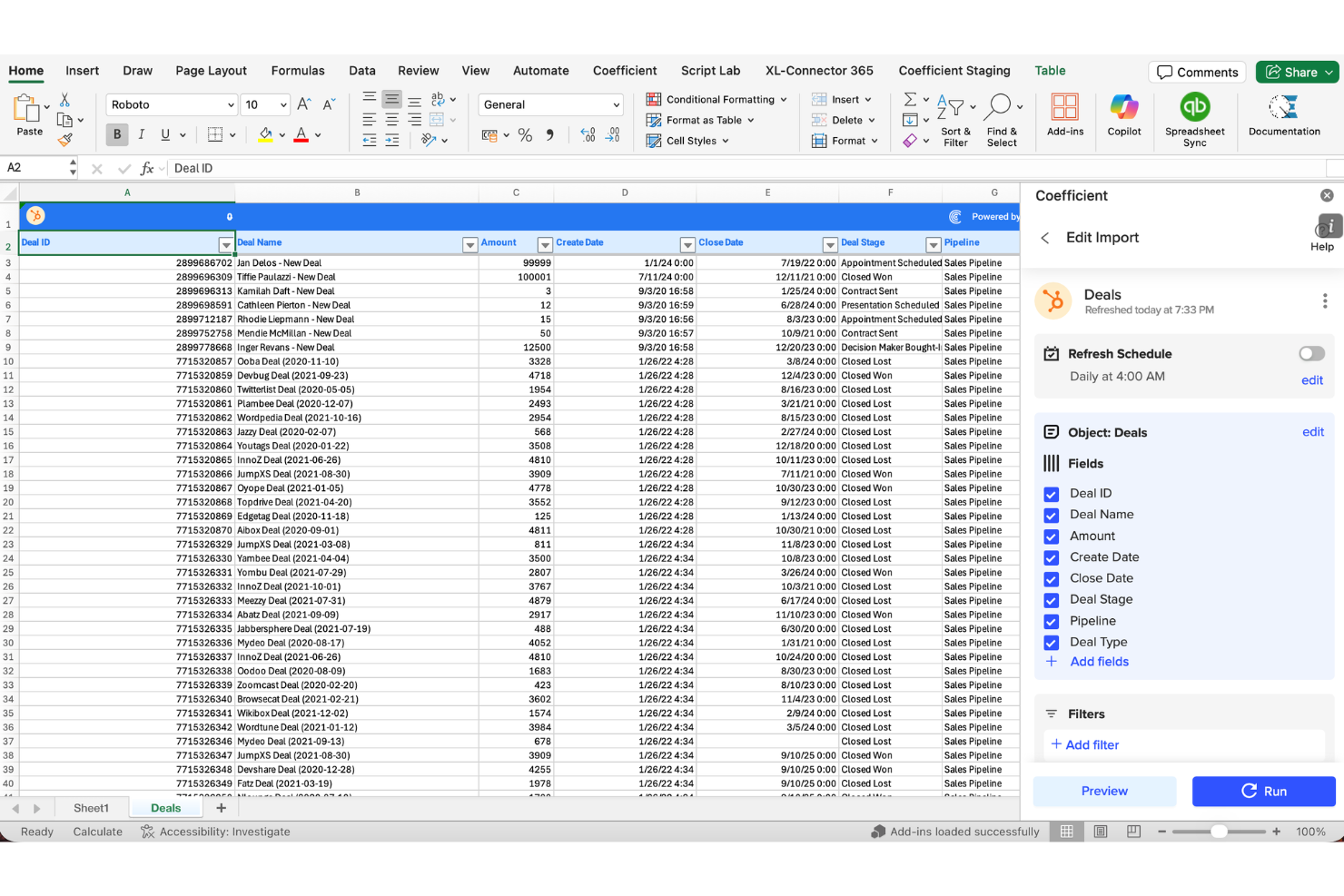

Für Fachleute, die effiziente ETL-Lösungen suchen, bietet Coefficient eine überzeugende Option, indem es Google Sheets und Excel mit über 100 Datenquellen verbindet. Besonders attraktiv ist es für Unternehmen in den Bereichen Finanzen, Marketing und Revenue Operations, wo Echtzeit-Datenanalyse und Automatisierung entscheidend sind. Durch den Verzicht auf Programmierung vereinfacht Coefficient die Erstellung komplexer Datenanwendungen und löst Herausforderungen wie Datenmanagement und Produktivitätssteigerung.

Warum ich Coefficient gewählt habe

Ich habe Coefficient aufgrund seiner einzigartigen Fähigkeit ausgewählt, Tabellenkalkulationen mit einer Vielzahl von Datenquellen zu verbinden – ein wesentliches Merkmal jedes ETL-Tools. Funktionen wie die Beibehaltung von Formeln und Daten-Snapshots stechen hervor, da sie Teams ermöglichen, Daten mühelos zu verwalten und zu transformieren. Darüber hinaus unterstützen Werkzeuge wie der Google Sheets Assistant und der SQL Query Builder Anwender bei der Bewältigung komplexer Aufgaben, ohne dass umfangreiche technische Kenntnisse erforderlich sind. Diese Fähigkeiten machen Coefficient zu einem wertvollen Werkzeug für Unternehmen, die ihre Datenprozesse optimieren möchten.

Wichtige Funktionen von Coefficient

Neben seinen Integrationsfähigkeiten bietet Coefficient mehrere bemerkenswerte Funktionen:

- Echtzeit-Datenanalyse: Arbeiten Sie direkt in Tabellen mit aktuellen Geschäftsdaten.

- KI-gestützte Dashboards: Erstellen Sie dynamische Dashboards, die sich automatisch mit den neuesten Erkenntnissen aktualisieren.

- Anbindung an beliebige APIs: Ziehen Sie Daten aus individuellen oder internen Systemen, ohne separate Pipelines erstellen zu müssen.

- No-Code-Anwendungserstellung: Erstellen Sie Datenanwendungen wie Provisions-Tracker und Marketing-Dashboards ohne Programmierkenntnisse.

Coefficient-Integrationen

Zu den Integrationen gehören Salesforce, QuickBooks, Snowflake, HubSpot, Google Analytics, Slack, Stripe, Shopify und mehr.

Pros and Cons

Pros:

- Reduziert manuelle Aktualisierungen und sich wiederholende Berichtserstellung

- Stellt Geschäftsdaten in Echtzeit ohne aufwändige Pipelines bereit

- Unterstützt sowohl vorgefertigte als auch API-basierte Integrationen

Cons:

- Weniger ideal für hochspezialisierte Dateninfrastrukturen

- Am besten geeignet für unternehmensfreundliche ETL-Workflows

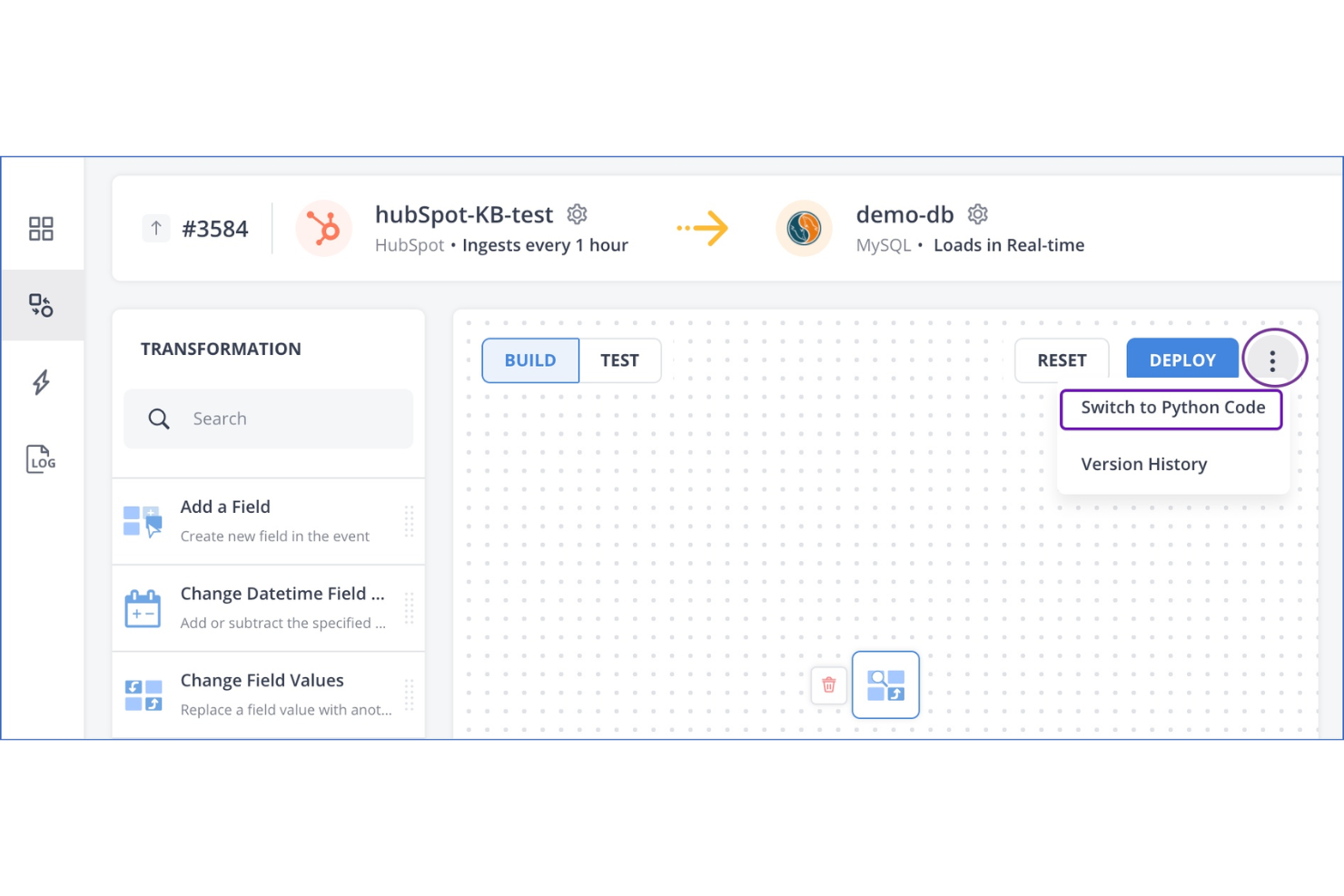

Hevo ist eine No-Code-ETL- und Datenintegrationsplattform, die für Unternehmen entwickelt wurde, die ihre Datenpipelines automatisieren möchten. Sie unterstützt Unternehmen, indem sie Verbindungen zu über 150 Datenquellen ohne Programmieraufwand ermöglicht und so die Effizienz im Datenmanagement steigert.

Warum ich Hevo ausgewählt habe: Basierend auf einer Kafka-Architektur liefert Hevo Daten mit geringer Latenz, sodass Ihre Analysen und Geschäftsentscheidungen auf den aktuellsten Informationen basieren. Diese Echtzeitverarbeitung ist entscheidend für Anwendungen, die auf aktuelle Daten angewiesen sind. Mit über 150 vorgefertigten Konnektoren erleichtert es die Datenextraktion und -integration aus verschiedenen Plattformen und unterstützt Unternehmen, die auf mehrere Datenquellen angewiesen sind. Darüber hinaus erkennt Hevo das Schema Ihrer Quelldaten automatisch und repliziert es in Ihr Zielsystem, sodass Ihr Data Warehouse selbst bei Änderungen in der Quellstruktur synchron bleibt.

Hervorstechende Funktionen und Integrationen von Hevo:

Funktionen beinhalten Transformationen vor und nach dem Laden, mit denen Sie Ihre Daten bereinigen, formatieren und standardisieren können, entweder bevor sie in Ihr Warehouse gelangen oder danach, damit sie für die Analyse bereit sind. Hevo bietet auch eine REST-API, mit der Sie die Plattform in Ihre bestehenden Workflows integrieren und Pipelines programmatisch auslösen können.

Integrationen umfassen MongoDB, Google Analytics, Salesforce, HubSpot, Azure Synapse Analytics, BigQuery, Snowflake, Redshift, Mailchimp, Klaviyo, WordPress, Pipedrive und mehr.

Pros and Cons

Pros:

- Die Plattform unterstützt eine große Bandbreite an Datenquellen

- Echtzeit-Datensynchronisierung

- Automatisiertes Schemamanagement und Fehlerbehandlung

Cons:

- Das Bearbeiten etablierter Pipelines kann herausfordernd sein

- Preisgestaltung könnte für kleine Unternehmen problematisch sein

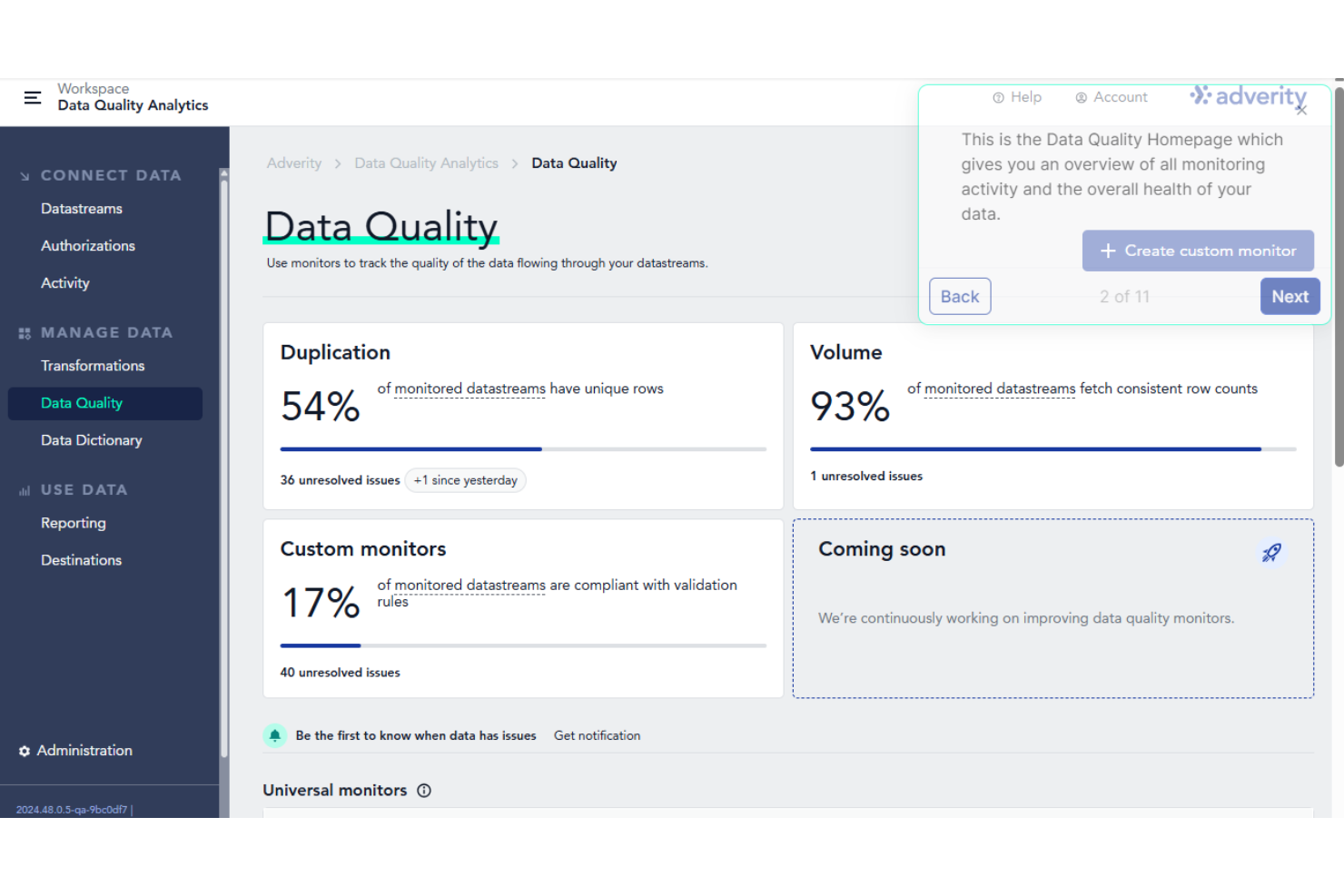

Adverity

Am besten geeignet für die Extraktion von Daten aus mehreren Quellen

Adverity ist eine Datenplattform, die Teams dabei unterstützt, ihre Daten zu verwalten und zu verstehen. Sie bietet Werkzeuge zum Sammeln, Verarbeiten und Verteilen von Daten und zielt darauf ab, die Arbeit mit Informationen zu erleichtern.

Warum ich Adverity ausgewählt habe: Ich habe Adverity ausgewählt, weil es ermöglicht, Daten aus mehreren Quellen zu extrahieren, sie nach eigenen Regeln zu transformieren und in bevorzugte Ziele zu laden. Die Connect-Funktion trägt dazu bei, alle Daten zusammenzuführen und verschafft Ihnen so einen vollständigen Überblick über Ihre Arbeitsgrundlage. Die Transform-Funktion ist hilfreich, um Daten vor der Analyse zu bereinigen und zu standardisieren – ein entscheidender Schritt für jeden ETL-Prozess. Außerdem lassen sich diese Arbeitsschritte automatisieren, um Datenpipelines reibungslos am Laufen zu halten. Diese Fähigkeiten machen Adverity zu einer guten Wahl für Teams, die ETL-Prozesse effizienter steuern möchten.

Herausragende Adverity-Funktionen und Integrationen:

Funktionen beinhalten Monitoring, das den Nutzern hilft, den Status und die Qualität ihrer Daten im Blick zu behalten. Dies unterstützt dabei, Probleme oder Inkonsistenzen in den Daten aufzudecken. Außerdem ermöglicht die Share-Funktion Teams, ihre Daten an verschiedene Ziele zu verteilen, was die Zusammenarbeit sowie weitere Analysen erleichtert.

Integrationen umfassen Google, Meta, TikTok, Google BigQuery, Looker Studio, Facebook Ads, Amazon Advertising, Hubspot, Salesforce, Amazon S3, Snowflake und Microsoft Azure.

Pros and Cons

Pros:

- Automatisierte Überwachung der Datenqualität

- Kann Daten aus verschiedenen Quellen harmonisieren

- Ermöglicht die Erstellung individueller Dashboards

Cons:

- Für bestimmte Konfigurationen sind technische Kenntnisse erforderlich

- Der initiale Einrichtungsaufwand kann zeitintensiv sein

New Product Updates from Adverity

Adverity Enhances Connectors and Adds TikTok GMV Max

Adverity updates connectors for Amazon Ads, SmartNews Ads, Indeed, and monday.com, and introduces the TikTok GMV Max connector. These updates improve data accuracy, control, and performance across integrations. For more information, visit Adverity’s official site.

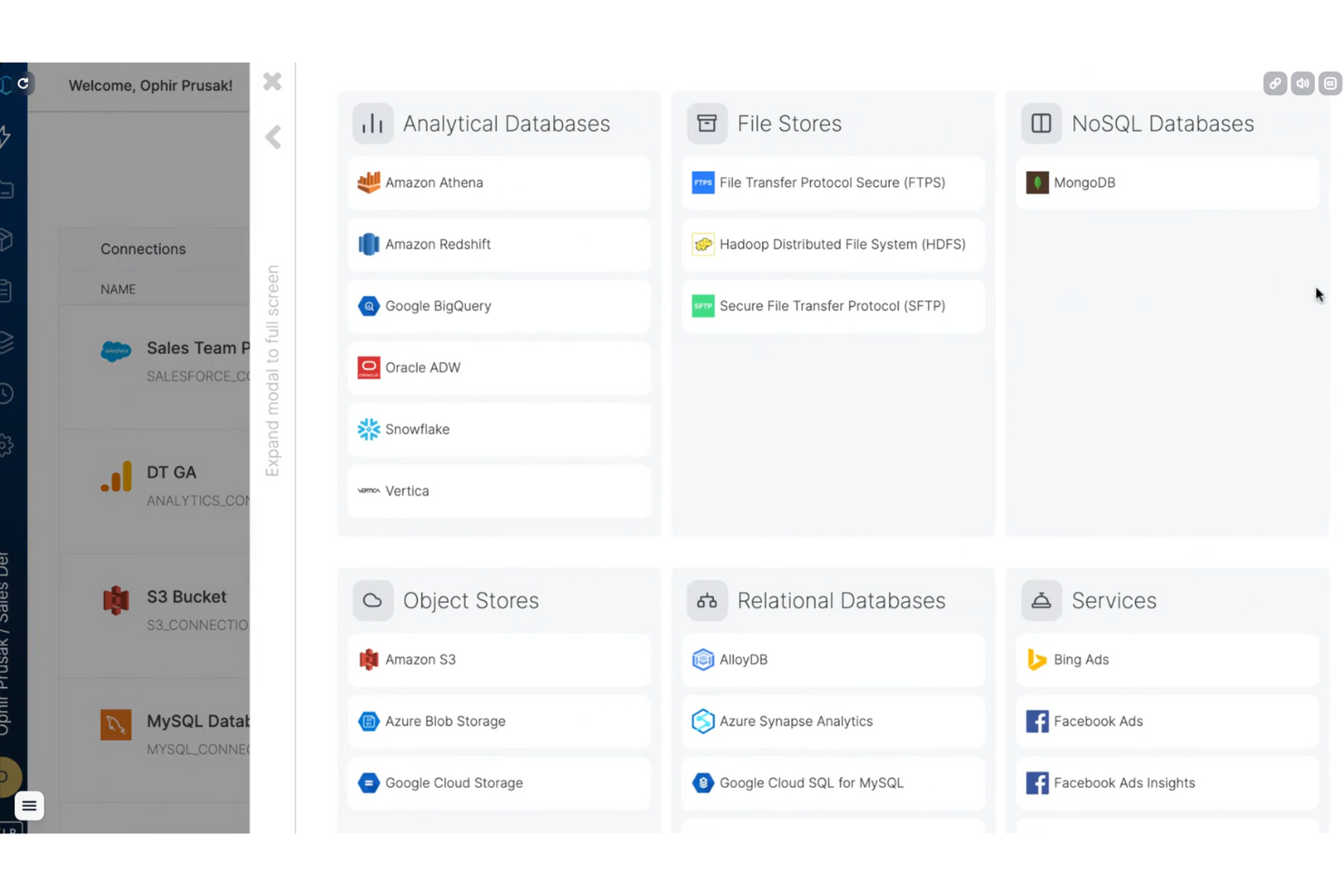

Integrate.io ist eine cloudbasierte ETL-Plattform, die dazu entwickelt wurde, Daten für Analysen und Business Intelligence zu organisieren und vorzubereiten. Sie bietet eine Low-Code-Umgebung, die den Aufbau und das Management von Pipelines über eine Vielzahl von Quellen wie relationale Datenbanken, NoSQL-Datenbanken, Dateisysteme, Objektspeicher und Werbeplattformen vereinfacht.

Warum ich Integrate.io ausgewählt habe: Ein Grund, warum ich Integrate.io gewählt habe, ist die Unterstützung von mehr als 220 integrierten Transformationen. Diese umfangreiche Bibliothek ermöglicht es Teams, komplexe Datenmanipulationen ohne Programmierung durchzuführen, was die Datenvorbereitung für Analysen erleichtert. Die Low-Code-Transformationsschicht reduziert außerdem den Bedarf an SQL oder Skripten und bietet so Flexibilität für technische und nicht-technische Anwender.

Hervorstechende Funktionen und Integrationen von Integrate.io

Funktionen umfassen die Unterstützung von operativen ETL-Anwendungsfällen, wie etwa die Automatisierung von bidirektionalen Salesforce-Integrationen und die Ermöglichung von B2B-Dateidatenaustausch. Außerdem werden Multi-Cloud- und Multi-Region-Deployments in den USA, der EU und im asiatisch-pazifischen Raum unterstützt, was verteilten Teams hilft, Leistungs- und Compliance-Anforderungen zu erfüllen.

Integrationen umfassen Salesforce, HubSpot, Google Analytics, Facebook Ads, Amazon Redshift, Google BigQuery, Amazon S3, Snowflake, MySQL, PostgreSQL, Microsoft Azure SQL Database und MongoDB.

Pros and Cons

Pros:

- Low-Code-Umgebung reduziert Scripting-Bedarf

- Starke Sicherheitsfunktionen und Compliance-Standards

- REST-API-Zugang zur Automatisierung

Cons:

- Für nicht-technische Nutzer kann es dennoch eine Lernkurve geben

- Mögliche Performance-Probleme bei großen Datenmengen

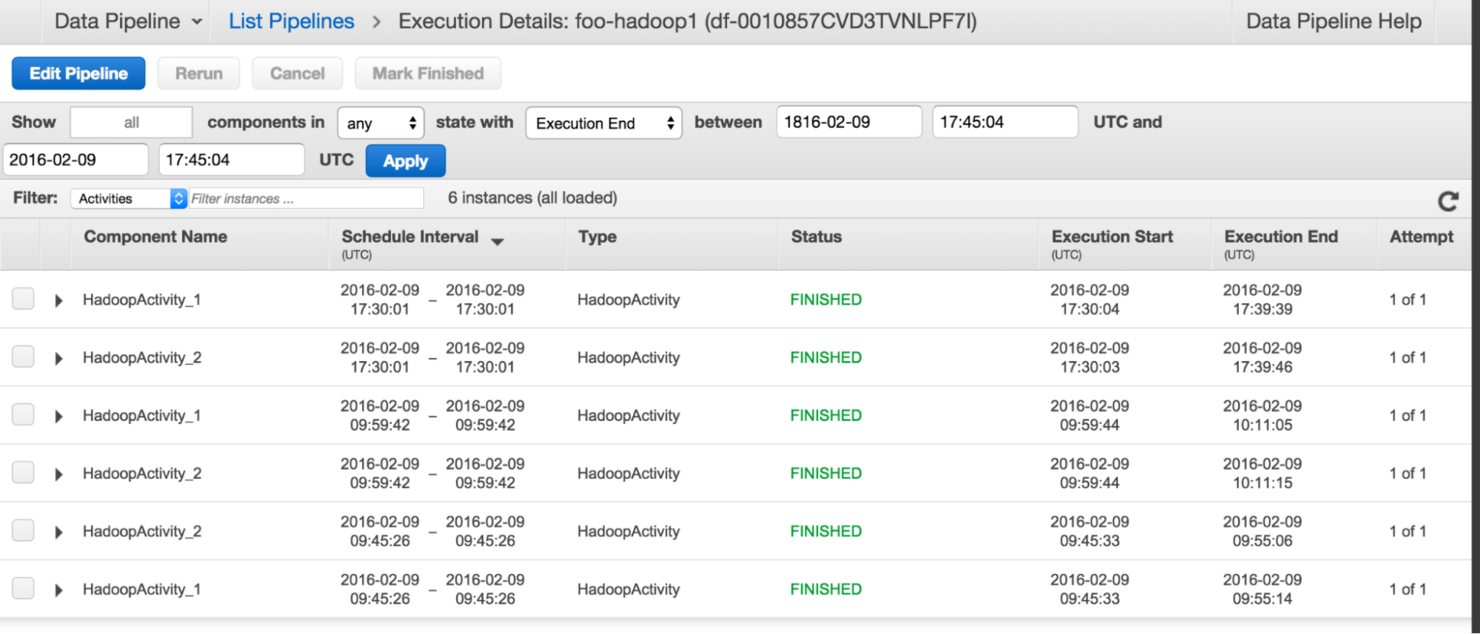

AWS Data Pipeline ist ein verwaltetes ETL-Tool, mit dem Sie Daten zwischen AWS-Diensten und anderen lokalen Ressourcen übertragen können. Sie können angeben, welche Daten Sie verschieben möchten, Transformationsaufgaben oder Abfragen definieren und Zeitpläne für die Durchführung dieser Transformationen festlegen.

Warum ich AWS Data Pipeline gewählt habe: Besonders gefällt mir an AWS Data Pipeline die benutzerfreundliche Drag-and-Drop-Konsole, mit der Sie den Prozess zum Erstellen und Verwalten Ihrer Pipelines vereinfachen können. Sie bietet außerdem eine hohe Fehlertoleranz und Anpassungsfähigkeit, die für einen reibungslosen Betrieb von Datenpipelines sorgt.

Herausragende Funktionen und Integrationen von AWS Data Pipeline:

Funktionen, die mir bei AWS Data Pipeline besonders aufgefallen sind, sind die Drag-and-Drop-Oberfläche und die hohe Fehlertoleranz. Die Drag-and-Drop-Funktion macht die Konsole sehr benutzerfreundlich, während die zusätzliche Fehlertoleranz dazu beiträgt, die Auswirkungen von Benutzerfehlern zu minimieren.

Integrationen für AWS Data Pipeline umfassen Redshift, SQL und DynamoDB. Solche Konnektoren stehen bei der Nutzung der Plattform als vorgefertigte Optionen zur Verfügung.

Pros and Cons

Pros:

- Einfache Drag-and-Drop-Konsole, die Prozesse vereinfacht

- Ermöglicht die Angabe, welche Daten verschoben werden sollen

- Hohe Fehlertoleranz und Anpassungsfähigkeit

Cons:

- Datenverwaltung kann zeitaufwändig sein

- Unterstützt keine Drittanbieterdaten

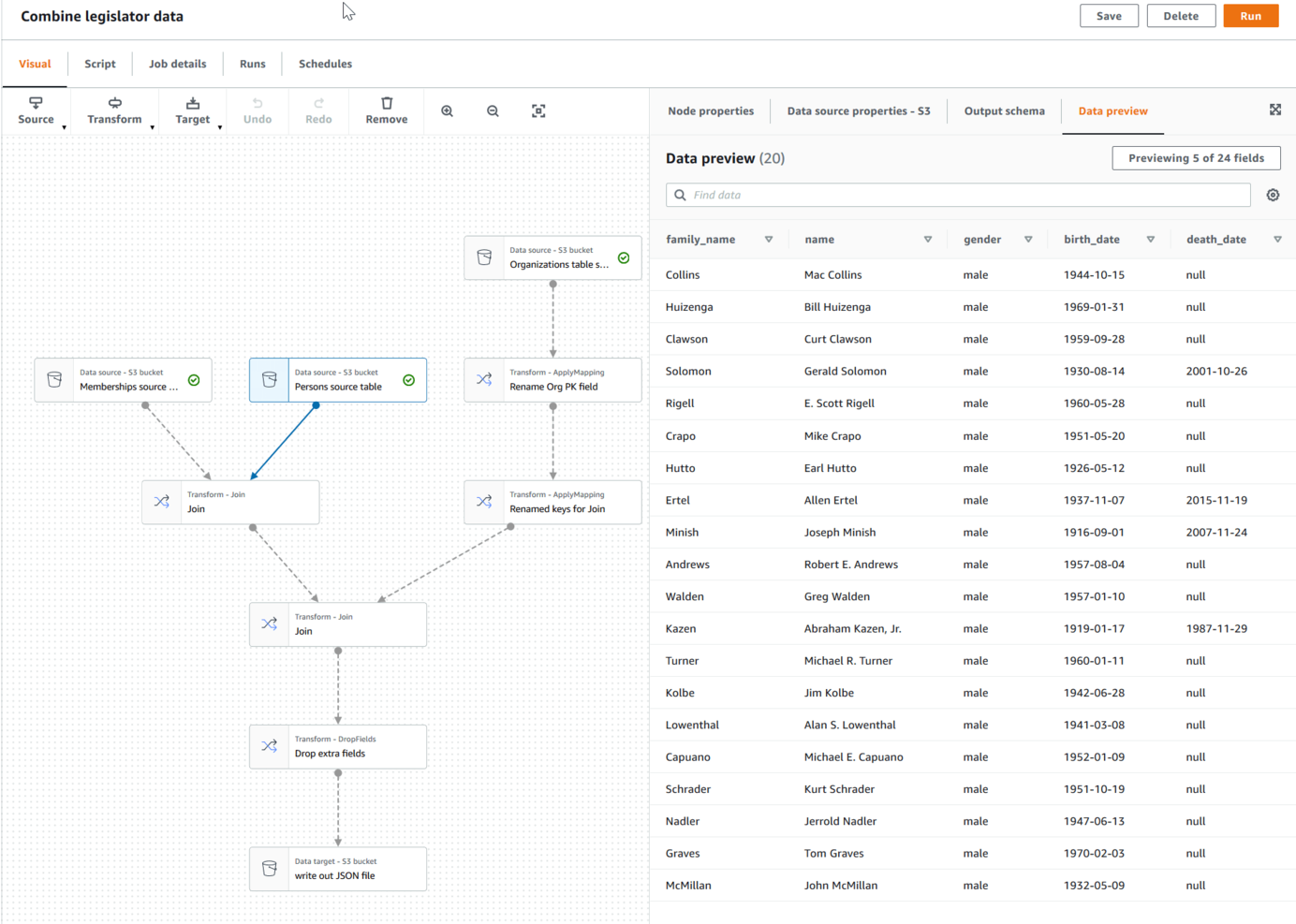

AWS Glue bietet Zugang zu einem serverlosen Datenintegrationsdienst, der den Prozess des Auffindens, Vorbereitens, Verarbeitens und Integrierens von Daten aus verschiedenen Quellen vereinfacht. Mit seiner visuellen Benutzeroberfläche können Sie das Laden von Daten in Ihre Data Lakes erleichtern, sodass Daten für Analysen jederzeit verfügbar sind.

Warum ich AWS Glue gewählt habe: Ich habe mich für AWS Glue entschieden, weil es Zugriff auf mehr als 70 Datenquellen bietet und Ihre Daten effizient über einen zentralen Datenkatalog verwaltet. Es kann je nach aktuellen Anforderungen Ihres Unternehmens hoch- oder herunterskalieren. Diese Fähigkeiten sind die Gründe, warum ich AWS Glue als das beste serverlose ETL-Tool auf dieser Liste betrachte.

Hervorstechende Funktionen und Integrationen von AWS Glue:

Funktionen von AWS Glue, die mir besonders aufgefallen sind, sind der Zugriff auf zahlreiche Datenspeicher und die Möglichkeit, komplexe ETL-Pipelines zu erstellen. Auf verschiedene Datenquellen zugreifen zu können, erleichtert das Sammeln von Business-Intelligence-Daten, während die Entwicklung komplexer Pipelines zu tiefergehenden Erkenntnissen führen kann.

Integrationen für AWS Glue umfassen MySQL, Oracle, Redshift, Amazon S3 und viele mehr. Alle diese Konnektoren sind vorgefertigt, wenn Sie die Plattform auswählen.

Pros and Cons

Pros:

- Fehlgeschlagene Jobs in AWS Glue können wiederhergestellt werden

- Bietet Filterung fehlerhafter Daten

- Einfache Wartung und Bereitstellung

Cons:

- Fehlende Kompatibilität mit häufig verwendeten Datenquellen

- Nicht die beste Wahl für Echtzeit-ETL-Aufgaben

IBM DataStage ist ein ETL-Tool, das es Ihnen ermöglicht, Daten zu extrahieren, zu transformieren, Geschäftsgrundsätze anzuwenden und die Daten mühelos in jedes gewünschte Ziel zu laden. Es gibt eine Basisversion der Software zur Installation vor Ort sowie ein Upgrade, mit dem Sie die Zeit und die Kosten für die Datenintegration reduzieren können.

Warum ich IBM DataStage gewählt habe: Ich habe mich für IBM DataStage entschieden, weil es sich um ein Integrationstool handelt, das sich durch die Integration von Daten aus einer Vielzahl von Unternehmens- und externen Quellen auszeichnet. Mir gefällt, wie es dank seines skalierbaren, parallelen Verarbeitungsansatzes bestens geeignet ist, große Datenmengen zu verarbeiten und umzuwandeln.

Herausragende Funktionen und Integrationen von IBM DataStage:

Funktionen von IBM DataStage, die mir besonders aufgefallen sind, waren die Datenwissenschaftsfunktionen und das automatisierte Lastausgleichsverfahren. Die Datenwissenschaftsfunktion ermöglicht es mir, schnell Erkenntnisse aus meinen Daten zu gewinnen, während der automatisierte Lastausgleich für einen maximalen Datendurchsatz sorgt.

Integrationen sind verfügbar mit Amazon S3, Azure, BDFS, BigQuery und FTP Enterprise. Sie können außerdem Datenquellen wie IBM Db2 Warehouse on Cloud und IBM Netezza verknüpfen und Daten übertragen. All diese Integrationen sind in die Plattform bereits integriert.

Pros and Cons

Pros:

- Workload-Balancierung ermöglicht eine schnellere Ausführung von Aufgaben

- Reduzierte Datenbewegungskosten

- Zugriff auf KI-Dienste

Cons:

- Fehlende Automatisierung für Fehlerbehandlung und Wiederherstellung

- Das Bearbeiten von Spalten kann mühsam sein

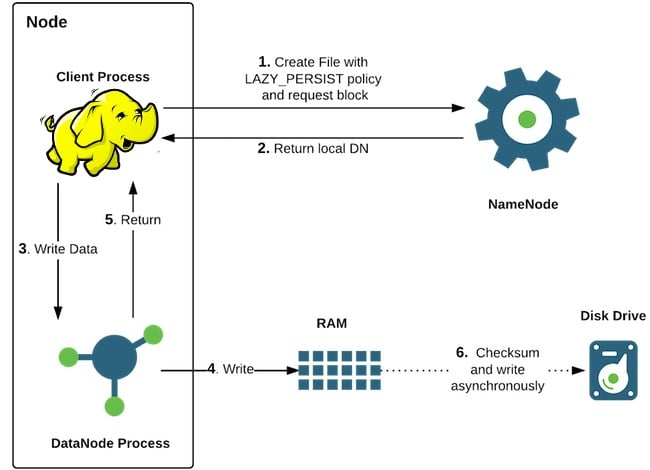

Hadoop ist ein Open-Source-ETL-Tool, mit dem Sie Daten speichern und verarbeiten können. Anstatt sich auf einen einzelnen Computer zu verlassen, ermöglicht die Software das Clustern mehrerer Geräte, sodass eine schnelle Analyse und Speicherung riesiger Datenmengen möglich ist.

Warum ich Hadoop gewählt habe: Ich habe Hadoop ausgewählt, weil es Zugriff auf eine umfangreiche Speicherkapazität bietet, die jede Art von Daten aufnehmen kann. Das Tool verfügt über enorme Verarbeitungskapazitäten, mit denen Sie eine außergewöhnlich große Anzahl gleichzeitiger Aufgaben oder Jobs bewältigen können.

Hadoop-Funktionen und Integrationen:

Funktionen von Hadoop, die mir besonders aufgefallen sind, waren das Cluster-Job-Scheduling und der Zugriff auf übliche Java-Bibliotheken. Durch diese Möglichkeiten konnte die Plattform große Datensätze schnell verarbeiten, was gut zu ihrer beachtlichen Datenspeicherkapazität passt.

Integrationen für Hadoop umfassen MySQL, PostgreSQL und Oracle. Alle diese Konnektoren sind bereits in die Plattform integriert.

Pros and Cons

Pros:

- Kann eine riesige Menge von Daten gleichzeitig verarbeiten

- Kann mit beliebigen Datentypen umgehen

- Sehr skalierbares ETL-Tool

Cons:

- Java-Framework kann leicht ausgenutzt werden

- Nicht ideal für kleinere Datensätze

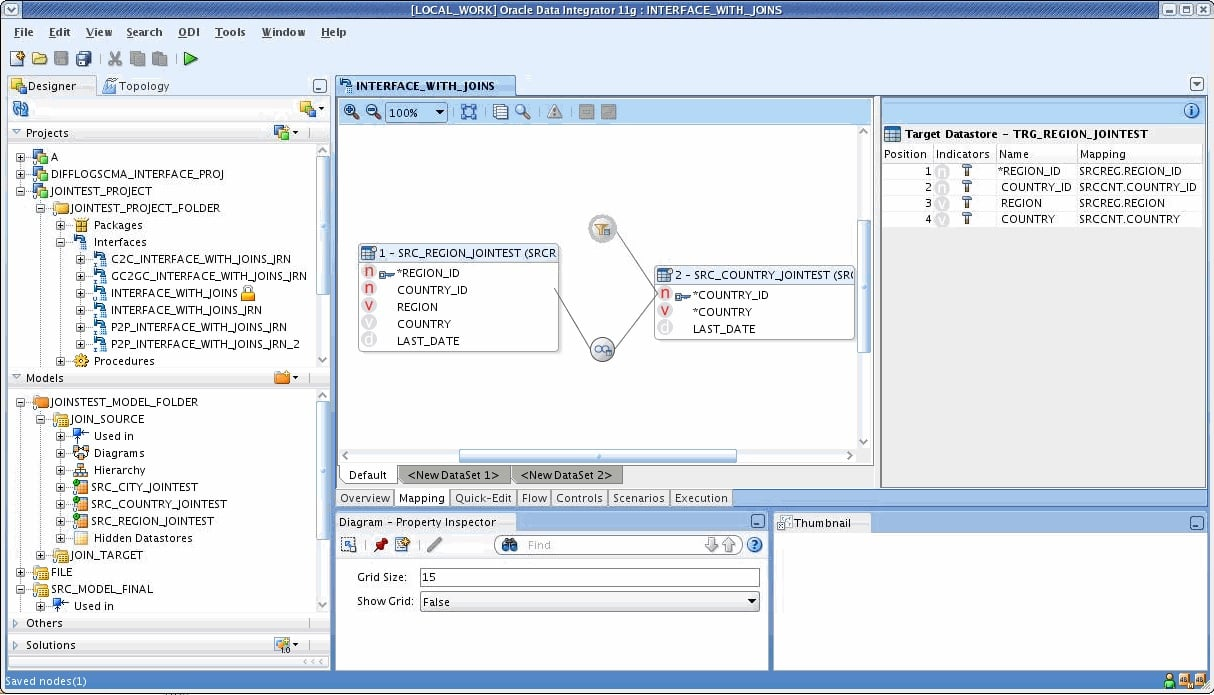

Oracle Data Integrator deckt verschiedene Anforderungen an die Datenintegration ab. Es bewältigt alles von groß angelegten Batch-Uploads mit hoher Leistung bis hin zu ereignisgesteuerter Echtzeit-Integration und sogar SOA-fähigen Datendiensten.

Warum ich Oracle Data Integrator ausgewählt habe: Ich habe mich für Oracle Data Integrator entschieden, weil es eine Vielzahl vorgefertigter Konnektoren bietet, mit denen Sie mühelos verschiedene Datenbanken verbinden können. Sie können damit direkt Verbindungen zu Hadoop, EREPs, CRMs, XML, JSON, LDAP, JDBC und ODBC herstellen – alles direkt verfügbar.

Hervorstechende Funktionen und Integrationen von Oracle Data Integrator:

Die Funktionen von Oracle Data Integrator, die mir besonders aufgefallen sind, umfassen die aktive Integrationsplattform sowie die Möglichkeit für Entwickler, eigene Zuordnungen anhand standardisierter Geschäftslogik zu erstellen. Die aktive Integrationsfunktion ermöglicht datenbasierte, ereignisbasierte und servicebasierte Datenintegration, während Letzteres die Erstellung von Code für verschiedenste Datenverarbeitungstechnologien erlaubt.

Integrationen sind verfügbar mit Data-Warehouse-Plattformen wie Oracle, Teradata, IBM DB2, Sybase und Exadata. Sie können es auch in Verbindung mit anderen Technologien wie ERPs, XML und LDAP nutzen. Alle diese Integrationen sind in die Plattform vorinstalliert.

Pros and Cons

Pros:

- Effiziente Architektur, die sowohl Quell- als auch Zielserver nutzt

- Erkennt fehlerhafte Daten automatisch vor der Anwendungseinfügung

- Unterstützt alle Plattformen, Hardware und Betriebssysteme

Cons:

- Schwierig zu erlernen und erfordert Schulung

- Benutzeroberfläche kann komplex sein

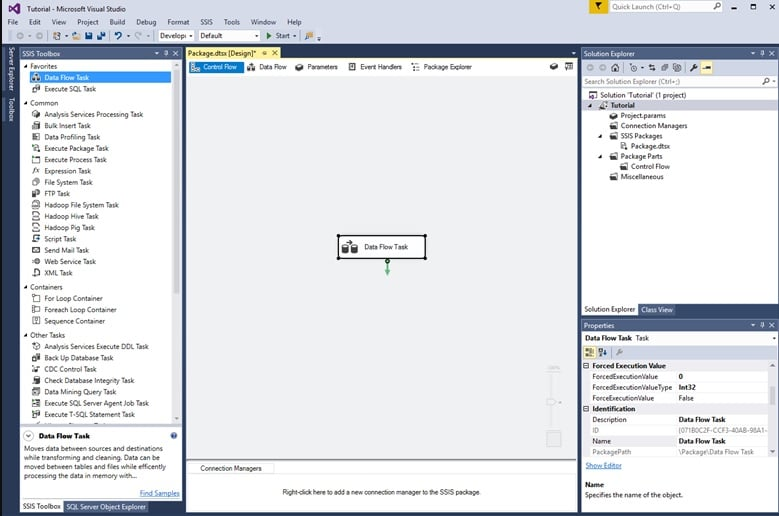

Microsoft SQL Server Integration Services, kurz Microsoft SSIS, ist ein Enterprise-Tool, das Daten innerhalb der SQL Server-Datenbank von Microsoft integriert, transformiert und migriert. Es bietet Funktionen zur Datenintegration wie Datenanalyse, Bereinigung und die Durchführung von ETL-Prozessen zur Aktualisierung von Data Warehouses.

Warum ich Microsoft SSIS gewählt habe: Ein Hauptgrund für meine Wahl von SSIS ist seine Vielseitigkeit, da es verschiedene Datenbanken wie SQL, DB2 und Oracle unterstützt. Diese Flexibilität ermöglicht es Anwendern, Daten aus unterschiedlichen Quellen zu kombinieren, während die grafische Benutzeroberfläche die Durchführung von Datenaufbereitungen und Transformationen erleichtert.

Herausragende Funktionen und Integrationen von Microsoft SSIS:

Funktionen von Microsoft SSIS, die mir aufgefallen sind, waren die grafischen Tools und die integrierte Katalogdatenbank. Die grafischen Tools erleichtern die Entwicklung von Paketen, während die SSIS-Katalogdatenbank das Management von Projekten, Parametern und Umgebungen vereinfacht. Ebenso hat mir gefallen, wie die Plattform das Importieren von Daten aus unterschiedlichen Quellen ermöglicht und deren Transformation nach eigenen Vorstellungen unterstützt.

Integrationen für Microsoft SSIS sind verfügbar mit ADO, DQS, Excel, FTP, HTTP, WMI und mehr. Diese Konnektoren sind direkt in die Plattform integriert. Darüber hinaus können zusätzliche Verbindungstypen auf ihrer Website heruntergeladen werden.

Pros and Cons

Pros:

- Ein flexibles ETL- und Datentransformationstool

- Die Benutzeroberfläche ist leicht zu bedienen und zu konfigurieren

- Bietet zahlreiche Dokumentationsfunktionen

Cons:

- Fehlende Integrationsmöglichkeiten mit anderen Tools

- Unterstützt nur Microsoft Windows

Weitere ETL-Tools

Neben den oben genannten habe ich noch einige weitere ETL-Tools ausgewählt, die sich ebenfalls lohnen:

- SAS Data Management

Am besten für große Unternehmen geeignet

- Fivetran

E Datenkonnektivität

- Talend Open Studio

E Zeit für Datenverarbeitung

- Informatica PowerCenter

Am besten beim Parsen fortgeschrittener Datenformate

- Pentaho Data Integration

E benutzerfreundliche Oberfläche

- Stitch Data

Am besten für automatisierte Datenpipelines

Weitere IT-Software-Bewertungen

Falls Sie hier noch nicht fündig geworden sind, sehen Sie sich gerne diese Tools rund um API-Management an, die wir getestet und bewertet haben.

- Netzwerk-Monitoring-Software

- Server-Monitoring-Software

- SD-WAN-Lösungen

- Infrastruktur-Monitoring-Tools

- Packet Sniffer

- Application Monitoring Tools

Auswahlkriterien für ETL-Tools

Bei der Auswahl von ETL-Tools achte ich besonders auf die Funktionalität und wie gut sie einzelne Anwendungsfälle abdecken. Meine Kriterien basieren auf umfangreicher persönlicher Recherche und Praxiserfahrung mit verschiedenen ETL-Lösungen. Hier eine Übersicht meiner Vorgehensweise für die Tool-Auswahl:

Kernfunktionalitäten von ETL-Tools: 25 % der Gesamtwertung

Um in meine Liste der besten ETL-Tools aufgenommen zu werden, musste die Lösung mindestens einen dieser typischen Anwendungsfälle unterstützen:

- Effiziente Datenintegration aus unterschiedlichen Quellen

- Skalierbare Datenumwandlungen

- Automatisierte Daten-Workflows

- Echtzeit-Datenverarbeitung und -Analyse

- Sicherstellung von Datenqualität und Compliance

Weitere herausragende Funktionen: 25 % der Gesamtwertung

- Tools, die fortschrittliche Datenumwandlungslogik bieten, wie unscharfe Zuordnung und Funktionen für maschinelles Lernen zur prädiktiven Modellierung.

- Lösungen mit umfangreichen vorgefertigten Konnektoren zu neuen und aufkommenden Datenquellen wie IoT-Geräten oder Blockchain-Plattformen.

- ETL-Plattformen, die einzigartige Datenvisualisierungswerkzeuge für die Überwachung von Datenflüssen und der Leistung in Echtzeit bereitstellen.

- Innovative Ansätze zur Datenverwaltung und Compliance, die dafür sorgen, dass Daten nicht nur sicher sind, sondern auch globale Vorschriften erfüllen.

- Beispiele sind Tools, die KI nutzen, um Datenqualitätsprüfungen zu verbessern, oder Plattformen, die umfangreiche Anpassungsoptionen bieten, sodass Unternehmen das Tool an ihre spezifischen Anforderungen anpassen können.

Benutzerfreundlichkeit: 10% der Gesamtbewertung

- Oberflächen, die komplexe Prozesse vereinfachen, wie Drag-and-drop-Funktionen zur Gestaltung von Datenpipelines.

- Klare, intuitive Dashboard-Designs, die schnellen Zugriff auf häufig genutzte Funktionen bieten.

- Responsives Design, das auf verschiedenen Geräten gut funktioniert, sodass Nutzer ETL-Aufgaben auch unterwegs verwalten können.

Onboarding: 10% der Gesamtbewertung

- Verfügbarkeit umfassender Schulungsmaterialien wie Videoanleitungen, Dokumentationen und interaktiver Produkttouren.

- Vorlagen und vorkonfigurierte Workflows, die neuen Anwendern helfen, schnell mit den gängigen ETL-Herausforderungen und Aufgaben zu starten.

- Zugang zu Kundensupport oder Community-Foren während des Onboardings, um einen reibungslosen Übergang und sofortige Problemlösung zu gewährleisten.

Kundensupport: 10% der Gesamtbewertung

- Bereitstellung verschiedener Support-Kanäle, einschließlich Live-Chat, Telefon- und E-Mail-Support, um unterschiedlichen Nutzerpräferenzen gerecht zu werden.

- Proaktiver Support, wie regelmäßige Check-ins und Updates zu neuen Funktionen oder Best Practices.

- Ein kompetentes und reaktionsschnelles Support-Team, das sowohl bei technischen als auch bei operativen Fragen helfen kann.

Preis-Leistungs-Verhältnis: 10% der Gesamtbewertung

- Transparente Preismodelle, die im Einklang mit den gebotenen Funktionen und Skalierbarkeit stehen.

- Berücksichtigung des langfristigen Nutzens durch flexible Tarife, die mit den wachsenden Anforderungen der Nutzer mitwachsen.

- Kostenlose Testphasen oder Demos, die es Nutzern ermöglichen, die Effektivität des Tools vor einer finanziellen Verpflichtung zu bewerten.

Kundenbewertungen: 10% der Gesamtbewertung

- Konsistent hohe Bewertungen in für ETL-Prozesse kritischen Bereichen wie Zuverlässigkeit, Leistung und Nutzerzufriedenheit.

- Positives Feedback zur Benutzerfreundlichkeit und zur Reaktionsfähigkeit des Kundensupports.

- Bewertungen, die erfolgreiche Anwendungsfälle hervorheben und zeigen, dass das Tool in der Lage ist, spezifische Probleme der Käufer zu lösen.

Dieses Kriterien-Framework sorgt dafür, dass ETL-Tools umfassend bewertet werden, wobei sowohl die Kernfunktionen als auch zusätzliche Merkmale berücksichtigt werden, die sie auf dem Markt auszeichnen, wie zum Beispiel ETL-Testautomatisierungstools. Es adressiert das gesamte Spektrum der Käuferinteressen von der ersten Einarbeitung bis hin zum langfristigen Mehrwert und stellt sicher, dass das gewählte ETL-Tool nicht nur Ihren aktuellen Anforderungen an Datenmanagement entspricht, sondern auch zukünftiges Wachstum und zunehmende Komplexität unterstützt.

So wählen Sie ETL-Tools aus

Wenn Sie ETL-Tools in die engere Auswahl nehmen, testen und auswählen, sollten Sie Folgendes beachten:

- Welches Problem möchten Sie lösen - Beginnen Sie damit, die Lücke im ETL-Pipeline-Management zu identifizieren, die Sie schließen möchten, um die erforderlichen Funktionen und Merkmale des Tools zu klären.

- Wer wird es nutzen müssen - Um Kosten und Anforderungen zu bewerten, überlegen Sie, wer das Tool nutzen wird und wie viele Lizenzen Sie benötigen. Prüfen Sie, ob nur die Datenabteilung oder das gesamte Unternehmen Zugriff benötigt. Sobald das klar ist, sollten Sie überlegen, ob Sie die Benutzerfreundlichkeit für alle oder die Geschwindigkeit für technische Power-User priorisieren wollen.

- Mit welchen anderen Tools muss es funktionieren - Prüfen Sie, welche Tools ersetzt werden, welche bleiben und mit welchen Tools Sie integrieren müssen. Dazu gehören möglicherweise Ihre bestehende ETL-Infrastruktur, verschiedene Datenquellen und Ihr Technologie-Stack insgesamt. Möglicherweise müssen Sie auch entscheiden, ob die Tools miteinander integriert werden müssen oder ob Sie mehrere Tools durch ein konsolidiertes ETL-Tool ersetzen können.

- Welche Ergebnisse sind wichtig - Überlegen Sie, welches Ergebnis das Tool liefern muss, um als erfolgreich zu gelten. Denken Sie darüber nach, welche Fähigkeiten Sie gewinnen oder was Sie verbessern möchten und wie Sie den Erfolg messen werden. Sie können ETL-Tool-Funktionalitäten endlos vergleichen, aber wenn Sie nicht an die gewünschten Ergebnisse denken, könnten Sie viel wertvolle Zeit verschwenden.

- Wie es in Ihrem Unternehmen arbeiten würde - Betrachten Sie die Lösungen im Zusammenhang mit Ihren Arbeitsabläufen und Ihrer ETL-Methodik. Bewerten Sie, was gut funktioniert und welche Bereiche Probleme bereiten, die angegangen werden müssen. Denken Sie daran, dass jedes Unternehmen anders ist – gehen Sie nicht davon aus, dass ein beliebtes Tool zwangsläufig in Ihrem Unternehmen funktioniert.

Trends bei ETL-Tools

In meinen Recherchen habe ich zahlreiche Produktneuheiten, Pressemitteilungen und Release-Logs verschiedener ETL-Tool-Anbieter ausgewertet. Hier sind einige der aktuellen Trends, die ich im Auge behalte:

- Echtzeit-Datenverarbeitung: Immer mehr ETL-Tools wechseln von der Batch- zur Echtzeitverarbeitung, sodass Unternehmen schnellere Entscheidungen auf Basis von Live-Daten treffen können.

- KI-gestützte Daten-Transformation: Einige Anbieter integrieren KI-Funktionen, um komplexe Datenumwandlungen zu automatisieren und den Bedarf an manueller Programmierung zu verringern.

- Datenqualitätsüberwachung: ETL-Tools bieten zunehmend integrierte Datenvalidierungs- und Qualitätsprüfungen, damit Teams Fehler und Inkonsistenzen erkennen, bevor sie nachgelagerte Systeme beeinflussen.

- Self-Service-ETL: Anbieter setzen verstärkt darauf, ETL-Tools benutzerfreundlicher zu gestalten, sodass auch Fachabteilungen ohne technische Expertise Daten extrahieren und transformieren können.

- Hybrid- und Multi-Cloud-Unterstützung: Da immer mehr Unternehmen mehrere Cloud-Plattformen nutzen, passen ETL-Tools sich an und bieten bessere Unterstützung für hybride und Multi-Cloud-Umgebungen.

Was sind ETL-Tools?

ETL-Tools sind Softwarelösungen, die dabei helfen, Daten aus verschiedenen Quellen zu übertragen, sie zu bereinigen und zu formatieren, und sie in ein System zu laden, in dem sie verwendet werden können. Sie werden von Data Engineers, Analysten und IT-Teams eingesetzt, die Daten für Berichte, Dashboards oder maschinelles Lernen aufbereiten müssen.

Funktionen wie Datenextraktion, Transformationsregeln und automatisierte Zeitplanung helfen, manuelle Arbeit zu reduzieren, Fehler zu beheben und sicherzustellen, dass Daten rechtzeitig zur Verfügung stehen. Diese Tools erleichtern die Arbeit mit Daten, ohne dass alles von Grund auf neu entwickelt werden muss.

Funktionen von ETL-Tools

Hier sind einige der wichtigsten Funktionen, die ich bei der Bewertung von ETL-Tools (Extract, Transform, Load) beachte:

- Intuitive Benutzeroberfläche (UI): Eine benutzerfreundliche und leicht verständliche Oberfläche vereinfacht die Erstellung und Verwaltung von ETL-Prozessen. Sie ermöglicht es Anwendern mit unterschiedlichen technischen Vorkenntnissen, effizient mit Daten zu arbeiten.

- Konnektivität und Integration: Die Fähigkeit, eine Vielzahl von Datenquellen und -zielen anzubinden. Diese Funktion ist entscheidend für Unternehmen, die Daten aus mehreren Quellen sammeln und eine nahtlose Integration über verschiedene Plattformen hinweg sicherstellen müssen.

- Daten-Transformationsfähigkeiten: Leistungsstarke Funktionen zur Datenumwandlung ermöglichen es, Daten mühelos in das gewünschte Format zu konvertieren. Dies ist unerlässlich, um Daten präzise für Analysen und Berichte vorzubereiten.

- Automatisierung und Terminplanung: Werkzeuge mit Automatisierungs- und Terminplanungsfunktionen ermöglichen es, ETL-Prozesse zu vordefinierten Zeiten oder als Reaktion auf bestimmte Auslöser auszuführen. So wird manueller Aufwand reduziert und sichergestellt, dass Daten stets auf dem neuesten Stand sind.

- Skalierbarkeit: Die Möglichkeit, je nach Datenvolumen und Rechenanforderungen auf- oder abzuskalieren. Wenn das Datenvolumen wächst, kann ein skalierbares ETL-Tool höhere Lasten bewältigen, ohne die Leistung zu beeinträchtigen.

- Echtzeitverarbeitung: Unterstützung für die Verarbeitung von Daten in Echtzeit ermöglicht es Unternehmen, Entscheidungen anhand der aktuellsten Daten zu treffen. Dies ist entscheidend für zeitkritische Anwendungen, bei denen minutengenaue Daten benötigt werden.

- Datenqualität und -bereinigung: Funktionen, die die Datenbereinigung unterstützen und Qualität sicherstellen, sind unabdingbar. Sie helfen, Fehler oder Inkonsistenzen in den Daten zu erkennen und zu korrigieren, sodass nur verlässliche Daten für Analysen verwendet werden.

- Sicherheit: Robuste Sicherheitsfunktionen, darunter Datenverschlüsselung und Zugriffskontrollen, schützen sensible Informationen vor unberechtigtem Zugriff. Sicherheit ist unerlässlich für die Einhaltung von Vorschriften und zur Sicherung wertvoller Unternehmensdaten.

- Überwachung und Protokollierung: Die Möglichkeit, ETL-Prozesse in Echtzeit zu überwachen und Aktivitäten für Prüfzwecke zu protokollieren. Dies hilft bei der Fehlerbehebung und sorgt für Transparenz in den Datenoperationen.

- Support und Community: Guter Kundensupport sowie eine aktive Benutzer-Community können entscheidend zur Lösung von Problemen und zum Austausch bewährter Praktiken beitragen. Dies ist hilfreich für kontinuierliches Lernen und das Bewältigen von Herausforderungen beim Management von ETL-Pipelines.

Vorteile von ETL-Tools

ETL-Tools spielen eine entscheidende Rolle in der modernen, datengetriebenen Unternehmenslandschaft und ermöglichen es Organisationen, große Datenmengen effizient zu verwalten, die aus unterschiedlichsten Quellen stammen. Diese Tools straffen den Prozess der Datenextraktion, Transformation in ein nutzbares Format sowie das Laden in ein Data Warehouse oder sonstige Speicherlösungen. Hier sind fünf Hauptvorteile von ETL-Tools für Anwender und Unternehmen:

- Erhöhte Effizienz: ETL-Tools automatisieren die Prozesse der Datenextraktion, -transformation und -beladung und reduzieren so den notwendigen Zeit- und Arbeitsaufwand im Vergleich zu manuellen Methoden erheblich. Mit dieser Automatisierung können Unternehmen große Datenmengen schnell verarbeiten und so Produktivität und operative Effizienz steigern.

- Verbesserte Datenqualität: Funktionen zur Datenbereinigung und -validierung stellen sicher, dass Daten präzise und verlässlich sind. Eine gesteigerte Datenqualität ermöglicht bessere Entscheidungen und kann die Kosten, die durch Fehler und Ungenauigkeiten in den Daten entstehen, deutlich reduzieren.

- Erweiterte Skalierbarkeit: ETL-Tools sind dafür ausgelegt, mit unterschiedlich großen Datenmengen zu arbeiten – von kleinen bis hin zu sehr großen Datensätzen, ohne dass die Leistung darunter leidet. Diese Skalierbarkeit unterstützt das Wachstum des Unternehmens, da sich die Datenverarbeitung problemlos an ein steigendes Volumen anpassen lässt, ohne grundlegende Infrastrukturänderungen vorzunehmen.

- Datenintegration aus mehreren Quellen: ETL-Tools können Daten aus verschiedensten Quellen – z. B. Datenbanken, Cloud-Services und Anwendungen – extrahieren und in einem einzigen Repository zusammenführen. Diese Integrationsfähigkeit ermöglicht es Unternehmen, einen umfassenden Überblick über die eigenen Prozesse zu erhalten und damit ihre Analyse- und Berichtsmöglichkeiten zu verbessern.

- Erhöhte Datensicherheit: Viele ETL-Tools verfügen über starke Sicherheitsfunktionen wie Verschlüsselung und Zugriffskontrollen, um sensible Informationen bei der Datenverarbeitung zu schützen. Die verbesserte Datensicherheit unterstützt Unternehmen bei der Einhaltung gesetzlicher Datenschutzvorgaben und schützt vor Datenlecks.

Kosten & Preise für ETL-Tools

Wer sich erstmals mit ETL-Tools beschäftigt, sollte – insbesondere als Softwarekäufer ohne umfangreiche Vorkenntnisse – die verschiedenen Tarif- und Preismodelle kennen. Diese können sich je nach Funktionsumfang, Skalierbarkeit, Support und weiteren Faktoren stark unterscheiden.

Vergleichstabelle für ETL-Tool-Tarife

Nachfolgend finden Sie eine detaillierte Übersicht gängiger Tarifoptionen für ETL-Tools. Sie soll Ihnen dabei helfen, eine fundierte Entscheidung zu treffen, die Ihren Anforderungen und Budgetvorgaben entspricht.

| Tariftyp | Durchschnittlicher Preis | Häufige Funktionen | Am besten geeignet für |

|---|---|---|---|

| Kostenlos | $0 | Zugriff auf grundlegende ETL-Funktionalitäten, Verarbeitung begrenzter Datenmengen, Community-Support. | Kleine Unternehmen mit minimalen Datenintegrationsanforderungen, Einzelentwickler, Open-Source-Enthusiasten |

| Basis | $500 - $2,000 / Monat | Standard-ETL-Funktionen, Unterstützung mehrerer Datenquellen, E-Mail-Support, grundlegende Datenumwandlungsmöglichkeiten. | Start-ups, kleine bis mittelgroße Unternehmen mit wachsenden Datenanforderungen, Organisationen mit begrenzten IT-Ressourcen |

| Professional | $2,001 - $10,000 / Monat | Erweiterte Datenumwandlungen, Echtzeit-Datenverarbeitung, höhere Kapazität für Datenmengen, priorisierter Kundensupport. | Mittelständische Unternehmen mit komplexen Integrationsanforderungen, Unternehmen mit mehreren Datenquellen und -formaten |

| Enterprise | $10,001+ / Monat | Individuelle ETL-Lösungen, dedizierter Support, unbegrenzte Datenmengen, erweiterte Sicherheitsfeatures, API-Zugriff. | Großunternehmen mit großen Datenmengen, komplexen Integrationsanforderungen, hohen Sicherheitsanforderungen |

ETL-Tools – Häufig gestellte Fragen

Im Folgenden finden Sie die Antworten auf die am häufigsten gestellten Fragen zu ETL-Tools:

Wie implementiert man ein ETL-Tool?

Wie stellen ETL-Tools Datensicherheit sicher?

Können ETL-Tools mit großen Datenmengen umgehen?

Wie viel kosten ETL-Tools?

Wie kann man die ETL-Performance verbessern?

Wie wähle ich das richtige ETL-Tool für meine Bedürfnisse aus?

Wie geht es weiter?

Wenn Sie sich aktuell mit der Recherche nach ETL-Tools beschäftigen, nehmen Sie Kontakt zu einem SoftwareSelect-Berater auf und erhalten Sie kostenlos Empfehlungen.

Sie füllen ein Formular aus und führen ein kurzes Gespräch, in dem Ihre individuellen Anforderungen besprochen werden. Anschließend erhalten Sie eine Shortlist mit infrage kommenden Software-Lösungen. Die Berater unterstützen Sie sogar während des gesamten Kaufprozesses – einschließlich Preisverhandlungen.