Meilleure sélection d’outils d’analyse Big Data

Voici ma sélection des meilleurs outils d’analyse Big Data :

Les meilleurs outils d’analyse Big Data permettent aux équipes de traiter de grands ensembles de données avec efficacité, d’exécuter des requêtes avancées à grande échelle et de générer des insights clairs qui soutiennent des décisions métier plus rapides et mieux informées. Ils offrent aux organisations la possibilité d’aller au-delà des données brutes pour révéler des schémas, tendances et prédictions qui impactent directement les opérations et la stratégie.

Beaucoup d’équipes commencent à rechercher ces outils après avoir rencontré des problèmes comme passer des heures à effectuer des requêtes lentes sur des systèmes classiques, avoir des difficultés à visualiser les données provenant de plateformes déconnectées, ou perdre du temps à nettoyer et préparer manuellement les ensembles de données. Sans la bonne plateforme, il devient difficile de transformer les données en insights concrets et fiables pour les décideurs.

J’ai évalué des outils d’analyse Big Data dans des environnements de production, testé leur performance avec des pipelines de données en temps réel et accompagné des équipes dans la migration de bases de données traditionnelles vers des systèmes distribués modernes. Ces expériences ont révélé quelles plateformes gèrent vraiment la montée en charge, offrent des insights exploitables et s’intègrent efficacement dans la chaîne analytique globale.

Dans ce guide, vous découvrirez quels outils d’analyse Big Data excellent en analyse temps réel, facilitent la collaboration entre les équipes et fournissent les insights les plus utiles pour améliorer la prise de décision et l’efficacité.

Pourquoi faire confiance à nos évaluations logicielles

Nous testons et évaluons des logiciels SaaS de développement depuis 2023. En tant qu’experts techniques, nous savons à quel point il est crucial et difficile de prendre la bonne décision lors du choix d’un logiciel. Nous investissons dans une recherche approfondie pour aider notre audience à faire de meilleurs choix lors de l’achat de solutions logicielles.

Nous avons testé plus de 2 000 outils pour différents cas d’usage liés au développement SaaS et rédigé plus de 1 000 avis de logiciels complets. Découvrez comment nous restons transparents et consultez notre méthodologie d’évaluation de logiciels.

Table of Contents

- Meilleure Sélection de Logiciels

- Pourquoi Nous Faire Confiance

- Comparer les Caractéristiques

- Avis

- Autres Outils d’Analyse de Big Data

- Logiciels Associés

- Critères de Sélection

- Comment Choisir

- Tendances

- Qu’est-ce que les Outils d’Analyse de Big Data ?

- Fonctionnalités

- Avantages

- Coûts et Tarification

- FAQ

Résumé des meilleurs outils d’analyse Big Data

Ce tableau comparatif résume les informations tarifaires de mes sélections d’outils d’analyse Big Data afin de vous aider à trouver celui qui correspond à votre budget et à vos besoins métier.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Idéal pour la résolution d'identité multicanal | Essai gratuit + démo gratuite disponible | Tarification sur demande | Website | |

| 2 | Idéal pour la gestion des journaux | Essai gratuit de 60 jours | Tarification sur demande | Website | |

| 3 | Idéal pour les petites entreprises | Essai gratuit de 15 jours + offre gratuite + démo gratuite disponible | À partir de 48 $/2 utilisateurs/mois (facturé annuellement) | Website | |

| 4 | Idéal pour l’entrepôt de données | Démo gratuite disponible | À partir de 37$/mois (facturé annuellement) | Website | |

| 5 | Idéal pour le reporting de feuilles de calcul en temps réel | Offre gratuite disponible | À partir de $49/mois (facturé annuellement) | Website | |

| 6 | Idéal pour l'agrégation de données multi-sources | Démo gratuite disponible | Tarif sur demande | Website | |

| 7 | Am besten für Teams, die Postgres-Experten suchen | $19/Monat | Website | ||

| 8 | Idéal pour la visualisation de données | Essai gratuit disponible | À partir de $75/utilisateur/mois (facturé annuellement) | Website | |

| 9 | Idéal pour la gestion des journaux | Essai gratuit de 60 jours | Tarification sur demande | Website | |

| 10 | Idéal pour l’analyse collaborative des données | Offre gratuite disponible | À partir de $22/utilisateur/mois (facturé annuellement) | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Avis détaillés sur les meilleurs outils d’analyse Big Data

Voici mes analyses détaillées des meilleurs outils d’analyse Big Data figurant dans ma sélection. Mes revues offrent un aperçu approfondi des fonctionnalités clés, avantages et inconvénients, intégrations, ainsi que des cas d’usage idéaux de chaque outil pour vous aider à faire le meilleur choix.

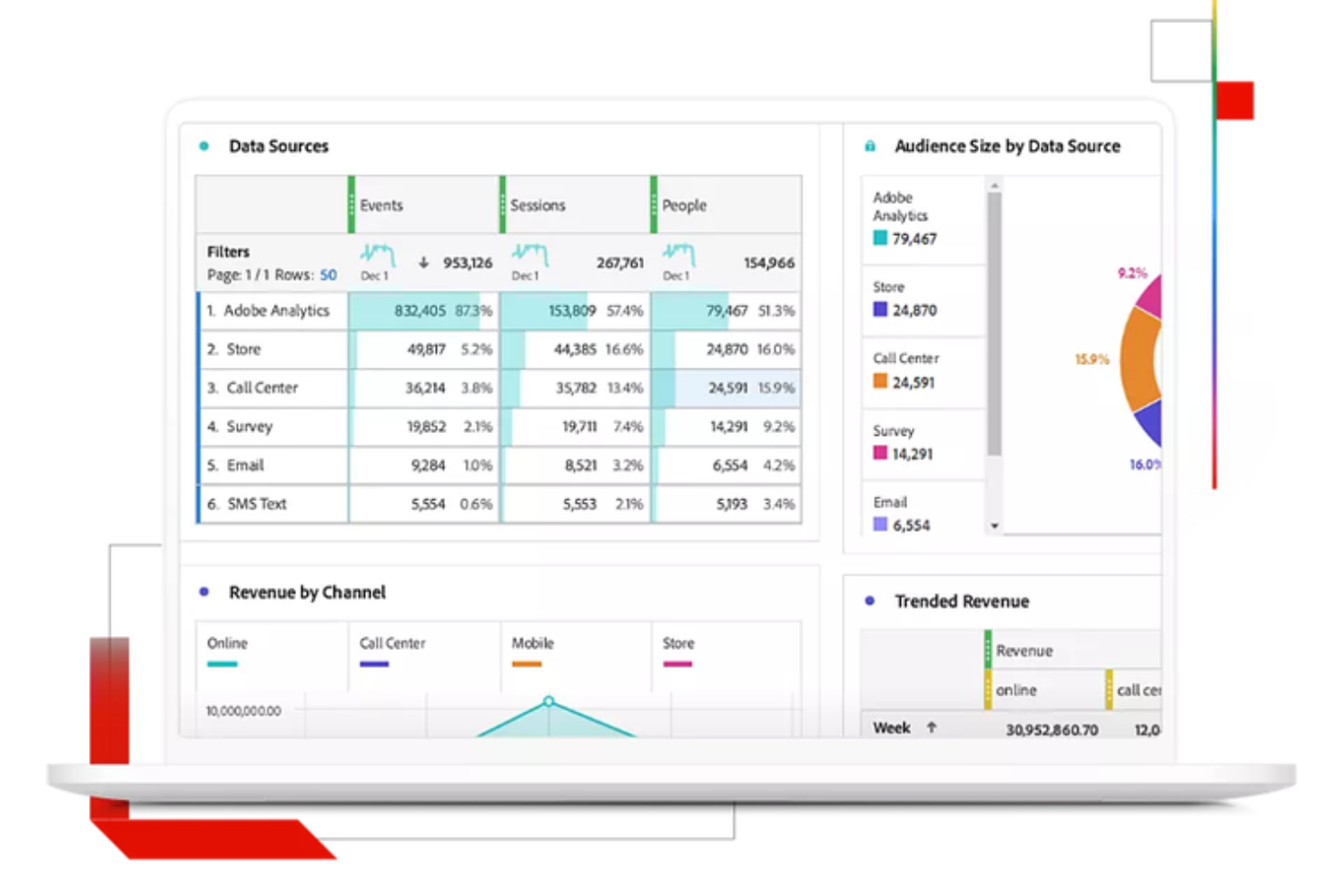

Adobe Customer Journey Analytics est une plateforme d'analyse de données massives d'entreprise qui vous permet d'unifier, d'analyser et de visualiser les interactions clients à travers de multiples canaux en utilisant la modélisation avancée des données et des outils alimentés par l'IA.

Pour qui Adobe Customer Journey Analytics est-il le mieux adapté ?

Grandes entreprises et équipes d'analyse ayant besoin d'unifier et d'analyser les données clients sur de nombreux canaux numériques et hors ligne.

Pourquoi j'ai choisi Adobe Customer Journey Analytics

J'ai choisi Adobe Customer Journey Analytics comme l'un des meilleurs car je peux recoller les identités clients sur le web, le mobile et les canaux hors ligne pour obtenir une vue unifiée. Mon équipe utilise sa résolution d'identité multicanal pour connecter des points de données fragmentés et suivre les parcours utilisateurs de bout en bout. J'apprécie la façon dont la plateforme nous permet d'analyser le comportement au niveau individuel ou par segment, même lorsque les clients interagissent anonymement ou changent d'appareil.

Fonctionnalités clés d'Adobe Customer Journey Analytics

- Vues de données : Créez des vues de données personnalisées pour segmenter et analyser de grands ensembles de données sans les dupliquer.

- Analytique en temps réel : Accédez à des tableaux de bord et rapports actualisés à la minute près pour des insights immédiats.

- Métriques calculées avancées : Créez des métriques complexes à l'aide de formules et de logiques adaptées à vos besoins métier.

- Visualisations interactives : Utilisez des outils glisser-déposer pour visualiser les tendances, les motifs et les relations dans vos données.

Intégrations d'Adobe Customer Journey Analytics

Adobe Customer Journey Analytics propose des intégrations natives avec Adobe Experience Platform, Adobe Analytics, Adobe Audience Manager et Adobe Target. Il offre également une API pour des intégrations personnalisées et prend en charge les connexions aux entrepôts de données cloud tels que Google BigQuery, Amazon Redshift et Snowflake.

Pros and Cons

Pros:

- Résolution d'identité multicanal pour des profils unifiés

- Détection d'anomalies alimentée par l'IA sur de grands ensembles de données

- Outils d'analyse de cohortes et de parcours flexibles

Cons:

- Nécessite l'écosystème Adobe pour une fonctionnalité complète

- Exigences importantes en ressources pour la mise en œuvre

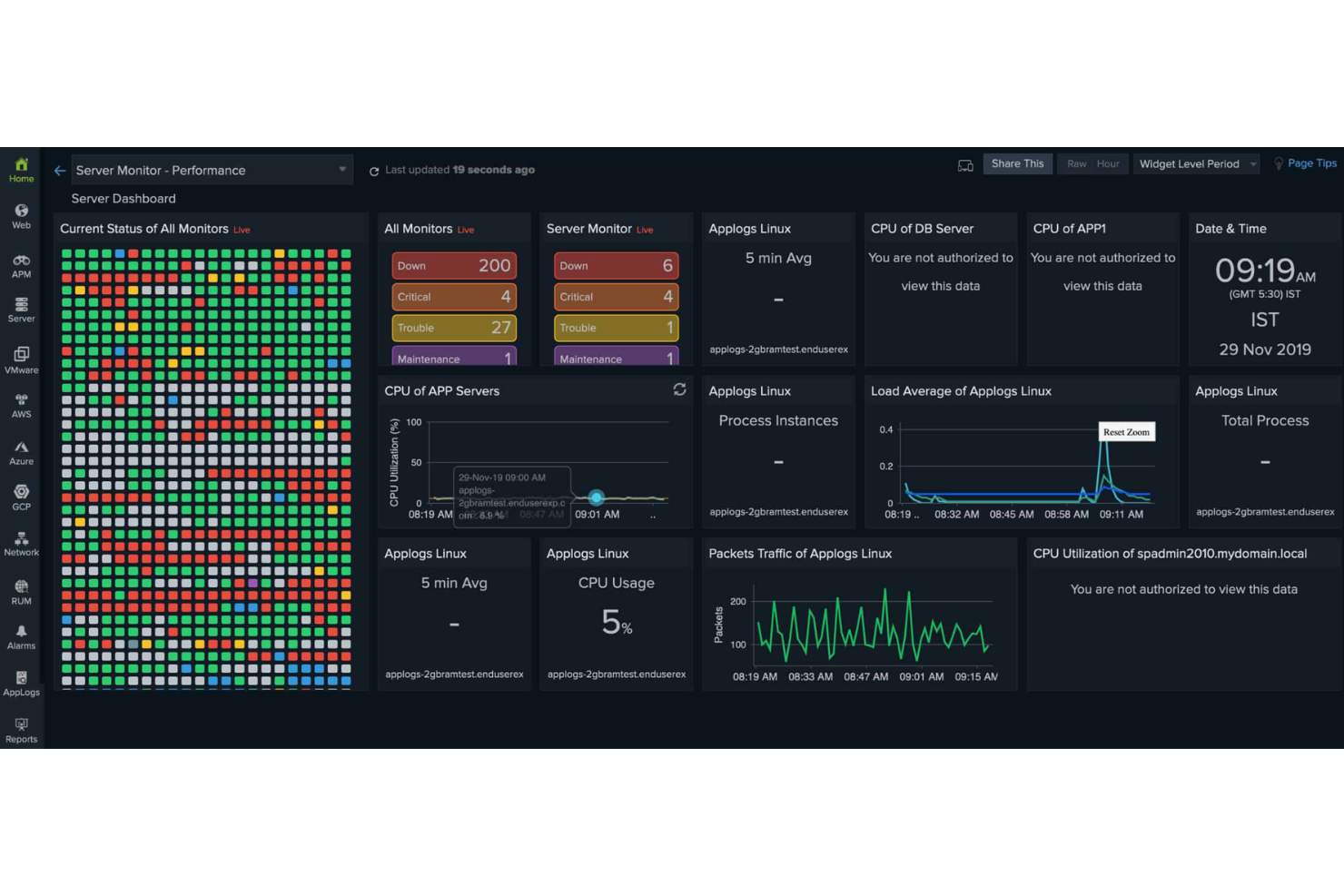

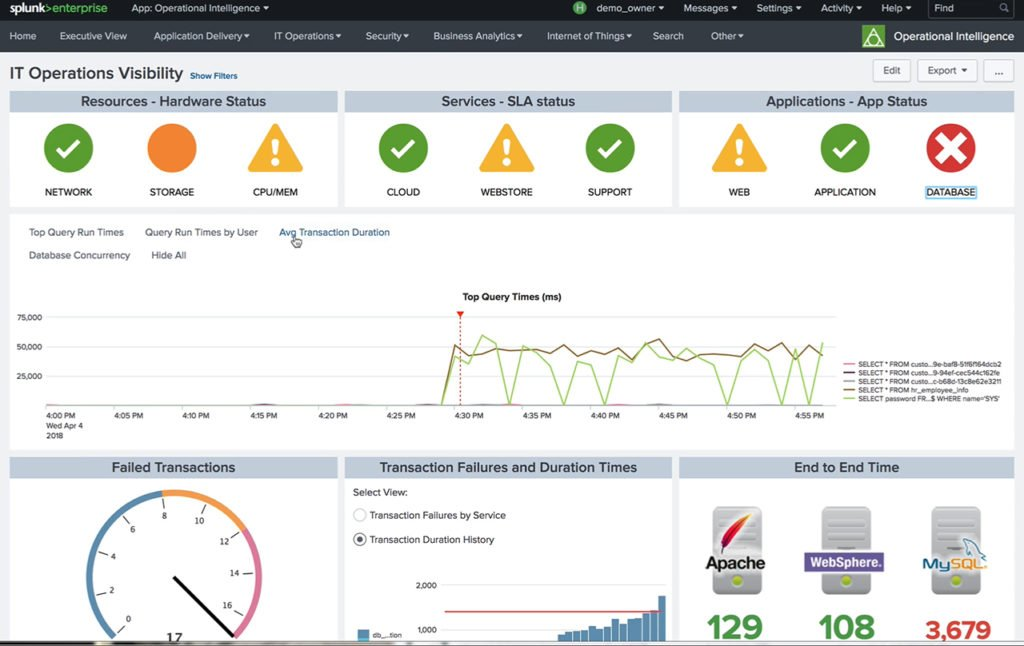

Splunk Enterprise est une plateforme d'analyse de données principalement utilisée par les équipes informatiques et de sécurité. Elle excelle dans la gestion des journaux et facilite l'analyse des données en temps réel, permettant ainsi une meilleure prise de décision.

Pourquoi j'ai choisi Splunk Enterprise : Elle est conçue pour la gestion des journaux, offrant des capacités avancées de recherche et d'indexation. Splunk Enterprise vous permet de collecter et d'analyser des journaux provenant de diverses sources en temps réel. Elle inclut des fonctionnalités d'alerte et de reporting pour tenir votre équipe informée. La plateforme est également évolutive, ce qui la rend adaptée aux entreprises en croissance.

Fonctionnalités et intégrations remarquables :

Les fonctionnalités incluent des capacités d'apprentissage automatique qui aident à l'analyse prédictive. Vous pouvez utiliser ses tableaux de bord personnalisables pour visualiser les données selon vos besoins. Splunk Enterprise propose également un système d'alerte qui informe votre équipe des problèmes critiques.

Les intégrations incluent Amazon Web Services, Microsoft Azure, Google Cloud Platform, ServiceNow, Cisco, Palo Alto Networks, VMware, Salesforce, Docker et Kubernetes.

Pros and Cons

Pros:

- Évolutif pour de grands volumes de données

- Solides capacités d'alerte

- Prend en charge l'apprentissage automatique

Cons:

- Peut être gourmand en ressources

- Assistance limitée pour les petites équipes

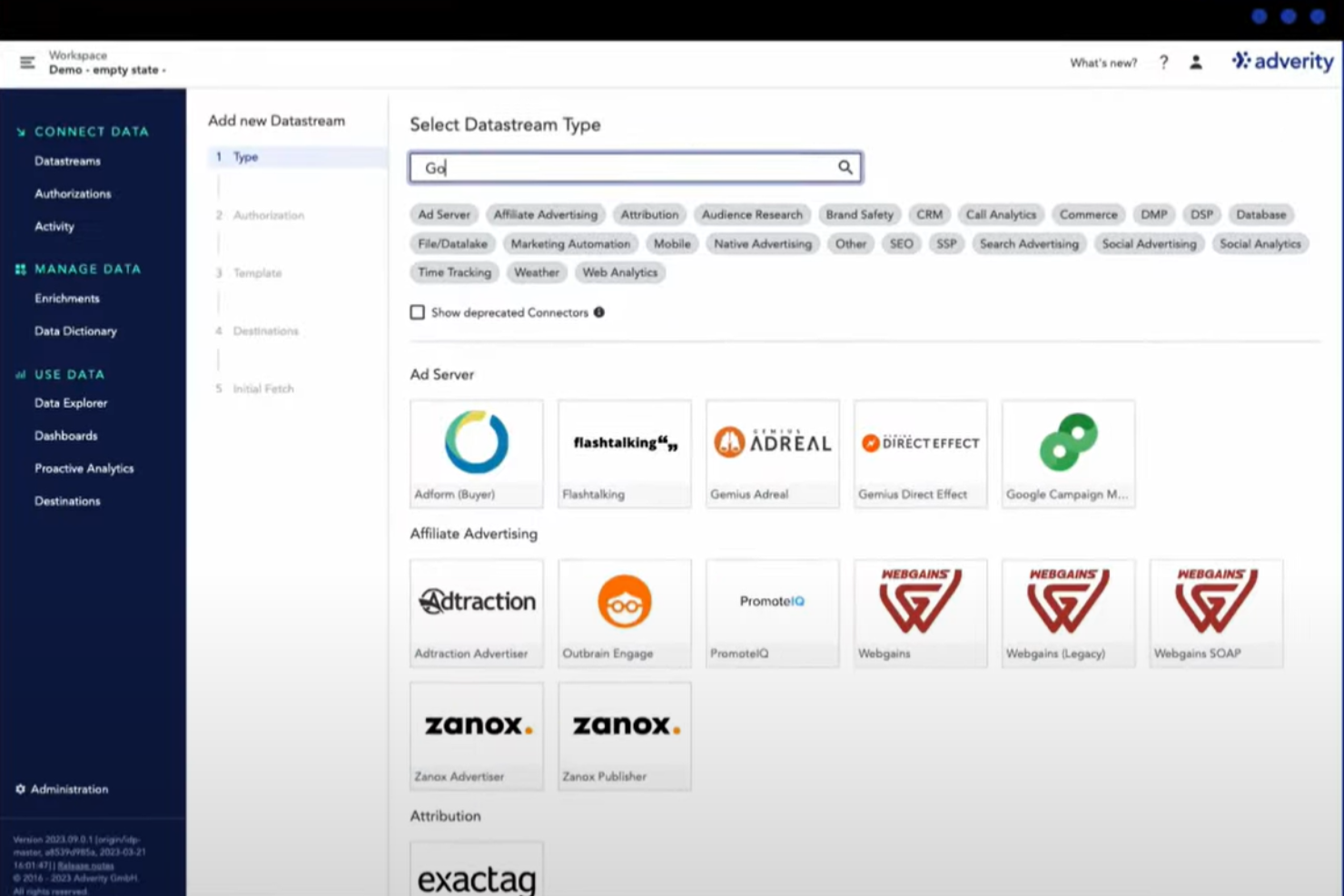

New Product Updates from Adverity

Adverity Enables Smart Scheduling in API

Adverity's Management API now includes smart schedule functionality, enhancing automation for data fetching. For more information, visit Adverity's official site.

Zoho Analytics est un outil d'intelligence d'affaires et d'analyse conçu pour les petites entreprises. Il permet aux utilisateurs de créer des rapports et des tableaux de bord pertinents, facilitant ainsi la prise de décisions basée sur les données.

Pourquoi j'ai choisi Zoho Analytics : Il est adapté aux petites entreprises grâce à une interface conviviale et une tarification avantageuse. Zoho Analytics propose des fonctionnalités de glisser-déposer pour une création de rapports facile. Il inclut des visualisations préconçues qui font gagner du temps à votre équipe. Vous pouvez également utiliser son assistant IA, Zia, pour interroger rapidement les données.

Fonctionnalités remarquables & intégrations :

Fonctionnalités : mélange des données, permettant de combiner des données issues de différentes sources. L'outil offre des analyses collaboratives, afin que votre équipe puisse travailler ensemble sur les rapports. Vous pouvez aussi bénéficier d'importations de données planifiées pour garder vos rapports à jour.

Intégrations : Salesforce, Microsoft Dynamics, Mailchimp, Google Workspace, Dropbox, Slack, Zendesk, HubSpot, QuickBooks et Shopify.

Pros and Cons

Pros:

- Tableaux de bord personnalisables

- Assistant IA pour les requêtes

- Adapté aux petites équipes

Cons:

- Analyses avancées limitées

- Certaines fonctionnalités nécessitent des forfaits premium

New Product Updates from Zoho Analytics

Zoho Analytics Enhances Analysis, Reporting, and Real-Time Data

Zoho Analytics brings richer PDF exports, smarter multi-table auto analysis, and real-time data connections. These updates help teams generate deeper insights, preserve report accuracy, and analyze data in real time with less manual effort. For more information, visit Zoho Analytics’ official site.

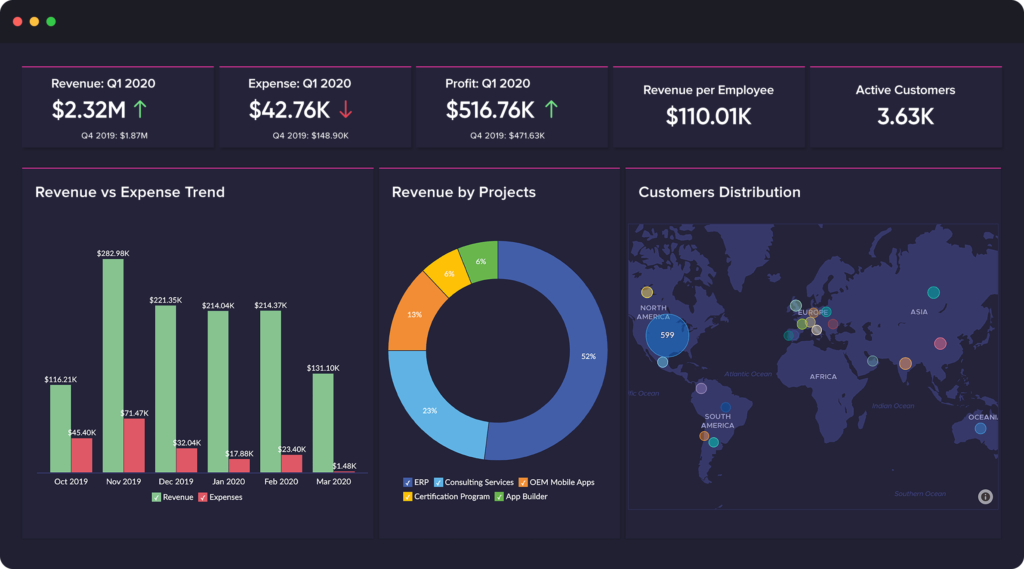

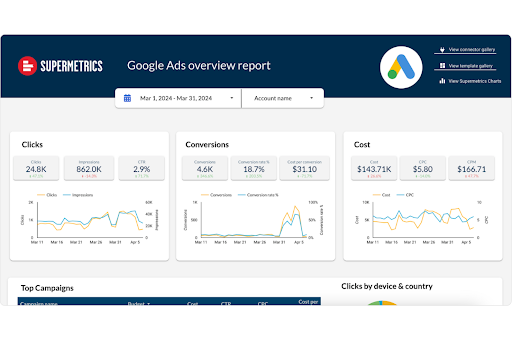

Supermetrics est une solution d’entrepôt de données conçue pour les spécialistes du marketing et les analystes de données. Elle aide les utilisateurs à intégrer des données provenant de plus de 150 sources marketing dans des plateformes comme Google Sheets et BigQuery.

Pourquoi j’ai choisi Supermetrics : Elle se concentre sur l’entrepôt de données en permettant une intégration transparente depuis diverses plateformes marketing. Supermetrics vous permet de connecter des données issues de Facebook Ads, Google Ads et bien d’autres. Sa capacité à transférer des données vers des outils tels que Looker Studio et Power BI la distingue. Vous pouvez visualiser et analyser les performances marketing efficacement.

Principales fonctionnalités & intégrations :

Fonctionnalités incluent des transferts de données automatisés, l’analyse des données historiques et une gestion sécurisée des données. Votre équipe peut facilement compiler des données provenant de différentes sources et les visualiser avec des outils de business intelligence. La plateforme garantit la conformité aux réglementations telles que le RGPD et le CCPA.

Intégrations incluent Facebook Ads, Google Ads, TikTok Ads, Google Sheets, BigQuery, Looker Studio, Power BI, LinkedIn Ads, Microsoft Excel et Instagram Insights.

Pros and Cons

Pros:

- Transferts de données sécurisés

- Adapté aux spécialistes du marketing

- Conformité au RGPD

Cons:

- Options de personnalisation limitées

- Peut s’avérer coûteux pour les petites équipes

New Product Updates from Supermetrics

Supermetrics Updates Ahrefs and Database Data Sources

Supermetrics has updated its Ahrefs and Database data sources to ensure smoother performance and stronger connection reliability. Users may need to reconnect or adjust their configurations to continue syncing data without interruptions. For more information, visit Supermetrics' official site.

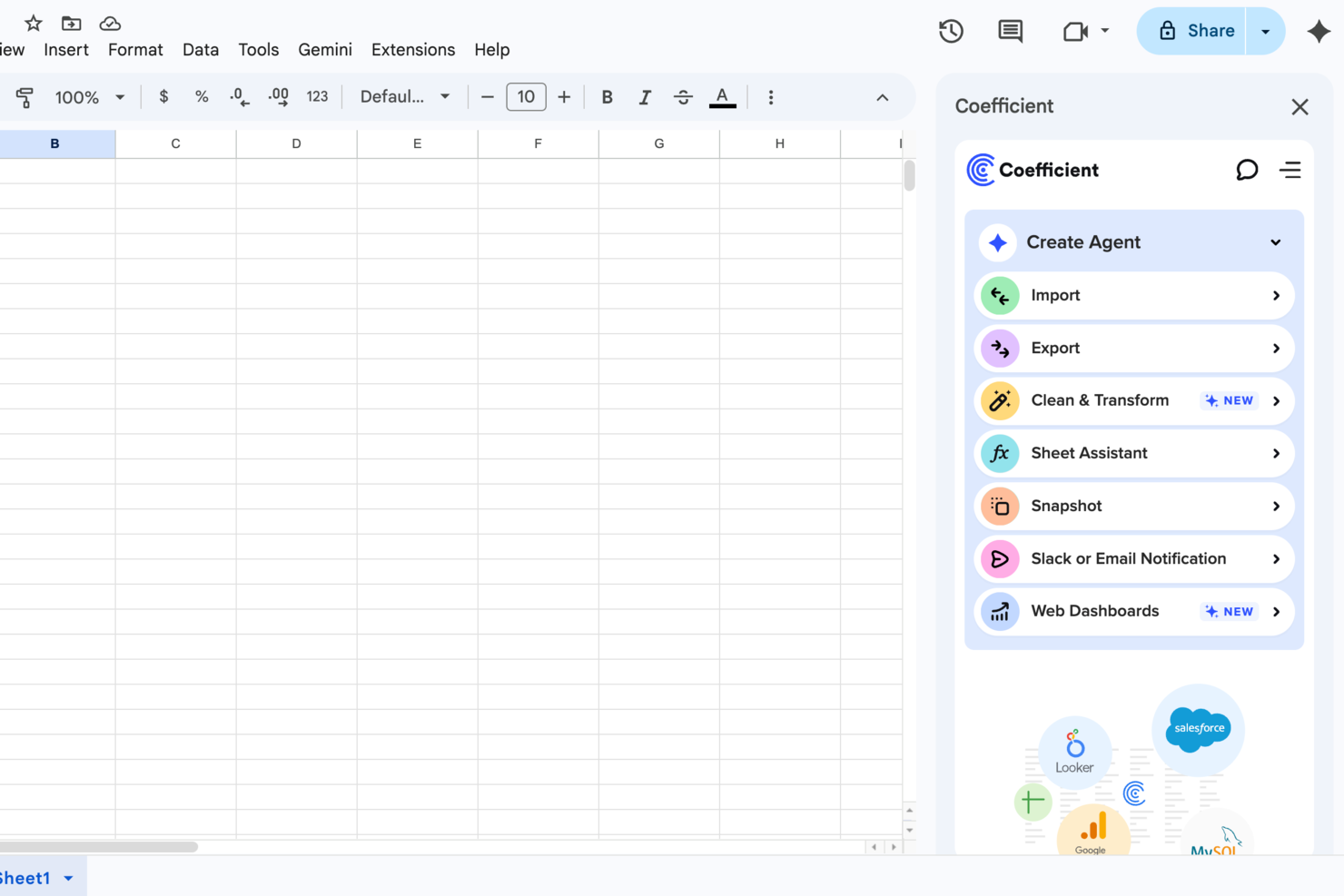

Coefficient est un outil de connectivité sans code qui relie vos feuilles de calcul directement à vos systèmes métier et bases de données en temps réel. Il élimine la contrainte des exportations manuelles de données en transformant Google Sheets ou Excel en un centre d’analyses en temps réel. Grâce à l’intégration de plus de 100 sources de données, Coefficient unifie les données disparates, permettant à votre équipe de créer des analyses et tableaux de bord dynamiques pour faciliter la prise de décision éclairée.

Pourquoi j’ai choisi Coefficient

J’ai choisi Coefficient pour sa capacité unique à transformer des feuilles de calcul ordinaires en applications de données dynamiques, une fonctionnalité qui le distingue dans le domaine des outils d’analyse big data. Il comble le fossé entre les vastes entrepôts de données et les feuilles de calcul déjà utilisées par vos équipes, garantissant que vos rapports reposent toujours sur des données en temps réel, sans avoir besoin de téléchargements CSV manuels. De plus, les analyses assistées par intelligence artificielle renforcent votre capacité à obtenir des insights exploitables sans nécessiter des compétences avancées en codage, en faisant un choix idéal pour les équipes souhaitant exploiter efficacement les données. Par conséquent, ces capacités correspondent parfaitement aux besoins des entreprises qui cherchent à renforcer leur stratégie axée sur les données.

Fonctionnalités clés de Coefficient

En plus de ses capacités d’intégration remarquables, j’ai également identifié plusieurs fonctionnalités qui renforcent sa valeur en tant qu’outil d’analyse big data :

- Analyse de données en direct pilotée par l’IA : Cette fonctionnalité vous permet d’effectuer des analyses de données en temps réel, offrant des informations immédiates et facilitant une prise de décision rapide.

- Rapports automatisés : Grâce à cette fonctionnalité, vous pouvez programmer la génération automatique de rapports, ce qui permet de gagner du temps tout en assurant des mises à jour régulières des données.

- Tableaux de bord personnalisables : Vous pouvez créer des tableaux de bord adaptés à vos besoins spécifiques, améliorant la visualisation et la compréhension de jeux de données complexes.

- Alertes automatisées : Cette fonctionnalité vous permet de configurer des notifications via Slack ou email, pour garantir que votre équipe reste informée des évolutions critiques ou nouveaux insights issus des données.

Intégrations de Coefficient

Les intégrations incluent Google Sheets, Excel, Salesforce, QuickBooks, Looker, Tableau, PostgreSQL, Snowflake, Slack, HubSpot, Google Analytics et MySQL, avec la possibilité d’ajouter d’autres connexions grâce à des intégrations API personnalisées. L’agent API personnalisé de Coefficient permet de créer vos propres intégrations directement dans Google Sheets ou Excel.

Pros and Cons

Pros:

- Unifie les données CRM, financières et d’entrepôt dans un seul environnement de reporting

- Permet la création de rapports en libre-service sans concevoir de pipelines de données personnalisés

- Connecte les données métier en direct dans des flux de travail de feuille de calcul familiers

Cons:

- Pas de visualisation autonome en tableau de bord

- Dépendance à la connexion Internet

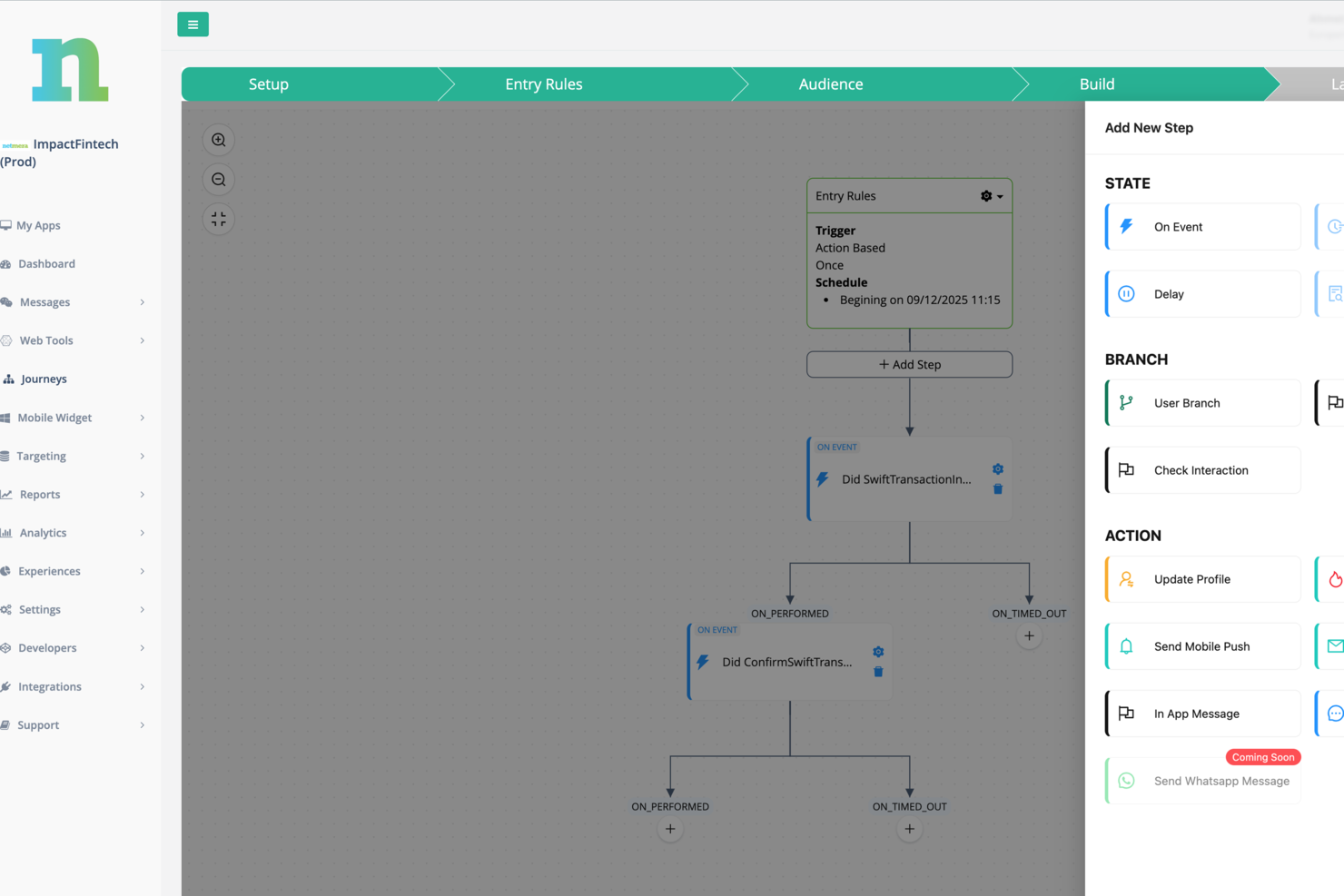

Netmera est une plateforme d'engagement client alimentée par l'IA, conçue pour les entreprises souhaitant transformer les données clients en interactions plus personnalisées et à fort impact. Elle prend en charge la communication omnicanal sur mobile, web, email et SMS, aidant les équipes à délivrer des messages cohérents tout au long du parcours client. Grâce à des outils d'analyse intégrés et d'orchestration de parcours, Netmera permet à des secteurs comme le commerce de détail, les télécommunications et la banque d'affiner leurs stratégies marketing, d'améliorer le ciblage et de renforcer la fidélisation.

Pourquoi j'ai choisi Netmera

J'ai choisi Netmera pour ses solides capacités d'analyse de données offrant des informations exploitables sur le comportement des clients. Sa plateforme de données clients agrège les données de multiples sources, vous permettant de créer des profils utilisateurs complets pour un marketing ciblé. De plus, la fonction de tests A/B de Netmera vous permet d'expérimenter différentes stratégies afin de déterminer l'approche la plus efficace, garantissant ainsi que vos campagnes sont toujours optimisées pour les meilleurs résultats.

Principales fonctionnalités de Netmera

En plus de ses fonctionnalités d'analyse de données et de tests A/B, Netmera propose plusieurs autres options pouvant améliorer les efforts marketing de votre équipe :

- Personnalisation web : Cette fonctionnalité vous permet d'adapter l'expérience web à chaque utilisateur selon son comportement et ses préférences.

- Collecte de données sans balises : Collectez automatiquement les données utilisateurs sans balisage manuel, simplifiant ainsi la gestion des données.

- Cartographie du parcours client : Visualisez et analysez les étapes suivies par les clients pour optimiser les points de contact et renforcer l'engagement.

- Collecte de retours : Obtenez des retours directement auprès des utilisateurs afin d'affiner vos stratégies et de résoudre rapidement tout problème.

Intégrations Netmera

Les intégrations incluent les notifications push sur mobile et web, le marketing par email et SMS, WhatsApp, les pop-ups web, Amazon SES, Setrow et Uzman Posta.

Pros and Cons

Pros:

- Aperçu en temps réel des performances des campagnes

- Outils de tests A/B intégrés

- Prend en charge les campagnes d'engagement multicanal

Cons:

- Les fonctionnalités avancées peuvent nécessiter un accompagnement lors de la prise en main

- La configuration initiale peut être chronophage

Für Entwicklungsteams ist der Rat von Database Labs einfach: 'Konzentriert euch auf eure App. Überlasst uns die Datenbank.' Für diejenigen, die diesem Rat folgen, scheinen die Ergebnisse eindeutig zu sein. Ein Nutzer sagt: 'Database Labs hat meine Entwickler entlastet – mein fortwährender Kampf mit Postgres ist endlich vorbei!' Ein anderer sagt: 'Allen, die nach Postgres-Experten suchen, kann ich Database Labs wirklich empfehlen.'

Die Tarife von Database Labs beginnen bei 19 $ pro Monat.

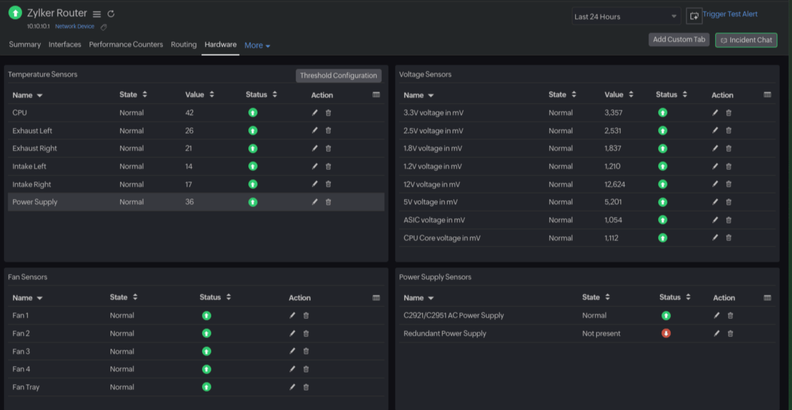

New Product Updates from Site24x7

Site24x7 Enhances Network Monitoring With Device and Visibility Updates

Site24x7 introduces proactive hardware health monitoring, expanded device support, centralized network controls, and enhanced SD-WAN visualization to improve network monitoring and management. For more information, visit Site24x7’s official site.

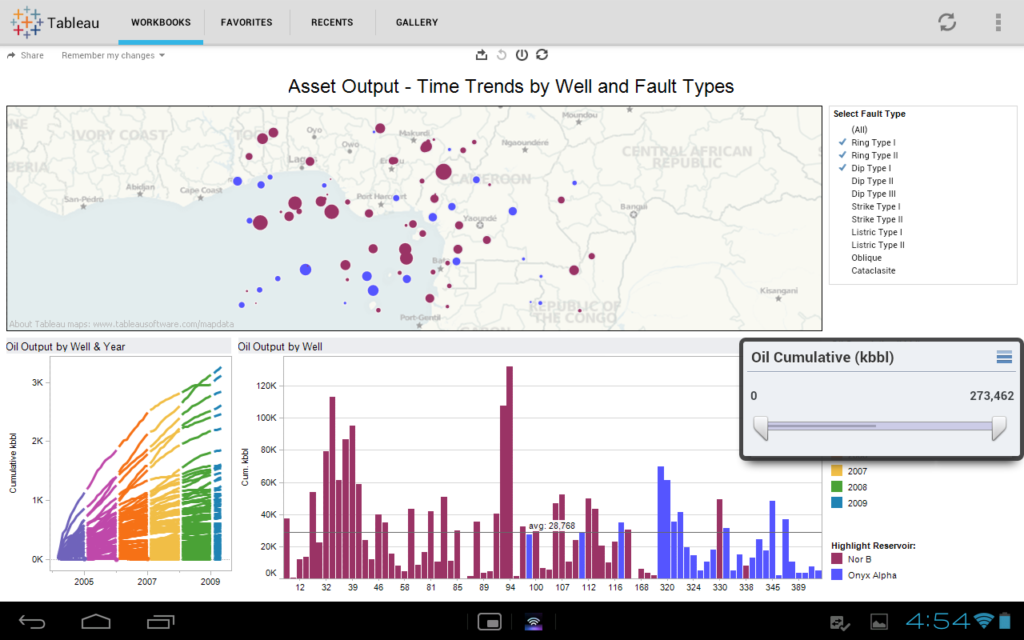

Tableau est un outil de visualisation de données conçu pour les analystes et les professionnels de l'intelligence d'affaires. Il permet aux utilisateurs de créer des tableaux de bord interactifs et partageables qui illustrent les données de manière visuellement attrayante.

Pourquoi j'ai choisi Tableau : Il est idéal pour la visualisation de données, offrant un large éventail de types de graphiques et d'options de personnalisation. Tableau propose une fonctionnalité de glisser-déposer, facilitant la création de tableaux de bord par votre équipe. Il prend en charge l'analyse des données en temps réel, ce qui vous aide à prendre des décisions rapidement. La capacité de cet outil à gérer facilement de grands ensembles de données le distingue sur le marché de la visualisation.

Fonctionnalités et intégrations remarquables :

Fonctionnalités : narration, qui vous permet de créer des présentations narratives à partir de vos données. Vous pouvez utiliser la fonctionnalité de fusion de données pour combiner des données provenant de différentes sources. Tableau propose également des analyses géospatiales, offrant des cartes et des perspectives basées sur la localisation.

Intégrations : Salesforce, Microsoft Excel, Google Analytics, Amazon Redshift, Microsoft SQL Server, Oracle, SAP HANA, Snowflake, Google BigQuery et Dropbox.

Pros and Cons

Pros:

- Large choix d'options de visualisation

- Analyse des données en temps réel

- Forte communauté d'entraide

Cons:

- Support mobile limité

- Nécessite une préparation des données

Splunk Enterprise est une plateforme d'analyse de données principalement utilisée par les équipes informatiques et de sécurité. Elle excelle dans la gestion des journaux et facilite l'analyse des données en temps réel, permettant ainsi de prendre de meilleures décisions.

Pourquoi j'ai choisi Splunk Enterprise : Elle est conçue pour la gestion des journaux, offrant des capacités avancées de recherche et d'indexation. Splunk Enterprise permet de collecter et d'analyser des données de journaux provenant de diverses sources en temps réel. Elle comprend des fonctionnalités d'alerte et de reporting qui tiennent votre équipe informée. La plateforme propose également une forte évolutivité, la rendant adaptée aux entreprises en croissance.

Fonctionnalités et intégrations remarquables :

Fonctionnalités : comprennent des capacités d'apprentissage automatique qui aident à l'analyse prédictive. Vous pouvez utiliser ses tableaux de bord personnalisables pour visualiser les données selon vos besoins. Splunk Enterprise propose également un système d'alerte qui informe votre équipe des problèmes critiques.

Intégrations : incluent Amazon Web Services, Microsoft Azure, Google Cloud Platform, ServiceNow, Cisco, Palo Alto Networks, VMware, Salesforce, Docker et Kubernetes.

Pros and Cons

Pros:

- Évolutif pour de gros volumes de données

- Capacités d'alerte puissantes

- Prend en charge l'apprentissage automatique

Cons:

- Peut être gourmand en ressources

- Support limité pour les petites équipes

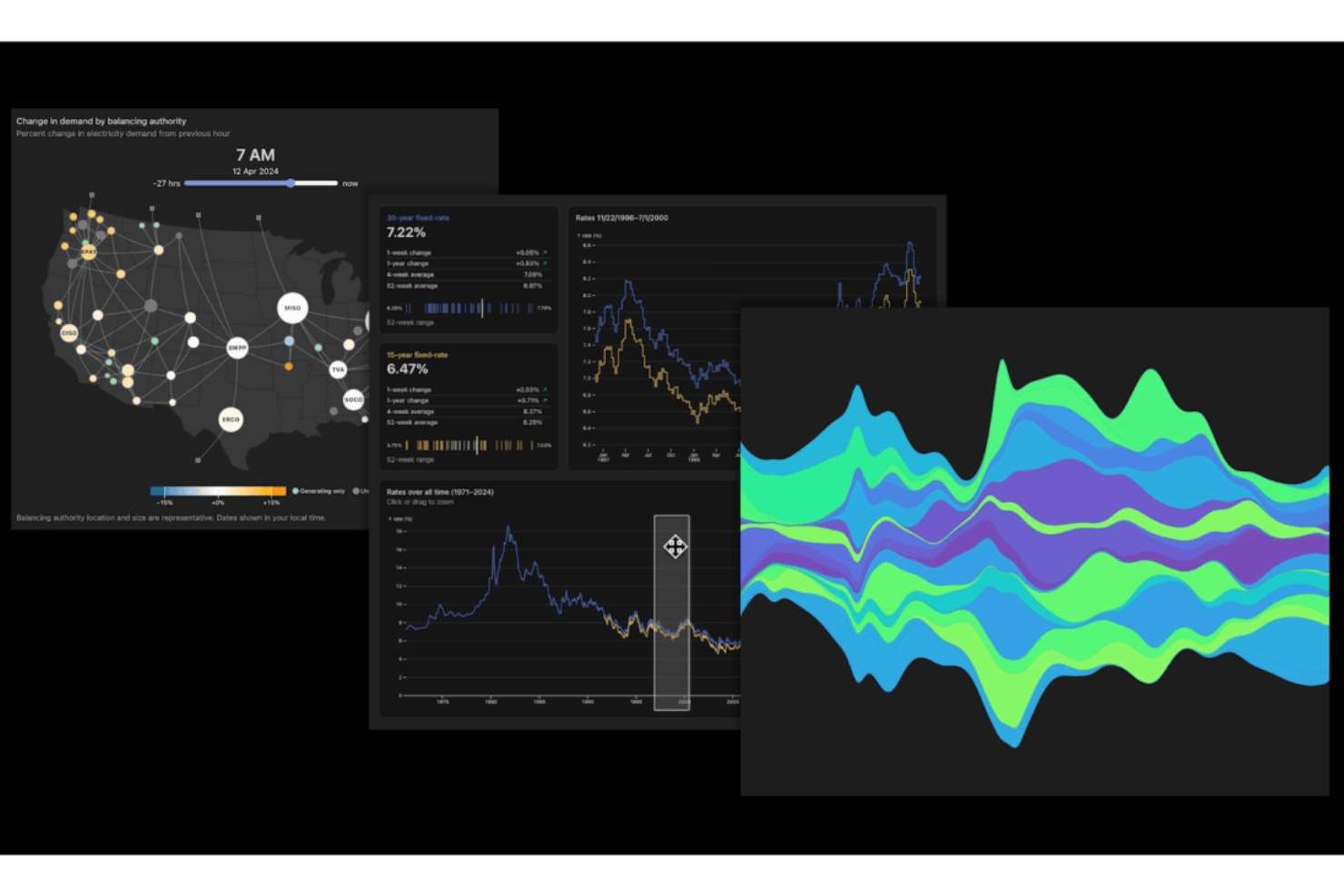

Observable est une plateforme de visualisation et d’analyse de données destinée aux data scientists et aux analystes. Elle permet aux utilisateurs de créer des visualisations interactives et partageables et de collaborer en temps réel sur des projets de données.

Pourquoi j’ai choisi Observable : Elle est axée sur l’analyse collaborative des données, permettant aux équipes de travailler ensemble sur des projets de données en toute fluidité. Observable propose des fonctionnalités de collaboration en direct, permettant à plusieurs utilisateurs de modifier et de consulter des visualisations de données en temps réel. Son interface en mode bloc-notes facilite l’exploration dynamique des données. Vous pouvez également utiliser du code personnalisé pour créer des visualisations sur mesure, renforçant ainsi le processus collaboratif.

Fonctionnalités et intégrations remarquables :

Fonctionnalités : incluent le contrôle de version, qui garde une trace des modifications apportées à vos projets de données. Observable propose des modèles personnalisables pour mettre facilement en place des visualisations. Vous pouvez aussi intégrer vos visualisations directement dans des sites web ou applications, ce qui facilite le partage des données.

Intégrations : incluent Google Sheets, GitHub, D3.js, Plotly, Vega-Lite, Mapbox, Leaflet, TopoJSON, Airtable et AWS S3.

Pros and Cons

Pros:

- Collaboration en temps réel

- Prise en charge du code personnalisé

- Intégration facile des visualisations

Cons:

- Fonctionnalité hors-ligne restreinte

- Limité à une utilisation basée sur le web

Autres outils d’analyse Big Data

Voici d’autres options d’outils d’analyse Big Data qui ne figurent pas dans ma sélection principale, mais qui méritent tout de même d’être considérées :

- GoodData

Idéal pour l’analytique embarquée

- IBM Cloud Pak for Data

Idéal pour réduire les demandes ETL

- SAS Visual Analytics

Meilleur outil d'analyse big data avec des visualisations intelligentes

- Qlik Sense

Idéal pour l'analytique en libre-service

- Azure Data Lake Analytics

Meilleure solution big data à paiement par tâche

- Azure Databricks

Idéal pour l'évolutivité

- Qrvey

Meilleure analyse de big data pour les start-ups

- DNIF Security Information & Event Management (SIEM)

Idéal pour l’analyse de la sécurité

- Arcadia Enterprise

Meilleure solution d’analyse pour les télécommunications

- Semrush

Meilleure analyse de données massives pour la facilité d'utilisation + accessibilité

Critères de sélection des outils d’analyse Big Data

Pour sélectionner les meilleurs outils d’analyse Big Data à inclure dans cette liste, j’ai pris en compte les besoins et les difficultés fréquents des acheteurs, tels que la gestion de grands ensembles de données ou la garantie de la sécurité des informations. J’ai également utilisé la grille d’évaluation suivante pour que mon analyse reste structurée et équitable :

Fonctionnalités principales (25 % du score total)

Pour figurer dans cette liste, chaque solution devait répondre à ces cas d’usage courants :

- Visualisation des données

- Analyse en temps réel

- Analyse prédictive

- Intégration des données

- Rapports et tableaux de bord

Fonctionnalités supplémentaires remarquables (25% du score total)

Pour affiner davantage la sélection, j'ai également recherché des fonctionnalités uniques, telles que :

- Capacités d'apprentissage automatique

- Interfaces utilisateur personnalisables

- Fonctionnalités de sécurité avancées

- Compatibilité avec le cloud

- Exploration interactive des données

Facilité d'utilisation (10% du score total)

Pour évaluer la facilité d’utilisation de chaque système, j’ai pris en compte les éléments suivants :

- Navigation intuitive

- Disposition et conception claires

- Courbe d'apprentissage minimale

- Interface réactive

- Options de personnalisation

Intégration des nouveaux utilisateurs (10% du score total)

Pour évaluer l'expérience d'intégration sur chaque plateforme, j'ai considéré les points suivants :

- Disponibilité de vidéos de formation

- Visites interactives du produit

- Accès à des modèles

- Webinaires et sessions en direct

- Chatbots d’assistance

Support client (10% du score total)

Pour évaluer les services de support client de chaque éditeur de logiciel, j'ai pris en considération :

- Disponibilité du support 24h/24 et 7j/7

- Multiples modes de contact

- Accès à une base de connaissances

- Délai de réponse

- Qualité des résolutions

Rapport qualité/prix (10% du score total)

Pour évaluer le rapport qualité/prix de chaque plateforme, j'ai pris en compte :

- Transparence des tarifs

- Prix concurrentiels

- Fonctionnalités proposées selon le niveau de prix

- Réductions pour les offres à long terme

- Disponibilité d'une période d'essai gratuite

Avis clients (10% du score total)

Pour mesurer la satisfaction globale des clients, j’ai pris en compte les éléments suivants lors de la lecture des avis :

- Notes de satisfaction globale

- Retours sur la facilité d’utilisation

- Commentaires sur la qualité du support

- Bugs ou problèmes signalés par les utilisateurs

- Recommandations et parrainages

Comment choisir un outil d'analyse de Big Data

Il est facile de se laisser submerger par de longues listes de fonctionnalités et des structures tarifaires complexes. Pour vous aider à rester concentré lors de votre processus unique de sélection de logiciel, voici une liste de critères à garder à l'esprit :

| Critère | À prendre en considération |

| Scalabilité | Assurez-vous que l’outil peut évoluer avec vos besoins en données. Privilégiez les solutions capables de gérer une augmentation des volumes de données sans compromettre les performances, en particulier si votre entreprise est en expansion. |

| Intégrations | Vérifiez si l’outil s’intègre à votre écosystème logiciel existant, tel que les systèmes CRM ou autres outils blockchain. Un flux de données sans couture entre applications peut faire gagner du temps et réduire les erreurs de votre équipe. |

| Personnalisation | Vérifiez si l’outil permet une personnalisation adaptée à vos processus métier spécifiques. Des tableaux de bord et rapports personnalisés peuvent fournir des analyses plus pertinentes pour votre équipe. |

| Facilité d'utilisation | Évaluez la courbe d’apprentissage et l’interface utilisateur. Des outils intuitifs font gagner du temps et réduisent le besoin de formations approfondies. |

| Budget | Veillez à ce que le coût de l’outil corresponde à vos contraintes budgétaires. Prenez en compte les coûts initiaux ainsi que les dépenses récurrentes comme les frais d’abonnement ou de licences supplémentaires. |

| Mesures de sécurité | Vérifiez les dispositifs de sécurité de l’outil, tels que le chiffrement et la conformité aux réglementations comme le RGPD. La protection de vos données doit rester une priorité absolue. |

| Services de support | Pensez aux options de support client disponibles. Un support fiable aide à résoudre rapidement les problèmes et à limiter les interruptions pour votre équipe. |

| Performance | Évaluez la vitesse et la fiabilité de l’outil. Une performance régulière garantit à votre équipe un accès et une analyse des données sans interruption. |

Tendances des outils d'analyse de Big Data

Au cours de mes recherches, j'ai consulté d'innombrables mises à jour produit, communiqués de presse et journaux de publication provenant de différents éditeurs d'outils d'analyse de données volumineuses. Voici quelques-unes des tendances émergentes que je surveille de près :

- Analyse en temps réel : Les entreprises souhaitent des informations exploitables en temps réel. Les outils d'analyse SQL se concentrent sur le traitement des données en temps réel pour aider les sociétés à prendre des décisions rapidement. Des éditeurs comme Apache Kafka et Azure Stream Analytics améliorent leurs capacités de gestion en temps réel.

- Démocratisation des données : De plus en plus d'outils permettent aux utilisateurs non techniques d'accéder aux données et de les interpréter. Cette tendance permet à tous les membres d'une équipe de prendre des décisions fondées sur les données. Qlik Sense et Tableau sont en tête du marché grâce à des interfaces conviviales.

- Analyse basée sur l’IA : L’intelligence artificielle est intégrée pour révéler des modèles et formuler des prédictions. Cela aide les entreprises à anticiper les tendances et à optimiser leurs stratégies. Des outils comme IBM Watson Analytics utilisent l'IA afin de fournir des analyses approfondies.

- Préparation autonome des données : Les utilisateurs souhaitent préparer leurs données sans dépendre du service informatique. Les outils offrent des fonctionnalités en libre-service qui simplifient le nettoyage et la transformation des données. Trifacta et Alteryx sont des exemples d’éditeurs qui misent sur cette tendance.

- Progrès en matière de protection des données : Avec la recrudescence des violations de données, les outils mettent l'accent sur l'amélioration de la sécurité des données. Cela comprend le chiffrement et la conformité à des réglementations telles que le RGPD. Splunk et GoodData font de la protection des données une priorité.

Qu’est-ce qu’un outil d’analyse de données volumineuses ?

Les outils d'analyse de données volumineuses sont des solutions logicielles conçues pour traiter et analyser de grands volumes de données afin d’en extraire des informations pertinentes. Ces outils sont couramment utilisés par les data scientists, analystes et professionnels IT qui doivent interpréter des ensembles de données complexes et en tirer des enseignements exploitables.

L’analyse en temps réel, les fonctionnalités basées sur l’IA et la démocratisation des données facilitent une prise de décision rapide et efficace. Globalement, ces outils permettent aux entreprises de transformer leurs données en atout stratégique, renforçant la prise de décision et l'efficacité opérationnelle.

Fonctionnalités des outils d’analyse de données volumineuses

Lors du choix des outils d'analyse de données volumineuses, surveillez les fonctionnalités clés suivantes :

- Visualisation des données : Transforme des données complexes en graphiques et diagrammes faciles à comprendre, facilitant la compréhension rapide des informations.

- Analyse basée sur l'IA : Utilise l’intelligence artificielle pour révéler des modèles et prédictions et ainsi améliorer la planification stratégique.

- Préparation autonome des données : Permet aux utilisateurs de nettoyer et de transformer les données sans l’aide du service IT, économisant temps et ressources.

- Évolutivité : Gère efficacement des volumes de données croissants, accompagnant la croissance et le développement des entreprises.

- Analyses cloud en temps réel : Fournit des informations immédiates à partir de données en direct, permettant aux entreprises de prendre des décisions en temps voulu.

- Intégration des données : Connecte différentes sources de données pour offrir une vision unifiée, améliorant la fiabilité et la complétude des informations.

- Personnalisation : Permet aux utilisateurs d’adapter tableaux de bord et rapports à leurs besoins et préférences spécifiques.

- Garanties de sécurité : Assure la protection des données grâce au chiffrement et au respect de normes telles que le RGPD.

- Fonctionnalités collaboratives : Facilite le travail d’équipe en permettant à plusieurs utilisateurs de collaborer simultanément sur des projets de données.

- Capacités de recherche intelligente : Les outils de catalogage de données aident à retrouver et analyser rapidement des données spécifiques, améliorant la productivité.

Avantages des outils d’analyse de données volumineuses

La mise en place d’outils d'analyse de données volumineuses offre divers avantages pour votre équipe et votre entreprise. Voici quelques éléments dont vous pouvez bénéficier :

- Meilleure prise de décision : L'analyse en temps réel et les informations issues de l’IA permettent à votre équipe de prendre des décisions éclairées rapidement.

- Efficacité accrue : La préparation autonome des données limite les besoins en support IT, accélérant le traitement des données.

- Collaboration optimisée : Les fonctionnalités collaboratives permettent à votre équipe de travailler ensemble sur les projets de données, ce qui améliore la productivité.

- Évolutivité : La capacité de gérer de grands ensembles de données signifie que vos outils peuvent accompagner l'évolution de vos besoins.

- Meilleure précision des données : L’intégration des données apporte une vision unifiée, garantissant que les décisions reposent sur des informations exactes et complètes.

- Sécurité des données : Les garanties de sécurité protègent les informations sensibles et aident à répondre aux exigences légales telles que le RGPD.

- Analyses personnalisées : La personnalisation vous permet d'adapter les rapports et tableaux de bord afin d’obtenir des informations directement pertinentes pour votre entreprise.

Coûts et tarification des outils d'analyse de Big Data

Choisir des outils d'analyse de Big Data nécessite de comprendre les différents modèles et plans tarifaires disponibles. Les coûts varient en fonction des fonctionnalités, de la taille de l'équipe, des modules complémentaires et bien plus. Le tableau ci-dessous résume les plans courants, leurs prix moyens, ainsi que les fonctionnalités typiquement incluses dans les solutions d'analyse de Big Data :

Tableau comparatif des plans pour les outils d'analyse de Big Data

| Type de plan | Prix moyen | Fonctionnalités courantes |

| Plan gratuit | $0 | Visualisation de données de base, stockage de données limité et assistance communautaire. |

| Plan personnel | $10-$30/user/month | Visualisations améliorées, analyses en temps réel et préparation des données en libre-service. |

| Plan business | $50-$150/user/month | Analyses avancées, fonctionnalités collaboratives et intégration avec des outils de gestion populaires. |

| Plan entreprise | $200-$500/user/month | Tableaux de bord personnalisables, analyses basées sur l’IA, possibilités d’extension et support client dédié. |

FAQ sur les outils d'analyse de Big Data

Voici les réponses à quelques questions fréquemment posées sur les outils d’analyse de Big Data :

Quelles sont les limitations de l'analyse de Big Data ?

L’analyse de Big Data peut rencontrer des difficultés liées à la qualité des données, à l’intégration et à des coûts d’infrastructure élevés. Vous pouvez aussi être confronté à des problèmes de vitesse de traitement, d’analyse en temps réel et de gestion des données non structurées. Pour minimiser ces limitations, investissez dans des cadres de gouvernance des données, une infrastructure cloud évolutive et des outils d’automatisation. Auditez régulièrement vos pipelines de données afin d’en garantir l’exactitude et l’efficacité, pour produire des résultats fiables.

Quel est le plus grand défi lors du travail avec le Big Data pour l’analyse ?

Le plus grand défi est souvent de garantir la sécurité et la conformité sur de grands ensembles de données complexes. La protection des données sensibles, le respect des exigences réglementaires et la surveillance des accès aux données deviennent compliqués à grande échelle. Vous pouvez réduire les risques en adoptant un chiffrement fort, des contrôles d’accès et des vérifications automatisées de conformité, tout en tenant votre documentation à jour.

Comment les outils d'analyse de Big Data prennent-ils en charge la montée en charge ?

De nombreux u003ca href=u0022https://thectoclub.com/tools/databricks-competitor/u0022u003econcurrents de Databricksu003c/au003e prennent en charge la montée en charge grâce à l’utilisation du calcul distribué, des architectures cloud natives et des fonctionnalités d’auto-dimensionnement. Si vous prévoyez une croissance rapide des données, privilégiez des solutions offrant des capacités de calcul et de stockage élastiques. Des API flexibles et des services modulaires permettront à votre équipe d’ajouter de la capacité sans interruption ou perte de performance.

Comment les CTO peuvent-ils garantir la confidentialité des données et la conformité lors de la mise en place d’outils d’analyse de Big Data ?

Vous pouvez garantir la confidentialité des données et la conformité en choisissant des outils intégrant des contrôles de politiques, des pistes d’audit et des options de chiffrement. Assurez-vous toujours que les flux de travail soient conformes aux normes telles que le RGPD ou l’HIPAA. Des audits de conformité réguliers, la formation des employés et la mise en œuvre d’anonymisation ou de masquage des données protègent les informations sensibles à chaque étape de l’analyse.

Quelles sont les erreurs fréquentes à éviter lors de la migration des systèmes hérités vers des plateformes modernes d’analyse de Big Data ?

Les erreurs courantes incluent la sous-estimation du nettoyage des données, l’échec de cartographie des intégrations, ou la négligence des coûts cachés comme la formation ou la mise à jour des protocoles de sécurité. Pour les éviter, planifiez une migration progressive, évaluez soigneusement les dépendances et réalisez des tests pilotes. Collaborez étroitement avec les équipes IT et métiers pour établir des objectifs clairs et garantir la stabilité du système.

Comment évaluer le coût total de possession des outils d’analyse de Big Data ?

Pour évaluer le coût dans son ensemble, ne vous limitez pas aux licences ou abonnements. Prenez aussi en compte l’infrastructure (cloud ou sur site), les frais d’intégration, la maintenance continue, la formation et le support. Analysez la façon dont les besoins en ressources de chaque outil correspondent à votre trafic et vos attentes de stockage. Vérifiez bien les clauses contractuelles pour repérer les frais additionnels liés à la montée en charge, au support ou aux modules spécifiques.

Et ensuite ?

Boostez la croissance de votre SaaS et vos compétences de leader. Abonnez-vous à notre newsletter pour recevoir les dernières analyses des CTOs et des futurs leaders technologiques. Nous vous aiderons à évoluer plus efficacement et à diriger avec assurance grâce à des guides, ressources et stratégies proposées par les meilleurs experts !