Meilleure sélection de logiciels de Deep Learning

Here's my pick of the 10 best software from the 27 tools reviewed.

En exploitant la puissance de l’intelligence artificielle, un logiciel de deep learning constitue votre outil pour résoudre des problématiques métier complexes. Grâce à des cadres de calcul haute performance et des tutoriels, même une startup peut concevoir des réseaux neuronaux convolutifs et récurrents (RNN), ouvrant la voie à des capacités transformantes de reconnaissance d’images.

Une telle plateforme d’IA facilite la modularité avec des modules indépendants et l’analytique prédictive, devenant une pièce maîtresse pour les initiatives de fouille de données. Ses fonctionnalités « no code » et sa gestion des problématiques de big data via Spark la rendent facile à prendre en main tout en optimisant l’efficacité de votre utilisation CPU. Travailler avec des nœuds ou des applications d’apprentissage telles que Javascript n’a jamais été aussi simple, permettant d’explorer facilement l’univers de la régression et de l’analytique prédictive.

Table of Contents

Why Trust Our Software Reviews

We’ve been testing and reviewing software since 2023. As tech leaders ourselves, we know how critical and difficult it is to make the right decision when selecting software.

We invest in deep research to help our audience make better software purchasing decisions. We’ve tested more than 2,000 tools for different tech use cases and written over 1,000 comprehensive software reviews. Learn how we stay transparent & our software review methodology.

Résumé des meilleurs logiciels de Deep Learning

Ce tableau comparatif résume les informations tarifaires des meilleurs logiciels de deep learning selon moi, pour vous aider à trouver la meilleure solution selon votre budget et vos besoins professionnels.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Best for experiment-driven machine learning development | Not available | From $39/user/month (billed annually) | Website | |

| 2 | Best for automated data labeling and annotation in AI | Not available | From $49/user/month | Website | |

| 3 | Best for managing, automating, and accelerating ML workflows | 14-day free trial | Pricing upon request | Website | |

| 4 | Best for leveraging powerful GPU-accelerated AI and Deep Learning tools | Not available | From $0.09/GPU/hour (billed monthly) | Website | |

| 5 | Best for symbolic and numerical computation in deep learning | Not available | From $25/user/month (billed annually) | Website | |

| 6 | Best for quick prototyping and production of neural networks | Not available | Pricing upon request | Website | |

| 7 | Best for accessing large-scale, diverse human-annotated datasets | Not available | Customized price upon request | Website | |

| 8 | Best for advanced algorithm development with extensive libraries | Free demo available | Pricing upon request | Website | |

| 9 | Best for improving learning outcomes with AI-driven adaptive learning | Not available | Pricing upon request | Website | |

| 10 | Best for easy integration of machine learning into business operations | Not available | From $59/user/month | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Avis sur les meilleurs logiciels de Deep Learning

Vous trouverez ci-dessous mes résumés détaillés des meilleurs logiciels de deep learning ayant intégré ma sélection. Mes avis offrent un aperçu approfondi des fonctionnalités clés, avantages et inconvénients, intégrations et cas d’usage idéaux pour chaque outil afin de vous aider à choisir celui qui vous correspond le mieux.

Comet enables data scientists to track, compare, explain, and optimize their machine-learning models and experiments. Its functionality aligns perfectly with an experiment-driven approach, where monitoring and comparing results is pivotal.

Why I Picked Comet:

I found Comet to stand out in machine learning development for its focus on experiment management. Its robustness in tracking, comparing, and managing ML experiments makes it a top pick. The ability to handle numerous experiments simultaneously while maintaining clear, organized records underpins its claim as the best tool for experiment-driven machine learning development.

Standout features and integrations:

Comet shines with features like real-time performance visualizations, code tracking, and automated experiment tracking. These features simplify managing and tracking experiments, driving more focused and effective machine learning development. Moreover, Comet integrates well with popular libraries such as Keras, PyTorch, and TensorFlow, which broadens its utility and eases workflow.

Pros and Cons

Pros:

- Broad compatibility with popular libraries

- Effective performance visualizations

- Robust experiment management

Cons:

- Limited offline capabilities

- UI can have a steep learning curve

- Pricing may be steep for small teams

Labellerr is a specialized platform that accelerates AI model training through automatic data labeling and annotation. Its key strength is assisting AI teams in handling vast amounts of data with precision.

Why I Picked Labellerr:

I chose Labellerr mainly due to its prowess in the crucial task of data labeling and annotation. Its automation capabilities significantly reduce the effort and time involved in this process, making it a stand-out choice for AI projects that deal with substantial data. For this reason, Labellerr is the best for automating data labeling and annotation in AI.

Standout features and integrations:

Labellerr boasts multi-format data labeling, innovative annotation tools, and project management tools that aid in team collaboration. It also integrates smoothly with popular data storage and machine learning platforms like Amazon S3, Google Cloud, Microsoft Azure, and more, simplifying the overall workflow.

Pros and Cons

Pros:

- Robust project management tools

- Supports various data formats

- Efficient automation of data labeling

Cons:

- Limited flexibility in certain workflows

- Could be complicated for beginners

- May not be cost-effective for smaller projects

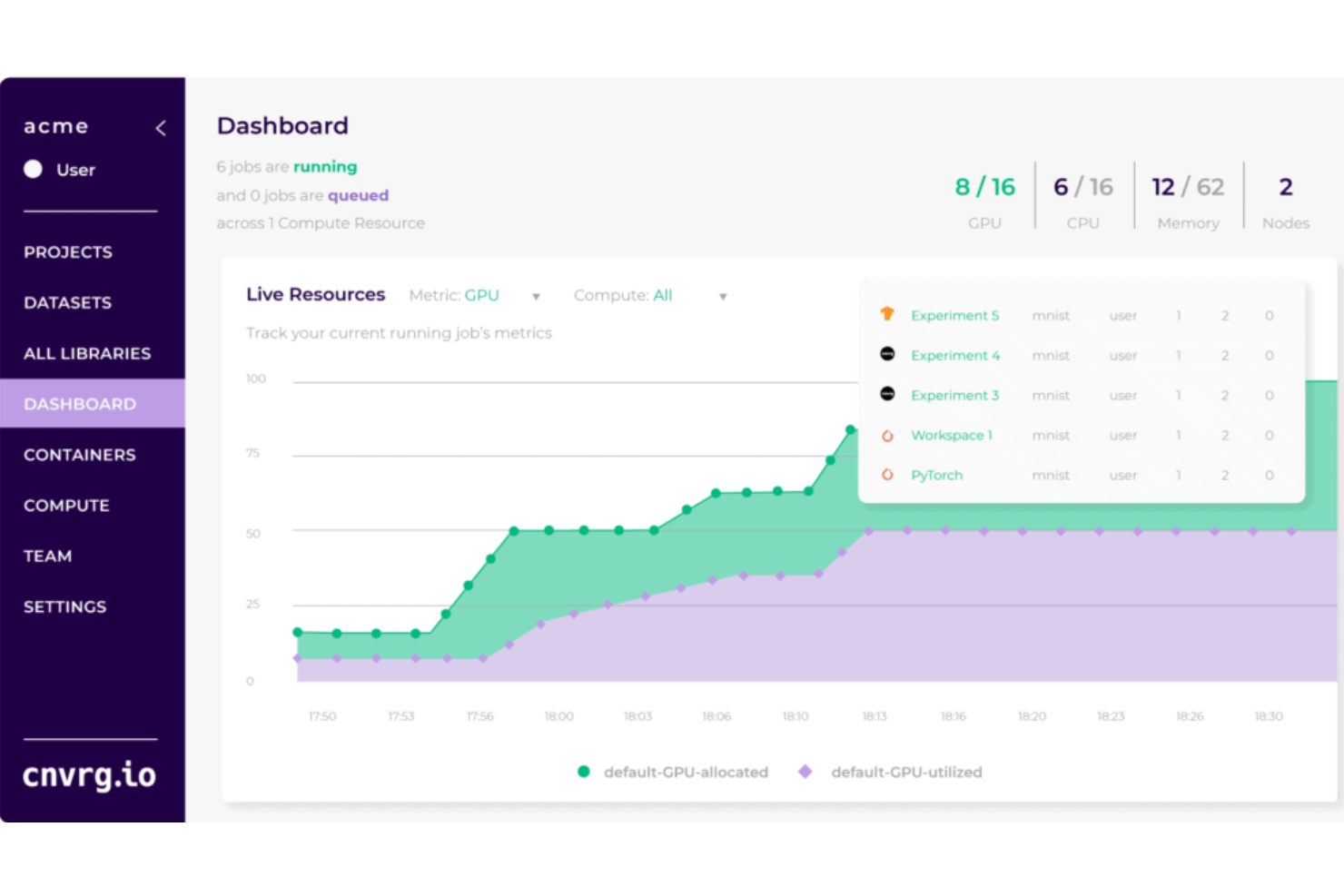

cnvrg.io is an end-to-end machine-learning operations (MLOps) platform designed to help data scientists and engineers automate machine learning from research to production. Its strengths lie in managing, automating, and accelerating machine-learning workflows, making it an optimal choice for teams looking to streamline their machine-learning projects.

Why I Picked cnvrg.io:

I chose cnvrg.io for this list due to its comprehensive approach to managing machine-learning workflows. It allows for the automation of repetitive tasks, enabling data scientists to focus on model development and improvement. Regarding managing, automating, and accelerating ML workflows, cnvrg.io has a proven track record.

Standout features and integrations:

cnvrg.io provides robust features like workflow automation, model management, versioning, and auto-scaling. Additionally, it offers integration capabilities with popular tools like Jupyter Notebooks, RStudio, TensorFlow, and PyTorch, providing users with an excellent working environment.

Pros and Cons

Pros:

- Emphasis on automation, freeing up data scientists for more complex tasks

- Robust integration capabilities

- Comprehensive management of ML workflows

Cons:

- Customization options could be more robust

- Might have a learning curve for new users

- Pricing transparency could be improved

Best for leveraging powerful GPU-accelerated AI and Deep Learning tools

The NVIDIA GPU Cloud (NGC) is a cloud-based platform that provides access to a comprehensive catalog of GPU-accelerated software for AI, machine learning, and HPC. NGC makes it easy for researchers and data scientists to develop, test, and deploy AI and HPC applications with pre-integrated GPU-accelerated software.

Why I Picked NVIDIA GPU Cloud (NGC):

I picked NGC due to its powerful computational capabilities, which utilize NVIDIA's top-tier GPU support technology. What distinguishes NGC is its catalog of GPU-optimized software for deep learning and machine learning and its ability to dramatically reduce the time it takes to deploy AI applications. Due to its pre-integrated, containerized software, NGC is best for leveraging GPU-accelerated AI and deep learning tools.

Standout features and integrations:

NGC's main features include a wide range of pre-trained models, performance-engineered containers, and industry-specific SDKs. The platform also integrates with major cloud providers, such as AWS, Azure, and Google Cloud, which makes deploying models to these services straightforward.

Pros and Cons

Pros:

- Integration with major cloud providers

- Broad selection of pre-trained models

- Powerful GPU-accelerated software

Cons:

- Requires knowledge of NVIDIA’s ecosystem

- May be overkill for smaller projects or businesses

- The cost can add up quickly with heavy usage

Wolfram Mathematica is a sophisticated computational software enabling users to perform complex mathematical computations, including symbolic and numerical ones. It's widely used in deep learning and AI research and development for its precise computation capabilities.

Why I Picked Wolfram Mathematica:

I selected Wolfram Mathematica for this list because of its unique strength in handling symbolic and numerical computations, essential components in deep learning operations. Its power to execute complex mathematical calculations with high precision sets it apart. Wolfram Mathematica is the top choice for tasks requiring advanced computations in deep learning due to its unparalleled computational capabilities.

Standout features and integrations:

Wolfram Mathematica shines with its vast features, including advanced numerical solving, symbolic computation, data visualization, and algorithm development. Moreover, it integrates with several other data analysis tools and platforms, making it a comprehensive computational tool for deep learning tasks.

Pros and Cons

Pros:

- Offers integration with other data analysis platforms

- Provides a wide array of computational tools and features

- Exceptional symbolic and numerical computation capabilities

Cons:

- Requires a steep learning curve for optimal usage

- Higher cost in comparison to some other computational tools

- The interface might be overwhelming for new users

Keras is a high-level neural networks API, designed for enabling fast experimentation with deep neural networks. It's built on top of TensorFlow and designed to be user-friendly, modular, and extensible. Given its design and functionality, Keras is ideal for fast prototyping and production of neural network models.

Why I Picked Keras:

Keras is my choice for this list because of its emphasis on user-friendliness and speed. Its intuitive API design accelerates the process from concept to result, facilitating rapid prototyping. Moreover, its ability to handle complex neural network architectures sets it apart from other similar tools. That's why I selected Keras as the best tool for quick prototyping and production of neural networks.

Standout features and integrations:

Keras' major features include accessible model building, comprehensive preprocessing layers, and powerful debugging tools. Its broad set of integrations with lower-level deep learning languages, like TensorFlow and Theano, allow it to be flexible and extensible, making it fit well in almost any machine learning workflow.

Pros and Cons

Pros:

- Comprehensive set of tools and features

- Extensible and highly modular

- User-friendly, enabling rapid prototyping

Cons:

- Requires understanding of underlying platforms for optimization and debugging

- Can be less efficient for models with multiple inputs/outputs

- For very specific tasks, lower-level APIs may offer more control

Appen provides high-quality training data for machine learning and artificial intelligence. It leverages a large and diverse crowd of workers across the globe to annotate and label data, ensuring datasets that can help train robust AI models. Considering its ability to provide such wide-ranging, human-annotated datasets, it's best suited for teams requiring large and varied data sets.

Why I Picked Appen:

I chose Appen for this list because of its vast global network of data annotators, which allows for significant diversity in the datasets it produces. Appen is dedicated to high-quality, human-annotated data that can cater to various AI use cases. Given its strengths, I determined that Appen is the best tool for those seeking large-scale, diverse human-annotated datasets.

Standout features and integrations:

Appen's standout features include its data collection and annotation services, highly diverse workforce, and intense data quality and security focus. Appen also provides integrations with numerous machine learning platforms, enhancing the convenience of incorporating their datasets into various ML workflows.

Pros and Cons

Pros:

- Integrations with numerous machine learning platforms

- High standards for data quality and security

- Provides large, diverse, human-annotated datasets

Cons:

- The complexity of projects might affect delivery time

- Might be expensive for smaller projects or businesses

- Pricing is not transparent

Torch is a powerful machine-learning library that offers a multitude of algorithms for deep learning. It is highly appreciated by researchers and developers for its flexible and efficient computational abilities, primarily dealing with creating and manipulating tensors.

Why I Picked Torch:

I picked Torch for its outstanding capacity to accommodate advanced algorithm development. Its extensive libraries provide a wide range of tools and functions that can cater to diverse and complex computational needs. Torch is the best choice for developing advanced algorithms due to its dynamic computational graph and well-documented, broad machine-learning algorithms.

Standout features and integrations:

Torch is known for its robust features, like a powerful N-dimensional array, excellent neural network support, and energy-based models. It also offers integration with LuaJIT, a Just-In-Time Compiler for the Lua programming language, which enables efficient scripting language, and fast prototyping, a considerable advantage in the iterative development of advanced algorithms.

Pros and Cons

Pros:

- Strong community support

- High computational efficiency

- Extensive machine-learning libraries

Cons:

- Lack of enterprise level support

- Mostly Lua-based, less popular than Python in the data science community

- Might have a steep learning curve for beginners

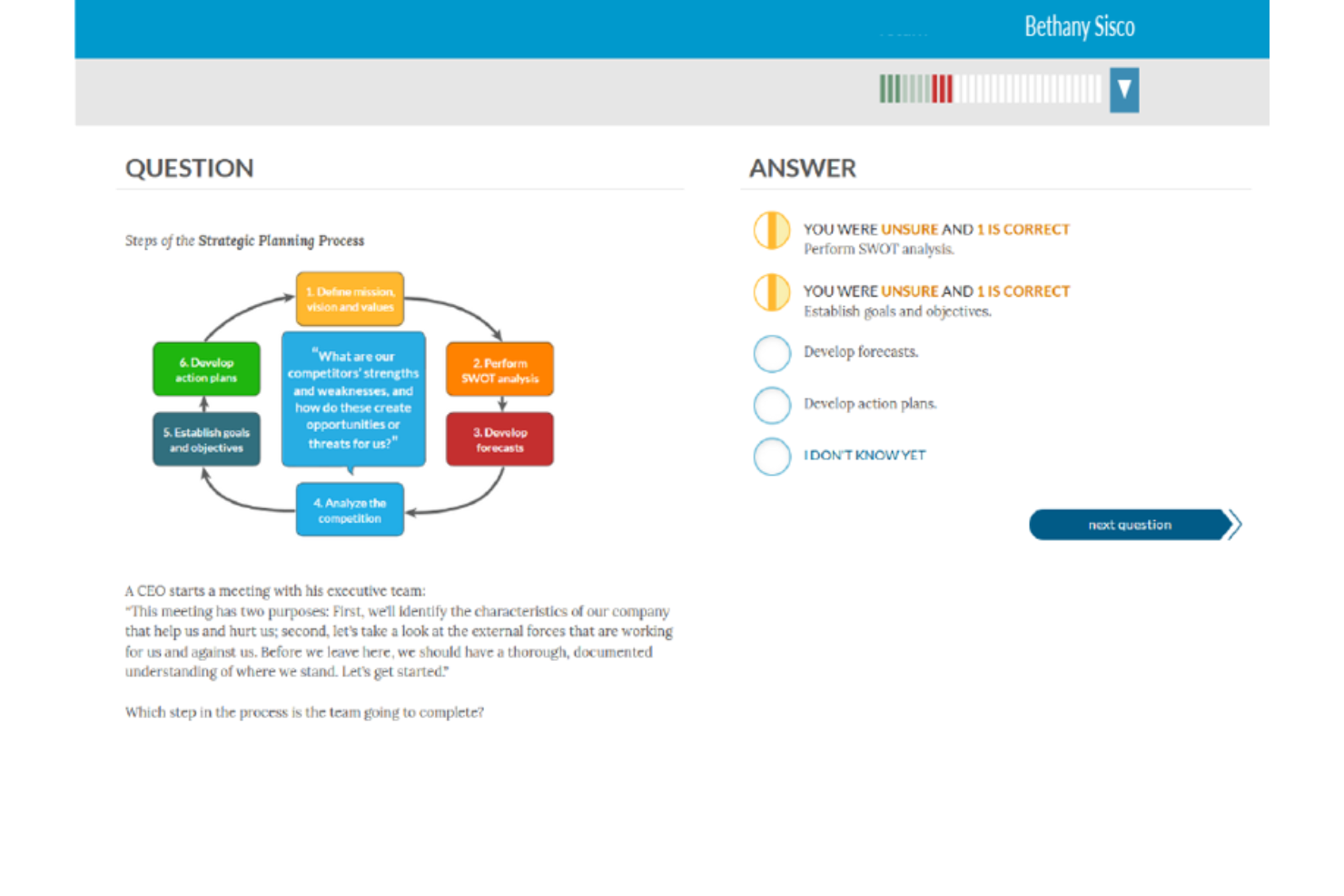

Amplifire is an advanced learning platform that employs AI-driven adaptive learning methods to enhance user learning outcomes. It focuses on identifying and correcting knowledge gaps and misconceptions, which directly correlates to its proficiency in improving learning outcomes.

Why I Picked Amplifire:

I selected Amplifire for this list due to its unique approach to learning enhancement. The platform stands out with its AI-driven adaptive learning methods that accurately identify and address learners' gaps in knowledge. This improves learning outcomes, making it a powerful tool in educational and corporate training environments.

Standout features and integrations:

Amplifire offers features like knowledge gap identification, AI-driven personalized learning paths, and performance tracking. It integrates with various learning management systems (LMS) like Moodle, Blackboard, and Canvas, allowing users to incorporate Amplifire's features into their learning environments.

Pros and Cons

Pros:

- Integrates with various learning management systems

- Identifies and addresses knowledge gaps

- Uses AI-driven methods to enhance learning outcomes

Cons:

- Could offer more customization options for unique learning environments

- May require training to maximize its features

- Pricing details are not transparent

Prime AI is a machine learning software that blends AI into your business operations. It's developed with a focus on easy integration, helping companies streamline their operations with the power of AI.

Why I Picked Prime AI:

I selected Prime AI for its impressive focus on business integration. Its user-friendly interface, coupled with a robust set of tools, facilitates the incorporation of machine learning into diverse business processes. These features make Prime AI the optimal choice for businesses seeking to integrate machine learning into their operations effortlessly.

Standout features and integrations:

Prime AI stands out with features such as pre-trained models for a quick start, custom model training, and explainable AI that makes the decision process transparent. Moreover, it offers valuable integrations with familiar data sources and applications, including SQL databases, Google Analytics, Salesforce, and more, aiding in a smooth workflow.

Pros and Cons

Pros:

- Wide range of integrations

- Comprehensive support for custom model training

- Pre-trained models for quick integration

Cons:

- Steep learning curve for non-technical users

- Limited options for very specialized tasks

- Pricing could be high for small businesses

Autres logiciels de Deep Learning

Voici quelques autres options de logiciels de deep learning qui n’ont pas été retenues dans ma sélection, mais qui méritent tout de même le détour :

- MIPAR

For image analysis with deep learning algorithms

- Cauliflower

For intuitive AI model creation with visual interface

- DataRobot

Good for automating machine learning model building and deployment

- Valohai

Good for managing end-to-end machine learning pipelines

- Aporia

Good for monitoring and explaining AI models in production

- Caffe

Good for fast prototyping of deep learning models

- Lityx

Good for advanced analytics and marketing automation

- Neural Designer

Good for simplifying complex data analytics with neural networks

- Fixzy Assist

Good for improving maintenance processes with predictive AI

- Môveo AI

Good for optimizing logistics and supply chain operations

- PaperEntry

Good for automating data entry and digitizing paperwork

- Industrytics

Good for enabling predictive maintenance in industrial environments

- Intel Deep Learning Training Tool

Good for accelerating deep learning model training on Intel hardware

- Cognex ViDi Suite

Good for quality inspection with deep learning-based machine vision

- Diffgram

Good for improving data labeling and annotation in machine learning projects

- Lt for labs

Good for improving lab efficiency with machine learning

- Machine Learning on AWS

Good for deploying scalable machine learning solutions in the cloud

Critères de sélection des logiciels de Deep Learning

Pour choisir les meilleurs logiciels de deep learning à inclure dans cette liste, j’ai pris en compte les besoins courants des acheteurs et leurs difficultés, comme la gestion de grands jeux de données et la garantie de la précision des modèles. J’ai aussi utilisé la méthodologie suivante pour assurer un processus d’évaluation structuré et équitable :

Fonctionnalités essentielles (25 % du score total)

Pour être considéré dans cette liste, chaque solution devait répondre à ces usages courants :

- Prétraitement des données

- Entraînement des modèles

- Évaluation des modèles

- Déploiement de modèles

- Intégration avec des sources de données

Fonctionnalités différenciantes supplémentaires (25 % du score total)

Pour affiner encore la sélection, j’ai aussi recherché certaines fonctionnalités uniques, telles que :

- Optimisation automatique des hyperparamètres

- Analyses en temps réel

- Tableaux de bord personnalisables

- Support multilingue

- Capacités d’edge computing

Facilité d’utilisation (10 % du score total)

Pour évaluer la facilité d’usage de chaque système, j’ai considéré les éléments suivants :

- Conception d’interface intuitive

- Parcours de navigation clairs

- Paramètres utilisateurs personnalisables

- Options d’accessibilité

- Accès optimisé pour mobile

Intégration (10 % du score total)

Pour évaluer l’expérience d’intégration de chaque plateforme, j’ai pris en compte les éléments suivants :

- Disponibilité de vidéos de formation

- Visites interactives du produit

- Modèles complets

- Accès à des webinaires

- Chatbots réactifs

Support client (10 % du score total)

Pour évaluer les services d’assistance de chaque éditeur de logiciel, j’ai pris en compte les éléments suivants :

- Disponibilité de l’assistance 24/7

- Support multicanal

- Gestionnaires de compte dédiés

- Base de connaissances complète

- Temps de réponse rapides

Rapport qualité-prix (10 % du score total)

Pour évaluer le rapport qualité-prix de chaque plateforme, j’ai pris en compte les éléments suivants :

- Tarification compétitive

- Formules d’abonnement flexibles

- Disponibilité d’une période d’essai gratuite

- Structure tarifaire transparente

- Réductions pour les engagements à long terme

Avis clients (10 % du score total)

Pour avoir un aperçu de la satisfaction globale des clients, j’ai pris en compte les éléments suivants en lisant les avis :

- Retours sur la facilité d’utilisation

- Fiabilité des performances

- Qualité du service client

- Satisfaction concernant les fonctionnalités

- Perception de la valeur globale

Comment choisir un logiciel de deep learning

Il est facile de se perdre dans des listes de fonctionnalités interminables et des structures tarifaires complexes. Pour vous aider à rester concentré lors de votre propre processus de sélection de logiciel, voici une liste de critères importants à garder en mémoire :

| Critère | À considérer |

|---|---|

| Scalabilité | Le logiciel peut-il évoluer avec vos besoins ? Vérifiez s’il supporte des volumes de données et des utilisateurs croissants sans perte de performance. |

| Intégrations | Est-il compatible avec votre logiciel d’IA actuel ? Recherchez une compatibilité avec vos sources de données et applications métiers pour éviter les silos. |

| Personnalisation | Pouvez-vous adapter le logiciel à vos processus ? Évaluez s’il permet de personnaliser tableaux de bord, rapports et processus. |

| Facilité d’utilisation | Est-il convivial pour votre équipe ? Considérez la courbe d’apprentissage et s’il requiert une formation approfondie pour démarrer. |

| Mise en œuvre et intégration | Combien de temps faudra-t-il pour l’utiliser pleinement ? L’implémentation au sein d’un logiciel de réalité virtuelle, par exemple, peut prendre plus de temps qu’avec des canaux traditionnels. Évaluez le processus de configuration, la disponibilité des ressources d’intégration, et l’accompagnement au démarrage. |

| Coût | Votre budget est-il respecté ? Comparez les forfaits, les frais cachés et les coûts à long terme. Vérifiez s’il existe des essais pour évaluer la valeur avant de vous engager. |

| Garanties de sécurité | Comment vos données sont-elles protégées ? Assurez-vous que le logiciel est conforme aux standards du secteur et propose des fonctionnalités comme le chiffrement et le contrôle d’accès. |

| Disponibilité du support | Aurez-vous de l’aide en cas de besoin ? Recherchez une assistance 24/7 et la qualité des ressources comme la documentation et les forums communautaires. |

Qu’est-ce qu’un logiciel de deep learning ?

Un logiciel de deep learning est un ensemble d’outils conçus pour créer, entraîner et déployer des réseaux neuronaux artificiels pour des applications telles que la reconnaissance d’images et les logiciels d’intelligence conversationnelle. Les data scientists, ingénieurs en machine learning et chercheurs utilisent généralement ces outils pour améliorer la modélisation prédictive et automatiser l’analyse complexe de données. Les fonctions de prétraitement de données, d’entraînement de modèles et d’intégration facilitent la gestion des ensembles de données et augmentent la précision des modèles. Globalement, ces outils apportent une grande valeur en simplifiant les tâches complexes fondées sur les données et en améliorant les processus décisionnels.

Fonctionnalités

Lors du choix d’un logiciel de deep learning, faites attention aux fonctionnalités clés suivantes :

- Entraînement du modèle : Facilite le développement de réseaux neuronaux en fournissant des outils pour le paramétrage et l’optimisation des modèles.

- Capacités d’intégration : Permet une connexion transparente avec les sources de données existantes et les applications métiers pour un flux de données efficace. Cela peut s’avérer encore plus crucial pour les entreprises utilisant un logiciel de reconnaissance d’images afin d’assurer l’exactitude en temps réel.

- Options de personnalisation : Offre la flexibilité de personnaliser les tableaux de bord, les rapports et les processus pour s’adapter à des flux de travail et besoins spécifiques.

- Interface conviviale : Assure une facilité d’utilisation, réduisant la courbe d’apprentissage et rendant le logiciel accessible à divers membres de l’équipe.

- Mécanismes de sécurité : Garantit la protection des données via le chiffrement et des contrôles d’accès, en assurant la conformité aux normes du secteur.

- Réglage automatisé des hyperparamètres : Améliore les performances du modèle en ajustant automatiquement les paramètres pour des résultats optimaux.

- Prétraitement des données : Simplifie le nettoyage et l’organisation des données, garantissant des entrées de qualité pour l’entraînement des modèles, notamment pour des outils tels que les logiciels de traitement du langage naturel (NLP).

- Analyse en temps réel : Fournit des informations instantanées issues des données, favorisant la rapidité de prise de décision et de réaction.

- Accès mobile : Permet aux utilisateurs d’interagir avec le logiciel lors de leurs déplacements, augmentant la flexibilité et l’accessibilité.

- Ressources de formation : Inclut des tutoriels, des webinaires et de la documentation pour aider les utilisateurs à apprendre et à exploiter efficacement le logiciel.

Avantages

La mise en œuvre d’un logiciel de deep learning offre de nombreux avantages pour votre équipe et votre entreprise. Voici quelques bénéfices auxquels vous pouvez vous attendre :

- Précision améliorée : Optimise la modélisation prédictive grâce à une analyse précise des données et des capacités d’entraînement des modèles.

- Efficacité dans le traitement des données : Automatise les tâches de prétraitement des données, ce qui permet d’économiser du temps et de réduire les erreurs manuelles.

- Solutions évolutives : Accompagne la croissance avec des fonctionnalités adaptées à l’augmentation du volume de données et du nombre d’utilisateurs.

- Prise de décision informée : Propose une analyse en temps réel pour des retours rapides et des stratégies d’entreprise réactives.

- Personnalisation selon les besoins : S’adapte à vos processus grâce à des tableaux de bord et des workflows personnalisables.

- Sécurité renforcée des données : Protège les informations sensibles avec des mesures de sécurité telles que le chiffrement et le contrôle d’accès.

- Accessibilité et flexibilité : Offre un accès mobile, permettant aux utilisateurs de travailler de n’importe où tout en restant connectés.

Coûts et tarification

Le choix d’un logiciel de deep learning nécessite de comprendre les différents modèles de tarification et formules disponibles. Les coûts varient en fonction des fonctionnalités, du nombre d’utilisateurs, des modules complémentaires, etc. Le tableau ci-dessous résume les offres courantes, leur prix moyen et les principales fonctionnalités inclues dans les solutions de deep learning :

Tableau comparatif des offres de logiciels de deep learning

| Type d’offre | Prix moyen | Fonctionnalités courantes |

|---|---|---|

| Offre gratuite | $0 | Entraînement de base des modèles, stockage de données limité et support communautaire. |

| Offre personnelle | $10-$30/user/ month | Prétraitement des données, analytics standard et support par e-mail. |

| Offre business | $50-$100/user/month | Analytics avancés, capacités d’intégration et support prioritaire. |

| Offre entreprise | $150-$300/user/month | Solutions personnalisables, gestion de compte dédiée et sécurité renforcée. |

FAQ sur les logiciels de deep learning

Voici quelques réponses aux questions courantes concernant les logiciels de deep learning :

Quelles sont les exigences matérielles pour utiliser un logiciel de deep learning ?

Les logiciels de deep learning nécessitent souvent du matériel performant pour traiter efficacement de grands volumes de données. Des GPU hautes performances, une grande capacité de RAM et des solutions de stockage rapides sont généralement recommandés. Consultez la documentation du logiciel pour obtenir des recommandations matérielles spécifiques afin d’optimiser les performances et éviter les goulets d’étranglement.

Est-il possible de personnaliser les algorithmes dans un logiciel de deep learning ?

De nombreux logiciels de deep learning permettent de personnaliser les algorithmes selon vos besoins spécifiques. Recherchez des outils offrant des architectures de réseaux neuronaux flexibles et la possibilité de modifier les paramètres. Cette personnalisation peut améliorer la précision et la pertinence du modèle pour votre cas d’usage.

Un logiciel de deep learning peut-il s'intégrer à l'infrastructure informatique existante ?

Oui, la plupart des logiciels de deep learning proposent des capacités d’intégration avec l’infrastructure informatique existante. Vérifiez que l’outil prend en charge des API ou dispose de connecteurs intégrés pour vos systèmes actuels, tels que les bases de données et services cloud, afin de garantir un flux de données fluide et la compatibilité.

Et ensuite :

Si vous êtes en train de rechercher un logiciel de deep learning, contactez gratuitement un conseiller SoftwareSelect pour des recommandations personnalisées.

Vous remplissez un formulaire et discutez brièvement de vos besoins. Ensuite, vous recevrez une liste restreinte de logiciels à examiner. Ils vous accompagneront même pendant tout le processus d'achat, y compris lors des négociations tarifaires.