Beste DataOps Tools Übersicht

Die besten DataOps-Tools unterstützen Teams dabei, Datenpipelines aufzubauen, zu überwachen und zu verwalten, die wirklich zuverlässige Ergebnisse liefern. Sie automatisieren Qualitätsprüfungen, verfolgen die Herkunft (Lineage) und geben Transparenz über Workflows, sodass Daten sicher und effizient von der Quelle zum Ziel gelangen.

Wer schon einmal stundenlang fehlgeschlagene ETL-Jobs mit unklaren Fehlermeldungen debuggt, mit isolierten Systemen jongliert hat, die sich nicht integrieren lassen, oder während eines Compliance-Audits ohne klare Herkunfstverfolgung improvisieren musste, weiß, wie störend schlechte Data-Operations-Prozesse sein können. Diese Herausforderungen verlangsamen die Auslieferung, schaffen Risiken und untergraben das Vertrauen in die Daten, auf die Ihr Unternehmen angewiesen ist.

Ich habe mit Data Engineers und Produktteams in wachstumsstarken SaaS-Umgebungen zusammengearbeitet und Plattformen unter realen Bedingungen getestet – dort, wo Performance, Sicherheit und Auditierbarkeit unverzichtbar sind. Ich habe Tools in Entwicklungs-, Staging- und Produktionsumgebungen geprüft, um diejenigen herauszufiltern, die nur Lösungen vermarkten, von denen, die tatsächlich Reibungspunkte reduzieren und die Zuverlässigkeit erhöhen.

In diesem Leitfaden erfahren Sie, welche DataOps-Plattformen praktikable Einblicke liefern, den Lärm reduzieren und Ihrem Team ermöglichen, schneller und mit mehr Sicherheit zu arbeiten.

Warum Sie unseren Software-Reviews vertrauen können

Wir testen und bewerten Software für die SaaS-Entwicklung seit 2023. Als Technikexperten wissen wir selbst, wie kritisch und schwierig es ist, bei der Auswahl von Software die richtige Entscheidung zu treffen. Wir investieren viel Zeit in gründliche Recherchen, um unserer Community eine bessere Entscheidungsgrundlage beim Softwarekauf zu bieten.

Wir haben mehr als 2.000 Tools für verschiedene SaaS-Entwicklungsbereiche getestet und über 1.000 umfassende Software-Bewertungen verfasst. Erfahren Sie wie wir transparent bleiben und sehen Sie sich unsere Methodik zur Softwarebewertung an.

Zusammenfassung der besten DataOps-Tools

Diese Vergleichstabelle fasst die Preisinformationen zu meinen Top-Empfehlungen der DataOps-Tools zusammen, damit Sie das passende Angebot für Ihr Budget und Ihre Geschäftsanforderungen finden.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Am besten für die Orchestrierung von Datenpipelines | Kostenlose Demo verfügbar | Preis auf Anfrage | Website | |

| 2 | Am besten geeignet für Datenschutzmanagement | Kostenloser Tarif verfügbar | Ab $150/Monat (jährlich abgerechnet) | Website | |

| 3 | Am besten für SQL-Workflow-Kollaboration | 21-tägige kostenlose Testversion | Ab $199/Benutzer/Jahr (jährliche Abrechnung) | Website | |

| 4 | Am besten geeignet für die Automatisierung der Datenvorbereitung | Nein | $5,195/user/year (entspricht etwa $433/user/month) | Website | |

| 5 | Am besten für Analysen im großen Maßstab | Nein | $99/user/month | Website | |

| 6 | Am besten für hybride Datenintegration | Nein | $1/User/Stunde für Datenbewegungsaktivitäten | Website | |

| 7 | Am besten geeignet für die Integration von Unternehmensdaten | Nein | Preis auf Anfrage | Website | |

| 8 | Am besten geeignet für SQL-ähnliche Abfragen | Not available | Kostenlos | Website | |

| 9 | Am besten geeignet für Suche und Datenanalyse | Nein | $16/user/month | Website | |

| 10 | Am besten geeignet für das Management von Echtzeitdatenflüssen | Not available | Kostenlos | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Detailierte Bewertungen zu den besten DataOps-Tools

Im Folgenden finden Sie meine detaillierten Zusammenfassungen der besten DataOps-Tools, die es auf meine Auswahlliste geschafft haben. Meine Reviews bieten einen tiefgehenden Einblick in die wichtigsten Funktionen, Vor- und Nachteile, Integrationen und typische Anwendungsfälle, damit Sie das für Sie passende Tool finden.

Am besten für die Orchestrierung von Datenpipelines

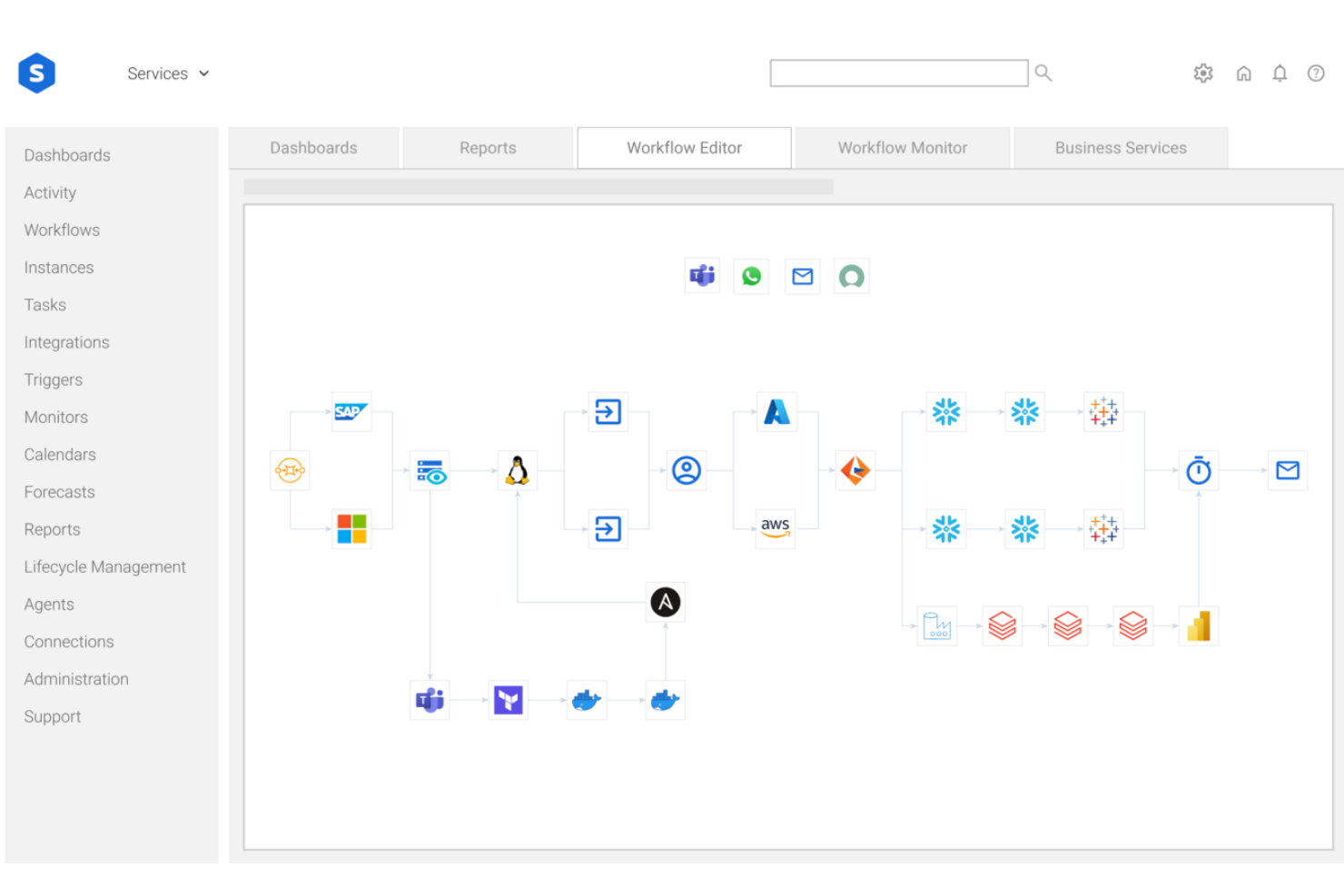

Das Stonebranch Universal Automation Center bietet IT-Teams eine zuverlässige Lösung zur Verbesserung ihrer Datenoperationen. Entwickelt für IT-Fachleute und Unternehmen, die ihre Daten-Workflows optimieren möchten, bewältigt es die Komplexität hybrider IT-Umgebungen, indem es Datenpipelines nahtlos orchestriert und Workflows über verschiedene Plattformen automatisiert. Mit seiner benutzerfreundlichen Oberfläche ist das Tool besonders attraktiv für Teams, die den manuellen Aufwand reduzieren und die betriebliche Effizienz steigern wollen.

Warum ich das Stonebranch Universal Automation Center gewählt habe

Ich habe mich für das Stonebranch Universal Automation Center aufgrund seiner einzigartigen Fähigkeit zur Orchestrierung von Datenpipelines entschieden – ein entscheidender Aspekt von DataOps. Die Echtzeit-Automatisierung in hybriden IT-Umgebungen der Plattform ermöglicht es Ihrem Team, komplexe Workflows sowohl in der Cloud als auch vor Ort zu verwalten. Die ereignisgesteuerte Automatisierung sorgt dafür, dass Workflows als Reaktion auf bestimmte Datenauslöser ausgeführt werden und steigert so die betriebliche Agilität. Diese Funktionen sind ideal für IT-Abteilungen, die ihr Datenmanagement optimieren und Abläufe ohne umfangreiche manuelle Eingriffe rationalisieren möchten.

Wichtige Funktionen des Stonebranch Universal Automation Center

Neben der Orchestrierung von Datenpipelines bietet das Stonebranch Universal Automation Center folgende Funktionen:

- Managed File Transfer: Kontrolliert den Datenfluss zwischen verschiedenen Umgebungen sicher, einschließlich B2B-Dateiübertragungen.

- Infrastruktur- & Serviceautomatisierung: Verwalten von Rechen-, Netzwerk- und Speicherressourcen nahtlos.

- Analyse & Beobachtbarkeit: Bietet fortschrittliche Berichte und prädiktive Funktionen zur Verbesserung des Service-Levels.

Stonebranch Universal Automation Center Integrationen

Integrationen umfassen Amazon Web Services (AWS), SAP, ServiceNow, Red Hat, Google Cloud, Kubernetes, Microsoft, Docker und Informatica.

Pros and Cons

Pros:

- Erweitertes Monitoring auf Mainframes und in Cloud-Umgebungen

- Umfassende Automatisierungsfunktionen für vielfältige IT-Prozesse

- Hohe Verfügbarkeit und Failover-Funktionen erhöhen die Zuverlässigkeit

Cons:

- Nutzer berichten von unzureichender Dokumentation für Einsteiger

- Begrenzte Cloud-Verfügbarkeit und Skalierbarkeit im Vergleich zu Alternativen

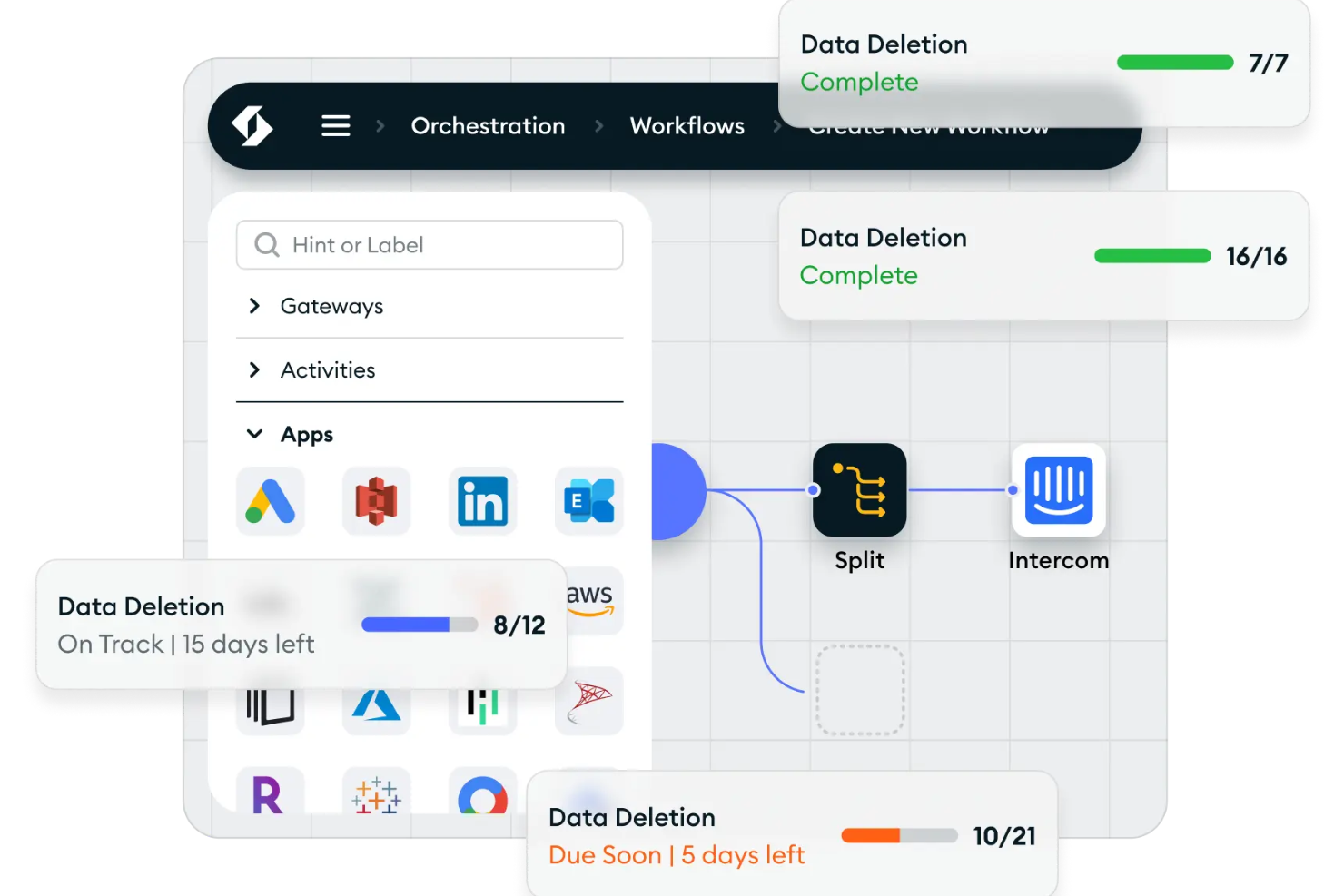

Ketch ist eine Datenschutzmanagement-Software, die speziell für Unternehmen entwickelt wurde, die Wert auf Compliance und den Schutz der Privatsphäre legen. Sie richtet sich an Fachleute aus den Bereichen Recht, Marketing und Technologie und bietet Werkzeuge wie Einwilligungsmanagement und Datenmapping.

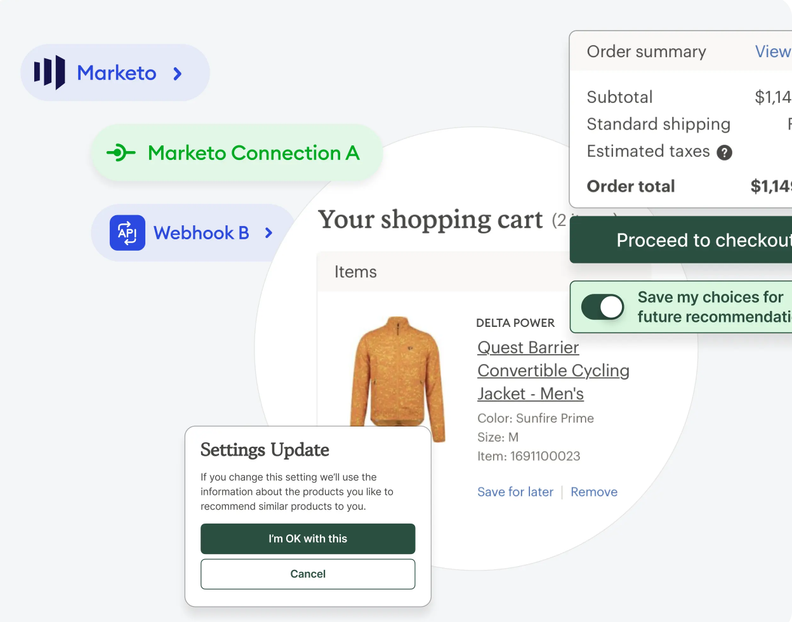

Warum ich Ketch gewählt habe: Der Fokus liegt auf der Einhaltung von Vorschriften wie der DSGVO und dem CCPA. Ketch automatisiert Datenschutzprozesse, einschließlich der Automatisierung von Betroffenenanfragen (DSR) und Risikobewertungen, was Ihrem Team Zeit spart. Außerdem erhalten Sie anpassbare Datenschutzhinweise, um die Kundenbeziehungen zu stärken. Dank der Integration mit über 1.000 Systemen ist Ketch flexibel und daher ideal für datenschutzorientierte Unternehmen geeignet.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen anpassbare Datenschutzvorlagen, Werkzeuge zur Risikobewertung und automatisierte Workflows. Mit Ketch können Sie Einwilligungen und Betroffenenanfragen einfach verwalten und so die Produktivität durch weniger manuelle Aufgaben steigern. Die Plattform bietet außerdem eine benutzerfreundliche Oberfläche, die eine schnelle Einrichtung und Einarbeitung ermöglicht.

Integrationen gibt es mit Salesforce, HubSpot, Marketo, Microsoft Dynamics, Google Analytics, Adobe Experience Cloud, Amazon Web Services, Oracle, SAP und Workday.

Pros and Cons

Pros:

- Verbessert die Kundenbeziehungen

- Unterstützt über 1.000 Integrationen

- Schnelle Einrichtung und Einarbeitung

Cons:

- Begrenzte Anpassungsmöglichkeiten

- Regelmäßige Aktualisierungen hinsichtlich der Gesetzgebung erforderlich

New Product Updates from Ketch

Ketch Expands Marketing Preference Management Capabilities

Ketch expands Marketing Preference Management, introducing capabilities for unifying consent, preferences, and zero-party data across systems. This update enables teams to activate customer data more effectively for personalized and compliant marketing. For more information, visit Ketch’s official site.

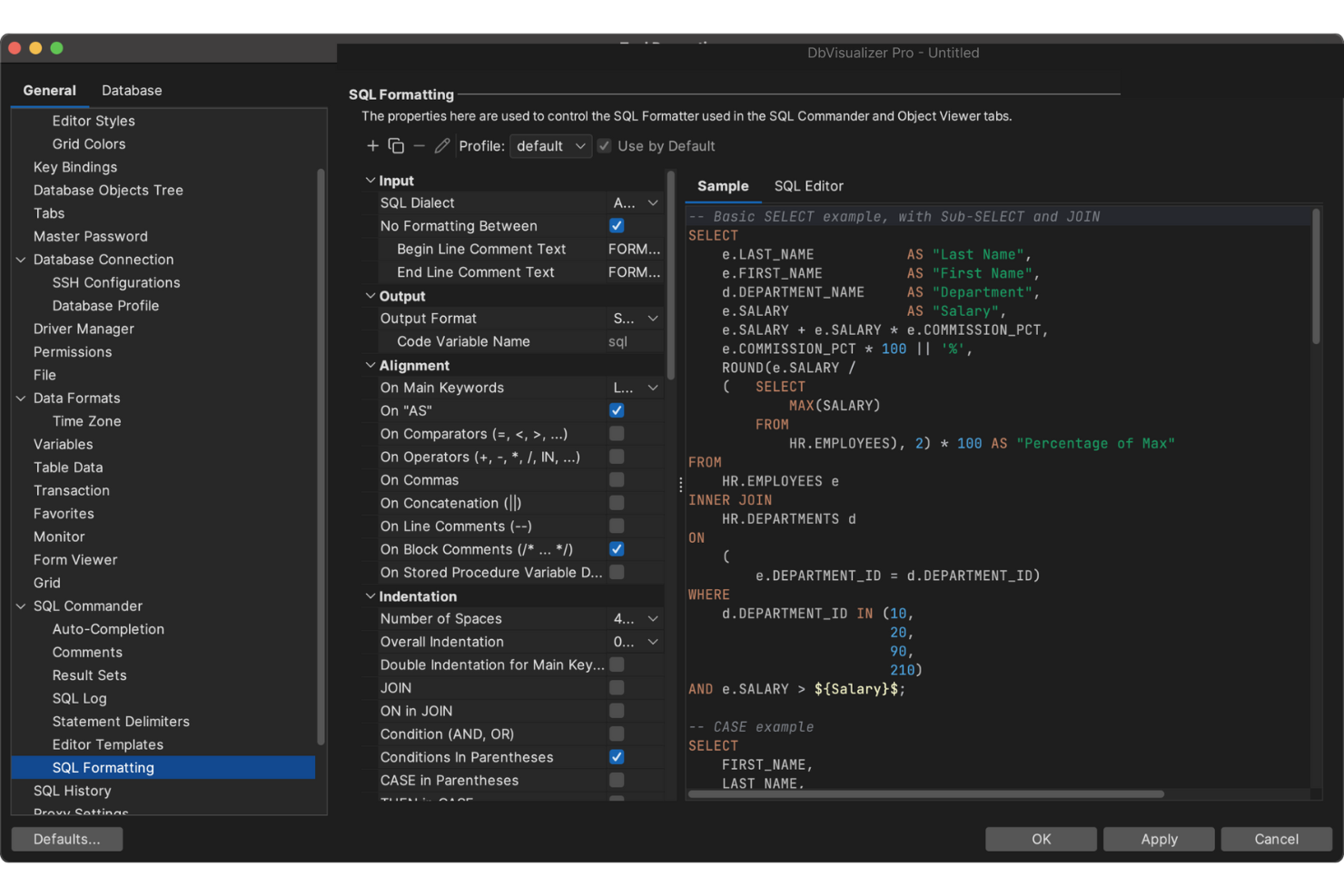

Für Teams, die eine zuverlässige DataOps-Lösung suchen, bietet DbVisualizer eine vielseitige Plattform, die unterschiedlichste Anforderungen im Datenbankmanagement abdeckt. Sie eignet sich ideal für Datenprofis aus verschiedenen Branchen, die ein einheitliches Tool zur Verwaltung komplexer Datenbanken benötigen. Mit Funktionen wie fortschrittlicher SQL-Bearbeitung und leistungsstarker Datenvisualisierung begegnet DbVisualizer Herausforderungen in der Datenintegration und -verwaltung und ist somit ein wertvoller Vorteil zur Optimierung von Daten-Workflows.

Warum ich DbVisualizer gewählt habe

Ich habe DbVisualizer gewählt, weil das auf Workflows ausgerichtete SQL-Tooling optimal zur iterativen Arbeitsweise von DataOps-Teams passt – bei der Validierung und Übernahme von Änderungen über verschiedene Umgebungen hinweg. Sie können an SQL-Skripten gemeinsam arbeiten, dank integrierter Versionsverwaltung, die es leichter macht, Änderungen nachzuvollziehen, Arbeiten aufzuteilen und einen klaren Prüfpfad für Transformationen zu erhalten. Visuelle Erklärungspläne helfen Ihrem Team dabei, die Abfrageleistung vor Änderungen zu bewerten, wodurch Störungen in Datenpipelines minimiert werden. Außerdem gefällt mir, dass Sie die Skriptausführung außerhalb der Benutzeroberfläche automatisieren können mit

Hauptfunktionen von DbVisualizer

Mir gefällt auch, dass DbVisualizer Folgendes bietet:

- Datenexploration: Erlaubt das einfache Durchsuchen und Verwalten komplexer Datenstrukturen innerhalb Ihrer Datenbanken.

- Inline-Bearbeitung: Ermöglicht das direkte Bearbeiten von Daten innerhalb von Tabellen und vereinfacht somit die Datenmanipulation.

- Kommandozeilen-Management: Unterstützt die Ausführung von Skripten und Aufgaben rund um das Datenmanagement über eine Kommandozeilenschnittstelle, was die Automatisierung fördert.

- Datenexport/-import: Erleichtert den Transfer von Daten in verschiedenen Formaten und unterstützt so nahtlose Datenintegration und -weitergabe.

DbVisualizer-Integrationen

Zu den Integrationen gehören DB2, MariaDB, SQL Server, MySQL, PostgreSQL, Oracle, Apache Derby, H2, SQLite und Sybase.

Pros and Cons

Pros:

- Fokus auf visuelle Datenveranschaulichung für klarere Einsichten

- Fortschrittlicher SQL-Editor mit Funktionen wie Auto-Vervollständigung und Formatierung

- Unterstützt verschiedene Datenbanktypen und ermöglicht vielseitiges Datenbankmanagement

Cons:

- Bei größeren Datensätzen kann die Performance gelegentlich beeinträchtigt sein

- Neue Nutzer müssen mit einer leichten Einarbeitungszeit rechnen

New Product Updates from DbVisualizer

DbVisualizer Adds AI Assistant and New Database Support

DbVisualizer introduces an AI assistant, OS-native file chooser support, and new database compatibility with Impala and Neo4j. These updates help users write SQL faster, simplify file handling, and expand database connectivity. For more information, visit DbVisualizer’s official site.

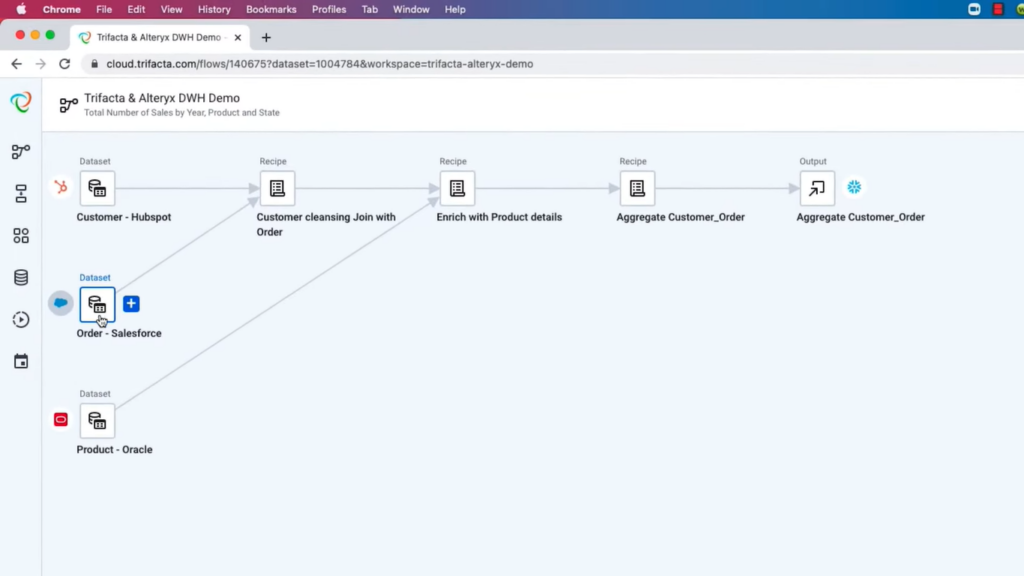

Alteryx

Am besten geeignet für die Automatisierung der Datenvorbereitung

Alteryx ist eine Datenanalyseplattform, die Nutzern hilft, Daten aus verschiedenen Quellen vorzubereiten, zusammenzuführen und zu analysieren. Sie bietet sowohl Desktop- als auch Cloud-basierte Lösungen und richtet sich an Fachleute, die Daten-Workflows automatisieren und effizient Erkenntnisse gewinnen möchten.

Warum ich Alteryx ausgewählt habe: Sie können mit der Drag-and-Drop-Oberfläche von Alteryx sich wiederholende Aufgaben der Datenvorbereitung automatisieren. Die Plattform stellt über 300 No-Code- und Low-Code-Tools bereit, mit denen Ihr Team Daten bereinigen, transformieren und anreichern kann, ohne eine einzige Zeile Code zu schreiben. Sie unterstützt sowohl strukturierte als auch unstrukturierte Daten, sodass Sie mit unterschiedlichsten Datensätzen arbeiten können. Zusätzlich bietet Alteryx KI-gestützte Empfehlungen zur Optimierung Ihrer Workflows an.

Herausragende Funktionen & Integrationen:

Funktionen umfassen Tools für räumliche Analysen, mit denen Ihr Team standortbezogene Auswertungen durchführen kann. Sie können außerdem integrierte Machine-Learning-Funktionen nutzen, um prädiktive Modelle zu erstellen, ohne umfangreiche Programmierkenntnisse zu benötigen. Darüber hinaus unterstützt Alteryx die Verarbeitung von Echtzeitdaten, sodass Sie auf Basis aktueller Daten zeitnah Entscheidungen treffen können.

Integrationen bestehen zu Salesforce, Snowflake, Amazon Redshift, Google BigQuery, Microsoft Azure, Tableau, Power BI, Oracle, SAP und Databricks.

Pros and Cons

Pros:

- Bietet KI-gestützte Empfehlungen für Workflows

- Automatisiert komplexe Aufgaben der Datenvorbereitung

- Verarbeitet sowohl strukturierte als auch unstrukturierte Daten

Cons:

- Begrenzte Möglichkeiten zur Datenvisualisierung

- Für einige Funktionen ist eine eigene Lizenz erforderlich

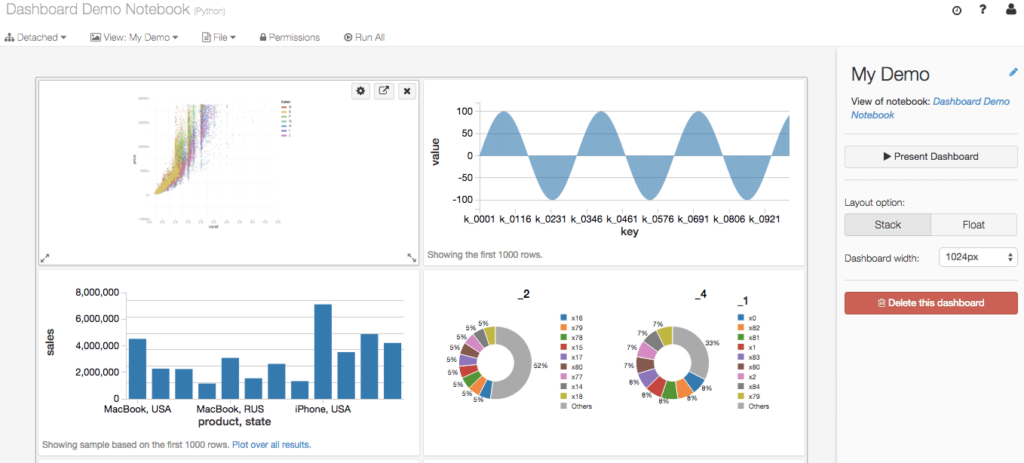

Databricks ist eine Daten- und KI-Plattform, die speziell für den Einsatz in Unternehmen entwickelt wurde und sich an Data Engineers, Data Scientists und Analysten richtet. Sie bietet Funktionen für Datenverarbeitung, Analysen und maschinelles Lernen.

Warum ich Databricks gewählt habe: Die Plattform überzeugt bei Analysen im großen Maßstab und bietet kollaborative Notebooks sowie Delta Lake für eine hohe Datenzuverlässigkeit. Ihr Team profitiert von fortschrittlichen Tools für maschinelles Lernen, die die Analysefähigkeiten erweitern. Die robuste Unterstützung für Apache Spark gewährleistet eine effiziente Verarbeitung großer Datenmengen. Flexible Integrationen mit führenden Cloud-Anbietern wie AWS, Azure und Google Cloud erhöhen die Attraktivität für groß angelegte Einsätze zusätzlich.

Herausragende Funktionen & Integrationen:

Funktionen umfassen kollaborative Notebooks, die Teamarbeit und Innovation fördern. Delta Lake sorgt für Datenzuverlässigkeit und -konsistenz, was bei Big-Data-Aufgaben entscheidend ist. Mit den Funktionen für maschinelles Lernen kann Ihr Team Modelle effizient erstellen und bereitstellen.

Integrationen sind unter anderem Apache Spark, AWS, Azure, Google Cloud, Tableau, Power BI, Snowflake, MongoDB, Looker und Qlik.

Pros and Cons

Pros:

- Flexible Cloud-Integrationen

- Unterstützt Big-Data-Verarbeitung

- Fortschrittliche Werkzeuge für maschinelles Lernen

Cons:

- Komplexe Preisstruktur

- Gelegentliche Leistungsprobleme

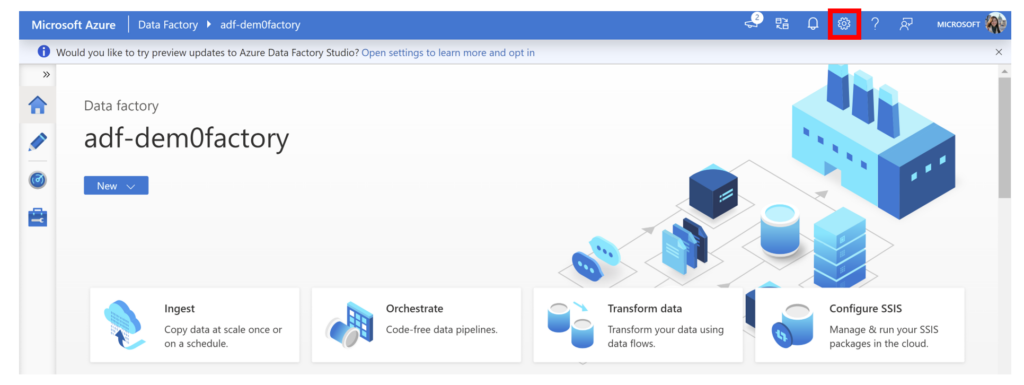

Azure Data Factory ist ein cloudbasierter Dienst zur Datenintegration für Data Engineers und Analysten. Er ermöglicht die Erstellung, Planung und Orchestrierung von Daten-Workflows und unterstützt sowohl Cloud- als auch lokale Datenquellen.

Warum ich Azure Data Factory gewählt habe: Der Dienst glänzt bei der Integration hybrider Datenumgebungen und erlaubt Ihrem Team, verschiedene Datenlandschaften miteinander zu verbinden. Die Drag-and-Drop-Oberfläche vereinfacht das Erstellen komplexer Workflows. Mit den integrierten Planungsfunktionen können Sie Datenbewegungen automatisieren und so manuelle Tätigkeiten reduzieren. Funktionen zur Überwachung in Echtzeit bieten Einblicke in Datenprozesse und steigern die betriebliche Effizienz.

Herausragende Funktionen & Integrationen:

Funktionen umfassen eine intuitive Drag-and-Drop-Oberfläche zum Entwerfen von Datenpipelines. Integrierte Planungstools automatisieren Daten-Workflows und sparen Zeit und Aufwand. Die Überwachung in Echtzeit verschafft Transparenz bei den Datenoperationen und hilft, Probleme schnell zu erkennen und zu lösen.

Integrationen beinhalten Azure Blob Storage, Azure SQL Database, Azure Synapse Analytics, Amazon S3, Google BigQuery, Oracle, SAP, Salesforce, Teradata und IBM Db2.

Pros and Cons

Pros:

- Einfache Drag-and-Drop-Oberfläche

- Unterstützt verschiedene Datenumgebungen

- Echtzeitüberwachung

Cons:

- Komplexität bei der Ersteinrichtung

- Eingeschränkte Offline-Funktionalität

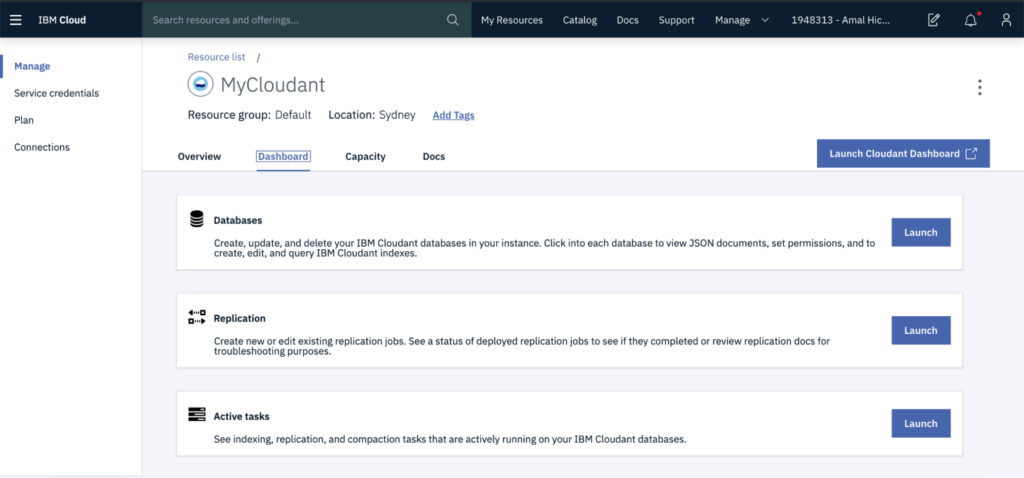

IBMs DataOps-Plattform ist für große Unternehmen konzipiert und richtet sich an IT-Fachleute und Dateningenieure. Sie konzentriert sich auf Datenintegration, Governance und Qualität und stellt sicher, dass Ihre Datenprozesse effizient und zuverlässig ablaufen.

Warum ich IBM gewählt habe: Das Tool überzeugt bei der Integration von Unternehmensdaten und bietet Werkzeuge wie Datenkatalogisierung und Governance. Sie können Workflows automatisieren, was hilft, die Datenqualität im gesamten Unternehmen zu erhalten. Die Datenherkunftsfunktion der Plattform sorgt für Transparenz, sodass Sie Datenquellen und -transformationen nachvollziehen können. Dank der Skalierbarkeit eignet sich die Lösung besonders für große Unternehmen, die große Datenmengen effizient verwalten müssen.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen Datenkatalogisierung, mit der Sie Ihre Datenbestände organisieren können. Die Governance-Tools der Plattform stellen die Einhaltung von Datenvorschriften sicher. Automatisierte Datenqualitätsprüfungen helfen, die Integrität Ihrer Datensätze zu gewährleisten.

Integrationen umfassen IBM Cloud, AWS, Azure, Google Cloud, Hadoop, Apache Spark, Oracle, SAP, Salesforce und Tableau.

Pros and Cons

Pros:

- Umfassende Tools für Daten-Governance

- Unterstützt groß angelegte Datenoperationen

- Automatisierte Qualitätsprüfungen

Cons:

- Könnte eine hohe Lernkurve haben

- Begrenzte Anpassungsmöglichkeiten

Apache Hive ist eine Data-Warehouse-Lösung, die sich in erster Linie an Datenanalysten und -ingenieure richtet. Sie ermöglicht das Abfragen und Verwalten großer Datensätze, die in verteiltem Speicher abgelegt sind.

Warum ich Apache Hive gewählt habe: Es bietet SQL-ähnliche Abfragen, was ideal für Nutzer ist, die mit SQL vertraut sind. Die Integration des Tools mit Hadoop macht es geeignet für die effiziente Analyse großer Datenmengen. Apache Hive unterstützt verschiedene Datenformate und bietet Ihrem Team somit Flexibilität beim Umgang mit Daten. Die Fähigkeit, komplexe Abfragen problemlos zu verarbeiten, macht es zu einer zuverlässigen Wahl für datengetriebene Unternehmen.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen eine Abfragesprache, die SQL ähnelt und das Erlernen und die Einführung erleichtert. Es unterstützt Indexierung zur Verbesserung der Abfrageleistung und beschleunigt damit die Datenabfrage. Apache Hive bietet außerdem Partitionierung, was das Management und die Abfrage großer Datensätze effizienter macht.

Integrationen umfassen Hadoop, HDFS, HBase, Amazon S3, Azure Blob Storage, Google Cloud Storage, Apache Spark, Apache Pig, Apache Tez und Apache Ranger.

Pros and Cons

Pros:

- SQL-ähnliche Abfragesprache

- Unterstützt komplexe Datenabfragen

- Verarbeitet große Datensätze effizient

Cons:

- Nicht ideal für Echtzeit-Analysen

- Leistung variiert je nach Datenmenge

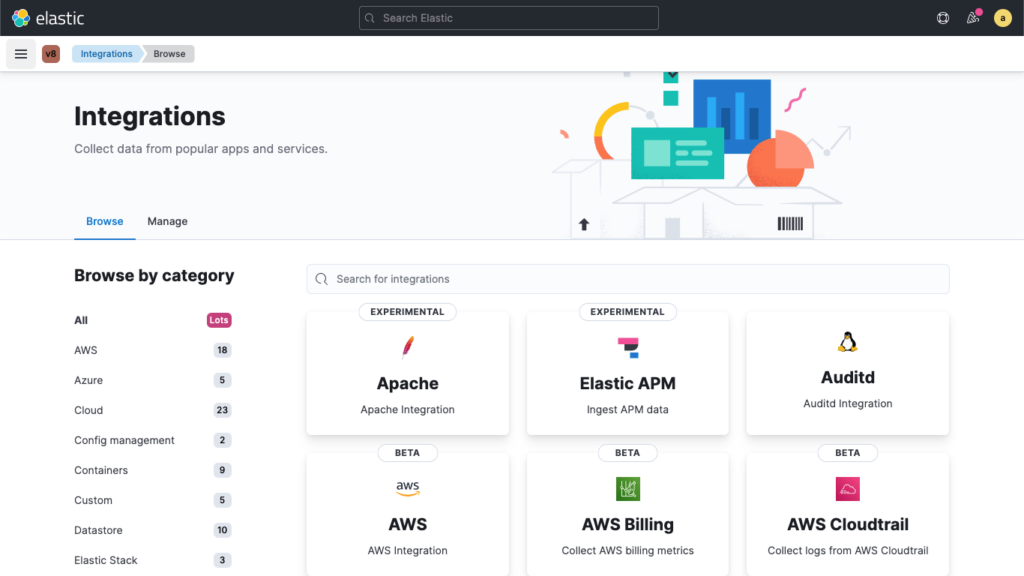

Elastic ist eine Open-Source-Such- und Analyse-Engine, die Echtzeit-Einblicke aus Ihren Daten liefert. Ihre Hauptfunktion besteht darin, große Datenmengen schnell und nahezu in Echtzeit zu speichern, zu durchsuchen und zu analysieren. Dadurch eignet sich Elastic hervorragend für Aufgaben im Bereich der Echtzeit-Suche und Datenanalyse.

Warum ich Elastic gewählt habe:

Ich habe mich für Elastic entschieden, weil es besonders schnelle Suchfunktionen bietet und enorme Datenmengen effektiv verarbeiten kann. Die leistungsstarken Suchmechanismen in Kombination mit Echtzeitanalyse-Fähigkeiten heben Elastic von anderen Tools ab.

Aufgrund dieser Fähigkeiten habe ich Elastic als das beste Tool für Echtzeit-Suche und Datenanalysen bewertet.

Hervorzuhebende Funktionen und Integrationen:

Funktionen umfassen Volltextsuche, verteilte Suche und Echtzeit-Analysen. Die mehrstufige Aggregationsfunktion in Echtzeit hilft Anwendern, ihre Daten intuitiver zu erkunden und zu analysieren.

Integrationen umfassen zahlreiche Tools zur Datensammlung und -visualisierung, darunter Logstash für zentrales Logging und Kibana zur Datenvisualisierung.

Pros and Cons

Pros:

- Bietet schnelle und effiziente Suchergebnisse

- Kann große Datenmengen verarbeiten

- Flexibel bei den Datenformaten

Cons:

- Die Konfiguration und Feinabstimmung von Elastic für spezielle Anwendungsfälle kann komplex sein

- Während der grundlegende Elastic Stack kostenlos ist, sind fortgeschrittene Funktionen kostenpflichtig

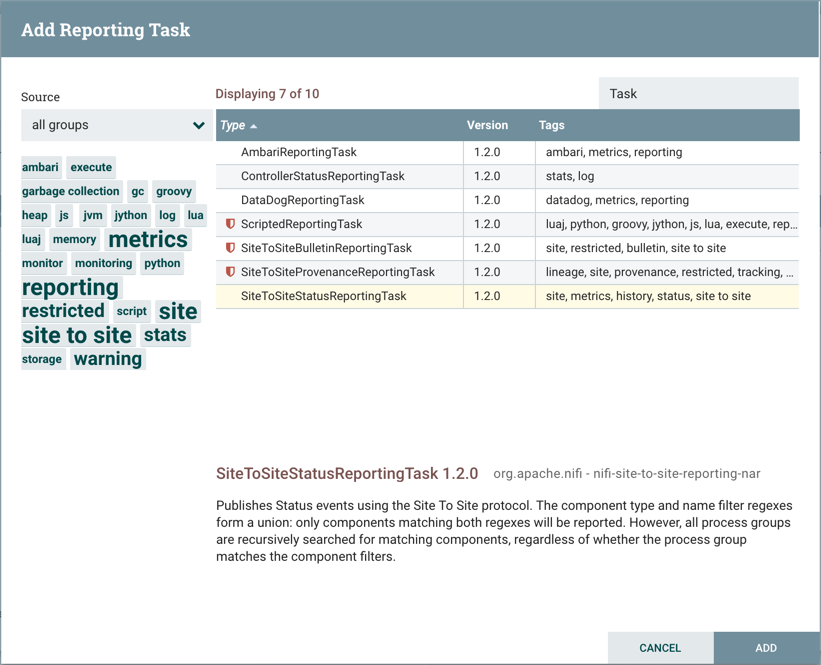

Apache NiFi ist eine integrierte Datenlogistik-Plattform zur Automatisierung der Datenübertragung zwischen unterschiedlichen Systemen. Sie bietet eine Echtzeitsteuerung, die sie besonders anpassungsfähig für hochvolatile Big-Data-Ströme macht und zu einer idealen Wahl für die Erfassung und das Streaming von Echtzeitdaten werden lässt.

Warum ich Apache NiFi gewählt habe:

Ich habe Apache NiFi wegen seiner Hochgeschwindigkeitsfähigkeiten bei der Datenweiterleitung und -transformation ausgewählt. Das einzigartige Design ermöglicht die Nachverfolgung von Daten in Echtzeit und die Erstellung dynamischer, reaktionsfähiger Datenflüsse. Diese herausragenden Funktionen sind der Grund, warum ich Apache NiFi als die beste Lösung für das Echtzeitdaten-Ingest und -Streaming betrachte.

Herausragende Funktionen und Integrationen:

Funktionen umfassen eine hoch konfigurierbare, webbasierte Benutzeroberfläche, Daten-Provenienz zur Rückverfolgung der Daten von der Quelle bis zum Verbrauch sowie flexible Skalierbarkeit.

Integrationen umfassen HTTP, AMQP, HDFS und Datenbankanbindung über JDBC.

Pros and Cons

Pros:

- Bietet Echtzeitsteuerung von Datenflüssen

- Umfangreiche Funktionen zur Datenweiterleitung und -transformation

- Open-Source und anpassbar

Cons:

- Einrichtung und Konfiguration können komplex sein

- Kein direkter Herstellersupport aufgrund von Open-Source

Weitere DataOps-Tools

Hier sind weitere DataOps-Tool-Optionen, die es nicht auf meine Auswahlliste geschafft haben, aber dennoch einen Blick wert sind:

- RightData

Am besten geeignet für Datentests und Validierung

- StreamSets

Am besten für Echtzeit-Datenbewegung geeignet

- HighByte

Am besten für die Integration von Industriedaten

- DataKitchen

Am besten für DataOps-Orchestrierung

- Badook

Am besten geeignet für die Überwachung der Datenqualität

Auswahlkriterien für DataOps-Tools

Bei der Auswahl der besten DataOps-Tools für diese Liste habe ich die gängigen Bedürfnisse und Herausforderungen der Nutzer wie Probleme bei der Datenintegration oder der Sicherstellung der Datenqualität berücksichtigt. Zusätzlich habe ich folgendes Bewertungsraster verwendet, um die Evaluation strukturiert und fair zu gestalten:

Kernfunktionen (25% der Gesamtwertung)

Um in diese Liste aufgenommen zu werden, musste jede Lösung diese Anwendungsfälle abdecken:

- Datenintegration und -transformation

- Management der Datenqualität

- Workflow-Automatisierung

- Echtzeitdatenverarbeitung

- Compliance und Governance

Zusätzliche herausragende Funktionen (25% der Gesamtwertung)

Zur weiteren Eingrenzung habe ich auch auf besondere Alleinstellungsmerkmale geachtet, wie zum Beispiel:

- Anpassbare Datenpipelines

- Fortschrittliche Nachverfolgung der Datenherkunft

- Fähigkeiten für maschinelles Lernen

- Echtzeit-Erkennung von Anomalien

- Skalierbare Architektur

Benutzerfreundlichkeit (10% der Gesamtbewertung)

Um die Benutzerfreundlichkeit jedes Systems einzuschätzen, habe ich Folgendes berücksichtigt:

- Intuitive Benutzeroberfläche

- Einfache Navigation

- Anpassbare Dashboards

- Geringe Einarbeitungszeit

- Responsives Design

Onboarding (10% der Gesamtbewertung)

Zur Bewertung der Einarbeitung bei jeder Plattform habe ich Folgendes berücksichtigt:

- Verfügbarkeit von Trainingsvideos

- Interaktive Produkttouren

- Umfassende Dokumentation

- Zugang zu Webinaren

- Hilfreiche Chatbots

Kundensupport (10% der Gesamtbewertung)

Zur Bewertung der Kundensupport-Leistungen jedes Softwareanbieters habe ich Folgendes berücksichtigt:

- Rund-um-die-Uhr-Erreichbarkeit des Supports

- Support über mehrere Kanäle

- Kompetente Support-Mitarbeitende

- Schnelle Reaktionszeiten

- Verfügbarkeit von Community-Foren

Preis-Leistungs-Verhältnis (10% der Gesamtbewertung)

Um das Preis-Leistungs-Verhältnis jeder Plattform zu bewerten, habe ich Folgendes berücksichtigt:

- Konkurrenzfähige Preise

- Flexible Abonnementmodelle

- Transparente Preisstruktur

- Verfügbarkeit von kostenlosen Testphasen

- Kosten-Nutzen-Verhältnis

Kundenbewertungen (10% der Gesamtbewertung)

Um ein Gefühl für die allgemeine Kundenzufriedenheit zu erhalten, habe ich bei der Analyse der Kundenbewertungen Folgendes beachtet:

- Allgemeine Zufriedenheitswerte

- Häufig erwähnte Problempunkte

- Lob für bestimmte Funktionen

- Rückmeldungen zum Kundensupport

- Häufigkeit von Updates und Verbesserungen

So wählen Sie DataOps-Tools aus

Es ist leicht, sich in langen Funktionslisten und komplexen Preisstrukturen zu verlieren. Um Ihnen zu helfen, im Auswahlprozess Ihrer idealen Software den Überblick zu behalten, finden Sie hier eine Checkliste wichtiger Faktoren:

| Faktor | Zu beachten |

| Skalierbarkeit | Stellen Sie sicher, dass das Tool mit Ihren Datenanforderungen wächst. Suchen Sie nach Funktionen für große Datenmengen und steigende Benutzerzahlen. |

| Integrationen | Überprüfen Sie die Kompatibilität mit vorhandenen Systemen. Prüfen Sie, ob APIs, Datenbanken und Drittanwendungen unterstützt werden. |

| Anpassbarkeit | Überlegen Sie, wie gut das Tool sich an Ihre Prozesse anpasst. Achten Sie auf Möglichkeiten, Dashboards, Workflows und Berichte anzupassen. |

| Benutzerfreundlichkeit | Bewerten Sie die Benutzeroberfläche und den Lernaufwand. Ihr Team sollte das Tool intuitiv und schnell übernehmen können. |

| Budget | Bewerten Sie die Gesamtkosten inklusive versteckter Gebühren. Vergleichen Sie Preispläne und prüfen Sie, ob sie zu Ihrem Budget passen. |

| Sicherheitsmaßnahmen | Analysieren Sie die Sicherheitsfunktionen des Tools. Es sollte den Datenschutzvorgaben entsprechen und Verschlüsselung bieten. |

| Support-Services | Überprüfen Sie die Verfügbarkeit des Kundensupports. Suchen Sie nach 24/7-Unterstützung, Dokumentation und Schulungsangeboten. |

| Leistung | Testen Sie die Geschwindigkeit und Zuverlässigkeit des Tools. Es sollte die Datenverarbeitung effizient und ohne Verzögerungen meistern. |

Trends bei DataOps-Tools

Für meine Recherche habe ich zahlreiche Produktneuheiten, Pressemitteilungen und Veröffentlichungsprotokolle verschiedener Anbieter von DataOps-Tools ausgewertet. Das sind einige der aktuellen Trends, die ich dabei beobachte:

- KI-gesteuerte Erkenntnisse: Immer mehr Tools nutzen Künstliche Intelligenz (KI), um prädiktive Analysen und Einblicke bereitzustellen. Dies hilft Teams, Probleme vorherzusehen und Prozesse zu optimieren. Anbieter wie Alteryx integrieren KI, um die Datenanalyse zu verbessern.

- Echtzeit-Datenverarbeitung: Die Nachfrage nach Echtzeit-Datenverarbeitung wächst. Sie ermöglicht Unternehmen, schnellere Entscheidungen auf Basis aktueller Informationen zu treffen. Tools wie StreamSets konzentrieren sich darauf, den Echtzeit-Datenfluss zu gewährleisten.

- Verbesserungen bei der Daten-Governance: Unternehmen legen verstärkt Wert auf verbesserte Daten-Governance-Funktionen. Das stellt die Einhaltung von Vorschriften sicher und steigert die Datenqualität. Die DataOps-Plattform von IBM bietet starke Governance-Tools, um diese Anforderungen zu erfüllen.

- Self-Service-Fähigkeiten: Es zeichnet sich ein Trend ab, nicht-technische Nutzer mit Self-Service-Optionen zu unterstützen. Damit werden Datenaufgaben teamsübergreifend zugänglicher. Talend ergänzt sein Angebot regelmäßig um Self-Service-Funktionen, um die Datenintegration zu vereinfachen.

- Cloud-native Architekturen: Immer mehr Tools werden für Cloud-Umgebungen entwickelt. Das bietet Unternehmen größere Flexibilität und Skalierbarkeit bei der Verwaltung großer Datenmengen. Azure Data Factory ist ein Beispiel für diesen Trend mit seinen cloud-nativen Datenintegrationsdiensten.

Was sind DataOps-Tools?

DataOps-Tools sind Softwarelösungen, die entwickelt wurden, um Datenmanagement-Prozesse zu automatisieren und zu verbessern. Dateningenieur*innen, Analyst*innen und IT-Fachkräfte nutzen diese Tools meist, um Datenqualität, Governance und Integration zu optimieren.

Echtzeitverarbeitung, KI-gesteuerte Erkenntnisse und Self-Service-Fähigkeiten helfen dabei, Arbeitsabläufe zu optimieren, Compliance sicherzustellen und Daten zugänglich zu machen. In Kombination mit leistungsstarken Data-Observability-Tools erhöhen diese Lösungen die Effizienz und Genauigkeit der Datenbearbeitung und unterstützen Unternehmen dabei, bessere Entscheidungen zu treffen.

Funktionen von DataOps-Tools

Achten Sie bei der Auswahl von DataOps-Tools auf die folgenden Schlüsselfunktionen:

- Echtzeit-Datenverarbeitung: Ermöglicht eine sofortige Datenanalyse, sodass Unternehmen schnell auf aktuelle Informationen reagieren können.

- KI-gesteuerte Erkenntnisse: Bieten prädiktive Analysen, mit denen Teams Probleme frühzeitig erkennen und Datenprozesse optimieren können.

- Daten-Governance: Stellt die Einhaltung gesetzlicher Vorschriften sicher und sorgt für eine hohe Datenqualität im gesamten Unternehmen.

- Self-Service-Fähigkeiten: Ermächtigt nicht-technische Nutzer*innen, Datenaufgaben eigenständig zu erledigen und erhöht somit die Zugänglichkeit.

- Cloud-native Architektur: Bietet Flexibilität und Skalierbarkeit für die Verwaltung großer Datenmengen in Cloud-Umgebungen.

- Automatisierte Workflows: Vereinfachen Aufgaben im Datenmanagement, reduzieren manuellen Aufwand und minimieren Fehlerquellen.

- Anpassbare Dashboards: Nutzer*innen können Visualisierungen individuell auf ihre Anforderungen zuschneiden und so das Verständnis verbessern.

- Datenherkunftsnachverfolgung: Sorgt für Transparenz, indem der Ursprung und die Transformation von Daten nachvollziehbar gemacht werden – für höhere Genauigkeit.

- Integrationsunterstützung: Ermöglicht einen nahtlosen Datenfluss zwischen verschiedenen Systemen und Anwendungen und erhöht die Kompatibilität.

- Fehlerbehandlung: Erkennt und löst Probleme schnell, um Unterbrechungen bei der Datenverarbeitung zu minimieren.

Vorteile von DataOps-Tools

Die Einführung von DataOps-Tools bietet zahlreiche Vorteile für Ihr Team und Ihr Unternehmen. Hier sind einige davon:

- Verbesserte Datenqualität: Automatisierte Workflows und Daten-Governance sorgen dafür, dass Ihre Daten präzise und zuverlässig sind.

- Schnellere Entscheidungsfindung: Durch Echtzeit-Datenverarbeitung kann Ihr Team sofort auf neue Erkenntnisse reagieren.

- Erhöhte Compliance: Starke Daten-Governance-Funktionen helfen Ihrem Unternehmen, regulatorische Anforderungen problemlos einzuhalten.

- Größere Zugänglichkeit: Data-Catalog-Tools mit Self-Service-Möglichkeiten befähigen auch Nicht-Techniker*innen, Datenaufgaben zu übernehmen und erweitern so den Zugang.

- Skalierbarkeit: Cloud-native Architekturen passen sich Ihrem wachsenden Datenbedarf an, ohne die Performance zu beeinträchtigen.

- Weniger manueller Aufwand: Automatisierte Fehlerbehandlung und Workflows minimieren sich wiederholende Aufgaben und entlasten Ihr Team.

- Bessere Zusammenarbeit: Anpassbare Dashboards und Echtzeit-Einblicke fördern Teamarbeit und fundierte Entscheidungsfindung.

Kosten und Preise von DataOps-Tools

Die Auswahl von DataOps-Tools erfordert ein Verständnis der verschiedenen Preismodelle und verfügbaren Tarife. Die Kosten variieren je nach Funktionen, Teamgröße, Add-ons und weiteren Faktoren. Beliebte Plattformen reichen von Cloud-nativen Lösungen bis hin zu Databricks-Alternativen, die sich auf einheitliche Analysen und Machine-Learning-Workflows spezialisieren. Die folgende Tabelle fasst die gängigen Tarife, ihre durchschnittlichen Preise und typische enthaltene Funktionen von DataOps-Tools zusammen:

Tarifvergleichstabelle für DataOps-Tools

| Tariftyp | Durchschnittlicher Preis | Gängige Funktionen |

| Kostenloser Tarif | $0 | Grundlegende Datenintegration, begrenzter Speicherplatz und Community-Support. |

| Persönlicher Tarif | $10-$30/user/month | Datenintegration, grundlegende Analysen, eingeschränkte Automatisierung und E-Mail-Support. |

| Business-Tarif | $50-$100/user/month | Erweiterte Analysen, Automatisierung, Daten-Governance und bevorzugter Support. |

| Enterprise-Tarif | $150-$300/user/month | Individuelle Integrationen, vollständige Automatisierung, erweiterte Sicherheit und dedizierter Support. |

DataOps-Tools: Häufig gestellte Fragen

Hier finden Sie Antworten auf häufig gestellte Fragen zu DataOps-Tools:

Wichtige Überlegungen bei der Implementierung von DataOps

Bei der Implementierung von DataOps sollten Sie funktionsübergreifende Teams aufbauen, um die Zusammenarbeit zwischen Data Engineers, Entwicklern und Analysten zu stärken. Wählen Sie die passenden Tools für Ihre Anforderungen und etablieren Sie klare Prozesse für Ihr Team. Automatisieren Sie sich wiederholende Aufgaben, um Zeit zu sparen, und überwachen und optimieren Sie Ihre Arbeitsabläufe kontinuierlich.

Was sind die drei Pipelines von DataOps?

DataOps umfasst in der Regel drei Pipelines: Produktion, Entwicklung und Umgebung. Jede Pipeline erfüllt einen bestimmten Zweck im Management von Datenflüssen. Produktionspipelines verarbeiten Live-Daten, Entwicklungspipelines dienen dem Testen und Erstellen und Umgebungspipelines verwalten Konfigurationen. Das Verständnis dieser Strukturen hilft, effiziente Workflows zu orchestrieren.

Wie unterscheidet sich DataOps von DevOps?

Während DevOps darauf abzielt, Entwicklungs- und Betriebsteams für eine schnellere Softwarebereitstellung zu vereinen, möchte DataOps Silos zwischen Datenbereitstellern und Datennutzern aufbrechen. Ziel ist es, Daten zugänglicher und wertvoller zu machen. DataOps betont die Zusammenarbeit zwischen Datenteams, um das Datenmanagement und die Datennutzung zu verbessern.

Was sind die wichtigsten Vorteile der Automatisierung von DataOps-Aufgaben?

Die Automatisierung von DataOps-Aufgaben kann die Effizienz erheblich steigern, indem sie manuellen Aufwand reduziert. Diese Database-DevOps-Tools sorgen für Konsistenz in Datenprozessen und helfen, die Datenqualität zu sichern. Automatisierung ermöglicht Ihrem Team zudem, sich auf strategischere Aufgaben zu konzentrieren, was die Produktivität verbessert und schnellere Entscheidungen ermöglicht.

Wie unterstützen DataOps-Tools die Data Governance?

DataOps-Tools bieten Funktionen, die die Einhaltung von Data-Governance-Richtlinien unterstützen. Sie sorgen für Transparenz in Datenprozessen und gewährleisten die Einhaltung von Vorschriften. Durch die Nachverfolgung der Datenherkunft und das Bereitstellen von Audit-Trails helfen diese Tools, Datenintegrität und Transparenz in Ihrem Unternehmen sicherzustellen.

Warum ist Echtzeit-Datenverarbeitung in DataOps wichtig?

Die Verarbeitung von Daten in Echtzeit ermöglicht Ihrem Team den Zugang zu stets aktuellen Informationen und erleichtert schnelle Entscheidungen. Sie unterstützt dynamische Geschäftsanforderungen, indem sie immer zeitnahe Erkenntnisse liefert. Diese Fähigkeit ist besonders wichtig in Branchen, in denen aktuelle Daten entscheidend für Wettbewerbsfähigkeit und schnelle Reaktionen auf Marktveränderungen sind.

Wie geht es weiter?

Steigern Sie Ihr SaaS-Wachstum und Ihre Führungskompetenzen.

Abonnieren Sie unseren Newsletter für die neuesten Einblicke von CTOs und aufstrebenden Tech-Führungskräften.

Wir unterstützen Sie dabei, intelligenter zu skalieren und stärker zu führen – mit Leitfäden, Ressourcen und Strategien führender Experten!