Im Durchschnitt arbeiten Organisationen regelmäßig mit 400 Datenquellen. Bei sprichwörtlich hunderten von Datensätzen kann eine reibungslose Datenintegration sowie eine genaue Datenanalyse ohne die passenden Workflows unmöglich sein.

In diesem Leitfaden stelle ich dir ETL-Workflows vor und gebe Tipps für den Aufbau von ETL-Datenpipelines, die eine erweiterte Funktionalität und Datenqualität unterstützen.

Was sind ETL-Workflows?

Unser ultimativer Leitfaden zu ETL erklärt die Details des ETL-Prozesses, einschließlich der Prozesse Extrahieren, Transformieren und Laden. Für eine optimale Funktionalität müssen diese Prozesse zusammenarbeiten, sodass Informationen effizient von der Datenquelle ins Data Warehouse fließen.

ETL-Workflows sind für diesen Gesamtprozess verantwortlich. In der Regel beinhalten sie verschiedene API-Tools, Konnektoren und Verarbeitungsschritte, um sicherzustellen, dass das Extrahieren-, Transformieren- und Laden-Verfahren zuverlässig funktioniert und die Anforderungen der Organisation unterstützt.

Vorteile von ETL-Workflows

Einige Vorteile starker ETL-Workflows sind:

- Verbesserter Datenzugriff. Mit den richtigen ETL-Prozessen kannst du einen Echtzeit-Zugriff auf Daten für Mitarbeitende ermöglichen. Das Extrahieren-, Transformieren- und Laden-Verfahren stellt sicher, dass die Daten nach dem Speichern sofort verwendbar sind, sodass sich SQL-Reports, Datenmodelle und andere Abfragen leichter ausführen lassen.

- Fähigkeit zur Verarbeitung von Big Data. Fortschrittliche ETL-Prozesse können große Datenmengen bewältigen und unstrukturierte Daten integrieren – ganz ohne zeitaufwändige manuelle Abläufe. Das erleichtert es Unternehmen, Big Data zu managen und davon zu profitieren.

- Bessere Datentransformations-Prozesse. Der richtige ETL-Workflow integriert beispielsweise das Säubern und Transformieren von Daten, sodass Rohdaten effektiver in strukturierte Datensätze umgewandelt werden, die genutzt werden können.

- Mehr Effizienz durch Automatisierung. Das Importieren von Quelldaten, das Durchführen von Validierungsprozessen und weitere Aufgaben können von ETL-Tools, die Automatisierung unterstützen, übernommen werden. Das verkürzt den Zeitaufwand für das Datenmanagement.

- Anwendung von Geschäftsregeln in Datenmanagement-Prozessen. ETL-Lösungen lassen sich individuell an organisatorische Bedürfnisse anpassen, inklusive der Integration von geschäftlichen und rechtlichen Vorgaben im Extract-, Transform- und Load-Workflow.

Überblick über den ETL-Prozess

Bevor wir die wichtigsten Bestandteile von ETL-Workflows und deren Modellierung betrachten, schauen wir uns an, wie diese Prozesse funktionieren – inklusive Ziele und Herausforderungen der einzelnen Schritte.

Extrahieren

Während der Extract-Phase von ETL werden Informationen aus einer oder mehreren Datenquellen entnommen. Bei der Datenextraktion können sowohl Rohdaten als auch bereits verarbeitete Daten auftreten, außerdem müssen diverse Dateiformate wie CSV und XML berücksichtigt werden.

- Ziel: Die möglichst umfassende und ganzheitliche Erfassung der Daten.

- Herausforderungen: Identifikation von Data Lakes und Datenquellen, Zugriffsbeschaffung auf Daten sowie das passende Timing der Datenerfassung, damit die Prozesse aktuell bleiben.

Transformieren

Beim Daten-Transformationsprozess werden die Daten in Formate überführt, die zu relationalen Datenbanken sowie anderen Speicher- und Analysemethoden passen. In dieser ETL-Phase kannst du Tools für Daten-Mapping und Datenbereinigung, Dubletten-Erkennung, Formatierungen, das Hinzufügen von Metadaten und weitere Aufgaben einsetzen – sowohl automatisiert als auch manuell.

- Ziel: Bereinigte, nutzbare Daten, die für das Zielsystem oder den Datenspeicher passend formatiert sind.

- Herausforderungen: Die Datenqualität ist eine häufige Herausforderung bei der Datenumwandlung – je geringer die Qualität, desto mehr Transformationsaufwand ist nötig. Weitere Herausforderungen sind potenzielle Datenverluste, die Integration verschiedener Datentypen sowie das Sicherstellen von Schutz und Sicherheit im Prozess.

Laden

Im letzten Schritt der ETL-Prozesse werden die Daten ins finale Data Warehouse geladen und stehen der Organisation bei Bedarf zur Verfügung.

- Ziel: Sicherstellen, dass saubere und sichere Daten für Analysen, CRM-Systeme oder andere Business-Software bereitstehen.

- Herausforderungen: Auch hier gilt es, die Qualität und Sicherheit der Daten zu gewährleisten. Organisationen müssen Data-Governance-Prozesse etablieren, die regeln, wer wie auf Daten zugreifen kann. Es kann zudem wichtig sein, den nahezu Echtzeit-Zugriff auf Daten zu ermöglichen – allerdings führen Batch-Prozesse häufig zu Zeitverzögerungen.

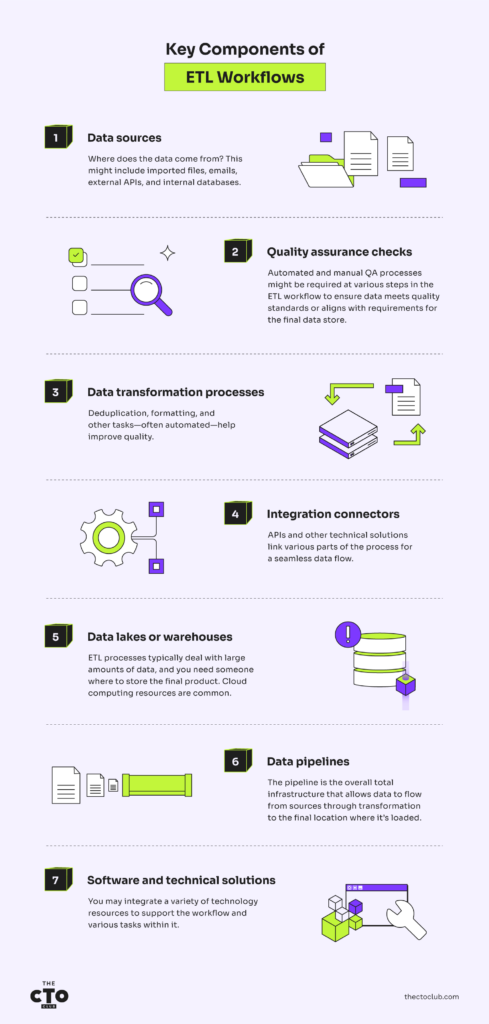

Wesentliche Bestandteile von ETL-Workflows

Der erste Schritt beim Aufbau von ETL-Workflows besteht darin, die wichtigsten Komponenten zu berücksichtigen, die enthalten sein sollten. Die Anwendungsfälle für diese Workflows sind unterschiedlich, und Sie müssen möglicherweise besondere Daten- und Prozessabhängigkeiten für Ihr Unternehmen in Betracht ziehen.

Dennoch gibt es einige Komponenten, die Dateningenieure typischerweise für ETL-Workflows berücksichtigen:

- Datenquellen. Woher stammen die Daten? Dies kann importierte Dateien, E-Mails, externe APIs und interne Datenbanken umfassen.

- Qualitätssicherungsprüfungen. Automatisierte und manuelle QS-Prozesse können an verschiedenen Stellen im ETL-Workflow erforderlich sein, um sicherzustellen, dass die Daten Qualitätsstandards erfüllen oder den Anforderungen für den finalen Datenspeicher entsprechen.

- Daten-Transformationsprozesse. Duplikaterkennung, Formatierung und andere Aufgaben – oft automatisiert – helfen dabei, die Datenqualität zu verbessern.

- Integrations-Konnektoren. APIs und andere technische Lösungen verbinden verschiedene Teile des Prozesses für einen nahtlosen Datenfluss.

- Daten-Lakes oder Data Warehouses. ETL-Prozesse verarbeiten typischerweise große Mengen an Daten, und Sie benötigen einen Ort, an dem das Endprodukt gespeichert wird. Cloud-Computing-Ressourcen sind dabei üblich.

- Datenpipelines. Die Pipeline ist die Gesamtinfrastruktur, die es ermöglicht, dass Daten von den Quellen über die Transformation bis zum endgültigen Speicherort fließen.

- Software und technische Lösungen. Sie können verschiedenste technologische Ressourcen integrieren, um den Workflow und die damit verbundenen Aufgaben zu unterstützen.

Modellierung von ETL-Workflows

Bei der Modellierung Ihrer ETL-Pipelines müssen Sie überlegen, ob Sie die Verarbeitung per Batch oder Stream abwickeln möchten.

Erstellung einer ETL-Pipeline mit Batch-Verarbeitung

Bei der Batch-Verarbeitung werden die Daten in Batches oder Blöcken verarbeitet. Jeder Batch ist in der Regel zeitlich festgelegt – Sie könnten beispielsweise täglich, mehrmals am Tag oder zu jeder vollen Stunde bearbeiten.

Batch-Verarbeitung ist eine gute Lösung, wenn:

- Sie Skaleneffekte nutzen möchten

- Sie Automatisierungen im Einsatz haben, die große Datenmengen schnell verarbeiten können

- Der Zugriff auf und die Verarbeitung der Daten nicht besonders zeitkritisch ist

Erstellung einer ETL-Pipeline mit Stream-Verarbeitung

Stream-Verarbeitung ermöglicht es, dass Daten in Echtzeit durch den ETL-Prozess fließen, ohne dass sie in Batches angesammelt werden. Sie ist flexibler als die Batch-Verarbeitung, jedoch ist es schwieriger, bei dieser Art von Pipeline eine gleichbleibende Datenqualität und Konsistenz sicherzustellen.

Stream-Verarbeitung ist eine gute Lösung, wenn:

- Daten in kleinen Mengen und zu unregelmäßigen Zeitpunkten in Ihren Prozess gelangen

- Der Zugriff auf Daten zeitkritisch ist und es entscheidend ist, Daten sofort in den Prozess einzuschleusen

- Sie auf aktuelle Trend-Insights zugreifen möchten, ohne darauf warten zu müssen, dass gebündelte Daten verarbeitet werden

Beispiele für ETL-Workflows

Das Verständnis der spezifischen Datenflüsse und des Datenmanagements Ihrer Branche ist entscheidend für eine erfolgreiche ETL-Workflow-Planung. Berücksichtigen Sie diese Beispiele aus verschiedenen Branchen, um zu sehen, wie Anforderungen und Abhängigkeiten variieren können.

ETL für Gesundheitsdatenflüsse

Gesundheitsorganisationen benötigen einen genauen und zeitnahen Zugriff auf Patienten- und Behandlungsdaten, was ETL-Prozesse für den Erfolg unverzichtbar macht. Die Daten können aus vielfältigen Quellen stammen, darunter Patientenportale, elektronische Gesundheitsakten, medizinische Bildgebungssysteme und Drittanbieter wie Pharmafirmen.

Eine der größten Herausforderungen für Healthcare-ETL besteht darin, sichere Prozesse zu schaffen, die gesetzlichen Vorgaben wie HIPAA entsprechen. Diese Prozesse hängen zudem von Datenquellen ab, die sowohl durch Patienten, Anbieter als auch durch Automatisierung gespeist werden – was zusätzliche Herausforderungen für die Datentransformation mit sich bringt.

Bei der Modellierung von Healthcare-Datenpipelines muss häufig sowohl mit Stream- als auch mit Batch-Verfahren gearbeitet werden. Beispielsweise benötigen Ärzte möglicherweise Echtzeit-Zugriff auf diagnostische Daten, während Kodierungs- und Abrechnungsdaten aus Abrechnungsgründen am Ende des Tages im Batch verarbeitet werden können.

ETL für E-Commerce-Datenflüsse

E-Commerce-Daten stammen aus vielen Quellen, einschließlich E-Mails, Kundenportalen, APIs und Apps, sozialen Medien, Webseiten, CRM-Systemen sowie Buchhaltungs- oder Zahlungsprozessen. Dies stellt eine enorme Herausforderung dar, Daten zu transformieren, ohne deren Qualität zu beeinträchtigen.

Batch-Verarbeitung funktioniert in vielen E-Commerce-Prozessen typischerweise sehr gut. Zum Beispiel können Sie stündlich Bestelldaten erfassen und sie in ETL-Prozesse einspeisen, die Lager- und Versandaufgaben unterstützen. Ebenso lassen sich Zahlungsdaten täglich auslesen, sodass die Finanzaufzeichnungen aktualisiert werden.

Wenn Sie jedoch einen 24/7 Self-Service für Kund:innen anbieten möchten, sind workflowbasierte Streams möglicherweise besser geeignet. Angenommen, Sie betreiben einen Chatbot, der Kund:innen Informationen über Bestellungen, Zahlungen, Rückgaben und Gutschriften liefert. Werden Ihre ETL-Prozesse täglich im Batch-Modus ausgeführt, sind die vom Chatbot bereitgestellten Informationen immer mindestens 24 Stunden veraltet.

ETL für Finanzdatenflüsse

Banken, Kreditkartenunternehmen, Geldverwaltungs-Apps und andere Organisationen sowie Dienste im Finanzbereich sind stark auf präzise Daten angewiesen. Diese Organisationen müssen zudem strenge Vorschriften und Compliance-Standards einhalten, um Daten sicher zu verwahren.

Datenquellen können importierte Daten anderer Finanzunternehmen, ACH- und Clearinghaus-Daten, Informationen aus kundenorientierten Apps und weniger strukturierte Formate wie E-Mails umfassen. Finanzorganisationen möchten zudem häufig eine Kombination aus Batch- und Stream-Pipelines verwenden, um den Kundenanforderungen gerecht zu werden.

Technologische Fortschritte in ETL-Prozessen

Vor einigen Jahrzehnten revolutionierte Cloud-Technologie die Datenverarbeitung – und sie ist nach wie vor eine wichtige Komponente für Fortschritte bei Data-Warehouse-Software und -Lösungen. Heutzutage konzentrieren sich ETL-Technologietrends jedoch stärker auf die Integration von KI, Machine Learning und Automatisierung in Workflows. Einige spezifische Fortschritte sind:

- Die Fähigkeit von KI, Big Data zu verarbeiten. Künstliche Intelligenz Tools können riesige Datenmengen innerhalb von Sekunden analysieren und so Skalierbarkeit für ETL-Prozesse ermöglichen, wie es sie zuvor nicht gab.

- Natural Language Processing. Maschinelles Lernen und Natural Language Processing ermöglichen es automatisierten Lösungen, Datenumwandlung mit einem umfassenderen Satz „kritischer Denkfähigkeiten“ anzugehen, als dies bisher möglich war. Dadurch können Aufgaben automatisiert werden, die früher menschliches Eingreifen erforderten.

- Unterstützung für Data Governance. Fast jede Branche sieht sich heute mit verschärften gesetzlichen Anforderungen konfrontiert. Technologielösungen unterstützen zunehmend die Compliance und die Sicherheit von Daten.

Best Practices zur Optimierung von ETL-Workflows

Was für eine andere Organisation funktioniert, muss nicht unbedingt die beste Praxis für Ihr Unternehmen im Bereich ETL sein. Ich habe jedoch einige allgemeine Best Practices zusammengestellt, die Sie implementieren können, um ETL-Workflows in fast jeder Umgebung zu optimieren.

- Wählen Sie die richtigen Tools für Ihren Bedarf. Recherchieren Sie zu ETL-Workflows und Prozess-Tools, um Partner und Lösungen zu finden, die Ihre spezifischen Datenanforderungen erfüllen. Überlegen Sie, ein Team zusammenzustellen, das gewünschte ETL-Workflows abbildet, Herausforderungen auflistet und potenzielle Lösungen hinsichtlich dieser Faktoren bewertet.

- Stellen Sie sicher, dass Ihre Workflow-Auswahl passt. Nehmen Sie sich die Zeit, ETL versus ELT zu verstehen und prüfen Sie, ob Sie Batch- oder Stream-Workflows benötigen.

- Überwachen Sie Ihre Prozesse regelmäßig. Nutzen Sie Tools wie SQL Server Performance Monitor – oder andere relevante Performance-Monitoring-Lösungen – um zu sehen, wie Ihre ETL-Workflows performen. Beobachten Sie Effizienz- und Qualitätskennzahlen und nehmen Sie Anpassungen für eine kontinuierliche Verbesserung vor.

- Integrieren Sie Technologien, die Qualität und Skalierbarkeit unterstützen. Ziehen Sie Optionen wie Parallelverarbeitung und Datenkompression in Betracht, um Ihre Workflows zu optimieren.

Fazit

Das Design Ihrer ETL-Workflows kann Ihre Datenprozesse maßgeblich beeinflussen. Nehmen Sie sich Zeit, um die Auswirkungen Ihrer Workflow-Entscheidungen zu überdenken, ideale Workflows zu planen und die richtigen Tools für Extraktion, Umwandlung und Laden Ihrer Daten auszuwählen.

Bleiben Sie auf dem Laufenden mit Technologie-Trends und Best Practices im Datenbereich und abonnieren Sie den CTO Club Newsletter.