Unternehmen sind darauf angewiesen, Informationen aus verschiedenen Quellen nahtlos zu integrieren. Hier kommt ETL (Extract, Transform, Load) ins Spiel, das eine entscheidende Rolle beim Aufbau einer einheitlichen Datenbasis spielt. Der ETL-Prozess ist jedoch nicht ohne Herausforderungen.

Dieser Artikel behandelt fünf häufige ETL-Herausforderungen, denen Sie begegnen können, und zeigt die besten ETL-Tools auf, die Ihnen helfen können, diese zu meistern und eine reibungslose und effiziente Datenintegrationsreise zu gewährleisten.

5 Häufige ETL-Herausforderungen

Obwohl sie für den Transfer und die Integration von Daten aus mehreren Quellen unerlässlich sind, bringen ETL-Prozesse zahlreiche Herausforderungen mit sich, die ein Entwickler bewältigen muss.

Schlechte Datenqualität

Eine der größten Herausforderungen bei ETL-Prozessen ist die Datenintegrität. Inkonsistente Daten können zu falschen Ergebnissen führen, die die Genauigkeit und Zuverlässigkeit von Datenanalysen untergraben. Der ETL-Prozess erfordert, dass Daten aus verschiedenen Quellen kompatibel und einheitlich sind, damit Informationen erfolgreich integriert werden können. Die Unterschiede zwischen diesen Quellen hinsichtlich Format, Struktur und Werten können den Prozess jedoch verzögern oder sogar entgleisen lassen. Daten können fehlende Werte, doppelte Informationen oder sogar widersprüchliche Angaben enthalten. Die Behebung dieser Probleme erfordert erheblichen Zeit- und Arbeitsaufwand, um die Daten zu bereinigen und in ein einheitliches Format zu bringen.

Engpässe

Engpässe in der Datenverarbeitung sind eine weitere häufige ETL-Herausforderung. Mit zunehmender Datenmenge wird es für Systeme schwieriger, diese zeitnah zu verarbeiten. Das kann zu langsamen Datenaktualisierungen führen und Daten veralten lassen, bevor sie überhaupt genutzt werden.

Leistungsprobleme

Ein entscheidendes Hindernis bei ETL-Prozessen ist die Handhabung riesiger Datenmengen aus unterschiedlichen Ursprüngen – eine anspruchsvolle Aufgabe. Die Optimierung dieser Abläufe ist unerlässlich, um eine effiziente Extraktion, Transformation und das Laden der Daten zu gewährleisten.

Da Unternehmen zunehmend datengesteuert arbeiten, wächst zudem das Volumen an Echtzeitdaten exponentiell. ETL-Prozesse müssen daher mit diesen Big-Data-Lasten und einer zeitnahen Aktualisierung der Daten umgehen, ohne erhebliche Leistungseinbußen zu verursachen.

Komplexität von ETL-Skripten

Oft werden ETL-Skripte manuell geschrieben, was die Wartung und Weiterentwicklung erschwert. Schon kleinere Änderungen in der Struktur von Quell- oder Zieldaten können eine vollständige Überarbeitung dieser Skripte erfordern. Die Fehlersuche in diesen komplexen Skripten ist eine anspruchsvolle Aufgabe, die viele Entwicklungsressourcen binden kann.

Datenschutz und -sicherheit

Dies ist ein wesentliches Anliegen bei ETL-Vorgängen. Während Daten aus verschiedenen Quellen extrahiert und über Systeme hinweg verschoben werden, gibt es mehrere Schwachstellen, an denen Datenpannen auftreten können. Dies wird zusätzlich erschwert, da Datenschutzregeln (wie GDPR und HIPAA) und Compliance-Anforderungen an die Datenverarbeitung immer strenger werden.

Trotz dieser Herausforderungen bleibt ETL ein integraler Bestandteil vieler Geschäftsprozesse. Mit den richtigen Strategien und effektiven Tools können diese Hürden erfolgreich gemeistert werden, sodass das volle Potenzial von ETL-Prozessen ausgeschöpft werden kann.

Best Practices zur Überwindung von ETL-Herausforderungen

Die Überwindung von ETL-Herausforderungen erfordert strategische Lösungen und die Einhaltung bewährter Methoden.

- Die Infrastruktur sollte skalierbar und flexibel sein, um schwankende Datenmengen bewältigen zu können. Cloud-basierte Lösungen können Storage-Management und Infrastrukturprobleme effektiv und kostengünstig adressieren.

- Eine klar definierte Daten-Governance-Richtlinie kann den Prozess der Datenzuordnung und -überprüfung vereinfachen. Es ist wichtig, inkrementelle statt Massendatenladungen durchzuführen, um die Ladezeit zu verkürzen und das Risiko von Datenverlusten zu minimieren. Regelmäßige Audits sollten durchgeführt werden, um die Datenqualität und -integrität zu erhalten. Die Implementierung solider Cybersicherheitsmaßnahmen ist unerlässlich, um sensible Daten während des gesamten ETL-Prozesses zu schützen und Datenpannen oder -lecks auszuschließen.

- Nutzen Sie hochwertige ETL-Tools, die nicht nur unterschiedliche Datentypen unterstützen, sondern auch den Programmieraufwand reduzieren. Diese Tools können den gesamten ETL-Prozess strukturiert verwalten und damit Fehler minimieren.

ETL-Testwerkzeuge

ETL-Testwerkzeuge validieren, überprüfen und qualifizieren Daten, während sie Duplikate und Datenverluste verhindern. Diese Werkzeuge spielen eine entscheidende Rolle dabei, die Effizienz, Geschwindigkeit und Effektivität des ETL-Prozesses zu steigern. Sie wurden entwickelt, um sicherzustellen, dass der Datentransfer aus mehreren Quellen in ein Data Warehouse korrekt erfolgt und konsistenten Mustern folgt.

Die Nutzung von ETL-Testwerkzeugen kann den manuellen Aufwand bei der Datentestung erheblich reduzieren und dadurch das Risiko menschlicher Fehler minimieren.

| Informatica Data Validation | QuerySurge | TestBench |

|---|---|---|

| Dieses Tool bietet umfassende ETL-Tests sowie Tests zur Datenintegration. Es erkennt und behebt mühelos Datenabweichungen und Anomalien, wodurch die Datenintegrität verbessert wird. Informatica Data Validation ist bekannt für seine benutzerfreundliche grafische Oberfläche, die bei der Erstellung, Verwaltung und Ausführung von ETL-Testfällen unterstützt und nur minimale Programmierkenntnisse erfordert. | QuerySurge ist Marktführer im Bereich vollständiger Big Data-, ETL- und Data-Warehouse-Tests. QuerySurge stellt sicher, dass die aus Quelldateien extrahierten Daten im Zielsystem intakt bleiben, indem es etwaige Abweichungen in den riesigen Datensätzen analysiert und erkennt. Es bietet End-to-End-Testing und ermöglicht so die Datenvalidierung von der Quelle bis zum Ziel. Die Lösung stellt Echtzeit-Analysen bereit, die eine schnelle Entscheidungsfindung auf Basis präziser Ergebnisse ermöglichen. QuerySurge ist besonders bekannt für seine Fähigkeit, den ETL-Testprozess zu automatisieren, wodurch erheblich Zeit eingespart und menschliche Fehler ausgeschlossen werden. | Berücksichtigen Sie die Größe und Komplexität der zu verarbeitenden Daten. Tools wie TestBench adressieren diese Komplexitäten und bieten integrierte Testprozesse, was sie ideal für komplexe Datenarchitekturen oder Projekte macht. Sie können zudem synthetische Testdaten generieren, die Datenschutzbestimmungen nicht verletzen – ein äußerst nützliches Feature bei der Arbeit mit sensiblen Informationen. |

Trotz der fortschrittlichen Fähigkeiten moderner ETL-Testautomatisierungstools bestehen weiterhin Herausforderungen. Unterschiedliche Kundenanforderungen verlangen nach diversen Testtools. Skalierbarkeit kann zum Problem werden, wenn die Datenmenge exponentiell ansteigt. Daher ist es entscheidend, auch die Skalierbarkeit des Tools selbst zu berücksichtigen.

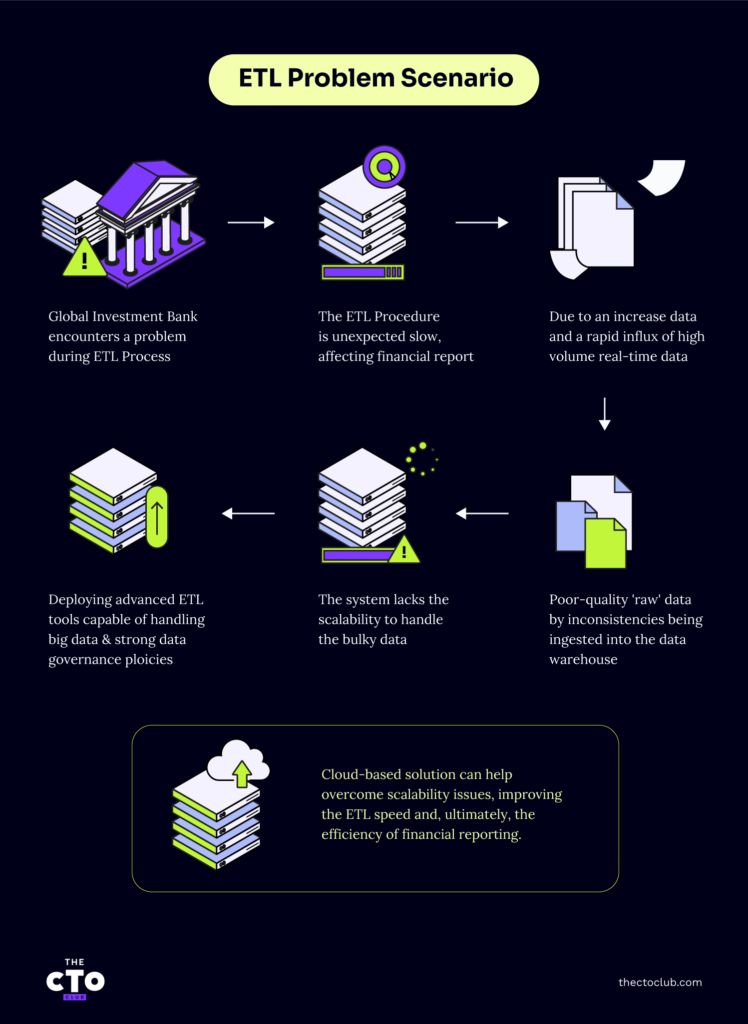

ETL-Problemszenario

Stellen Sie sich vor, eine globale Investmentbank stößt während ihres ETL-Prozesses auf ein erhebliches Problem. Das Finanzinstitut verarbeitet täglich enorme Mengen an Transaktionsdaten und der ETL-Vorgang verlangsamt sich unerwartet, was letztlich die Effizienz der Finanzberichte beeinträchtigt. Ursache ist eine Zunahme unstrukturierter Daten sowie der rasche Zustrom großer Mengen an Echtzeitdaten, die die traditionelle ETL-Prozessinfrastruktur überfordern.

In der Folge entstehen Dateninkonsistenzen und Ungenauigkeiten, weil qualitativ minderwertige „Rohdaten“ in das Data Warehouse eingespeist werden. Zusätzlich fehlt dem System aufgrund der Beschränkungen der lokalen Infrastruktur die Skalierbarkeit, um große Datenmengen zu bewältigen.

Die Lösung besteht im Einsatz fortschrittlicher ETL-Tools, die in der Lage sind, Big Data zu verarbeiten, kombiniert mit strikten Richtlinien zur Datenverwaltung, um die Datenqualität bereits an der Quelle sicherzustellen. In diesem Szenario kann eine cloudbasierte Lösung helfen, Skalierungsprobleme zu überwinden, die ETL-Geschwindigkeit zu erhöhen und letztlich die Effizienz der Finanzberichterstattung zu verbessern.

Die Zukunft von ETL

Es ist mit einem erheblichen Wandel hin zu cloudbasierten ETL-Tools zu rechnen, denn Unternehmen nutzen Cloud-Technologien zunehmend für Datenmanagement und Datenspeicherung.

Die Integration von künstlicher Intelligenz und maschinellem Lernen in ETL-Prozesse wird Datenextraktion und -verarbeitung revolutionieren, was zu effizienteren und präziseren Datenanalysen führt. Auch die Einführung von Echtzeit-ETL-Funktionen wird weiter zunehmen und eine sofortige Datenextraktion sowie -analyse für Entscheidungen in Echtzeit ermöglichen.

In den kommenden Jahren wird der Fokus darauf liegen, anhaltende ETL-Herausforderungen wie die Verarbeitung großer Datenmengen, die Optimierung komplexer Transformationen sowie die Datensicherheit und den Datenschutz zu bewältigen.

Mit dem stetigen Datenwachstum und der zunehmenden Abhängigkeit der Unternehmen von datenbasierten Entscheidungen müssen ETL-Prozesse agiler, sicherer und effizienter werden. Daher können wir die Entwicklung anspruchsvollerer ETL-Tools und -Methoden erwarten, um diesen Anforderungen gerecht zu werden.

Mehr über ETL-Herausforderungen, Testtools und vieles mehr erfahren Sie, wenn Sie sich für den Newsletter des CTO Clubs anmelden.