Meilleure sélection d’outils d’observabilité des données

Les meilleurs outils d’observabilité des données aident les équipes à détecter précocement les problèmes de qualité des données, à réduire les défaillances des pipelines et à maintenir une analytique et un reporting fiables. Ces outils offrent aux équipes data et ingénierie de la visibilité sur la circulation et l’évolution des données, afin que les problèmes puissent être résolus avant qu’ils n’affectent les systèmes en aval.

Les équipes recherchent souvent des outils d’observabilité des données lorsque des pipelines cassés passent inaperçus, que les vérifications manuelles ne détectent pas les anomalies ou que des mauvaises configurations aboutissent à des données incorrectes dans les tableaux de bord et applications. Ces problèmes ralentissent la prise de décision, augmentent le travail de reprise et créent des frictions entre les équipes data, ingénierie et métiers.

Fort de plus de 20 ans d’expérience dans l’industrie en tant que Chief Technology Officer, j’ai testé et évalué des dizaines d’outils d’observabilité des données dans des environnements réels pour juger de la profondeur de leur surveillance, de leurs intégrations et de leur simplicité d’utilisation. Ce guide met en avant les meilleurs outils d’observabilité des données pour améliorer la fiabilité des données, accélérer la résolution des incidents et renforcer la confiance des équipes dans leurs données. Chaque avis détaille les fonctionnalités, avantages et inconvénients, ainsi que les cas d’usage idéaux, pour vous guider dans votre choix.

Pourquoi faire confiance à nos avis sur les logiciels

Nous testons et évaluons des logiciels SaaS pour le développement depuis 2023. En tant qu’experts tech, nous savons combien il est crucial et difficile de bien choisir un logiciel. Nous investissons dans une recherche approfondie afin d’aider notre audience à prendre de meilleures décisions d’achat.

Nous avons testé plus de 2 000 outils pour différents cas d’usage liés au SaaS et rédigé plus de 1 000 avis complets sur des logiciels. Découvrez comment nous restons transparents & consultez notre méthodologie d’évaluation logicielle.

Table of Contents

- Meilleure sélection logicielle

- Pourquoi nous faire confiance

- Comparer les spécifications

- Avis

- Autres outils d'observabilité des données

- Avis similaires

- Critères de sélection

- Comment choisir

- Tendances des outils d'observabilité des données

- Qu'est-ce que les outils d'observabilité des données ?

- Fonctionnalités

- Avantages

- Coûts & tarifs

- FAQ

Résumé des meilleurs outils d’observabilité des données

Ce tableau comparatif résume les détails tarifaires de mes meilleurs choix d’outils d’observabilité des données afin de vous aider à trouver le plus adapté à votre budget et à vos besoins.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Idéal pour la gestion avancée des logs | Démo gratuite + essai gratuit de 30 jours disponible | À partir de 9 $/mois (facturé annuellement) | Website | |

| 2 | Idéal pour l'analyse des journaux | Essai gratuit disponible + démo gratuite | À partir de $25/utilisateur/mois (facturé annuellement) | Website | |

| 3 | Idéal pour la détection des anomalies | Démo gratuite disponible | Tarifs sur demande | Website | |

| 4 | Idéal pour la performance applicative | Essai gratuit de 14 jours + démo disponible | À partir de 75 $/mois | Website | |

| 5 | Idéal pour la surveillance automatisée | Démo gratuite disponible | Tarification sur demande | Website | |

| 6 | Idéal pour les opérations de données | Essai gratuit de 30 jours | Tarification sur demande | Website | |

| 7 | Idéal pour des analyses approfondies de la qualité des données | Démo gratuite disponible | Tarifs sur demande | Website | |

| 8 | Idéal pour la surveillance de Kubernetes | Offre gratuite disponible | À partir de $20/mois (facturé annuellement) | Website | |

| 9 | Idéal pour la validation des données | Démo gratuite disponible | Tarification sur demande | Website | |

| 10 | Idéal pour les alertes en temps réel | Offre gratuite disponible | À partir de 10 $/mois (facturation annuelle) | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Avis sur les meilleurs outils d’observabilité des données

Ci-dessous, retrouvez mes synthèses détaillées des meilleurs outils d’observabilité des données qui figurent dans ma sélection.

Mes évaluations présentent en détail les principales fonctionnalités, les avantages et inconvénients, les intégrations et les cas d’usage idéaux de chaque outil pour vous aider à choisir celui qui vous conviendra le mieux.

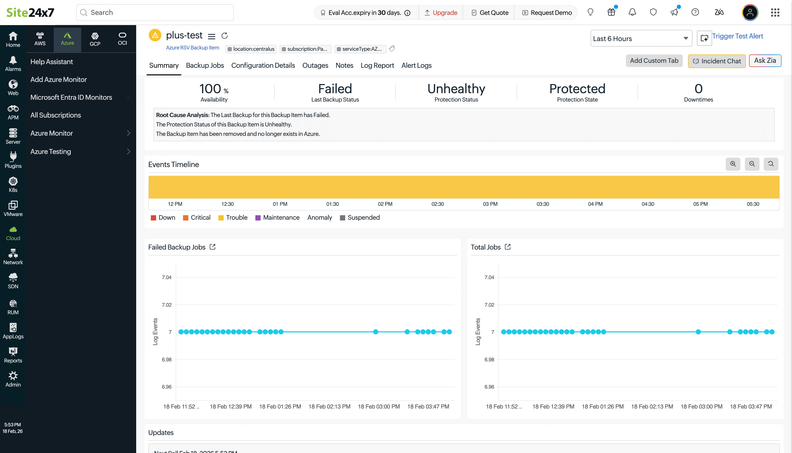

Si vous recherchez un outil d'observabilité des données pour assurer la fiabilité de vos systèmes, Site24x7 propose une gestion avancée des journaux permettant aux équipes d'examiner et d'analyser l'activité du système. Conçu pour les professionnels de l'informatique, les équipes DevOps et les entreprises de différentes tailles, il offre un large éventail de fonctionnalités de surveillance pour gérer et maintenir les environnements numériques. Avec Site24x7, les équipes peuvent suivre les performances des applications, surveiller les ressources cloud et maintenir la santé du réseau afin de garantir la stabilité des opérations quotidiennes.

Pourquoi j'ai choisi Site24x7

J'ai choisi Site24x7 pour sa gestion avancée des journaux, qui aide les équipes à collecter et à examiner les logs afin de comprendre l'activité du système et d'identifier les problèmes. Son Application Performance Monitoring (APM) permet aux équipes de suivre en temps réel la santé et les performances des applications. La plateforme offre également la collecte, l'indexation et l'analyse des logs à travers différents environnements, ce qui aide les équipes à investiguer les incidents et à maintenir des performances applicatives stables.

Principales fonctionnalités de Site24x7

En plus de la gestion avancée des logs, Site24x7 propose :

- Suivi de l'expérience utilisateur réelle (RUM) : Suit les interactions réelles des utilisateurs avec votre site Web, fournissant des informations sur l'expérience utilisateur et sur les goulots d'étranglement des performances.

- Surveillance du réseau : Surveille les équipements critiques et le trafic réseau afin d'assurer la visibilité sur les performances et la disponibilité du réseau.

- Pages de statut publiques : Communique le statut du service et les temps d'arrêt à vos clients, renforçant ainsi la transparence et la confiance.

- Intégration AIOps : Utilise l'IA et l'apprentissage automatique pour détecter les anomalies et gérer les incidents, améliorant l'efficacité opérationnelle.

Intégrations Site24x7

Les intégrations incluent ServiceNow, PagerDuty, Jira, Slack, Microsoft Teams, Zapier, Moogsoft, Opsgenie, VictorOps et HipChat. Une API est disponible pour les intégrations personnalisées.

Pros and Cons

Pros:

- Une surveillance flexible s'intègre facilement avec de nombreux composants d'infrastructure

- Le processus de configuration rapide couvre la surveillance des sites Web et des ressources cloud

- La surveillance complète alimentée par l'IA prend en charge la gestion des infrastructures multicloud

Cons:

- La tarification devient coûteuse en raison de la multiplicité des types de moniteurs

- Des bugs dans les alertes provoquent des problèmes lors de l'ajout de nouvelles configurations de surveillance

New Product Updates from Site24x7

Site24x7 Adds Azure Backup and Multi-Cloud Monitoring Updates

Site24x7’s new update adds per-item Azure Recovery Services Vault backup monitoring and extends monitoring to five new cloud providers, giving you deeper backup insights and unified multi-cloud visibility. For more information, visit Site24x7’s official site.

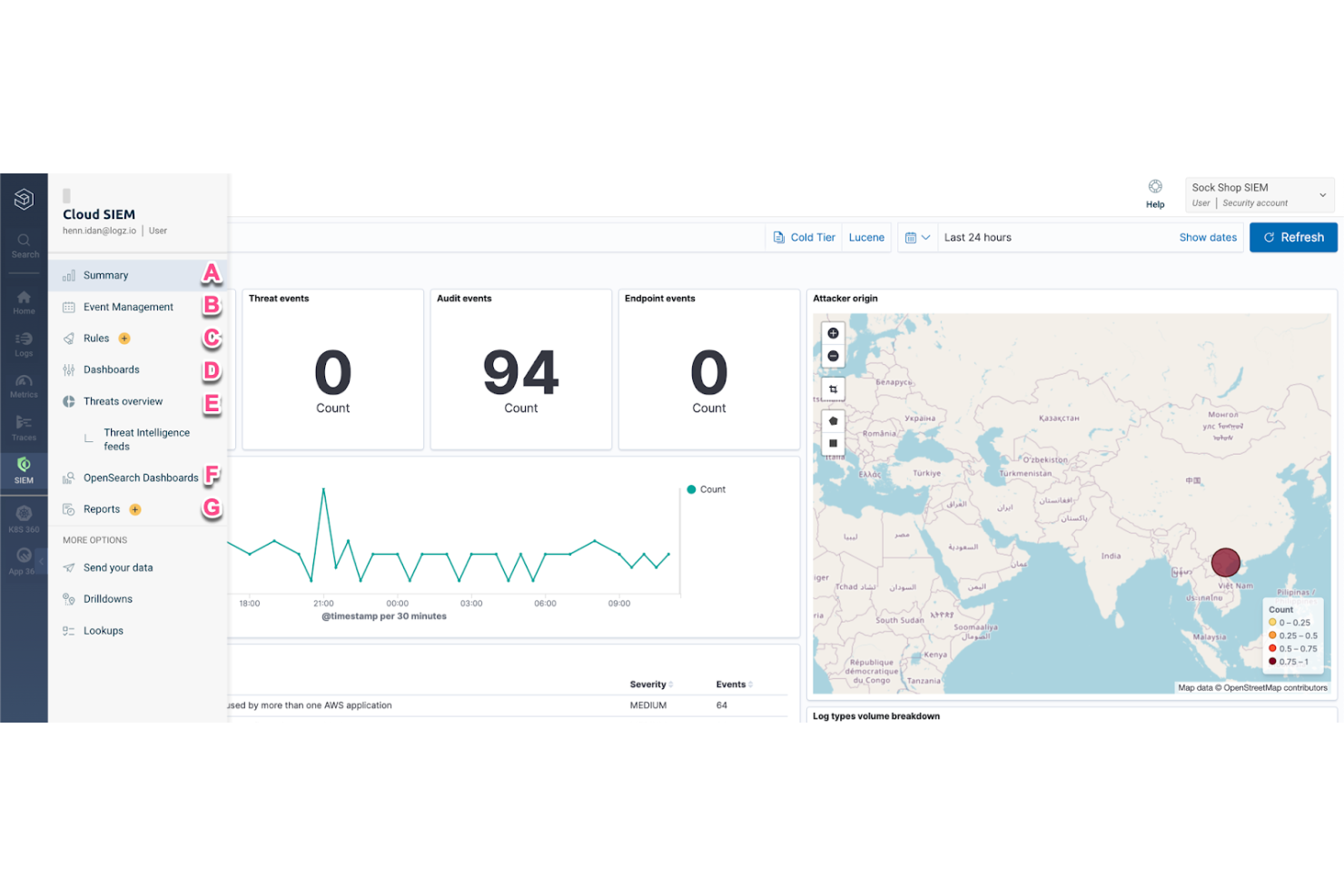

Logz.io est une plateforme de gestion des journaux basée sur le cloud, conçue pour les équipes DevOps et informatiques, axée sur l'analyse et la surveillance des journaux. Elle aide les équipes à tirer des enseignements des logs afin d'améliorer les performances des applications et de résoudre efficacement les problèmes.

Pourquoi j'ai choisi Logz.io : La plateforme excelle dans l'analyse des journaux, offrant à votre équipe des informations précieuses sur la performance des applications. Logz.io propose une surveillance en temps réel, ce qui vous garantit de détecter les problèmes dès qu'ils surviennent. Le système d'alerte de l'outil vous informe de toute anomalie détectée dans vos journaux. Son tableau de bord convivial permet une navigation aisée et un accès rapide aux données essentielles.

Fonctionnalités et intégrations remarquables :

Fonctionnalités : surveillance des journaux en temps réel, qui permet de détecter rapidement les problèmes. Logz.io propose la détection des anomalies pour repérer les schémas inhabituels dans vos journaux. De plus, la plateforme offre un tableau de bord convivial qui facilite la navigation et l'accès aux informations critiques.

Intégrations : AWS, Azure, Google Cloud, Kubernetes, Docker, Datadog, Grafana, Slack, PagerDuty et ServiceNow.

Pros and Cons

Pros:

- Analyse des journaux efficace

- Détection des anomalies incluse

- Tableau de bord convivial

Cons:

- Options de personnalisation limitées

- Courbe d'apprentissage abrupte

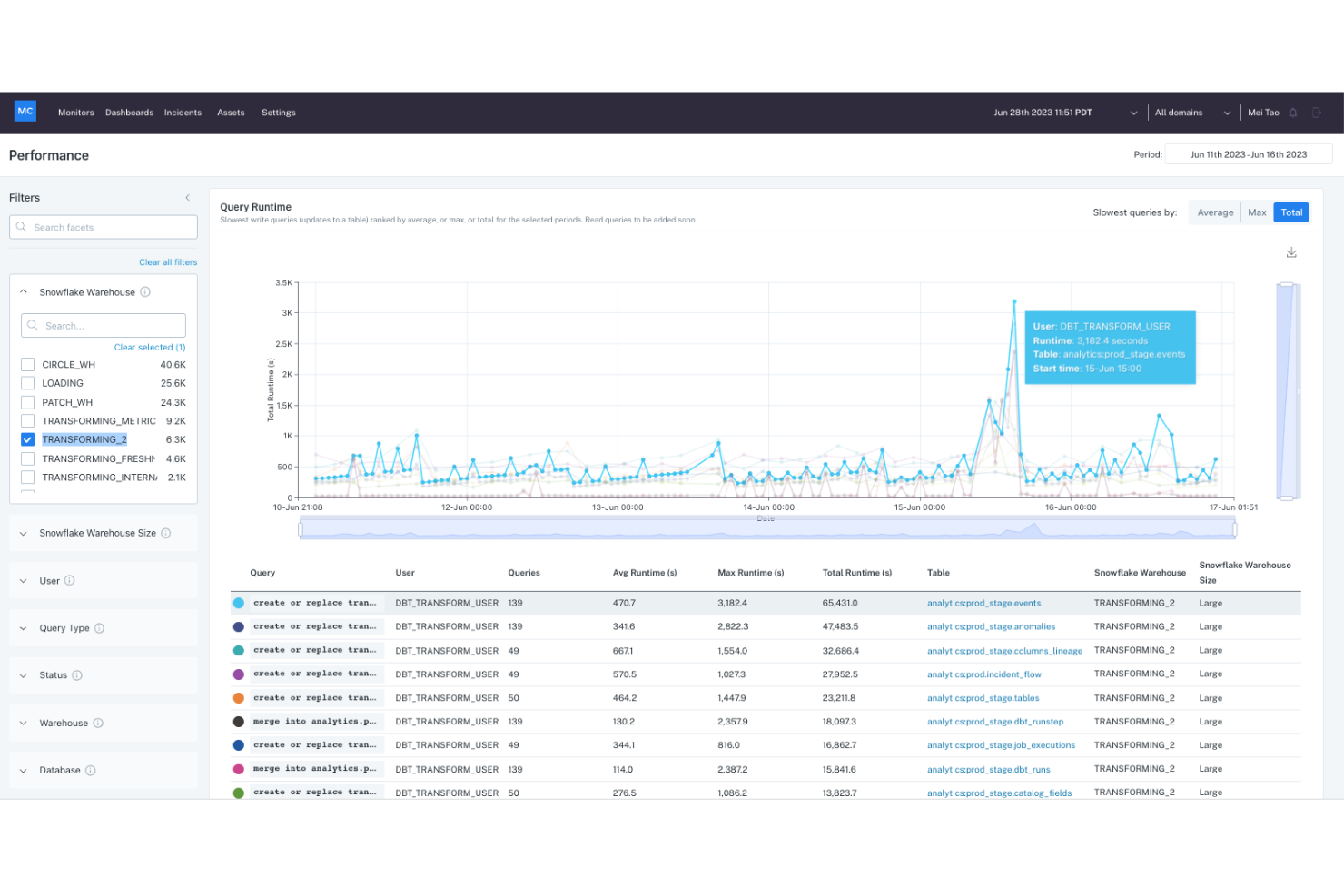

Monte Carlo est une plateforme d'observabilité des données conçue pour les ingénieurs et analystes de données, axée sur la détection des anomalies et l'assurance de la fiabilité des données. Elle aide les équipes à surveiller les flux de données et à prévenir les interruptions de données.

Pourquoi j'ai choisi Monte Carlo : La plateforme excelle dans la détection des anomalies, ce qui est essentiel pour maintenir la qualité des données. Monte Carlo utilise une surveillance automatisée pour identifier les problèmes de données avant qu'ils n'affectent vos opérations. L'outil fournit des informations sur l'état de santé des données et leur traçabilité, aidant votre équipe à identifier et résoudre rapidement les problèmes. Son système d'alertes vous informe en temps réel de toute anomalie, garantissant la fiabilité des données.

Fonctionnalités & intégrations remarquables :

Fonctionnalités : surveillance automatisée des données, pour maintenir l'intégrité des données. Monte Carlo propose des outils de traçabilité des données qui permettent à votre équipe de remonter à l'origine des problèmes. De plus, la plateforme offre un système d'alertes personnalisable, afin d'adapter les notifications à vos besoins spécifiques.

Intégrations : Snowflake, BigQuery, Redshift, Databricks, Azure, AWS, Google Cloud, Looker, Tableau et dbt.

Pros and Cons

Pros:

- Détection efficace des anomalies

- Alertes en temps réel

- Surveillance automatisée des données

Cons:

- Options de personnalisation limitées

- Courbe d'apprentissage abrupte

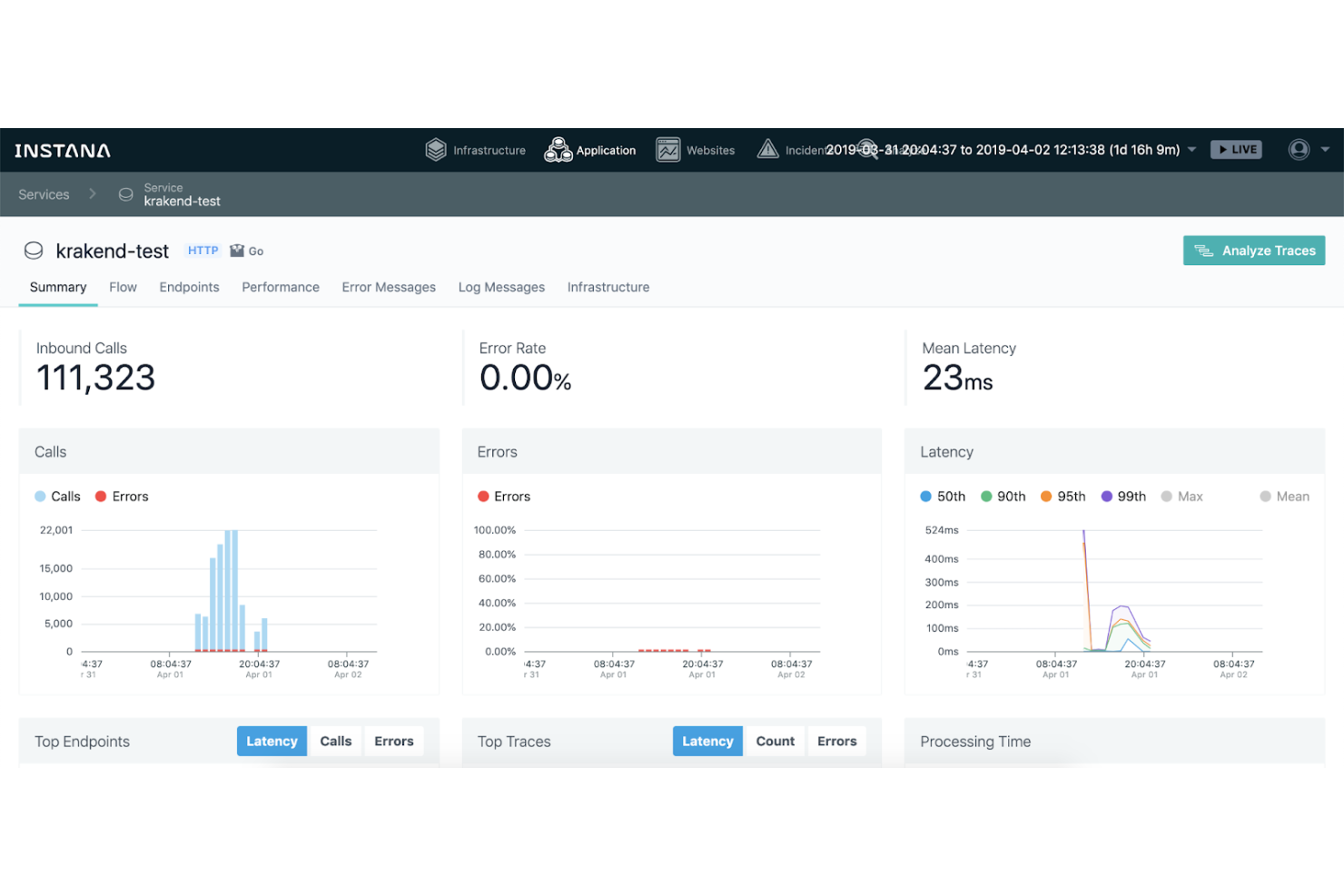

Instana est un outil de surveillance des performances applicatives conçu pour les équipes DevOps et opérations IT, avec un accent sur la visibilité et les analyses en temps réel. Il aide les équipes à surveiller les applications et l'infrastructure afin d'assurer des performances et une fiabilité optimales.

Pourquoi j'ai choisi Instana : Il offre une surveillance exceptionnelle des performances applicatives avec des analyses en temps réel, essentielles pour maintenir des opérations systèmes optimales. Instana assure la découverte automatique des applications et de l’infrastructure, garantissant à votre équipe des informations toujours à jour. Ses alertes en temps réel vous informent immédiatement de tout problème de performance. Les tableaux de bord détaillés de l’outil offrent une vue complète de la santé et des performances de votre système.

Fonctionnalités remarquables & intégrations :

Fonctionnalités : analyse automatique des causes principales pour identifier rapidement la source des problèmes de performance. Instana propose une surveillance continue, assurant une observation permanente de vos applications et de votre infrastructure. De plus, la plateforme propose des tableaux de bord détaillés donnant une vue claire de la santé de votre système.

Intégrations : AWS, Azure, Google Cloud, Kubernetes, Docker, Prometheus, Grafana, Slack, Splunk et Jenkins.

Pros and Cons

Pros:

- Analyses en temps réel

- Découverte automatique des applications

- Tableaux de bord détaillés

Cons:

- Complexe pour les nouveaux utilisateurs

- Nécessite une expertise technique

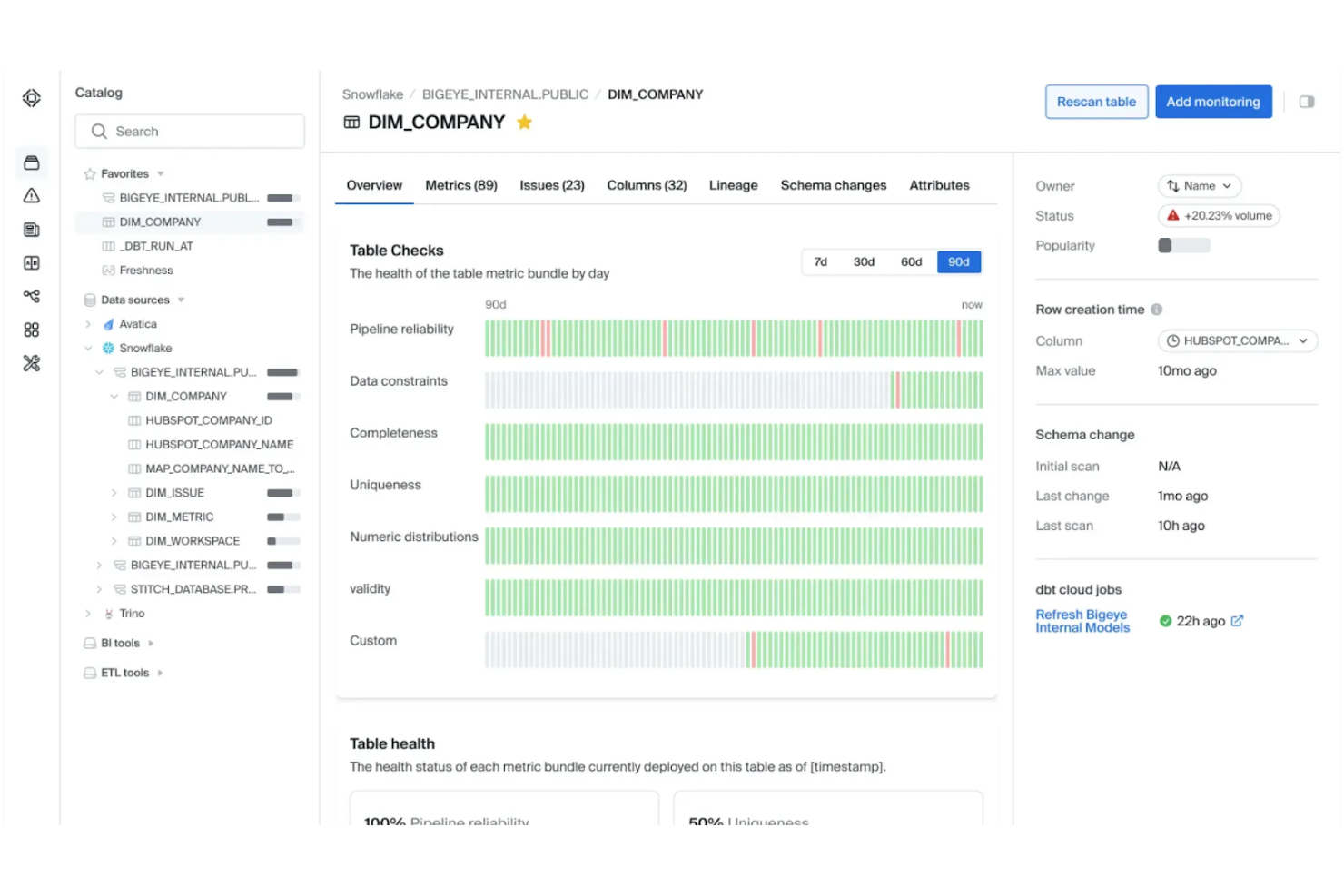

Bigeye est une plateforme d'observabilité des données destinée aux ingénieurs et analystes de données, axée sur l'automatisation de la surveillance de la qualité des données. Elle aide les équipes à garantir l'exactitude et la fiabilité de leurs pipelines de données.

Pourquoi j'ai choisi Bigeye : Elle excelle dans la surveillance automatisée, ce qui réduit le besoin de vérifications manuelles et augmente l'efficacité. La plateforme de Bigeye propose une détection des anomalies qui alerte automatiquement votre équipe en cas de problèmes potentiels liés aux données. L'outil fournit des métriques de qualité des données personnalisables, vous permettant d'adapter la surveillance à vos besoins spécifiques. Son système d'alerte vous assure de rester informé sur la santé de vos données.

Fonctionnalités phares & intégrations :

Fonctionnalités : contrôles de fraîcheur des données pour garantir qu'elles sont à jour. Bigeye propose une surveillance de l'exactitude et de la cohérence, offrant des informations sur la qualité des données tout au long de vos pipelines. De plus, la plateforme permet des alertes basées sur des seuils, afin que vous puissiez définir des critères spécifiques pour les notifications.

Intégrations : Snowflake, BigQuery, Redshift, Databricks, Amazon S3, Google Cloud, Looker, Tableau, dbt et Airflow.

Pros and Cons

Pros:

- Surveillance automatisée disponible

- Métriques de qualité des données personnalisables

- Alertes basées sur des seuils

Cons:

- Configuration complexe pour les débutants

- Nécessite une expertise technique

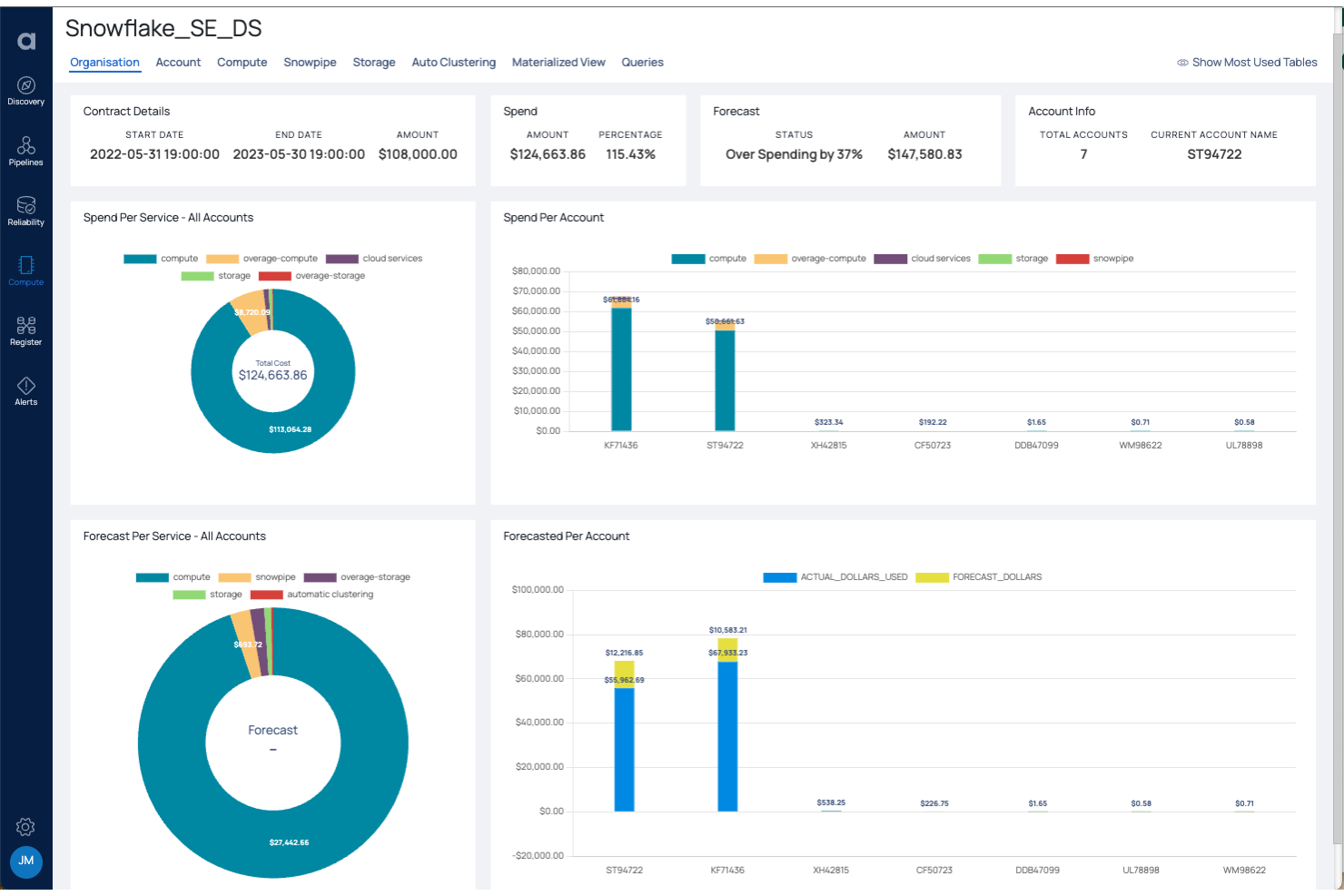

Acceldata est une plateforme d'observabilité des données conçue pour les ingénieurs et les équipes d'exploitation des données, axée sur l'amélioration de la fiabilité des données et de l'efficacité opérationnelle. Elle offre une surveillance et une optimisation complètes des pipelines de données et de l'infrastructure.

Pourquoi j'ai choisi Acceldata : Elle excelle dans les opérations de données en proposant des outils qui renforcent la fiabilité des données et l'efficacité opérationnelle. Les capacités de surveillance d'Acceldata aident votre équipe à identifier et à résoudre rapidement les problèmes. La plateforme fournit des informations sur la manière dont les données circulent au sein de votre système, permettant ainsi une meilleure gestion des ressources. Elle propose également des analyses prédictives qui aident à anticiper les problèmes de données potentiels avant qu'ils ne surviennent.

Fonctionnalités phares & intégrations :

Fonctionnalités : analyses prédictives, qui aident à prévoir les incidents potentiels liés aux données. Acceldata propose des outils de surveillance complets offrant à votre équipe une vision de la performance des pipelines de données. De plus, la plateforme propose des options d'optimisation des ressources afin d'accroître l'efficacité des opérations de données.

Intégrations : AWS, Azure, Google Cloud, Hadoop, Spark, Databricks, Snowflake, Cloudera, Kafka et Tableau.

Pros and Cons

Pros:

- Analyses prédictives disponibles

- Outils de surveillance complets

- Améliore l'efficacité opérationnelle

Cons:

- Documentation limitée

- Peu d'options de personnalisation

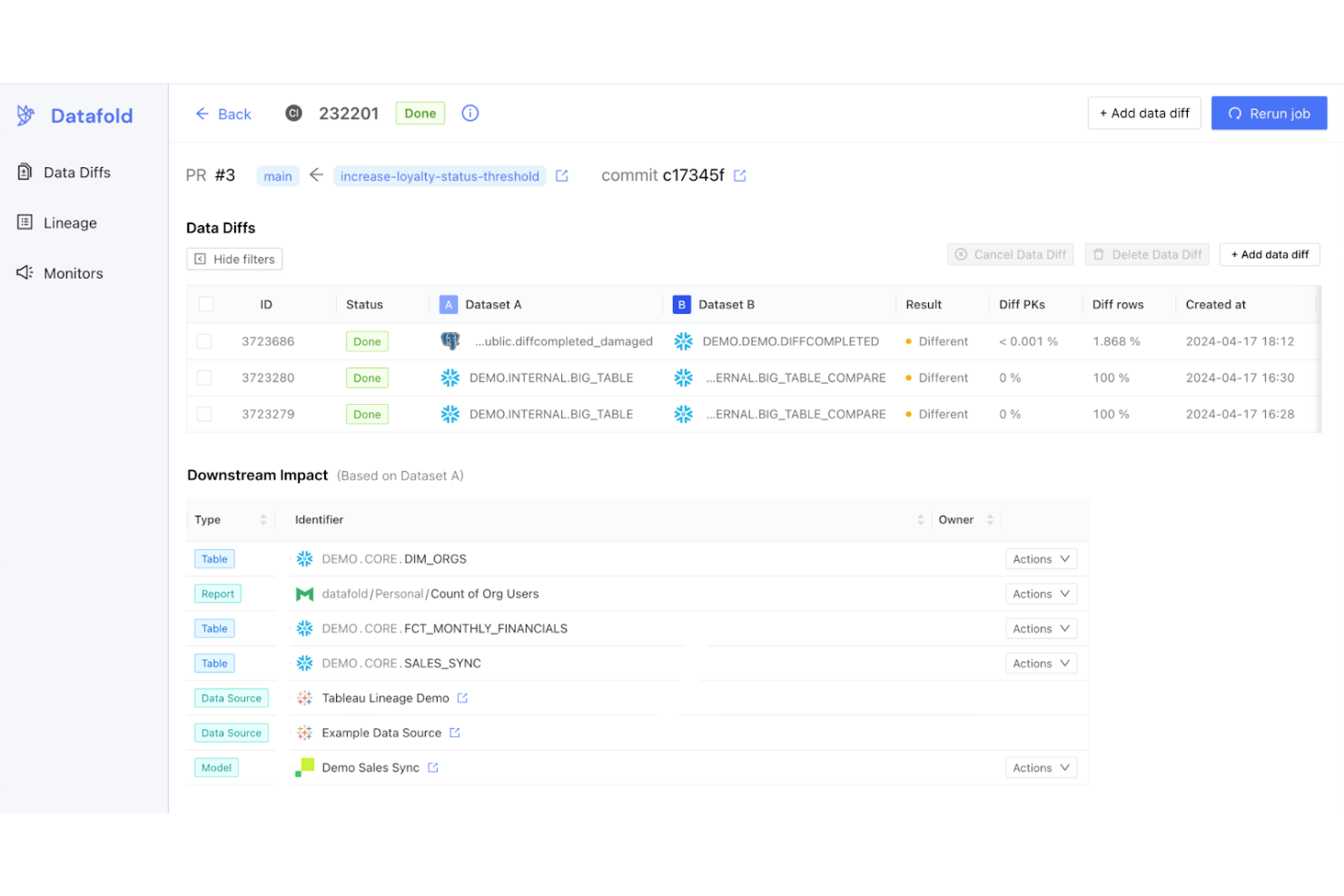

Datafold est une plateforme d'observabilité des données conçue pour les ingénieurs et analystes de données, mettant l'accent sur la qualité et la validation des données. Elle aide les équipes à identifier les écarts de données et à garantir l'exactitude lors des opérations pilotées par les données.

Pourquoi j'ai choisi Datafold : Elle se distingue par sa capacité à fournir des informations détaillées sur la qualité des données, permettant à votre équipe de détecter les problèmes avant qu'ils n'affectent la prise de décision. La plateforme propose des fonctionnalités telles que la traçabilité au niveau des colonnes, ce qui aide à remonter les erreurs de données à leur source. L'outil diff de Datafold vous permet de comparer facilement des ensembles de données pour repérer les différences. Grâce à ses capacités de profilage, votre équipe peut mieux comprendre les schémas et anomalies des données.

Fonctionnalités et intégrations remarquables :

Fonctionnalités : comparaison de jeux de données (data diffing) pour les analyser rapidement et précisément. Datafold propose également des outils de profilage qui offrent un aperçu des distributions et tendances des données. En outre, la plateforme assure la traçabilité au niveau des colonnes, pour permettre à votre équipe de remonter à l'origine des problèmes de données.

Intégrations : Snowflake, BigQuery, Redshift, Databricks, dbt, Looker, Tableau, Airflow, Segment, FiveTran et Amazon S3.

Pros and Cons

Pros:

- Analyses détaillées de la qualité des données

- Traçabilité au niveau des colonnes

- Comparaison facile des ensembles de données

Cons:

- Documentation limitée

- Peut être complexe pour les débutants

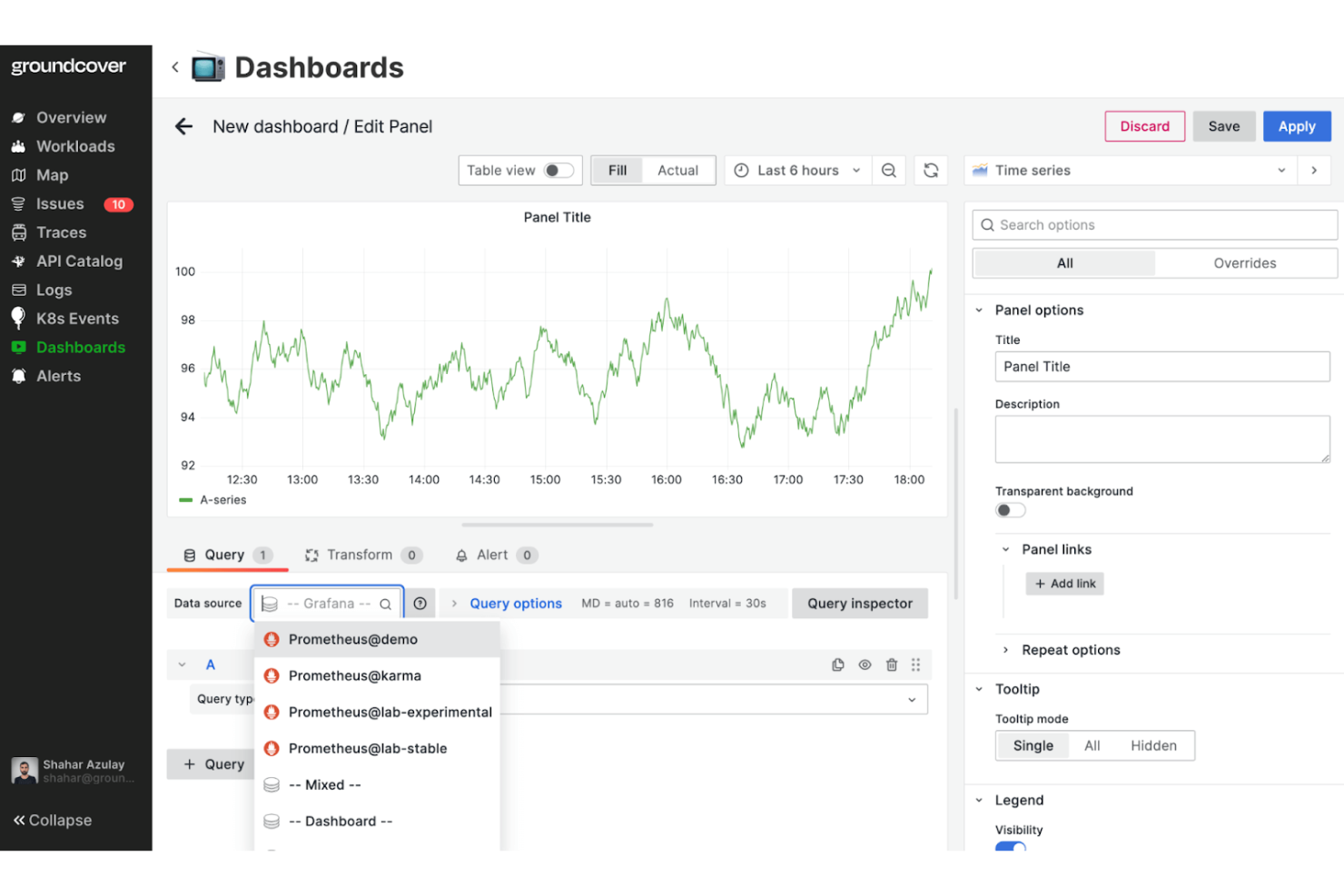

Groundcover est une plateforme d'observabilité cloud conçue pour les équipes DevOps, offrant une surveillance complète des environnements Kubernetes. Elle utilise la technologie eBPF pour fournir des informations et une visibilité en temps réel sur les performances des applications.

Pourquoi j'ai choisi Groundcover : Il excelle dans la surveillance des environnements Kubernetes grâce à ses capacités d'intégration poussées. L'architecture BYOC (Bring Your Own Cloud) de la plateforme garantit la confidentialité et le contrôle des données, permettant à votre équipe de surveiller sans modifier le code. Les informations en temps réel et les alertes personnalisables vous tiennent informé de tout problème. Son modèle de tarification transparent permet de collecter des données de manière illimitée, sans coûts imprévus.

Fonctionnalités principales & intégrations :

Fonctionnalités : accès en temps réel à des informations contextualisées pour comprendre ce qui se passe dans votre environnement. La plateforme propose des alertes personnalisables pour signaler toute anomalie. De plus, Groundcover consolide les logs, métriques et traces dans une interface conviviale afin de faciliter le dépannage.

Intégrations : AWS, Google Cloud, Azure, Kubernetes, Prometheus, Grafana, Datadog, ElasticSearch, Splunk et New Relic.

Pros and Cons

Pros:

- Intégration approfondie à Kubernetes

- Modèle de tarification transparent

- Aucune modification de code nécessaire

Cons:

- Personnalisation limitée

- L'intégration pourrait être plus fluide

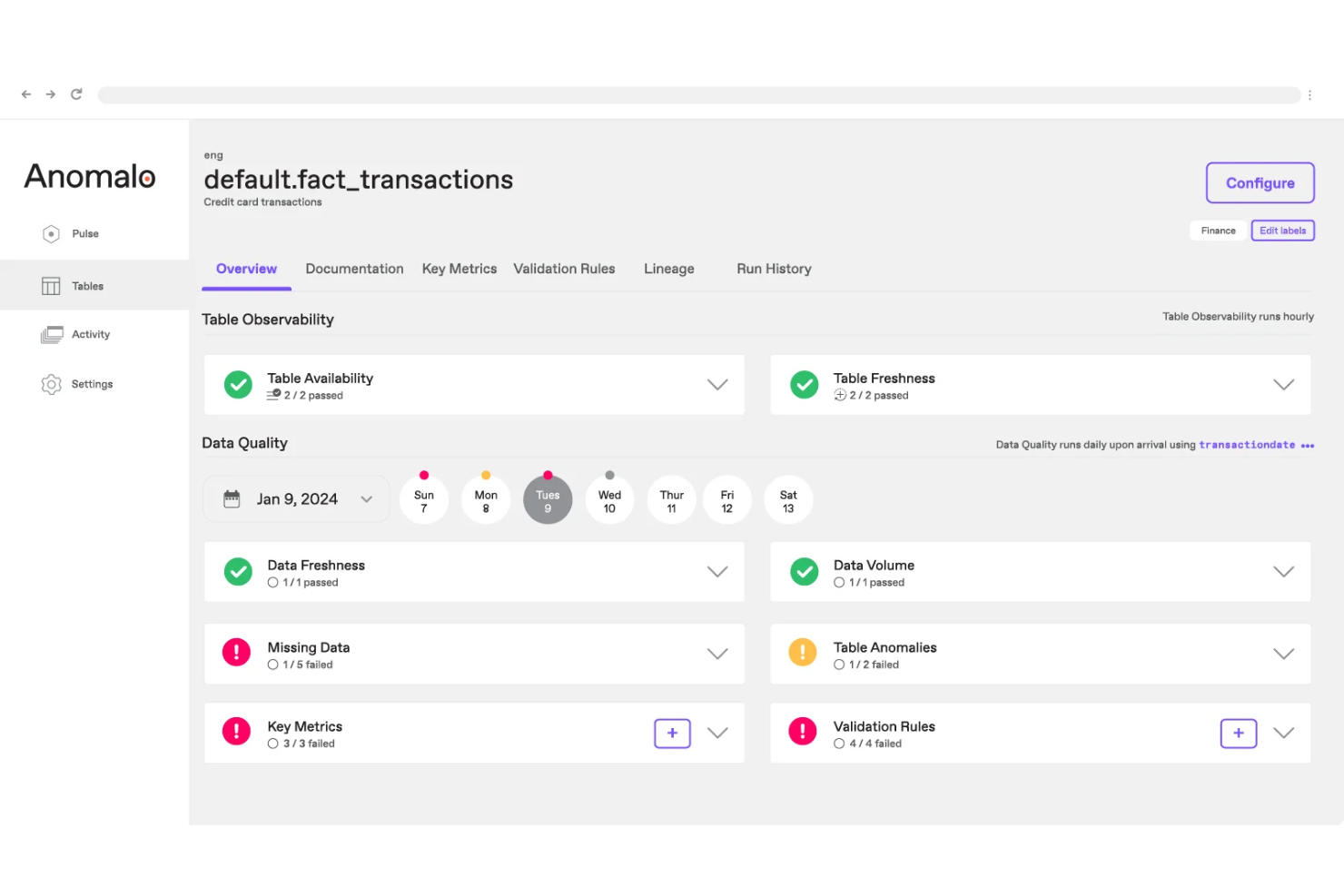

Anomalo est une plateforme de surveillance de la qualité des données pilotée par l'IA, conçue pour les entreprises, axée sur la détection d'anomalies et la validation des données. Elle s'adresse aux ingénieurs et analystes de données en garantissant l'intégrité et la fiabilité des données sans nécessiter de compétences en programmation.

Pourquoi j'ai choisi Anomalo : Elle se distingue dans la validation des données, en utilisant l'apprentissage automatique pour identifier de manière proactive les problèmes de données. Anomalo permet à votre équipe de définir des règles de validation personnalisables et des indicateurs de performance clés. Elle prend en charge la gouvernance et l'observabilité des données, améliorant l'efficacité opérationnelle. Avec Anomalo, il est facile d'intégrer les lacs de données et entrepôts pour une surveillance continue.

Fonctionnalités et intégrations remarquables :

Fonctionnalités : profilage des données pour fournir des informations sur les tendances et les schémas, outils de lignage pour aider votre équipe à comprendre les flux et dépendances des données. En plus, Anomalo propose des contrôles automatisés et une observabilité basée sur les métadonnées pour garantir la fiabilité des données.

Intégrations : Snowflake, BigQuery, Redshift, Databricks, Azure, Google Cloud Storage, Amazon S3, Looker, Tableau et Power BI.

Pros and Cons

Pros:

- Validation des données pilotée par l'IA

- Règles de validation personnalisées

- Aucune compétence en programmation requise

Cons:

- Nécessite des connaissances techniques

- Détails tarifaires non transparents

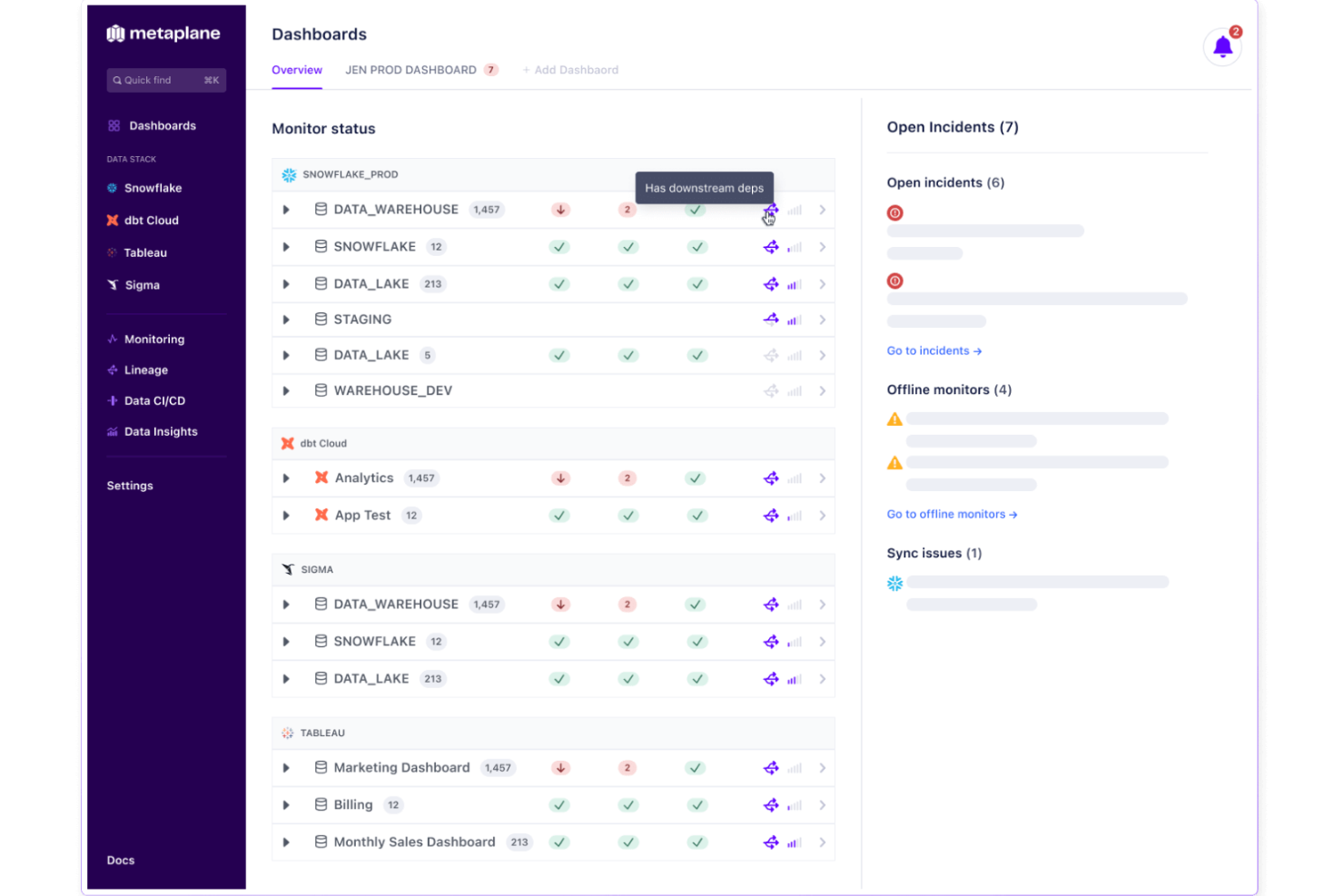

Metaplane est une plateforme complète d'observabilité des données conçue pour les équipes data modernes, axée sur la surveillance de la qualité et de la traçabilité des données. Elle s'adresse aux analystes et ingénieurs data en prévenant les problèmes de qualité des données et en offrant une visibilité sur les pipelines de données.

Pourquoi j'ai choisi Metaplane : Elle se distingue par la fourniture d'alertes en temps réel, essentielles pour maintenir l'intégrité des données. Les alertes automatisées informent immédiatement votre équipe de toute anomalie. Des fonctionnalités telles que la gestion CI/CD des données et les notifications de modifications de schéma garantissent l'exactitude de vos données. Avec Metaplane, vous pouvez surveiller uniquement les tables nécessaires, ce qui est rentable pour des équipes de toutes tailles.

Fonctionnalités et intégrations remarquables :

Les fonctionnalités incluent la surveillance automatisée, la détection d'anomalies et l'alerte personnalisable. Votre équipe bénéficiera de ses capacités de CI/CD pour les données, assurant des opérations data fluides. La plateforme offre également un suivi détaillé de la traçabilité, vous donnant une vue précise des flux de données.

Intégrations : Snowflake, BigQuery, Redshift, Databricks, dbt, Looker, Tableau, Airflow, Segment et FiveTran.

Pros and Cons

Pros:

- Alertes d'anomalies en temps réel

- Modèle de tarification flexible

- Suivi détaillé de la traçabilité

Cons:

- Documentation limitée

- Quelques fausses alertes occasionnelles

Autres outils d’observabilité des données

Voici quelques autres options d’outils d’observabilité de données qui n’ont pas fait partie de ma sélection, mais qui méritent tout de même d’être considérées :

- Unravel Data

Idéal pour la surveillance des performances

- StackState

Idéal pour la visualisation de la topologie

- Pantomath

Idéal pour la traçabilité des données

Critères de sélection des outils d’observabilité des données

Pour sélectionner les meilleurs outils d’observabilité des données de cette liste, j’ai pris en compte les besoins quotidiens des acheteurs et leurs points de douleur, tels que l’assurance qualité des données et la surveillance en temps réel. J’ai aussi utilisé le cadre suivant pour garantir une évaluation structurée et équitable :

Fonctionnalités principales (25% de la note globale)

Pour être inclus dans cette liste, chaque solution devait répondre à ces cas d’usage quotidiens :

- Surveiller la qualité des données

- Détecter les anomalies

- Suivre la traçabilité des données

- Fournir des alertes en temps réel

- Garantir la fiabilité des données

Fonctionnalités distinctives supplémentaires (25 % de la note globale)

Pour affiner encore la sélection, j’ai également recherché des fonctionnalités uniques, telles que :

- Analyse automatisée des causes premières

- Tableaux de bord personnalisables

- Analyse prédictive

- Informations alimentées par l’IA

- Compatibilité multiplateforme

Facilité d’utilisation (10 % du score total)

Pour évaluer la facilité d’utilisation de chaque système, j’ai pris en compte les points suivants :

- Conception d’interface intuitive

- Facilité de navigation

- Courbe d’apprentissage minimale

- Documentation complète

- Interaction utilisateur réactive

Onboarding (10 % du score total)

Pour évaluer l’expérience d’intégration de chaque plateforme, j’ai pris en compte les éléments suivants :

- Disponibilité de vidéos de formation

- Tours de produit interactifs

- Accès à des webinaires

- Présence de chatbots

- Modèles préconçus

Service client (10 % du score total)

Pour évaluer les services de support client de chaque éditeur de logiciel, j’ai examiné les critères suivants :

- Disponibilité du service client 24/7

- Accès à une base de connaissances

- Assistance par chat en direct

- Délai de réponse par e-mail

- Disponibilité de gestionnaires de compte dédiés

Rapport qualité/prix (10 % du score total)

Pour évaluer le rapport qualité/prix de chaque plateforme, j’ai pris en compte les critères suivants :

- Transparence des tarifs

- Tarification compétitive

- Disponibilité de versions d’essai gratuites

- Flexibilité des formules tarifaires

- Rapport coût/bénéfice

Avis clients (10 % du score total)

Pour évaluer la satisfaction globale des clients, j’ai pris en compte les éléments suivants lors de la lecture des avis :

- Régularité des retours positifs

- Problèmes récurrents signalés

- Niveaux de satisfaction des utilisateurs

- Fréquence des mises à jour et améliorations

- Réactivité face aux retours

Comment choisir un outil d’observabilité des données

Il est facile de se perdre dans de longues listes de fonctionnalités et des structures tarifaires complexes.

Pour vous aider à rester concentré lors de votre propre processus de sélection de logiciel, voici une liste de facteurs à garder à l’esprit :

| Facteur | À prendre en compte |

| Scalabilité | Vérifiez que l’outil peut évoluer avec vos besoins en données. Privilégiez les options qui gèrent l’augmentation des volumes et de la complexité. |

| Intégrations | Vérifiez si l’outil s’intègre à vos systèmes existants comme les entrepôts de données et outils BI pour fluidifier vos flux de travail. |

| Personnalisation | Sélectionnez des outils permettant d’ajuster tableaux de bord et rapports aux besoins et objectifs spécifiques de votre équipe. |

| Facilité d’utilisation | Favorisez un outil à interface intuitive limitant la courbe d’apprentissage de votre équipe. |

| Budget | Pesez le coût par rapport à votre budget. Recherchez une tarification transparente et l’absence de frais cachés. |

| Sécurité | Assurez-vous que l’outil propose des fonctions de sécurité avancées pour protéger vos données, incluant chiffrement et conformité réglementaire. |

| Options de support | Évaluez la disponibilité et la qualité de l’assistance client, y compris le chat en direct et les gestionnaires de compte dédiés. |

| Performance | Analysez la rapidité de traitement des données et de restitution des analyses afin de répondre à vos exigences opérationnelles. |

Tendances dans les outils d’observabilité des données

Au cours de mes recherches, j’ai consulté de nombreuses annonces de mises à jour de produits, communiqués de presse et journaux de publication provenant de divers éditeurs d’outils d’observabilité des données. Voici quelques tendances émergentes que je surveille de près :

- Analyses alimentées par l’IA : Les fournisseurs intègrent l’IA afin de fournir des analyses prédictives et de détecter les anomalies. Cela aide les équipes à identifier les problèmes potentiels avant qu’ils ne s’aggravent, économisant ainsi du temps et des ressources. Des outils comme Dynatrace utilisent l’IA pour renforcer leurs capacités d’observabilité.

- Surveillance en temps réel : Le traitement des données en temps réel devient essentiel. Les entreprises recherchent des analyses instantanées pour réagir rapidement aux problèmes, et des fournisseurs comme Logz.io concentrent leurs efforts sur l'offre d'analyses en temps réel pour répondre à cette demande.

- Plateformes d’observabilité unifiées : Les sociétés recherchent des plateformes rassemblant différentes fonctions d’observabilité. Cette tendance réduit la complexité et améliore l’efficacité. Splunk Observability Cloud, par exemple, propose une vue unifiée des métriques, journaux et traces.

- Accent sur la confidentialité des données : Les fonctionnalités de confidentialité des données sont de plus en plus recherchées avec l’accroissement des exigences réglementaires. Les fournisseurs renforcent leurs mesures de sécurité afin d’assurer la conformité avec des réglementations comme le RGPD. IBM Databand met en avant la confidentialité des données dans ses solutions d’observabilité.

- Tableaux de bord personnalisables : Les utilisateurs souhaitent personnaliser les tableaux de bord selon leurs besoins. Cette tendance reflète la demande croissante pour des expériences adaptées. New Relic propose des tableaux de bord personnalisables permettant aux utilisateurs de se concentrer sur les données les plus pertinentes.

Qu’est-ce qu’un outil d’observabilité des données ?

Les outils d’observabilité des données surveillent et garantissent la santé ainsi que la fiabilité des systèmes de données. Ingénieurs data, analystes et professionnels IT utilisent généralement ces outils pour détecter les anomalies, suivre la traçabilité des données et assurer la qualité des données via des plateformes d’observabilité complètes.

La surveillance en temps réel, les analyses basées sur l’IA et les tableaux de bord personnalisables aident à identifier rapidement les incidents, à prédire les problèmes potentiels et à adapter les expériences utilisateurs. Ces outils apportent la tranquillité d’esprit en maintenant une gestion fluide et efficace des systèmes de données.

Fonctionnalités des outils d’observabilité des données

Lors du choix de vos outils d’observabilité des données, soyez attentif aux fonctionnalités clés suivantes :

- Surveillance en temps réel : Cette fonctionnalité vous permet de détecter et de répondre aux incidents dès qu’ils se produisent, garantissant la fiabilité des données.

- Détection d’anomalies : Elle identifie les schémas inhabituels dans vos données, ce qui permet de repérer les problèmes avant qu’ils ne s’aggravent.

- Suivi de la traçabilité des données : Cette fonctionnalité offre une visibilité sur le parcours des données, ce qui facilite la recherche de l’origine des incidents.

- Analyses alimentées par l’IA : Grâce à l’IA, l’outil peut anticiper d’éventuels problèmes de données et proposer des recommandations de résolution.

- Tableaux de bord personnalisables : Ils permettent à chaque utilisateur d’adapter l’interface à ses besoins, offrant une vue personnalisée de ses données.

- Alertes automatisées : Les notifications sont transmises immédiatement lors d’incidents, tenant l’équipe informée et prête à agir.

- Analyses prédictives : Cette capacité permet d’anticiper les tendances et de prévenir de futurs problèmes de données.

- Mécanismes de sécurité : Garantissent la protection des données et la conformité réglementaire, préservant la confidentialité des informations sensibles.

- Plateforme unifiée : Réunir plusieurs fonctions d’observabilité sur une seule interface simplifie la gestion des données.

- Analyse de la cause première : Identifie rapidement l’origine d’un problème, ce qui accélère la résolution et limite les interruptions.

Bénéfices des outils d’observabilité des données

Mettre en place des outils d’observabilité des données offre de nombreux avantages pour votre équipe et votre entreprise.

Découvrez quelques-uns de ces avantages :

- Fiabilité accrue des données : La surveillance en temps réel et la détection d’anomalies garantissent le bon fonctionnement des systèmes de données et limitent les interruptions.

- Prise de décision améliorée : Les analyses alimentées par l’IA et l’analytique prédictive fournissent des tendances précieuses, permettant à votre équipe de prendre des décisions éclairées.

- Résolution accélérée des problèmes : Les alertes automatisées et l’analyse de la cause première permettent de détecter et corriger rapidement les problèmes.

- Efficacité renforcée : Les tableaux de bord personnalisables permettent de se concentrer sur les données pertinentes, ce qui améliore les processus et la productivité.

- Meilleure conformité : Les mécanismes de sécurité assurent la protection et la conformité des données aux exigences sectorielles.

- Gestion simplifiée des données : Une plateforme unifiée consolide les différentes fonctionnalités d’observabilité, facilitant la gestion de vos systèmes de données.

- Maintenance proactive : L’analytique prédictive permet d’anticiper d’éventuels problèmes pour mettre en œuvre des mesures préventives.

Coûts & tarification des outils d’observabilité des données

Choisir des outils d’observabilité des données implique de bien comprendre les différents modèles de tarification et abonnements disponibles. Les coûts varient selon les fonctionnalités, la taille de l’équipe, les modules complémentaires, et d’autres facteurs.

Le tableau ci-dessous résume les offres standards, leurs prix moyens et les fonctionnalités typiques incluses dans les solutions d’outils d’observabilité des données :

Tableau comparatif des offres pour les outils d’observabilité des données

| Type d’offre | Prix moyen | Fonctionnalités courantes |

| Offre gratuite | $0 | Supervision de base, alertes limitées et support communautaire. |

| Offre personnelle | $10-$30/ utilisateur/mois | Détection des anomalies, tableaux de bord personnalisables et alertes par e-mail. |

| Offre business | $50-$100/ utilisateur/mois | Supervision en temps réel, traçabilité des données (data lineage) et analyses avancées. |

| Offre entreprise | $150-$300/ utilisateur/mois | Analytique prédictive, mesures de sécurité et gestion de compte dédiée. |

FAQ sur les outils d’observabilité des données

Voici des réponses aux questions fréquentes concernant les outils d’observabilité des données :

Quelle est la différence entre les outils de supervision et les outils d’observabilité ?

Les outils de supervision permettent de détecter les anomalies ou comportements inhabituels dans la performance d’un système. Les outils d’observabilité vont plus loin, car ils offrent la possibilité d’analyser en profondeur ces anomalies, même si elles résultent d’interactions entre plusieurs composants de services. Cela vous permet d’identifier les causes profondes et de mieux comprendre le comportement du système.

Quelles sont les techniques de l’observabilité des données ?

L’observabilité des données repose sur des piliers clés tels que la fraîcheur, la distribution, le volume, le schéma et la traçabilité (lineage). La fraîcheur garantit que les données sont actuelles pour la prise de décision. La distribution suit les parcours des données pour détecter les défauts. Le volume concerne la gestion des données pour maîtriser le stockage et l’évolution, offrant ainsi une approche globale de la gestion des données.

Comment l’observabilité des données améliore-t-elle la qualité des données ?

Les outils d’observabilité des données améliorent la qualité des données en fournissant une supervision en temps réel et une détection des anomalies. Ils suivent la traçabilité des données et les modifications de schéma, garantissant que tout problème est rapidement identifié et corrigé. Cette approche proactive contribue à maintenir la précision et la fiabilité des données à travers vos systèmes.

Pourquoi la traçabilité des données est-elle importante en observabilité ?

La traçabilité des données est essentielle car elle permet de suivre le parcours des données au sein de vos systèmes. Comprendre la traçabilité aide à localiser l’origine des problèmes et à évaluer leur impact sur les processus en aval. Cette visibilité est cruciale pour préserver l’intégrité des données et assurer des analyses fiables.

Les outils d’observabilité des données peuvent-ils aider en matière de conformité ?

Oui, les outils d’observabilité des données peuvent faciliter la conformité en apportant une visibilité sur l’utilisation et l’accès aux données. Ils proposent des capacités d’audit et effectuent le suivi des modifications, aidant ainsi à assurer le respect de réglementations telles que le RGPD. Cette transparence est essentielle pour répondre aux exigences réglementaires et protéger les informations sensibles.

Comment les fonctionnalités de détection d’anomalies contribuent-elles à l’observabilité des données ?

Les fonctionnalités de détection d’anomalies dans les outils d’observabilité des données vous alertent sur des schémas inhabituels ou des comportements atypiques dans vos systèmes de données. En identifiant ces problèmes rapidement, vous pouvez intervenir avant qu’ils n’entraînent des conséquences importantes. Cette capacité est indispensable pour assurer la fiabilité des systèmes et limiter les interruptions.

Et maintenant ?

Accélérez la croissance de votre SaaS et développez vos compétences de leadership.

Abonnez-vous à notre newsletter pour recevoir les dernières tendances partagées par des CTO et des leaders technologiques en devenir.

Nous vous aidons à évoluer plus intelligemment et à diriger avec assurance grâce à des guides, des ressources et des stratégies des meilleurs experts !