Beste Open Source ETL Tools Shortlist

Die besten Open Source ETL Tools helfen Teams dabei, die Extraktion, Transformation und das Laden von Daten zu automatisieren, sodass sie präzise und konsistente Datensätze über verschiedene Systeme hinweg pflegen können. Sie erleichtern den Umgang mit komplexen Datenquellen, ermöglichen Transformationen im großen Maßstab und reduzieren den manuellen Aufwand bei der Verwaltung von Datenpipelines.

Wenn Pipelines auf benutzerdefinierten Skripten basieren, Schemaänderungen zu stillen Fehlern führen oder den Teams die Transparenz darüber fehlt, wie Daten zwischen Systemen ausgetauscht werden, leidet die Datenqualität und Zuverlässigkeit darunter. Solche Probleme verlangsamen die Analysearbeiten, erhöhen den Wartungsaufwand und sorgen für Reibungen zwischen Entwicklungs- und Datenteams.

Mit über 20 Jahren Branchenerfahrung als Chief Technology Officer habe ich Dutzende Open Source ETL Tools getestet und bewertet, um deren Leistung, Integrationsqualität und Benutzerfreundlichkeit einzuschätzen. Dieser Leitfaden stellt die besten Optionen vor, die skalierbare Workflows und planbarere Datenoperationen unterstützen. Jede Rezension behandelt Funktionen, Vor- und Nachteile sowie ideale Anwendungsszenarien, um Ihnen bei der Auswahl des richtigen Tools zu helfen.

Warum Sie unseren Software-Bewertungen vertrauen können

Wir testen und bewerten SaaS-Entwicklungssoftware seit 2023. Als Tech-Experten verstehen wir, wie entscheidend und schwierig die Wahl der passenden Software ist. Wir betreiben intensive Recherchen, um unserer Community eine bessere Entscheidungsgrundlage für Softwarekäufe zu bieten.

Wir haben über 2.000 Tools für verschiedene SaaS-Entwicklungsszenarien getestet und mehr als 1.000 umfassende Softwarebewertungen geschrieben. Erfahren Sie wie wir transparent bleiben und werfen Sie einen Blick auf unsere Methodik der Software-Bewertung.

Table of Contents

Open Source ETL Tools Vergleichsübersicht

Diese Vergleichstabelle fasst die Preisinformationen zu meinen Top-Auswahlmöglichkeiten der besten Open Source ETL Tools zusammen, damit Sie das passende Tool für Ihr Budget und Ihre Geschäftsanforderungen finden.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Am besten für komplexe Datenaufgaben | Kostenlose Testversion verfügbar | Ab $5,500/Einheit/Jahr | Website | |

| 2 | Am besten geeignet für die Verarbeitung von Logdaten | Kostenlose Testversion verfügbar | Ab $95/Monat | Website | |

| 3 | Am besten geeignet für Python-ETL-Skripte | Not available | Kostenlos nutzbar | Website | |

| 4 | Am besten geeignet für Datenumwandlung | 30-tägige kostenlose Testversion | Ab $4/Benutzer/Monat | Website | |

| 5 | Am besten geeignet für Big-Data-Integration | 14-tägige Testversion verfügbar | Preis auf Anfrage | Website | |

| 6 | Am besten für automatisierte Datenintegration | 14 Tage kostenlos testen + kostenlose Demo | Ab $239/Monat | Website | |

| 7 | Am besten geeignet für Integrationsmuster | Not available | Kostenlos nutzbar | Website | |

| 8 | Am besten geeignet für Echtzeit-Datenstreaming | Kostenloser Tarif verfügbar | Kostenlos | Website | |

| 9 | Am besten geeignet für die Automatisierung von Datenflüssen | Not available | Kostenlos nutzbar | Website | |

| 10 | Am besten für skalierbare ETL-Lösungen | Kostenloser Tarif verfügbar | Kostenlos | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Open Source ETL Tool Bewertungen

Nachfolgend finden Sie meine detaillierten Zusammenfassungen der besten Open Source ETL Tools, die es auf meine Shortlist geschafft haben. Die Bewertungen bieten einen detaillierten Einblick in Hauptfunktionen, Vor- u0026amp; Nachteile, Integrationen und ideale Anwendungsbereiche der einzelnen Tools, damit Sie das passende für sich finden können.

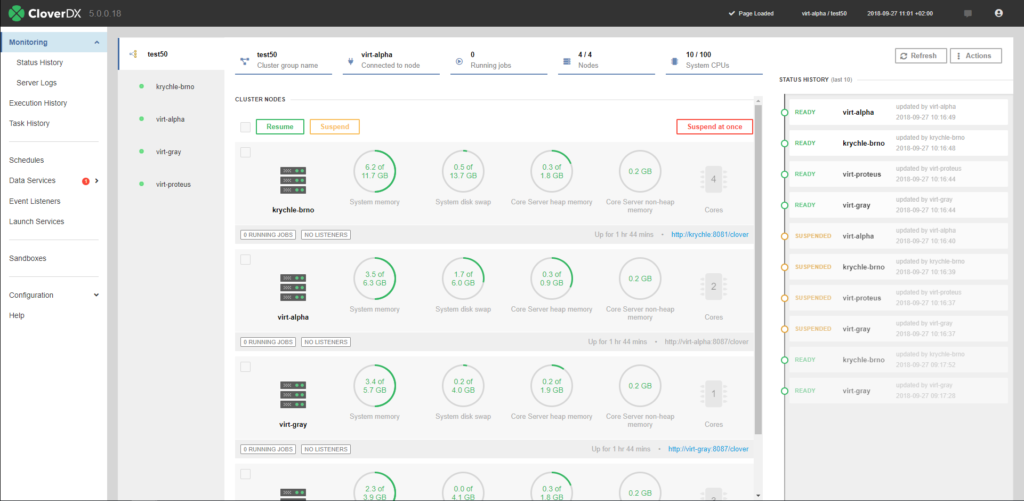

CloverDX ist eine Datenintegrationsplattform, die Geschäftsbenutzern und IT-Teams dient, indem sie Daten automatisiert, orchestriert und transformiert. Sie unterstützt verschiedene Bereitstellungsoptionen und ist dadurch vielseitig für unterschiedliche Geschäftsanforderungen einsetzbar.

Warum ich CloverDX gewählt habe: CloverDX ist auf komplexe Datenaufgaben zugeschnitten, dank seiner intuitiven Benutzeroberfläche und vielseitigen Bereitstellungsmöglichkeiten, einschließlich On-Premise und Cloud-Diensten wie AWS, Azure und Google Cloud. Es bietet Datendienste für den API-Zugriff und Kollaborationstools, damit Ihr Team effizient in unterschiedlichen Umgebungen arbeiten kann. Die Einbindung eines Datenkatalogs sorgt für zuverlässigen Datenzugriff, was entscheidend für die Wahrung der Datenintegrität ist. Diese Merkmale machen CloverDX zur herausragenden Wahl für Teams, die mit komplexen Datenprozessen arbeiten.

Hervorzuhebende Funktionen & Integrationen:

Funktionen sind eine intuitive Benutzeroberfläche für Geschäftsbenutzer, Datendienste für den API-Zugriff und ein Datenkatalog für zuverlässigen Datenzugriff. Diese Elemente gewährleisten ein effizientes Datenmanagement und einen reibungslosen Datenzugriff. Die Plattform bietet zudem Tools zur Zusammenarbeit, um Teamarbeit zu stärken.

Integrationen umfassen AWS, Azure, Google Cloud, Snowflake, Salesforce, Microsoft SQL Server, Oracle, PostgreSQL, MongoDB und Kafka.

Pros and Cons

Pros:

- Unterstützt komplexe Datenprozesse

- Vielseitige Bereitstellungsoptionen

- Starke API-Zugriffsfunktionen

Cons:

- Potentiell steile Lernkurve

- Erfordert technisches Fachwissen

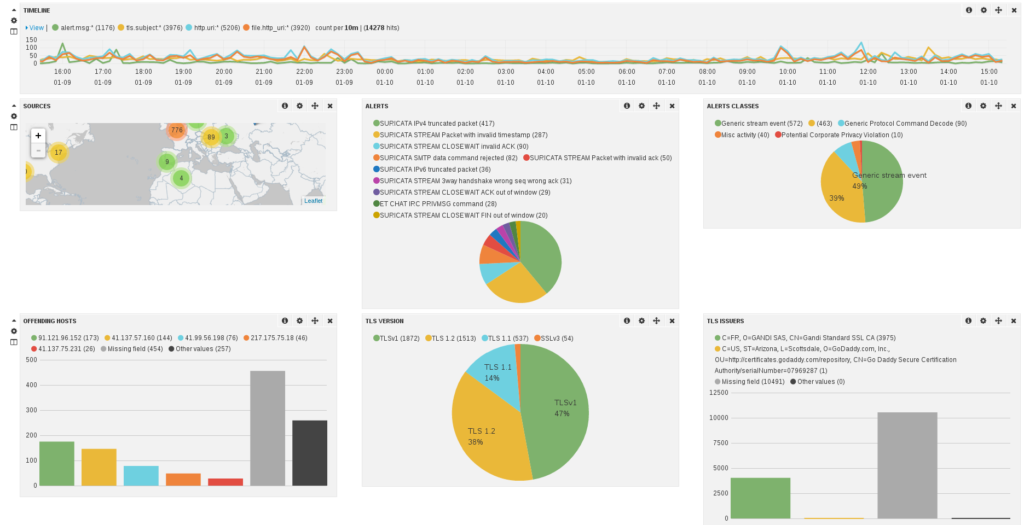

Logstash ist eine Open-Source-Datenverarbeitungspipeline, die es Entwicklern und IT-Teams ermöglicht, Logs aus verschiedenen Quellen zu sammeln, zu transformieren und zu speichern. Sie ist dafür konzipiert, große Mengen an Logdaten zu verarbeiten, was sie ideal für Organisationen macht, die ihre Protokollierungsinformationen zentralisieren und analysieren müssen.

Warum ich Logstash gewählt habe: Logstash glänzt bei der Verarbeitung von Logdaten und bietet eine flexible Pipeline-Architektur, mit der sich Logs aus mehreren Quellen aggregieren lassen. Das Tool stellt leistungsstarke Filter- und Transformationsfunktionen bereit, sodass Ihr Team die Daten an spezifische Anforderungen anpassen kann. Die Echtzeitverarbeitung von Logstash stellt sicher, dass Ihre Logdaten aktuell und verwertbar sind. Durch die Kompatibilität mit Elasticsearch und Kibana ist es eine hervorragende Wahl für alle, die bereits den Elastic Stack nutzen.

Hervorzuhebende Funktionen & Integrationen:

Funktionen umfassen eine flexible Pipeline-Architektur, die komplexe Datentransformationen unterstützt und es Ihnen ermöglicht, die Logverarbeitung individuell anzupassen. Die Echtzeitverarbeitungsfähigkeiten von Logstash stellen sicher, dass Ihre Logdaten stets aktuell sind. Das Tool bietet zudem robuste Filteroptionen, um die Daten nach Ihren spezifischen Anforderungen zu gestalten.

Integrationen umfassen Elasticsearch, Kibana, Beats, AWS, Azure, Google Cloud, Kafka, RabbitMQ, JDBC und Redis.

Pros and Cons

Pros:

- Verarbeitet große Logmengen

- Echtzeitdatenverarbeitung

- Flexible Pipeline-Architektur

Cons:

- Kann ressourcenintensiv sein

- Eingeschränkte integrierte Analysen

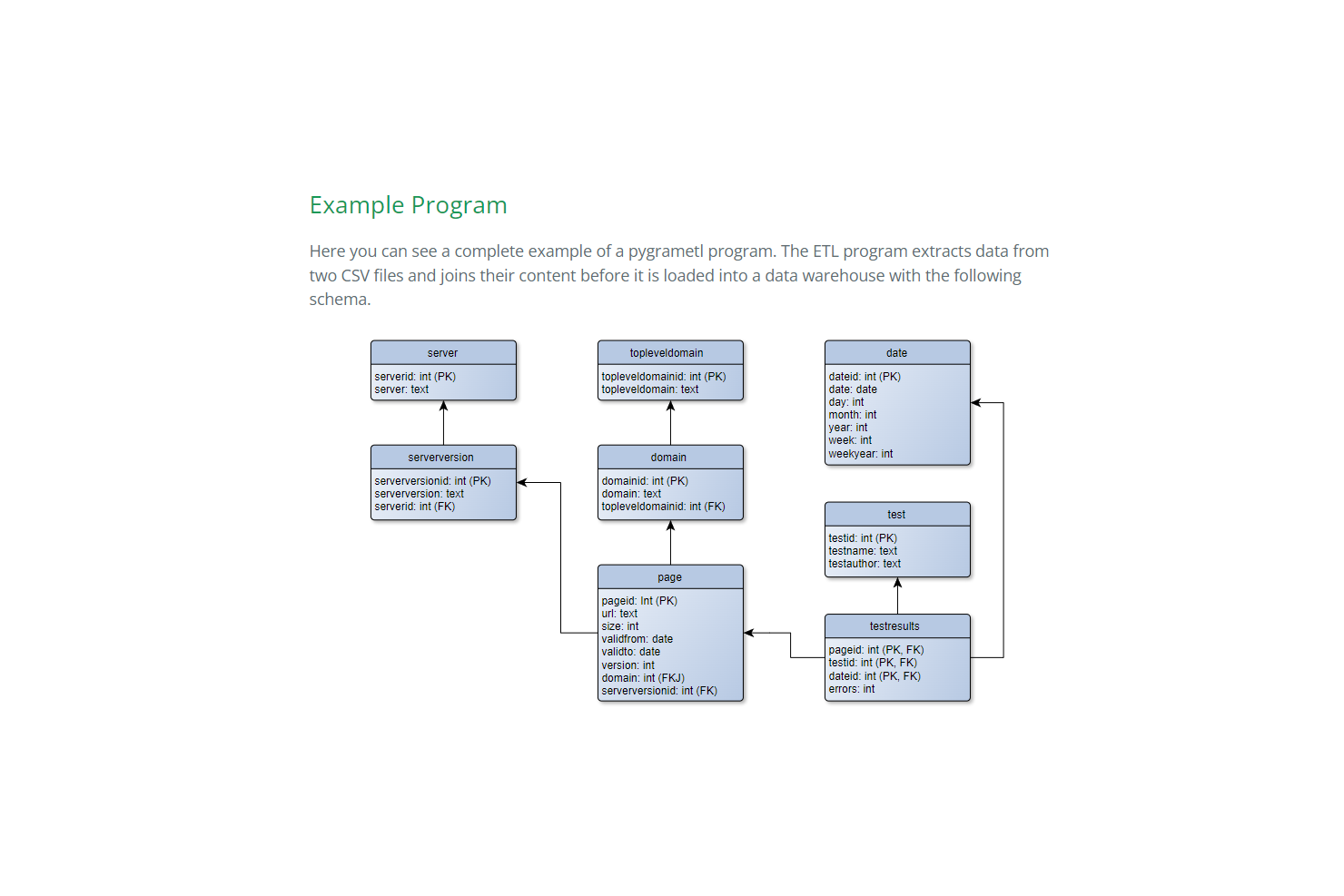

pygrametl ist ein Open-Source-Python-Framework zur Entwicklung von ETL-Prozessen. Es wurde als Alternative zu grafischen BI-Programmen konzipiert, bietet jedoch die gleiche Benutzerfreundlichkeit. Es unterstützt CPython und Jython und ermöglicht ETL-Entwicklern die Nutzung bestehender Java-Codes und JDBC-Treiber.

Entwickler können Daten aus zahlreichen in pygrametl verfügbaren Quellen extrahieren, wie z. B. SQL, CSV und Pandas. Benutzer können auch eigene Datenquellen definieren. Die Plattform bietet Filter und Aggregatoren zur Transformation von Daten. Standard-Aggregatoren sind AVG, Count, CountDistinct, Max, Min und Sum.

pygrametl kann transformierte Daten in jedes Data Warehouse laden, das dimensionales Modellieren unterstützt. Das System stellt Strukturen zur Definition von Faktentabellen und Dimensionen zur Verfügung, einschließlich langsam veränderlicher und 'snowflaked' Dimensionen.

Entwickler können pygrametl kostenlos herunterladen.

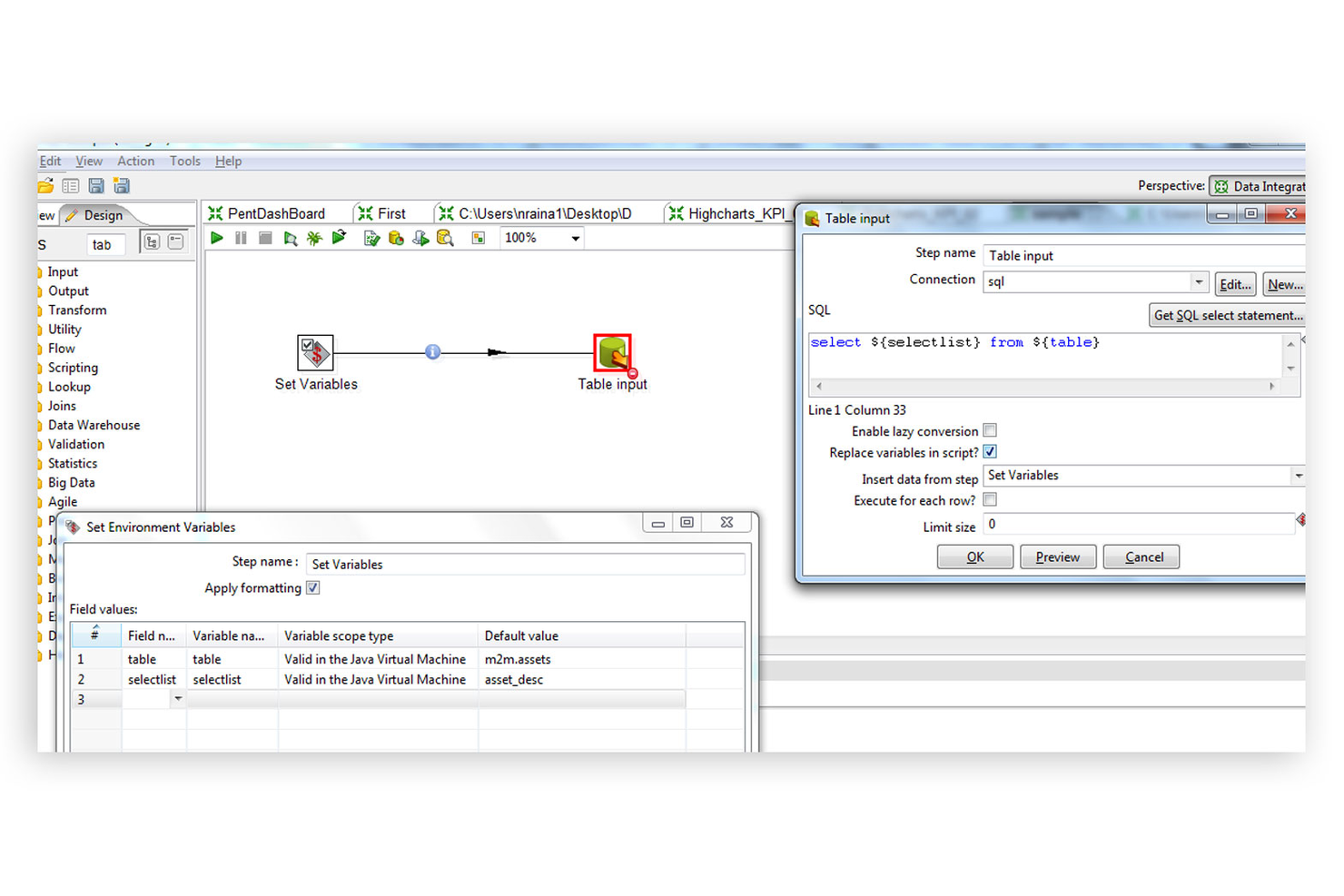

Pentaho Kettle ist ein Open-Source ETL-Tool, das sich an Dateningenieure und Business-Analysten richtet, die komplexe Datenumwandlungen durchführen müssen. Es bietet eine visuelle Oberfläche zum Entwerfen von Datenpipelines, wodurch die Verwaltung von Datenflüssen und die effiziente Ausführung von Transformationen erleichtert werden.

Warum ich Pentaho Kettle gewählt habe: Es ist bekannt für seine Fähigkeiten in der Datenumwandlung und bietet eine visuelle Drag-and-Drop-Oberfläche, die die Erstellung komplexer Workflows vereinfacht. Kettle unterstützt zahlreiche Datenquellen und stellt dadurch sicher, dass Ihr Team Daten aus verschiedenen Ursprüngen integrieren kann. Die grafische Oberfläche reduziert die Notwendigkeit umfangreicher Programmierkenntnisse, was für Teams mit begrenzter Programmiererfahrung vorteilhaft ist. Die Flexibilität des Tools im Umgang mit unterschiedlichen Datentypen und -formaten macht es zu einer vielseitigen Wahl für vielfältige Datenanforderungen.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen eine visuelle Drag-and-Drop-Oberfläche, die das Design von Workflows vereinfacht und es ermöglicht, komplexe Datenumwandlungen ohne Programmierung zu erstellen. Das Tool unterstützt eine breite Palette von Datenquellen, wodurch die Integration unkompliziert ist. Die Flexibilität von Kettle im Umgang mit mehreren Datentypen und -formaten gewährleistet die Kompatibilität mit unterschiedlichen Datenumgebungen.

Integrationen umfassen Oracle, MySQL, PostgreSQL, Microsoft SQL Server, MongoDB, Amazon Redshift, Google BigQuery, Salesforce, SAP und Hadoop.

Pros and Cons

Pros:

- Visuelle Oberfläche für Transformationen

- Verarbeitet unterschiedliche Datentypen

- Umfangreiche Unterstützung für Datenquellen

Cons:

- Kann ressourcenintensiv sein

- Komplexität bei der Erstinstallation

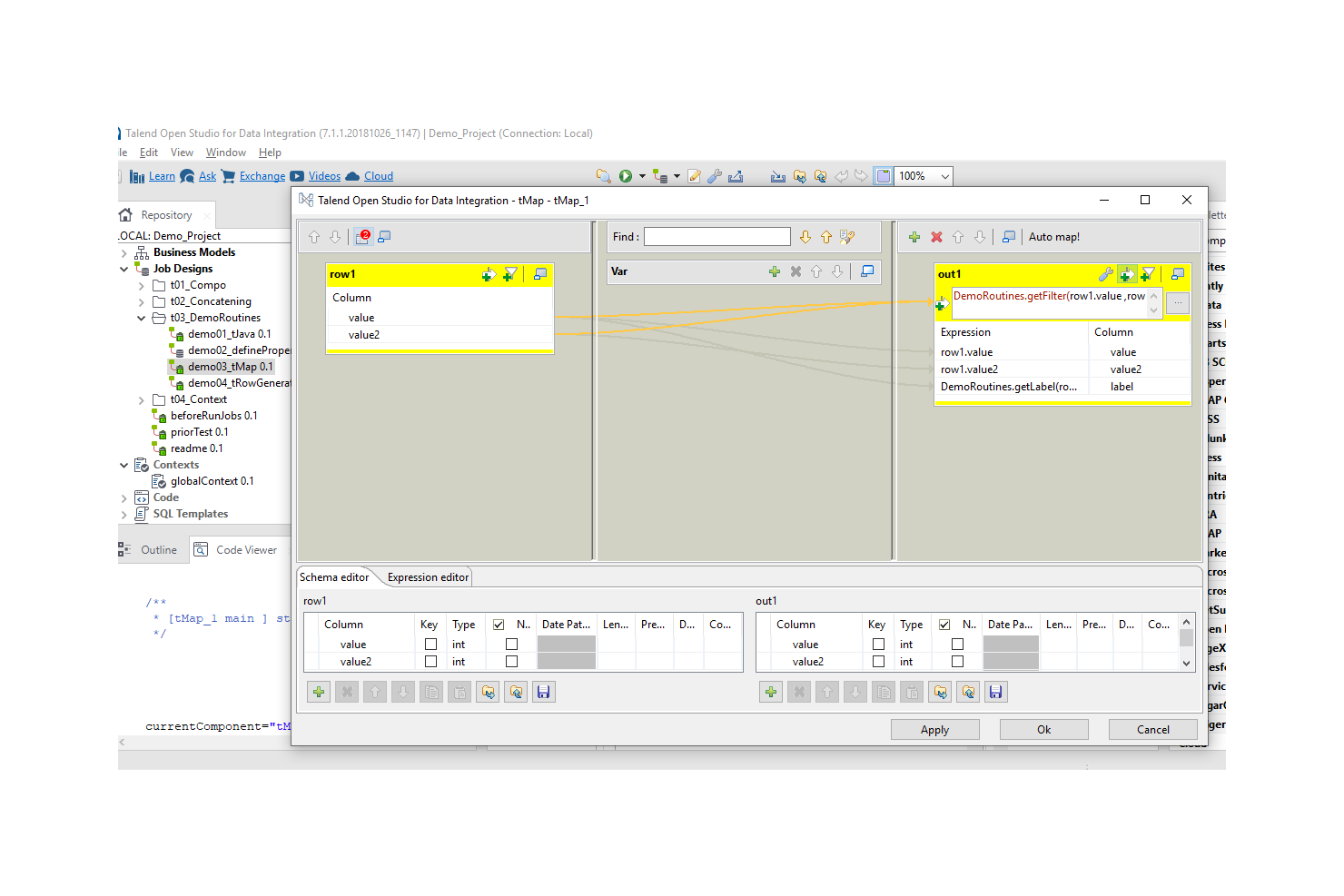

Talend Open Studio ist eine Suite von Open-Source-Tools, die ETL-Entwicklern ermöglicht, grundlegende Datenpipelines in kürzerer Zeit zu erstellen. Sie bietet eine auf Eclipse basierende Entwicklungsumgebung und mehr als 900 vorgefertigte Konnektoren, darunter Oracle, Teradata, Marketo und Microsoft SQL Server. Die Plattform umfasst fünf Komponenten: Talend Open Studio für Datenintegration, Big Data, Datenqualität, Enterprise Service Bus (ESB) und Master Data Management (MDM).

Talend Open Studio ist ein hervorragender Begleiter für viele Business-Intelligence-(BI)-Tools. Es bietet verschiedene Methoden, um mehrere Datensätze in Formate umzuwandeln, die mit gängigen BI-Plattformen wie Jasper, OLAP und SPSS kompatibel sind. Anwender können auch direkt in Talend Open Studio Erkenntnisse gewinnen, da es grundlegende Visualisierungen wie Balkendiagramme erstellen kann.

Talend Open Studio unterstützt Integrationen mit mehreren Datenbanken, darunter Microsoft SQL Server, Postgres, MySQL, Teradata und Greenplum.

Talend Open Studio ist für alle Nutzer kostenlos als Download verfügbar.

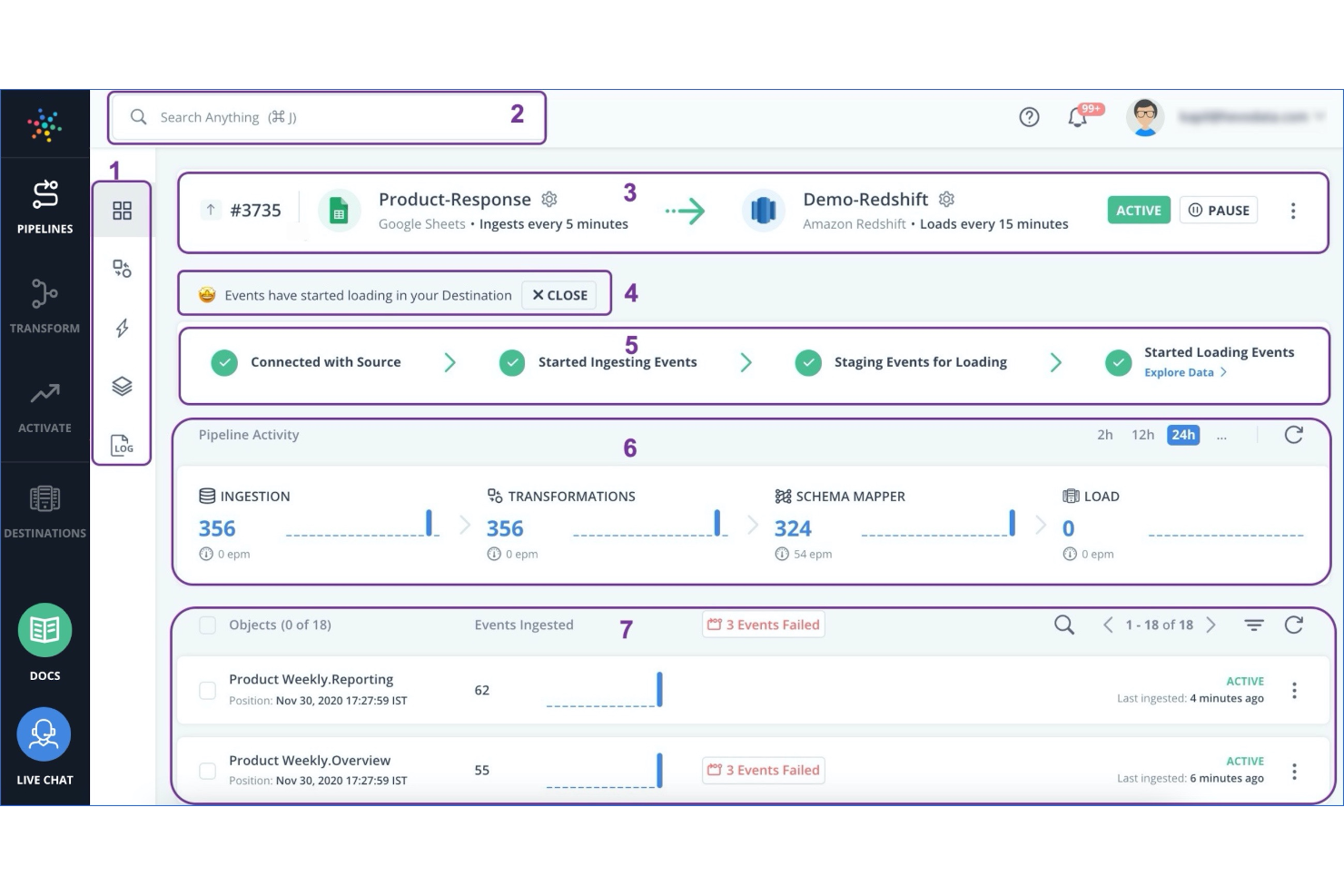

Hevo Data ist eine ETL- und Datenintegrationsplattform, die sich an Datenteams richtet, die zuverlässige und automatisierte Datenpipelines benötigen. Sie ermöglicht die Aufnahme von Daten aus verschiedenen Quellen mit minimalem Aufwand und ohne Programmierkenntnisse, wodurch die Datenqualität und Entscheidungsfindung verbessert werden.

Warum ich Hevo Data ausgewählt habe: Die Plattform überzeugt durch automatisierte Datenintegration, mit Funktionen wie Echtzeitüberwachung der Datenpipelines und Hochgeschwindigkeitsdatenreplikation, sodass Ihr Team immer mit minimalem Aufwand auf dem neuesten Stand bleibt. Die Compliance- und Sicherheitsfunktionen von Hevo sorgen für ein beruhigendes Gefühl, insbesondere bei Unternehmenskunden. Das transparente Preismodell bedeutet keine versteckten Kosten, was für die Budgetierung ein großer Vorteil ist. Die benutzerfreundliche Oberfläche ermöglicht das Datenmanagement ohne umfassende Programmierkenntnisse.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen die Echtzeitüberwachung der Pipelines, damit Ihre Daten stets aktuell sind, erweiterte Verwaltungsoptionen für mehr Kontrolle sowie Compliance- und Sicherheitsmerkmale zum Schutz sensibler Daten. Diese Funktionen ermöglichen Ihrem Team ein effizientes und sicheres Arbeiten. Hevo bietet außerdem eine Hochgeschwindigkeitsdatenreplikation, um die Konsistenz der Daten sicherzustellen.

Integrationen umfassen Salesforce, Google Analytics, Amazon Redshift, Snowflake, BigQuery, MySQL, PostgreSQL, Oracle, MS SQL Server und HubSpot.

Pros and Cons

Pros:

- Automatisierte Datenintegration

- Echtzeitüberwachung

- Hochgeschwindigkeitsreplikation

Cons:

- Begrenzte Anpassungsmöglichkeiten

- Nicht für alle Datentypen geeignet

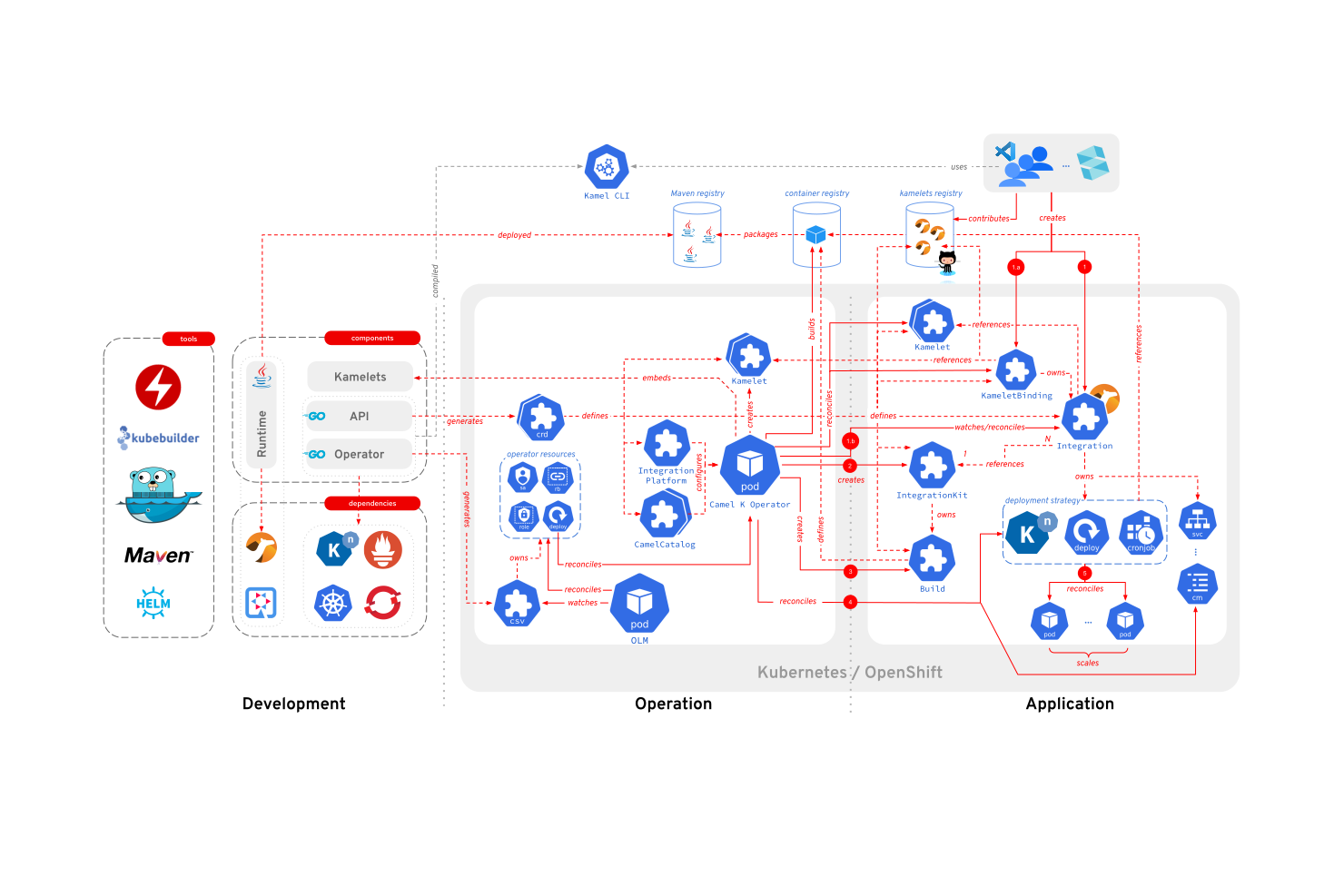

Apache Camel ist ein Open-Source-Integrationsframework, das für Entwickler und Architekten entwickelt wurde, die Unternehmensintegrationsmuster implementieren müssen. Es erleichtert das Routing und die Vermittlung von Nachrichten zwischen Systemen und ist somit ideal für komplexe Integrationsszenarien.

Warum ich Apache Camel gewählt habe: Es zeichnet sich durch die Nutzung von Integrationsmustern aus, um die Konnektivität zwischen verschiedenen Systemen zu vereinfachen. Camel unterstützt eine Vielzahl von Protokollen und Datenformaten, sodass Ihr Team problemlos unterschiedliche Systeme verbinden kann. Die domänenspezifische Sprache (DSL) von Camel bietet eine flexible Möglichkeit, Routing- und Vermittlungsregeln zu definieren – entscheidend für das Management komplexer Integrationen. Die Fähigkeit des Tools, mit diversen Endpunkten zu integrieren, bietet eine beispiellose Vielseitigkeit beim Entwurf von Integrationslösungen.

Herausragende Funktionen & Integrationen:

Funktionen umfassen eine breite Palette von Unternehmensintegrationsmustern, die den Integrationsprozess vereinfachen. Die domänenspezifische Sprache des Tools ermöglicht es, komplexe Routing-Regeln einfach zu definieren. Apache Camel unterstützt außerdem zahlreiche Datenformate und Protokolle, was die Kompatibilität mit verschiedenen Systemen sicherstellt.

Integrationen beinhalten AWS, Apache Kafka, ActiveMQ, RabbitMQ, Salesforce, Google Cloud, Azure, JMS, File und FTP.

Pros and Cons

Pros:

- Umfassende Integrationsmuster

- Breite Unterstützung von Datenformaten

- Vielseitige Endpunktintegration

Cons:

- Dokumentation kann lückenhaft sein

- Ressourcenintensiv bei großen Umgebungen

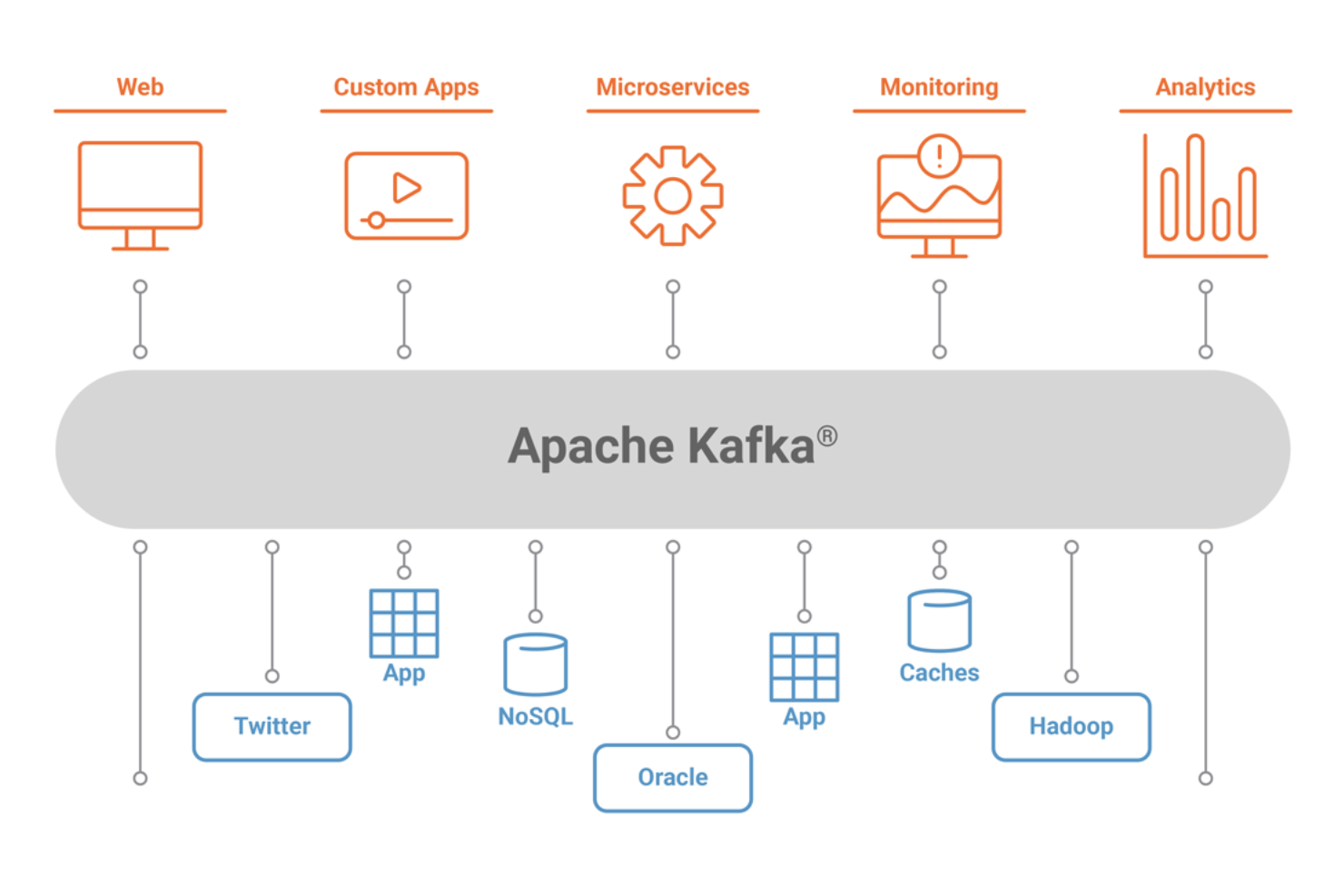

Apache Kafka ist eine verteilte Event-Streaming-Plattform, die von Entwicklern und Unternehmen genutzt wird, um Echtzeit-Datenpipelines und Streaming-Anwendungen zu erstellen. Sie ist darauf ausgelegt, große Datenmengen schnell und effizient zu verarbeiten, was sie ideal für Unternehmen macht, die eine Echtzeit-Datenverarbeitung benötigen.

Warum ich Apache Kafka ausgewählt habe: Es ist speziell für das Echtzeit-Streaming von Daten konzipiert und unterstützt eine hohe Durchsatzrate sowie eine geringe Latenz – beides ist für moderne, datengetriebene Anwendungen unerlässlich. Die verteilte Architektur von Kafka gewährleistet hohe Verfügbarkeit und Ausfallsicherheit, sodass Ihre Daten stets zugänglich sind. Die Plattform ist skalierbar, sodass Sie wachsende Datenmengen bewältigen können, ohne die Leistung zu beeinträchtigen. Zudem bietet Kafka starke Garantien zur Dauerhaftigkeit, was die Integrität Ihrer Daten im Zeitverlauf gewährleistet.

Herausragende Funktionen & Integrationen:

Funktionen umfassen eine verteilte Architektur, die hohe Verfügbarkeit sicherstellt, eingebaute Datenreplikation für Ausfallsicherheit und ein robustes Messaging-System für skalierbare Datenverarbeitung. Diese Eigenschaften erlauben eine effiziente Verarbeitung großer Datenmengen. Das auf Protokollen basierende Speichersystem von Kafka gewährleistet Datenhaltbarkeit und Zuverlässigkeit.

Integrationen umfassen Confluent, AWS, Azure, Google Cloud, MongoDB, Cassandra, Elasticsearch, Splunk, Hadoop und MySQL.

Pros and Cons

Pros:

- Verarbeitet große Datenmengen mit hohem Durchsatz

- Geringe Latenz bei der Verarbeitung

- Hohe Datenhaltbarkeit

Cons:

- Begrenztes integriertes Monitoring

- Konfiguration kann herausfordernd sein

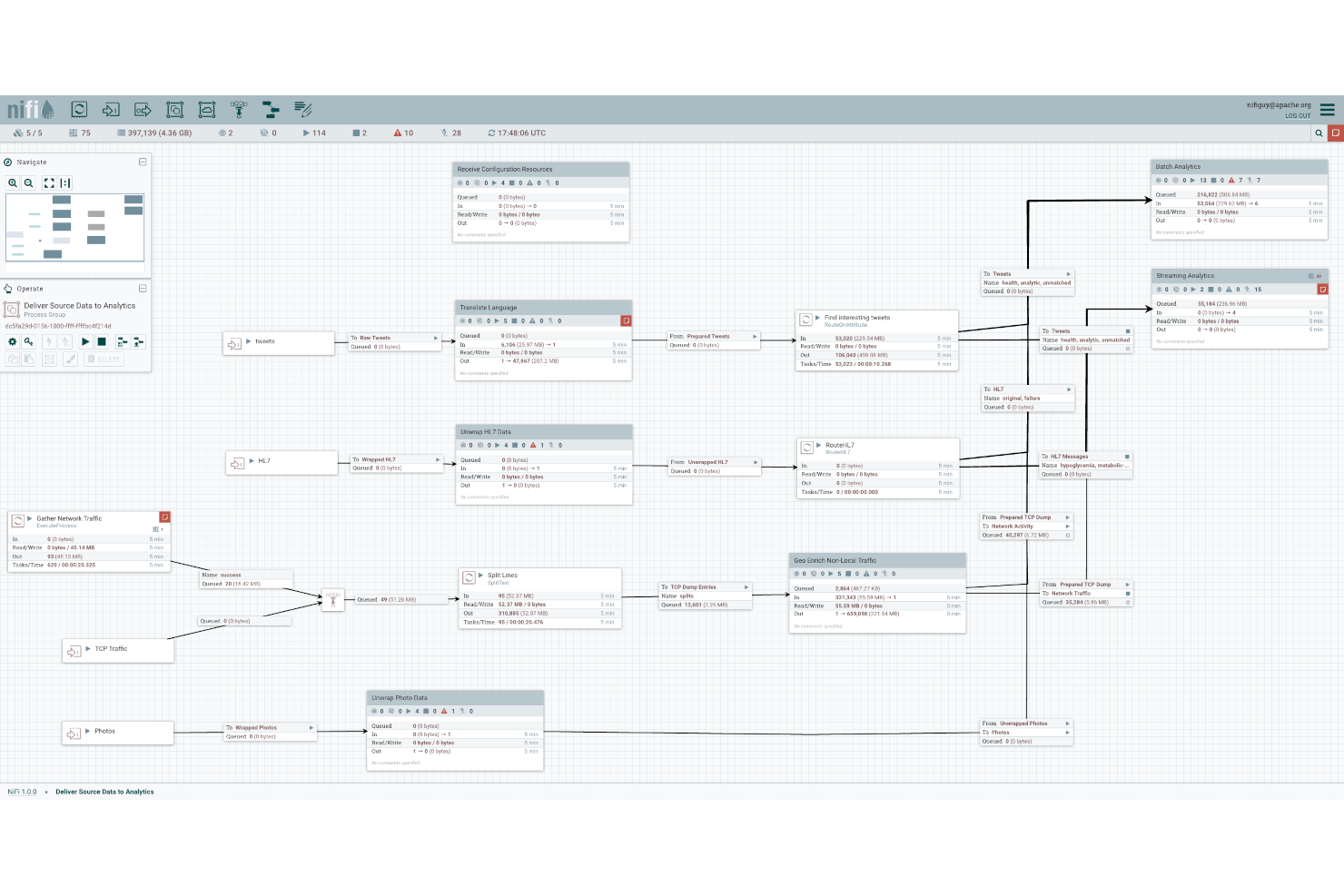

Apache NiFi ist ein Open-Source-Datenintegrationswerkzeug, das für Entwickler und Data Engineers entwickelt wurde, die Datenflüsse automatisieren möchten. Es ermöglicht das Sammeln, Verarbeiten und Verteilen von Daten über verschiedene Systeme hinweg und eignet sich daher ideal für die Verarbeitung von Echtzeitdaten.

Warum ich Apache NiFi gewählt habe: Es ist speziell für die Automatisierung von Datenflüssen konzipiert und bietet eine benutzerfreundliche Oberfläche zur Gestaltung komplexer Workflows. Die Drag-and-Drop-Oberfläche von NiFi vereinfacht die Erstellung von Datenpipelines, was besonders für Teams ohne umfassende Programmierkenntnisse wichtig ist. Das Tool unterstützt das Management von Echtzeit-Datenflüssen und stellt sicher, dass Ihre Daten stets aktuell und relevant sind. Die integrierten Sicherheitsfunktionen bieten zusätzlichen Schutz für sensible Daten.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen eine Drag-and-Drop-Oberfläche, die die Workflow-Gestaltung vereinfacht und es ermöglicht, Datenpipelines mühelos zu erstellen. Das Echtzeit-Management der Datenflüsse durch NiFi gewährleistet, dass Ihre Daten immer auf dem neuesten Stand sind. Zudem bietet das Tool integrierte Sicherheitsfunktionen zum Schutz sensibler Informationen.

Integrationen umfassen AWS, Azure, Google Cloud, Kafka, HDFS, MongoDB, Elasticsearch, MySQL, PostgreSQL und JMS.

Pros and Cons

Pros:

- Automatisiert Datenflüsse effizient

- Benutzerfreundliche Drag-and-Drop-Oberfläche

- Echtzeit-Datenmanagement

Cons:

- Kann ressourcenintensiv sein

- Komplexität bei der Ersteinrichtung

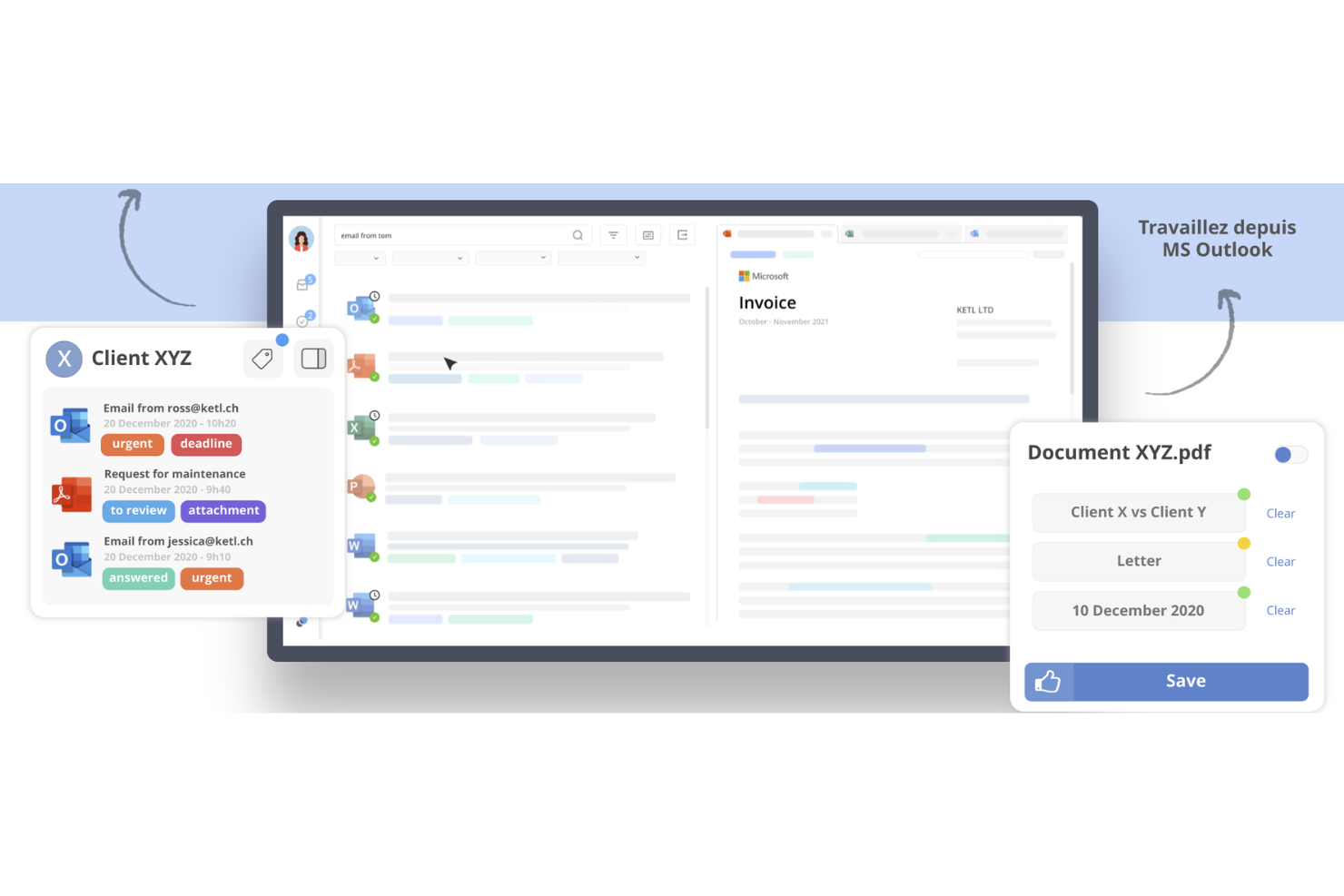

KETL ist eine Open-Source-ETL-Plattform, die für Data Engineers und IT-Profis entwickelt wurde, die skalierbare Datenintegration und Planungsfunktionen benötigen. Sie bietet eine multithreadbasierte, XML-basierte Architektur, die komplexe Datenmanipulationen unterstützt und sich somit für umfangreiche Datenverarbeitungsaufgaben eignet.

Warum ich KETL gewählt habe: Es bietet skalierbare ETL-Lösungen durch die Möglichkeit, große Datenmengen über mehrere Server und CPUs hinweg zu verarbeiten. Der Ausführungs- und Zeitplanungsmanager der Plattform gewährleistet ein effizientes Workflow-Management, das für groß angelegte Abläufe entscheidend ist. Das zentrale Repository für Job-Definitionen hilft dabei, Organisation und Kontrolle über Datenprozesse zu bewahren. Zusätzlich ermöglichen KETLs Leistungsüberwachungsfunktionen Ihrem Team, Datenworkflows effektiv zu verfolgen und zu optimieren.

Herausragende Funktionen & Integrationen:

Funktionen umfassen eine multithreadbasierte Architektur, die Skalierbarkeit und Leistung verbessert. KETL unterstützt eine breite Palette an Job-Typen, darunter SQL, OS und XML, was Flexibilität bei der Verarbeitung unterschiedlicher Datenformate bietet. Das zentrale Repository für Job-Definitionen hilft dabei, das Workflow-Management zu optimieren und Konsistenz sicherzustellen.

Integrationen umfassen Oracle, MySQL, PostgreSQL, Microsoft SQL Server, MongoDB, Amazon Redshift, Google BigQuery, Salesforce, SAP und Hadoop.

Pros and Cons

Pros:

- Skalierbar über mehrere Server hinweg

- Unterstützt komplexe Datenmanipulation

- Zentrales Job-Repository

Cons:

- Begrenzte Community-Unterstützung

- Dokumentation kann lückenhaft sein

Weitere Open Source ETL Tools

Hier sind weitere Open Source ETL Tools, die es nicht auf meine Shortlist geschafft haben, aber dennoch einen Blick wert sind:

- Singer

Am besten für Datenextraktionsskripte geeignet

- Scriptella

Am besten geeignet für einfache ETL-Skripterstellung

- Bubbles

Python ETL-Framework zur Verarbeitung, Überprüfung und Inspektion von Daten

Kriterien zur Auswahl von Open Source ETL Tools

Für die Auswahl der besten Open Source ETL Tools in dieser Liste habe ich die typischen Bedürfnisse und Herausforderungen von Käufern berücksichtigt, wie zum Beispiel Komplexität und Skalierbarkeit von Data Integration Tools. Außerdem habe ich folgendes Bewertungsframework verwendet, um die Bewertung strukturiert und fair zu gestalten:

Kernfunktionalität (25 % der Gesamtbewertung)

Um in diese Liste aufgenommen zu werden, musste jede Lösung folgende typische Anwendungsfälle abdecken:

- Datenextraktion aus mehreren Quellen

- Datentransformation und Bereinigung

- Datenladen in Zielsysteme

- Echtzeit-Datenverarbeitung

- Batch-Datenverarbeitung

Zusätzliche herausragende Funktionen (25 % der Gesamtbewertung)

Um die Auswahl weiter einzugrenzen, habe ich zudem nach besonderen Merkmalen gesucht, wie zum Beispiel:

- Unterstützung für komplexe Daten-Workflows

- Erweiterte Datenschutzfunktionen

- Integration mit Cloud-Diensten

- Anpassbare Datenkonnektoren

- Automatisierte Fehlerbehandlung

Benutzerfreundlichkeit (10 % der Gesamtbewertung)

Um einen Eindruck von der Benutzerfreundlichkeit jedes Systems zu bekommen, habe ich Folgendes berücksichtigt:

- Intuitive Benutzeroberfläche

- Einfache Navigation

- Geringe Lernkurve

- Klare Dokumentation

- Responsives Design

Onboarding (10 % der Gesamtbewertung)

Um die Onboarding-Erfahrung für jede Plattform einzuschätzen, habe ich folgende Aspekte betrachtet:

- Verfügbarkeit von Trainingsvideos

- Interaktive Produkttouren

- Zugriff auf Vorlagen

- Live-Webinare zur Anleitung

- Hilfreiche Chatbots

Kundensupport (10 % der Gesamtbewertung)

Um die Supportdienste der jeweiligen Softwareanbieter zu beurteilen, habe ich folgende Kriterien herangezogen:

- 24/7 Verfügbarkeit

- Mehrere Supportkanäle

- Schneller Helpdesk

- Umfassende FAQs

- Zugang zu Community-Foren

Preis-Leistungs-Verhältnis (10 % der Gesamtbewertung)

Um das Preis-Leistungs-Verhältnis jeder Plattform zu beurteilen, habe ich folgende Faktoren betrachtet:

- Wettbewerbsfähige Preisstufen

- Verfügbarkeit einer kostenlosen Testphase

- Kosten im Verhältnis zum Funktionsumfang

- Skalierbarkeit der Preismodelle

- Rabatte für Langzeitanwender

Kundenrezensionen (10 % der Gesamtbewertung)

Um einen Eindruck der allgemeinen Kundenzufriedenheit zu gewinnen, habe ich beim Lesen von Rezensionen auf Folgendes geachtet:

- Positives Nutzer-Feedback

- Häufig berichtete Probleme

- Konsistenz der Funktionsleistung

- Allgemeine Zufriedenheitsbewertungen

- Trends bei Nutzerbeschwerden

So wählen Sie Open-Source-ETL-Tools aus

Es ist leicht, sich in langen Funktionslisten und komplexen Preisstrukturen zu verlieren. Damit Sie bei der Auswahl Ihrer individuellen Software nicht den Fokus verlieren, finden Sie hier eine Checkliste mit wichtigen Faktoren, die Sie im Hinterkopf behalten sollten:

| Faktor | Worauf achten? |

| Skalierbarkeit | Stellen Sie sicher, dass das Tool auch mit wachsendem Datenvolumen umgehen kann. Denken Sie an künftige Anforderungen und daran, ob das Tool sowohl Batch- als auch Echtzeitverarbeitung effizient unterstützt. |

| Integrationen | Prüfen Sie, ob das Tool sich mit Ihren vorhandenen Systemen und Datenquellen wie Datenbanken, Cloud-Diensten und Drittanbieteranwendungen integrieren lässt, um Arbeitsabläufe zu optimieren. |

| Anpassungsfähigkeit | Achten Sie darauf, dass Sie Daten-Workflows individuell an Ihre Abläufe anpassen können. Je anpassungsfähiger das Tool, desto besser kann es sich verändernden Anforderungen anpassen. |

| Benutzerfreundlichkeit | Bewerten Sie die Benutzeroberfläche. Ein Tool, das einfach zu bedienen ist, senkt die Lernkurve für Ihr Team und beschleunigt die Einführung. |

| Budget | Vergleichen Sie die Preise mit Ihrem Budget. Berücksichtigen Sie die Gesamtkosten, einschließlich versteckter Ausgaben, um sicherzustellen, dass das Tool zu Ihren finanziellen Rahmenbedingungen passt. |

| Sicherheitsfunktionen | Stellen Sie sicher, dass das Tool über umfassende Sicherheitsfunktionen zum Schutz sensibler Daten verfügt. Achten Sie auf Verschlüsselung, Benutzerzugriffskontrollen und Einhaltung von Vorschriften. |

| Support | Prüfen Sie die Erreichbarkeit des Kundensupports. Reaktionsschneller Support ist besonders bei der Einführung und im Fehlerfall wichtig. |

| Leistung | Bewerten Sie die Verarbeitungsgeschwindigkeit und Zuverlässigkeit des Tools. Es sollte Daten zuverlässig und rechtzeitig fehlerfrei liefern, um Ihren Geschäftsbetrieb zu unterstützen. |

Trends bei Open-Source-ETL-Tools

In meinen Recherchen habe ich zahllose Produktupdates, Pressemeldungen und Release-Logs verschiedener Open-Source-ETL-Anbieter ausgewertet. Hier sind einige der aufkommenden Trends, die ich besonders im Auge behalte:

- Echtzeitverarbeitung: Immer mehr Tools konzentrieren sich auf die Verarbeitung von Daten in Echtzeit, sodass Unternehmen schnell auf Veränderungen reagieren und fundierte Entscheidungen treffen können. Apache Kafka zum Beispiel hat seine Streaming-Funktionen erweitert, um Echtzeitanalysen zu unterstützen.

- Datenbeobachtbarkeit: Anbieter fügen Funktionen hinzu, um die Sichtbarkeit und Überwachung von Daten zu verbessern, damit Teams Probleme schneller erkennen und beheben können. Tools wie Apache NiFi bieten jetzt erweiterte Funktionen zur Datenverfolgung und -herkunft, um die Datenintegrität zu gewährleisten.

- Cloud-native Architektur: Mit dem Wechsel zum Cloud Computing werden ETL-Tools so entwickelt, dass sie Cloud-Ressourcen effizient nutzen. Talend Open Studio bietet beispielsweise cloud-native Funktionen, um Leistung und Skalierbarkeit zu optimieren.

- Low-Code-Oberflächen: Die Nachfrage nach Low-Code- oder No-Code-Plattformen, die ETL-Tools auch für nicht-technische Nutzer zugänglich machen, steigt. Tools wie Pentaho Kettle setzen zunehmend auf visuelle Oberflächen, um die Erstellung von Datenpipelines zu vereinfachen.

- Data Governance: Mit den strengeren Datenschutzvorschriften integrieren ETL-Tools immer mehr Funktionen zur Datensteuerung. Dazu gehören beispielsweise Optionen für Datenmaskierung und Verschlüsselung, die in Lösungen wie Hevo Data mittlerweile zum Standard gehören, um die Einhaltung von Vorschriften sowie eine sichere Datenverarbeitung zu gewährleisten.

Was sind Open-Source-ETL-Tools?

Open-Source-ETL-Tools unterstützen die Extraktion, Transformation und das Laden von Daten aus verschiedenen Quellen an einen zentralen Ort. Dateningenieure, Analysten und IT-Fachkräfte verwenden diese Tools in der Regel, um große Datenmengen effizient zu verwalten und zu verarbeiten.

Echtzeitverarbeitung, Datenbeobachtbarkeit und cloud-native Fähigkeiten fördern schnelle Entscheidungsfindung, eine zügige Behebung von Problemen und einen effizienten Ressourceneinsatz. Insgesamt bieten diese Tools die erforderliche Flexibilität und Skalierbarkeit, um komplexe Daten-Workflows zu bewältigen und datenbasierte Strategien zu unterstützen. Um Zuverlässigkeit im großen Maßstab zu gewährleisten, sollten Teams ihre ETL-Tools mit leistungsstarken ETL-Testautomatisierungstools ergänzen.

Funktionen von Open-Source-ETL-Tools

Achten Sie bei der Auswahl von Open-Source-ETL-Tools auf die folgenden Schlüsselfunktionen:

- Echtzeitverarbeitung: Verarbeitet Daten sofort bei Eingang und unterstützt Sie so bei rechtzeitigen Entscheidungen und schnellen Reaktionen auf Veränderungen.

- Datenbeobachtbarkeit: Ermöglicht Einblicke in Datenflüsse, damit Sie diese überwachen und Probleme zügig beheben können.

- Cloud-native Architektur: Nutzt Cloud-Ressourcen effizient, um Skalierbarkeit und Leistungsfähigkeit zu erhöhen.

- Low-Code-Oberflächen: Vereinfachen die Erstellung von Datenpipelines und machen Tools für nicht-technische Nutzer zugänglich.

- Data Governance: Sichert Compliance und Schutz durch Funktionen wie Datenmaskierung und Verschlüsselung.

- Multi-Source-Integration: Verbindet sich mit verschiedenen Datenquellen, um die Datenverarbeitung zu zentralisieren und zu optimieren.

- Skalierbarkeit: Bewältigt wachsende Datenmengen und unterstützt sowohl Batch- als auch Echtzeitverarbeitung.

- Anpassbarkeit: Ermöglicht die individuelle Gestaltung von Daten-Workflows, um spezifischen Geschäftsanforderungen und Prozessen zu entsprechen.

- Leistungsüberwachung: Überwacht und optimiert Daten-Workflows, um Effizienz und Genauigkeit zu erhalten.

- Planungsmanager: Automatisiert die Ausführung von Aufgaben und steuert Workflows zur Steigerung der Produktivität.

Vorteile von Open-Source-ETL-Tools

Die Implementierung von Open-Source-ETL-Tools bringt für Ihr Team und Ihr Unternehmen zahlreiche Vorteile. Auf einige können Sie sich freuen:

- Kosteneffizienz: Als Open-Source-Software fallen oft keine Lizenzgebühren an, was die Gesamtkosten für Ihr Unternehmen senkt.

- Flexibilität: Anpassbare Workflows ermöglichen es Ihnen, Datenprozesse genau auf Ihre Bedürfnisse zuzuschneiden und diese bei Bedarf weiterzuentwickeln.

- Skalierbarkeit: Unterstützt sowohl Batch- als auch Echtzeitverarbeitung, sodass Ihr Unternehmen wachsende Datenmengen bewältigen kann, ohne auf Leistung zu verzichten.

- Verbesserte Entscheidungsfindung: Dank Echtzeit-Datenverarbeitung steht Ihrem Team stets aktuelle Information zur Verfügung, was rechtzeitige und fundierte Entscheidungen ermöglicht.

- Verbesserte Datenqualität: Funktionen wie Datenbeobachtbarkeit und -steuerung helfen, Datenqualität und Compliance zu gewährleisten – und stärken das Vertrauen in Ihre Daten.

- Community-Support: Hinter diesen Tools steht häufig eine starke Entwickler-Community, die mit Ressourcen und gemeinsamem Wissen bei der Problemlösung und Weiterentwicklung unterstützt.

- Integrationsfähigkeit: Lässt sich problemlos mit verschiedenen Datenquellen und Systemen verbinden und vereinfacht so das Datenmanagement im gesamten Unternehmen.

Kosten und Preise von Open-Source-ETL-Tools

Die Auswahl von Open-Source-ETL-Tools erfordert ein Verständnis der verschiedenen verfügbaren Preismodelle und Tarife. Die Kosten variieren je nach Funktionsumfang, Teamgröße, Zusatzfunktionen und mehr. Die folgende Tabelle fasst gängige Pläne, deren durchschnittliche Preise und typische Merkmale bei Open-Source-ETL-Tools-Lösungen zusammen:

Vergleichstabelle der Tarife für Open-Source-ETL-Tools

| Tariftyp | Durchschnittspreis | Häufige Funktionen |

| Gratis-Tarif | $0 | Grundlegende Datenextraktion, eingeschränkte Integrationen und Community-Support. |

| Persönlicher Tarif | $5-$25/user/month | Erweiterte Datenumwandlungen, persönlicher Support und eingeschränkte Anpassungsmöglichkeiten. |

| Geschäftstarif | $50-$100/user/month | Fortschrittliche Datenverarbeitung, mehrere Integrationen und Team-Kollaborationstools. |

| Unternehmenstarif | $100-$500/user/month | Volle Anpassbarkeit, Support auf Unternehmensebene und umfassende Sicherheitsfunktionen. |

Open-Source-ETL-Tools (FAQs)

Hier sind einige Antworten auf häufig gestellte Fragen zu Open-Source-ETL-Tools:

Was sind die Einschränkungen von ETL-Tools?

ETL-Tools speichern Daten häufig nicht dauerhaft, weshalb zusätzliche Speicherlösungen erforderlich sind. Außerdem kann es zu Datenlatenzen kommen, sodass Daten verzögert verfügbar sind. Die Einarbeitung kann anspruchsvoll sein, und die Skalierung auf große Datenmengen erfordert oft zusätzliche Ressourcen. Zudem sind ETL-Tools häufig weniger geeignet für unstrukturierte Daten.

Welches Open-Source-ETL-Tool ist das beste?

Das beste Open-Source-ETL-Tool hängt von den eigenen Anforderungen ab. Tools wie Apache NiFi eignen sich hervorragend für Echtzeit-Datenflüsse, während Talend Open Studio besonders gut für umfassende Datenintegration ist. Berücksichtigen Sie Erfahrung Ihres Teams, Komplexität der Daten und Integrationsbedarf bei der Auswahl.

In welche Formate können fortschrittliche ETL-Tools strukturierte und unstrukturierte Daten laden und konvertieren?

Fortschrittliche ETL-Tools können sowohl strukturierte als auch unstrukturierte Daten in Formate konvertieren, die mit Systemen wie Hadoop kompatibel sind. Sie verarbeiten mehrere Dateien parallel und vereinfachen so das Zusammenführen unterschiedlichster Daten zu einem einheitlichen Transformationsprozess.

Was ist der Unterschied zwischen API- und ETL-Tools?

APIs eignen sich ideal zum Austausch von Daten in Echtzeit und zur Kommunikation zwischen Anwendungen. Im Gegensatz dazu sind ETL-Tools besser geeignet für Batch-Verarbeitung, bei der Daten aus verschiedenen Quellen zusammengeführt, transformiert und zur Analyse in ein Zielsystem überführt werden.

Wie stellen ETL-Tools die Datensicherheit sicher?

ETL-Tools gewährleisten Datensicherheit durch Verschlüsselung, Zugriffskontrollen und Compliance-Maßnahmen. Sie sorgen dafür, dass sensible Daten während Extraktion, Transformation und Laden geschützt sind. Manche Lösungen bieten zudem integrierte Audit-Funktionen zur Nachverfolgung von Zugriffen und Änderungen an den Daten.

Können ETL-Tools mit Cloud-Diensten integriert werden?

Ja, viele ETL-Tools integrieren sich nahtlos mit Cloud-Diensten. Sie unterstützen die Übertragung von Daten zu und von Cloud-Plattformen wie AWS, Google Cloud und Azure, sodass Sie die Möglichkeiten der Cloud-Speicherung und -Verarbeitung für Ihre Daten-Workflows nutzen können.

Wie geht es weiter?

Steigern Sie Ihr SaaS-Wachstum und Ihre Führungsqualitäten. Abonnieren Sie unseren Newsletter für die neuesten Einblicke von CTOs und ambitionierten Tech-Führungskräften.

Wir helfen Ihnen dabei, intelligenter zu skalieren und stärker zu führen – mit Ratgebern, Ressourcen und Strategien von Top-Expert:innen!