Meilleurs logiciels Data Fabric

Le meilleur logiciel data fabric aide les équipes à connecter et gérer des données provenant de différents systèmes sans dépendre d'intégrations manuelles complexes. Ces outils unifient les données structurées et non structurées, offrant aux organisations un accès cohérent à des informations fiables à travers les environnements.

Les équipes se tournent souvent vers des solutions data fabric lorsqu'elles font face à une récupération de données lente, à des sources cloisonnées, ou à des exigences de gouvernance complexes qui rendent difficile l'obtention d'une vue complète de leurs opérations. Sans vision connectée, les pipelines analytiques se dégradent, et les décisions se basent sur des données incomplètes ou obsolètes.

J’ai accompagné des entreprises dans la mise en œuvre d’architectures data fabric pour moderniser des systèmes hérités et permettre un accès plus rapide et plus fiable à l’intelligence d’affaires. Grâce à cette expérience, j’ai pu évaluer la manière dont ces plateformes gèrent le traitement des données en temps réel, la gestion des métadonnées et l’application de la sécurité à grande échelle.

Ce guide présente les meilleurs outils data fabric qui simplifient l’intégration, améliorent la visibilité des données et soutiennent des analyses évolutives pour les organisations modernes.

Table of Contents

Why Trust Our Software Reviews

We’ve been testing and reviewing software since 2023. As tech leaders ourselves, we know how critical and difficult it is to make the right decision when selecting software.

We invest in deep research to help our audience make better software purchasing decisions. We’ve tested more than 2,000 tools for different tech use cases and written over 1,000 comprehensive software reviews. Learn how we stay transparent & our software review methodology.

Résumé des meilleurs logiciels Data Fabric

Ce tableau comparatif résume les informations tarifaires de mes principaux choix de logiciels data fabric pour vous aider à trouver le meilleur selon votre budget et vos besoins professionnels.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Meilleur pour les capacités de recherche et d'analyse | Not available | À partir de 16 $/utilisateur/mois (facturé annuellement). | Website | |

| 2 | Meilleure pour l’intégration de données enrichie par l’IA | Essai gratuit disponible | Tarification sur demande. | Website | |

| 3 | Idéal pour les services de données cloud | Not available | Tarification sur demande. | Website | |

| 4 | Idéal pour la gestion d'Apache Airflow | Not available | Tarification sur demande. | Website | |

| 5 | Meilleur pour la virtualisation des données en temps réel | Not available | Tarification sur demande. | Website | |

| 6 | Idéal pour la gestion des données opérationnelles | Not available | Tarification sur demande. | Website | |

| 7 | Idéale pour la cartographie directe des données | Démo gratuite disponible | Tarification sur demande. | Website | |

| 8 | Idéal pour la synchronisation automatisée des données | Not available | Tarification sur demande. | Website | |

| 9 | Idéal pour le partage collaboratif des données | Not available | Tarification sur demande. | Website | |

| 10 | Idéal pour la connectivité et la préparation des données | Not available | Tarification sur demande. | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Avis sur les meilleurs logiciels Data Fabric

Vous trouverez ci-dessous mes analyses détaillées des meilleurs logiciels data fabric qui ont intégré ma sélection. Mes avis donnent un aperçu approfondi des fonctionnalités clés, des avantages et inconvénients, des intégrations et des cas d’usage idéaux de chaque outil pour vous aider à choisir le plus adapté à vos besoins.

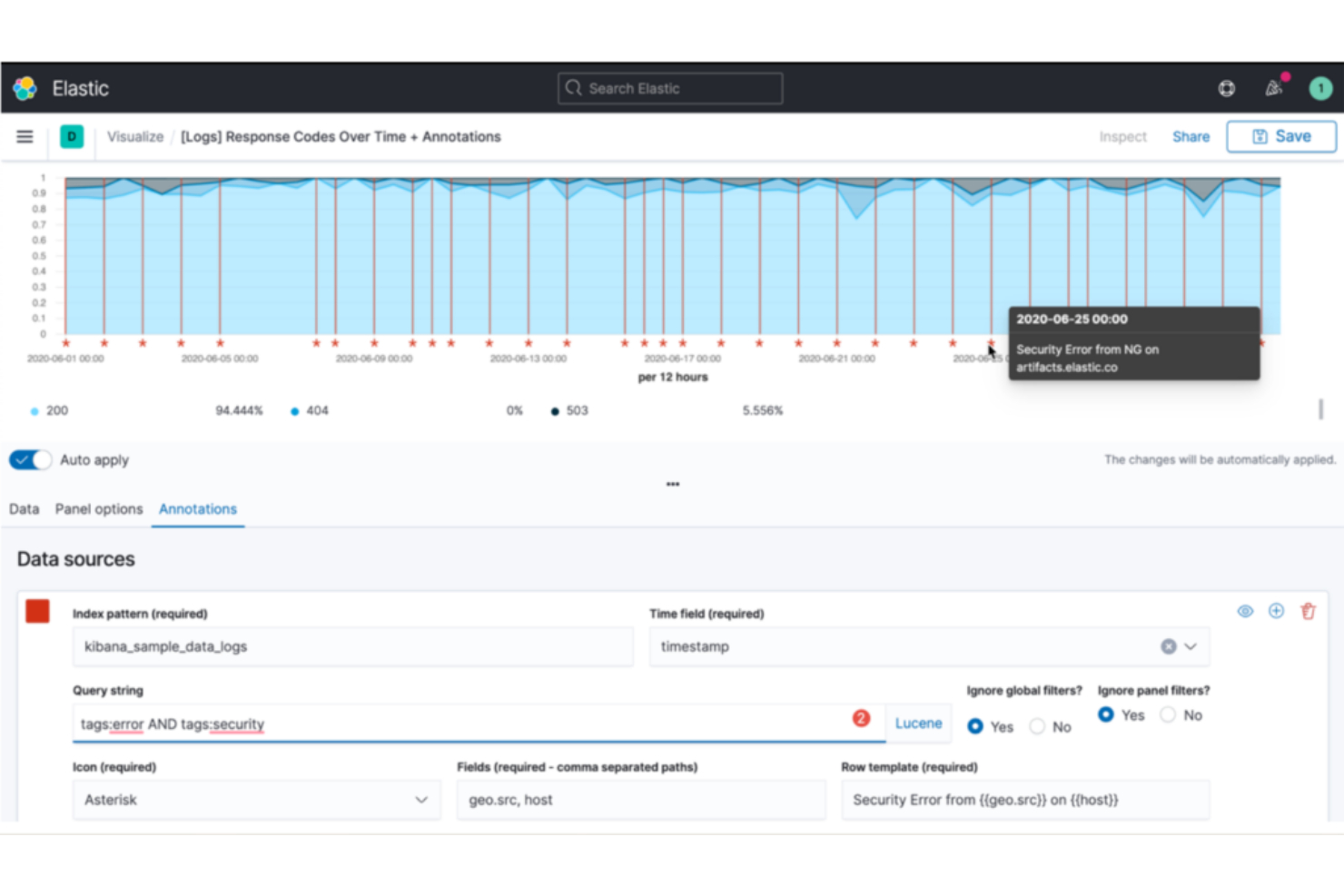

Elastic Stack, souvent appelée la pile ELK, se compose d'Elasticsearch, Logstash et Kibana. Ensemble, ces outils offrent aux entreprises des capacités puissantes de recherche et d'analyse, particulièrement essentielles pour exploiter efficacement d'immenses volumes de données.

Pourquoi j'ai choisi Elastic Stack :

Au cours de mon exploration des outils de données, j'ai systématiquement été attiré par Elastic Stack en raison de son offre complète. J'ai évalué et comparé différentes plateformes, et c'est la robustesse d'Elastic dans les domaines de la recherche et de l'analyse qui s'est démarquée. Sa combinaison unique d'outils, chacun spécialisé dans un aspect particulier du traitement des données, le rend remarquable. C'est pourquoi, après mûre réflexion et analyse, je l'ai choisi comme « Meilleur pour la recherche et les capacités d'analyse ».

Fonctionnalités et intégrations remarquables :

Elasticsearch est au cœur d'Elastic Stack, offrant une fonction de recherche puissante sur d'immenses lacs de données. Kibana facilite la visualisation des données, aidant les data scientists et les utilisateurs professionnels à en tirer des enseignements. Logstash, quant à lui, simplifie la collecte et le traitement des journaux de données. En outre, Elastic Stack propose des intégrations avec de nombreuses plateformes, des environnements cloud tels qu'AWS à divers types de sources de données, garantissant ainsi un accès flexible aux données.

Pros and Cons

Pros:

- Solution complète intégrant des outils pour la recherche, l’analyse et la collecte de données.

- Intégration avec un large éventail de plateformes, y compris AWS.

- Offre de solides capacités de gouvernance des données, assurant la qualité des données.

Cons:

- La configuration initiale peut être complexe, surtout pour ceux qui ne connaissent pas ses composants

- Peut être surdimensionné pour les petites entreprises n’ayant pas besoin de toute la suite d’outils

- Les coûts peuvent augmenter avec l’usage et le volume de données

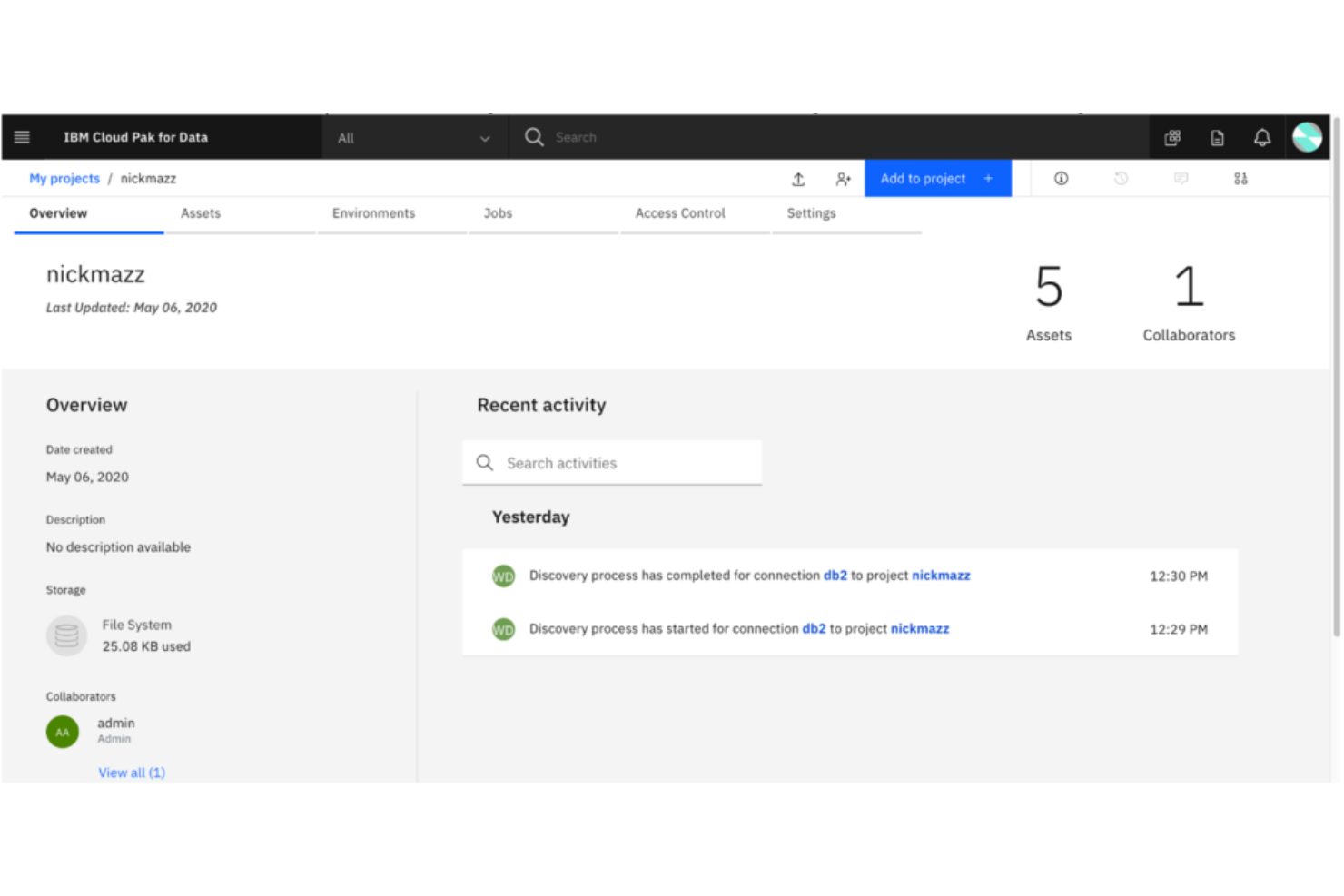

IBM Cloud Pak for Data est une plateforme unifiée qui regroupe de nombreuses fonctionnalités, allant de l'intégration de données aux capacités d'IA. Conçue pour fonctionner dans divers environnements de données, y compris multi-cloud et sur site, son intégration de l'IA dans les processus de données est ce qui définit véritablement sa stature.

Pourquoi j'ai choisi IBM Cloud Pak for Data :

Dans l’océan des plateformes d’intégration, IBM Cloud Pak for Data s’est nettement démarquée, motivant ma décision de la sélectionner. La fusion de l’IA avec l’intégration des données m’a amené à la juger comme une pionnière dans cette catégorie. J’ai estimé que, pour ceux qui recherchent une solution de bout en bout avec l’IA au cœur, IBM Cloud Pak for Data est sans conteste la « Meilleure pour l’intégration de données enrichie par l’IA ».

Fonctionnalités remarquables et intégrations :

IBM Cloud Pak for Data regorge de fonctionnalités telles que la gouvernance des données pilotée par l’IA, la qualité des données et les solutions de data fabric. Elle est conçue pour favoriser la collaboration entre les utilisateurs métiers et les data scientists, permettant ainsi de développer des modèles de machine learning avec facilité. Au niveau des intégrations, IBM Cloud Pak for Data propose des connecteurs vers diverses sources de données, y compris les plus connues comme SAP, et prend en charge des outils d’intégration pour se connecter à des environnements cloud, notamment AWS.

Pros and Cons

Pros:

- Propose une gouvernance des données pilotée par l’IA, améliorant la qualité des données intégrées.

- Fournit une plateforme unifiée, répondant à divers besoins allant de l’intégration à l’apprentissage automatique.

- Dispose d'une multitude de connecteurs, assurant l’accès aux données à travers de nombreuses sources.

Cons:

- Peut paraître complexe pour les utilisateurs novices sur les plateformes enrichies d’IA

- La large gamme de fonctionnalités peut sembler écrasante pour les utilisateurs recherchant des fonctionnalités spécifiques

- Compte tenu de son caractère global, il pourrait être plus onéreux que des outils plus spécialisés

NetApp Data Fabric simplifie la gestion, l'accès et le contrôle des données à travers divers environnements cloud, ce qui en fait un choix de premier plan pour les services de données cloud.

Pourquoi j'ai choisi NetApp Data Fabric :

NetApp Data Fabric s'est constamment imposé comme un concurrent de premier plan dans ma recherche des meilleures solutions de gestion de données sur le marché. J'ai sélectionné cet outil après avoir comparé minutieusement ses fonctionnalités à celles d'autres solutions et avoir noté sa démarche unique en matière de gouvernance des données multi-cloud et d'infrastructure de données d'entreprise. À l’ère où les entreprises migrent rapidement vers le cloud, disposer d’un outil performant dans les services de données cloud est indispensable, et c’est là que NetApp brille réellement.

Fonctionnalités et intégrations remarquables :

NetApp Data Fabric propose une suite complète de fonctionnalités conçues pour la gouvernance des données, assurant la qualité des données même lorsqu'elles transitent entre différentes sources et plateformes. Il offre une plateforme unifiée particulièrement performante pour l'intégration de données dans des environnements multi-cloud, simplifiant les processus complexes de préparation et de traitement des données. De plus, il dispose d'intégrations robustes avec des plateformes et services majeurs, notamment AWS, SAP et divers entrepôts de données, renforçant sa position de leader dans les services de données cloud.

Pros and Cons

Pros:

- Fonctionnalités complètes de gouvernance des données multi-cloud

- Intégrations riches avec les principales plateformes et services

- Accent sur l’infrastructure de données d’entreprise et l’accès aux données

Cons:

- Des complexités potentielles pour les nouveaux venus dans la gestion des données cloud

- L'ampleur de la plateforme peut nécessiter une formation dédiée

- Certains utilisateurs professionnels peuvent trouver certaines fonctionnalités trop avancées pour les tâches quotidiennes

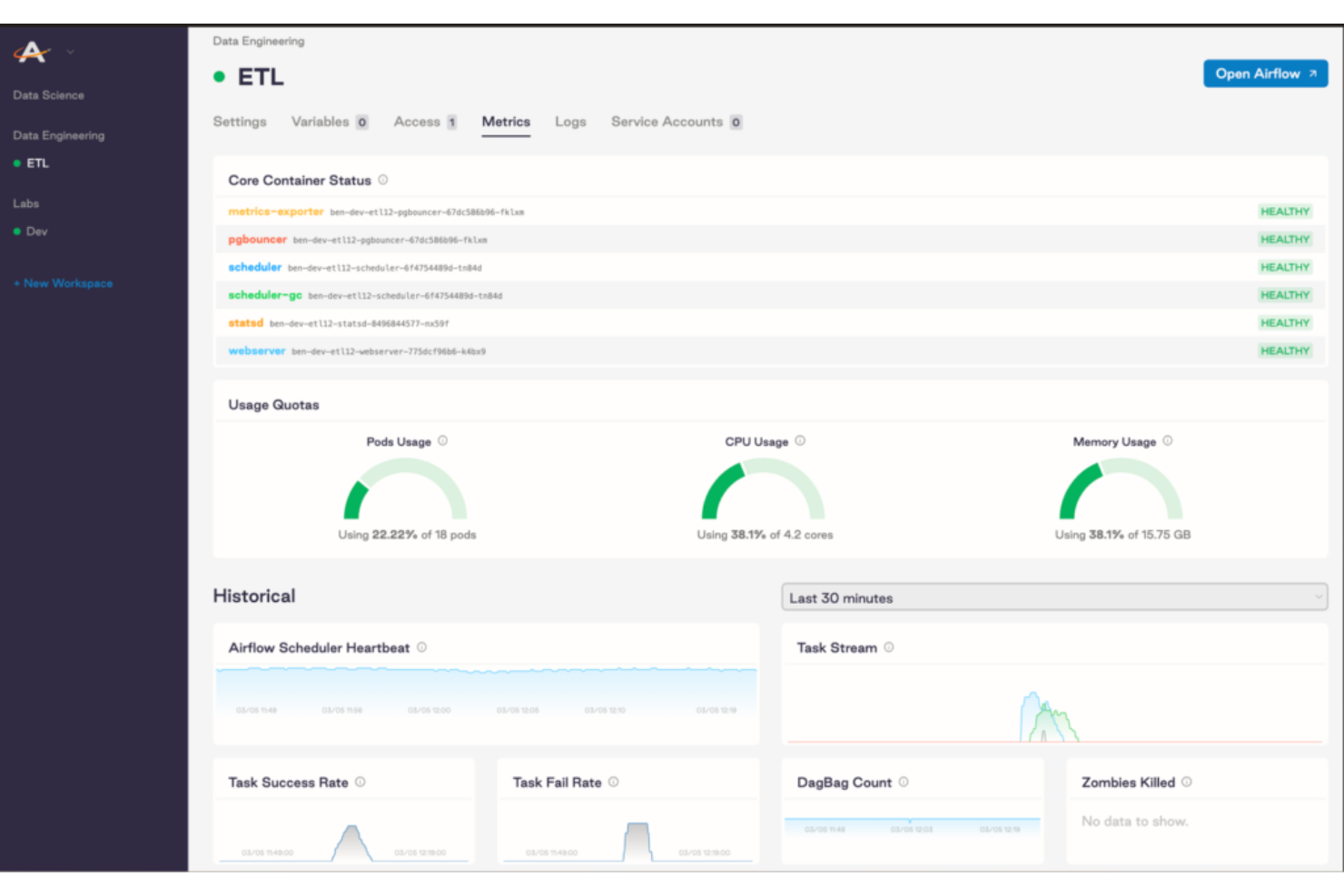

Astro by Astronomer est conçu pour simplifier le déploiement et la gestion d'Apache Airflow. Étant donné qu'Apache Airflow est une plateforme populaire pour l'orchestration de workflows de données complexes, Astro va encore plus loin en assurant une gestion optimisée des instances Airflow. Son expertise éprouvée dans la gestion d'Apache Airflow est précisément la raison pour laquelle il est identifié comme le 'meilleur' de cette catégorie.

Pourquoi j'ai choisi Astro by Astronomer :

Astro by Astronomer s'est démarqué pour moi dans la vaste gamme des outils de gestion des données. Lors de la sélection et de la comparaison d'outils spécifiquement dédiés à la gestion d'Apache Airflow, sa fonctionnalité spécialisée et son expérience utilisateur raffinée lui ont donné un avantage sur les autres. J'ai choisi Astro en raison de sa profonde intégration avec Apache Airflow et de son engagement à améliorer les capacités de la plateforme, ce qui en fait un choix parfaitement aligné sur le tag 'Idéal pour la gestion d'Apache Airflow'.

Fonctionnalités et intégrations remarquables :

Les fonctionnalités phares d'Astro tournent autour de son tableau de bord complet, qui offre une visibilité de bout en bout sur les charges de travail Airflow. Il propose une plateforme unifiée qui simplifie le déploiement, la surveillance et la montée en charge des instances Airflow. En ce qui concerne les intégrations, Astro se connecte aux principaux environnements cloud, dont AWS, et prend en charge diverses sources de données, garantissant ainsi que les pipelines de données fonctionnent de manière fluide et efficace.

Pros and Cons

Pros:

- Plateforme dédiée à Apache Airflow, assurant une fonctionnalité spécialisée.

- Propose des intégrations avec les principaux environnements cloud et sources de données.

- Capacités accrues de gouvernance des données, garantissant la qualité et la conformité des données.

Cons:

- Peut présenter une courbe d'apprentissage pour ceux qui ne connaissent pas Apache Airflow

- La transparence sur les tarifs pourrait être améliorée

- Les petites entreprises ou les utilisateurs individuels pourraient trouver la plateforme trop complète pour leurs besoins

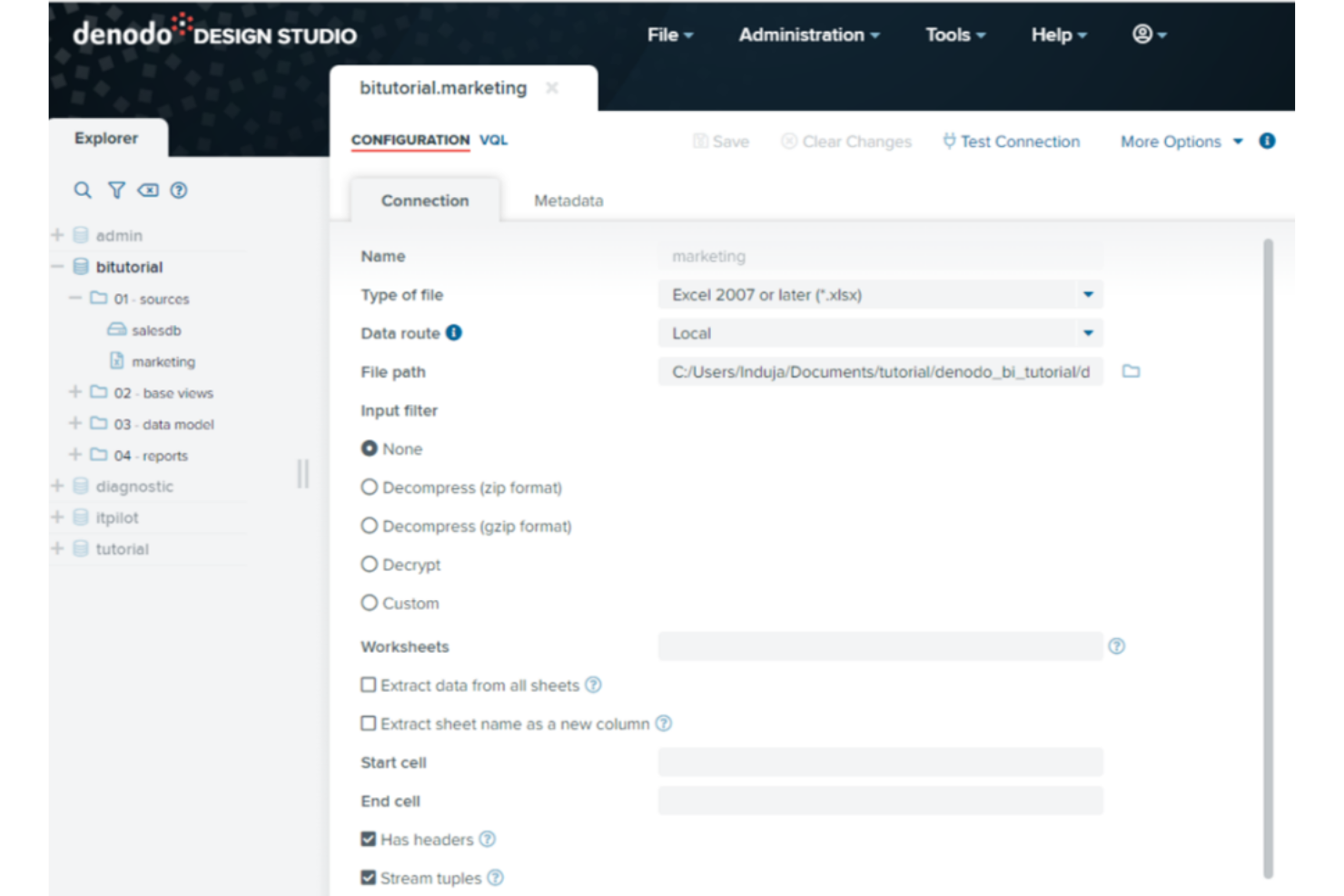

Denodo sert de plateforme clé pour les entreprises recherchant des solutions efficaces et en temps réel de virtualisation des données. Centraliser les données issues de sources disparates permet aux utilisateurs d’accéder à des vues de données unifiées sans les contraintes du déplacement physique traditionnel des données, répondant ainsi aux besoins de virtualisation des données en temps réel.

Pourquoi j'ai choisi Denodo :

Dans le domaine de la virtualisation de données, de nombreux outils ont été examinés. Cependant, après avoir comparé et évalué leurs capacités, Denodo s’est démarqué à mes yeux. La raison principale de ce choix est sa capacité impressionnante à virtualiser les données en temps réel, une fonctionnalité qui le distingue de nombreux concurrents. Ce trait unique positionne naturellement Denodo comme le « Meilleur pour la virtualisation des données en temps réel ».

Fonctionnalités et intégrations remarquables :

Denodo propose une solide gestion de la gouvernance des données, garantissant la cohérence et la qualité des données entre les différentes sources de données de l’entreprise. Grâce à ses API de pointe, Denodo facilite l’accès aux données et l’intégration sur de nombreuses plateformes. Les intégrations s’étendent aux grands acteurs comme AWS, SAP, et des entrepôts de données réputés, répondant à divers types de charges de travail et de cas d’usage métier.

Pros and Cons

Pros:

- Dispose de capacités sophistiquées de virtualisation des données en temps réel.

- Outils de gouvernance des données complets assurant la cohérence.

- Vaste choix d’intégrations avec les principales plateformes, améliorant sa polyvalence.

Cons:

- Courbe d’apprentissage possible pour les entreprises novices en virtualisation des données

- Des intégrations personnalisées peuvent nécessiter une configuration supplémentaire

- Les fonctionnalités avancées peuvent être intimidantes pour les petites entreprises

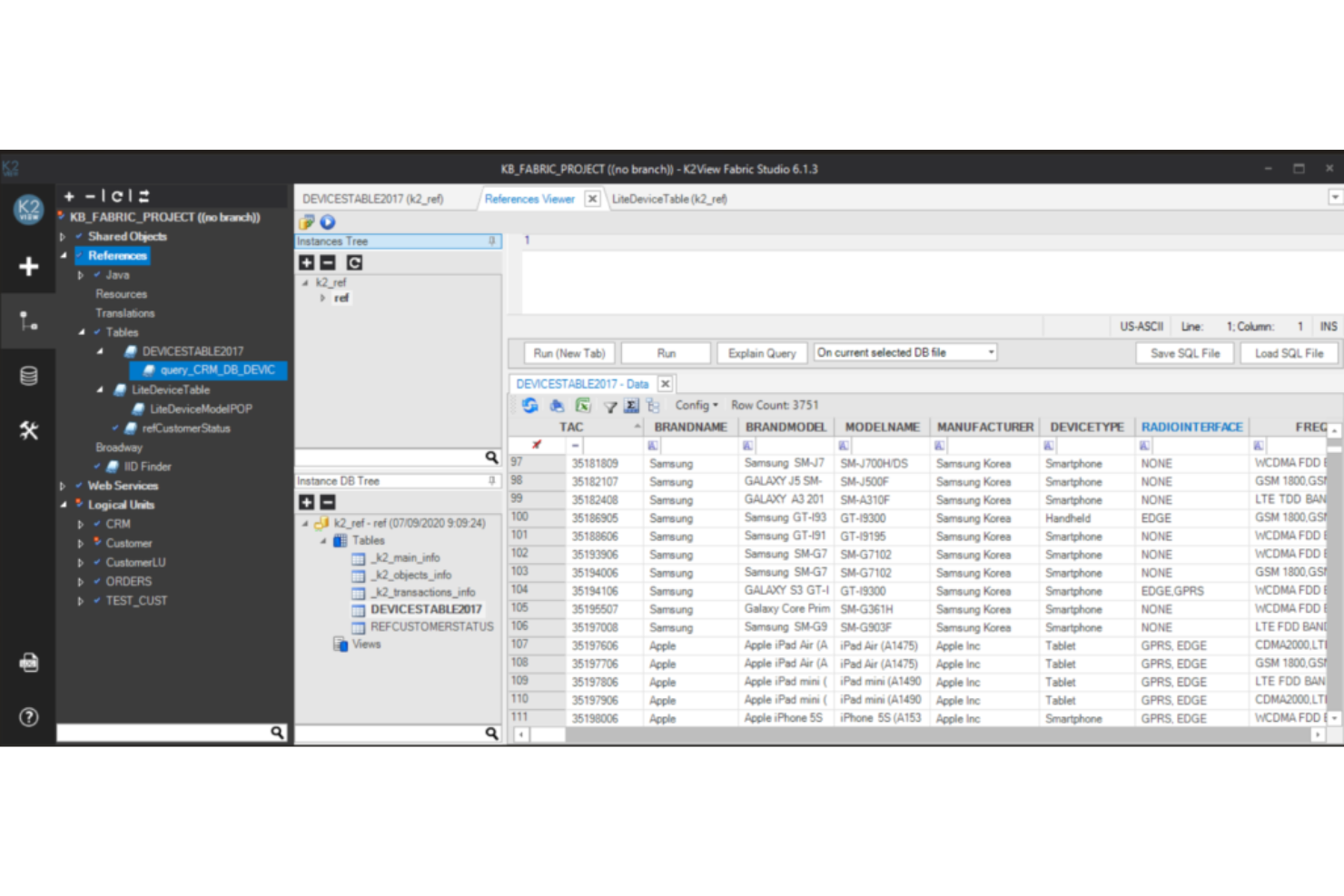

K2View gère et maintient efficacement les données opérationnelles pour les entreprises, offrant une gestion précise et opportune.

Pourquoi j'ai choisi K2View :

Dans le domaine des outils de gestion de données, le choix dépend souvent du secteur de spécialisation. Après avoir évalué plusieurs options et analysé leurs fonctionnalités, K2View a retenu mon attention grâce à son approche ciblée de la gestion des données opérationnelles. La précision et la fonctionnalité qu’elle propose dans ce domaine spécifique la distinguent. J'ai choisi K2View car il répond parfaitement aux besoins des entreprises qui considèrent les données opérationnelles comme un atout clé, ce qui en fait le « Meilleur pour la gestion des données opérationnelles ».

Fonctionnalités et intégrations remarquables :

K2View se distingue par une suite complète de fonctionnalités dédiées à la gouvernance des données et à la garantie de leur qualité, particulièrement adaptées aux données opérationnelles. La plateforme offre des capacités avancées de traitement des données et une plateforme unifiée, permettant aux entreprises de gérer l’ensemble de leurs données opérationnelles de bout en bout. Les intégrations sont également notables : K2View s'intègre parfaitement aux principaux environnements cloud, à des sources de données comme AWS et SAP, et à divers entrepôts de données, enrichissant ainsi ses capacités de gestion de données opérationnelles.

Pros and Cons

Pros:

- Fonctionnalité dédiée à la gestion des données opérationnelles

- Intégrations robustes avec les principales plateformes et sources de données

- Fonctionnalités avancées de gouvernance et de qualité des données

Cons:

- Peut présenter une courbe d'apprentissage plus raide pour ceux qui ne maîtrisent pas les subtilités des données opérationnelles

- Peut être excessif pour les entreprises qui ne priorisent pas les données opérationnelles

- L'intégration peut nécessiter une expertise technique pour certaines plateformes moins courantes

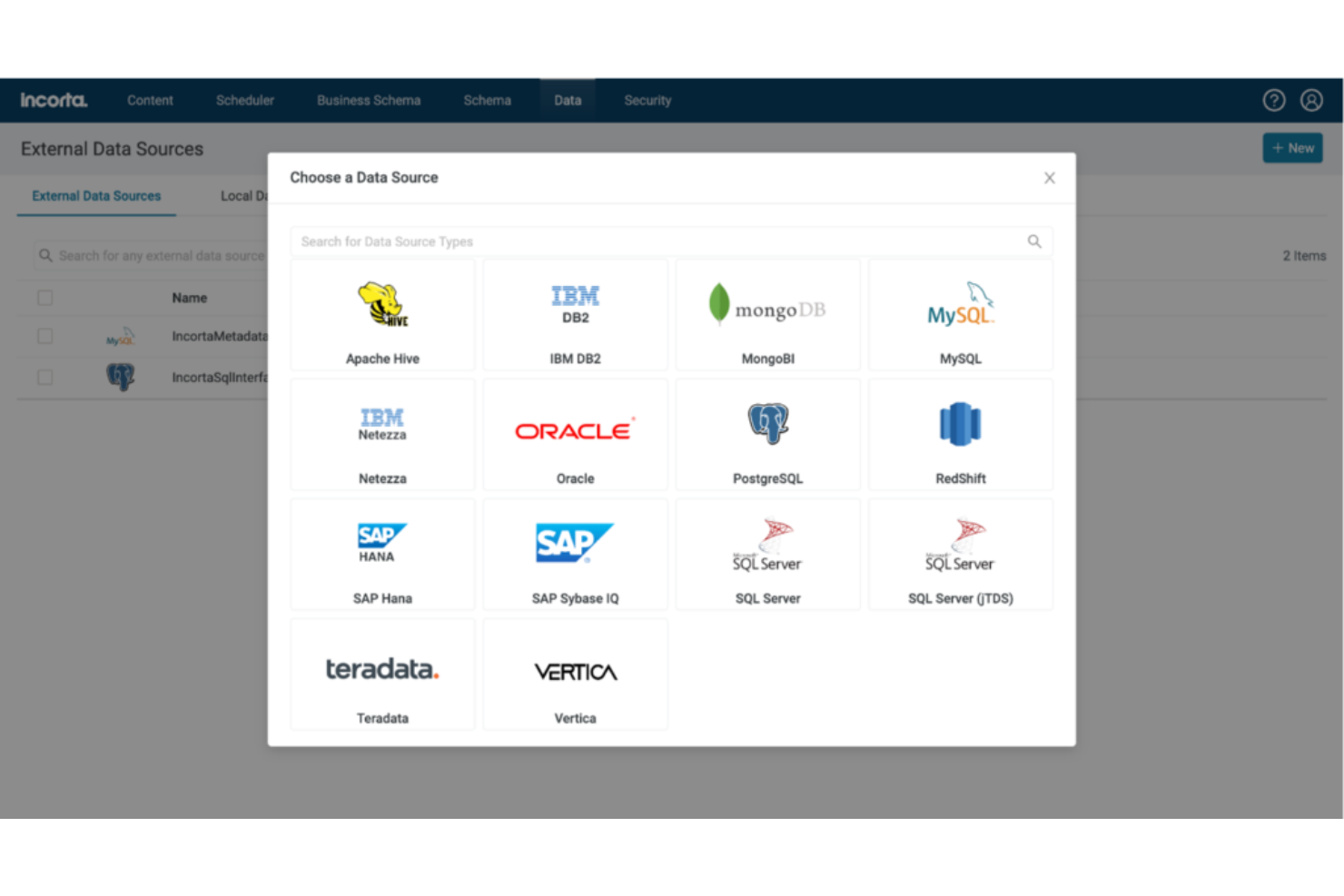

Incorta est une plateforme d'analyse de pointe, reconnue pour ses capacités de cartographie directe des données. Cette technologie permet aux utilisateurs de cartographier efficacement les données sans recourir à des entrepôts de données complexes ou à des processus ETL. Sa maîtrise de la cartographie directe des données est la principale raison pour laquelle elle se distingue comme étant supérieure dans ce domaine.

Pourquoi j'ai choisi Incorta :

Face à une multitude de plateformes d'analyse, Incorta a retenu mon attention grâce à son approche distinctive de la cartographie des données. Ce choix repose sur son architecture révolutionnaire, qui la différencie des plateformes traditionnelles reposant fortement sur l'ETL. J'ai estimé qu'Incorta, grâce à ses capacités de cartographie directe, mérite réellement l'appellation « Idéale pour la cartographie directe des données ».

Fonctionnalités et intégrations remarquables :

L'une des caractéristiques les plus importantes d'Incorta est sa faculté à contourner les phases fastidieuses de préparation des données, offrant ainsi un accès immédiat à de grands ensembles de données. De plus, elle favorise l'analyse en libre-service, permettant aux utilisateurs métiers de générer des insights sans dépendre du service informatique. En termes d'intégrations, Incorta se connecte efficacement à un large éventail de sources de données, dont SAP, et s'intègre également aux environnements cloud tels qu'AWS, ce qui améliore l'accès aux données et la flexibilité.

Pros and Cons

Pros:

- Contourne les processus ETL traditionnels, permettant un accès plus rapide aux données.

- Propose des fonctionnalités en libre-service, permettant aux utilisateurs métiers de générer des insights de façon autonome.

- S’intègre avec les principales sources de données et environnements cloud.

Cons:

- Peut sembler complexe pour des utilisateurs peu familiers avec la cartographie directe des données

- Certaines intégrations spécifiques peuvent manquer, limitant son applicabilité dans des scénarios spécialisés

- Certains utilisateurs peuvent souhaiter un contrôle plus granulaire sur les phases de préparation des données

SyncWith simplifie la synchronisation des données pour les entreprises grâce à une fonctionnalité intuitive et à l'automatisation. Gardez les données cohérentes et à jour sur toutes les plateformes en temps réel.

Pourquoi j'ai choisi SyncWith :

Lors du choix d'un outil de synchronisation des données, de nombreux facteurs ont été étudiés et comparés. Mon choix s'est porté sur SyncWith après avoir évalué ses capacités uniques d'automatisation qui facilitent la synchronisation des données, une fonctionnalité que tous les outils du marché ne proposent pas. La valeur intrinsèque de SyncWith réside dans son automatisation performante, en parfaite adéquation avec son argument clé, ce qui en fait « Le meilleur pour la synchronisation automatisée des données ».

Fonctionnalités et intégrations remarquables :

SyncWith se distingue par ses fonctionnalités d'automatisation robustes qui simplifient la tâche souvent fastidieuse de la synchronisation de grands ensembles de données. Les API de la plateforme jouent un rôle clé pour garantir la qualité des données sur l'ensemble du système. De plus, ses intégrations sont nombreuses et variées, avec la prise en charge de connecteurs vers des plateformes majeures comme AWS, SAP, ainsi qu'une multitude d'entrepôts de données, ce qui améliore sa capacité d'accès et de traitement des données.

Pros and Cons

Pros:

- Fonctionnalités d'automatisation avancées qui simplifient la synchronisation des données.

- Large gamme d'intégrations avec des plateformes majeures, offrant flexibilité.

- Maintient une haute qualité de données grâce à ses API sophistiquées.

Cons:

- Peut ne pas convenir aux petites entreprises avec des besoins limités en synchronisation de données

- Complexité potentielle lors de la configuration d'intégrations personnalisées

- L'outil peut nécessiter une formation initiale pour une utilisation optimale

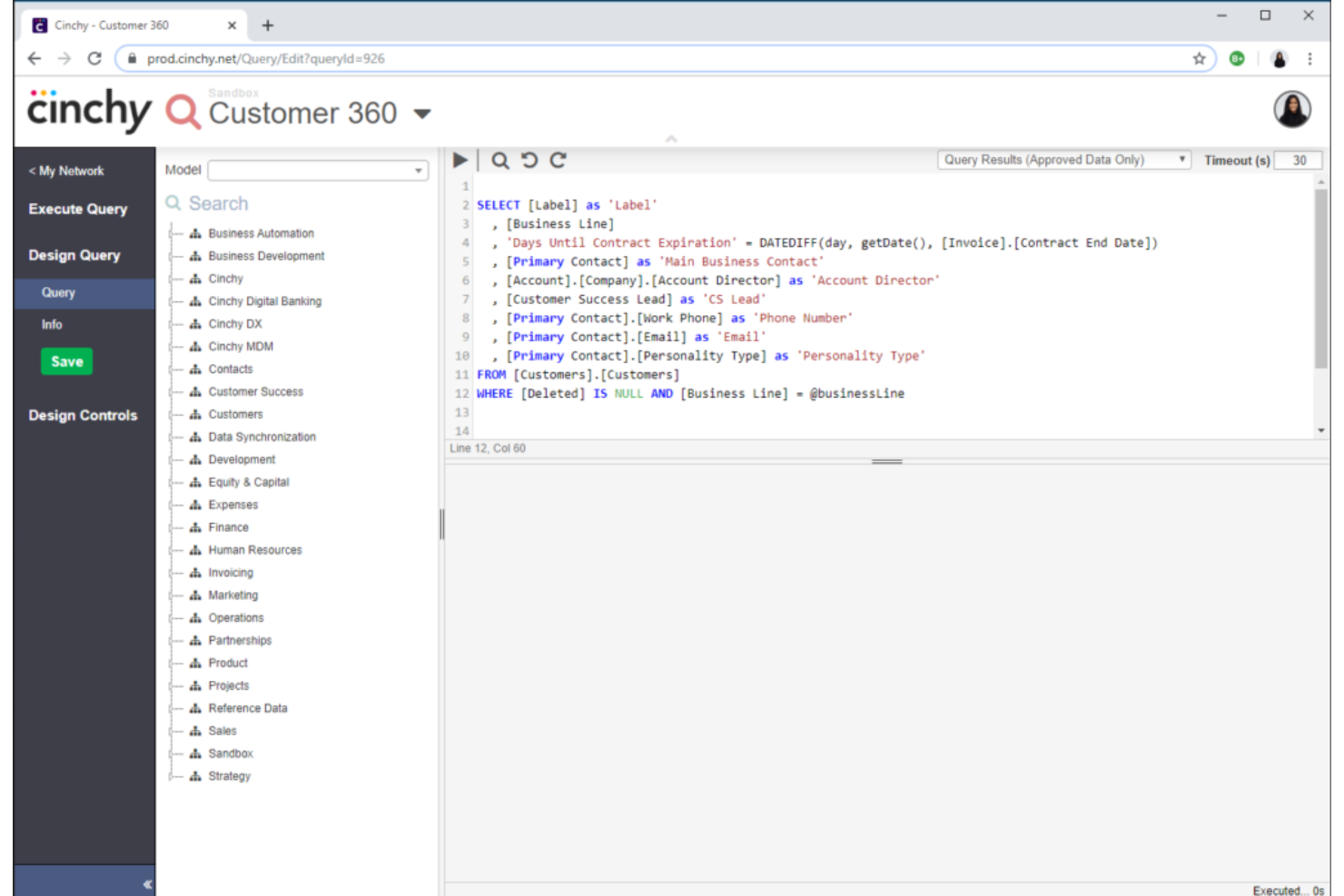

Cinchy simplifie la gestion des données pour les organisations en centralisant et en facilitant le partage collaboratif des données entre les équipes.

Pourquoi j'ai choisi Cinchy :

Lors de la sélection parmi une multitude d’outils d’intégration, Cinchy a retenu mon attention grâce à son approche unique de la gouvernance des données et du partage collaboratif. Alors que de nombreux outils facilitent l’accès aux données, Cinchy se distingue en plaçant la collaboration au cœur de son fonctionnement, soulignant que la véritable valeur des données provient des connaissances partagées. J’ai choisi cet outil car il s’aligne sur l’idée que dans l’ère actuelle du multi-cloud et du Big Data, le partage collaboratif des données n’est pas un simple luxe, mais une nécessité pour les entreprises voulant exploiter tout le potentiel de leurs données.

Fonctionnalités et intégrations remarquables :

Cinchy propose un ensemble robuste de fonctionnalités axées sur la gouvernance des données, garantissant un niveau de qualité élevé même lorsque plusieurs parties prenantes accèdent ou manipulent les données partagées. Grâce à l’automatisation fortement intégrée à sa structure, la plateforme peut rationaliser les flux de données, rendant la préparation et le traitement plus efficaces. La vaste suite d’intégrations de l’outil permet de centraliser des données issues de sources variées, telles que SAP, des entrepôts de données ou des systèmes sur site, dans une plateforme unifiée, facilitant ainsi une visibilité des données de bout en bout.

Pros and Cons

Pros:

- Accent sur le partage collaboratif des données

- Capacités robustes de gouvernance des données

- Large gamme d'intégrations avec les principales sources et plateformes de données

Cons:

- Courbe d'apprentissage potentielle pour les nouveaux venus sur ces plateformes collaboratives

- Certaines fonctionnalités avancées peuvent nécessiter une expertise technique

- Problèmes de scalabilité potentiels pour les grandes organisations

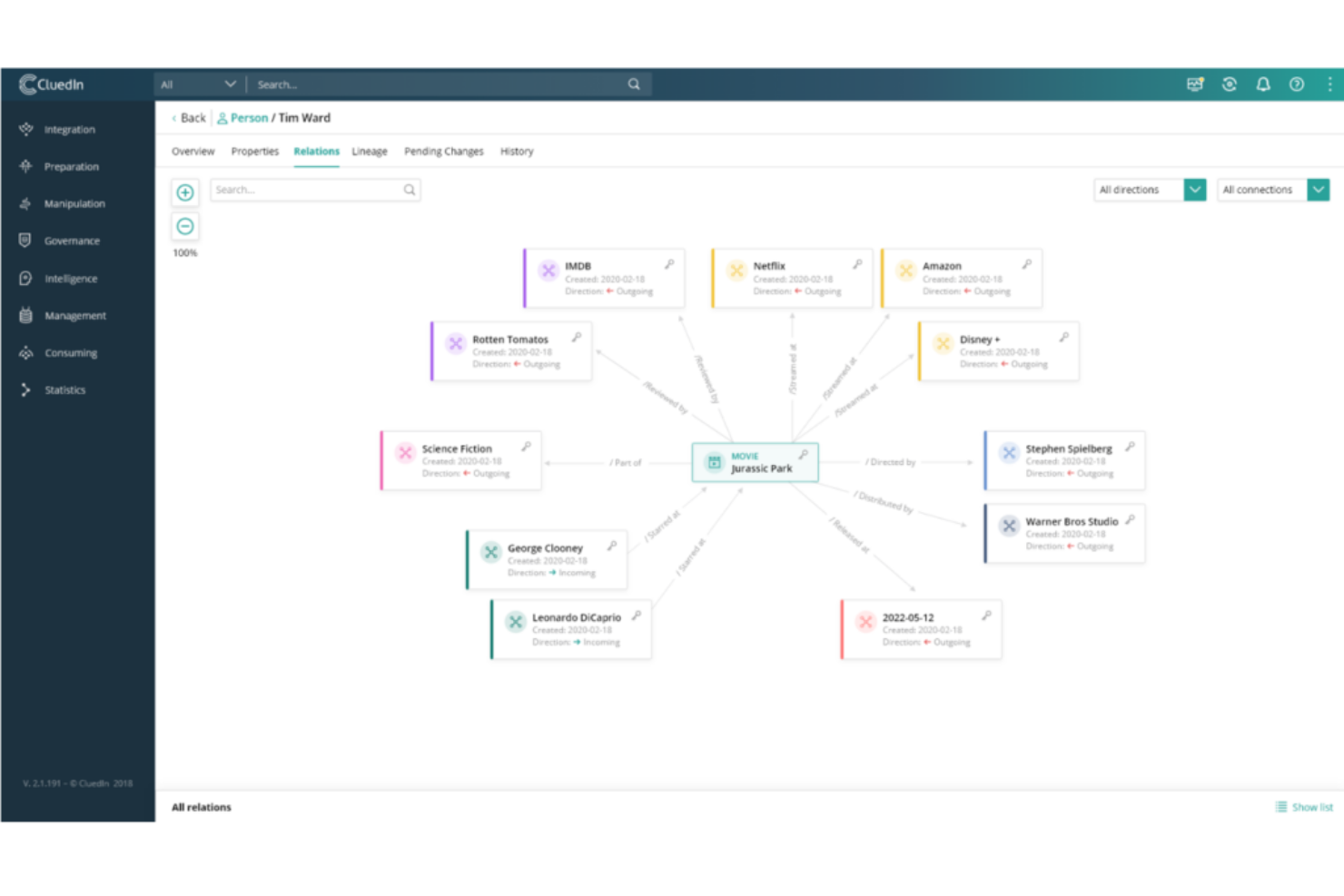

Cluedin simplifie la préparation des données pour les entreprises en connectant et en organisant les données issues de diverses sources, afin de les rendre prêtes pour l’analyse et les opérations.

Pourquoi j’ai choisi Cluedin :

Dans le domaine en constante évolution des solutions data fabric, le choix de Cluedin s’est imposé après avoir évalué différents outils pour leur capacité d’intégration et de gestion des données. En me basant sur l’accès aux données, l’automatisation et la qualité des données, Cluedin s’est distingué par son approche innovante de la connectivité des données. Ce qui m’a convaincu, c’est son accent mis sur la préparation des données : une étape critique souvent négligée, mais essentielle pour garantir que les données de l’entreprise soient prêtes à être exploitées.

Fonctionnalités et intégrations remarquables :

L’une des principales fonctionnalités de Cluedin est son cadre robuste de gouvernance des données, qui garantit la qualité et la transparence tout au long du cycle de vie des données. Grâce à l’automatisation, Cluedin accélère la phase de préparation, permettant aux data scientists et aux utilisateurs métier de disposer de données propres et unifiées. L’outil propose des intégrations complètes, y compris des connexions aux principales sources de données comme SAP, divers entrepôts de données et des API, facilitant ainsi la circulation des données dans des environnements multi-cloud et sur site.

Pros and Cons

Pros:

- Forte importance accordée à la préparation et à la connectivité des données

- S’intègre avec les principales sources de données et plateformes

- Cadre complet de gouvernance des données

Cons:

- Peut être perçu comme complexe pour les nouveaux utilisateurs

- Peut nécessiter des connaissances techniques avancées pour certaines fonctionnalités

- Options en libre-service limitées pour les utilisateurs non techniques

Autres logiciels Data Fabric

Vous trouverez ci-dessous une liste supplémentaire de logiciels data fabric que j’ai sélectionnés mais qui n’apparaissent pas dans le top 10. Ils valent vraiment le détour.

- Mosaic.

Idéal pour l'intégration globale des données

- Tengu DataOps platform

Meilleure pour les flux de travail des opérations de données

- Fraxses

Idéal pour la démocratisation des données à travers les écosystèmes

Critères de sélection des logiciels Data Fabric

Pour sélectionner les meilleurs logiciels data fabric à inclure dans cette liste, j’ai pris en compte les besoins courants des acheteurs et leurs difficultés comme les défis d'intégration des données et l’accès en temps réel. J’ai également utilisé le cadre suivant pour garantir une évaluation structurée et équitable :

Fonctionnalités principales (25 % de la note globale)

Pour faire partie de cette sélection, chaque solution devait répondre à ces cas d’usage :

- Intégration de données

- Gestion des données

- Gouvernance des données

- Sécurité des données

- Analyses en temps réel

Fonctionnalités supplémentaires remarquables (25 % de la note globale)

Pour affiner encore la sélection, j’ai aussi recherché des fonctionnalités uniques, telles que :

- Découverte automatique des données

- Visualisation avancée des données

- Intégration de l’apprentissage automatique

- Workflows personnalisables

- Support multi-cloud

Facilité d’utilisation (10 % de la note globale)

Pour évaluer l’ergonomie de chaque système, j’ai pris en compte les éléments suivants :

- Conception d'interface intuitive

- Facilité de navigation

- Tableaux de bord personnalisables

- Courbe d'apprentissage minimale

- Conception responsive

Intégration (10 % du score total)

Pour évaluer l’expérience d’intégration de chaque plateforme, j’ai pris en compte les éléments suivants :

- Disponibilité de vidéos de formation

- Visites interactives du produit

- Accès à des modèles

- Chatbots d’assistance

- Webinaires éducatifs

Support client (10 % du score total)

Pour évaluer les services de support client de chaque fournisseur de logiciels, j’ai pris en compte les éléments suivants :

- Disponibilité du support 24/7

- Efficacité du temps de réponse

- Accès à du personnel compétent

- Options de support multi-canal

- Existence d’un centre d’aide

Rapport qualité-prix (10 % du score total)

Pour évaluer le rapport qualité-prix de chaque plateforme, j’ai pris en compte les éléments suivants :

- Tarifs compétitifs

- Structure tarifaire transparente

- Gamme de plans tarifaires

- Fonctionnalités incluses dans le prix de base

- Coût des services additionnels

Avis clients (10 % du score total)

Pour me faire une idée de la satisfaction globale des utilisateurs, j’ai pris en compte les critères suivants lors de la lecture des avis clients :

- Notes de satisfaction globale

- Forces fréquemment mentionnées

- Réclamations fréquentes

- Recommandations des utilisateurs

- Retours sur les mises à jour et améliorations

Comment choisir un logiciel Data Fabric

Il est facile de se perdre dans de longues listes de fonctionnalités et des structures tarifaires complexes. Pour vous aider à garder le cap au cours de votre processus de sélection de logiciel, voici une liste de points à garder à l’esprit :

| Facteur | À prendre en compte |

|---|---|

| Scalabilité | Le logiciel pourra-t-il accompagner la croissance de vos besoins en données ? Vérifiez qu’il peut gérer l’augmentation du volume de données et le nombre d’utilisateurs sans baisse de performance. |

| Intégrations | Peut-il se connecter à vos outils existants ? Vérifiez qu’il prend en charge les plateformes et applications déjà utilisées par votre équipe pour éviter toute interruption du flux de travail. |

| Personnalisation | Pouvez-vous l’adapter à vos processus ? Cherchez des options permettant de personnaliser tableaux de bord, workflows et rapports afin de répondre aux besoins spécifiques de votre équipe. |

| Facilité d’utilisation | L’interface est-elle intuitive ? Assurez-vous que votre équipe puisse utiliser le logiciel sans formation poussée ni courbe d’apprentissage abrupte. |

| Mise en place et intégration | Combien de temps faudra-t-il pour démarrer ? Évaluez les ressources nécessaires à l'installation et à la formation. Privilégiez les logiciels qui offrent des guides clairs ou un soutien à l’intégration. |

| Coût | Rentre-t-il dans votre budget ? Comparez les différents plans tarifaires à votre budget. Faites attention aux frais cachés pour les fonctionnalités ou services non inclus dans le prix de base. |

| Sécurité | Protège-t-il vos données ? Vérifiez les mesures de sécurité du logiciel, telles que le chiffrement et les contrôles d’accès, afin d’assurer la sûreté de vos données. |

| Exigences réglementaires | Est-il conforme aux standards du secteur ? Vérifiez qu’il respecte les réglementations pertinentes comme le RGPD ou la HIPAA si nécessaire pour votre entreprise. |

Qu’est-ce qu’un logiciel Data Fabric ?

Un logiciel Data Fabric est un ensemble d’outils conçus pour intégrer et gérer les données à travers plusieurs plateformes et environnements. Les professionnels IT, les ingénieurs et analystes de données utilisent généralement ces outils pour renforcer l’accessibilité et la gouvernance des données.

Les fonctionnalités d’intégration, de gestion et de gouvernance des données aident à organiser et rendre les données accessibles de façon cohérente sur divers systèmes. Globalement, ces outils simplifient l’exploitation des données et améliorent la prise de décision en garantissant un accès fiable et sécurisé aux informations.

Fonctionnalités

Lors de la sélection d’un logiciel Data Fabric, soyez attentif aux fonctionnalités clés suivantes :

- Intégration des données : Relie diverses sources de données, permettant une circulation fluide des données et un accès unifié entre les plateformes.

- Analytique en temps réel : Fournit des analyses instantanées en traitant les données à leur arrivée, aidant les utilisateurs à prendre des décisions rapidement.

- Gouvernance des données : Garantit la qualité et la conformité des données en appliquant des règles et des politiques pour gérer l'accès et l'utilisation des données.

- Scalabilité : Prend en charge l'augmentation du volume de données et des besoins utilisateurs sans compromettre la performance ou la rapidité.

- Personnalisation : Permet aux utilisateurs d’adapter tableaux de bord, flux de travail et rapports aux besoins et processus spécifiques de l’entreprise.

- Garanties de sécurité : Protège les données grâce au chiffrement et aux contrôles d’accès, assurant l’intégrité et la confidentialité des informations.

- Découverte automatisée des données : Identifie et classe automatiquement les données, faisant gagner du temps et améliorant l’efficacité de la gestion des données.

- Visualisation des données : Transforme des ensembles de données complexes en formats visuels faciles à comprendre pour une meilleure interprétation et analyse.

- Capacités d’intégration : Offre une connectivité transparente avec les outils et plateformes existants, minimisant les interruptions de workflow.

- Traitement en mémoire : Améliore la rapidité d'accès aux données grâce au stockage en mémoire, pour une récupération et une analyse plus rapides.

Bénéfices

La mise en place d’un logiciel de fabric de données apporte plusieurs avantages à votre équipe et votre entreprise. Voici quelques-uns des bénéfices auxquels vous pouvez vous attendre :

- Amélioration de l’accès aux données : Assure un accès cohérent et unifié aux données entre les plateformes, permettant une meilleure collaboration et prise de décision.

- Aide à la prise de décision : L’analytique en temps réel fournit des informations ponctuelles, aidant votre équipe à prendre des décisions éclairées rapidement.

- Efficacité accrue : Automatise les tâches de découverte et d’intégration des données, économisant du temps et réduisant les efforts manuels.

- Renforcement de la sécurité des données : Met en œuvre des garanties de sécurité telles que le chiffrement et les contrôles d’accès pour protéger les informations sensibles.

- Scalabilité : Répond à la croissance des besoins en données sans compromettre la performance, permettant à votre entreprise de se développer sans rupture.

- Personnalisation : Offre la flexibilité d’adapter le logiciel à vos besoins spécifiques, améliorant ainsi l’expérience utilisateur globale.

- Assurance de conformité : Respecte les standards de gouvernance des données, garantissant que vos données sont conformes aux réglementations et politiques de votre secteur.

Coûts & Tarification

Le choix d’un logiciel de fabric de données nécessite de comprendre les différents modèles de tarification et plans proposés. Les coûts varient en fonction des fonctionnalités, de la taille de l’équipe, des modules complémentaires et plus encore. Le tableau ci-dessous résume les plans courants, leurs tarifs moyens, ainsi que les principales fonctionnalités incluses dans les solutions de fabric de données :

Tableau comparatif des plans pour les logiciels de fabric de données

| Type de plan | Prix moyen | Fonctionnalités communes |

|---|---|---|

| Plan gratuit | $0 | Intégration basique des données, analytique limitée et support communautaire. |

| Plan personnel | $5-$25/utilisateur/mois | Intégration des données, analytique de base, visualisation des données et assistance par email. |

| Plan entreprise | $30-$100/utilisateur/mois | Analytique avancée, gouvernance des données, tableaux de bord personnalisés et support prioritaire. |

| Plan d’entreprise | $100+/utilisateur/mois | Gestion des données complète, analytique en temps réel, sécurité renforcée, intégrations sur mesure et assistance dédiée. |

FAQ sur les logiciels de Data Fabric

Voici des réponses à des questions fréquemment posées sur les logiciels de data fabric :

Quels sont les inconvénients du data fabric ?

Le data fabric peut être complexe à cause de la multiplicité des dépôts de données, ce qui rend la gestion des données plus difficile. Vous pouvez rencontrer des problèmes de manque de standardisation, car les données stockées dans différents formats sont plus difficiles à analyser. Demandez-vous si votre équipe dispose des ressources nécessaires pour gérer efficacement cette complexité.

Comment fonctionne le data fabric ?

Le data fabric connecte, gère et gouverne les données à travers différents systèmes. Il offre une vue centralisée et unifiée de vos données, les rendant accessibles à vos équipes et à vos systèmes. Cette approche garantit que votre organisation peut utiliser les données efficacement, quel que soit leur emplacement.

Le data fabric nécessite-t-il la virtualisation des données ?

La virtualisation des données aide à intégrer rapidement les données et constitue souvent un élément central de l’architecture data fabric. Lorsque vous avez besoin d’une plateforme centralisée pour gérer et gouverner toutes vos données, la virtualisation peut soutenir ces efforts. Analysez les besoins spécifiques de votre organisation pour déterminer si c’est nécessaire.

Quels secteurs bénéficient le plus du data fabric ?

Des secteurs comme la finance, la santé et le commerce de détail tirent un avantage considérable du data fabric. Ces domaines traitent souvent de vastes volumes de données provenant de sources diverses, nécessitant une intégration et une gestion efficaces. Déterminez si votre secteur fait face à des défis similaires auxquels le data fabric peut répondre.

Quel est le rôle de l’IA dans le data fabric ?

L’IA améliore le data fabric en automatisant les tâches de gestion de données et en fournissant des analyses avancées. Elle aide votre équipe à obtenir des insights plus rapidement et à améliorer la prise de décision. Évaluez si les capacités de l’IA correspondent à vos objectifs afin de déterminer leur importance dans votre solution data fabric.

Et après :

Si vous êtes en train de rechercher un logiciel de data fabric, contactez gratuitement un conseiller SoftwareSelect pour obtenir des recommandations personnalisées.

Vous remplissez un formulaire puis avez une brève discussion où ils abordent précisément vos besoins. Vous recevrez ensuite une liste restreinte de logiciels à examiner. Ils vous accompagneront même tout au long du processus d'achat, y compris lors des négociations tarifaires.