Meilleur logiciel de préparation des données : notre sélection

Naviguer dans l’univers de la préparation des données peut s’avérer complexe, mais le bon logiciel facilite des tâches telles que le nettoyage, la découverte et la transformation des données. Que vous soyez analyste travaillant avec des données non structurées ou une entreprise cherchant à unifier des données provenant de diverses sources, ces outils proposent des solutions de bout en bout. Ils connectent les pipelines de données aux entrepôts de données et aux plateformes d’analyse, permettant ainsi une analyse efficace.

Grâce à des fonctionnalités telles que les connecteurs sans code, la validation et l’enrichissement des données, ils facilitent l'accès aux données, même pour les personnes sans expertise technique, afin d’extraire des indicateurs et des analyses pertinents. Sur site ou dans le cloud, ces outils sont polyvalents et peuvent s’intégrer à diverses applications d’analyse métier. Ainsi, si vous cherchez à optimiser votre analyse de données par des fonctionnalités dédiées au nettoyage, à l’enrichissement et au traitement des données, explorer ces solutions pourrait répondre à vos problématiques de gestion de données.

Table of Contents

Why Trust Our Software Reviews

We’ve been testing and reviewing software since 2023. As tech leaders ourselves, we know how critical and difficult it is to make the right decision when selecting software.

We invest in deep research to help our audience make better software purchasing decisions. We’ve tested more than 2,000 tools for different tech use cases and written over 1,000 comprehensive software reviews. Learn how we stay transparent & our software review methodology.

Résumé des meilleurs logiciels de préparation des données

Ce tableau comparatif récapitule les détails de tarification de mes meilleurs choix de logiciels de préparation des données afin de vous aider à trouver le plus adapté à vos besoins et à votre budget.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Idéal pour la combinaison de données et l'analyse avancée | Essai gratuit + démo gratuite disponible | À partir de $79/utilisateur/mois (facturé annuellement) | Website | |

| 2 | Idéal pour la modélisation d'analyses prédictives | Une offre gratuite est disponible | À partir de 2 500 $/utilisateur/mois (facturé annuellement) | Website | |

| 3 | Idéal pour une flexibilité open-source | Plan gratuit disponible | Tarification sur demande | Website | |

| 4 | Idéal pour la visualisation interactive de données | Essai gratuit de 30 jours | À partir de $125/utilisateur/mois (facturé annuellement) | Website | |

| 5 | Idéal pour l'intégration de données en temps réel | Essai gratuit de 14 jours disponible | À partir de $1000/utilisateur/mois (facturé annuellement) | Website | |

| 6 | Idéal pour une interface de préparation de données visuelle | Not available | À partir de $70/utilisateur/mois | Website | |

| 7 | Idéal pour une gestion robuste des données d’entreprise | Not available | Tarification sur demande | Website | |

| 8 | Idéal pour la gouvernance de la qualité des données | Démo gratuite disponible | Tarification sur demande | Website | |

| 9 | Idéal pour l'intégration de données à grande échelle | Essai gratuit de 30 jours et démo gratuite disponible | Tarification sur demande | Website | |

| 10 | Idéal pour les projets collaboratifs de science des données | Not available | Tarification sur demande | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Avis sur les meilleurs logiciels de préparation des données

Vous trouverez ci-dessous mes analyses détaillées des meilleurs logiciels de préparation des données présélectionnés. Mes avis présentent en détail les fonctionnalités clés, les avantages et inconvénients, les intégrations et les usages idéaux de chaque solution pour vous aider à trouver celle qui vous convient le mieux.

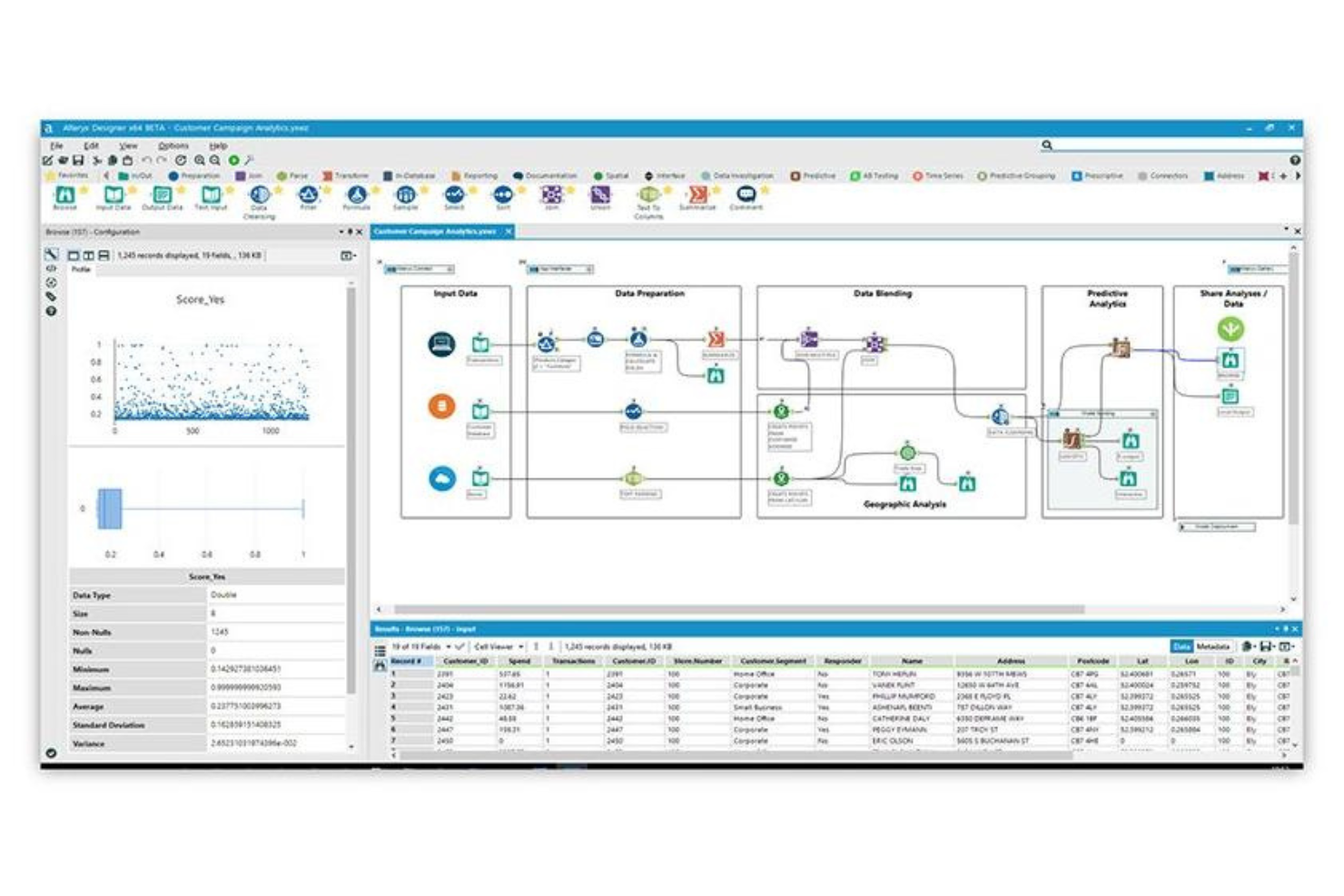

Alteryx est un outil spécialisé dans la combinaison de données et l'analyse avancée, permettant aux utilisateurs de rassembler des ensembles de données et d'effectuer des analyses complexes. Cette plateforme robuste réunit des sources d'information disparates et offre aux utilisateurs des capacités analytiques avancées, en faisant la solution privilégiée pour la combinaison de données et l'obtention d'informations approfondies.

Pourquoi j'ai choisi Alteryx :

J'ai sélectionné Alteryx pour cette liste en raison de sa capacité unique à combiner différents types de données tout en proposant une suite analytique avancée. Ce qui le distingue, c'est son interface intuitive qui permet à tous les utilisateurs, quel que soit leur profil, d'explorer des analyses complexes. C'est précisément cette fonctionnalité qui en fait le meilleur pour la combinaison de données et l'analyse avancée, car les utilisateurs peuvent tirer des enseignements de diverses sources sans avoir besoin de compétences approfondies en codage.

Fonctionnalités et intégrations remarquables :

Alteryx propose un large éventail de fonctionnalités, dont la combinaison de données, l'analyse prédictive, l'analyse spatiale et le profilage des données. Son interface par glisser-déposer permet de créer des flux de travail facilement, réduisant ainsi la courbe d'apprentissage. Des intégrations avec des outils comme Tableau, Microsoft Power BI et Excel offrent une flexibilité supplémentaire et élargissent les possibilités d'utilisation des données au sein de l'organisation.

Pros and Cons

Pros:

- Excellentes capacités de combinaison de données

- Fonctionnalités analytiques avancées

- Intégration avec des outils BI populaires

Cons:

- Courbe d'apprentissage plus marquée pour les nouveaux utilisateurs

- Fonctionnalités de collaboration limitées

- Le prix peut être prohibitif pour les petites entreprises

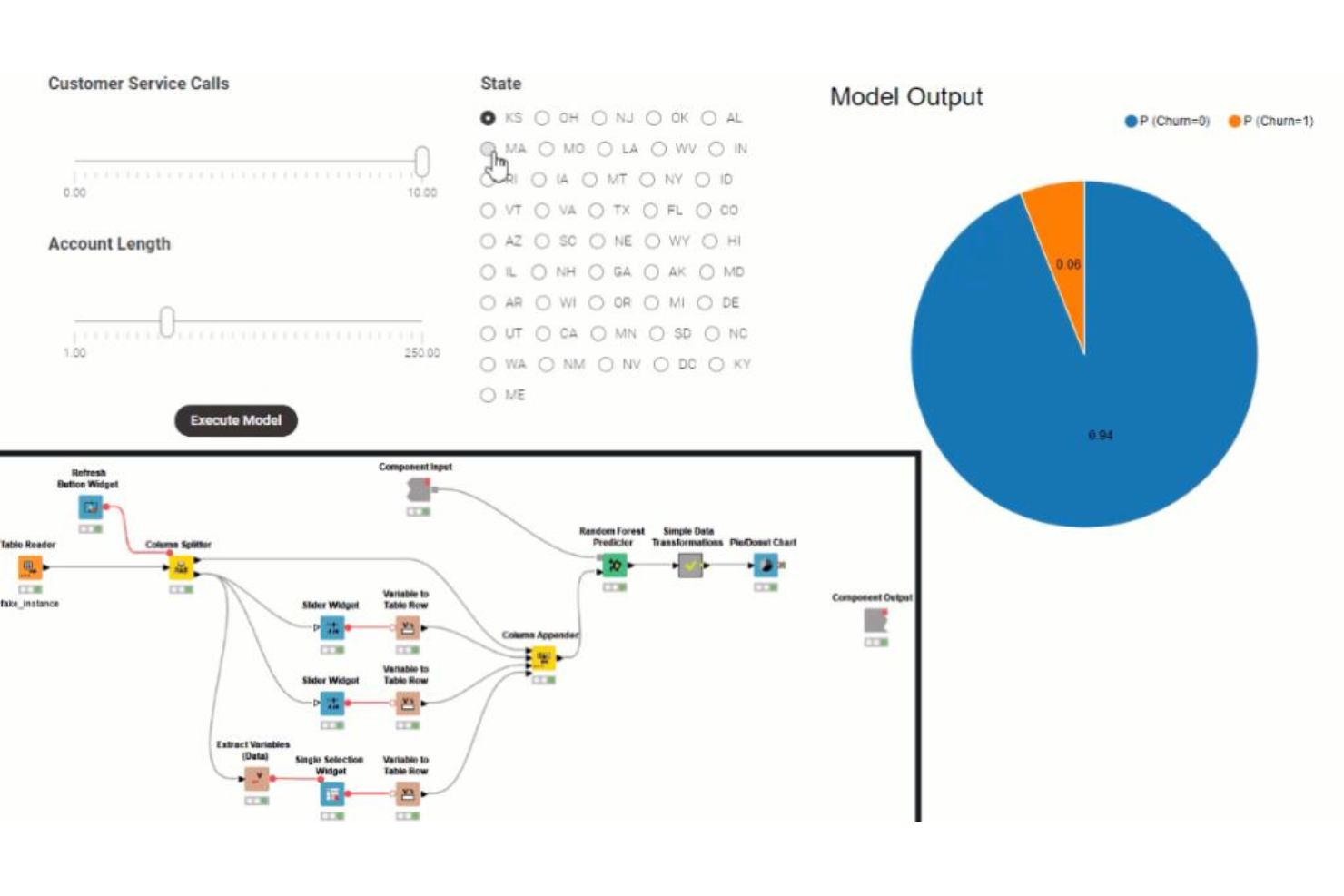

RapidMiner est une plateforme de data science spécialisée dans la modélisation d'analyses prédictives, permettant aux utilisateurs de créer des modèles qui prévoient les tendances, les comportements et les événements futurs. Grâce à son interface conviviale et à ses fonctionnalités de modélisation robustes, RapidMiner se distingue comme l'outil idéal pour ceux qui doivent réaliser des tâches d'analytique prédictive complexes.

Pourquoi j'ai choisi RapidMiner :

J'ai sélectionné RapidMiner pour cette liste après avoir soigneusement comparé et évalué divers outils axés sur l'analytique prédictive. Son ensemble de fonctionnalités distinctif et ses solides capacités en modélisation prédictive ont retenu mon attention. RapidMiner propose des modèles et des modèles préconçus qui facilitent le démarrage avec l'analytique prédictive, ce qui le distingue comme le meilleur outil pour ceux qui recherchent une modélisation prédictive efficace.

Fonctionnalités phares et intégrations :

RapidMiner propose un concepteur de flux de travail visuel qui simplifie le processus de modélisation, rendant l'analytique prédictive plus accessible. Sa fonctionnalité Auto Model accélère la création de modèles en ajustant automatiquement les paramètres. RapidMiner s'intègre à de nombreuses bases de données et services cloud et offre une compatibilité étendue avec les scripts R et Python, permettant la connexion à diverses sources et outils de données.

Pros and Cons

Pros:

- Forte orientation analytique prédictive avec des modèles préconçus

- Prise en charge de l’intégration avec R, Python et diverses sources de données

- Fonction Auto Model qui accélère le processus de création de modèles

Cons:

- Un tarif élevé qui peut restreindre l’accessibilité aux petites entreprises

- Nécessite une certaine connaissance préalable des concepts de data science

- Flexibilité limitée dans la version gratuite, avec des fonctionnalités essentielles réservées à l’offre payante

KNIME est une plateforme d'analyse de données, de reporting et d'intégration qui permet aux utilisateurs de créer et de produire des analyses fondées sur les données. En tant qu'outil open-source, KNIME offre une flexibilité inégalée, permettant aux utilisateurs de personnaliser leurs flux de travail et d'intégrer divers outils de données. Cela en fait un choix puissant pour ceux qui ont besoin de solutions sur mesure et qui préfèrent la flexibilité offerte par l'open-source.

Pourquoi j'ai choisi KNIME :

J'ai sélectionné KNIME pour cette liste en raison de son impressionnante nature open-source, qui autorise les utilisateurs à concevoir des flux de travail et des processus analytiques personnalisés. Au cours de mon évaluation et de ma comparaison, j'ai constaté que l'approche de KNIME en matière d'intégration des données et de flexibilité la distingue dans ce domaine. La flexibilité open-source, en particulier, répond à un large éventail d'utilisateurs et offre des possibilités de personnalisation uniques, ce qui en fait le meilleur choix pour ceux qui ont besoin d'outils adaptables.

Fonctionnalités et intégrations remarquables :

KNIME propose des flux de travail de données en glisser-déposer grâce auxquels les utilisateurs peuvent facilement construire leurs processus de données à l'aide d'une grande variété de nœuds. La disponibilité d’extensions communautaires et d’intégrations avec des langages de programmation comme Python et R offre une flexibilité considérable. KNIME s'intègre à différentes bases de données, à des extensions big data et même à des stockages cloud, ce qui le rend adaptable à de nombreux environnements de données différents.

Pros and Cons

Pros:

- Plateforme open-source permettant une personnalisation poussée

- Intégration riche avec différents langages de programmation et bases de données

- Forte communauté et nombreuses extensions

Cons:

- L'apprentissage peut être difficile pour les débutants

- Les performances peuvent être moindres avec des ensembles de données extrêmement volumineux

- L'absence d'informations tarifaires facilement accessibles peut décourager certains utilisateurs potentiels

TIBCO Spotfire est une plateforme d’analyse de données et d’intelligence économique conçue pour créer des visualisations interactives et des tableaux de bord. Elle propose un ensemble complet d’outils pour analyser, visualiser et partager des informations issues de jeux de données complexes. L’accent prononcé mis sur les visualisations interactives et l’interface conviviale fait que je la considère comme la meilleure solution pour la visualisation interactive des données.

Pourquoi j’ai choisi TIBCO Spotfire :

J’ai sélectionné TIBCO Spotfire pour cette liste après avoir soigneusement comparé ses fonctionnalités avec d’autres outils de visualisation. Sa capacité à créer des visualisations dynamiques et interactives, ainsi que sa flexibilité à gérer diverses sources de données, la distinguent des autres. Je considère cet outil comme étant « Idéal pour... » la visualisation interactive des données, car il permet aux utilisateurs d’interagir avec leurs données de manière très visuelle et intuitive, renforçant ainsi les processus de prise de décision.

Fonctionnalités et intégrations remarquables :

TIBCO Spotfire propose des analyses avancées, une connectivité aux données en temps réel et la modélisation prédictive parmi ses fonctionnalités phares. La fonction glisser-déposer de la plateforme garantit une expérience utilisateur facile et fluide. L’intégration avec de nombreuses sources de données, y compris les bases de données, les tableurs et les services cloud, en fait un outil polyvalent pour divers besoins métiers.

Pros and Cons

Pros:

- Accent fort sur les visualisations interactives et dynamiques

- Intégration avec une grande variété de sources de données

- Tableaux de bord personnalisables pour différents besoins utilisateurs

Cons:

- La tarification peut être élevée pour les petites entreprises

- Certaines fonctionnalités avancées peuvent nécessiter une expertise technique

- Documentation et support limités pour des personnalisations spécifiques

Talend est une plateforme d'intégration de données robuste conçue pour faciliter le flux de données en temps réel entre divers systèmes. Avec son fort accent sur l'intégration de données en temps réel, Talend propose une solution qui garantit l'échange de données, en faisant un choix idéal pour les organisations ayant besoin d'une synchronisation des données à la minute près.

Pourquoi j'ai choisi Talend :

J'ai sélectionné Talend pour cette liste en raison de son engagement envers l'intégration des données en temps réel. La capacité à déplacer et transformer les données instantanément est essentielle pour de nombreuses entreprises, et les outils spécialisés de Talend offrent cette fonctionnalité. Cet engagement envers le traitement en temps réel distingue Talend et c'est pourquoi je l'ai déterminé comme la meilleure option pour les entreprises nécessitant une synchronisation immédiate de leurs données sur différentes plateformes.

Fonctionnalités remarquables et intégrations :

Talend propose des fonctionnalités telles que le streaming de données en temps réel, la transformation et l'intégration à travers un large éventail de sources. Son intégration au Big Data et sa compatibilité avec les plateformes cloud sont particulièrement notables. Talend s'intègre efficacement avec diverses sources de données telles qu'AWS, Azure, Salesforce et Hadoop, offrant un support complet pour des besoins métier variés.

Pros and Cons

Pros:

- Capacités robustes d'intégration de données en temps réel

- Support complet du cloud et du Big Data

- Intégration flexible avec diverses sources de données

Cons:

- Configuration complexe pouvant nécessiter une expertise technique

- Tarification élevée pour les petites et moyennes entreprises

- Absence d'interface visuelle pour les tâches de préparation de données

Tableau Prep est réputé pour son interface de préparation de données visuelle qui permet aux utilisateurs de voir les données au fur et à mesure qu'ils les transforment. Cette approche pratique et visuelle garantit que les utilisateurs comprennent comment les modifications affectent les données, ce qui en fait une solution idéale pour ceux qui privilégient une expérience de préparation guidée par la visualisation.

Pourquoi j'ai choisi Tableau Prep :

J'ai choisi Tableau Prep pour son interface unique et intuitive de préparation de données visuelle. Cette fonctionnalité la distingue des autres en permettant aux utilisateurs d'interagir graphiquement avec leurs données, facilitant ainsi une meilleure compréhension des actions effectuées. C'est cette interaction visuelle qui me fait considérer Tableau Prep comme la meilleure option pour ceux qui veulent voir et manipuler leurs données de façon naturelle et directe.

Fonctionnalités remarquables et intégrations :

Tableau Prep propose une interface interactive où l'utilisateur peut explorer et nettoyer visuellement les données. Ses recommandations intelligentes pour les jonctions, les unions et le nettoyage de données font gagner du temps et contribuent à créer un flux de travail fluide. Les intégrations clés incluent la connexion à de multiples sources de données comme Excel, SQL Server et Google Sheets, ainsi que l'intégration avec Tableau Desktop pour une analyse approfondie.

Pros and Cons

Pros:

- L'interface visuelle améliore la compréhension

- Recommandations intelligentes pour les tâches de préparation de données

- Intégration poussée avec les autres produits Tableau

Cons:

- Peut être moins adapté aux personnes qui n'apprennent pas visuellement

- Fonctionnalités avancées de transformation limitées

- Tarif plus élevé pour les utilisateurs individuels

Idéal pour une gestion robuste des données d’entreprise

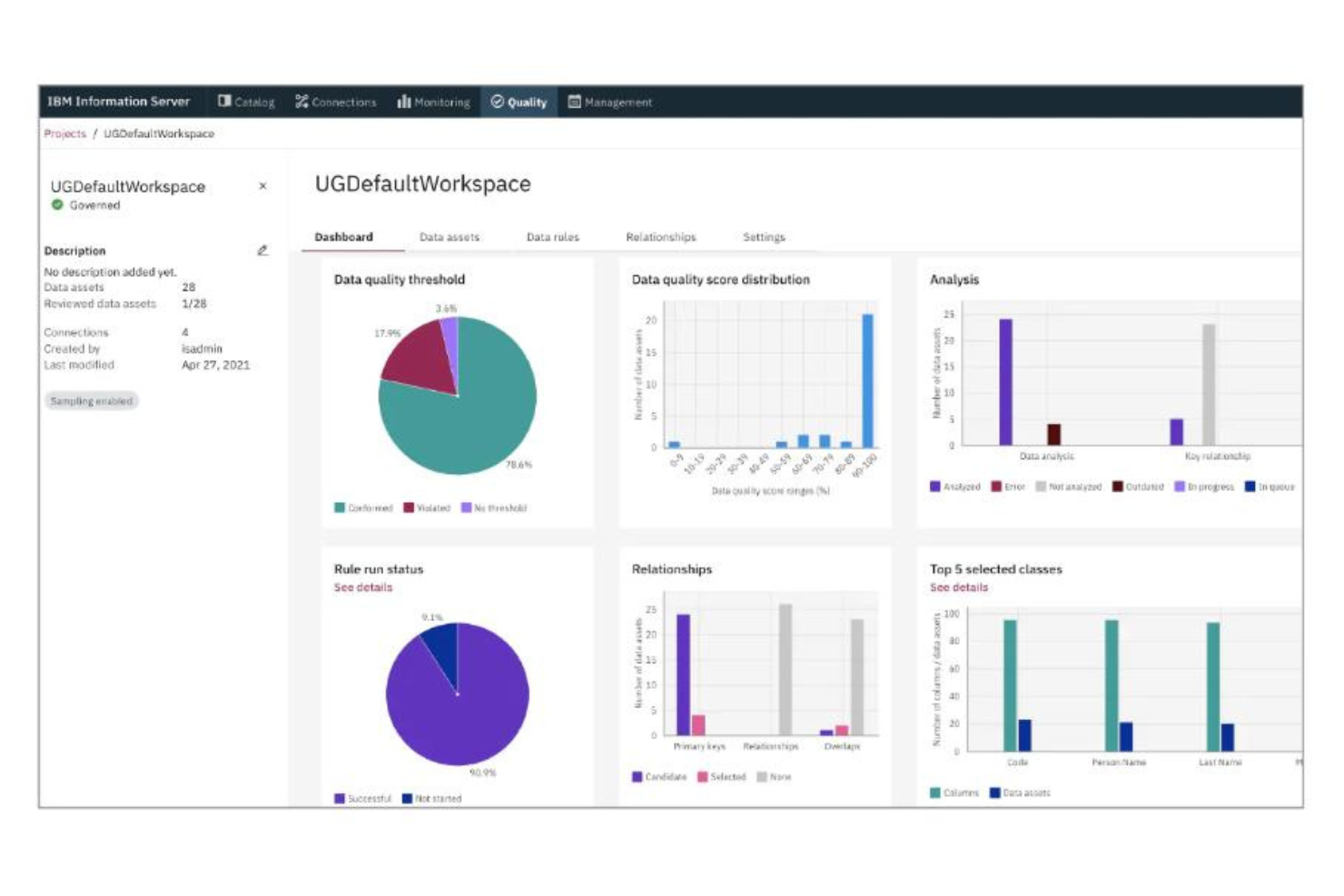

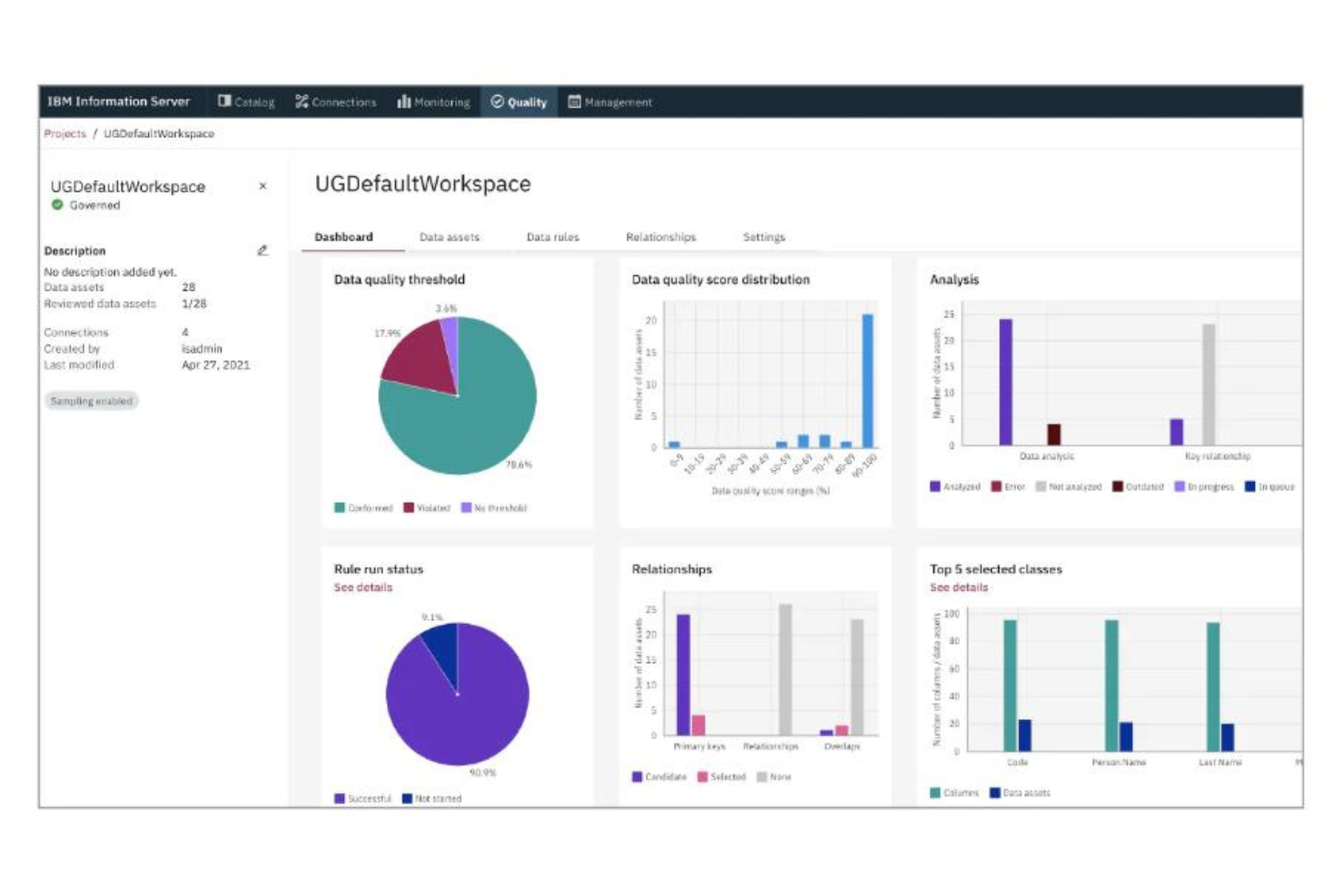

IBM Infosphere Information Server est une plateforme intégrée pour l’intégration, le nettoyage, le contrôle et la transformation des données. Elle offre une suite complète de fonctionnalités facilitant la gestion et l’exploitation des données d’entreprise, en garantissant leur qualité et leur cohérence dans toute l’organisation. Son orientation vers des fonctionnalités de niveau entreprise et son adaptabilité à divers environnements de données en font la meilleure solution pour une gestion robuste des données d’entreprise.

Pourquoi j’ai choisi IBM Infosphere Information Server :

J’ai choisi IBM Infosphere Information Server après avoir examiné ses capacités étendues à gérer les besoins complexes en données d’entreprise. Son architecture solide, sa scalabilité et sa gamme étendue de fonctionnalités le distinguent des autres outils. Je considère que cet outil est idéal pour la gestion robuste des données d’entreprise grâce à sa capacité à prendre en charge de vastes opérations de données, de l’intégration à l’assurance qualité, au sein de grandes organisations.

Fonctionnalités et intégrations remarquables :

Les fonctionnalités phares d’IBM Infosphere Information Server comprennent des cadres de qualité des données, la gestion des métadonnées et des capacités de traitement en parallèle. Ces fonctionnalités garantissent des données précises et cohérentes dans les différents systèmes de l’organisation. Les intégrations avec une large variété de bases de données, de systèmes ERP et de plateformes big data permettent la connexion et la collaboration entre différentes sources de données et technologies.

Pros and Cons

Pros:

- Suite complète pour tous les aspects de la gestion des données d’entreprise

- Évolutif pour gérer de gros volumes de données

- Large gamme d’intégrations avec diverses sources et plateformes de données

Cons:

- Peut s’avérer trop complexe pour les petites entreprises ou les cas d’utilisation simples

- La courbe d’apprentissage peut être importante pour les nouveaux utilisateurs de la plateforme

- L’absence de transparence sur les tarifs peut constituer un frein pour certains utilisateurs potentiels

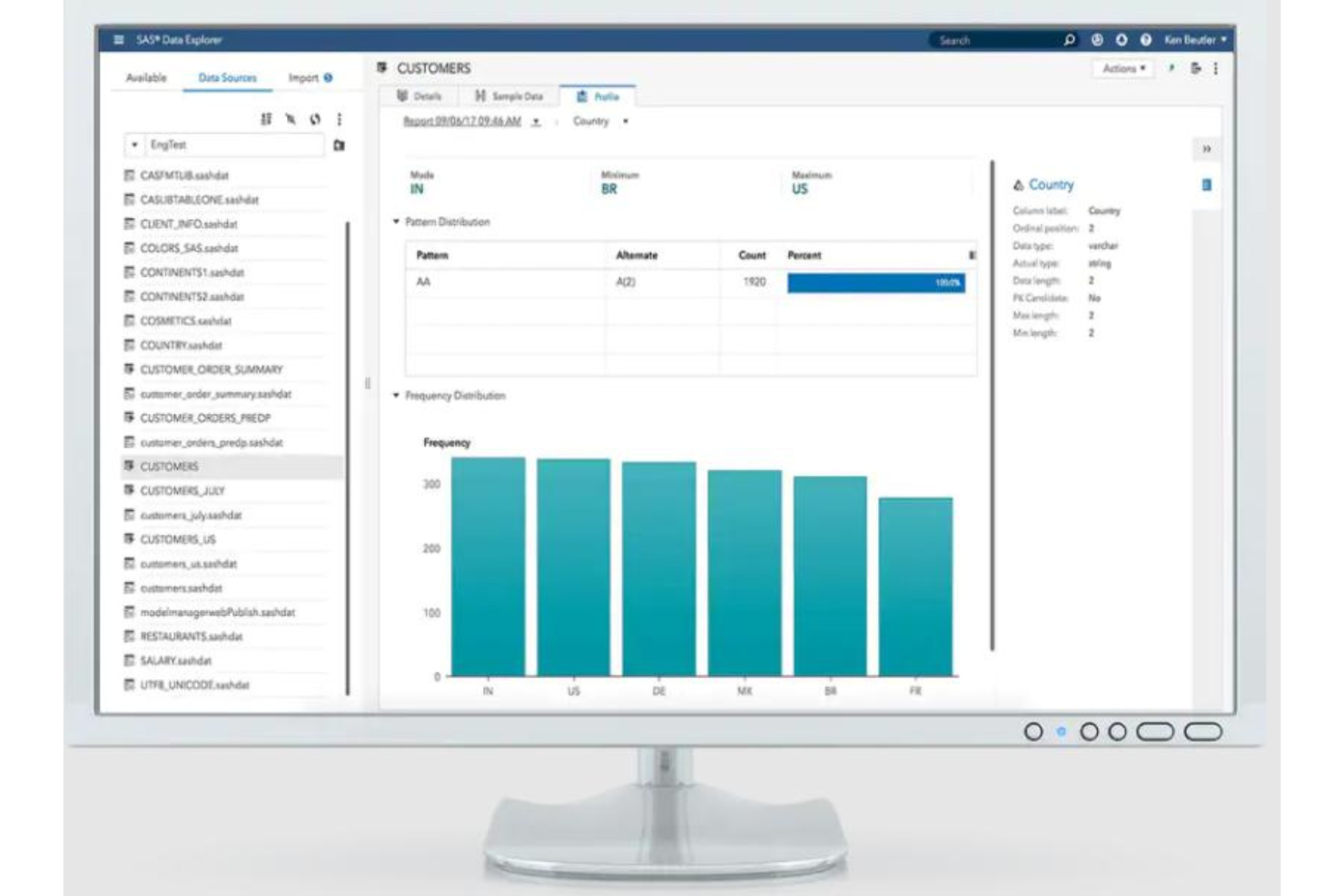

SAS Data Management est une solution complète conçue pour soutenir la qualité, l'intégration et la gouvernance des données. Offrant des fonctionnalités pour nettoyer, standardiser et enrichir les données, elle aide les organisations à garantir l'exactitude et la fiabilité des données, ce qui en fait la meilleure option pour la gouvernance de la qualité des données.

Pourquoi j'ai choisi SAS Data Management :

J'ai choisi SAS Data Management après avoir soigneusement comparé et évalué ses capacités à garantir la qualité et la gouvernance des données sur diverses plateformes. Ce qui le distingue, c'est son ensemble robuste de fonctionnalités axées sur les contrôles de qualité des données, la standardisation et la surveillance. J'ai sélectionné cet outil parce qu'il est le meilleur pour la gouvernance de la qualité des données, offrant des solutions uniques pour maintenir l'intégrité, l'exactitude et la cohérence des données au sein d'une organisation.

Fonctionnalités et intégrations remarquables :

SAS Data Management propose des fonctionnalités telles que le profilage de données, le nettoyage, l'appariement, la surveillance et la visualisation de l'origine des données. Son cadre de gouvernance des données garantit que les données sont fiables et cohérentes dans toute l'organisation. L'outil s'intègre à diverses bases de données, applications et même aux technologies de big data, offrant une solution unifiée pour la gestion de la qualité des données.

Pros and Cons

Pros:

- Mesures robustes de contrôle de la qualité des données

- Intégration flexible avec diverses plateformes

- Capacités complètes de surveillance et de reporting

Cons:

- Les informations tarifaires ne sont pas transparentes

- Peut nécessiter une formation spécialisée pour exploiter pleinement ses fonctionnalités

- Certains utilisateurs peuvent trouver l'interface moins intuitive que d'autres solutions du marché

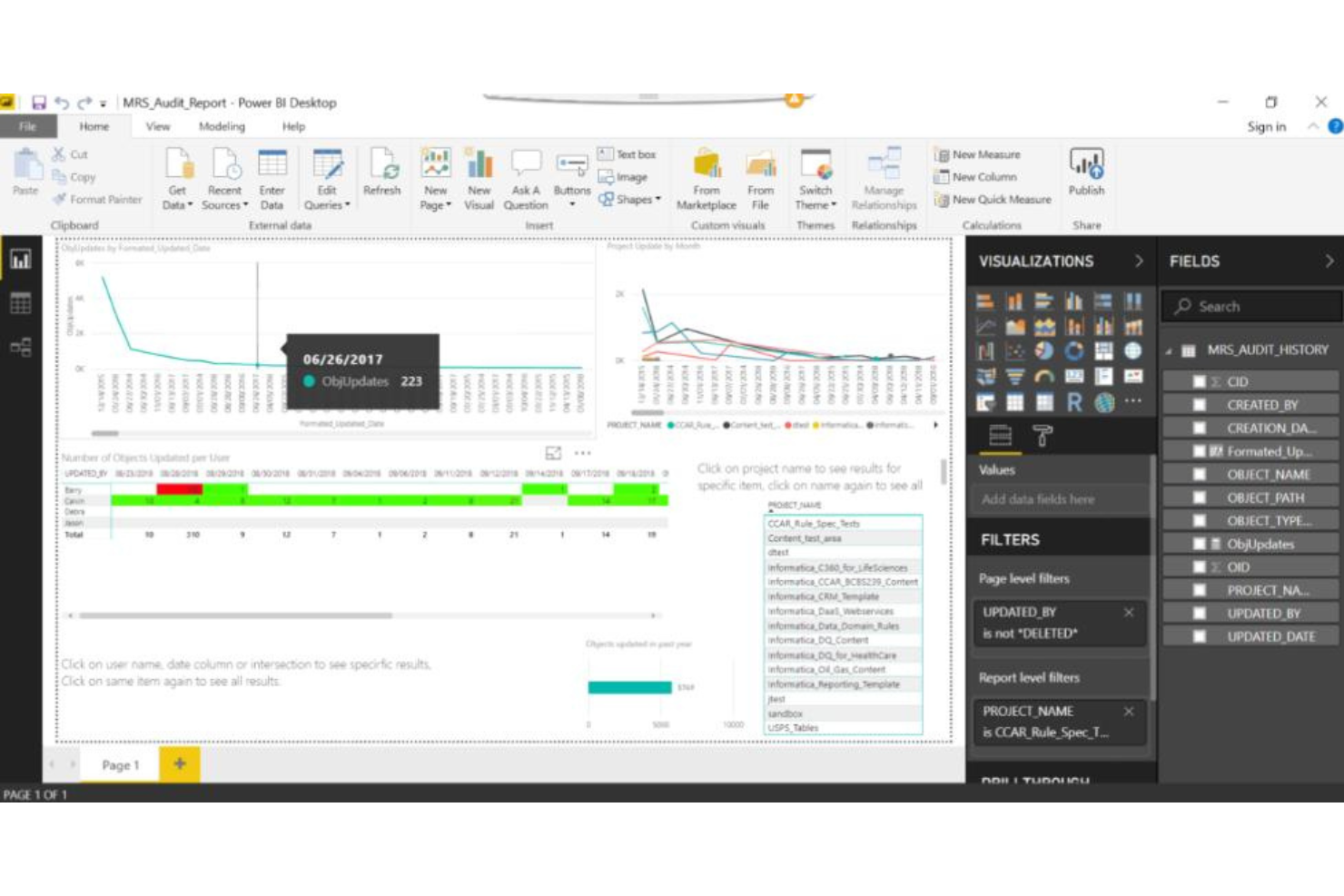

Informatica PowerCenter est une plate-forme d'intégration de données robuste conçue pour connecter, collecter et transformer des données provenant de diverses sources. Grâce à sa capacité à gérer l'intégration de données à grande échelle au sein de systèmes complexes, PowerCenter s'impose comme un choix de premier plan pour les organisations ayant besoin de gérer d'importants volumes de données.

Pourquoi j'ai choisi Informatica PowerCenter :

J'ai sélectionné Informatica PowerCenter pour cette liste après avoir minutieusement évalué son efficacité à traiter de grands ensembles de données variées. Sa capacité à intégrer les données au niveau de l'entreprise le distingue des autres outils. J'ai retenu cet outil car il est idéal pour l'intégration de données à grande échelle, offrant flexibilité, évolutivité et un moteur haute performance pour le traitement de volumes de données importants.

Fonctionnalités et intégrations remarquables :

PowerCenter propose une interface de conception visuelle qui simplifie la création et la gestion des flux de données. Il prend en charge la haute disponibilité et l'évolutivité et propose des fonctionnalités avancées de transformation des données. PowerCenter s'intègre à un large éventail de sources de données, notamment les bases de données relationnelles, les applications cloud, les réseaux sociaux et bien plus encore, permettant ainsi une gestion complète des données.

Pros and Cons

Pros:

- Conçu pour l'intégration de données à grande échelle

- Interface de conception visuelle robuste simplifiant la gestion des flux de données

- Prend en charge un large éventail de sources de données et de plates-formes

Cons:

- Les renseignements sur la tarification peuvent ne pas être facilement accessibles

- Peut présenter une courbe d'apprentissage importante pour les personnes novices en intégration de données

- Peut nécessiter des ressources supplémentaires pour l'optimisation et l'ajustement dans des environnements complexes

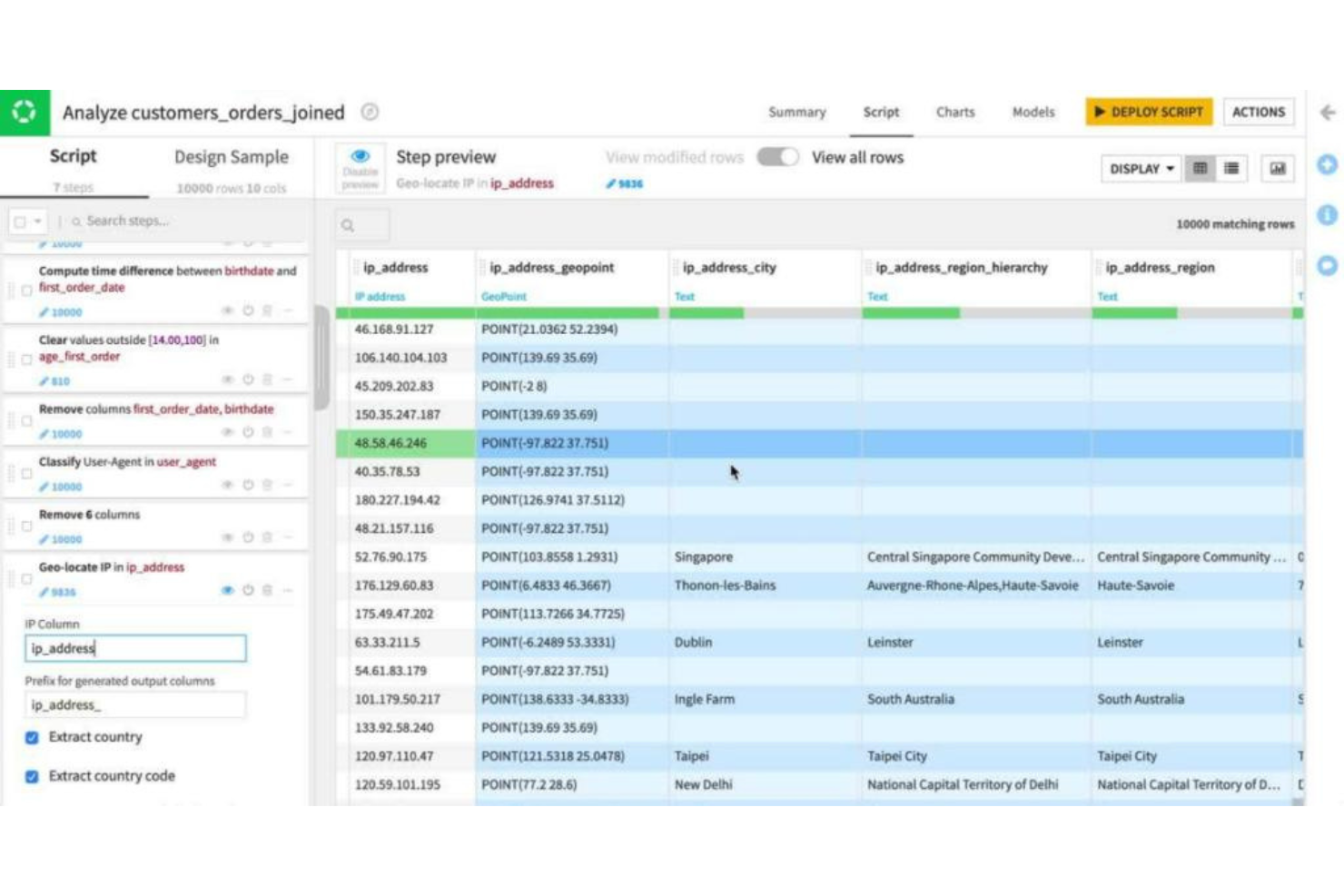

Dataiku est une plateforme conçue pour permettre la collaboration entre les data scientists, les analystes et les équipes métier. En proposant des outils pour la préparation des données, l'apprentissage automatique et le déploiement, elle permet à différents membres de l'équipe de travailler ensemble efficacement sur des projets de science des données. Cette approche collaborative fait de Dataiku la solution idéale pour gérer et exécuter des projets de science des données impliquant plusieurs parties prenantes.

Pourquoi j'ai choisi Dataiku :

J'ai choisi Dataiku après avoir soigneusement examiné ses fonctionnalités pour favoriser la collaboration entre les professionnels de la donnée. La capacité de la plateforme à permettre l'interaction entre les data scientists et les utilisateurs métiers la distingue des autres. En renforçant la collaboration, elle assure une livraison plus rapide des projets et des solutions plus efficaces, c'est pourquoi je pense que cet outil est idéal pour les projets collaboratifs de science des données.

Fonctionnalités et intégrations remarquables :

Les fonctionnalités phares de Dataiku incluent des espaces projet partagés, la préparation visuelle des données et des workflows automatisés de machine learning. Ces fonctionnalités offrent un environnement unifié où tous les membres de l'équipe peuvent travailler sur des objectifs communs. Elle propose des intégrations clés avec les écosystèmes Python, R, SQL et Hadoop, entre autres, permettant aux utilisateurs de tirer parti de différents outils et technologies au sein d'une même plateforme.

Pros and Cons

Pros:

- Favorise la collaboration entre des équipes diversifiées

- Prise en charge étendue de divers langages et outils

- Interface utilisateur intuitive adaptée aussi bien aux utilisateurs techniques que non techniques

Cons:

- Les informations sur la tarification peuvent ne pas être facilement accessibles

- Peut être trop complexe pour de petites équipes ou des utilisateurs individuels

- Nécessite un certain temps d'adaptation pour ceux qui découvrent les plateformes de science des données

Autres logiciels de préparation des données

Voici d’autres logiciels de préparation des données qui n’ont pas été inclus dans ma sélection, mais qui méritent d’être découverts :

- DataRobot

Idéal pour la préparation des données pilotée par l’IA

- Trifacta

Idéal pour le nettoyage automatisé des données

- Microsoft Power Query

Idéal pour la transformation et l'intégration facile des données

Critères de sélection des logiciels de préparation des données

Pour sélectionner les meilleurs logiciels de préparation des données à inclure dans cette liste, j’ai pris en compte les besoins courants des acheteurs et leurs points de douleur, comme l’efficacité du nettoyage des données et l’intégration avec les systèmes existants. J’ai également utilisé la grille suivante pour évaluer chaque solution de façon structurée et équitable :

Fonctionnalités de base (25 % du score total)

Pour figurer dans cette liste, chaque solution devait répondre à ces cas d’usage fréquents :

- Nettoyage et transformation des données

- Intégration de données depuis plusieurs sources

- Profilage des données et évaluation de leur qualité

- Enrichissement et combinaison des données

- Exportation des données dans différents formats

Fonctionnalités distinctives (25 % du score total)

Pour affiner la sélection, j’ai aussi recherché des fonctionnalités uniques, telles que :

- Traitement des données en temps réel

- Suivi automatisé de la traçabilité des données

- Masquage avancé des données pour la confidentialité

- Outils collaboratifs pour les flux de travail

- Modèles d’analytique prédictive intégrés

Utilisabilité (10 % du score total)

Pour évaluer l’ergonomie de chaque système, j’ai pris en compte les éléments suivants :

- Conception d’interface utilisateur intuitive

- Fonctionnalité de glisser-déposer

- Tableaux de bord et mises en page personnalisables

- Courbe d’apprentissage pour les nouveaux utilisateurs

- Accessibilité sur différents appareils et plateformes

Intégration des nouveaux utilisateurs (10% du score total)

Pour évaluer l’expérience d’intégration sur chaque plateforme, j’ai pris en compte les éléments suivants :

- Disponibilité de ressources de formation complètes

- Visites guidées interactives étape par étape

- Accès à des modèles préconçus et des exemples

- Chatbots réactifs pour une assistance instantanée

- Webinaires réguliers pour un apprentissage continu

Support client (10% du score total)

Pour évaluer les services d’assistance de chaque fournisseur de logiciel, j’ai pris en compte les éléments suivants :

- Disponibilité de canaux d’assistance 24h/24 et 7j/7

- Accès à un responsable client dédié

- Base de connaissances en ligne complète

- Temps de réponse rapides aux demandes

- Forums communautaires d’utilisateurs pour une aide entre pairs

Rapport qualité/prix (10% du score total)

Pour évaluer le rapport qualité/prix de chaque plateforme, j’ai pris en compte les éléments suivants :

- Tarification compétitive par rapport à des outils similaires

- Plans tarifaires flexibles adaptés à différents besoins

- Transparence des tarifs et des frais

- Réductions pour engagements à long terme

- Périodes d’essai gratuites ou démonstrations pour une première évaluation

Avis clients (10% du score total)

Pour me faire une idée de la satisfaction globale des clients, j’ai pris en compte les points suivants lors de la lecture des avis clients :

- Cohérence des retours positifs

- Problèmes ou difficultés fréquemment signalés

- Témoignages d’utilisateurs mettant en avant des avantages précis

- Retours sur les expériences avec le support client

- Notes et évaluations de satisfaction globale

Comment choisir un logiciel de préparation de données

Il est facile de se perdre dans de longues listes de fonctionnalités et des structures tarifaires complexes. Pour vous aider à rester concentré lors de votre processus de sélection de logiciel, voici une liste de critères à garder à l’esprit :

| Critère | À prendre en compte |

|---|---|

| Évolutivité | Le logiciel évoluera-t-il avec vos besoins en données ? Prenez en compte les volumes de données futurs et si l’outil peut supporter une complexité croissante sans perte de performance. |

| Intégrations | Est-il compatible avec vos systèmes actuels ? Assurez-vous de la compatibilité avec vos sources de données, plates-formes d’analyse et applications métier existantes afin d’éviter les silos. |

| Personnalisation | Pouvez-vous l’adapter à vos processus ? Recherchez des outils configurables pour coller à vos modes de fonctionnement sans codage poussé. |

| Simplicité d’utilisation | Est-il convivial pour votre équipe ? Évaluez la courbe d’apprentissage et la capacité des utilisateurs peu techniques à s’y repérer efficacement. |

| Mise en œuvre et intégration | Combien de temps pour le déployer ? Évaluez les ressources et la durée nécessaires pour la configuration, y compris la formation et l’accompagnement pendant la période de transition. |

| Coût | Est-ce compatible avec votre budget ? Comparez les modèles tarifaires, frais cachés compris, et prenez en compte le coût total de possession dans la durée. |

| Garanties de sécurité | Vos exigences de protection des données sont-elles couvertes ? Vérifiez la présence de chiffrement, de contrôles d’accès et la conformité aux normes du secteur afin de sécuriser les données sensibles. |

| Disponibilité du support | De l’aide est-elle accessible à tout moment ? Privilégiez les options de support 24/7, les gestionnaires de compte dédiés et les communautés d’utilisateurs pour vous aider en cas de problème. |

Qu’est-ce qu’un logiciel de préparation de données ?

Un logiciel de préparation de données est un outil qui permet de nettoyer, organiser et transformer des données brutes en un format exploitable pour l’analyse. Ces outils sont généralement utilisés par des analystes de données, des data scientists et des professionnels de la business intelligence afin d’améliorer la précision et l’efficacité des données. Les fonctions de nettoyage, de transformation et d’intégration des données facilitent la gestion d’importants volumes d’informations et leur préparation à l’analyse. En somme, ces logiciels permettent de gagner du temps et de limiter les erreurs, ce qui favorise la prise de décisions éclairées.

Fonctionnalités

Lors du choix d’un logiciel de préparation de données, veillez à rechercher les fonctionnalités clés suivantes :

- Nettoyage des données : Détectez et corrigez automatiquement les erreurs dans les ensembles de données pour garantir leur précision et leur fiabilité.

- Transformation des données : Convertissez les données dans le format ou la structure désirée, afin de les préparer à l’analyse.

- Capacités d’intégration : Connectez-vous à diverses sources de données et applications pour rassembler et consolider les informations sans effort.

- Profilage des données : Analysez les ensembles de données pour comprendre leur structure, leur contenu et leur qualité, fournissant ainsi des informations utiles pour la préparation.

- Suivi de la traçabilité des données : Surveillez le flux et la transformation des données afin d’assurer transparence et traçabilité.

- Workflows automatisés : Rationalisez les tâches et processus répétitifs pour gagner du temps et réduire les efforts manuels.

- Outils de collaboration : Permettez à plusieurs utilisateurs de travailler ensemble sur des projets de données, favorisant ainsi le travail d’équipe et la productivité.

- Garanties de sécurité : Protégez les données sensibles grâce au chiffrement et à un contrôle d’accès, en garantissant la conformité avec les normes.

- Outils de visualisation : Présentez les données sous forme graphique pour aider les utilisateurs à les interpréter et à en tirer rapidement des conclusions.

- Intégration de l’apprentissage automatique : Permettez la modélisation avancée des données et la prédiction, renforçant ainsi les capacités d’analyse.

Avantages

L’implémentation d’un logiciel de préparation de données offre de nombreux avantages pour votre équipe et votre entreprise. Voici quelques bénéfices auxquels vous pouvez vous attendre :

- Qualité des données améliorée : Le nettoyage et le profilage automatiques garantissent que vos données sont précises et fiables pour la prise de décision.

- Gain de temps : Les workflows automatisés et les capacités d’intégration réduisent les efforts manuels, permettant à votre équipe de se concentrer sur l’analyse.

- Collaboration renforcée : Les outils de collaboration permettent aux membres de l’équipe de travailler ensemble efficacement sur des projets de données.

- Meilleure compréhension des données : Les outils de visualisation aident les utilisateurs à interpréter les données rapidement, ce qui favorise des décisions plus rapides et mieux informées.

- Sécurité renforcée : Les protections de sécurité protègent les informations sensibles et assurent la conformité avec les réglementations sur la protection des données.

- Évolutivité : La capacité à gérer de grands volumes de données accompagne la croissance de l’entreprise et l’évolution des besoins.

- Analyses avancées : L’intégration de l’apprentissage automatique propose des fonctions de prédiction qui renforcent vos démarches analytiques.

Coûts & Tarification

Choisir un logiciel de préparation de données implique de comprendre les différents modèles et plans tarifaires proposés. Les coûts varient en fonction des fonctionnalités, de la taille de l’équipe, des modules complémentaires, et plus encore. Le tableau ci-dessous résume les plans courants, leurs prix moyens et les principales fonctionnalités généralement incluses dans les solutions de préparation de données :

Tableau comparatif des plans pour les logiciels de préparation de données

| Type de plan | Prix moyen | Fonctionnalités courantes |

|---|---|---|

| Plan gratuit | $0 | Nettoyage de données basique, intégrations limitées, et assistance communautaire. |

| Plan personnel | $10-$30/user/month | Transformation des données, profilage des données, et fonctions d’automatisation basiques. |

| Plan professionnel | $30-$60/user/month | Intégrations avancées, outils de collaboration, et sécurité renforcée. |

| Plan entreprise | $60-$120/user/month | Personnalisation complète, gouvernance des données approfondie, et support dédié. |

FAQ sur les logiciels de préparation des données

Voici quelques réponses aux questions courantes concernant les logiciels de préparation des données :

Quels outils peuvent automatiser la préparation des données ?

Des outils comme Alteryx, Tableau Prep et Trifacta automatisent les tâches de préparation des données. Ces solutions proposent des fonctionnalités de nettoyage, de transformation et d’intégration des données, réduisant ainsi l’effort manuel. L’automatisation permet à votre équipe de se concentrer sur l’analyse en rationalisant les tâches de données répétitives et chronophages.

Les logiciels de préparation des données peuvent-ils gérer à la fois des données structurées et non structurées ?

Oui, la plupart des outils modernes peuvent traiter les deux types. Les données structurées (comme les feuilles de calcul ou les bases de données) et les données non structurées (comme les e-mails, les textes ou les publications sur les réseaux sociaux) peuvent être unifiées dans un seul environnement. Cette flexibilité permet à votre équipe de préparer des ensembles de données enrichis pour l’analyse ou l’apprentissage automatique sans avoir besoin d’outils distincts pour chaque type de données.

Comment l'automatisation améliore-t-elle les workflows de préparation des données ?

L’automatisation permet à votre équipe de planifier des tâches de nettoyage, de transformation et d’intégration de données sans intervention manuelle. Vous pouvez configurer des workflows reproductibles qui s’exécutent quotidiennement ou en réponse à de nouvelles données. Cela permet non seulement de gagner du temps, mais aussi d’assurer la cohérence dans le traitement de vos données, réduisant ainsi les risques d’erreurs humaines.

Et après :

Si vous êtes en train de rechercher un logiciel de préparation des données, contactez gratuitement un conseiller SoftwareSelect pour des recommandations personnalisées.

Vous remplissez un formulaire et avez une brève conversation pour préciser vos besoins. Ensuite, vous recevrez une liste restreinte de logiciels à évaluer. Ils vous accompagneront même tout au long du processus d'achat, y compris lors des négociations de prix.