Beste Databricks-Alternativen im Überblick

Databricks ist leistungsstark, aber passt nicht immer zu jedem. Vielleicht ist Ihr Team an den Kosten gescheitert, hat mit der Lernkurve der Plattform gekämpft oder benötigt etwas Flexibleres für Multi-Cloud- oder On-Premises-Setups. Wie dem auch sei, wenn Sie hier sind, suchen Sie wahrscheinlich nach einer Alternative, die ähnliche Data-Lakehouse-Funktionen bietet – jedoch ohne die damit verbundenen Kompromisse.

Ich habe mit Daten-Teams in Startups und Großunternehmen zusammengearbeitet und Plattformen wie Databricks, Snowflake und andere bewertet und implementiert. Ich weiß aus erster Hand, was nötig ist, um Analysen im großen Maßstab zu ermöglichen, chaotische Datenquellen zu vereinheitlichen und zuverlässige Pipelines zu bauen, die tatsächlich genutzt werden.

In diesem Leitfaden stelle ich Ihnen Databricks-Alternativen vor, die Sie sich genauer ansehen sollten – Tools, mit denen Sie Daten intuitiver speichern, transformieren und analysieren können, und die Ihnen gleichzeitig Raum für Wachstum und Anpassung an Ihr Team geben.

Warum Sie unseren Software-Reviews vertrauen können

Seit 2023 testen und bewerten wir SaaS-Entwicklungssoftware. Als Tech-Expert:innen wissen wir, wie entscheidend und schwer es ist, bei der Softwareauswahl die richtige Entscheidung zu treffen. Daher investieren wir viel Zeit in gründliche Recherchen, um unseren Leser:innen bessere Software-Kaufentscheidungen zu ermöglichen.

Wir haben mehr als 2.000 Tools für verschiedene SaaS-Entwicklungsszenarien getestet und über 1.000 umfassende Software-Reviews geschrieben. Erfahren Sie wie wir transparent bleiben und sehen Sie sich unsere Software-Review-Methodik an.

Table of Contents

Zusammenfassung: Die besten Databricks-Alternativen

Diese Vergleichstabelle fasst die Preisinformationen zu meinen Top-Auswahlmöglichkeiten der Databricks-Konkurrenz zusammen, um Ihnen die passende Lösung für Ihr Budget und Ihre Anforderungen zu erleichtern.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Am besten geeignet für Cloud-Datenlagerung | Nein | $40 pro Credit (monatliche Abrechnung) | Website | |

| 2 | Am besten für Aufgaben der Datenintegration geeignet | Nein | $1,170/user/year (jährliche Abrechnung) | Website | |

| 3 | Am besten für verwaltete Spark- und Hadoop-Umgebungen | Nein | $0.01 pro virtuelle CPU im Cluster und Stunde | Website | |

| 4 | Am besten geeignet für Hadoop-Verarbeitung | Nein | $0,032 pro Stunde für eine m5.xlarge-Instanz (Abrechnung pro Sekunde der Nutzung) | Website | |

| 5 | Am besten für SQL-Analysen | Nein | $30/user/month (jährliche Abrechnung) | Website | |

| 6 | Am besten geeignet für In-Memory-Verarbeitung | Not available | Kostenlos | Website | |

| 7 | Am besten geeignet für die Anforderungen von Unternehmensdatenbanken | Nein | $68/user/month (jährliche Abrechnung) | Website | |

| 8 | Am besten für schnelle SQL-Abfragen | Ja | $20/TB verarbeitete Daten | Website | |

| 9 | Am besten für KI- und ML-Lösungen | Ja | $5000/user/year (jährliche Abrechnung) | Website | |

| 10 | Am besten für Self-Service-Analysen geeignet | Nein | $210/user/month (jährliche Abrechnung) | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Bewertung: Beste Databricks-Alternativen

Nachfolgend finden Sie meine ausführlichen Zusammenfassungen der besten Databricks-Alternativen, die es auf meine Shortlist geschafft haben. Meine Bewertungen bieten einen detaillierten Blick auf Schlüsselfunktionen, Vorteile & Nachteile, Integrationen und ideale Anwendungsfälle der jeweiligen Tools, damit Sie die beste Lösung für sich finden.

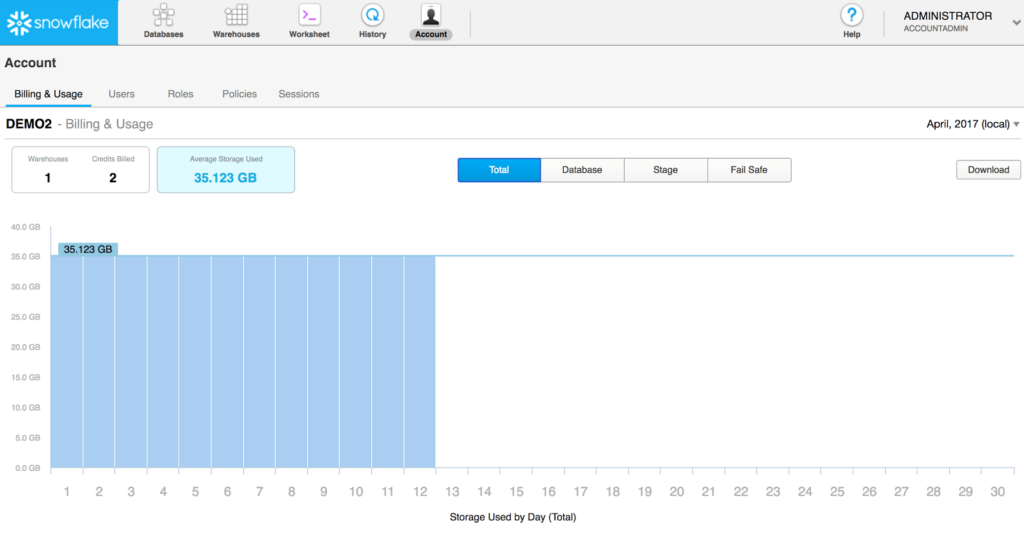

Snowflake ist eine cloudbasierte Data-Warehouse-Plattform, die für Datenanalysten und Business-Intelligence-Teams entwickelt wurde. Sie ermöglicht es Nutzern, Daten im großen Maßstab zu speichern und zu analysieren, um Erkenntnisse zu gewinnen, die Geschäftsentscheidungen vorantreiben.

Warum ich Snowflake gewählt habe: Snowflake ist speziell für Cloud-Datenlager konzipiert und bietet Funktionen wie automatisches Skalieren, um unterschiedliche Arbeitslasten effizient zu bewältigen. Die Architektur trennt Speicher und Rechenleistung, sodass Sie beide unabhängig voneinander nach Bedarf skalieren können. Die Datenfreigabefunktionen der Plattform ermöglichen nahtlose Zusammenarbeit zwischen verschiedenen Teams. Zusätzlich unterstützt Snowflake strukturierte und semi-strukturierte Daten, was es vielseitig für unterschiedliche Datentypen macht.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen eine Multi-Cluster-Architektur für verbesserte Leistung, sichere Datenfreigabe zur Zusammenarbeit ohne Datenbewegung und eine intuitive SQL-Oberfläche für einfache Abfragen. Diese Funktionen steigern die Flexibilität und Sicherheit im Umgang mit Daten in Ihrem Team.

Integrationen beinhalten Tableau, Looker, Power BI, AWS, Microsoft Azure, Google Cloud Platform, Salesforce, Informatica, Alteryx und Talend.

Pros and Cons

Pros:

- Sichere Datenfreigabe

- Unterstützt verschiedene Datentypen

- Automatische Skalierungsfunktionen

Cons:

- Begrenzte On-Premise-Optionen

- Erfordert Cloud-Expertise

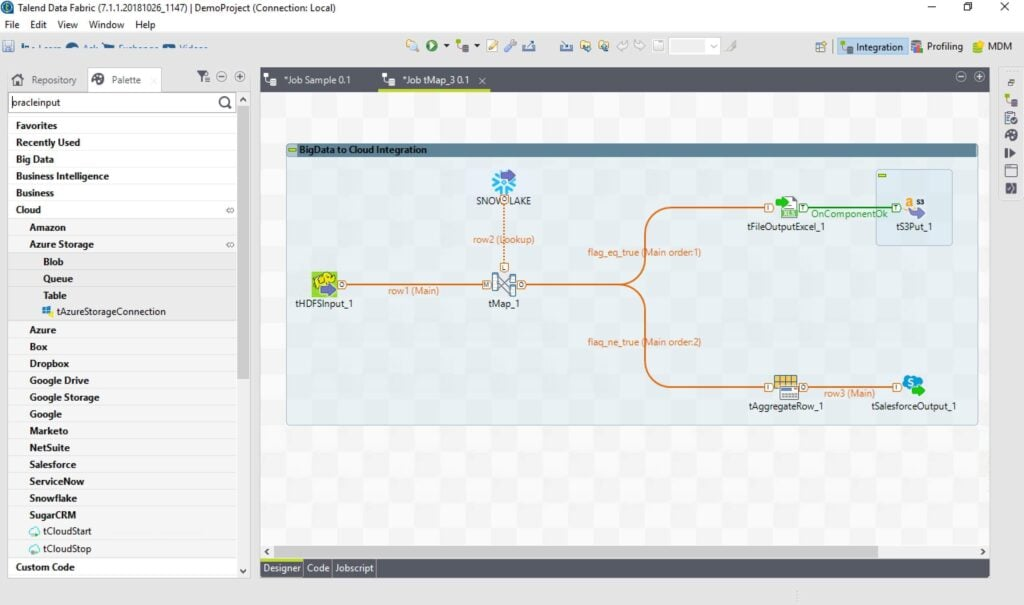

Talend ist eine Datenintegrationsplattform, die IT- und Datenteams dabei unterstützt, den Prozess der Verbindung, Bereinigung und Transformation von Daten zu vereinfachen. Sie ermöglicht es Anwendern, Daten aus verschiedenen Quellen zu verwalten und zu integrieren und bietet so eine einheitliche Datenumgebung.

Warum ich Talend gewählt habe: Talend überzeugt im Bereich der Datenintegration durch eine umfassende Suite von Werkzeugen zur Verbindung verschiedenster Datenquellen. Es verfügt über eine visuelle Benutzeroberfläche, die die Erstellung von Datenpipelines vereinfacht und es Ihrem Team erleichtert, komplexe Datenaufgaben zu verwalten. Talend unterstützt zudem die Verarbeitung von Echtzeitdaten, was für Unternehmen, die auf aktuelle Einblicke angewiesen sind, von entscheidender Bedeutung ist. Das umfangreiche Set an Konnektoren stellt die Kompatibilität mit einer Vielzahl von Datenumgebungen sicher und unterstreicht damit den Fokus auf Datenintegrationsaufgaben.

Herausragende Funktionen & Integrationen:

Funktionen umfassen eine Drag-and-Drop-Oberfläche für den Aufbau von Daten-Workflows, integrierte Werkzeuge zur Datenqualitätssicherung sowie Unterstützung für Big-Data-Umgebungen. Diese Funktionen helfen dabei, Ihre Datenmanagement-Prozesse zu optimieren und die Zuverlässigkeit der Daten zu verbessern.

Integrationen umfassen Salesforce, SAP, AWS, Microsoft Azure, Google Cloud Platform, Apache Hadoop, Apache Spark, Snowflake, Oracle und IBM Db2.

Pros and Cons

Pros:

- Visuelle Benutzeroberfläche für einfache Bedienung

- Echtzeitdatenverarbeitung

- Umfangreiche Konnektoren-Bibliothek

Cons:

- Kann ressourcenintensiv sein

- Komplexer Einrichtungsprozess

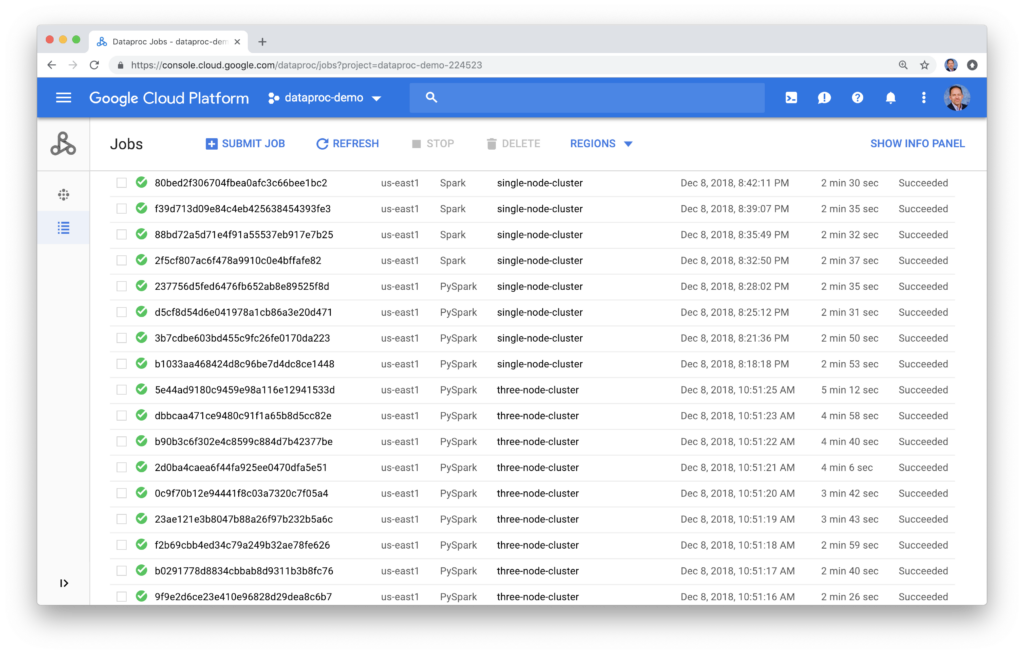

Google Cloud Dataproc ist ein cloudbasierter Dienst, der für Dateningenieure und Analysten entwickelt wurde, um Apache Spark- und Hadoop-Cluster auszuführen. Er vereinfacht die Verwaltung und Bereitstellung von Big-Data-Tools, sodass sich Ihr Team auf Datenverarbeitungsaufgaben konzentrieren kann.

Warum ich Google Cloud Dataproc gewählt habe: Google Cloud Dataproc überzeugt durch eine effiziente Verwaltung von Spark- und Hadoop-Clustern und bietet extrem schnelle Bereitstellungszeiten. Es integriert sich nahtlos mit anderen Google-Cloud-Diensten und erweitert so die Datenverarbeitungsfähigkeiten Ihres Teams. Die automatische Skalierung der Plattform passt die Ressourcen an Ihre Arbeitslast an und reduziert so den manuellen Aufwand. Darüber hinaus ist das Preismodell für Unternehmen, die ihre Ressourcen optimal nutzen möchten, kosteneffizient.

Herausragende Funktionen & Integrationen:

Funktionen umfassen schnelle Cluster-Startzeiten, Integration mit Google Cloud Storage für einfachen Datenzugriff sowie integriertes Monitoring und Logging für eine bessere Clusterverwaltung. Diese Funktionen erleichtern Ihrem Team das effektive Verwalten und Analysieren großer Datenmengen.

Integrationen umfassen Google Cloud Storage, BigQuery, Google Cloud Pub/Sub, Google Cloud Bigtable, Google Cloud Logging, Google Cloud Monitoring, Google Cloud IAM, Apache Hive, Apache Pig und Apache Spark.

Pros and Cons

Pros:

- Integriertes Monitoring und Logging

- Automatische Skalierungsfunktionen

- Schnelle Cluster-Startzeiten

Cons:

- Potenzial für hohe Kosten

- Komplexe Ersteinrichtung

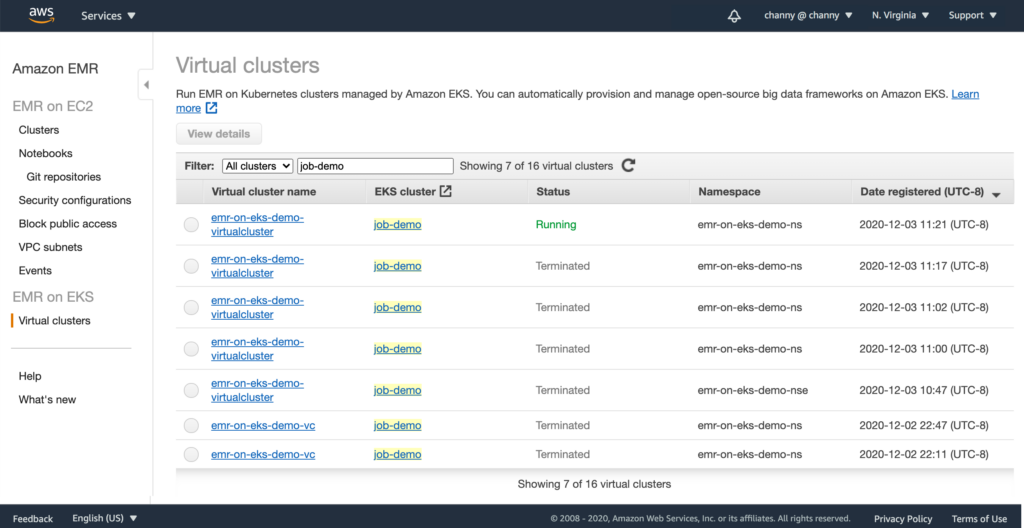

Amazon EMR ist ein cloudbasierter Dienst, der für Dateningenieure und Analysten entwickelt wurde, um große Datenmengen mit Hadoop zu verarbeiten. Er vereinfacht das Management von Big-Data-Frameworks, sodass sich Ihr Team auf die Datenanalyse anstatt auf die Infrastruktur konzentrieren kann.

Warum ich Amazon EMR ausgewählt habe: Amazon EMR ist ideal für die Hadoop-Verarbeitung und bietet Skalierbarkeit, um große Datensätze effizient zu bewältigen. Es lässt sich in verschiedene AWS-Dienste integrieren und stellt Ihrem Team Werkzeuge zur Verfügung, um die Datenverarbeitungsfähigkeiten zu verbessern. Die Flexibilität der Plattform erlaubt es, unterschiedliche Instanztypen je nach Arbeitslast auszuwählen. Darüber hinaus passt das kosteneffiziente Preismodell zu Unternehmen, die ihre Ressourcen effizient verwalten möchten.

Herausragende Funktionen & Integrationen:

Funktionen umfassen die einfache Bereitstellung von Clustern mit nur wenigen Klicks, automatisches Skalieren zur Anpassung der Ressourcen nach Bedarf und anpassbare Konfigurationen für spezifische Workloads. Diese Funktionen erleichtern es Ihrem Team, Big Data zu verwalten und zu verarbeiten.

Integrationen umfassen Amazon S3, Amazon RDS, Amazon DynamoDB, Amazon CloudWatch, AWS Lambda, Amazon Redshift, Amazon VPC, Amazon Kinesis, AWS Glue und Apache HBase.

Pros and Cons

Pros:

- Kosteneffizient für variable Arbeitslasten

- Skalierbar für große Datensätze

- Einfache Integration mit AWS-Diensten

Cons:

- Beschränkt auf das AWS-Ökosystem

- Hohe Lernkurve

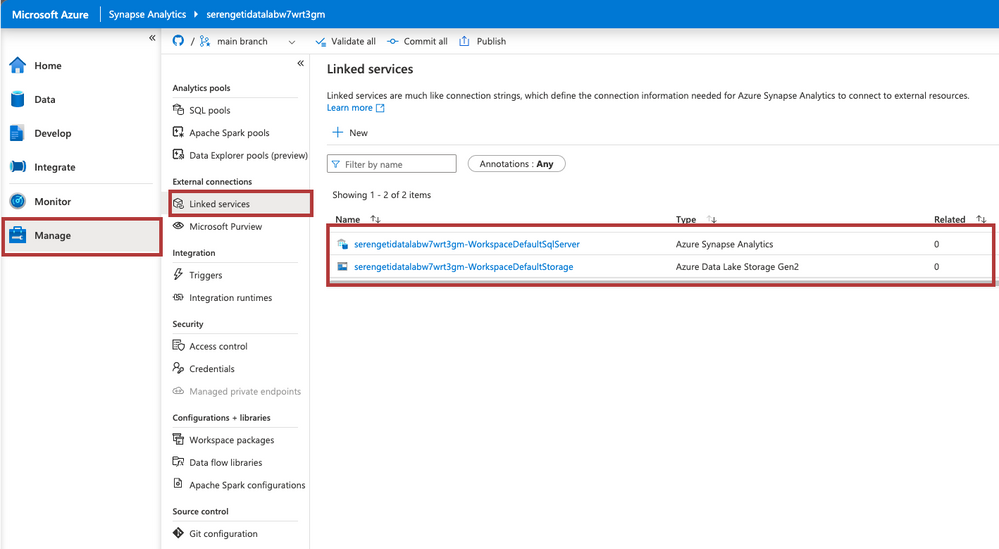

Azure Synapse Analytics ist ein cloudbasierter Analysedienst, der für Dateningenieure und Analysten entwickelt wurde, um SQL-Analysen und Big Data-Verarbeitung durchzuführen. Er ermöglicht Ihrem Team, Daten über Ihre gesamte Datenlandschaft hinweg effizient zu analysieren und zu visualisieren.

Warum ich Azure Synapse Analytics ausgewählt habe: Azure Synapse Analytics eignet sich hervorragend für SQL-Analysen und bietet eine einheitliche Plattform zum Erfassen, Vorbereiten, Verwalten und Bereitstellen von Daten für unmittelbare Business-Intelligence-Anforderungen. Es integriert sich nahtlos in Azure-Dienste und verbessert so die Fähigkeit Ihres Teams, innerhalb des Cloud-Ökosystems zu arbeiten. Die bedarfsabhängigen Abfragefunktionen des Tools ermöglichen es, Daten nach Bedarf zu verarbeiten, ohne Ressourcen vorab bereitstellen zu müssen. Zudem sorgen integrierte Sicherheitsfunktionen für den Schutz der Daten und machen das Tool zu einer zuverlässigen Wahl für Unternehmen mit hohen Sicherheitsanforderungen.

Herausragende Funktionen & Integrationen:

Funktionen umfassen einen dedizierten SQL-Pool für leistungsstarke Analysen, integrierte Data-Lake-Funktionen für großflächige Datenspeicherung sowie eine visuelle Oberfläche zum Erstellen von Datenpipelines. Diese Funktionen stärken die Fähigkeit Ihres Teams, Daten effektiv zu verwalten und zu analysieren.

Integrationen umfassen Azure Data Lake Storage, Azure Blob Storage, Power BI, Azure Machine Learning, Azure Data Factory, Azure Stream Analytics, Azure Cosmos DB, Azure Data Explorer, Azure Cognitive Services und Microsoft Excel.

Pros and Cons

Pros:

- Integrierte Data Lake-Unterstützung

- Bedarfsabhängige Abfragefunktionen

- Einheitliche Analyseumgebung

Cons:

- Erfordert Azure-Kenntnisse

- Begrenzte Integrationen außerhalb von Azure

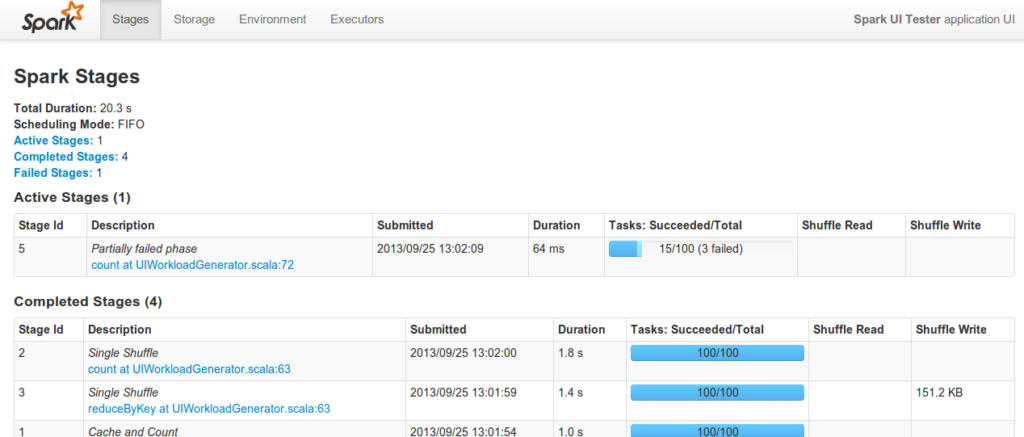

Apache Spark ist eine Open-Source-Datenverarbeitungs-Engine, die für Datenwissenschaftler und Ingenieure entwickelt wurde, um groß angelegte Datenanalysen zu bewältigen. Sie zeichnet sich durch schnelle Ausführung komplexer Berechnungen aus und eignet sich daher sowohl für Echtzeit-Datenanalysen als auch für Batch-Verarbeitung.

Warum ich Apache Spark gewählt habe: Apache Spark ist für seine In-Memory-Verarbeitungsfunktionen bekannt, die die Rechengeschwindigkeit erheblich steigern. Es unterstützt mehrere Programmiersprachen, sodass Ihr Team die Sprache nutzen kann, mit der es am vertrautesten ist. Die Fähigkeit des Tools, sowohl Batch- als auch Streaming-Daten zu verarbeiten, macht es vielseitig für unterschiedliche Anforderungen in der Datenverarbeitung. Darüber hinaus ermöglicht der Open-Source-Charakter eine umfassende Anpassung, was besonders zu seinem Fokus auf die In-Memory-Verarbeitung passt.

Herausragende Funktionen & Integrationen:

Funktionen umfassen eine einheitliche Analyse-Engine für Big-Data-Verarbeitung, Unterstützung für interaktive Abfragen und Bibliotheken für maschinelles Lernen zur Erweiterung der Datenanalyse. Diese Funktionen arbeiten zusammen, um eine umfassende Lösung für die Verarbeitung und Analyse großer Datensätze bereitzustellen.

Integrationen umfassen Hadoop, Hive, HBase, Cassandra, Kafka, Amazon S3, Azure Blob Storage, Google Cloud Storage, Elasticsearch und MongoDB.

Pros and Cons

Pros:

- Batch- und Streaming-Datenverarbeitung

- Unterstützt mehrere Programmiersprachen

- Schnelle In-Memory-Verarbeitung

Cons:

- Begrenzte native Visualisierungstools

- Hoher Speicherverbrauch

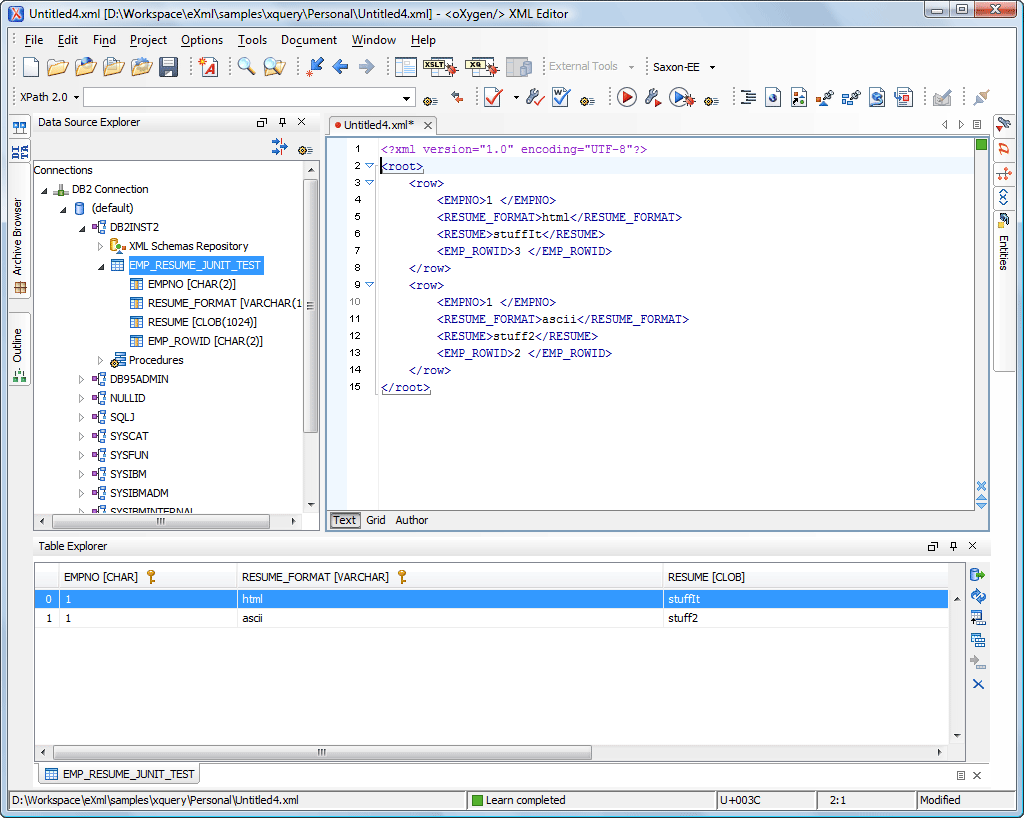

IBM Db2 ist ein Datenbankmanagementsystem, das für Unternehmen entwickelt wurde, die zuverlässige Lösungen zur Datenspeicherung und -verwaltung benötigen. Es richtet sich an IT-Fachleute und Datenbankadministratoren und bietet leistungsstarke Möglichkeiten zur Datenverarbeitung und -analyse.

Warum ich IBM Db2 gewählt habe: IBM Db2 ist speziell auf die Anforderungen von Unternehmensdatenbanken zugeschnitten und bietet eine leistungsstarke Datenverarbeitung und -speicherung. Die fortschrittlichen Datenkomprimierungsfunktionen helfen, Speicherkosten zu senken und gleichzeitig die Effizienz zu erhalten. Die Plattform unterstützt sowohl strukturierte als auch unstrukturierte Daten und bietet damit Vielseitigkeit für Ihre Datenanforderungen. Zusätzlich sorgen die integrierten Sicherheitsfunktionen für den Schutz der Daten, was sie zu einer verlässlichen Wahl für Unternehmen macht, die auf Datenintegrität Wert legen.

Herausragende Funktionen & Integrationen:

Funktionen umfassen fortschrittliche Abfrageoptimierung für effiziente Datenabfragen, Unterstützung für hybride Cloud-Umgebungen zur Erhöhung der Flexibilität und integrierte KI-Funktionen für prädiktive Einblicke. Diese Eigenschaften ermöglichen es Ihrem Team, Daten effektiv über verschiedene Plattformen hinweg zu verwalten und zu analysieren.

Integrationen umfassen IBM Cloud, IBM Watson, IBM Cognos Analytics, IBM SPSS, SAP, Oracle, Microsoft SQL Server, Apache Hadoop, Apache Spark und Amazon S3.

Pros and Cons

Pros:

- Fortschrittliche Datenkomprimierung

- Unterstützt hybride Cloud-Umgebungen

- Integrierte KI-Funktionen

Cons:

- Erfordert technisches Fachwissen

- Potenzial für hohe Kosten

Google BigQuery ist ein cloudbasiertes Data Warehouse, das für Datenanalysten und Business-Intelligence-Teams entwickelt wurde, um schnelle SQL-Abfragen auf großen Datensätzen durchzuführen. Es bietet skalierbare Datenverarbeitung und Analysefunktionen, damit Ihr Team schnell Erkenntnisse gewinnen kann.

Warum ich Google BigQuery gewählt habe: Google BigQuery überzeugt durch die Ausführung schneller SQL-Abfragen und stellt eine serverlose Architektur bereit, die große Datenmengen effizient verarbeitet. Die Integration mit Google Cloud-Services erweitert die Analysefähigkeiten Ihres Teams maßgeblich. Das nutzungsbasierte Preismodell der Plattform ist kosteneffizient für unterschiedlich große Datenmengen. Zudem sorgt die fortschrittliche Abfrageoptimierung für eine zügige Datenabfrage, was sie ideal für Unternehmen macht, die schnelle Erkenntnisse benötigen.

Herausragende Funktionen & Integrationen:

Funktionen umfassen eingebaute Machine-Learning-Fähigkeiten für prädiktive Analysen, Unterstützung für Echtzeitdatenanalysen zur Bereitstellung aktueller Erkenntnisse sowie eine benutzerfreundliche SQL-Oberfläche für einfache Abfragen. Diese Funktionen verbessern die Datenanalyse und ermöglichen wertvolle Einblicke in kurzer Zeit.

Integrationen umfassen Google Cloud Storage, Google Analytics, Google Data Studio, Google Sheets, Google Cloud Pub/Sub, Google Cloud Dataflow, Google Cloud Functions, Looker, Tableau und Microsoft Excel.

Pros and Cons

Pros:

- Echtzeitdatenanalyse

- Fortschrittliche Abfrageoptimierung

- Kosteneffizientes Preismodell

Cons:

- Einarbeitungskurve für neue Nutzer

- Begrenzte Integrationen außerhalb von Google

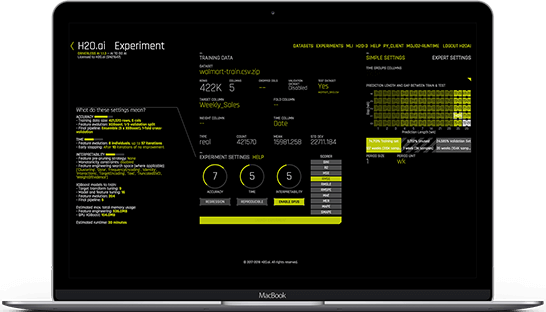

H2O.ai ist eine KI- und Machine-Learning-Plattform, die für Datenwissenschaftler und Analysten entwickelt wurde. Sie hilft, maschinelle Lernprozesse zu automatisieren und erleichtert Ihrem Team die Entwicklung von KI-Modellen.

Warum ich H2O.ai ausgewählt habe: Dieses Tool glänzt im Bereich KI und Machine Learning und bietet Funktionen wie automatisiertes maschinelles Lernen (AutoML), um die Modellentwicklung zu vereinfachen. Es unterstützt eine Vielzahl von Algorithmen und gibt Ihrem Team damit Flexibilität bei der Auswahl der richtigen Methoden für Ihre Projekte. Die Plattform stellt zudem erklärbare KI bereit, was für das Verständnis von Modellentscheidungen unerlässlich ist. Außerdem ermöglicht die Open-Source-Natur von H2O.ai eine individuelle Anpassung, die sich an seinen Schwerpunkten im Bereich KI und ML orientiert.

Herausragende Funktionen & Integrationen:

Funktionen umfassen eine benutzerfreundliche Oberfläche für eine einfache Navigation, umfassende Unterstützung verschiedener Datentypen sowie Echtzeit-Auswertung für unmittelbare Einblicke. Diese Funktionen verbessern Ihre Möglichkeiten, mit unterschiedlichsten Datensätzen zu arbeiten, und sorgen für schnelle Ergebnisse.

Integrationen umfassen Apache Hadoop, Apache Spark, Amazon S3, Microsoft Azure, Google Cloud Platform, IBM Watson, Databricks, Snowflake, Tableau und Qlik.

Pros and Cons

Pros:

- Open-Source-Anpassung

- Automatisiertes maschinelles Lernen

- Unterstützt mehrere Algorithmen

Cons:

- Hoher Ressourcenverbrauch

- Begrenzte Dokumentation

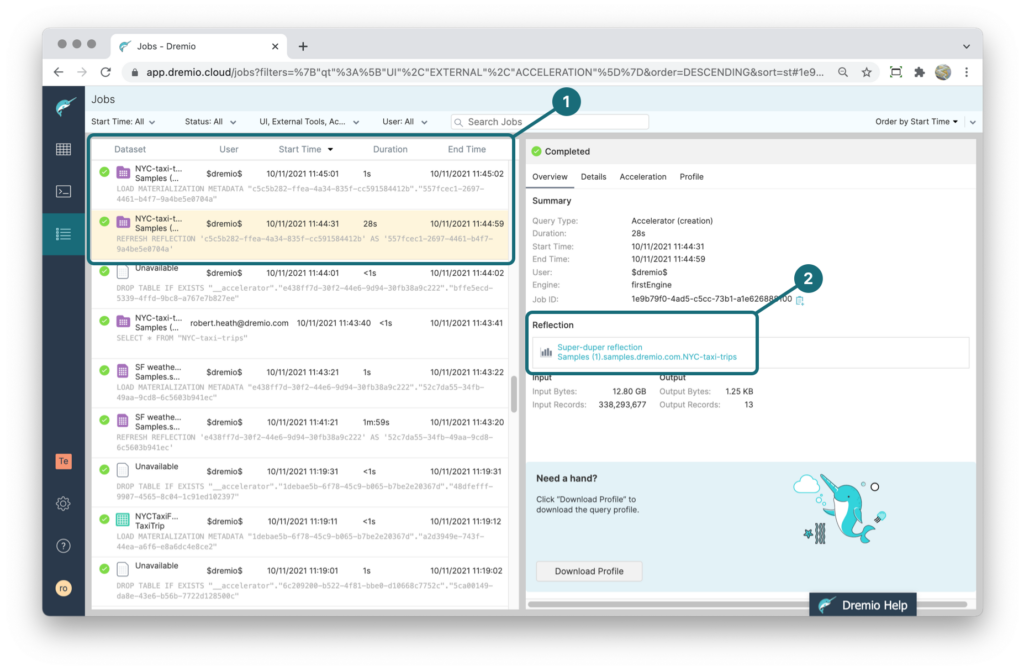

Dremio ist eine Data-Lakehouse-Plattform, die sich auf Self-Service-Analysen für Datenteams spezialisiert hat. Sie richtet sich an Unternehmen, die ihre Teams in die Lage versetzen möchten, direkten Zugriff auf Daten zu erhalten und Analyseprozesse zu vereinfachen.

Warum ich Dremio gewählt habe: Dremio bietet einzigartige Funktionen, die es ideal für Self-Service-Analysen machen. Das Data-as-a-Service-Modell ermöglicht es Ihrem Team, auf Daten zuzugreifen und Abfragen durchzuführen, ohne komplexe ETL-Prozesse zu benötigen. Die Fähigkeit der Plattform, Abfragen mit ihrer auf Apache Arrow basierenden Ausführungs-Engine zu beschleunigen, hebt sie hervor. Zudem profitieren Sie von einer vereinfachten Datenarchitektur, die den Bedarf an Datenkopien reduziert, was Dremio zu einer herausragenden Wahl für effiziente Analysen macht.

Hervorstechende Funktionen & Integrationen:

Funktionen sind eine benutzerfreundliche SQL-Oberfläche, Data Reflections für schnellere Abfragen und ein integrierter Datenkatalog zur Organisation und Verwaltung von Datenbeständen. Diese Funktionen sorgen gemeinsam für ein nahtloses Erlebnis beim Zugriff auf und bei der Analyse von Daten.

Integrationen umfassen Amazon S3, Microsoft Azure, Google Cloud Storage, Apache Hive, Apache HBase, ElasticSearch, Oracle, MySQL, PostgreSQL und MongoDB.

Pros and Cons

Pros:

- Schnelle Abfrageausführung

- Kein Bedarf an ETL-Prozessen

- Einfache SQL-Oberfläche

Cons:

- Begrenzte Machine-Learning-Funktionen

- Hoher Ressourcenverbrauch bei großen Datensätzen

Weitere Databricks-Alternativen

Hier sind weitere Optionen als Konkurrenz zu Databricks, die es zwar nicht auf meine Shortlist geschafft haben, aber dennoch einen Blick wert sind:

- Qubole

Am besten geeignet für Big Data-Workloads

- Azure Databricks

Am besten für kollaborative Analysen

- TigerGraph

Am besten für Graphenanalyse

Kriterien zur Auswahl von Databricks-Alternativen

Bei der Auswahl der besten Databricks-Alternative für diese Liste habe ich die wichtigsten Bedürfnisse und Schmerzpunkte der Käufer:innen betrachtet, wie etwa Integration komplexer Daten und Skalierungsprobleme. Außerdem habe ich das folgende Bewertungsschema genutzt, um fair und strukturiert zu bleiben:

Kernfunktionalität (25% der Gesamtwertung)

Um auf diese Liste zu kommen, musste jede Lösung folgende Anwendungsfälle abdecken:

- Datenverarbeitung und Analyse

- Datenintegration und ETL

- Echtzeit-Daten-Streaming

- Unterstützung für Machine Learning

- Skalierbare Datenspeicherung

Weitere besondere Merkmale (25% der Gesamtwertung)

Um die Auswahl weiter einzugrenzen, habe ich zudem nach Alleinstellungsmerkmalen gesucht, zum Beispiel:

- Erweiterte Werkzeuge zur Datenvisualisierung

- Eingebaute maschinelle Lernalgorithmen

- Echtzeit-Kollaborationsfunktionen

- Anpassbare Dashboards

- Automatisierte Datenverwaltung

Benutzerfreundlichkeit (10% der Gesamtbewertung)

Um einen Eindruck von der Benutzerfreundlichkeit jedes Systems zu erhalten, habe ich Folgendes berücksichtigt:

- Intuitive Benutzeroberfläche

- Anpassbare Arbeitsabläufe

- Übersichtliches Navigationsdesign

- Reaktionsschnelle Performance der Oberfläche

- Ausgewogenheit zwischen Komplexität und Benutzerfreundlichkeit

Einarbeitung (10% der Gesamtbewertung)

Um die Einarbeitungserfahrung für jede Plattform zu bewerten, habe ich Folgendes berücksichtigt:

- Verfügbarkeit von Trainingsvideos

- Interaktive Produkttouren

- Umfassende Dokumentation

- Zugang zu Webinaren und Tutorials

- Unterstützung bei Migration und Einrichtung

Kundensupport (10% der Gesamtbewertung)

Um die Kundendienstleistungen jedes Softwareanbieters zu beurteilen, habe ich Folgendes berücksichtigt:

- Rund-um-die-Uhr-Support

- Zugang zu Live-Chat

- Verfügbarkeit von Community-Foren

- Reaktionszeit auf Support-Tickets

- Qualität der Support-Dokumentation

Preis-Leistungs-Verhältnis (10% der Gesamtbewertung)

Um das Preis-Leistungs-Verhältnis jeder Plattform zu bewerten, habe ich Folgendes berücksichtigt:

- Wettbewerbsfähige Preismodelle

- Flexibilität der Tarifstrukturen

- Transparenz im Kostenaufbau

- Rabatte für langfristige Bindungen

- Leistungsumfang innerhalb des Basistarifs

Kundenbewertungen (10% der Gesamtbewertung)

Um das allgemeine Kundenzufriedenheitsniveau einschätzen zu können, habe ich bei der Auswertung von Kundenbewertungen folgende Aspekte berücksichtigt:

- Gesamte Zufriedenheitsbewertungen

- Feedback zur Leistungsfähigkeit von Funktionen

- Kommentare zur Benutzerfreundlichkeit

- Erfahrungen mit dem Kundensupport

- Meinungen zu Kosten-Nutzen-Verhältnis

So wählen Sie einen Databricks-Konkurrenten aus

Es ist leicht, sich in langen Funktionslisten und komplexen Preisstrukturen zu verlieren. Damit Sie im Auswahlprozess Ihrer Software den Fokus behalten, finden Sie hier eine Checkliste mit Faktoren, die Sie im Auge behalten sollten:

| Faktor | Worauf achten? |

| Skalierbarkeit | Stellen Sie sicher, dass die Lösung mit Ihrem Datenwachstum Schritt halten kann, ohne dabei an Leistung zu verlieren. Prüfen Sie, ob sowohl horizontale wie auch vertikale Skalierung unterstützt wird, um flexibel zu bleiben. |

| Integrationen | Suchen Sie nach Kompatibilität mit Ihren bestehenden Tools, wie Data Lakes oder BI-Tools, um einen reibungslosen Datenfluss sicherzustellen und Silos zu vermeiden. |

| Anpassbarkeit | Bewerten Sie, wie gut sich die Plattform an die spezifischen Arbeitsabläufe und Prozesse Ihres Teams anpassen lässt. Anpassbare Dashboards können verschiedene Team-Anforderungen erfüllen. |

| Benutzerfreundlichkeit | Berücksichtigen Sie die Lernkurve und prüfen Sie, wie intuitiv die Benutzeroberfläche für Ihr Team ist. Eine benutzerfreundliche Plattform verkürzt die Schulungszeit und erhöht die Akzeptanz. |

| Budget | Vergleichen Sie Preismodelle und achten Sie darauf, ob diese in Ihr Budget passen. Berücksichtigen Sie versteckte Kosten wie Speicher oder zusätzliche Benutzergebühren, die Ihre Entscheidung beeinflussen könnten. |

| Schutzmaßnahmen für Sicherheit | Bewerten Sie die Sicherheitsmerkmale der Plattform, wie Datenverschlüsselung und Einhaltung von Industriestandards, um sensible Daten zu schützen. |

| Support | Prüfen Sie die Verfügbarkeit von Supportoptionen, einschließlich Live-Chat und Community-Foren, damit Ihr Team bei Bedarf Hilfe erhält. |

| Leistung | Untersuchen Sie, wie die Plattform mit großen Datenmengen und Echtzeitverarbeitung umgeht, um sicherzustellen, dass sie den Leistungsanforderungen Ihres Teams entspricht. |

Trends bei Databricks-Konkurrenten

Bei meinen Recherchen habe ich zahlreiche Produktneuheiten, Pressemitteilungen und Release-Logs verschiedener Databricks-Konkurrenten untersucht. Hier sind einige aufkommende Trends, die ich besonders im Blick behalte:

- Echtzeit-Analysen: Unternehmen fordern zunehmend Einblicke in Echtzeitdaten. Anbieter verbessern ihre Plattformen, um Daten in Echtzeit zu verarbeiten und zu analysieren, sodass Nutzer sofortige Entscheidungen treffen können. Lösungen wie Google BigQuery integrieren Funktionen zur Unterstützung von Daten-Streaming in Echtzeit.

- Erweiterte Analysen: Dieser Trend beinhaltet den Einsatz von KI und maschinellem Lernen zur Verbesserung von Datenanalyseprozessen. Er gewinnt an Popularität, da er Anwendern hilft, Erkenntnisse ohne manuellen Aufwand zu gewinnen. IBM Watson Studio ist ein Beispiel und bietet erweiterte Analysefähigkeiten zur Automatisierung der Datenanalyse.

- Daten-Demokratisierung: Immer mehr Plattformen legen den Fokus darauf, Daten für nicht-technische Nutzer zugänglich zu machen. Dieser Trend ist entscheidend, um eine datengetriebene Unternehmenskultur zu fördern. Werkzeuge werden mit intuitiven Oberflächen und Self-Service-Funktionen entwickelt, wie sie etwa bei Alteryx zu finden sind.

- Daten-Governance: Mit zunehmenden Datenschutzvorschriften gewinnen Funktionen zur Daten-Governance an Bedeutung. Anbieter integrieren Governance-Tools, die Anwender bei der Einhaltung von Vorschriften und beim verantwortungsvollen Umgang mit Daten unterstützen. Azure Synapse Analytics zum Beispiel bietet integrierte Governance-Funktionen.

- Hybrid-Cloud-Unterstützung: Viele Unternehmen wünschen sich Flexibilität bei ihrer Cloud-Strategie. Die Unterstützung für Hybrid-Cloud-Lösungen wächst, da Nutzer ihre Daten sowohl vor Ort als auch in der Cloud verwalten können. Cloudera ist hier führend und bietet Lösungen, die Hybrid-Cloud-Bereitstellungen unterstützen.

Was sind Databricks-Wettbewerber?

Databricks-Wettbewerber sind Softwarelösungen, die Datenverarbeitung, Analysen und maschinelles Lernen ermöglichen. Diese Werkzeuge werden typischerweise von Datenwissenschaftlern, Ingenieuren und Analysten genutzt, um Erkenntnisse zu gewinnen und Geschäftsentscheidungen voranzutreiben.

Echtzeit-Analysen, erweiterte Analysen und Funktionen zur Daten-Governance helfen dabei, Daten effizient zu verarbeiten, Erkenntnisse zu finden und Daten verantwortungsbewusst zu managen. Insgesamt ermöglichen diese Tools Unternehmen, ihr Datenpotenzial für fundierte Entscheidungen und die strategische Planung zu nutzen.

Funktionen von Databricks-Wettbewerbern

Wenn Sie einen Databricks-Wettbewerber auswählen, achten Sie auf die folgenden wichtigen Funktionen:

- Echtzeit-Analysen: Ermöglicht die sofortige Datenverarbeitung und Einblicke, sodass schnelle Geschäftsentscheidungen getroffen werden können.

- Erweiterte Analysen: Nutzt KI zur Automatisierung der Datenanalyse und hilft dabei, Erkenntnisse ohne manuellen Aufwand zu gewinnen.

- Daten-Governance: Sichert die Einhaltung von Datenschutzgesetzen und sorgt für verantwortungsbewusste Datenverwaltung.

- Hybrid-Cloud-Unterstützung: Ermöglicht die Verwaltung von Daten sowohl lokal als auch in der Cloud zur Steigerung der Flexibilität.

- Interaktive Zusammenarbeit: Unterstützt Teamarbeit durch geteilte Arbeitsbereiche und Werkzeuge zur gemeinsamen Datenanalyse.

- Automatische Skalierung: Passt Ressourcen je nach Arbeitslast an und optimiert so die Leistung ohne manuelle Eingriffe.

- Integration von Machine Learning: Bietet integrierte Funktionen für maschinelles Lernen für fortschrittliche Datenprognosen und Analysen.

- Anpassbarkeit: Erlaubt individuelle Workflows und Dashboards, die auf die spezifischen Bedürfnisse und Prozesse des Teams zugeschnitten sind.

- Sicherheitsmechanismen: Stellt Verschlüsselung und Compliance-Funktionen bereit, um sensible Daten zu schützen.

- Benutzerfreundliche Oberfläche: Sorgt für einfache Bedienbarkeit, verringert die Einarbeitungszeit und erhöht die Akzeptanz im Team.

Vorteile von Databricks-Wettbewerbern

Die Implementierung eines Databricks-Wettbewerbers bietet für Ihr Team und Ihr Unternehmen zahlreiche Vorteile. Diese Vorteile können Sie erwarten:

- Verbesserte Entscheidungsfindung: Echtzeit-Analysen und erweiterte Analytik liefern unmittelbare Erkenntnisse und verbessern die Entscheidungsfindung Ihres Teams.

- Mehr Zusammenarbeit: Funktionen für interaktive Zusammenarbeit ermöglichen ein effektives Miteinander, was zu besseren und konsistenteren Datenprojekten führt.

- Skalierbarkeit: Die automatische Skalierung sorgt dafür, dass Ihr System bei Datenwachstum effizient bleibt, ohne dass manuelle Anpassungen erforderlich sind.

- Kosteneffizienz: Pay-as-you-go-Preismodelle bedeuten, dass Sie nur für tatsächlich genutzte Ressourcen zahlen und Ihr Budget optimal einsetzen.

- Bessere Sicherheit: Integrierte Sicherheitsmechanismen schützen Ihre Daten und gewährleisten die Einhaltung von Branchenstandards.

- Flexibilität: Hybrid-Cloud-Unterstützung ermöglicht es, Daten in unterschiedlichen Umgebungen zu verwalten und sich flexibel an Geschäftsanforderungen anzupassen.

- Anpassung: Anpassbare Funktionen erlauben es, Workflows und Dashboards auf die individuellen Anforderungen zuzuschneiden und so die Produktivität zu steigern.

Kosten und Preise von Databricks-Wettbewerbern

Die Auswahl eines Databricks-Konkurrenten erfordert ein Verständnis der verschiedenen Preismodelle und verfügbaren Pläne. Die Kosten variieren je nach Funktionen, Teamgröße, Add-ons und mehr. Die folgende Tabelle fasst gängige Pläne, deren durchschnittliche Preise und typische in Databricks-Konkurrenzlösungen enthaltene Funktionen zusammen:

Vergleichstabelle für Databricks-Konkurrenten

| Tariftyp | Durchschnittlicher Preis | Gemeinsame Funktionen |

| Gratis-Tarif | $0 | Grundlegende Datenverarbeitung, begrenzter Speicherplatz und Community-Support. |

| Persönlicher Tarif | $10-$30 /Nutzer /Monat | Erweiterte Datenanalyse, persönliche Dashboards und E-Mail-Support. |

| Business-Tarif | $50-$100 /Nutzer /Monat | Fortgeschrittene Analyse-Tools, Team-Kollaborationsfunktionen und Prioritäts-Support. |

| Enterprise-Tarif | $150-$300/Nutzer /Monat | Maßgeschneiderte Integrationen, persönliches Account-Management und Sicherheit auf Unternehmensniveau. |

Databricks-Konkurrenten: FAQ

Hier finden Sie Antworten auf häufig gestellte Fragen zu Databricks-Konkurrenten:

Wer ist der größte Konkurrent von Databricks?

Snowflake wird oft als größter Konkurrent von Databricks angesehen, da beide ähnliche cloudbasierte Datenplattformen bieten. Beide verfügen über umfangreiche Funktionen zur Datenverarbeitung und -analyse, wobei Snowflake insbesondere mit seinen Stärken im Bereich Data Warehousing überzeugt. Welche Lösung für Sie optimal ist, hängt von Ihren individuellen Anforderungen ab.

Was wird Databricks ersetzen?

Kein einzelnes Tool wird Databricks komplett ersetzen, dennoch bieten Alternativen wie SQL Server überzeugende Funktionen. SQL Server lässt sich gut mit Analyse-Tools wie Power BI integrieren und stellt ein leistungsfähiges relationales Datenbankmanagementsystem dar. Ihre Wahl sollte sich an Ihren spezifischen Anforderungen zur Datenverarbeitung orientieren.

Welche Einschränkungen hat Databricks?

Databricks hat einige Einschränkungen, beispielsweise hinsichtlich der Anzahl von Widgets in einem Notebook sowie bezüglich der Zeichenbegrenzungen für Widget-Namen und Eingaben. Diese Beschränkungen können die Gestaltung und Interaktion mit Daten in Notebooks beeinflussen – berücksichtigen Sie dies bei Workflows, die davon betroffen sein könnten.

Wer sind die Amazon Databricks Konkurrenten?

Amazon Databricks steht in Konkurrenz zu Plattformen wie Snowflake, die ähnliche Datenverarbeitungsfähigkeiten bieten. Snowflake stellt eine cloudbasierte Data-Warehouse-Lösung bereit, die für ihre Skalierbarkeit und Benutzerfreundlichkeit bekannt ist und somit eine starke Auswahl auf dem Markt darstellt.

Wie vergleichen sich die Preise von Databricks mit denen der Konkurrenz?

Die Preise von Databricks können je nach Nutzung und Funktionsumfang stark variieren. Es ist wichtig, diese mit Mitbewerbern wie Snowflake und Google BigQuery zu vergleichen. Besonders Faktoren wie Datenspeicherung, Verarbeitungskosten sowie zusätzliche Funktionen sollten beim Vergleich der Preisstrukturen berücksichtigt werden, um das beste Angebot für Ihr Budget zu finden.

Auf welche Funktionen sollte ich bei einem Databricks-Konkurrenten achten?

Achten Sie bei der Bewertung von Databricks-Konkurrenten vor allem auf Funktionen wie Echtzeit-Analysen, Integration von maschinellem Lernen und Datenmanagement. Diese erweitern Ihre Möglichkeiten zur Datenverarbeitung und -analyse und bringen Ihrem Team einen Mehrwert. Ihre individuelle Geschäftssituation entscheidet, welche Features besonders wichtig sind.

Wie geht es weiter?

Steigern Sie das Wachstum Ihres SaaS und Ihre Führungsqualitäten. Abonnieren Sie unseren Newsletter für die neuesten Einblicke von CTOs und aufstrebenden Tech-Führungskräften. Wir helfen Ihnen dabei, klüger zu skalieren und souverän zu führen – mit Leitfäden, Ressourcen und Strategien von Top-Expert:innen!