10 Meilleurs logiciels Big Data sélectionnés

Naviguer dans le monde du big data peut sembler intimidant. En tant qu'expert technologique, vous êtes confronté à des défis tels que la gestion de vastes quantités de données et l’extraction d’informations pertinentes. C’est là que les logiciels Big Data entrent en jeu, rendant vos tâches plus simples et plus efficaces.

D'après mon expérience, choisir le bon outil peut transformer votre manière de travailler avec la donnée, ainsi que celle de votre équipe. J’ai testé et analysé de nombreuses solutions logicielles afin de vous proposer un avis impartial sur les meilleures options du marché.

Dans cet article, je vous présente mes meilleurs choix, en mettant en avant les fonctionnalités et avantages qui répondent à vos besoins. Que vous souhaitiez renforcer l’analyse des données ou améliorer la prise de décision, vous trouverez ici la solution adaptée. Découvrez sans plus attendre les meilleurs logiciels Big Data disponibles.

Why Trust Our Software Reviews

We’ve been testing and reviewing software since 2023. As tech leaders ourselves, we know how critical and difficult it is to make the right decision when selecting software.

We invest in deep research to help our audience make better software purchasing decisions. We’ve tested more than 2,000 tools for different tech use cases and written over 1,000 comprehensive software reviews. Learn how we stay transparent & our software review methodology.

Résumé des meilleurs logiciels Big Data

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Meilleur pour la visualisation interactive du big data | Essai gratuit disponible | $70/utilisateur/mois (facturé annuellement) | Website | |

| 2 | Idéal pour la transformation automatisée des données | Démo gratuite disponible | Tarification sur demande | Website | |

| 3 | Idéal pour la découverte des données et la conformité | Démo gratuite disponible | $50/utilisateur/mois (facturé annuellement) | Website | |

| 4 | Idéal pour le calcul mathématique avec le big data | Essai gratuit disponible | $50/utilisateur/mois (facturé annuellement) | Website | |

| 5 | Idéal pour la recherche et l'analytique en temps réel | Version d'essai gratuite disponible | $7/utilisateur/mois (facturé annuellement) | Website | |

| 6 | Idéal pour l’entreposage de données sans serveur et hautement évolutif | Offre gratuite disponible | $20/user/month | Website | |

| 7 | Idéal pour les tâches de traitement de données à grande échelle | Not available | Tarif sur demande | Website | |

| 8 | Idéal pour le traitement et l'analyse de données en temps réel | Not available | Tarification sur demande | Website | |

| 9 | Idéal pour l'analyse et l'exploitation des données à l'échelle de l'entreprise | Not available | Tarification sur demande | Website | |

| 10 | Idéal pour la gestion de bases de données relationnelles | Démo gratuite disponible | $25/utilisateur/mois (facturé annuellement) | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Avis sur les meilleurs logiciels Big Data

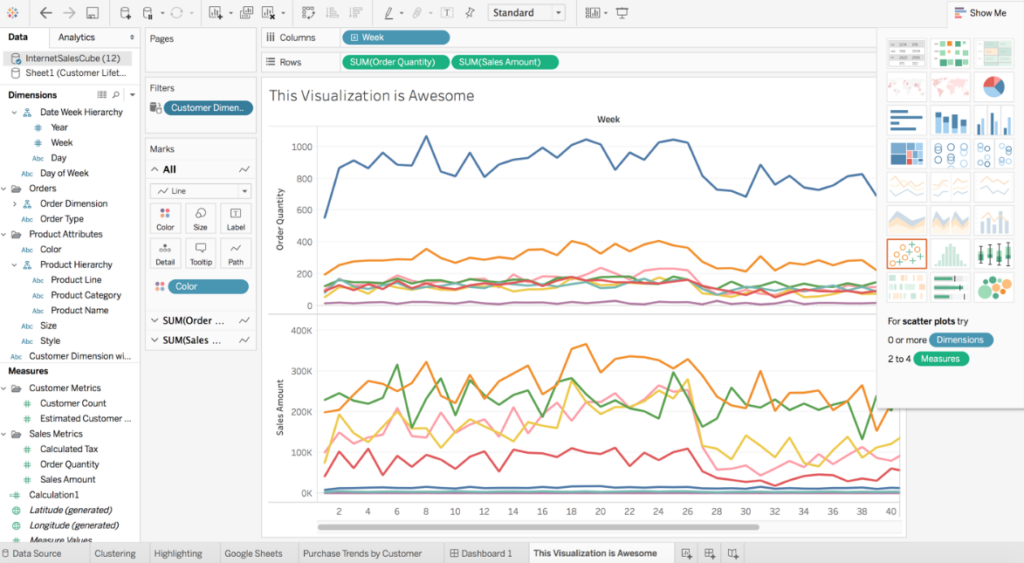

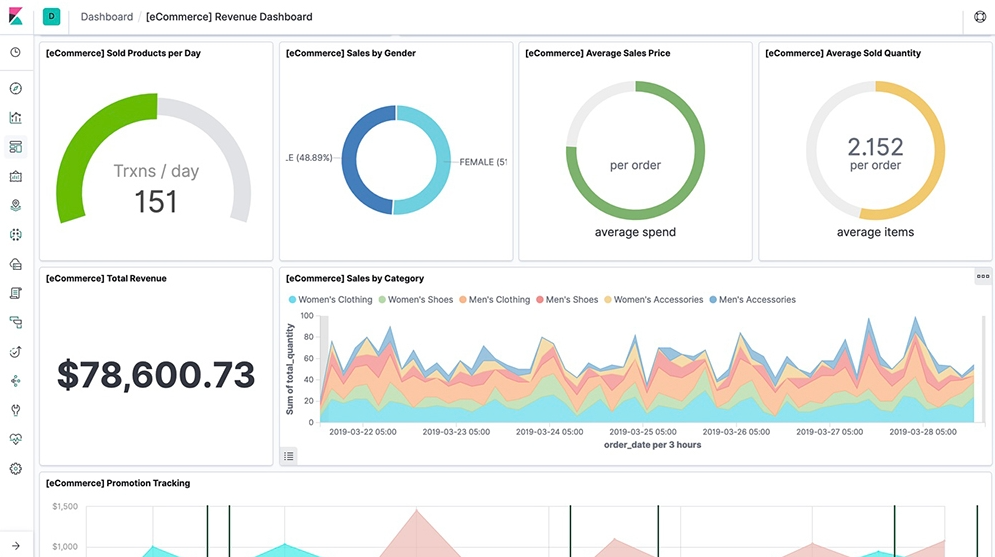

Tableau s'impose comme une référence incontournable dans le domaine de la visualisation de données, permettant aux utilisateurs de transformer des données brutes en visualisations et tableaux de bord intuitifs et interactifs. Sa capacité à offrir une expérience d'exploration des données immersive explique sa réputation comme le meilleur outil de visualisation interactive de big data.

Pourquoi j'ai choisi Tableau : Au cours de ma quête du meilleur outil de visualisation, Tableau s'est systématiquement imposé en tête. Je l'ai sélectionné non seulement pour sa popularité, mais surtout pour son aptitude indéniable à donner vie aux données massives à travers des visuels à la fois informatifs et engageants. Sa réputation pour la création de scénarios de données interactifs a consolidé ma conviction qu'il s'agit véritablement du meilleur choix pour cette tâche unique.

Fonctionnalités phares & intégrations :

Tableau se distingue par sa fonctionnalité de glisser-déposer, permettant aux utilisateurs, quel que soit leur niveau technique, de concevoir facilement des visualisations complexes. Ses analyses de données en temps réel et ses options collaboratives offrent une vision globale, garantissant que les informations soient non seulement pertinentes mais aussi exploitables.

Au-delà de ces fonctionnalités, Tableau propose des intégrations avec une multitude de sources de données, allant des bases de données traditionnelles aux services cloud.

Pros and Cons

Pros:

- L'interface intuitive de glisser-déposer facilite la création de visualisations

- L'analytique en temps réel assure des informations à jour

- Capacités d'intégration étendues avec diverses sources de données

Cons:

- Peut présenter une courbe d'apprentissage plus raide pour les débutants comparé à d'autres plateformes

- Les coûts de licence peuvent s'accumuler pour de grandes équipes

- Certaines fonctionnalités avancées peuvent nécessiter des connaissances en script

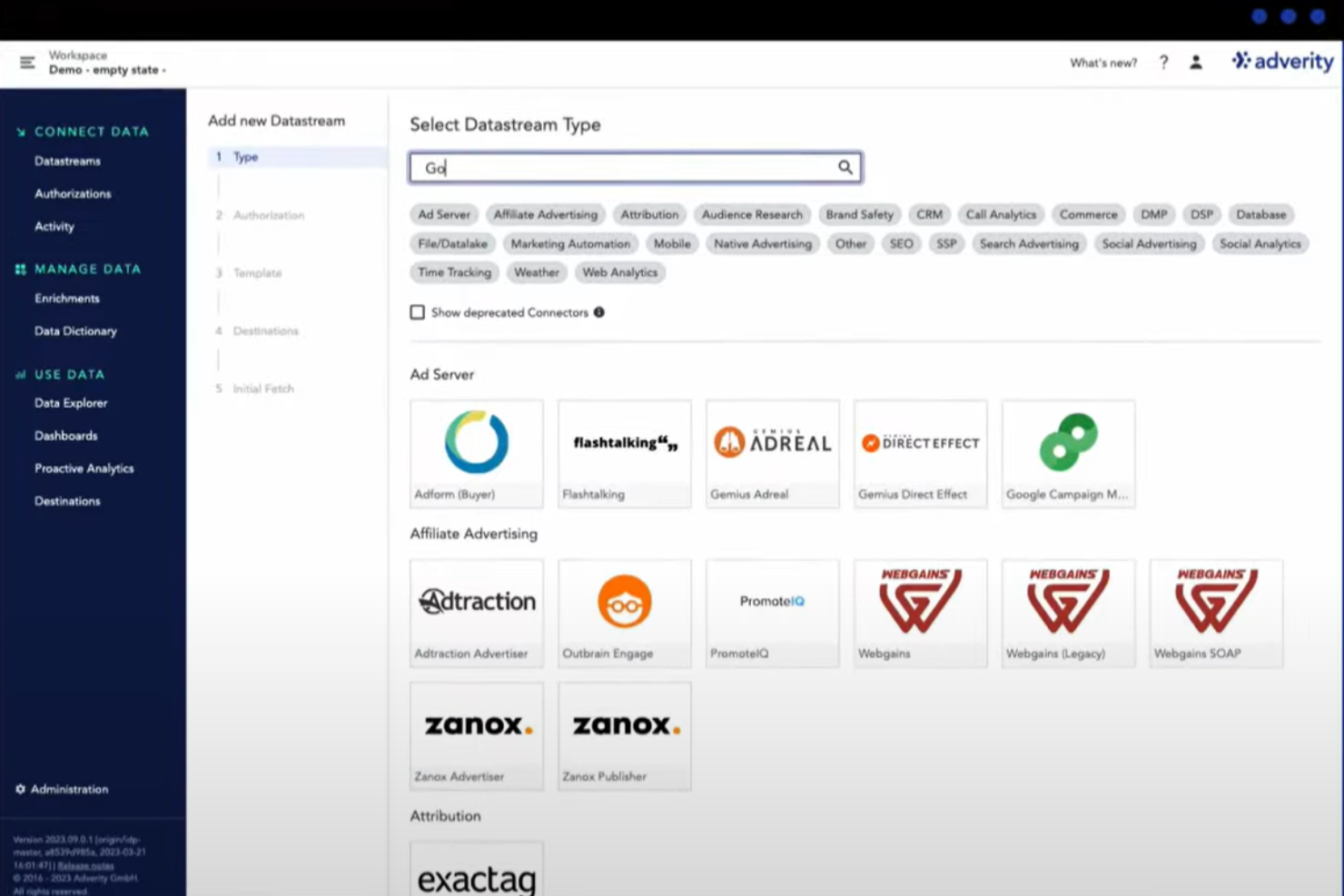

Adverity est une plateforme de données qui aide les entreprises à connecter, transformer et gérer leurs données marketing. Elle permet aux équipes d'automatiser la collecte et le traitement des données, facilitant ainsi l'analyse et le partage des insights.

Pourquoi j'ai choisi Adverity : J'ai choisi Adverity parce qu'il permet à votre équipe d'intégrer, de transformer et de gérer efficacement de grandes quantités de données. Ses transformations automatisées—comme les conventions de nommage intelligentes et les conversions de devises—rendent facile la standardisation de grands ensembles de données. Vous pouvez également utiliser son copilote de transformation alimenté par l'IA pour préparer les données à l'aide de simples invites textuelles au lieu de coder. De plus, sa fonctionnalité de conversations sur les données permet aux utilisateurs non techniciens d'accéder aux insights en utilisant le langage naturel.

Fonctionnalités phares et intégrations :

Parmi les autres fonctionnalités figurent la surveillance de la qualité des données, qui effectue des contrôles pour valider vos données et garantir leur propreté ainsi que leur exhaustivité. La plateforme propose également un dictionnaire de données qui catalogue tout pour vous, éliminant le besoin de documenter vos données vous-même.

Les intégrations incluent Google, Meta, TikTok, Google BigQuery, Looker Studio, Facebook Ads, Amazon Advertising, Hubspot, Salesforce, Amazon S3, Snowflake et Microsoft Azure.

Pros and Cons

Pros:

- Surveillance automatisée de la qualité des données

- Peut harmoniser les données provenant de différentes sources

- Permet de créer des tableaux de bord personnalisés

Cons:

- Certaines configurations peuvent nécessiter des connaissances techniques

- La configuration initiale peut être chronophage

New Product Updates from Adverity

Adverity Enhances Connectors and Adds TikTok GMV Max

Adverity updates connectors for Amazon Ads, SmartNews Ads, Indeed, and monday.com, and introduces the TikTok GMV Max connector. These updates improve data accuracy, control, and performance across integrations. For more information, visit Adverity’s official site.

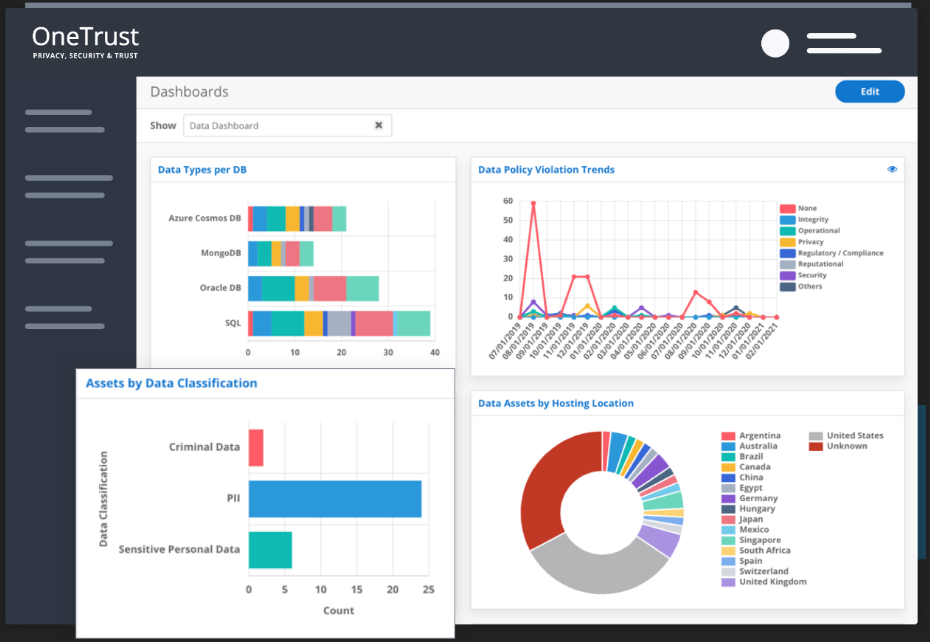

OneTrust propose une plateforme axée sur la découverte des données, la confidentialité, la sécurité et la gestion des risques liés aux tiers. Dans l'environnement réglementaire strict d'aujourd'hui, son engagement envers la conformité des données s'impose, validant ainsi sa position comme le meilleur outil pour la découverte des données et la conformité.

Pourquoi j'ai choisi OneTrust : Face à la multitude d'outils de gestion de données, OneTrust a immédiatement retenu mon attention. L'engagement de l'outil à intégrer à la fois la découverte des données et la conformité répondait parfaitement aux défis émergents des entreprises modernes.

Après une comparaison minutieuse et un jugement approfondi, j'ai constaté que OneTrust offre un équilibre inégalé entre la découverte des données cachées et la garantie de leur conformité.

Fonctionnalités et intégrations remarquables :

OneTrust propose des fonctionnalités telles que la découverte automatisée des données, un référentiel central pour tous les actifs liés aux données et l'automatisation des évaluations, qui sont essentielles pour les entreprises évoluant dans des écosystèmes de données complexes.

Côté intégrations, OneTrust s'associe aisément à divers outils et plateformes d'entreprise, ce qui facilite son intégration dans les infrastructures existantes des sociétés.

Pros and Cons

Pros:

- Mécanismes complets de découverte des données

- L'accent mis sur la conformité est en phase avec les règlements mondiaux

- Large éventail d'intégrations avec les principaux outils d'entreprise

Cons:

- Peut s'avérer complexe pour les petites structures

- Nécessite un certain niveau d'expertise pour une utilisation optimale

- La multitude de fonctionnalités peut dérouter les nouveaux utilisateurs

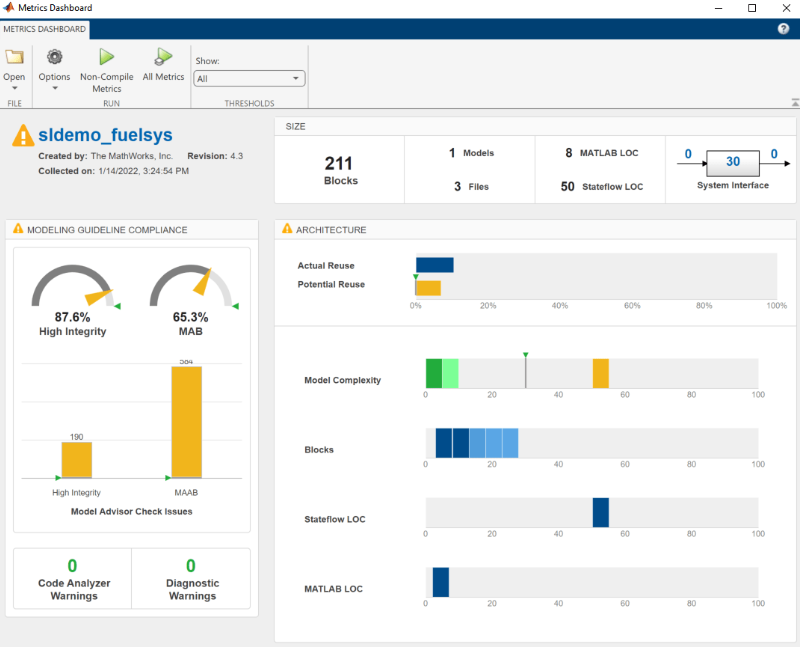

MATLAB, développé par MathWorks, est un langage haute performance pour le calcul technique. Conçu pour des fonctions telles que le développement d'algorithmes, la visualisation de données et le calcul numérique, il est idéal pour ceux qui recherchent une puissance de calcul mathématique dans le domaine du big data.

Pourquoi j'ai choisi MATLAB : Quand je me suis plongé dans le monde des logiciels de big data, choisir MATLAB s'est imposé comme une évidence. Sa réputation au sein des communautés scientifiques et d'ingénierie n'est plus à faire. La puissance qu'il offre pour les calculs mathématiques, notamment lors du traitement de big data, le distingue nettement.

À mon avis, en comparant différents outils, MATLAB s'affirme comme le meilleur pour les opérations mathématiques complexes dans l'environnement du big data.

Fonctionnalités et intégrations remarquables :

MATLAB est reconnu pour sa boîte à outils, qui contient un large éventail de fonctions pour le traitement du signal, l'apprentissage automatique et bien plus encore. Sa fonctionnalité Simulink permet des conceptions basées sur des modèles, ce qui renforce les processus de simulation et de test de modèles. MATLAB s'intègre à de nombreux environnements et outils tiers, dont C/C++, Java, .NET et Python, garantissant ainsi des workflows fluides entre différentes plateformes.

Pros and Cons

Pros:

- Boîte à outils étendue avec de nombreuses fonctionnalités

- Facilite les calculs mathématiques de base comme avancés

- Capacités d'intégration robustes avec d'autres langages et plateformes

Cons:

- Peut être surdimensionné pour des tâches plus simples

- Courbe d'apprentissage relativement raide pour les non-initiés à son langage

- La structure de licence peut être complexe pour les grandes équipes

Elasticsearch est un moteur de recherche et d'analytique open-source qui permet l'exploration et la visualisation de données en temps réel. Grâce à sa capacité à traiter de grands volumes de données instantanément, il facilite l'obtention rapide d'informations sur des ensembles de données complexes, ce qui le rend idéal pour la recherche et l'analyse en temps réel.

Pourquoi j'ai choisi Elasticsearch : J'ai sélectionné Elasticsearch pour cette liste en raison de son extraordinaire capacité à fournir des analyses en temps réel, de sa robustesse et de son large support communautaire. En comparant divers outils, Elasticsearch s'est distingué par son intégration avec des types de données variés et ses options de requête flexibles.

J'ai estimé qu'il était le meilleur choix pour la recherche et l'analytique en temps réel grâce à ses capacités d'indexation et de recherche rapides, permettant aux utilisateurs d'accéder instantanément aux informations.

Fonctionnalités et intégrations remarquables :

Elasticsearch excelle en matière de recherche plein texte et sa nature distribuée le rend hautement évolutif. Son indexation en temps réel permet un traitement instantané des données et l'extraction rapide d'informations. Parmi les intégrations clés figurent Kibana pour la visualisation, Logstash pour la collecte de données, et Beats pour l'acheminement des données, formant ainsi une Elastic Stack robuste.

Pros and Cons

Pros:

- Open-source avec une forte communauté

- Capacités analytiques étendues

- Évolutif et adaptable à divers besoins métiers

Cons:

- Courbe d'apprentissage plus raide pour les débutants

- Peut nécessiter des ressources matérielles importantes pour de grands ensembles de données

- Complexité dans la gestion et la configuration du système

Idéal pour l’entreposage de données sans serveur et hautement évolutif

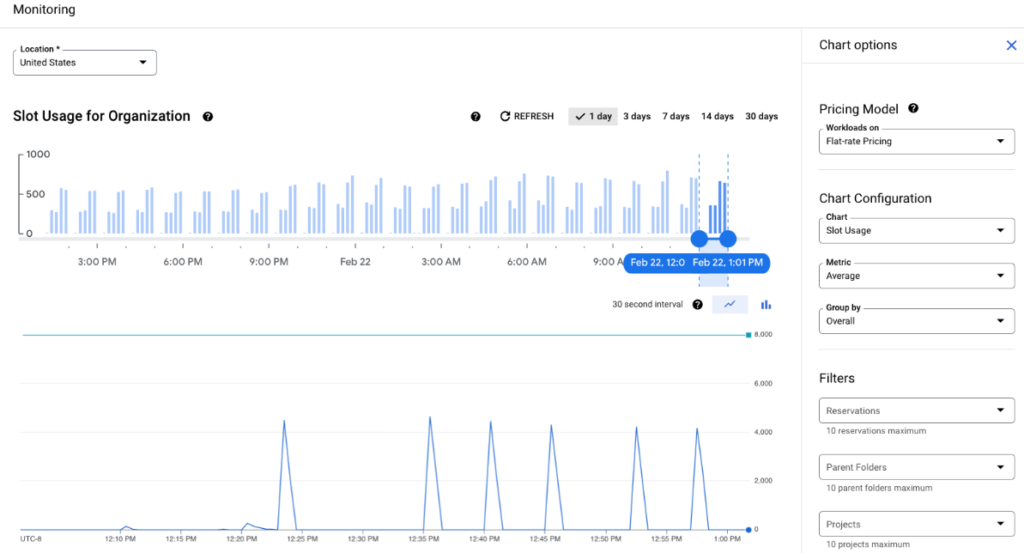

Google Cloud BigQuery offre une solution multi-cloud conçue pour l’analyse de vastes ensembles de données en temps réel. Son architecture sans serveur garantit évolutivité et simplicité, ce qui la rend particulièrement adaptée à ceux qui souhaitent exploiter l’entreposage de données sans les complexités de la gestion des serveurs.

Pourquoi j’ai choisi Google Cloud BigQuery : Après une évaluation rigoureuse de divers outils, j’ai constaté que l’approche sans serveur de BigQuery et ses mécanismes d’évolutivité robustes le distinguent. J’ai choisi cet outil car il élimine la corvée de gestion des serveurs tout en offrant des performances puissantes.

Pour les entreprises souhaitant faire évoluer leurs besoins en entreposage de données sans avoir à plonger dans les subtilités des serveurs, BigQuery est sans doute le meilleur choix.

Fonctionnalités remarquables & intégrations :

La capacité d’analyse en temps réel de BigQuery permet aux entreprises de prendre rapidement des décisions basées sur les données. Ses options de sauvegarde automatique et de restauration facile garantissent la sécurité et la continuité des données. En matière d’intégration, BigQuery s’associe parfaitement à divers services Google Cloud tels que Dataflow, Pub/Sub et AI Platform, offrant aux utilisateurs une expérience cloud globale.

Pros and Cons

Pros:

- L’aspect sans serveur garantit une évolutivité sans effort

- L’analyse en temps réel permet des décisions d’entreprise rapides

- Intégration facile avec les autres services Google Cloud

Cons:

- Peut devenir coûteux pour des volumes de requêtes très importants

- Courbe d’apprentissage pour ceux qui ne connaissent pas Google Cloud Platform

- Certaines requêtes complexes peuvent nécessiter une optimisation pour le coût et la performance

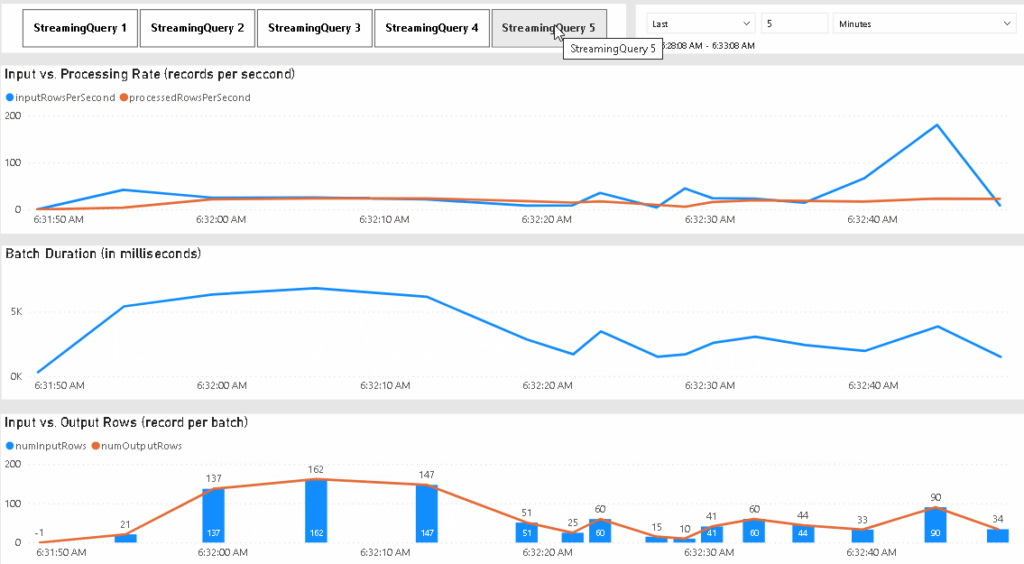

Apache Spark est un système de traitement distribué open source conçu pour gérer une vaste gamme de tâches de traitement des données, en mettant l'accent sur la rapidité et la facilité d'utilisation. Cette plateforme s'adresse aux organisations qui ont besoin de traiter d'énormes ensembles de données, ce qui en fait un choix idéal pour les tâches de traitement de données à grande échelle.

Pourquoi j'ai choisi Apache Spark : Lorsque je cherchais un framework capable de gérer des charges massives de traitement des données, Apache Spark s'est constamment imposé comme une option de premier plan. Sa particularité réside dans ses capacités de calcul en mémoire, qui accélèrent considérablement les tâches de données à grande échelle. Étant donné son efficacité prouvée et sa large adoption dans l'industrie, je suis convaincu que Spark est le meilleur choix pour les projets de traitement de données volumineuses.

Fonctionnalités et intégrations remarquables :

Apache Spark propose des fonctionnalités impressionnantes comme le traitement en mémoire, ce qui contribue à réduire le temps passé par les données sur les disques. De plus, il offre une plateforme unifiée permettant aux utilisateurs de combiner SQL, streaming et analyses complexes. La capacité de Spark à s'intégrer avec des outils de stockage de données populaires tels que HDFS et Apache Cassandra, ainsi qu'avec des outils de traitement de données comme Apache Kafka, le rend polyvalent pour des tâches variées.

Pros and Cons

Pros:

- Vitesse inégalée grâce au traitement en mémoire

- Polyvalence dans la gestion de diverses tâches comme le traitement par lots, l'apprentissage automatique et le traitement de graphes

- Un ensemble riche de bibliothèques et d'API pour développeurs afin d'étendre ses capacités

Cons:

- Peut nécessiter une mémoire importante pour certaines tâches, entraînant des coûts opérationnels plus élevés

- La courbe d'apprentissage peut être abrupte pour les débutants

- La configuration et l'optimisation de Spark pour des performances optimales peuvent être complexes

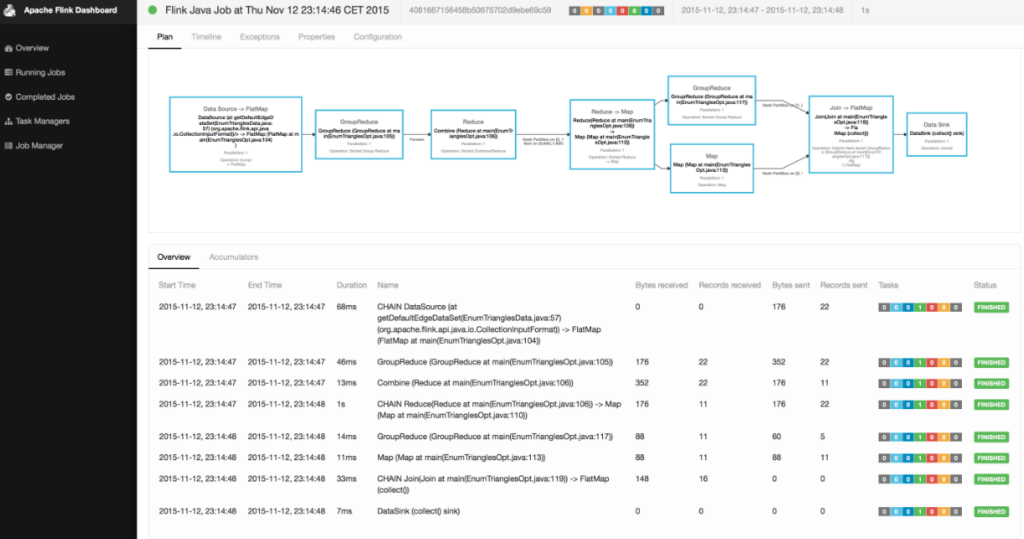

Apache Flink se distingue comme un puissant framework open-source de traitement de flux. Grâce à ses performances en matière de traitement et d'analyse de données en temps réel, il permet de transformer d'immenses flux de données en informations exploitables rapidement et efficacement.

Pourquoi j'ai choisi Apache Flink : Dans le processus de choix de l'outil idéal pour l'analytique en temps réel, Apache Flink s'est constamment imposé en tête de mes comparaisons. Ses capacités distinctives de traitement de flux, associées à ses performances éprouvées dans des écosystèmes de données complexes, ont rendu ma décision évidente.

Pour les organisations qui accordent la priorité aux informations en temps réel et aux réponses dynamiques aux données, Apache Flink constitue une solution optimale.

Fonctionnalités clés et intégrations :

Apache Flink offre un modèle de streaming tolérant aux pannes, garantissant la fiabilité et la cohérence des données. Il prend en charge le traitement selon l'heure des événements, fournissant des résultats précis même lorsque les données arrivent dans le désordre. Flink s'intègre facilement aux systèmes de stockage de données populaires tels qu'Apache Kafka, Apache Cassandra et AWS S3, offrant une grande flexibilité au niveau des sources de données.

Pros and Cons

Pros:

- Sa forte tolérance aux pannes assure l'intégrité des données lors du traitement

- Le traitement efficace selon l'heure des événements gère avec précision les données arrivant hors ordre

- Ses capacités d'intégration avancées permettent la connexion avec divers systèmes de stockage de données

Cons:

- La configuration et la mise en place peuvent représenter une courbe d'apprentissage importante pour les nouveaux utilisateurs

- La montée en charge, bien que robuste, peut nécessiter des ajustements complexes lors de déploiements à très grande échelle

- En tant qu'outil open-source, les options de support commercial peuvent être limitées

Idéal pour l'analyse et l'exploitation des données à l'échelle de l'entreprise

IBM Big Data Analytics est une plateforme intégrée proposée par IBM, conçue pour doter les entreprises des outils nécessaires afin de tirer des informations exploitables de leurs vastes réservoirs de données. Grâce à ses capacités sophistiquées adaptées aux entreprises, c'est la solution idéale pour ceux qui recherchent une solution complète d'analyse et d'exploitation des données à grande échelle.

Pourquoi j'ai choisi IBM Big Data Analytics : En me penchant sur les outils d'analyse de données de niveau entreprise, IBM Big Data Analytics s'est imposé comme un concurrent de poids. J'ai choisi cette plateforme en raison de sa réputation de fiabilité et de sa large gamme de fonctionnalités spécifiquement conçues pour les grandes entreprises.

Ce puissant outil, associé à l'héritage d'IBM dans l'industrie technologique, m'a convaincu qu'il était parfaitement adapté à l'analyse et à l'exploitation des données au niveau entreprise.

Fonctionnalités phares et intégrations :

IBM Big Data Analytics propose une multitude d'outils permettant des analyses prédictives avancées, allant de l'exploration de données à l'apprentissage automatique. Il intègre des informations pilotées par l'IA afin d'améliorer la précision des prévisions et s'intègre avec les autres solutions de données d'IBM.

De plus, sa compatibilité avec des outils comme Hadoop et Spark, ainsi que ses capacités d'intégration avec de nombreuses plateformes tierces, renforcent encore sa proposition de valeur.

Pros and Cons

Pros:

- Gamme complète d'outils d'analyse répondant à une variété de besoins

- Capacités d'intégration robustes avec les solutions IBM et de tiers

- Support fiable et ressources disponibles grâce à la réputation d’IBM

Cons:

- Peut s'avérer complexe pour ceux qui ne sont pas familiers avec l'écosystème IBM

- Le déploiement et la configuration peuvent être plus complexes que pour d'autres outils

- Le coût peut être prohibitif pour les petites organisations

Microsoft SQL Server est un produit vénérable dans le domaine des bases de données, offrant des outils complets pour le stockage, la récupération et la gestion des données structurées. Ses performances robustes et sa fiabilité dans la gestion des bases de données relationnelles en font un choix évident pour les organisations recherchant une gestion efficace des bases de données relationnelles.

Pourquoi j'ai choisi Microsoft SQL Server : Au cours de mes comparaisons, j'ai été attiré par Microsoft SQL Server principalement en raison de sa constance à fournir des solutions de base de données de premier ordre. Je l'ai sélectionné pour sa profonde intégration avec d'autres produits Microsoft, ce qui simplifie de nombreux processus opérationnels. De plus, son historique éprouvé et ses progrès constants en matière de techniques de gestion des bases de données relationnelles le rendent inégalé dans ce domaine.

Fonctionnalités et intégrations remarquables :

Microsoft SQL Server est réputé pour ses performances élevées et ses caractéristiques de sécurité, garantissant que les données restent à la fois accessibles et protégées. De plus, ses groupes de disponibilité Always On offrent une grande disponibilité et des capacités de reprise après sinistre. Côté intégration, il se synchronise avec d'autres produits Microsoft comme Azure, Power BI et Microsoft Office, favorisant un écosystème de données harmonieux.

Pros and Cons

Pros:

- Des fonctionnalités de sécurité solides garantissent la protection des données

- Haute disponibilité avec options de reprise après sinistre via Always On Availability Groups

- Intégration fluide avec une large gamme de produits Microsoft

Cons:

- Peut présenter des difficultés pour les débutants peu familiers avec l'écosystème Microsoft

- Le modèle de licence peut être complexe pour certaines entreprises

- Gourmand en ressources, nécessite un matériel serveur puissant

Autres logiciels Big Data

Vous trouverez ci-dessous une liste supplémentaire de logiciels Big Data que j’ai présélectionnés, mais qui n’ont pas été retenus dans le top 10. Ils valent tout de même le détour.

- Apache Kafka

Idéal pour les plateformes de streaming de données en temps réel

- Qubole

Idéal pour l'analyse big data cloud-native et évolutive

- Explorium

Idéal pour l’intégration de plateformes de données externes

Critiques associées

- Outils de conception de bases de données

- Logiciels de masquage de données

- Outils d’intégration de données

- Logiciels de base de données sur poste de travail

- Logiciels de réplication de données

Critères de sélection des logiciels Big Data

Pour sélectionner les meilleurs logiciels Big Data à inclure dans cette liste, j’ai pris en compte les besoins courants des acheteurs et leurs points de douleur, comme la capacité à gérer la montée en charge et l’intégration des données. J’ai également utilisé la grille d’évaluation suivante afin de structurer et d’objectiver mon analyse :

Fonctionnalités principales (25 % de la note finale)

Pour figurer dans cette sélection, chaque solution devait répondre à ces cas d’usage incontournables :

- Stockage et gestion des données

- Traitement et analyse des données

- Intégration avec les systèmes existants

- Traitement des données en temps réel

- Scalabilité des opérations de données

Fonctionnalités distinctives supplémentaires (25 % de la note finale)

Pour affiner encore la sélection, j’ai recherché des fonctionnalités uniques telles que :

- Fonctionnalités d’apprentissage automatique

- Outils avancés de visualisation de données

- Nettoyage automatique des données

- Analyse prédictive

- Tableaux de bord personnalisables

Utilisabilité (10 % de la note finale)

Pour évaluer la convivialité de chaque système, j’ai pris en compte les facteurs suivants :

- Interface utilisateur intuitive

- Facilité de navigation

- Options de personnalisation

- Courbe d’apprentissage

- Retours et avis des utilisateurs

Onboarding (10 % de la note finale)

Pour juger l’expérience d’intégration de chaque plateforme, j’ai étudié les éléments suivants :

- Disponibilité de vidéos de formation

- Visites interactives du produit

- Accès à des modèles

- Webinaires et ateliers

- Réactivité des chatbots

Support client (10 % du score total)

Pour évaluer les services d’assistance de chaque fournisseur de logiciel, j’ai pris en compte les éléments suivants :

- Disponibilité d'une assistance 24h/24 et 7j/7

- Délai de réponse aux demandes

- Accès à une base de connaissances

- Qualité de la documentation d'assistance

- Forums communautaires d’utilisateurs

Rapport qualité/prix (10 % du score total)

Pour évaluer le rapport qualité/prix de chaque plateforme, j’ai pris en compte les éléments suivants :

- Comparaison des plans tarifaires

- Fonctionnalités incluses dans chaque offre

- Flexibilité des abonnements

- Réductions pour les contrats à long terme

- Retours des clients sur la tarification

Avis clients (10 % du score total)

Pour évaluer le niveau de satisfaction globale des clients, j’ai pris en compte les points suivants lors de la lecture des avis :

- Notes de satisfaction globale

- Avantages et inconvénients les plus souvent mentionnés

- Fréquence des mises à jour et améliorations

- Retour d'expérience sur le support

- Expériences des utilisateurs sur le long terme

Comment choisir un logiciel Big Data

Il est facile de se perdre dans de longues listes de fonctionnalités et des grilles tarifaires complexes. Pour vous aider à rester concentré lors de votre processus de sélection de logiciel, voici une liste des facteurs à garder à l’esprit :

| Facteur | À prendre en compte |

|---|---|

| Scalabilité | Le logiciel peut-il gérer la croissance de vos données ? Vérifiez s’il prend en charge l’augmentation du volume et de la complexité des données sans perte de performance. |

| Intégrations | S’intègre-t-il à vos outils existants ? Vérifiez s’il permet une intégration transparente avec vos systèmes actuels, comme le stockage cloud et les logiciels de data fabric. |

| Personnalisation | Pouvez-vous l’adapter à vos besoins ? Vérifiez si le logiciel autorise la personnalisation pour répondre à vos exigences et processus métier spécifiques. |

| Facilité d’utilisation | Est-il facile à utiliser ? Évaluez la courbe d’apprentissage et la facilité avec laquelle votre équipe pourra adopter et utiliser efficacement le logiciel. |

| Mise en œuvre et intégration | Combien de temps pour se lancer ? Évaluez le temps et les ressources nécessaires pour l’installation et la formation, ainsi que la disponibilité d’un accompagnement pour vous aider dans le processus. |

| Coût | Rentre-t-il dans votre budget ? Comparez les modèles de tarification et le coût total de possession, y compris les frais cachés et les dépenses à long terme. |

| Mesures de sécurité | Vos données sont-elles protégées ? Assurez-vous que le logiciel répond à vos normes de sécurité et propose les fonctionnalités de protection des données requises. |

| Exigences de conformité | Est-il conforme à la réglementation ? Vérifiez si le logiciel répond aux normes de conformité spécifiques à votre secteur et aux exigences légales applicables à votre organisation. |

Qu’est-ce qu’un logiciel Big Data ?

Un logiciel Big Data est un outil conçu pour traiter, analyser et gérer efficacement de grands volumes de données. Les data scientists, analystes et professionnels IT utilisent généralement ces outils pour extraire des informations et prendre des décisions fondées sur les données. Les capacités de stockage, de traitement en temps réel et d’intégration facilitent la gestion d’opérations complexes et le soutien aux besoins métiers. Pour les organisations qui envisagent leurs options, explorer Databricks ou les concurrents de Databricks peut offrir un aperçu précieux des différentes plateformes possibles. Ces outils apportent une immense valeur en transformant de vastes quantités de données en informations exploitables.

Fonctionnalités

Lors de la sélection d’un logiciel Big Data, portez une attention particulière aux fonctionnalités clés suivantes :

- Stockage des données : Gère efficacement de grands volumes de données en offrant un accès fiable et une gestion optimisée.

- Traitement en temps réel : Permet une analyse rapide des données dès leur arrivée, facilitant ainsi la prise de décisions rapide.

- Capacités d’intégration : Se connecte aisément avec les systèmes et outils existants, améliorant l’efficacité des flux de travail.

- Évolutivité : S’adapte à la croissance des besoins en données sans compromettre les performances, accompagnant l’expansion de l’entreprise.

- Outils d’observabilité des données : Propose une représentation visuelle des analyses, rendant les informations complexes plus faciles à comprendre.

- Personnalisation : Permet d’adapter le logiciel aux besoins et processus spécifiques de l’entreprise.

- Mesures de sécurité : Protège les données sensibles grâce à des dispositifs de sécurité robustes, garantissant conformité et confiance.

- Soutien à l’apprentissage automatique : Facilite l’analyse avancée et la modélisation prédictive, améliorant ainsi les stratégies basées sur les données.

- Interface conviviale : Simplifie la navigation et l’utilisation, réduisant la courbe d’apprentissage pour les utilisateurs.

- Nettoyage automatisé des données : Améliore la qualité des données en détectant et corrigeant automatiquement les erreurs.

Avantages

L’adoption d’un logiciel big data apporte de nombreux avantages à votre équipe et à votre entreprise. Voici quelques bénéfices à anticiper :

- Meilleure prise de décision : Le traitement en temps réel et la visualisation facilitent la compréhension rapide des tendances pour des choix éclairés.

- Efficacité accrue : Les capacités d’intégration et l’automatisation réduisent les tâches manuelles, permettant à l’équipe de se concentrer sur des activités stratégiques.

- Évolutivité : Répond facilement à l’augmentation des besoins en données, garantissant que votre logiciel suit la croissance de votre entreprise.

- Sécurité renforcée des données : Des mesures de sécurité protègent les informations sensibles, assurant conformité et confiance.

- Meilleures analyses : Le support de l’apprentissage automatique et l’analytique avancée offrent une compréhension approfondie et des prédictions pour optimiser les stratégies futures.

- Réduction des coûts : Une gestion efficace des données diminue les coûts opérationnels en optimisant les ressources et en limitant les gaspillages.

Coûts & Tarification

Pour choisir un logiciel big data, il faut comprendre les différents modèles de tarification disponibles. Les coûts varient selon les fonctionnalités, la taille de l’équipe, les modules complémentaires, et plus encore. Le tableau ci-dessous résume les offres courantes, leurs tarifs moyens et les caractéristiques généralement incluses dans les solutions big data :

Tableau comparatif des offres de logiciels Big Data

| Type d’offre | Prix moyen | Fonctionnalités courantes |

|---|---|---|

| Offre gratuite | $0 | Stockage de données de base, capacités de traitement limitées et support par la communauté. |

| Offre personnelle | $10-$30/user/month | Visualisation avancée des données, intégration avec des outils courants et support par e-mail. |

| Offre professionnelle | $50-$100/user/month | Analytique avancée, traitement en temps réel et support client dédié. |

| Offre entreprise | $150-$300/user/month | Solutions personnalisables, support de l’apprentissage automatique, sécurité complète et assistance 24/7. |

| Je n’ai pas trouvé de FAQ spécifiques dans les résultats de recherche. Toutefois, voici quelques questions avancées fréquentes sur les logiciels big data selon la connaissance courante du secteur : |

Questions les plus fréquentes concernant les logiciels Big Data

Les logiciels Big Data peuvent-ils améliorer la prise de décision ?

Oui, les logiciels Big Data peuvent considérablement améliorer la prise de décision en fournissant des analyses et des informations en temps réel. Ils vous aident à comprendre les tendances, les schémas et les anomalies dans vos données. Grâce à des outils d’analyse avancés et de visualisation, votre équipe peut prendre des décisions éclairées basées sur des données précises et complètes.

Quels sont les défis courants lors de la mise en œuvre d'un logiciel Big Data ?

Les défis courants incluent l’intégration des données, le maintien de la qualité des données et la gestion de la sécurité des données. Vous pouvez rencontrer des difficultés à faire évoluer le logiciel pour gérer des volumes de données croissants. Une formation adéquate et une bonne gestion du changement sont essentielles pour que votre équipe utilise efficacement le logiciel.

Quelle est l'importance de la sécurité des données dans un logiciel Big Data ?

La sécurité des données est cruciale dans les logiciels Big Data en raison de la nature sensible des informations traitées. Assurez-vous que le logiciel offre des fonctionnalités de sécurité robustes telles que le chiffrement, des contrôles d’accès et la conformité aux normes du secteur. Protéger vos données renforce la confiance de vos parties prenantes et minimise les risques juridiques.

Prochaine étape :

Si vous êtes en train de rechercher des logiciels Big Data, contactez gratuitement un conseiller SoftwareSelect pour recevoir des recommandations personnalisées.

Vous remplissez un formulaire puis avez un court entretien dans lequel ils s'intéressent aux détails spécifiques de vos besoins. Vous recevrez alors une liste restreinte de logiciels à examiner. Ils vous accompagneront même tout au long du processus d’achat, y compris lors des négociations tarifaires.