Die besten Data Observability Tools im Überblick

Hier ist meine Auswahl der besten Data Observability Tools:

Die besten Data Observability Tools helfen Teams dabei, Datenqualitätsprobleme frühzeitig zu erkennen, Pipeline-Ausfälle zu reduzieren und zuverlässige Analysen und Berichte sicherzustellen. Diese Tools verschaffen Daten- und Engineering-Teams Einblicke darin, wie sich Daten bewegen und verändern, sodass Probleme behoben werden können, bevor sie nachgelagerte Systeme beeinträchtigen.

Teams suchen oft nach Data Observability Tools, wenn kaputte Pipelines unbemerkt bleiben, manuelle Prüfungen keine Anomalien erkennen oder Fehlkonfigurationen dafür sorgen, dass falsche Daten an Dashboards und Anwendungen gelangen. Diese Probleme verlangsamen Entscheidungsprozesse, sorgen für Nacharbeit und führen zu Reibungen zwischen Daten-, Engineering- und Business-Teams.

Mit über 20 Jahren Branchenerfahrung als Chief Technology Officer habe ich Dutzende Data Observability Tools in realen Umgebungen getestet und bewertet, um deren Überwachungstiefe, Integrationen und Bedienbarkeit einzuordnen. Dieser Leitfaden stellt die besten Data Observability Tools vor, die die Datenzuverlässigkeit erhöhen, eine schnellere Problemlösung ermöglichen und für mehr Vertrauen in die genutzten Daten sorgen. Jede Bewertung geht auf Funktionen, Vor- und Nachteile sowie die idealen Einsatzszenarien ein, um Ihnen bei der Auswahl des passenden Tools zu helfen.

Warum Sie unseren Software-Bewertungen vertrauen können

Wir testen und bewerten SaaS-Entwicklungssoftware seit 2023. Als Tech-Expert:innen wissen wir, wie wichtig und zugleich schwierig es ist, die richtige Entscheidung bei der Software-Auswahl zu treffen. Wir investieren intensiv in Recherchen, um unserer Community zu besseren Software-Kaufentscheidungen zu verhelfen.

Wir haben mehr als 2.000 Tools für verschiedene SaaS-Entwicklungsszenarien getestet und über 1.000 umfassende Software-Bewertungen verfasst. Erfahren Sie wie wir transparent bleiben und schauen Sie sich unsere Software-Bewertungsmethodik an.

Table of Contents

- Beste Software-Auswahl

- Warum Sie uns vertrauen können

- Spezifikationen vergleichen

- Bewertungen

- Weitere Data-Observability-Tools

- Verwandte Bewertungen

- Auswahlkriterien

- Wie Sie auswählen

- Trends bei Data-Observability-Tools

- Was sind Data-Observability-Tools?

- Funktionen

- Vorteile

- Kosten & Preise

- Häufige Fragen

Zusammenfassung der besten Data Observability Tools

Diese Vergleichstabelle fasst die Preisinformationen meiner Top Data Observability Tools zusammen, sodass Sie das passende Tool für Ihr Budget und Ihre geschäftlichen Anforderungen finden.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Am besten geeignet für fortschrittliches Log-Management | Kostenlose Demo + 30-tägige kostenlose Testversion verfügbar | Ab $9/Monat (jährlich abgerechnet) | Website | |

| 2 | Am besten für Log-Analysen geeignet | Kostenlose Testversion verfügbar + kostenlose Demo | Ab $25/Nutzer/Monat (jährliche Abrechnung) | Website | |

| 3 | Am besten geeignet für Anomalieerkennung | Kostenlose Demo verfügbar | Preise auf Anfrage | Website | |

| 4 | Am besten für Anwendungsperformance | 14-tägige kostenlose Testphase + Demo verfügbar | Ab $75/Monat | Website | |

| 5 | Am besten geeignet für automatisierte Überwachung | Kostenlose Demo verfügbar | Preise auf Anfrage | Website | |

| 6 | Am besten geeignet für Datenoperationen | 30 Tage kostenlos testen | Preis auf Anfrage | Website | |

| 7 | Am besten geeignet für Einblicke in die Datenqualität | Kostenlose Demo verfügbar | Preis auf Anfrage | Website | |

| 8 | Am besten für Kubernetes-Überwachung | Kostenloser Tarif verfügbar | Ab $20/Monat (jährliche Abrechnung) | Website | |

| 9 | Am besten für Datenvalidierung | Kostenlose Demo verfügbar | Preise auf Anfrage | Website | |

| 10 | Am besten für Echtzeit-Benachrichtigungen | Kostenloser Plan verfügbar | Ab $10/Monat (jährliche Abrechnung) | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Bewertungen der besten Data Observability Tools

Nachfolgend finden Sie meine ausführlichen Zusammenfassungen der besten Data Observability Tools, die es in meine Vorauswahl geschafft haben.nnMeine Bewertungen bieten einen detaillierten Überblick über die wichtigsten Funktionen, Vor- und Nachteile, Integrationen und idealen Anwendungsfälle jedes Tools, damit Sie das beste für sich finden.

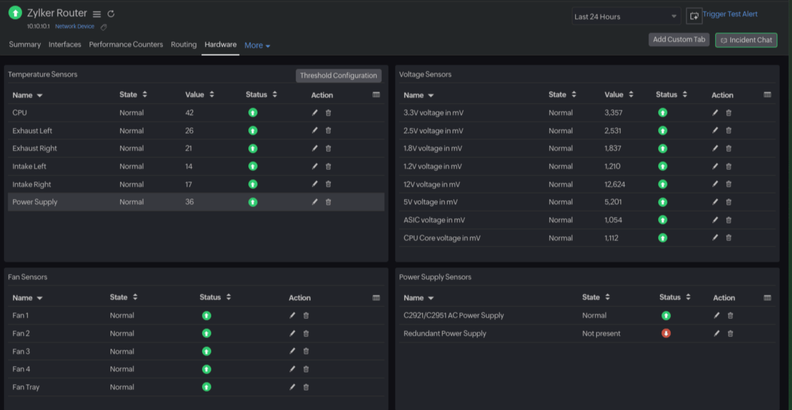

Wenn Sie ein Data-Observability-Tool suchen, das die zuverlässige Funktion Ihrer Systeme unterstützt, bietet Site24x7 erweiterte Log-Management-Funktionen, mit denen Teams Systemaktivitäten überprüfen und analysieren können. Die Lösung richtet sich an IT-Fachleute, DevOps-Teams und Unternehmen unterschiedlicher Größe und stellt eine Vielzahl an Überwachungsfunktionen für das Management und die Wartung digitaler Umgebungen bereit. Mit Site24x7 können Teams die Anwendungsleistung nachverfolgen, Cloud-Ressourcen überwachen und die Netzwerkintegrität erhalten, um einen stabilen Betrieb sicherzustellen.

Warum ich Site24x7 ausgewählt habe

Ich habe Site24x7 aufgrund seines fortschrittlichen Log-Managements gewählt, das es Teams ermöglicht, Protokolle zu sammeln und zu prüfen, um Systemaktivitäten zu verstehen und Probleme zu erkennen. Das Application Performance Monitoring (APM) erlaubt es Teams, den Zustand und die Leistung von Anwendungen in Echtzeit zu überwachen. Die Plattform ermöglicht zudem das Sammeln, Indexieren und Analysieren von Logs in unterschiedlichen Umgebungen, unterstützt die Problemanalyse und trägt zur Stabilität der Anwendungen bei.

Wichtige Funktionen von Site24x7

Neben fortschrittlichem Log-Management bietet Site24x7:

- Real User Monitoring (RUM): Verfolgt reale Benutzerinteraktionen auf Ihrer Website und liefert Einblicke in Nutzererfahrung und Leistungsengpässe.

- Netzwerküberwachung: Überwacht kritische Netzwerkgeräte und den Datenverkehr, um die Sichtbarkeit sowie Leistung und Verfügbarkeit des Netzwerks sicherzustellen.

- Öffentliche Statusseiten: Kommuniziert Service-Status und Ausfallzeiten an Ihre Kunden, steigert Transparenz und Vertrauen.

- AIOps-Integration: Nutzt KI und maschinelles Lernen zur Anomalieerkennung sowie zum Incident Management und erhöht damit die betriebliche Effizienz.

Site24x7-Integrationen

Zu den Integrationen zählen ServiceNow, PagerDuty, Jira, Slack, Microsoft Teams, Zapier, Moogsoft, Opsgenie, VictorOps und HipChat. Eine API für benutzerdefinierte Integrationen ist verfügbar.

Pros and Cons

Pros:

- Flexible Überwachungslösung lässt sich leicht mit verschiedenen Infrastrukturkomponenten integrieren

- Schneller Einrichtungsprozess ermöglicht Website- und Cloud-Überwachung

- KI-gestütztes Full-Stack-Monitoring unterstützt das Management multicloudfähiger Infrastrukturen

Cons:

- Preisstruktur wird durch unterschiedliche Monitoring-Typen schnell teuer

- Probleme mit Benachrichtigungen treten beim Hinzufügen neuer Überwachungskonfigurationen auf

New Product Updates from Site24x7

Site24x7 Enhances Network Monitoring With Device and Visibility Updates

Site24x7 introduces proactive hardware health monitoring, expanded device support, centralized network controls, and enhanced SD-WAN visualization to improve network monitoring and management. For more information, visit Site24x7’s official site.

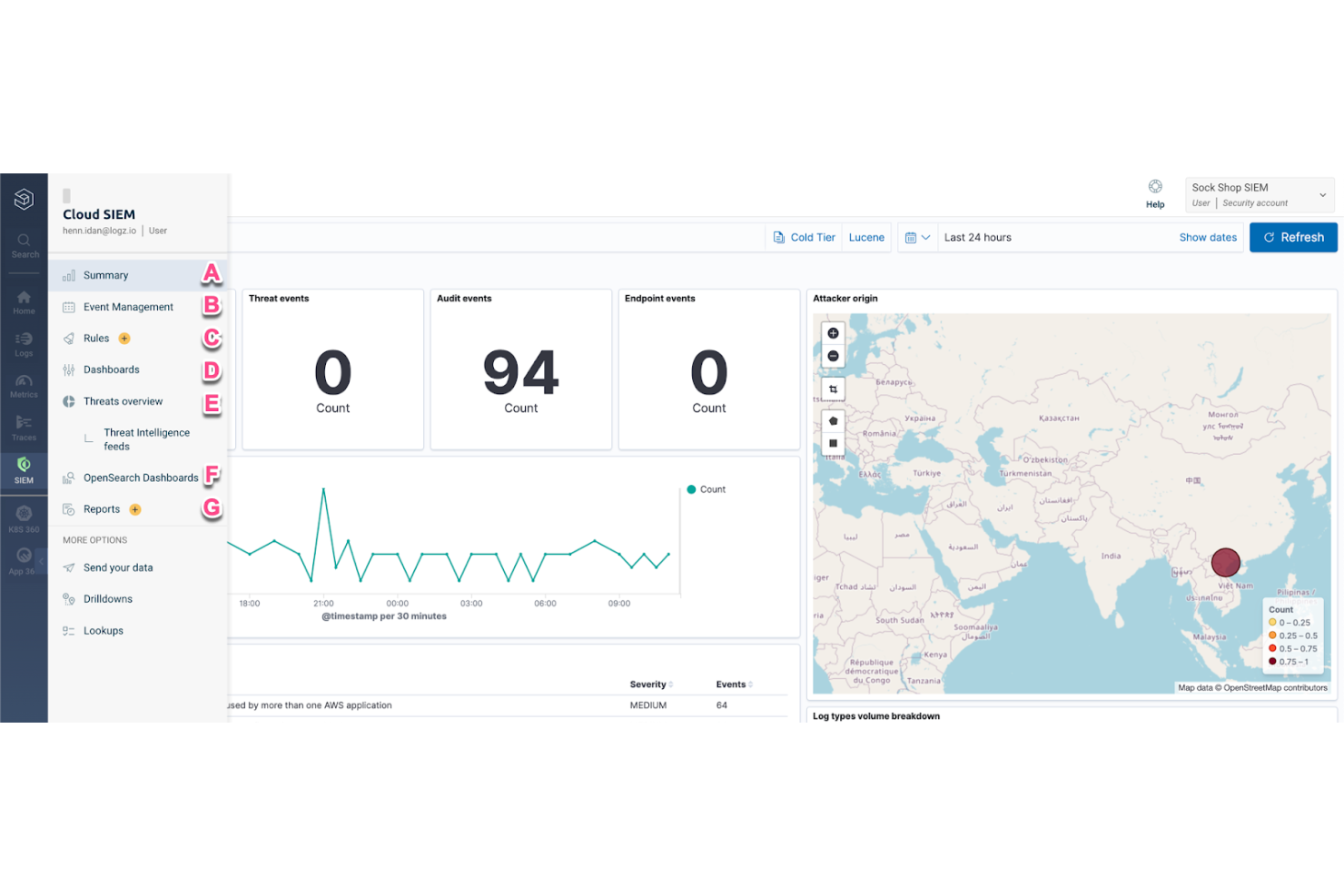

Logz.io ist eine cloudbasierte Plattform für Log-Management, die für DevOps- und IT-Teams entwickelt wurde und sich auf Log-Analysen und Monitoring konzentriert. Sie hilft Teams dabei, Erkenntnisse aus Protokollen zu gewinnen, um die Anwendungsleistung zu verbessern und Probleme effizient zu beheben.

Warum ich Logz.io gewählt habe: Die Plattform glänzt in der Log-Analyse und liefert Ihrem Team wertvolle Einblicke in die Anwendungsleistung. Logz.io bietet Echtzeitüberwachung und stellt sicher, dass Sie Probleme erkennen, sobald sie auftreten. Das Alarmsystem des Tools hält Sie über alle in Ihren Logs erkannten Anomalien auf dem Laufenden. Das benutzerfreundliche Dashboard ermöglicht eine einfache Navigation und schnellen Zugriff auf wichtige Daten.

Herausragende Funktionen & Integrationen:

Funktionen beinhalten das Echtzeit-Log-Monitoring, das Ihnen hilft, Probleme zeitnah zu erkennen. Logz.io bietet Anomalieerkennung, um ungewöhnliche Muster in Ihren Protokolldaten zu identifizieren. Darüber hinaus stellt die Plattform ein benutzerfreundliches Dashboard bereit, das die Navigation und den Zugriff auf wichtige Informationen erleichtert.

Integrationen umfassen AWS, Azure, Google Cloud, Kubernetes, Docker, Datadog, Grafana, Slack, PagerDuty und ServiceNow.

Pros and Cons

Pros:

- Effektive Log-Analyse

- Anomalieerkennung inklusive

- Benutzerfreundliches Dashboard

Cons:

- Begrenzte Anpassungsmöglichkeiten

- Hohe Lernkurve

Monte Carlo ist eine Daten-Observability-Plattform, die für Data Engineers und Analysten entwickelt wurde und sich auf die Erkennung von Anomalien sowie die Sicherstellung der Datenzuverlässigkeit konzentriert. Sie unterstützt Teams dabei, Datenpipelines zu überwachen und Ausfallzeiten von Daten zu verhindern.

Warum ich Monte Carlo ausgewählt habe: Die Plattform überzeugt durch ihre exzellente Anomalieerkennung, die essenziell für die Aufrechterhaltung der Datenqualität ist. Monte Carlo nutzt automatisiertes Monitoring, um Datenprobleme zu erkennen, bevor sie Ihre Abläufe beeinflussen. Das Tool liefert Einblicke in den Gesundheitszustand und die Herkunft Ihrer Daten, wodurch Ihr Team Probleme schnell identifizieren und lösen kann. Das Benachrichtigungssystem informiert Sie in Echtzeit über Anomalien und stellt so die Zuverlässigkeit der Daten sicher.

Hervorstechende Funktionen & Integrationen:

Funktionen beinhalten automatisch arbeitendes Datenmonitoring, das Ihnen hilft, die Datenintegrität zu wahren. Monte Carlo bietet Werkzeuge für die Datenherkunft (Data Lineage), mit denen Ihr Team die Quelle von Datenproblemen nachverfolgen kann. Darüber hinaus stellt die Plattform anpassbare Benachrichtigungen bereit, sodass Sie Mitteilungen auf Ihre spezifischen Anforderungen abstimmen können.

Integrationen umfassen Snowflake, BigQuery, Redshift, Databricks, Azure, AWS, Google Cloud, Looker, Tableau und dbt.

Pros and Cons

Pros:

- Effektive Anomalieerkennung

- Echtzeit-Benachrichtigungen

- Automatisiertes Datenmonitoring

Cons:

- Begrenzte Anpassungsmöglichkeiten

- Hohe Lernkurve

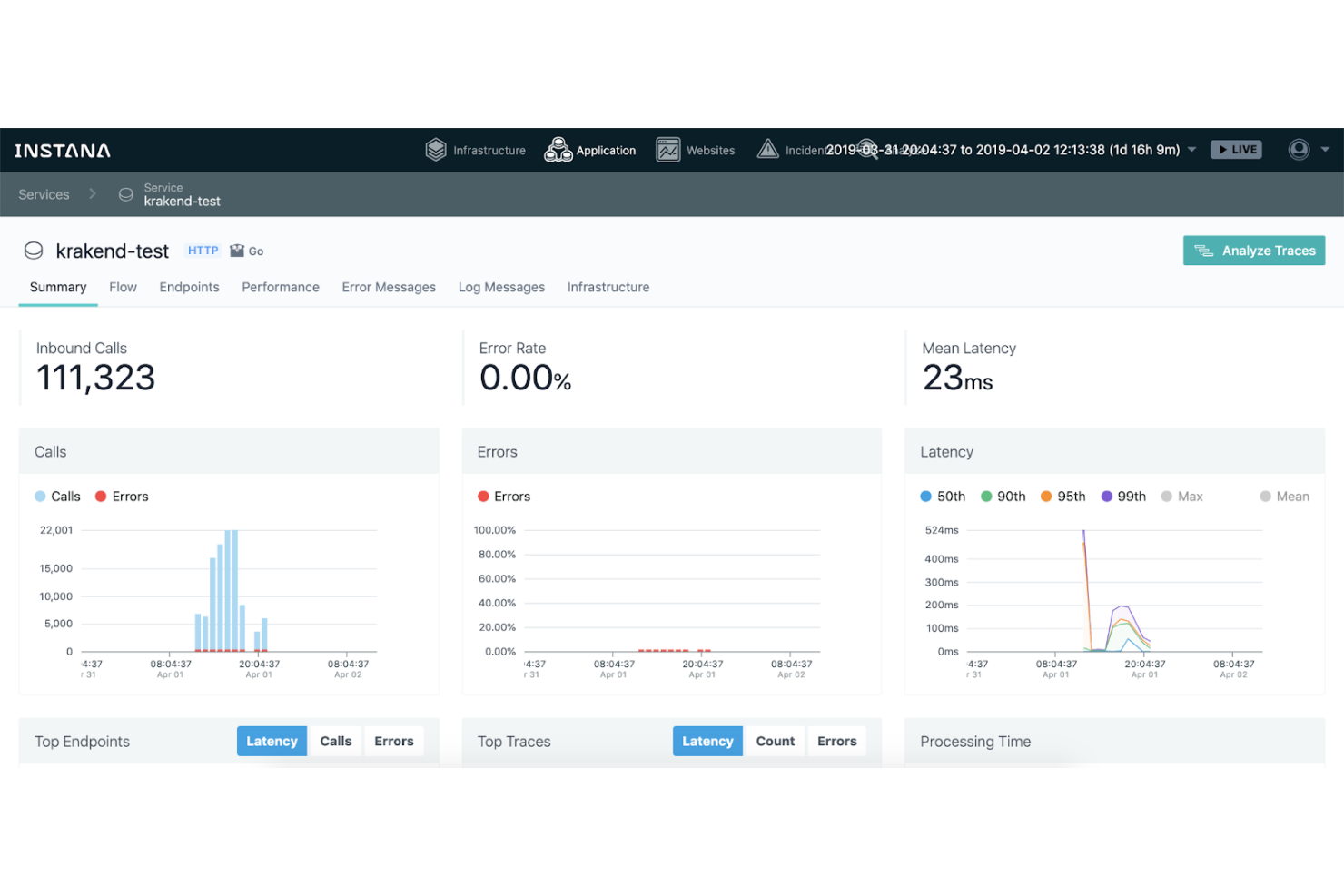

Instana ist ein Tool zur Überwachung der Anwendungsleistung, das für DevOps- und IT-Operationsteams entwickelt wurde und sich auf Echtzeittransparenz und Einblicke konzentriert. Es hilft Teams, Anwendungen und Infrastruktur zu überwachen, um eine optimale Leistung und Zuverlässigkeit sicherzustellen.

Warum ich Instana gewählt habe: Es bietet eine außergewöhnliche Überwachung der Anwendungsleistung mit Echtzeit-Einblicken, die für den Erhalt eines optimalen Systembetriebs entscheidend sind. Instana ermöglicht die automatische Erkennung von Anwendungen und Infrastruktur, sodass Ihr Team immer über aktuelle Informationen verfügt. Mit Echtzeit-Benachrichtigungen werden Sie sofort über Leistungsprobleme informiert. Die detaillierten Dashboards des Tools bieten einen umfassenden Überblick über den Zustand und die Performance Ihres Systems.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen automatische Ursachenanalyse, die Ihnen hilft, die Quelle von Leistungsproblemen schnell zu identifizieren. Instana bietet kontinuierliche Überwachung, sodass Ihre Anwendungen und Infrastruktur stets im Blick sind. Darüber hinaus stellt die Plattform detaillierte Dashboards bereit, die Ihnen einen klaren Überblick über den Systemzustand geben.

Integrationen umfassen AWS, Azure, Google Cloud, Kubernetes, Docker, Prometheus, Grafana, Slack, Splunk und Jenkins.

Pros and Cons

Pros:

- Echtzeit-Einblicke

- Automatische Erkennung von Anwendungen

- Detaillierte Dashboards

Cons:

- Komplex für neue Benutzer

- Erfordert technisches Fachwissen

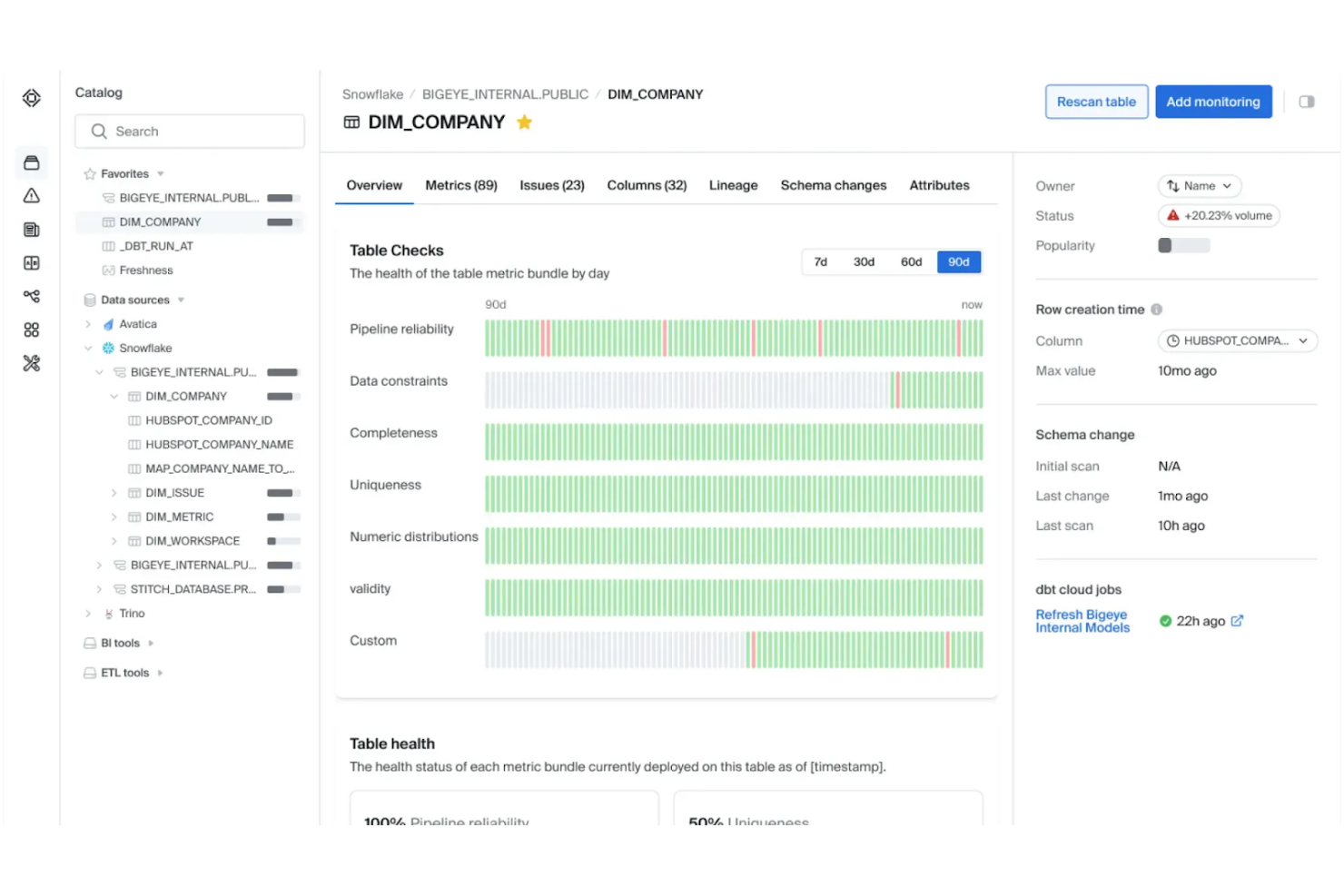

Bigeye ist eine Plattform für Datenüberwachung, die sich an Data Engineers und Analysten richtet und den Fokus auf die Automatisierung der Datenqualitätsüberwachung legt. Sie hilft Teams dabei, die Genauigkeit und Zuverlässigkeit ihrer Datenpipelines sicherzustellen.

Warum ich Bigeye gewählt habe: Die Software punktet besonders durch automatisierte Überwachung, wodurch der Bedarf an manuellen Prüfungen sinkt und die Effizienz steigt. Die Bigeye-Plattform bietet eine Anomalieerkennung, die Ihr Team automatisch auf potenzielle Datenprobleme aufmerksam macht. Das Tool stellt anpassbare Datenqualitätsmetriken bereit, sodass Sie die Überwachung auf Ihre individuellen Anforderungen abstimmen können. Das Benachrichtigungssystem sorgt dafür, dass Sie stets über den Zustand Ihrer Daten informiert bleiben.

Herausragende Funktionen & Integrationen:

Funktionen beinhalten Prüfungen auf Datenaktualität, mit denen Sie sicherstellen, dass Ihre Daten aktuell sind. Bigeye überwacht Genauigkeit und Konsistenz und liefert Einblicke in die Datenqualität Ihrer gesamten Pipelines. Darüber hinaus ermöglicht die Plattform eine Schwellenwert-basierte Alarmierung, sodass Sie spezifische Kriterien für Benachrichtigungen festlegen können.

Integrationen umfassen Snowflake, BigQuery, Redshift, Databricks, Amazon S3, Google Cloud, Looker, Tableau, dbt und Airflow.

Pros and Cons

Pros:

- Automatisierte Überwachung verfügbar

- Anpassbare Datenqualitätsmetriken

- Schwellenwert-basierte Benachrichtigungen

Cons:

- Komplexe Einrichtung für Einsteiger

- Erfordert technisches Fachwissen

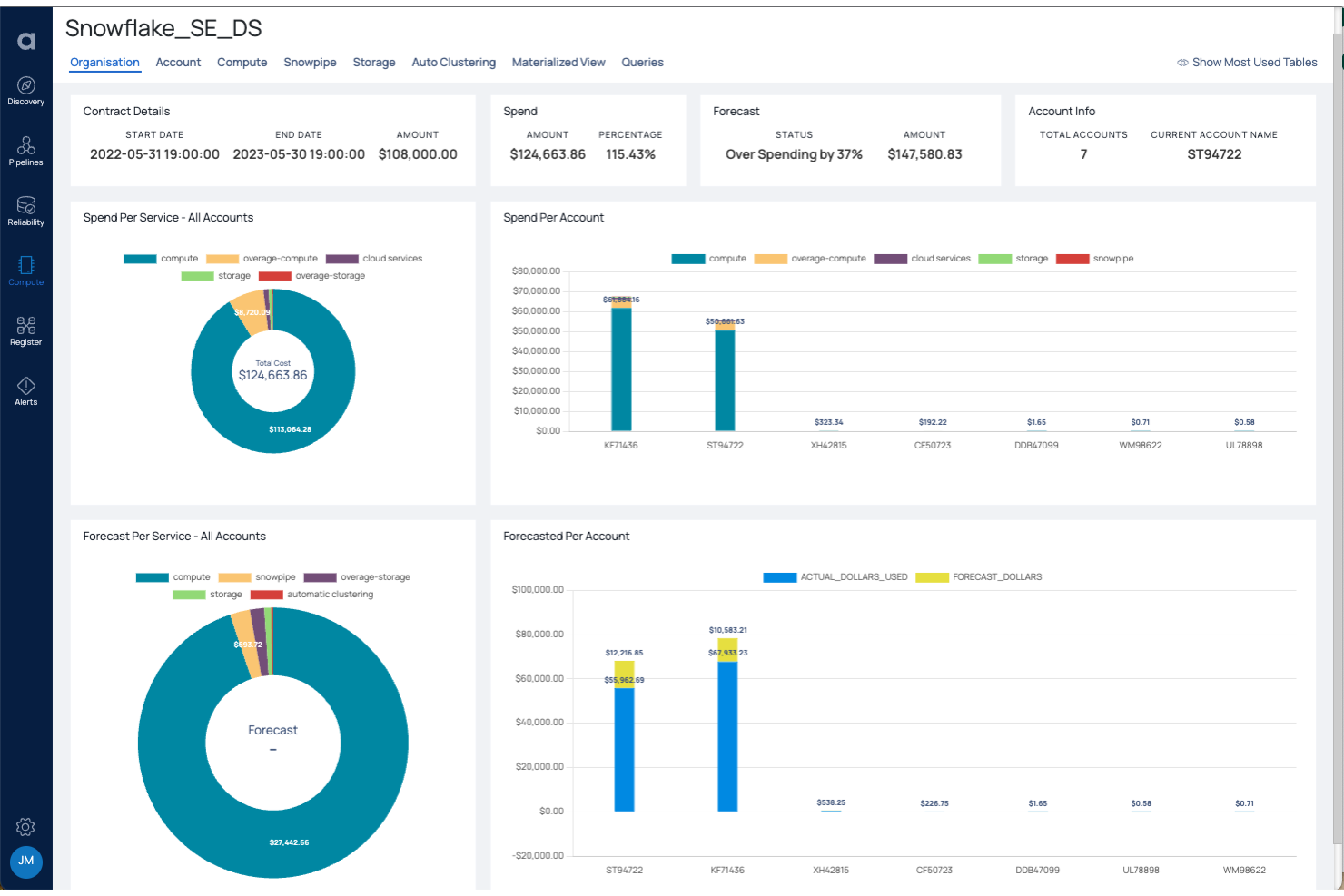

Acceldata ist eine Plattform für Datenbeobachtbarkeit, die speziell für Data Engineers und Betriebsteams entwickelt wurde und den Schwerpunkt auf die Verbesserung der Datenzuverlässigkeit und operativen Effizienz legt. Sie bietet umfassende Überwachung und Optimierung von Datenpipelines und Infrastruktur.

Warum ich Acceldata gewählt habe: Die Plattform glänzt im Bereich der Datenoperationen, indem sie Werkzeuge bereitstellt, die die Zuverlässigkeit und Effizienz von Datenprozessen steigern. Mit Acceldatas Überwachungsfunktionen kann Ihr Team Probleme frühzeitig erkennen und schnell beheben. Die Plattform liefert Einblicke in den Datenfluss innerhalb Ihres Systems, was ein besseres Ressourcenmanagement ermöglicht. Außerdem bietet sie prädiktive Analysen, um potenzielle Datenprobleme bereits im Vorfeld zu erkennen.

Herausragende Funktionen & Integrationen:

Funktionen umfassen prädiktive Analysen, mit denen Sie potenzielle Datenprobleme frühzeitig erkennen können. Acceldata stellt umfassende Überwachungstools bereit, die Ihrem Team Einblicke in die Performance der Datenpipelines bieten. Darüber hinaus ermöglicht die Plattform Ressourcenoptimierung, um die Effizienz der Datenprozesse zu steigern.

Integrationen umfassen AWS, Azure, Google Cloud, Hadoop, Spark, Databricks, Snowflake, Cloudera, Kafka und Tableau.

Pros and Cons

Pros:

- Prädiktive Analysen verfügbar

- Umfassende Überwachungstools

- Steigert die operative Effizienz

Cons:

- Begrenzte Dokumentation

- Wenige Anpassungsmöglichkeiten

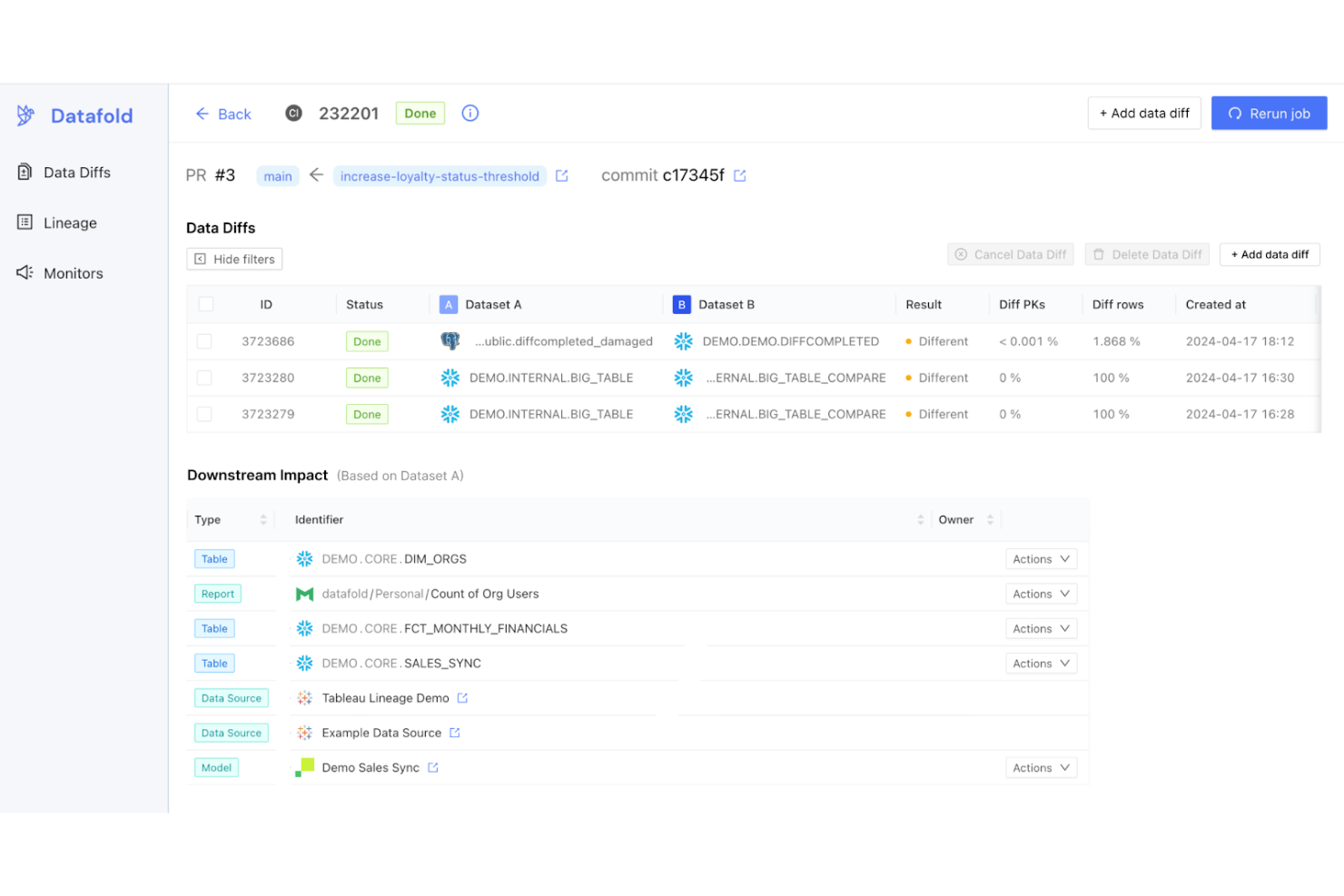

Datafold ist eine Plattform für Datenüberwachung, die speziell für Dateningenieure und Analysten entwickelt wurde und sich auf Datenqualität und -validierung konzentriert. Sie unterstützt Teams dabei, Datenabweichungen zu erkennen und Genauigkeit in datengetriebenen Abläufen sicherzustellen.

Warum ich Datafold ausgewählt habe: Die Plattform bietet detaillierte Einblicke in die Datenqualität, sodass Ihr Team Probleme erkennen kann, bevor sie sich auf die Entscheidungsfindung auswirken. Zu den Funktionen gehören Lineage auf Spaltenebene, womit Datenfehler bis zur Quelle zurückverfolgt werden können. Das Diff-Tool von Datafold ermöglicht den Vergleich von Datensätzen, um Unterschiede leicht festzustellen. Mit den Profiling-Funktionen erhält Ihr Team einen klaren Überblick über Datenmuster und Auffälligkeiten.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen Datendiffing, wodurch Datensätze schnell und präzise verglichen werden können. Datafold bietet zudem Profiling-Tools, die Einblicke in Datenverteilungen und Trends liefern. Darüber hinaus ermöglicht die Plattform Lineage auf Spaltenebene, sodass Ihr Team Datenprobleme bis zum Ursprung zurückverfolgen kann.

Integrationen umfassen Snowflake, BigQuery, Redshift, Databricks, dbt, Looker, Tableau, Airflow, Segment, FiveTran und Amazon S3.

Pros and Cons

Pros:

- Detaillierte Einblicke in die Datenqualität

- Lineage auf Spaltenebene

- Einfache Datensatzvergleiche

Cons:

- Begrenzte Dokumentation

- Kann für Einsteiger komplex sein

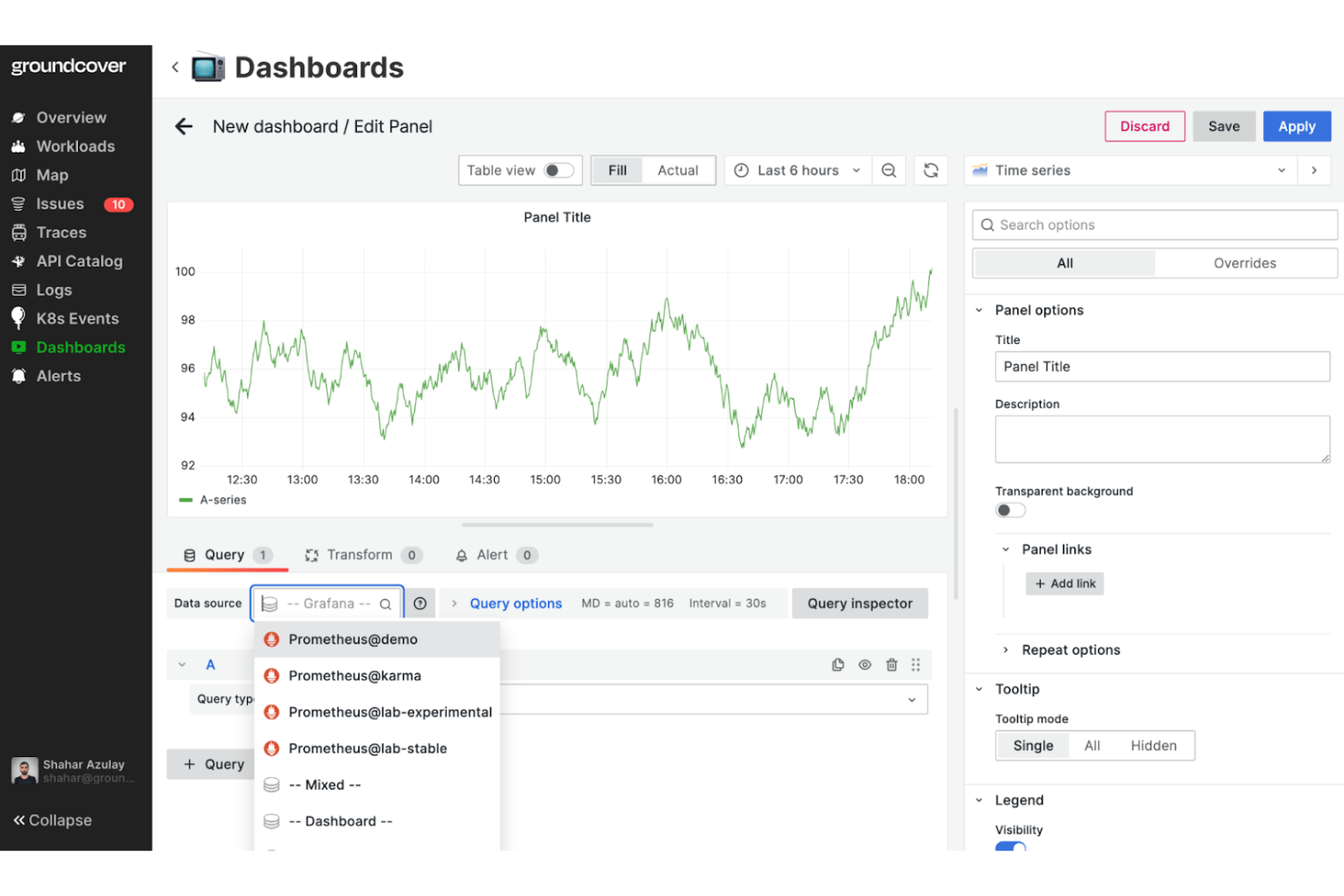

Groundcover ist eine Cloud-Observability-Plattform, die speziell für DevOps-Teams entwickelt wurde und eine umfassende Überwachung von Kubernetes-Umgebungen bietet. Sie nutzt eBPF-Technologie, um Echtzeiteinblicke und Sichtbarkeit in die Anwendungsperformance zu ermöglichen.

Warum ich Groundcover gewählt habe: Die Plattform zeichnet sich durch ihre tiefgehenden Integrationsmöglichkeiten für die Überwachung von Kubernetes-Umgebungen aus. Die BYOC-Architektur (Bring Your Own Cloud) sorgt für Datenschutz und Kontrolle, sodass Ihr Team ohne Codeänderungen überwachen kann. Echtzeiteinblicke und anpassbare Benachrichtigungen informieren Sie sofort über Probleme. Das transparente Preismodell ermöglicht unbegrenzte Datenerfassung ohne unerwartete Kosten.

Herausragende Funktionen & Integrationen:

Funktionen umfassen den Echtzeitzugriff auf kontextualisierte Einblicke, wodurch Sie Ihr Umfeld besser verstehen. Die Plattform bietet anpassbare Benachrichtigungen, um Sie über Anomalien zu informieren. Darüber hinaus konsolidiert Groundcover Logs, Metriken und Traces in einer benutzerfreundlichen Oberfläche für einfacheres Troubleshooting.

Integrationen umfassen AWS, Google Cloud, Azure, Kubernetes, Prometheus, Grafana, Datadog, ElasticSearch, Splunk und New Relic.

Pros and Cons

Pros:

- Tiefe Kubernetes-Integration

- Transparentes Preismodell

- Keine Codeänderungen nötig

Cons:

- Begrenzte Anpassungsmöglichkeiten

- Das Onboarding könnte reibungsloser sein

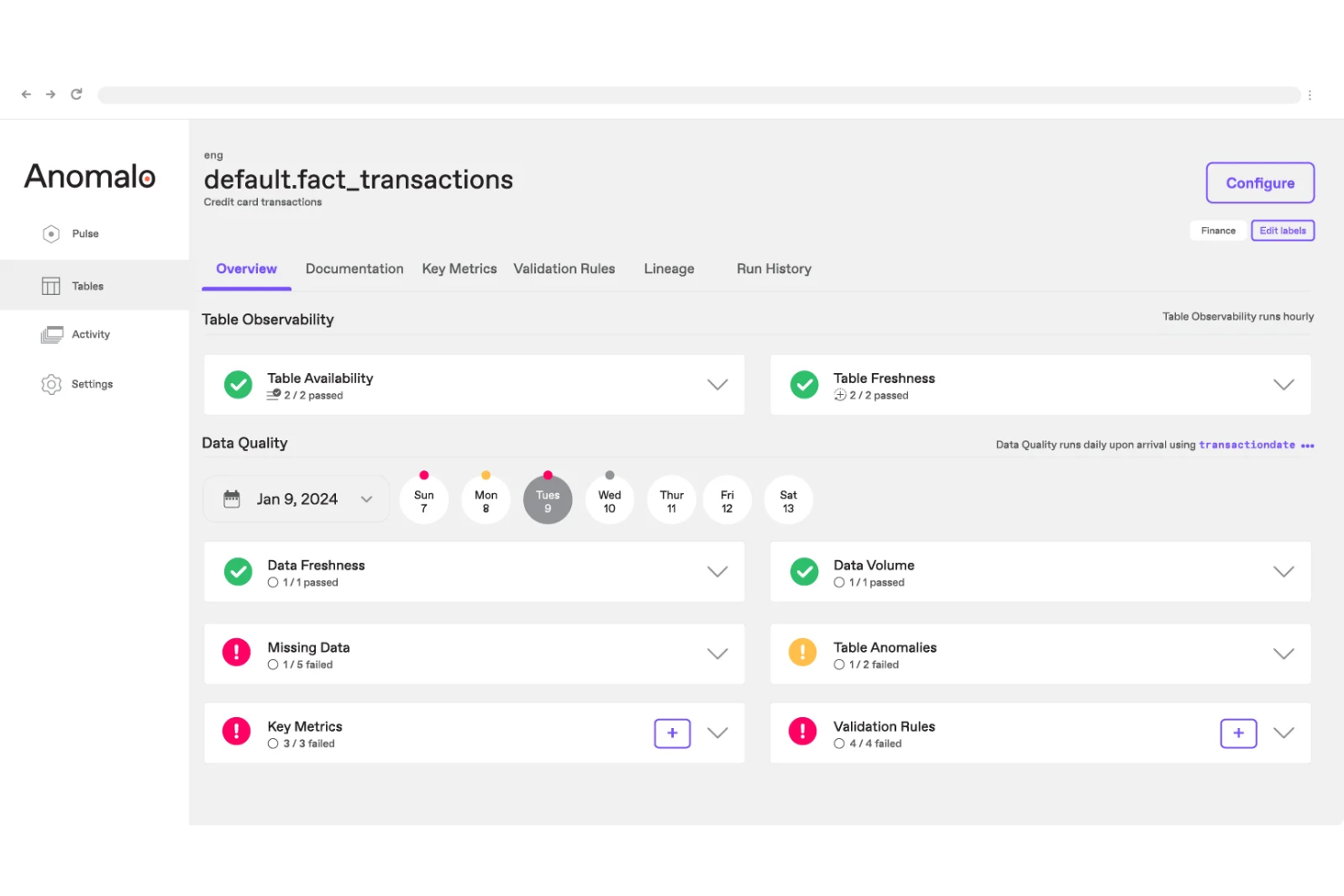

Anomalo ist eine KI-gesteuerte Plattform zur Überwachung der Datenqualität, die speziell für Unternehmen entwickelt wurde und sich auf Anomalieerkennung sowie Datenvalidierung konzentriert. Sie richtet sich an Data Engineers und Analysten, indem sie Datenintegrität und Vertrauen gewährleistet, ohne dass Programmierkenntnisse erforderlich sind.

Warum ich Anomalo ausgewählt habe: Die Lösung überzeugt insbesondere bei der Datenvalidierung, da sie maschinelles Lernen einsetzt, um Datenprobleme proaktiv zu erkennen. Mit Anomalo kann Ihr Team anpassbare Validierungsregeln und wichtige Leistungskennzahlen festlegen. Darüber hinaus unterstützt die Plattform Data Governance und Überwachbarkeit, wodurch die betriebliche Effizienz gesteigert wird. Anomalo lässt sich problemlos mit Data Lakes und Data Warehouses integrieren, um eine nahtlose Überwachung zu ermöglichen.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen Datenprofilierung, die Ihnen Einblicke in Datenmuster und Trends bietet. Anomalo stellt außerdem Werkzeuge zur Datenherkunft (Lineage) bereit, die es Ihrem Team ermöglichen, Datenflüsse und Abhängigkeiten nachzuvollziehen. Zusätzlich gibt es automatisierte Prüfungen und eine auf Metadaten basierende Überwachbarkeit, die die Zuverlässigkeit der Daten sicherstellt.

Integrationen umfassen Snowflake, BigQuery, Redshift, Databricks, Azure, Google Cloud Storage, Amazon S3, Looker, Tableau und Power BI.

Pros and Cons

Pros:

- KI-basierte Datenvalidierung

- Individuell anpassbare Validierungsregeln

- Keine Programmierung erforderlich

Cons:

- Erfordert technisches Know-how

- Preisinformationen nicht transparent

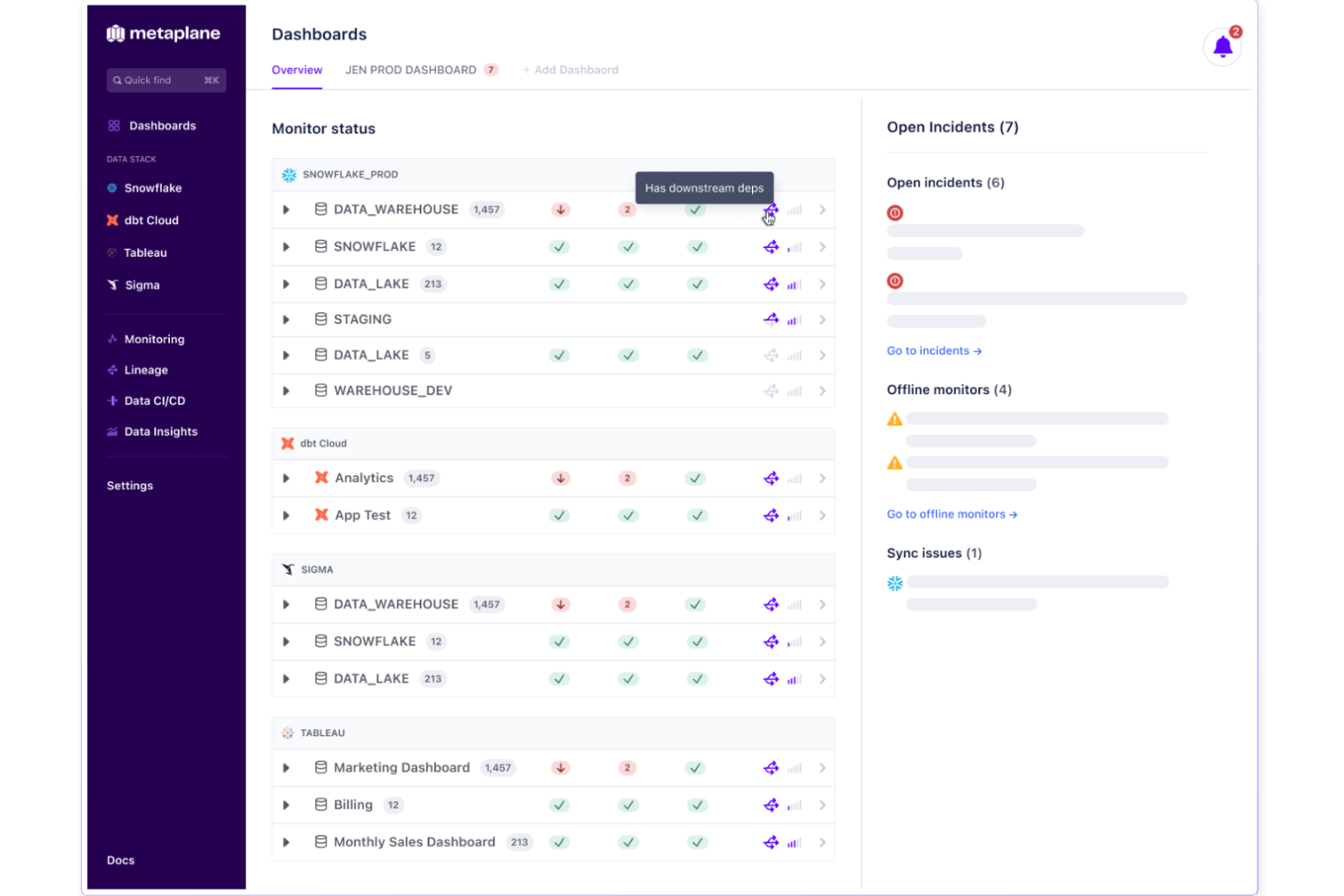

Metaplane ist eine End-to-End-Datenüberwachungsplattform, die für moderne Datenteams entwickelt wurde und sich auf die Überwachung von Datenqualität und -herkunft konzentriert. Sie richtet sich an Datenanalysten und -ingenieure, um Datenqualitätsprobleme zu verhindern und Einblick in Datenpipelines zu bieten.

Warum ich Metaplane ausgewählt habe: Die Plattform überzeugt durch Echtzeit-Benachrichtigungen, die entscheidend für die Wahrung der Datenintegrität sind. Automatisierte Benachrichtigungen informieren Ihr Team sofort über Anomalien. Funktionen wie Data CI/CD und Benachrichtigungen bei Schemaänderungen sorgen dafür, dass Ihre Daten stets korrekt bleiben. Mit Metaplane können Sie gezielt nur die benötigten Tabellen überwachen, was für Teams jeder Größe kostengünstig ist.

Besondere Funktionen & Integrationen:

Funktionen sind unter anderem automatisiertes Monitoring, Anomalieerkennung und anpassbare Alerts. Ihr Team profitiert von den Data-CI/CD-Fähigkeiten, die reibungslose Datenprozesse sichern. Die Plattform bietet zudem detailliertes Lineage-Tracking, sodass Sie Einblicke in Datenflüsse erhalten.

Integrationen sind Snowflake, BigQuery, Redshift, Databricks, dbt, Looker, Tableau, Airflow, Segment und FiveTran.

Pros and Cons

Pros:

- Echtzeit-Anomalie-Benachrichtigungen

- Flexibles Preismodell

- Detailliertes Lineage-Tracking

Cons:

- Begrenzte Dokumentation

- Gelegentliche Fehlalarme

Weitere Data Observability Tools

Hier sind einige weitere Data Observability Tools, die es zwar nicht in meine Vorauswahl geschafft haben, aber dennoch einen Blick wert sind:

- Unravel Data

Am besten geeignet für Leistungsüberwachung

- StackState

Am besten für Topologie-Visualisierung

- Pantomath

Am besten geeignet für Data Lineage (Datenherkunft)

Kriterien für die Auswahl von Data Observability Tools

Bei der Auswahl der besten Data Observability Tools für diese Liste habe ich alltägliche Anforderungen und Pain Points von Käufern wie Datenqualitätsprüfung und Echtzeitüberwachung berücksichtigt. Außerdem habe ich den folgenden Bewertungsrahmen genutzt, um objektiv und strukturiert zu vergleichen:

Kernfunktionen (25% der Gesamtnote)

Um in diese Liste aufgenommen zu werden, musste jede Lösung diese alltäglichen Anwendungsfälle abdecken:

- Datenqualität überwachen

- Anomalien erkennen

- Datenherkunft (Data Lineage) verfolgen

- Echtzeit-Benachrichtigungen bereitstellen

- Datenzuverlässigkeit gewährleisten

Weitere herausragende Features (25% der Gesamtnote)

Um die Auswahl weiter einzugrenzen, habe ich außerdem auf besondere Funktionen geachtet, wie zum Beispiel:

- Automatisierte Ursachenanalyse

- Anpassbare Dashboards

- Vorausschauende Analysen

- KI-gesteuerte Einblicke

- Plattformübergreifende Kompatibilität

Benutzerfreundlichkeit (10 % der Gesamtbewertung)

Um einen Eindruck von der Benutzerfreundlichkeit jedes Systems zu bekommen, habe ich Folgendes berücksichtigt:

- Intuitives Oberflächendesign

- Einfache Navigation

- Geringe Lernkurve

- Umfassende Dokumentation

- Reaktionsschnelle Benutzerinteraktion

Onboarding (10 % der Gesamtbewertung)

Um die Onboarding-Erfahrung für jede Plattform zu beurteilen, habe ich Folgendes berücksichtigt:

- Verfügbarkeit von Schulungsvideos

- Interaktive Produkttouren

- Zugang zu Webinaren

- Verfügbarkeit von Chatbots

- Vorgefertigte Vorlagen

Kundenservice (10 % der Gesamtbewertung)

Um den Kundenservice der einzelnen Softwareanbieter zu bewerten, habe ich Folgendes berücksichtigt:

- 24/7 Erreichbarkeit des Kundenservice

- Zugang zu einer Wissensdatenbank

- Live-Chat-Support

- E-Mail-Antwortzeit

- Verfügbarkeit von persönlichen Account Managern

Preis-Leistungs-Verhältnis (10 % der Gesamtbewertung)

Um das Preis-Leistungs-Verhältnis jeder Plattform zu bewerten, habe ich Folgendes berücksichtigt:

- Preistransparenz

- Wettbewerbsfähige Preise

- Verfügbarkeit von kostenlosen Testversionen

- Flexibilität bei den Preismodellen

- Kosten-Nutzen-Verhältnis

Kundenbewertungen (10 % der Gesamtbewertung)

Um ein Gefühl für die allgemeine Kundenzufriedenheit zu bekommen, habe ich beim Lesen von Kundenbewertungen auf Folgendes geachtet:

- Konsistenz positiver Rückmeldungen

- Häufig gemeldete Probleme

- Anwenderzufriedenheit

- Häufigkeit von Updates und Verbesserungen

- Reaktionsfähigkeit auf Feedback

Wie Sie Daten-Observability-Tools auswählen

Es ist leicht, sich in langen Funktionslisten und komplexen Preisstrukturen zu verlieren.

Um Ihnen zu helfen, sich bei der Auswahl Ihrer individuellen Software nicht zu verzetteln, finden Sie hier eine Checkliste mit Faktoren, die Sie berücksichtigen sollten:

| Faktor | Worauf achten? |

| Skalierbarkeit | Stellen Sie sicher, dass das Tool mit Ihren Datenanforderungen wächst. Suchen Sie nach Lösungen, die steigende Datenmengen und Komplexität unterstützen. |

| Integrationen | Überprüfen Sie, ob das Tool mit Ihren bestehenden Systemen wie Data Warehouses und BI-Tools integriert werden kann, um Arbeitsabläufe zu optimieren. |

| Anpassbarkeit | Achten Sie auf Werkzeuge, die die Anpassung von Dashboards und Berichten an die spezifischen Bedürfnisse und Ziele Ihres Teams ermöglichen. |

| Benutzerfreundlichkeit | Wählen Sie ein Tool mit einer intuitiven Benutzeroberfläche, die die Einarbeitungszeit für Ihr Team minimiert. |

| Budget | Stellen Sie die Kosten dem verfügbaren Budget gegenüber. Achten Sie auf transparente Preismodelle und mögliche versteckte Gebühren. |

| Sicherheitsmaßnahmen | Stellen Sie sicher, dass das Tool robuste Sicherheitsfunktionen wie Verschlüsselung und Unterstützung von Compliance-Anforderungen bietet. |

| Support-Optionen | Bewerten Sie die Verfügbarkeit und Qualität des Kundensupports, einschließlich Live-Chat und persönliche Account Manager. |

| Leistung | Prüfen Sie, wie schnell das Tool Daten verarbeitet und Erkenntnisse liefert, um sicherzustellen, dass es Ihre betrieblichen Anforderungen erfüllt. |

Trends bei Daten-Observability-Tools

In meinen Recherchen habe ich zahllose Produkt-Updates, Pressemitteilungen und Release-Logs verschiedener Anbieter von Daten-Observability-Tools ausgewertet. Hier sind einige der aufkommenden Trends, die ich besonders beobachte:

- KI-gestützte Einblicke: Anbieter integrieren KI, um prädiktive Analysen und Anomalieerkennung zu ermöglichen. Dies hilft Teams, potenzielle Probleme zu erkennen, bevor sie eskalieren, wodurch Zeit und Ressourcen gespart werden. Tools wie Dynatrace nutzen KI zur Verbesserung ihrer Observability-Funktionen.

- Echtzeitüberwachung: Die Verarbeitung von Daten in Echtzeit wird immer wichtiger. Unternehmen benötigen sofortige Einblicke, um schnell auf Probleme reagieren zu können, und Anbieter wie Logz.io konzentrieren sich darauf, Echtzeitanalysen anzubieten, um dieser Nachfrage gerecht zu werden.

- Vereinheitlichte Observability-Plattformen: Unternehmen suchen nach Plattformen, die verschiedene Observability-Funktionen zusammenführen. Dieser Trend reduziert Komplexität und steigert die Effizienz. Splunk Observability Cloud ist ein Beispiel hierfür und bietet eine einheitliche Ansicht auf Metriken, Logs und Traces.

- Fokus auf Datenschutz: Datenschutzfunktionen sind aufgrund steigender regulatorischer Anforderungen gefragt. Anbieter verstärken ihre Sicherheitsmaßnahmen, um die Einhaltung von Vorschriften wie der DSGVO zu gewährleisten. IBM Databand legt besonderen Wert auf Datenschutz in seinen Observability-Lösungen.

- Anpassbare Dashboards: Anwender wünschen sich Dashboards, die sie auf ihre spezifischen Bedürfnisse zuschneiden können. Dieser Trend spiegelt das Bedürfnis nach personalisierten Benutzererlebnissen wider. New Relic bietet anpassbare Dashboards, mit denen Nutzer sich auf die für sie wichtigsten Daten konzentrieren können.

Was sind Data Observability Tools?

Data Observability Tools überwachen und gewährleisten die Gesundheit und Zuverlässigkeit von Datensystemen. Dateningenieure, Analysten und IT-Fachkräfte nutzen diese Tools in der Regel, um Anomalien zu erkennen, Datenherkunft (Data Lineage) nachzuverfolgen und die Datenqualität über umfassende Observability-Plattformen zu sichern.

Echtzeitüberwachung, KI-gestützte Einblicke und anpassbare Dashboards helfen, Probleme schnell zu erkennen, potenzielle Risiken vorherzusagen und Anwendererfahrungen zu individualisieren. Diese Tools sorgen für Sicherheit, indem sie den reibungslosen und effizienten Betrieb der Datensysteme gewährleisten.

Funktionen von Data Observability Tools

Beim Vergleich von Data Observability Tools sollten Sie auf folgende Schlüsselfunktionen achten:

- Echtzeitüberwachung: Dadurch können Sie Datenprobleme sofort erkennen und beheben und die Zuverlässigkeit Ihrer Daten sicherstellen.

- Anomalieerkennung: Erkennt ungewöhnliche Muster in Ihren Daten und hilft, potenzielle Probleme frühzeitig zu erfassen.

- Verfolgung der Datenherkunft: Gibt Einblicke in den Datenfluss und erleichtert das Zurückverfolgen von Fehlerquellen.

- KI-gestützte Einblicke: Nutzt KI, um potenzielle Datenprobleme vorherzusagen und Lösungsvorschläge zu bieten.

- Anpassbare Dashboards: Benutzer können die Oberfläche nach ihren Anforderungen gestalten und erhalten eine personalisierte Datenansicht.

- Automatisierte Benachrichtigungen: Meldungen werden sofort bei Problemen gesendet, damit Ihr Team informiert und einsatzbereit bleibt.

- Prädiktive Analysen: Diese Funktion hilft, Datenentwicklungen vorherzusagen und künftige Probleme zu vermeiden.

- Sicherheitsmaßnahmen: Schützt Daten und sorgt für die Einhaltung von Vorschriften – insbesondere beim Umgang mit sensiblen Informationen.

- Vereinheitlichte Plattform: Die Zusammenführung verschiedener Observability-Funktionen in einer Oberfläche vereinfacht das Datenmanagement.

- Ursachenanalyse: Identifiziert schnell den Ursprung von Datenproblemen, ermöglicht deren rasche Behebung und reduziert Ausfallzeiten.

Vorteile von Data Observability Tools

Der Einsatz von Data Observability Tools bietet zahlreiche Vorteile für Ihr Team und Ihr Unternehmen.

Hier einige Vorteile, auf die Sie sich freuen können:

- Höhere Datenzuverlässigkeit: Echtzeitüberwachung und Anomalieerkennung sorgen für einen reibungslosen Ablauf Ihrer Datensysteme und minimieren Ausfallzeiten.

- Bessere Entscheidungsfindung: KI-gestützte Einblicke und prädiktive Analysen liefern wertvolle Datentrends zur Unterstützung fundierter Entscheidungen.

- Schnellere Problemlösung: Automatisierte Benachrichtigungen und Ursachenanalysen ermöglichen Ihrem Team eine rasche Identifizierung und Behebung von Problemen.

- Effizientere Arbeitsabläufe: Anpassbare Dashboards unterstützen Anwender dabei, sich auf die wichtigsten Daten zu konzentrieren und die Produktivität zu steigern.

- Bessere Compliance: Sicherheitsmaßnahmen stellen sicher, dass Ihre Daten geschützt und konform mit Branchenstandards bleiben.

- Vereinfachtes Datenmanagement: Eine vereinheitlichte Plattform bündelt verschiedene Observability-Funktionen und erleichtert die Verwaltung Ihrer Datensysteme.

- Proaktive Wartung: Prädiktive Analysen ermöglichen es, potenzielle Probleme frühzeitig zu erkennen und präventive Maßnahmen zu ergreifen.

Kosten & Preise von Data Observability Tools

Bei der Auswahl von Data Observability Tools ist es wichtig, die unterschiedlichen Preismodelle und Tarifpläne zu verstehen. Die Kosten variieren je nach Funktionen, Teamgröße, Zusatzoptionen und mehr.

Die folgende Tabelle gibt einen Überblick über Standardpläne, deren durchschnittliche Preise und die typischen Funktionen, die in Lösungen für Data-Observability-Tools enthalten sind:

Vergleichstabelle für Data-Observability-Tools

| Tariftyp | Durchschnittspreis | Häufige Funktionen |

| Gratis-Tarif | $0 | Basisüberwachung, begrenzte Warnmeldungen und Community-Support. |

| Persönlicher Tarif | $10-$30/ Nutzer/Monat | Anomalie-Erkennung, anpassbare Dashboards und E-Mail-Benachrichtigungen. |

| Business-Tarif | $50-$100/ Nutzer/Monat | Echtzeitüberwachung, Datenherkunftsnachverfolgung und erweiterte Analytik. |

| Enterprise-Tarif | $150-$300/ Nutzer/Monat | Prädiktive Analysen, Sicherheitsmaßnahmen und dediziertes Account-Management. |

FAQs zu Data-Observability-Tools

Hier finden Sie Antworten auf häufig gestellte Fragen zu Data-Observability-Tools:

Was ist der Unterschied zwischen Monitoring-Tools und Observability-Tools?

Monitoring-Tools helfen Ihnen, Anomalien oder ungewöhnliches Verhalten in der Systemleistung zu erkennen. Observability-Tools gehen einen Schritt weiter und ermöglichen eine tiefgehende Untersuchung dieser Anomalien, auch wenn sie durch das Zusammenspiel mehrerer Servicekomponenten entstehen. Das bedeutet, Sie können Ursachen identifizieren und das Systemverhalten umfassender nachvollziehen.

Welche Methoden gibt es zur Data Observability?

Data-Observability basiert auf zentralen Säulen wie Aktualität, Verteilung, Volumen, Schema und Herkunft. Aktualität stellt sicher, dass Daten für Entscheidungen aktuell sind. Verteilung verfolgt den Weg der Daten, um Fehlerquellen aufzudecken. Das Volumen betrachtet das Datenhandling zur effektiven Speicher- und Wachstumskontrolle und sorgt so für einen ganzheitlichen Datenmanagement-Ansatz.

Wie verbessert Data Observability die Datenqualität?

Data-Observability-Tools verbessern die Datenqualität durch Echtzeitüberwachung und Anomalieerkennung. Sie verfolgen Datenherkunft und Schemaänderungen, wodurch Probleme schnell erkannt und behoben werden können. Dieser proaktive Ansatz hilft, Datenintegrität und Zuverlässigkeit in Ihren Systemen zu sichern.

Warum ist Datenherkunft (Data Lineage) in der Observability wichtig?

Die Datenherkunft ist entscheidend, weil sie das Nachverfolgen des Datenflusses in Ihren Systemen ermöglicht. Die Kenntnis der Datenherkunft hilft dabei, zu erkennen, wo Probleme auftreten und wie sie nachgelagerte Prozesse beeinflussen. Diese Transparenz ist unerlässlich, um Datenintegrität zu sichern und genaue Analysen zu gewährleisten.

Können Data-Observability-Tools bei der Compliance helfen?

Ja, Data-Observability-Tools unterstützen die Compliance, indem sie Einblicke in Datenverwendung und Zugriffe bieten. Sie ermöglichen Audits und verfolgen Datenänderungen, was die Einhaltung von Vorschriften wie der DSGVO erleichtert. Diese Transparenz ist entscheidend, um regulatorische Anforderungen zu erfüllen und sensible Informationen zu schützen.

Wie helfen Anomalieerkennungsfunktionen der Data Observability?

Anomalieerkennungsfunktionen in Data-Observability-Tools alarmieren Sie auf ungewöhnliche Muster oder Verhaltensweisen in Ihren Datensystemen. Durch die frühzeitige Identifikation können Probleme behoben werden, bevor sie ernsthafte Folgen verursachen. Diese Fähigkeit ist essenziell, um Systemzuverlässigkeit zu gewährleisten und Ausfallzeiten zu minimieren.

Wie geht es weiter?

Stärken Sie Ihr SaaS-Wachstum und Ihre Führungskompetenzen.

Abonnieren Sie unseren Newsletter für die neuesten Erkenntnisse von CTOs und aufstrebenden Tech-Leadern.

Wir helfen Ihnen, smarter zu skalieren und stärker zu führen – mit Leitfäden, Ressourcen und Strategien führender Experten!