Beste Data-Fabric-Software Shortlist

Die beste Data-Fabric-Software hilft Teams dabei, Daten aus unterschiedlichen Systemen zu verbinden und zu verwalten, ohne sich auf komplexe manuelle Integrationen verlassen zu müssen. Diese Tools vereinheitlichen strukturierte und unstrukturierte Daten und geben Organisationen konsistenten Zugang zu zuverlässigen Informationen über verschiedene Umgebungen hinweg.

Teams greifen häufig zu Data-Fabric-Lösungen, wenn sie mit langsamer Datenbereitstellung, isolierten Datenquellen oder komplexen Governance-Anforderungen konfrontiert sind, die es schwer machen, einen vollständigen Überblick über ihre Abläufe zu erhalten. Ohne eine vernetzte Sichtweise bricht die Analytics-Pipeline zusammen und Entscheidungen basieren auf unvollständigen oder veralteten Daten.

Ich habe mit Unternehmen gearbeitet, die Data-Fabric-Architekturen eingeführt haben, um Altsysteme zu modernisieren und einen schnelleren sowie zuverlässigeren Zugang zu Business Intelligence zu ermöglichen. Durch diese Erfahrung konnte ich bewerten, wie die Plattformen Echtzeit-Datenverarbeitung, Metadatenmanagement und Sicherheit auf großer Skala umsetzen.

Dieser Leitfaden stellt die besten Data-Fabric-Tools vor, die Integration vereinfachen, die Datentransparenz erhöhen und skalierbare Einblicke für moderne Organisationen ermöglichen.

Why Trust Our Software Reviews

We’ve been testing and reviewing software since 2023. As tech leaders ourselves, we know how critical and difficult it is to make the right decision when selecting software.

We invest in deep research to help our audience make better software purchasing decisions. We’ve tested more than 2,000 tools for different tech use cases and written over 1,000 comprehensive software reviews. Learn how we stay transparent & our software review methodology.

Zusammenfassung Beste Data-Fabric-Software

Diese Vergleichstabelle fasst die Preisinformationen meiner Top-Auswahl an Data-Fabric-Software zusammen, um Ihnen dabei zu helfen, die beste Lösung für Ihr Budget und Ihre geschäftlichen Anforderungen zu finden.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Am besten für Such- und Analysefunktionen geeignet | Not available | Ab $16/Nutzer/Monat (jährliche Abrechnung). | Website | |

| 2 | Beste Lösung für KI-gestützte Datenintegration | Kostenlose Testversion verfügbar | Preis auf Anfrage. | Website | |

| 3 | Am besten geeignet für Cloud-Datendienste | Not available | Preise auf Anfrage. | Website | |

| 4 | Am besten für Apache Airflow-Management | Not available | Preise auf Anfrage. | Website | |

| 5 | Bestes für Echtzeit-Datenvirtualisierung | Not available | Preise auf Anfrage. | Website | |

| 6 | Beste Wahl für operatives Datenmanagement | Not available | Preise auf Anfrage. | Website | |

| 7 | Am besten für direktes Daten-Mapping | Kostenlose Demo verfügbar | Preise auf Anfrage. | Website | |

| 8 | Am besten geeignet für automatisierte Datensynchronisierung | Not available | Preise auf Anfrage. | Website | |

| 9 | Am besten für kollaborative Datenfreigabe | Not available | Preise auf Anfrage. | Website | |

| 10 | Am besten für Datenkonnektivität und -vorbereitung geeignet | Not available | Preise auf Anfrage. | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.7 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Bewertungen Beste Data-Fabric-Software

Nachfolgend finden Sie meine detaillierten Zusammenfassungen der besten Data-Fabric-Software, die es auf die Shortlist geschafft haben. Meine Bewertungen bieten einen genauen Einblick in die wichtigsten Funktionen, Vor- & Nachteile, Integrationen und die idealen Anwendungsfälle jedes Tools, um Ihnen bei der Auswahl des für Sie passenden Produkts zu helfen.

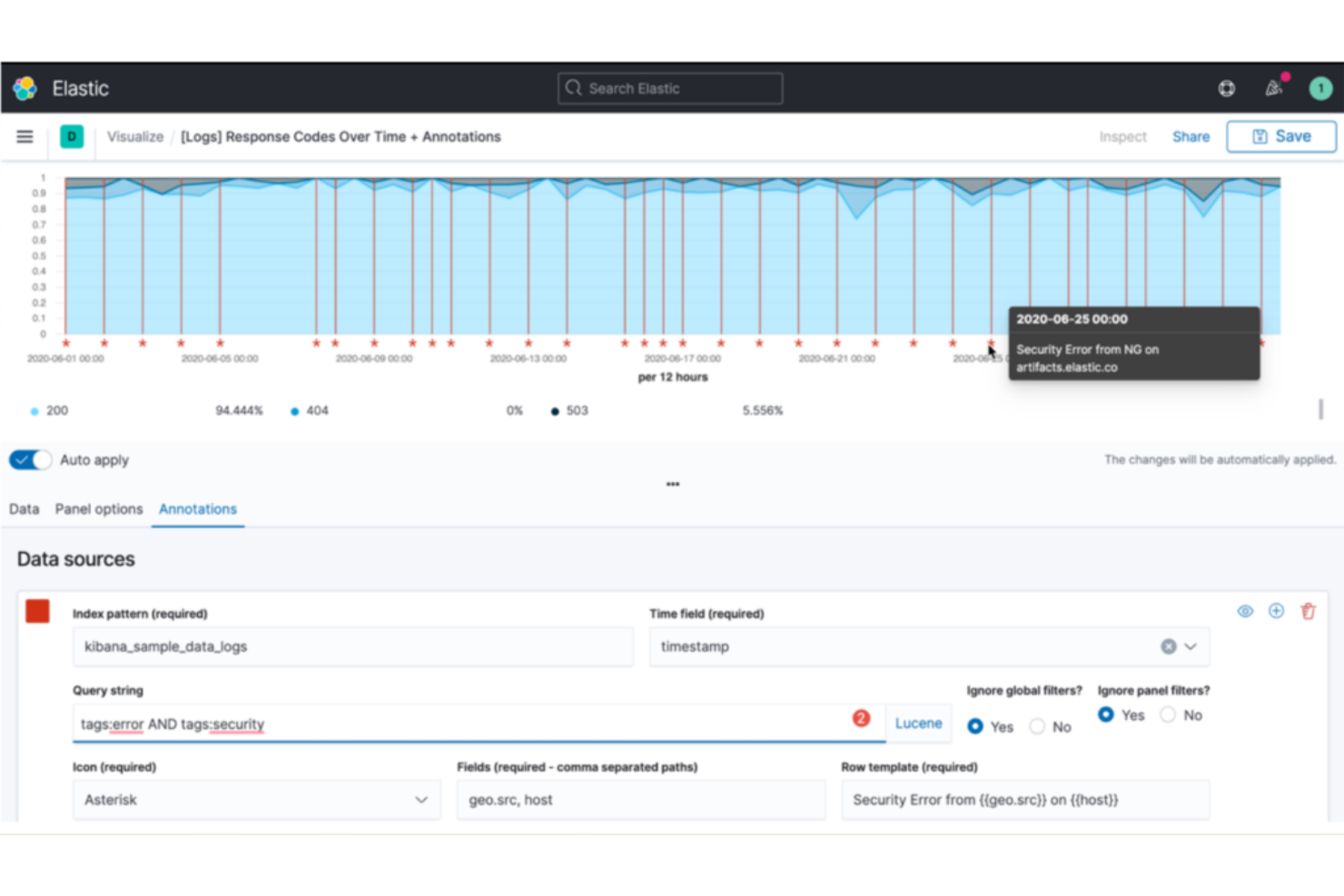

Elastic Stack, oft als ELK Stack bezeichnet, besteht aus Elasticsearch, Logstash und Kibana. Gemeinsam bieten diese Tools Unternehmen leistungsstarke Such- und Analysefunktionen, die besonders wichtig sind, um effizient große Datenmengen zu durchsuchen.

Warum ich Elastic Stack ausgewählt habe:

Während meiner Erkundung von Datentools wurde ich immer wieder zum Elastic Stack hingezogen, da es ein umfassendes Angebot darstellt. Ich habe verschiedene Plattformen evaluiert und verglichen, wobei sich Elastics Stärke im Bereich Suche und Analyse deutlich zeigte. Die einzigartige Kombination von Tools, von denen jedes auf einen bestimmten Aspekt der Datenverarbeitung spezialisiert ist, macht Elastic Stack besonders. Deshalb habe ich mich nach reiflicher Überlegung entschieden, es als 'Beste Lösung für Such- und Analysefunktionen' zu küren.

Hervorstechende Funktionen und Integrationen:

Elasticsearch bildet das Herzstück des Elastic Stack und ermöglicht leistungsstarke Suchfunktionen über große Datenbestände hinweg. Kibana sorgt für Datenvisualisierung und unterstützt Datenwissenschaftler und Unternehmensnutzer dabei, Erkenntnisse zu gewinnen. Logstash hingegen optimiert die Datensammlung und das Durchsuchen von Protokollen. Darüber hinaus überzeugt der Elastic Stack durch zahlreiche Integrationen – von Cloud-Umgebungen wie AWS bis zu diversen Datenquellen, was flexiblen Datenzugriff ermöglicht.

Pros and Cons

Pros:

- Umfassende Lösung mit Tools für Suche, Analytik und Datenerfassung.

- Integration mit einer Vielzahl von Plattformen, einschließlich AWS.

- Bietet starke Datenmanagement-Funktionen und sorgt für Datenqualität.

Cons:

- Die Erstinstallation kann komplex sein, insbesondere für Anwender ohne Erfahrung mit den einzelnen Komponenten

- Kann für kleinere Unternehmen, die nicht die gesamte Tool-Suite benötigen, überdimensioniert sein

- Die Kosten können mit steigendem Nutzungs- und Datenvolumen zunehmen

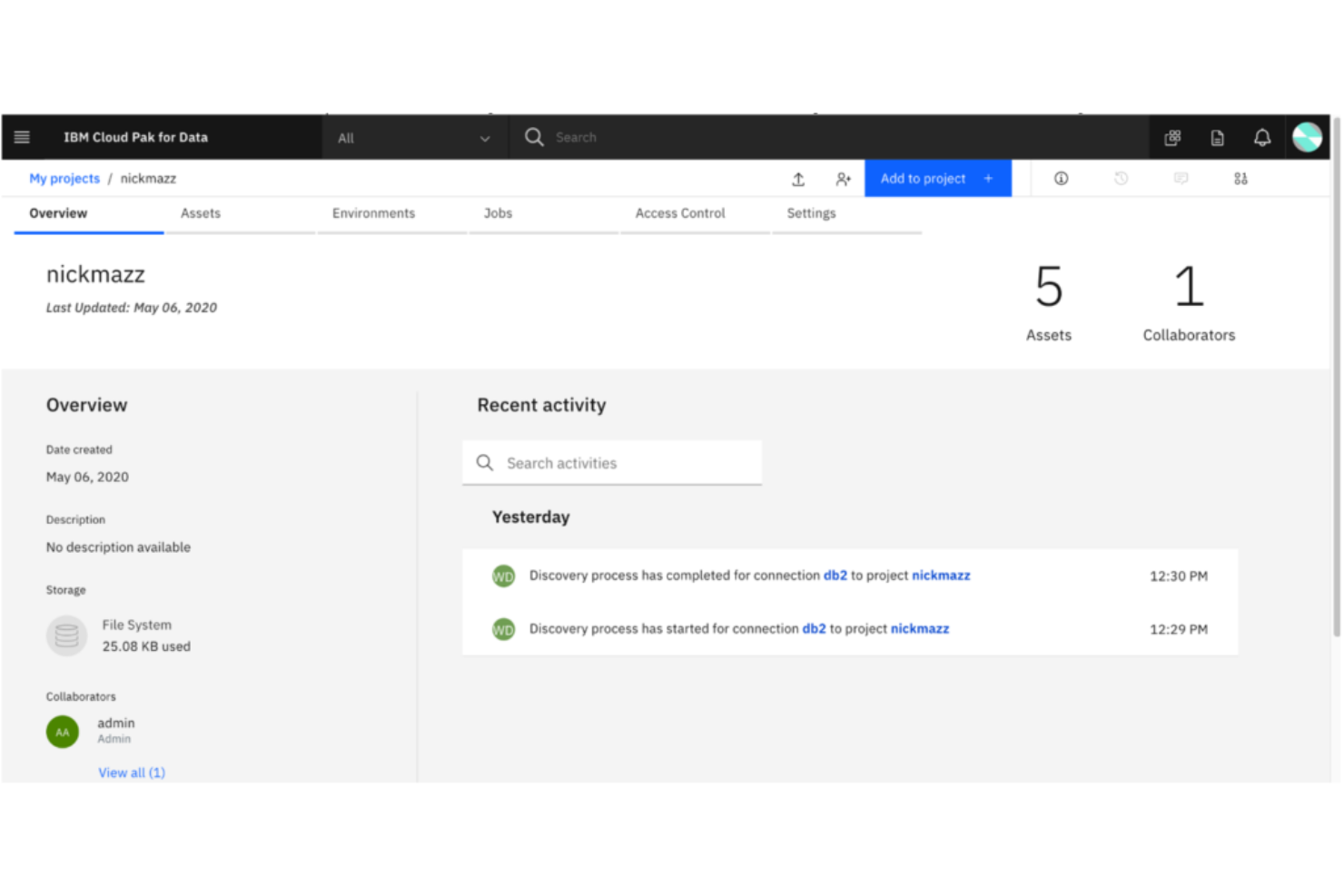

IBM Cloud Pak for Data ist eine einheitliche Plattform, die eine Vielzahl von Funktionen von der Datenintegration bis hin zu KI-Fähigkeiten vereint. Sie ist darauf ausgelegt, in verschiedensten Datenumgebungen – einschließlich Multi-Cloud und On-Premises – zu arbeiten, wobei die Integration von KI in Datenprozesse ihre wahre Größe ausmacht.

Warum ich IBM Cloud Pak for Data gewählt habe:

Inmitten der Vielzahl von Integrationsplattformen hat sich IBM Cloud Pak for Data besonders hervorgetan, was meine Entscheidung maßgeblich beeinflusst hat. Die Verbindung von KI mit Datenintegration hat mich dazu bewogen, dieses Tool als Vorreiter in dieser Kategorie einzustufen. Ich bin überzeugt, dass IBM Cloud Pak for Data für diejenigen, die eine End-to-End-Lösung mit KI als Herzstück suchen, ohne Zweifel die 'Beste Lösung für KI-gestützte Datenintegration' ist.

Herausragende Funktionen und Integrationen:

IBM Cloud Pak for Data bietet zahlreiche Features wie KI-gesteuerte Data Governance, Datenqualität und Data Fabric-Lösungen. Die Plattform ist darauf ausgelegt, die Zusammenarbeit zwischen Business-Anwendern und Data Scientists zu fördern und die Entwicklung von Machine-Learning-Modellen zu erleichtern. Was die Integration angeht, stellt IBM Cloud Pak for Data Konnektoren zu verschiedenen Datenquellen bereit, darunter führende Systeme wie SAP, und unterstützt Integrationswerkzeuge zur Anbindung an Cloud-Umgebungen, insbesondere AWS.

Pros and Cons

Pros:

- Ermöglicht KI-gesteuerte Data Governance und hebt die Qualität integrierter Daten auf ein neues Niveau.

- Bietet eine einheitliche Plattform, die verschiedenste Datenanforderungen – von Integration bis Machine Learning – abdeckt.

- Verfügt über eine Vielzahl von Konnektoren, die den Datenzugriff aus zahlreichen Quellen sicherstellen.

Cons:

- Könnte für Anwender, die neu im Bereich KI-gestützter Plattformen sind, zunächst komplex erscheinen.

- Der breite Funktionsumfang kann für Nutzer, die gezielt nach bestimmten Funktionen suchen, überwältigend wirken.

- Angesichts des umfassenden Funktionsumfangs könnte der Preis höher ausfallen als bei spezialisierten Tools.

NetApp Data Fabric vereinfacht das Datenmanagement, den Zugriff und die Kontrolle über verschiedene Cloud-Umgebungen hinweg und ist damit eine erstklassige Wahl für Cloud-Datendienste.

Warum ich NetApp Data Fabric ausgewählt habe:

NetApp Data Fabric hat sich bei meinen Recherchen nach den besten Datenlösungen immer wieder als herausragender Kandidat erwiesen. Ich habe dieses Tool gewählt, nachdem ich seine Funktionen sorgfältig mit anderen verglichen und seinen einzigartigen Ansatz für Multi-Cloud-Datengovernance sowie den gebotenen Enterprise Data Fabric erkannt habe. In einer Zeit, in der Unternehmen rasant in die Cloud wechseln, ist ein Tool, das im Bereich der Cloud-Datendienste herausragt, unverzichtbar – und genau hier überzeugt NetApp.

Herausragende Funktionen und Integrationen:

NetApp Data Fabric bietet eine umfassende Palette an Funktionen zur Datenverwaltung und gewährleistet Datenqualität, auch wenn Daten verschiedene Datenquellen und Plattformen durchlaufen. Es stellt eine einheitliche Plattform zur Verfügung, die besonders für die Datenintegration über Multi-Cloud-Umgebungen hinweg geeignet ist und so die ansonsten komplexen Prozesse der Datenvorbereitung und -verarbeitung vereinfacht. Darüber hinaus verfügt es über starke Integrationen mit bedeutenden Plattformen und Diensten wie AWS, SAP und verschiedenen Data Warehouses – was seine Rolle als Kraftpaket für Cloud-Datendienste nochmals unterstreicht.

Pros and Cons

Pros:

- Umfassende Multi-Cloud-Datengovernance-Funktionen

- Umfangreiche Integrationen mit wichtigen Plattformen und Diensten

- Schwerpunkt auf Enterprise Data Fabric und Datenzugriff

Cons:

- Mögliche Komplexitäten für Einsteiger im Cloud-Datenmanagement

- Der Funktionsumfang kann eine gezielte Schulung erfordern

- Einige Geschäftsanwender könnten bestimmte Funktionen für alltägliche Aufgaben zu komplex finden

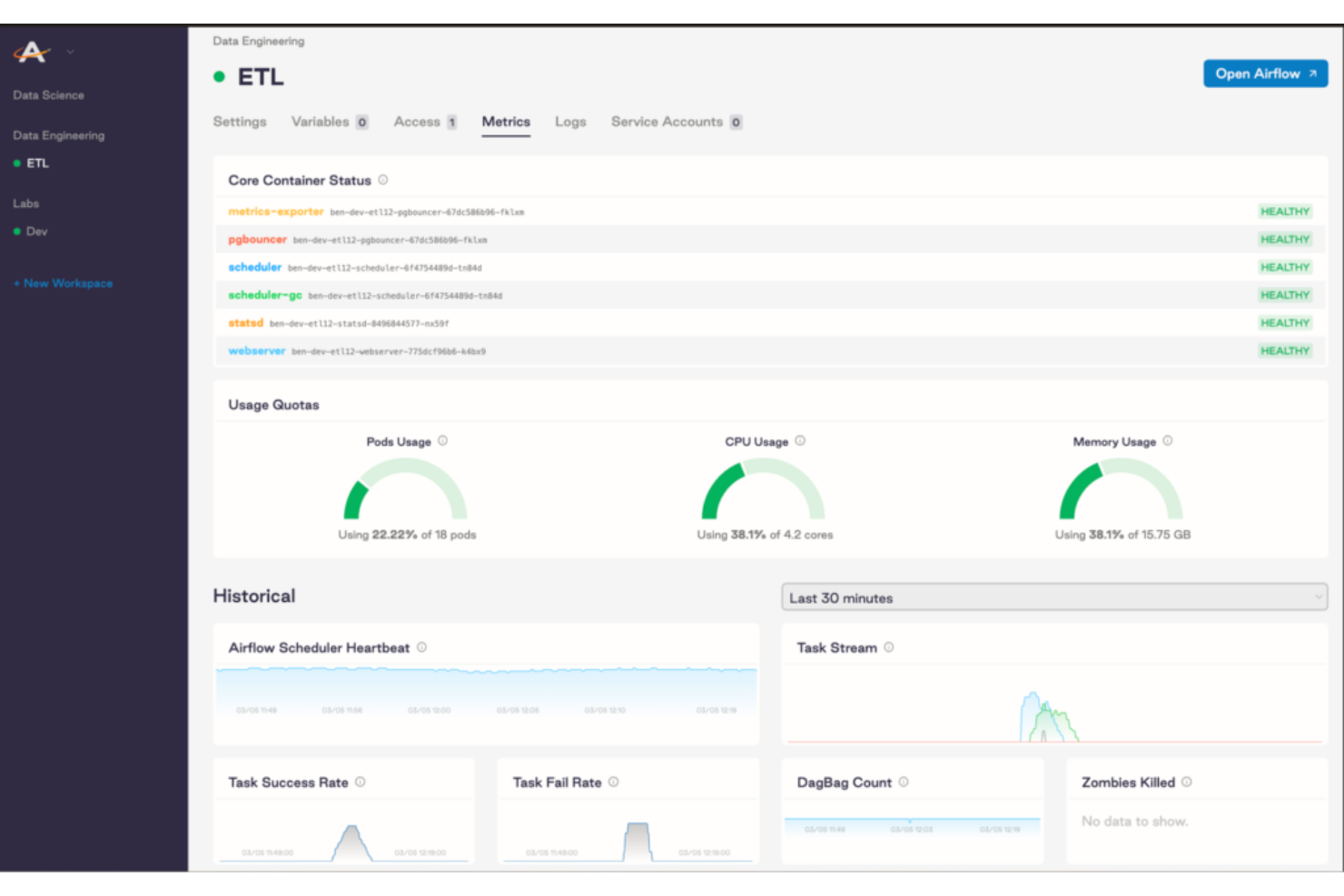

Astro von Astronomer ist darauf ausgelegt, die Bereitstellung und Verwaltung von Apache Airflow zu vereinfachen. Da Apache Airflow eine beliebte Plattform zur Orchestrierung komplexer Daten-Workflows ist, setzt Astro in Sachen Funktionalität noch einen drauf und sorgt für ein nahtloses Management von Airflow-Instanzen. Seine Expertise im Apache Airflow-Management ist genau der Grund, warum es als das 'beste' in dieser Kategorie gilt.

Warum ich Astro von Astronomer gewählt habe:

Astro von Astronomer hat sich für mich im breiten Feld der Datenmanagement-Tools hervorgehoben. Bei der Auswahl und dem Vergleich von Tools speziell für das Apache Airflow-Management gaben ihm seine dedizierte Funktionalität und die ausgefeilte Benutzererfahrung einen Vorsprung vor anderen. Ich habe Astro gewählt, weil es tief in Apache Airflow integriert ist und sich der Weiterentwicklung der Plattform verschrieben hat. Es passt somit perfekt zum Schlagwort 'Am besten für Apache Airflow-Management'.

Hervorstechende Funktionen und Integrationen:

Die hervorstechenden Funktionen von Astro drehen sich um ein umfassendes Dashboard, das einen vollständigen Überblick über die Auslastung von Airflow bietet. Es stellt eine einheitliche Plattform zur Verfügung, die die Bereitstellung, Überwachung und Skalierung von Airflow-Instanzen vereinfacht. Was Integrationen betrifft, so verbindet sich Astro mit wichtigen Cloud-Umgebungen wie AWS und unterstützt verschiedene Datenquellen, wodurch Datenpipelines reibungslos und effizient ablaufen.

Pros and Cons

Pros:

- Dedizierte Plattform für Apache Airflow und damit spezialisierte Funktionen.

- Bietet Integrationen mit führenden Cloud-Umgebungen und Datenquellen.

- Verbesserte Data-Governance-Funktionen, die Datenqualität und Compliance gewährleisten.

Cons:

- Für Nutzer ohne Apache Airflow-Vorkenntnisse möglicherweise mit Lernkurve verbunden

- Preistransparenz könnte besser sein

- Kleinere Unternehmen oder Einzelanwender könnten die Plattform als überdimensioniert empfinden

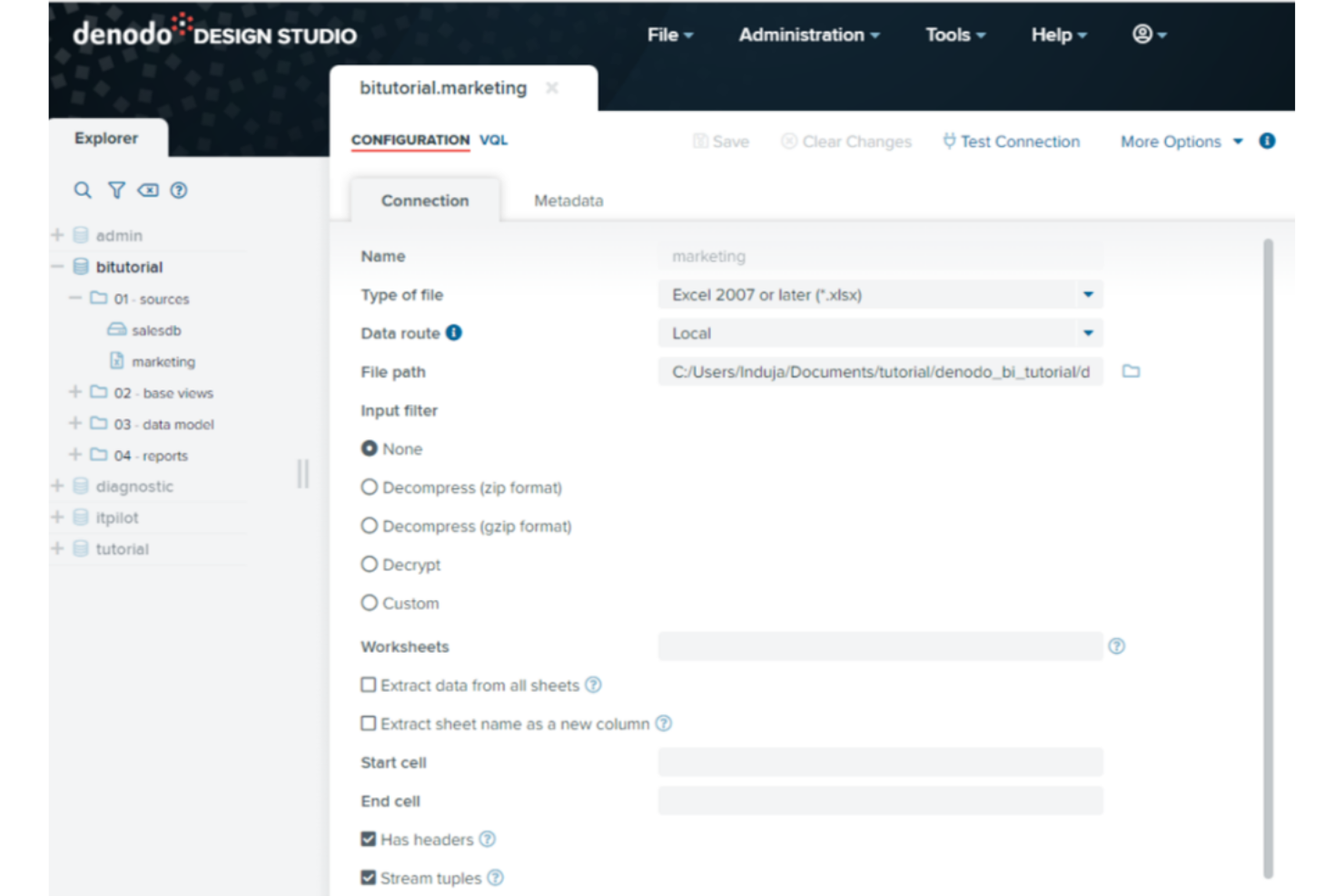

Denodo dient als zentrale Plattform für Unternehmen, die effiziente und Echtzeit-Datenvirtualisierungslösungen suchen. Durch die Zentralisierung von Daten aus unterschiedlichen Quellen ermöglicht Denodo den Nutzern den Zugriff auf vereinheitlichte Datenansichten, ohne die Herausforderungen traditioneller physischer Datenbewegungen – dies entspricht dem Bedarf an Echtzeit-Datenvirtualisierung.

Warum ich Denodo gewählt habe:

Im Bereich der Datenvirtualisierung standen zahlreiche Tools zur Auswahl. Nach sorgfältigem Vergleich und Bewertung ihrer Funktionen habe ich mich jedoch für Denodo entschieden. Der Hauptgrund für diese Wahl ist seine beeindruckende Fähigkeit, Daten in Echtzeit zu virtualisieren – ein Merkmal, das es von vielen Wettbewerbern abhebt. Diese einzigartige Eigenschaft positioniert Denodo ganz klar als das 'Beste für Echtzeit-Datenvirtualisierung'.

Hervorstechende Funktionen und Integrationen:

Denodo bietet umfangreiche Funktionen zur Daten-Governance, die Konsistenz und Datenqualität über verschiedene Unternehmensdatenquellen hinweg gewährleisten. Mit seinen hochmodernen APIs erleichtert Denodo den Datenzugriff sowie die Integration über zahlreiche Plattformen. Die Integrationsmöglichkeiten erstrecken sich auf führende Anbieter wie AWS, SAP und bekannte Data Warehouses, wodurch unterschiedlichste geschäftliche Anforderungen und Anwendungsfälle abgedeckt werden.

Pros and Cons

Pros:

- Bietet ausgeklügelte Echtzeit-Datenvirtualisierungsfunktionen.

- Umfassende Data-Governance-Tools sorgen für Konsistenz.

- Umfangreiche Integrationsoptionen mit führenden Plattformen erhöhen die Vielseitigkeit.

Cons:

- Mögliche Lernkurve für Unternehmen, die neu in der Datenvirtualisierung sind

- Eigene Integrationen können zusätzliche Konfiguration erfordern

- Fortgeschrittene Funktionen können für kleinere Unternehmen überwältigend sein

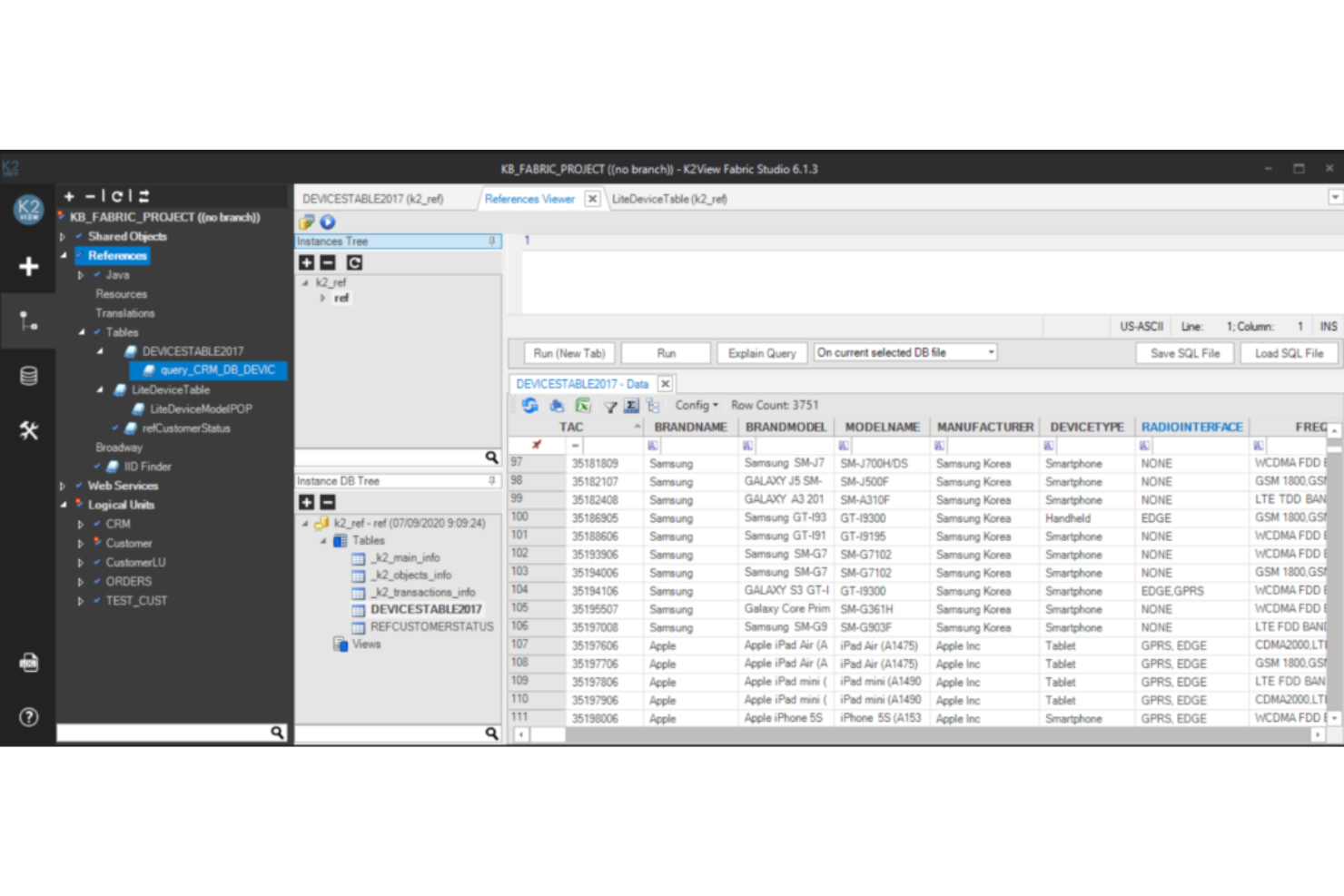

K2View verwaltet und pflegt operative Daten für Unternehmen effizient und sorgt für eine präzise und zeitnahe Verwaltung.

Warum ich K2View gewählt habe:

Im Bereich der Datenmanagement-Tools kommt es oft auf die Nische an, die sie bedienen. Nach der Prüfung verschiedener Optionen und der Bewertung ihrer Funktionen fiel meine Wahl auf K2View wegen seines gezielten Ansatzes im operativen Datenmanagement. Die Präzision und Funktionalität, die es in diesem speziellen Bereich bietet, heben es hervor. Ich habe K2View ausgewählt, weil es den Anforderungen von Unternehmen entspricht, die operative Daten als kritische Ressource betrachten – daher ist es 'Die beste Wahl für operatives Datenmanagement'.

Herausragende Funktionen und Integrationen:

K2View überzeugt mit einem umfangreichen Funktionspaket für Data-Governance und Datenqualität, insbesondere für operative Daten. Die Plattform bietet fortschrittliche Datenverarbeitungsfunktionen und stellt eine einheitliche Plattform bereit, mit der Unternehmen ihre operativen Daten von Anfang bis Ende verwalten können. Auch die Integrationen sind bemerkenswert: K2View verbindet sich nahtlos mit wichtigen Cloud-Umgebungen, Datenquellen wie AWS und SAP sowie diversen Data Warehouses und stärkt so seine Fähigkeiten im operativen Datenmanagement.

Pros and Cons

Pros:

- Spezielle Funktionen für operatives Datenmanagement

- Leistungsstarke Integrationen mit führenden Plattformen und Datenquellen

- Erweiterte Funktionen für Data-Governance und Datenqualität

Cons:

- Könnte eine höhere Lernkurve für Nutzer haben, die mit den Besonderheiten operativer Daten nicht vertraut sind

- Eventuell zu umfangreich für Unternehmen, deren Schwerpunkt nicht auf operativen Daten liegt

- Für bestimmte, weniger verbreitete Plattformen kann die Integration technisches Fachwissen erfordern

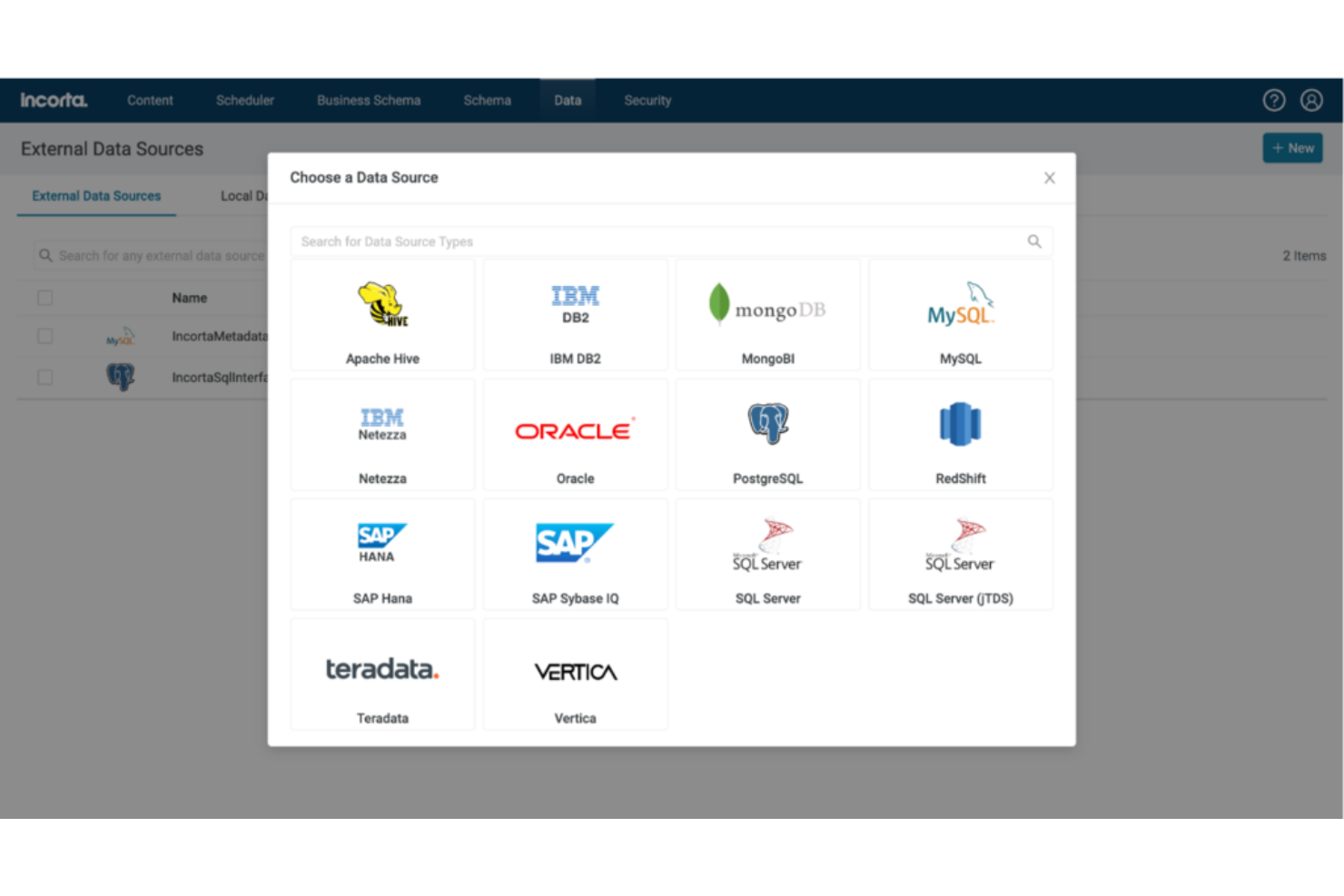

Incorta ist eine fortschrittliche Analyseplattform, die für ihre Fähigkeiten im Bereich direktes Daten-Mapping bekannt ist. Diese Technologie ermöglicht es den Nutzern, Daten effizient zuzuordnen, ohne dass komplexe Data Warehouses oder ETL-Prozesse erforderlich sind. Ihre Stärke im direkten Daten-Mapping ist der Hauptgrund, warum sie als führend in diesem Bereich gilt.

Warum ich Incorta gewählt habe:

Bei der Durchsicht zahlreicher Analyseplattformen fiel mir Incorta durch seinen einzigartigen Ansatz im Daten-Mapping auf. Die Auswahl dieses Tools basiert auf seiner revolutionären Architektur, die es von traditionellen Datenplattformen abhebt, welche stark auf ETL setzen. Ich kam zu dem Schluss, dass Incorta mit seinen Fähigkeiten im direkten Daten-Mapping die Aussage 'Am besten für direktes Daten-Mapping' wirklich verdient.

Hervorstechende Funktionen und Integrationen:

Eines der wichtigsten Merkmale von Incorta ist die Möglichkeit, umständliche Datenvorbereitungsphasen zu umgehen und sofortigen Zugriff auf große Datensätze zu bieten. Darüber hinaus fördert es Self-Service-Analysen und befähigt Business User, eigenständig Erkenntnisse zu gewinnen, ohne auf die IT angewiesen zu sein. Was die Integrationen betrifft, so verbindet sich Incorta effektiv mit einer Vielzahl von Datenquellen, einschließlich SAP, und integriert sich außerdem gut mit Cloud-Umgebungen wie AWS, was den Datenzugriff und die Flexibilität erhöht.

Pros and Cons

Pros:

- Umgeht traditionelle ETL-Prozesse für einen schnelleren Datenzugriff.

- Bietet Self-Service-Funktionen, wodurch Business-User eigenständig Erkenntnisse gewinnen können.

- Integriert sich mit wichtigen Datenquellen und Cloud-Umgebungen.

Cons:

- Könnte für Nutzer, die mit direktem Daten-Mapping nicht vertraut sind, überwältigend sein

- Bestimmte Nischenintegrationen könnten fehlen, was die Anwendbarkeit in spezialisierten Szenarien einschränkt

- Einige Nutzer wünschen sich eventuell mehr Feineinstellungen bei den Datenvorbereitungsschritten

SyncWith vereinfacht die Datensynchronisierung für Unternehmen durch intuitive Funktionen und Automatisierung. Halten Sie Daten in Echtzeit plattformübergreifend konsistent und aktuell.

Warum ich SyncWith gewählt habe:

Bei der Auswahl eines Tools für die Datensynchronisierung wurden zahlreiche Faktoren abgewogen und verglichen. Meine Entscheidung fiel auf SyncWith, nachdem ich seine einzigartigen Automatisierungsfähigkeiten bewertet hatte, die die Datensynchronisierung erleichtern – ein Merkmal, das nicht alle Tools auf dem Markt bieten. Der besondere Mehrwert von SyncWith liegt in seiner effizienten Automatisierung, die sich perfekt mit seinem USP deckt und es zum 'Besten für automatisierte Datensynchronisierung' macht.

Hervorstechende Funktionen und Integrationen:

SyncWith überzeugt mit seinen umfangreichen Automatisierungsfunktionen, die die oft umständliche Aufgabe der Synchronisierung großer Datenmengen vereinfachen. Die APIs der Plattform spielen eine zentrale Rolle bei der Sicherstellung gleichbleibender Datenqualität. Darüber hinaus sind die Integrationen vielseitig und breit gefächert, mit Anbindungen an wichtige Plattformen wie AWS, SAP und zahlreiche Data Warehouses, was die Datenzugriffs- und -verarbeitungskompetenzen deutlich erweitert.

Pros and Cons

Pros:

- Fortschrittliche Automatisierungsfunktionen optimieren die Datensynchronisierung.

- Umfangreiche Integrationen mit führenden Plattformen für maximale Flexibilität.

- Gewährleistet hohe Datenqualität durch ausgefeilte APIs.

Cons:

- Möglicherweise nicht geeignet für Kleinunternehmen mit geringem Bedarf an Datensynchronisierung

- Potenzielle Komplexität bei der Einrichtung benutzerdefinierter Integrationen

- Das Tool kann anfänglich eine Einarbeitung für die optimale Nutzung erfordern

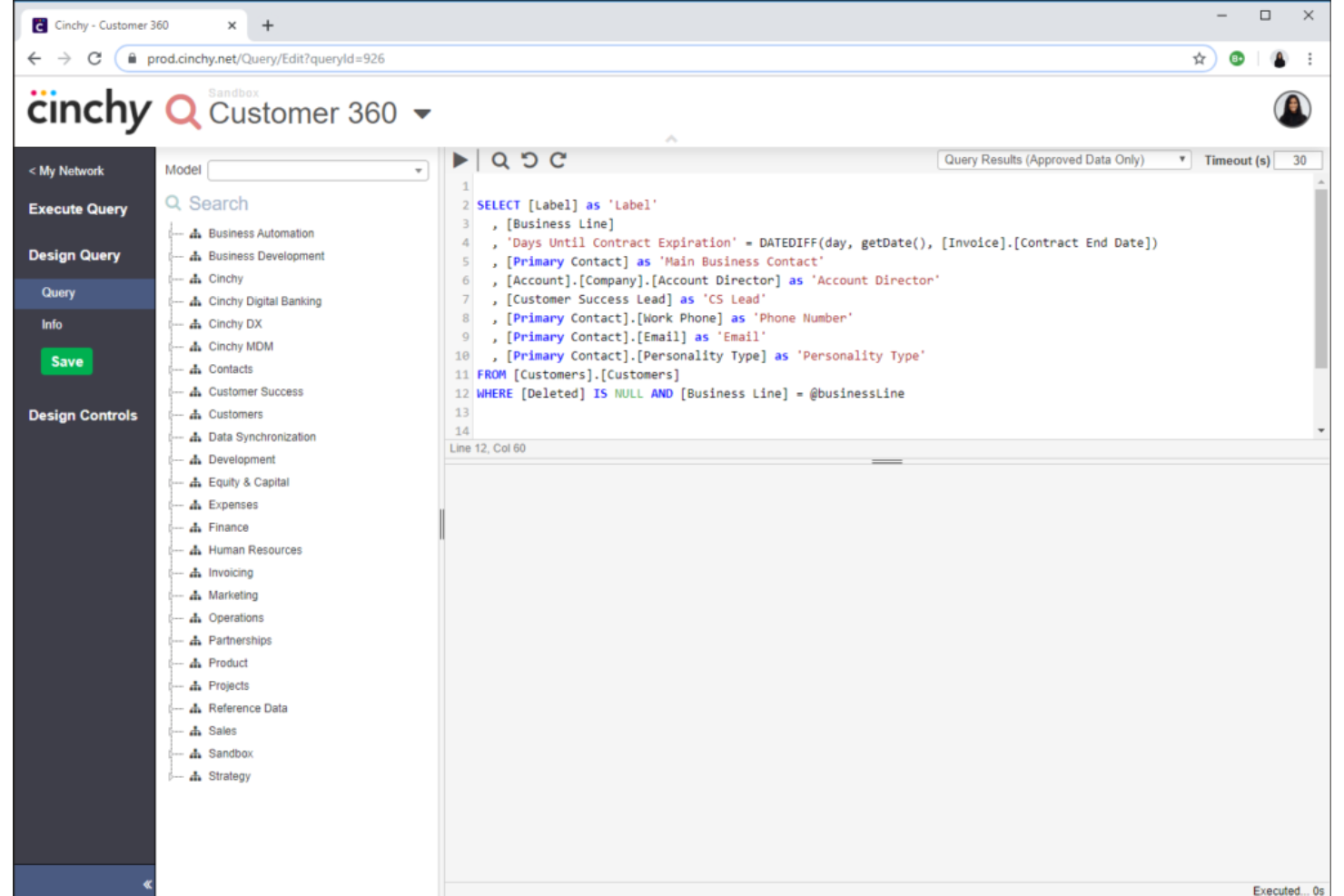

Cinchy vereinfacht das Datenmanagement für Unternehmen, indem es die zentrale und kollaborative Datenfreigabe über Teams hinweg ermöglicht.

Warum ich Cinchy ausgewählt habe:

Bei der Auswahl aus einer Vielzahl von Integrationstools fiel meine Wahl auf Cinchy aufgrund seines einzigartigen Ansatzes im Bereich Data Governance und der gemeinschaftlichen Nutzung von Daten. Während viele Tools den Datenzugriff ermöglichen, hebt sich Cinchy dadurch ab, dass Zusammenarbeit im Mittelpunkt steht und betont, dass der wahre Wert von Daten aus geteilten Erkenntnissen entsteht. Ich habe dieses Tool gewählt, weil es der Idee entspricht, dass im heutigen Multi-Cloud- und Big-Data-Zeitalter gemeinsames Teilen von Daten kein Luxus, sondern eine Notwendigkeit für Unternehmen ist, die das volle Potenzial ihrer Daten ausschöpfen wollen.

Herausragende Funktionen und Integrationen:

Cinchy bietet eine umfassende Auswahl an Funktionen rund um Data Governance, sodass auch bei Zugriff und Bearbeitung durch mehrere Beteiligte die Datenqualität hoch bleibt. Mit tief integrierter Automatisierung im Framework kann die Plattform Datenpipelines optimieren und so die Datenaufbereitung und -verarbeitung effizienter gestalten. Die beeindruckende Bandbreite an Integrationen sorgt dafür, dass Daten aus verschiedenen Quellen, darunter SAP, Data Warehouses und lokale Systeme, in einer einheitlichen Plattform zusammengeführt werden und vollständige Transparenz über den gesamten Datenfluss entsteht.

Pros and Cons

Pros:

- Fokus auf gemeinsame Datenfreigabe

- Umfassende Funktionen für Data Governance

- Große Bandbreite an Integrationen mit wichtigen Datenquellen und Plattformen

Cons:

- Mögliche Lernkurve für Anwender ohne Erfahrung mit kollaborativen Plattformen

- Fortgeschrittene Funktionen erfordern gegebenenfalls technisches Know-how

- Mögliche Skalierungsprobleme bei sehr großen Unternehmen

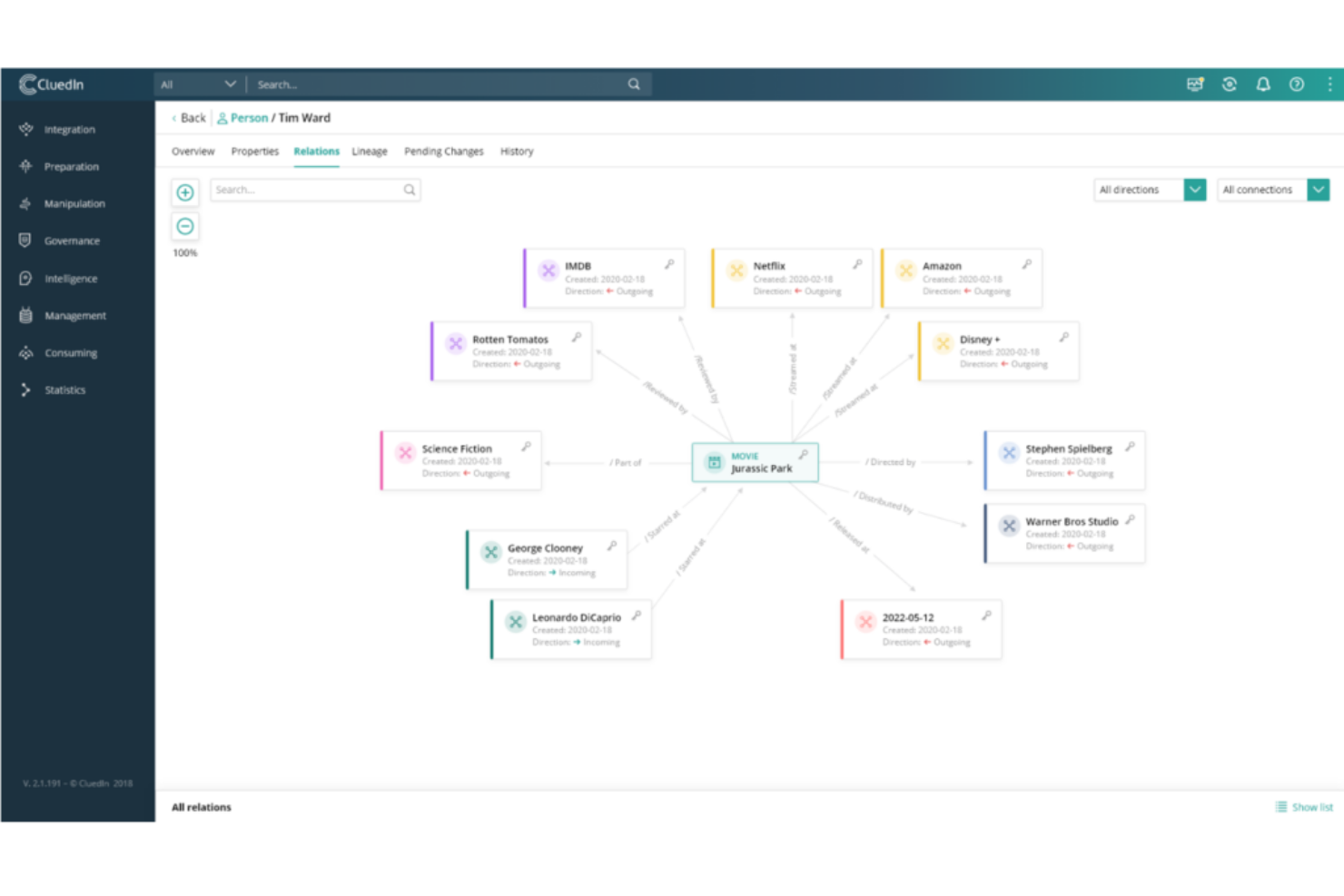

Cluedin vereinfacht die Datenaufbereitung für Unternehmen, indem es Daten aus verschiedenen Quellen verbindet und organisiert, sodass sie für Analysen und operative Zwecke bereitstehen.

Warum ich mich für Cluedin entschieden habe:

Im sich stetig weiterentwickelnden Bereich der Data-Fabric-Lösungen wurde die Wahl von Cluedin offensichtlich, nachdem ich verschiedene Tools hinsichtlich ihrer Fähigkeiten zur Datenintegration und -verwaltung bewertet habe. Betrachtet man die Kriterien Datenzugriff, Automatisierung und Datenqualität, hebt sich Cluedin dank seines innovativen Ansatzes in der Datenkonnektivität hervor. Ausschlaggebend war für mich der Fokus auf die Datenvorbereitung – eine oft übersehene, aber für die Nutzbarkeit von Unternehmensdaten essenzielle Phase.

Hervorstechende Funktionen und Integrationen:

Eines der herausragenden Merkmale von Cluedin ist sein robustes Daten-Governance-Framework, das Qualität und Transparenz während des gesamten Datenlebenszyklus gewährleistet. Mit Automatisierung als Kernfunktion beschleunigt Cluedin die Phase der Datenaufbereitung, sodass Datenwissenschaftler und Business-Anwender auf saubere, konsolidierte Daten zugreifen können. Das Tool bietet umfassende Integrationen, einschließlich Verbindungen zu wichtigen Datenquellen wie SAP, verschiedenen Data Warehouses und APIs, was reibungslose Datenflüsse über Multi-Cloud- und On-Premises-Umgebungen hinweg ermöglicht.

Pros and Cons

Pros:

- Starker Fokus auf Datenaufbereitung und -konnektivität

- Integration mit wichtigen Datenquellen und Plattformen

- Umfassendes Daten-Governance-Framework

Cons:

- Könnte für erstmalige Nutzer als komplex wahrgenommen werden

- Für bestimmte Funktionen sind möglicherweise fortgeschrittene technische Kenntnisse erforderlich

- Begrenzte Self-Service-Optionen für nicht-technische Benutzer

Weitere Data-Fabric-Software

Im Folgenden finden Sie eine Liste weiterer Data-Fabric-Software, die ich auf die Shortlist gesetzt habe, die es jedoch nicht unter die Top 10 geschafft haben. Sie sind auf jeden Fall einen Blick wert.

- Mosaic.

Am besten geeignet für ganzheitliche Datenintegration

- Tengu DataOps platform

Am besten für Datenbetriebs-Workflows

- Fraxses

Gut zur Demokratisierung von Daten in gesamten Ökosystemen

Auswahlkriterien für Data-Fabric-Software

Bei der Auswahl der besten Data-Fabric-Software für diese Liste habe ich die gängigen Bedürfnisse und Herausforderungen von Käufern wie Integrationsprobleme und den Bedarf an Echtzeit-Zugriff auf Daten berücksichtigt. Außerdem habe ich das folgende Bewertungsraster verwendet, um die Bewertung strukturiert und fair zu gestalten:

Kernfunktionen (25% der Gesamtbewertung)

Um in diese Liste aufgenommen zu werden, musste jede Lösung die folgenden Anwendungsfälle abdecken:

- Datenintegration

- Datenmanagement

- Daten-Governance

- Datensicherheit

- Echtzeit-Analysen

Herausragende Zusatzfunktionen (25% der Gesamtbewertung)

Zur weiteren Eingrenzung habe ich auch nach besonderen Funktionen gesucht, etwa:

- Automatisierte Datenerkennung

- Erweiterte Datenvisualisierung

- Integration von maschinellem Lernen

- Anpassbare Workflows

- Multi-Cloud-Unterstützung

Benutzerfreundlichkeit (10% der Gesamtbewertung)

Um die Benutzerfreundlichkeit jedes Systems einschätzen zu können, habe ich folgende Kriterien betrachtet:

- Intuitives Oberflächendesign

- Einfache Navigation

- Anpassbare Dashboards

- Minimale Einarbeitungszeit

- Responsives Design

Onboarding (10% der Gesamtbewertung)

Um das Onboarding-Erlebnis jeder Plattform zu beurteilen, habe ich Folgendes berücksichtigt:

- Verfügbarkeit von Schulungsvideos

- Interaktive Produkttouren

- Zugriff auf Vorlagen

- Unterstützende Chatbots

- Lehrreiche Webinare

Kundensupport (10% der Gesamtbewertung)

Um den Kundendienst jedes Softwareanbieters zu bewerten, habe ich Folgendes berücksichtigt:

- 24/7-Support-Verfügbarkeit

- Effizienz der Reaktionszeit

- Zugang zu kompetentem Personal

- Multi-Channel-Support-Optionen

- Verfügbarkeit eines Help Centers

Preis-Leistungs-Verhältnis (10% der Gesamtbewertung)

Zur Bewertung des Preis-Leistungs-Verhältnisses jeder Plattform habe ich Folgendes in Betracht gezogen:

- Wettbewerbsfähige Preise

- Transparente Preisstruktur

- Auswahl an Preismodellen

- Leistungsumfang im Grundpreis

- Kosten für zusätzliche Services

Kundenbewertungen (10% der Gesamtbewertung)

Um einen Eindruck von der allgemeinen Kundenzufriedenheit zu gewinnen, habe ich auf folgende Aspekte bei der Durchsicht von Bewertungen geachtet:

- Allgemeine Zufriedenheitswerte

- Häufig genannte Stärken

- Wiederkehrende Beschwerden

- Empfehlungen durch Nutzer

- Feedback zu Updates und Verbesserungen

Wie wählt man Data Fabric Software aus?

Es ist leicht, sich in langen Funktionslisten und komplexen Preisstrukturen zu verlieren. Damit Sie während Ihres individuellen Auswahlprozesses den Überblick behalten, finden Sie hier eine Checkliste wichtiger Faktoren:

| Faktor | Worauf achten? |

|---|---|

| Skalierbarkeit | Wächst die Software mit Ihren Datenanforderungen? Prüfen Sie, ob sie steigende Datenmengen und Benutzerzahlen ohne Leistungseinbußen bewältigt. |

| Integrationen | Lässt sich das System mit Ihren bestehenden Tools verbinden? Achten Sie darauf, dass die Software die von Ihrem Team genutzten Plattformen und Anwendungen unterstützt, um Workflow-Unterbrechungen zu vermeiden. |

| Anpassbarkeit | Können Sie sie an Ihre Prozesse anpassen? Suchen Sie nach Optionen, Dashboards, Workflows und Berichte individuell an die Bedürfnisse Ihres Teams anzupassen. |

| Benutzerfreundlichkeit | Wie intuitiv ist die Benutzeroberfläche? Vergewissern Sie sich, dass Ihr Team die Software ohne umfassende Schulungen oder eine steile Lernkurve bedienen kann. |

| Implementierung und Onboarding | Wie lange dauert der Einstieg? Bewerten Sie den nötigen Aufwand für Einrichtung und Schulung. Achten Sie auf Software mit klaren Leitfäden oder Support. |

| Kosten | Passt die Software in Ihr Budget? Vergleichen Sie die Tarifmodelle mit Ihrem Budget und achten Sie auf versteckte Kosten für Funktionen oder Services, die nicht im Grundpreis enthalten sind. |

| Sicherheitsmaßnahmen | Schützt die Software Ihre Daten? Überprüfen Sie die Sicherheitsfeatures wie Verschlüsselung und Zugriffskontrollen, um Ihre Daten abzusichern. |

| Compliance-Anforderungen | Erfüllt sie Branchenstandards? Stellen Sie sicher, dass die Software relevante Vorschriften wie DSGVO oder HIPAA einhält, sofern für Ihr Unternehmen relevant. |

Was ist Data Fabric Software?

Data Fabric Software ist eine Sammlung von Tools, die dafür entwickelt wurden, Daten über mehrere Plattformen und Umgebungen hinweg zu integrieren und zu verwalten. IT-Fachleute, Dateningenieure und Analysten nutzen diese Tools typischerweise, um die Datenzugänglichkeit und -verwaltung zu verbessern.

Funktionen zur Datenintegration, -verwaltung und -kontrolle helfen dabei, Daten zu organisieren und den konsistenten Zugriff über Systeme hinweg sicherzustellen. Insgesamt vereinfachen diese Tools Datenprozesse und unterstützen fundierte Entscheidungen, indem sie gewährleisten, dass Daten zugänglich und zuverlässig sind.

Funktionen

Bei der Auswahl von Data Fabric Software sollten Sie auf folgende zentrale Funktionen achten:

- Datenintegration: Verbindet verschiedene Datenquellen und ermöglicht einen nahtlosen Datenfluss sowie einen einheitlichen Zugriff über Plattformen hinweg.

- Echtzeit-Analyse: Bietet sofortige Erkenntnisse durch die Verarbeitung von Daten bei deren Eingang und unterstützt Anwender bei zeitnahen Entscheidungen.

- Daten-Governance: Sichert die Datenqualität und die Einhaltung von Vorschriften, indem Regeln und Richtlinien für den Zugriff und die Nutzung von Daten angewendet werden.

- Skalierbarkeit: Unterstützt wachsende Datenmengen und Benutzeranforderungen, ohne an Leistung oder Geschwindigkeit einzubüßen.

- Anpassbarkeit: Ermöglicht es Anwendern, Dashboards, Workflows und Berichte individuell an die jeweiligen Geschäftsanforderungen und -prozesse anzupassen.

- Sicherheitsmaßnahmen: Schützt Daten durch Verschlüsselung und Zugriffskontrollen und stellt so Integrität und Vertraulichkeit sicher.

- Automatisierte Datenerkennung: Identifiziert und klassifiziert Daten automatisch, spart Zeit und erhöht die Effizienz beim Datenmanagement.

- Datenvisualisierung: Wandelt komplexe Datensätze in leicht verständliche visuelle Formate um und erleichtert so Interpretation und Analyse.

- Integrationsfähigkeit: Bietet eine nahtlose Verbindung zu bestehenden Tools und Plattformen und minimiert Unterbrechungen im Arbeitsablauf.

- In-Memory-Verarbeitung: Erhöht die Datenzugriffsgeschwindigkeit, indem Daten im Arbeitsspeicher gehalten und dadurch schneller abgerufen und analysiert werden können.

Vorteile

Die Implementierung von Data-Fabric-Software bietet Ihrem Team und Ihrem Unternehmen mehrere Vorteile. Auf folgende Punkte können Sie sich freuen:

- Verbesserter Datenzugriff: Sichert einen konsistenten und einheitlichen Datenzugriff über verschiedene Plattformen hinweg und ermöglicht so bessere Zusammenarbeit und Entscheidungsfindung.

- Verbesserte Entscheidungsfindung: Echtzeitanalysen liefern zeitnahe Einblicke und helfen Ihrem Team, fundierte Entscheidungen schnell zu treffen.

- Höhere Effizienz: Automatisiert Aufgaben der Datenerkennung und -integration, spart Zeit und verringert den manuellen Aufwand.

- Stärkere Datensicherheit: Implementiert Sicherheitsmechanismen wie Verschlüsselung und Zugriffskontrollen zum Schutz sensibler Informationen.

- Skalierbarkeit: Ermöglicht steigende Datenmengen und -anforderungen, ohne die Leistung zu beeinträchtigen, sodass Ihr Unternehmen problemlos wachsen kann.

- Anpassung: Bietet die Flexibilität, die Software an Ihre spezifischen Anforderungen anzupassen und dadurch die Nutzererfahrung insgesamt zu verbessern.

- Compliance-Sicherung: Stellt die Einhaltung von Daten-Governance-Standards sicher, damit Ihre Daten branchenspezifische Vorschriften und Richtlinien erfüllen.

Kosten & Preise

Für die Auswahl von Data-Fabric-Software ist es wichtig, die verschiedenen Preismodelle und verfügbaren Tarife zu verstehen. Die Kosten variieren abhängig von Funktionen, Teamgröße, Zusatzoptionen und mehr. Die folgende Tabelle fasst gängige Tarife, deren durchschnittliche Preise sowie typische Leistungsmerkmale von Data-Fabric-Softwarelösungen zusammen:

Vergleichstabelle für Data-Fabric-Software-Tarife

| Tarifart | Durchschnittspreis | Übliche Leistungsmerkmale |

|---|---|---|

| Free-Tarif | $0 | Grundlegende Datenintegration, eingeschränkte Analysefunktionen und Community-Support. |

| Personal-Tarif | $5-$25/user/month | Datenintegration, grundlegende Analysefunktionen, Datenvisualisierung und E-Mail-Support. |

| Business-Tarif | $30-$100/user/month | Erweiterte Analysefunktionen, Daten-Governance, individuelle Dashboards und vorrangiger Support. |

| Enterprise-Tarif | $100+/user/month | Umfassendes Datenmanagement, Echtzeit-Analyse, erhöhte Sicherheit, individuelle Integrationen und dedizierter Support. |

Häufig gestellte Fragen zur Data Fabric Software

Hier finden Sie Antworten auf häufig gestellte Fragen zu Data Fabric Software:

Was sind die Nachteile von Data Fabric?

Data Fabric kann aufgrund mehrerer Datenablagen komplex werden, was das Datenmanagement erschwert. Sie könnten auf Probleme mit fehlender Standardisierung stoßen, da in unterschiedlichen Formaten gespeicherte Daten schwieriger zu analysieren sind. Überlegen Sie, ob Ihr Team über die Ressourcen verfügt, diese Komplexität effektiv zu bewältigen.

Wie funktioniert Data Fabric?

Data Fabric funktioniert, indem es Daten über verschiedene Systeme hinweg verbindet, verwaltet und steuert. Es bietet eine zentrale und einheitliche Ansicht Ihrer Daten, sodass sie sowohl für Ihre Teams als auch für Ihre Systeme zugänglich sind. Dieser Ansatz stellt sicher, dass Ihr Unternehmen Daten effizient nutzen kann – unabhängig davon, wo sie sich befinden.

Erfordert Data Fabric Datenvirtualisierung?

Datenvirtualisierung hilft dabei, Daten schnell zu integrieren, und ist häufig ein Kernelement einer Data-Fabric-Architektur. Wenn Sie eine zentrale Plattform benötigen, um alle Ihre Daten zu verwalten und zu steuern, kann die Datenvirtualisierung diese Bemühungen unterstützen. Prüfen Sie die spezifischen Anforderungen Ihres Unternehmens, um den Bedarf zu ermitteln.

Welche Branchen profitieren am meisten von Data Fabric?

Branchen wie Finanzen, Gesundheitswesen und Einzelhandel profitieren erheblich von Data Fabric. Diese Bereiche arbeiten oft mit großen Mengen an Daten aus verschiedenen Quellen und benötigen eine effiziente Integration und Verwaltung. Überlegen Sie, ob Ihre Branche vor ähnlichen Herausforderungen steht, die Data Fabric lösen kann.

Welche Rolle spielt KI in Data Fabric?

KI verbessert Data Fabric, indem sie Aufgaben im Datenmanagement automatisiert und erweiterte Analysen ermöglicht. Ihr Team erhält dadurch schneller Einblicke und Verbesserungen bei Entscheidungsprozessen. Bewerten Sie, ob KI-Funktionen zu Ihren Zielen passen, um ihre Bedeutung für Ihre Data-Fabric-Lösung zu bestimmen.

Wie geht es weiter:

Wenn Sie gerade Data-Fabric-Software recherchieren, verbinden Sie sich mit einem SoftwareSelect-Berater für kostenlose Empfehlungen.

Sie füllen ein Formular aus und führen ein kurzes Gespräch, in dem sie die Details Ihrer Anforderungen erfragen. Dann erhalten Sie eine Shortlist passender Software zum Überprüfen. Sie begleiten Sie sogar durch den gesamten Kaufprozess – einschließlich Preisverhandlungen.