Meilleure liste des outils d’ingénierie des données

Here's my pick of the 10 best software from the 5 tools reviewed.

Gérer les données de façon efficace est un défi quotidien. Vous avez besoin d’outils qui vous aident à traiter, analyser et visualiser les données sans difficulté. Les outils d’ingénierie des données peuvent devenir vos alliés pour réaliser ces tâches, en faisant gagner du temps et des efforts à votre équipe.

J’ai testé et évalué de manière indépendante de nombreuses solutions logicielles pour vous présenter les meilleures options disponibles. Mon objectif est de vous offrir un avis objectif, approfondi et basé sur la recherche, des meilleures solutions adaptées à vos besoins.

Dans cet article, vous trouverez une analyse détaillée des fonctionnalités, avantages et inconvénients potentiels de chaque outil. Que vous souhaitiez simplifier l’intégration des données ou améliorer la surveillance de vos flux, vous trouverez ici des solutions adaptées. Plongeons ensemble dans ces outils qui peuvent transformer vos processus de gestion des données.

Table of Contents

- Meilleure sélection de logiciels

- Pourquoi nous faire confiance

- Comparer les spécifications

- Avis

- Autres outils d’ingénierie des données

- Avis associés

- Critères de sélection

- Comment choisir

- Tendances dans les outils d’ingénierie des données

- Que sont les outils d’ingénierie des données ?

- Fonctionnalités

- Avantages

- Coûts & Tarification

- FAQ

Why Trust Our Software Reviews

Résumé des meilleurs outils d’ingénierie des données

Ce tableau comparatif résume les prix de mes meilleures sélections d’outils d’ingénierie des données pour vous aider à trouver celui qui conviendra le mieux à votre budget et à votre entreprise.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Idéal pour les flux de travail ETL sans code | Démo gratuite disponible | Tarification sur demande | Website | |

| 2 | Idéal pour la visualisation de données | Démo gratuite disponible + essai gratuit disponible | À partir de 75 $/utilisateur/mois (facturé annuellement) | Website | |

| 3 | Idéal pour la simplicité de l’ETL | Essai gratuit 14 jours + démo gratuite disponible | À partir de $100/5 utilisateurs/mois | Website | |

| 4 | Idéal pour la collaboration en équipe | Essai gratuit disponible | Tarification sur demande | Website | |

| 5 | Idéal pour la surveillance des pipelines de données | Démo gratuite disponible | Tarification sur demande | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Avis sur les meilleurs outils d’ingénierie des données

Vous trouverez ci-dessous mes résumés détaillés des meilleurs outils d’ingénierie des données sélectionnés. Mes avis vous offrent un aperçu des principales fonctionnalités, des avantages et inconvénients, des intégrations et des cas d’usage idéals pour chacun afin de vous aider à trouver celui qui vous conviendra le mieux.

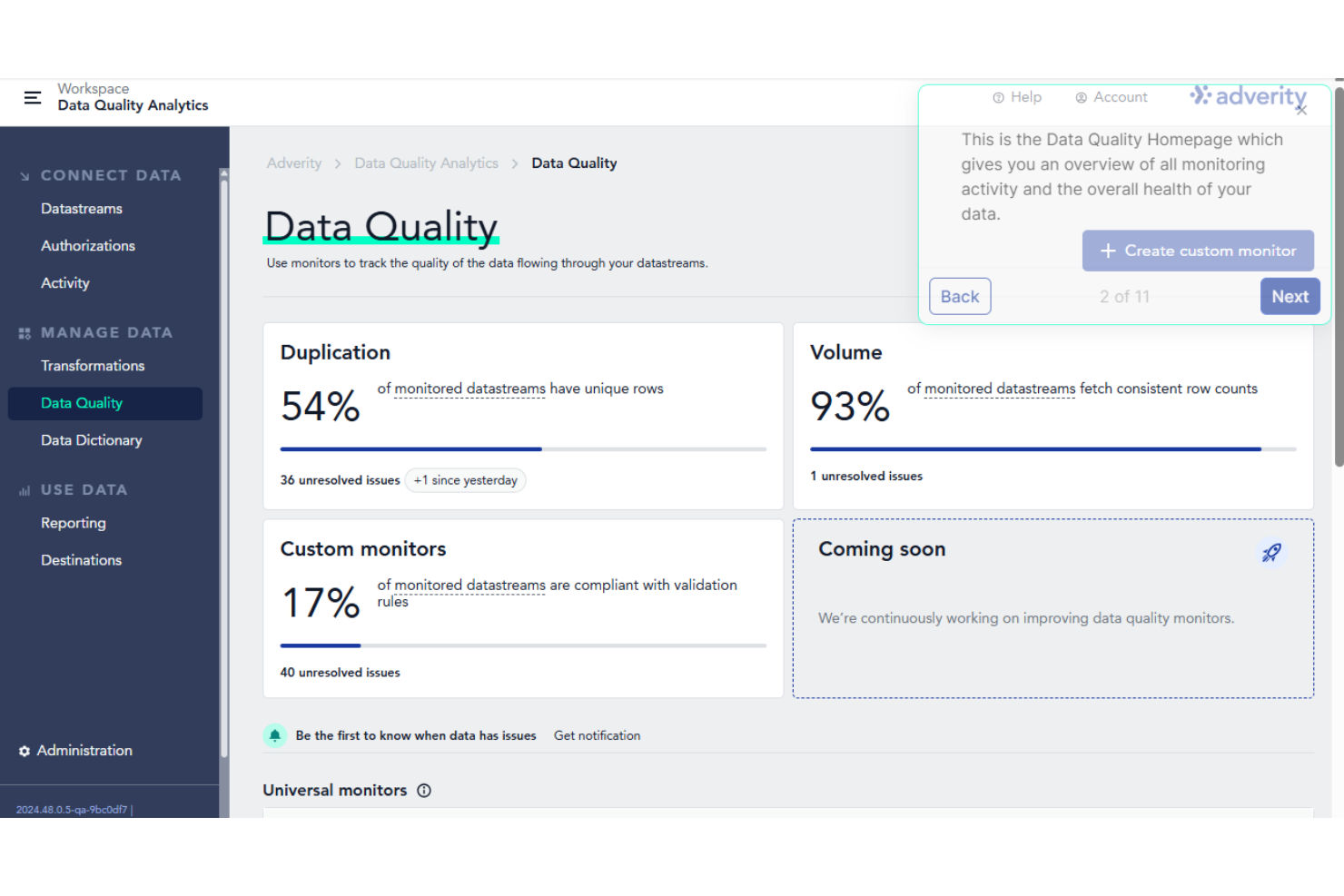

Adverity est une plateforme de données qui aide les équipes à automatiser la connexion, la transformation et la gestion des données provenant de différentes sources. Elle est conçue pour vous offrir une vue unique et précise de vos données, facilitant ainsi leur analyse et leur utilisation.

Pourquoi j'ai choisi Adverity : J'ai choisi Adverity car il permet à votre équipe d'automatiser les flux de travail ETL sans avoir besoin de coder. Vous pouvez créer des pipelines qui extraient, transforment et chargent des données depuis plus de 600 sources. Les fonctionnalités comme les conventions de nommage intelligentes et la correspondance & cartographie facilitent la standardisation et le nettoyage des données. Il prend également en charge les métriques calculées et l'enrichissement avancé des données, ce qui est essentiel pour préparer des ensembles de données fiables. Ces outils aident les ingénieurs de données à assurer la cohérence des données et à réduire les efforts manuels tout au long du pipeline.

Fonctionnalités remarquables & intégrations :

Fonctionnalités : Elles incluent la détection d'anomalies qui vous alerte en cas de problèmes tels que des doublons ou des variations inattendues dans vos données, vous aidant à résoudre les problèmes avant qu'ils n'affectent votre analyse. La plateforme propose également un dictionnaire de données partagé, garantissant que chaque membre de votre équipe comprenne les champs de données et les métriques utilisés.

Intégrations : Elles incluent Google, Meta, TikTok, Google BigQuery, Looker Studio, Facebook Ads, Amazon Advertising, Hubspot, Salesforce, Amazon S3, Snowflake et Microsoft Azure.

Pros and Cons

Pros:

- Possibilité d'automatiser l'extraction des données depuis de nombreuses sources

- Comprend des fonctionnalités pour surveiller la qualité et l'état des données

- Offre des capacités de transformation des données personnalisables

Cons:

- La configuration initiale peut prendre du temps

- Certaines configurations peuvent requérir des connaissances techniques

New Product Updates from Adverity

Adverity Introduces Brandwatch and Kakao Connectors

Adverity introduces the Brandwatch Measure and Kakao Moment connectors. These updates expand data integration capabilities, enabling more comprehensive social media and regional marketing analysis. For more information, visit Adverity’s official site.

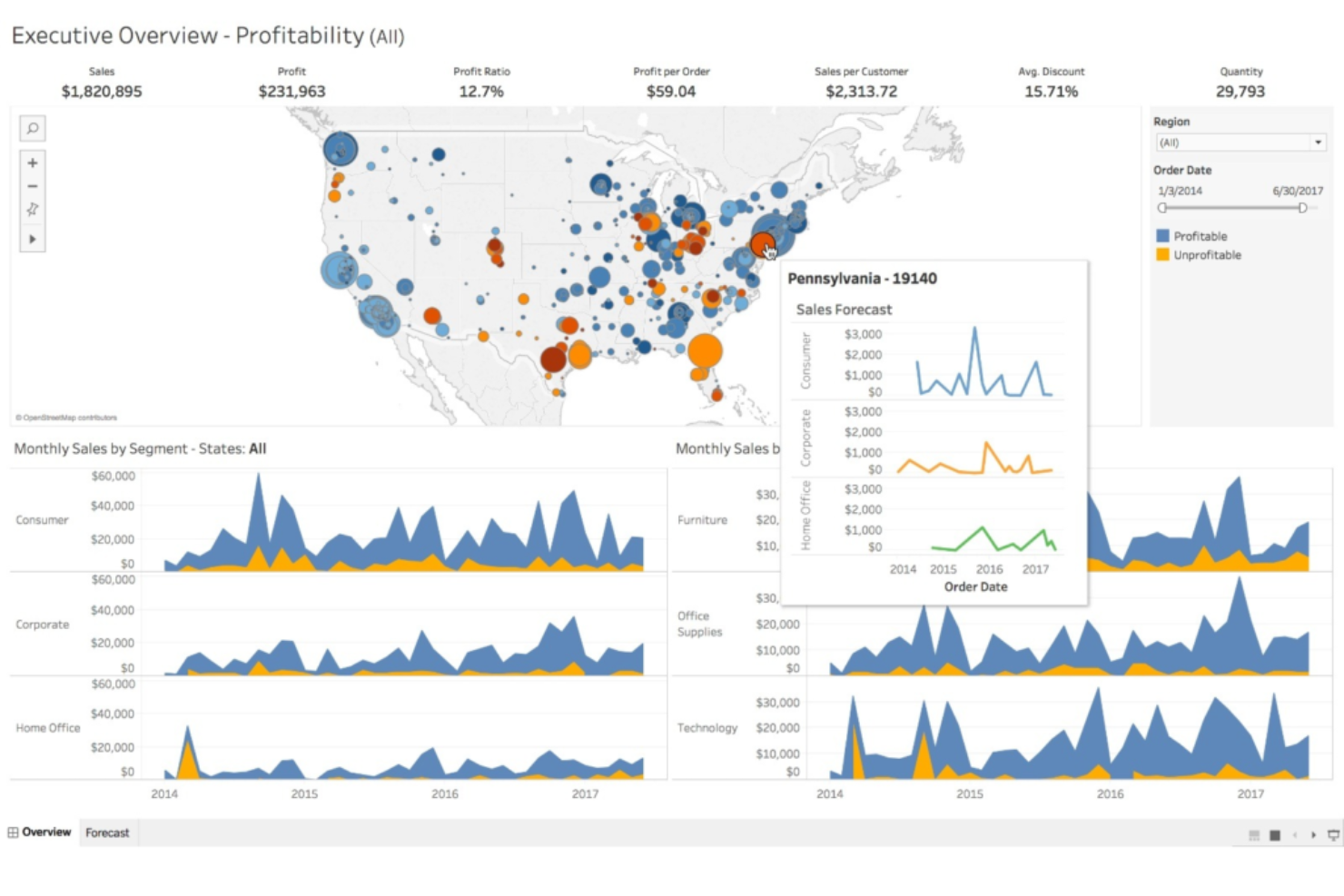

Tableau est un outil de business intelligence conçu pour la visualisation des données, principalement destiné aux analystes, aux data scientists et aux utilisateurs métiers. Il permet aux utilisateurs de créer des tableaux de bord interactifs et partageables qui mettent en évidence les tendances, les schémas et les informations issues des données.

Pourquoi j'ai choisi Tableau : Il est reconnu pour ses capacités de visualisation des données, ce qui en fait un outil idéal pour ceux qui souhaitent présenter des données de manière attrayante. Son interface glisser-déposer vous permet de créer des visualisations sans avoir besoin de connaissances techniques approfondies. Tableau prend en charge de nombreuses sources de données, vous permettant de vous connecter à vos données où qu'elles se trouvent. Sa communauté active offre une mine de ressources pour vous aider à exploiter toutes ses fonctionnalités.

Fonctionnalités et intégrations remarquables :

Fonctionnalités : tableaux de bord interactifs, assemblage de données et analyses en temps réel. Vous pouvez créer des présentations visuelles convaincantes avec un minimum d'effort. Sa capacité à traiter efficacement de grands volumes de données le distingue de bon nombre de ses concurrents.

Intégrations : Salesforce, Google Analytics, Amazon Redshift, Microsoft Excel, SQL Server, Snowflake, Oracle, SAP Hana, Hadoop et Dropbox.

Pros and Cons

Pros:

- Mises à jour des données en temps réel

- Visualisations personnalisables

- Exploration interactive des données

Cons:

- Coût élevé pour les grandes équipes

- Courbe d'apprentissage abrupte

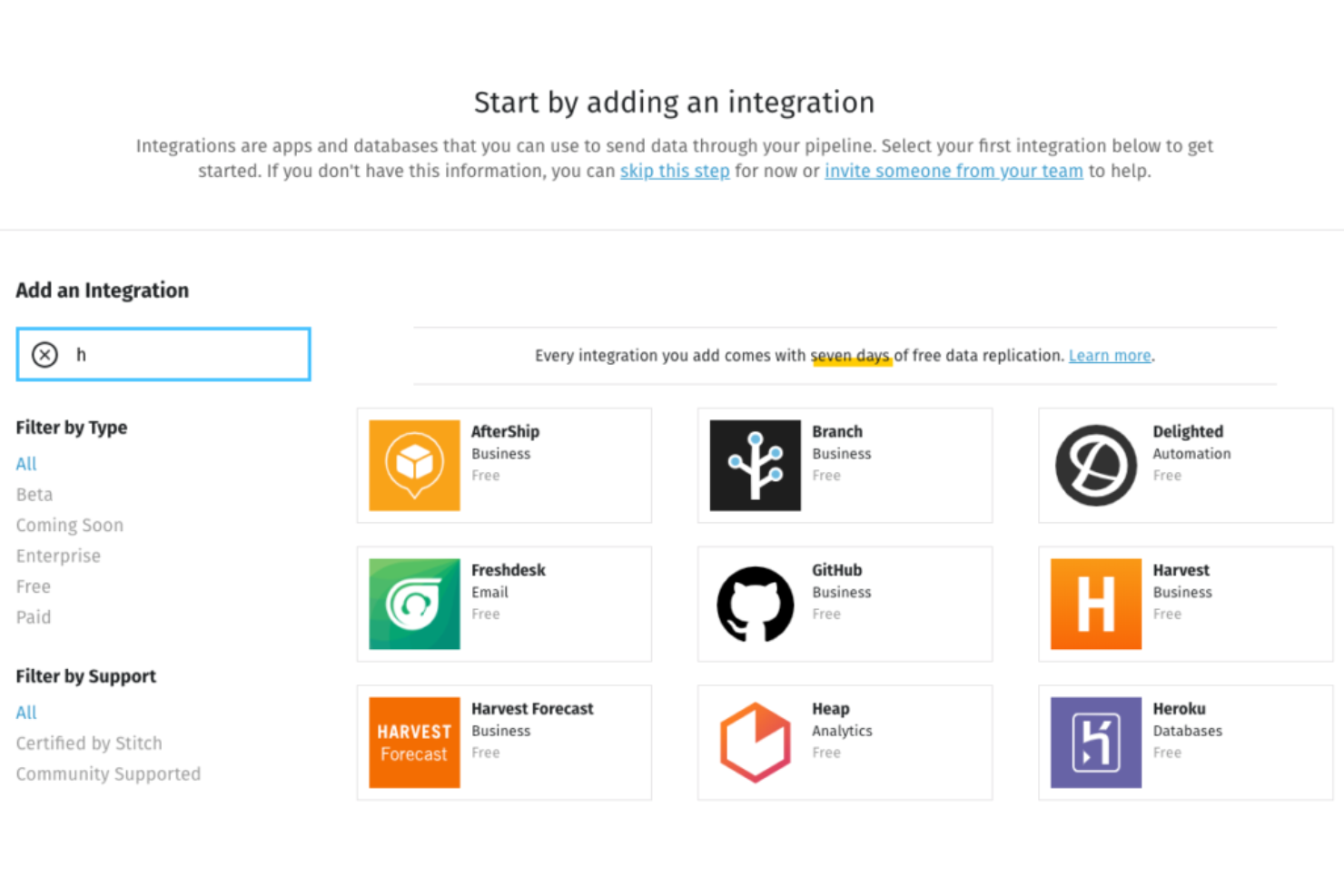

Stitch est un outil ETL conçu pour les ingénieurs et analystes de données qui doivent transférer des données de diverses sources vers un entrepôt de données. Il simplifie le processus de pipeline de données, permettant aux utilisateurs d’extraire, de transformer et de charger les données efficacement.

Pourquoi j’ai choisi Stitch : Son approche directe de l’ETL en fait une solution idéale pour les équipes qui souhaitent simplifier le transfert de données. Avec Stitch, vous pouvez configurer des pipelines de données en quelques minutes, réduisant ainsi le besoin de codage complexe. Il prend en charge un large éventail de sources de données, vous offrant une flexibilité quant à la provenance de vos données. Sa détection automatique de schéma vous aide à maintenir l’intégrité des données sans intervention manuelle.

Fonctionnalités remarquables & intégrations :

Fonctionnalités comprennent la mise à jour automatique des données, qui garde vos données à jour sans efforts manuels. La réplication des données en temps réel garantit que votre équipe dispose toujours des informations les plus récentes. Son interface conviviale vous permet de configurer rapidement les sources de données.

Intégrations comprennent Salesforce, Google Analytics, MySQL, PostgreSQL, Amazon Redshift, Snowflake, Microsoft SQL Server, MongoDB, Facebook Ads et Shopify.

Pros and Cons

Pros:

- Détection automatique de schéma

- Processus d'installation rapide

- Interface facile à utiliser

Cons:

- Pas de visualisation de données intégrée

- Options de personnalisation limitées

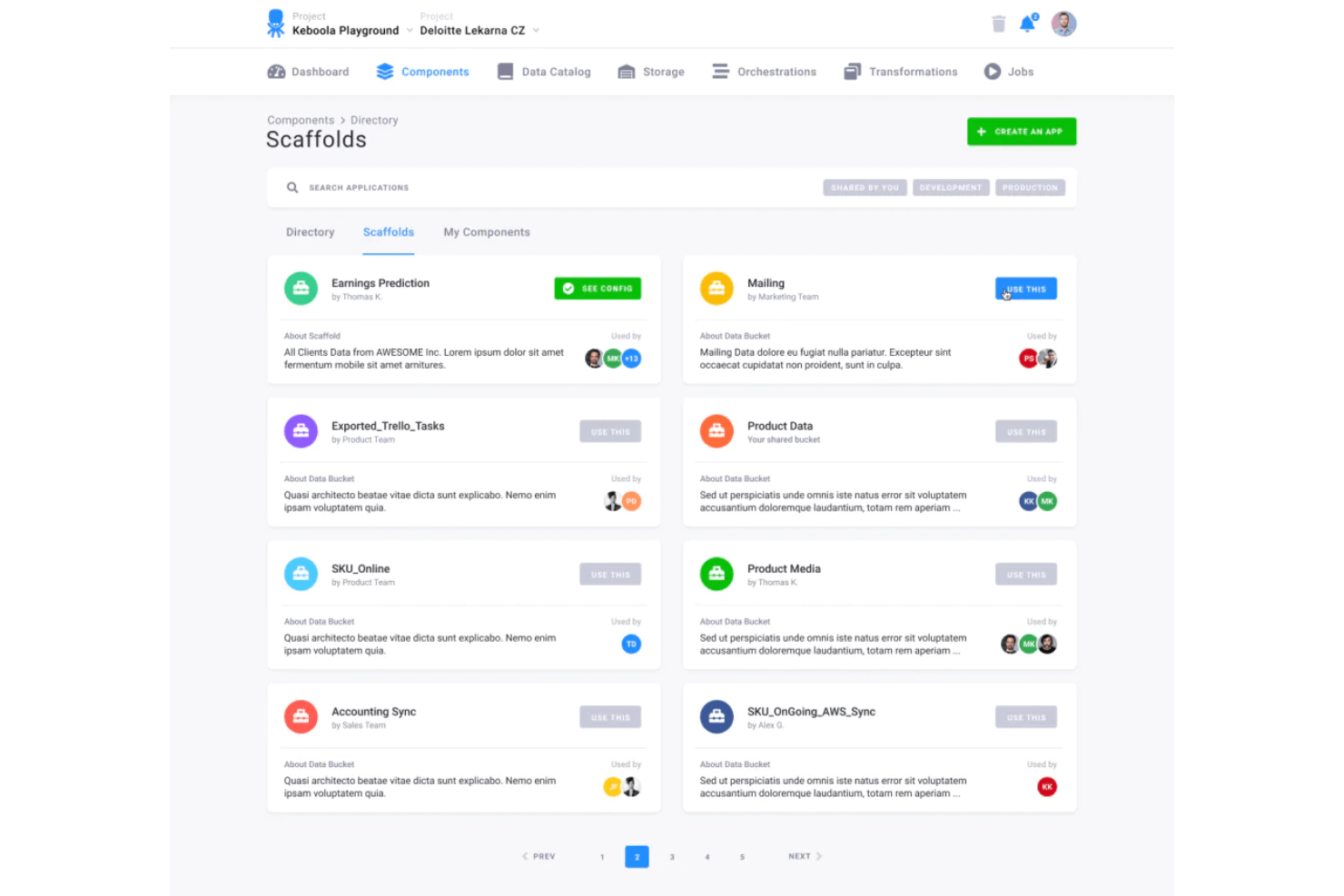

Keboola Connection est une plateforme d'opérations sur les données destinée aux équipes data et aux analystes métiers qui doivent collaborer sur des projets de données. Elle simplifie le processus d'orchestration des données, facilitant ainsi le travail collaboratif des équipes et la gestion des flux de travail des données.

Pourquoi j'ai choisi Keboola Connection : Elle est conçue pour renforcer la collaboration en équipe, permettant à plusieurs utilisateurs de travailler simultanément sur des projets de données. La plateforme offre un partage de données en temps réel, ce qui aide votre équipe à rester à jour avec les dernières modifications. Elle propose un environnement flexible où vous pouvez personnaliser les processus de données selon vos besoins. Grâce à son interface conviviale, Keboola Connection rend les opérations complexes sur les données accessibles à tous les membres de votre équipe.

Fonctionnalités remarquables & intégrations :

Fonctionnalités : traitement des données en temps réel, garantissant que votre équipe travaille toujours avec les informations les plus récentes. Elle dispose d'outils de gouvernance des données intégrés qui vous aident à maintenir la qualité et la conformité des données. Les capacités d'automatisation de la plateforme réduisent les tâches manuelles, libérant ainsi votre équipe pour des travaux plus stratégiques.

Intégrations : Snowflake, Amazon Redshift, Google BigQuery, MySQL, PostgreSQL, Microsoft Azure, Salesforce, Google Analytics, HubSpot et Slack.

Pros and Cons

Pros:

- Outils de gouvernance des données intégrés

- Options de personnalisation flexibles

- Collaboration sur les données en temps réel

Cons:

- Nécessite une expertise technique

- Courbe d'apprentissage élevée

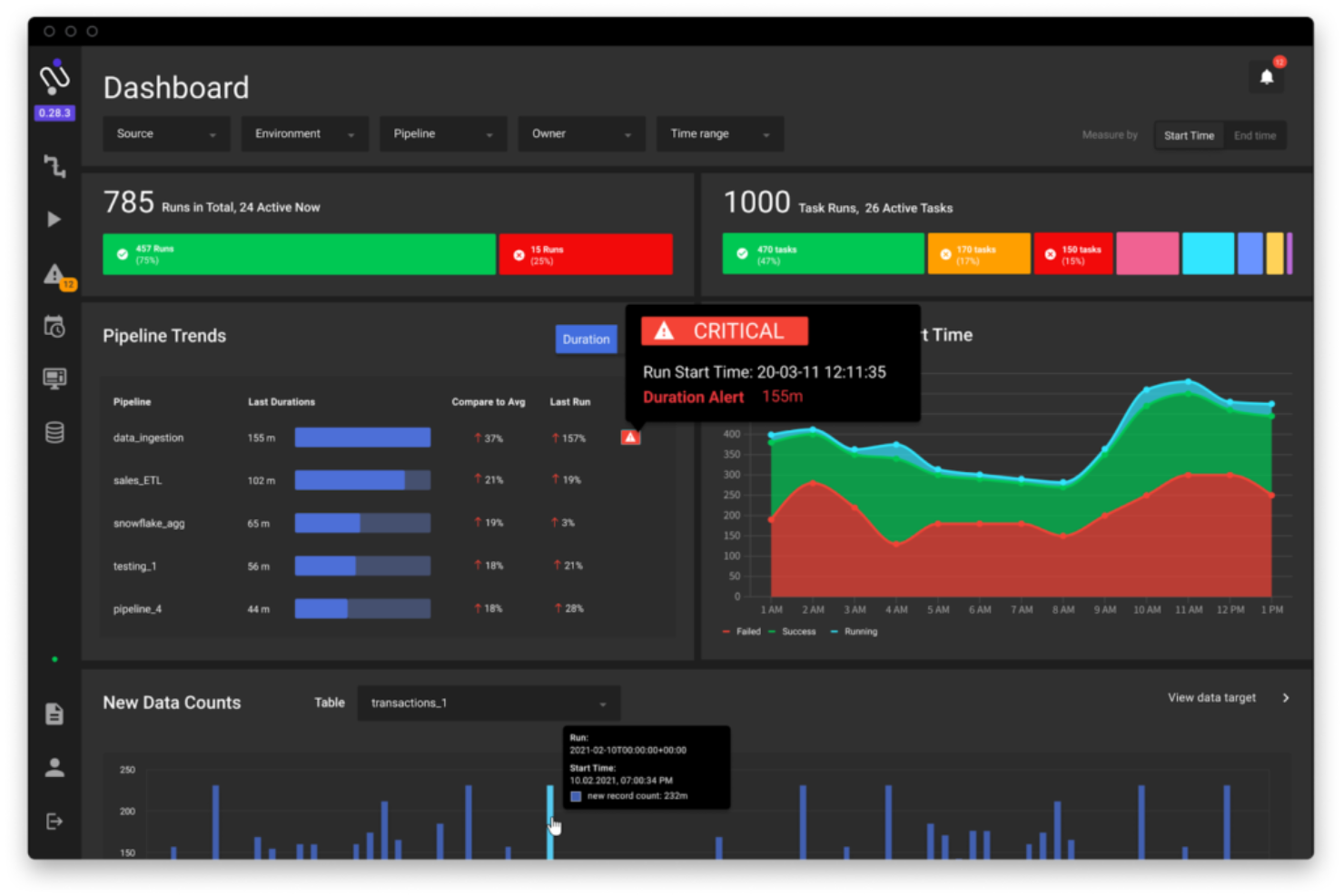

Databand est une plateforme d'observabilité des données conçue pour les ingénieurs de données et les équipes d'exploitation qui doivent surveiller et gérer les pipelines de données. Elle aide les utilisateurs à détecter, diagnostiquer et résoudre les problèmes de qualité des données, garantissant ainsi le bon fonctionnement des opérations de données.

Pourquoi j'ai choisi Databand : Cette solution est conçue pour surveiller les pipelines de données, ce qui la rend essentielle pour les équipes ayant besoin de maintenir l'intégrité et la fiabilité de leurs données. Databand propose des alertes en temps réel afin que votre équipe puisse réagir rapidement à tout incident. Grâce à ses analyses détaillées du flux de données, vous identifiez facilement les goulots d'étranglement. L'interface conviviale de la plateforme facilite la visualisation des processus de données.

Fonctionnalités et intégrations phares :

Fonctionnalités incluent la détection d'anomalies, qui permet de repérer tôt des schémas de données irréguliers. La plateforme propose un suivi historique des données afin d'analyser la performance passée des pipelines. Ses tableaux de bord personnalisables vous offrent la flexibilité de vous concentrer sur les indicateurs les plus importants pour votre équipe.

Intégrations incluent Apache Airflow, Apache Spark, Databricks, Google Cloud Platform, Amazon Web Services, Snowflake, Microsoft Azure, Kubernetes, Slack et PagerDuty.

Pros and Cons

Pros:

- Interface conviviale

- Analyses détaillées du flux de données

- Capacités de surveillance en temps réel

Cons:

- Courbe d'apprentissage abrupte

- Peut nécessiter des ressources supplémentaires

Critères de sélection pour les outils d’ingénierie des données

Pour choisir les meilleurs outils d’ingénierie des données à inclure dans cette liste, j’ai pris en compte les besoins courants des acheteurs et leurs difficultés, comme la complexité de l’intégration des données ou la question de l’évolutivité. J’ai aussi utilisé le cadre suivant pour garantir une évaluation structurée et équitable :

Fonctionnalités clés (25 % de la note finale)

Pour figurer dans cette sélection, chaque solution devait couvrir ces cas d’utilisation courants :

- Intégration des données

- Transformation des données

- Automatisation des pipelines de données

- Visualisation des données

- Gestion du stockage des données

Fonctionnalités supplémentaires remarquables (25 % de la note finale)

Pour départager davantage les outils, j’ai aussi cherché des fonctionnalités uniques, telles que :

- Traitement des données en temps réel

- Détection d’anomalies

- Analyses prédictives

- Workflows personnalisables

- Fonctions de sécurité avancées

Facilité d’utilisation (10 % de la note finale)

Pour évaluer l’ergonomie de chaque système, j’ai pris en compte les aspects suivants :

- Conception de l’interface intuitive

- Facilité de navigation

- Courbe d’apprentissage réduite

- Réactivité de la solution

- Options de personnalisation

Intégration des nouveaux utilisateurs (10 % du score total)

Pour évaluer l’expérience d’intégration de chaque plateforme, j’ai pris en compte les éléments suivants :

- Disponibilité de vidéos de formation

- Tours interactifs du produit

- Accès à des modèles prédéfinis

- Présence de chatbots pour l’assistance

- Webinaires pour les nouveaux utilisateurs

Service client (10 % du score total)

Pour évaluer les services d’assistance de chaque fournisseur, j’ai considéré :

- Disponibilité d’une assistance 24h/24, 7j/7

- Réactivité de l’équipe support

- Accès à une base de connaissances

- Forums communautaires dédiés aux utilisateurs

- Diversité des canaux de support

Rapport qualité/prix (10 % du score total)

Pour évaluer le rapport qualité/prix de chaque plateforme, j’ai pris en compte les critères suivants :

- Tarification compétitive

- Fonctionnalités proposées à ce niveau de prix

- Coût des options ou modules supplémentaires

- Flexibilité des formules tarifaires

- Niveau de satisfaction quant au retour sur investissement

Avis clients (10 % du score total)

Pour me faire une idée de la satisfaction générale des clients, j’ai examiné dans les avis clients :

- Notes globales de satisfaction

- Points forts fréquemment mentionnés

- Faiblesses récurrentes signalées

- Retours concernant le support client

- Recommandations par les utilisateurs

Comment choisir ses outils d’ingénierie des données

Il est facile de se perdre dans de longues listes de fonctionnalités et des tarifs parfois complexes. Pour garder le cap tout au long de votre processus de sélection, voici une liste de points essentiels à garder à l’esprit :

| Facteur | À considérer |

| Évolutivité | Assurez-vous que l’outil pourra évoluer avec vos besoins en données. Pensez à l’augmentation future des volumes et à la capacité de l’outil à traiter de grands ensembles sans perte de performance. |

| Intégrations | Cherchez des outils compatibles avec votre écosystème existant, tels que les logiciels de data fabric ou plateformes analytiques, afin de simplifier les flux et éviter tout problème de compatibilité. |

| Personnalisation | Vérifiez si l’outil peut être personnalisé pour s’adapter à vos processus métiers. Vous pourriez avoir besoin de modifier les flux de travail ou la gestion des données selon vos usages. |

| Simplicité d’utilisation | Évaluez l’interface utilisateur et la courbe d’apprentissage. L’outil doit pouvoir être adopté sans nécessiter une formation avancée ni expertise technique pointue. |

| Budget | Examinez les plans tarifaires et vérifiez leur adéquation avec vos contraintes budgétaires. Prenez en compte les coûts initiaux comme les frais récurrents éventuels. |

| Sécurité | Assurez-vous que l’outil dispose de garanties de sécurité robustes pour protéger vos données : chiffrement, contrôles d’accès et conformité aux normes du secteur. |

| Support | Considérez la disponibilité et la qualité de l’assistance. Vous pourriez avoir besoin d’aide lors du déploiement ou en cas de problème, donc un support réactif est essentiel. |

| Performance | Analysez les métriques de performance, telles que la vitesse de traitement et la fiabilité. L’outil doit rester performant même sous forte charge. |

Tendances des outils d’ingénierie des données

Durant mes recherches, j’ai consulté de nombreuses actualités produits, communiqués de presse et journaux de mises à jour des fournisseurs d’outils d’ingénierie des données. Voici quelques tendances émergentes que je surveille de près :

- Traitement des données en temps réel : Les entreprises exigent des analyses plus rapides, ce qui entraîne une montée du besoin de capacités de traitement en temps réel. Les outils évoluent pour gérer les flux de données et fournir des analyses instantanées, aidant les équipes à prendre des décisions plus rapides. Des fournisseurs comme Apache Kafka sont des leaders dans ce domaine.

- Démocratisation des données : De plus en plus d'outils se concentrent sur l’accessibilité des données pour les utilisateurs non techniques. Cette tendance permet à tous les membres de l’équipe d’exploiter les informations issues des données sans avoir besoin d’un bagage en science des données. Des plateformes comme Tableau améliorent leurs interfaces conviviales pour accompagner ce changement.

- Observabilité des données : Garantir la qualité et la fiabilité des données devient essentiel. Les outils proposent désormais des fonctions de surveillance et d’alerte en cas d’anomalies, aidant les équipes à conserver la confiance en leurs données. Databand est un fournisseur remarquable qui propose des solutions d’observabilité puissantes.

- Confidentialité et conformité : Avec l’augmentation des réglementations, les outils intègrent des fonctionnalités pour garantir la confidentialité des données et leur conformité à des lois telles que le RGPD. Cette tendance est cruciale pour que les entreprises évitent les écueils juridiques, et des fournisseurs comme Informatica intègrent des contrôles de conformité.

- Architectures cloud-native : Il existe un mouvement croissant en faveur des outils d’ingénierie des données conçus pour le cloud, offrant une meilleure évolutivité et flexibilité. Ces outils sont optimisés pour les environnements cloud et offrent aux entreprises des solutions de données plus adaptables. Snowflake illustre cette tendance avec son approche orientée cloud.

Qu'est-ce que les outils d'ingénierie des données ?

Les outils d’ingénierie des données sont des solutions logicielles conçues pour aider à gérer, traiter et transformer les données au sein d’une organisation. Ces outils sont généralement utilisés par les ingénieurs en données, les analystes de données et les professionnels de l’informatique devant manipuler efficacement de grands volumes de données.

Des fonctionnalités telles que l’intégration de données, le traitement en temps réel et l’observabilité des données contribuent au maintien de la qualité des données, à la fourniture rapide d’informations et à la garantie de la conformité. Les outils d’automatisation de test ETL jouent un rôle crucial dans ce processus en validant les transformations des données. Globalement, ces outils permettent aux entreprises de transformer les données brutes en informations précieuses pour accompagner la prise de décisions éclairées.

Fonctionnalités des outils d'ingénierie des données

Lorsque vous sélectionnez des outils d’ingénierie des données, soyez attentif aux caractéristiques clés suivantes :

- Outils d'intégration de données : Cette fonctionnalité vous permet de connecter et de consolider des données issues de sources multiples, facilitant l’analyse et l’extraction d’informations.

- Traitement en temps réel : Permet de gérer les données à leur arrivée, offrant ainsi des informations instantanées et favorisant une prise de décision rapide.

- Visualisation des données : Propose des outils pour créer des graphiques et des tableaux, facilitant l’interprétation de jeux de données complexes par les utilisateurs.

- Évolutivité : Garantit que l’outil peut gérer une augmentation du volume de données sans perte de performance, aspect essentiel pour les entreprises en croissance.

- Flux de travail personnalisables : Permet aux équipes d’ajuster les processus pour répondre à des besoins spécifiques de gestion des données, augmentant ainsi l’efficacité.

- Mesures de sécurité : Comprend le chiffrement et des contrôles d’accès pour protéger les données sensibles et respecter la réglementation.

- Analyse prédictive : Utilise des modèles d’apprentissage automatique pour anticiper les tendances et résultats, facilitant la planification proactive.

- Capacités d’automatisation : Réduit les tâches manuelles en automatisant les processus répétitifs, ce qui augmente la productivité.

- Outils d'observabilité des données : Offre des fonctionnalités de surveillance et d’alerte pour garantir le maintien de la qualité et de la fiabilité des données.

- Interface conviviale : Garantit que l’outil est facile à prendre en main, limitant ainsi la courbe d’apprentissage pour les nouveaux utilisateurs.

Avantages des outils d'ingénierie des données

Mettre en place des outils d’ingénierie des données apporte plusieurs avantages à votre équipe et à votre entreprise, en particulier lorsqu’ils sont associés à un logiciel d’automatisation de la charge de travail. Voici quelques-uns des bénéfices auxquels vous pouvez vous attendre :

- Prise de décision plus rapide : Le traitement en temps réel et les analyses instantanées des données aident votre équipe à prendre rapidement des décisions éclairées.

- Efficacité accrue : Les capacités d'automatisation éliminent les tâches répétitives, libérant ainsi du temps pour des activités plus stratégiques.

- Collaboration améliorée : Des interfaces conviviales et des flux de travail personnalisables favorisent le travail d'équipe en permettant à chacun d'accéder facilement aux données et de travailler avec elles.

- Scalabilité : La capacité à gérer des volumes de données croissants signifie que vos outils peuvent évoluer en même temps que votre entreprise sans problème de performance.

- Meilleure qualité des données : Les outils de catalogage de données avec des fonctionnalités d’observabilité garantissent que vos données restent précises et fiables, réduisant les erreurs d’analyse.

- Meilleure conformité : Les garanties de sécurité telles que le chiffrement et les contrôles d’accès contribuent à garantir que vos pratiques de gestion des données respectent la réglementation du secteur.

- Planification proactive : L’analytique prédictive fournit des prévisions qui permettent à votre équipe d’anticiper les tendances et de planifier en conséquence.

Coûts et tarification des outils d’ingénierie des données

Le choix des outils d’ingénierie des données nécessite de comprendre les différents modèles et formules tarifaires disponibles. Les coûts varient en fonction des fonctionnalités, de la taille de l’équipe, des options supplémentaires et d’autres critères. Le tableau ci-dessous résume les formules courantes, leurs prix moyens et les fonctionnalités typiques incluses dans les solutions d’outils d’ingénierie des données :

Tableau comparatif des formules pour les outils d’ingénierie des données

| Type de formule | Prix moyen | Fonctionnalités courantes |

| Formule Gratuite | $0 | Intégration de données de base, stockage de données limité et assistance communautaire. |

| Formule Personnelle | $10-$50 /utilisateur /mois | Visualisation avancée des données, traitement en temps réel et assistance par email. |

| Formule Professionnelle | $50-$150 /utilisateur /mois | Flux de travail personnalisables, fonctionnalités de sécurité renforcées et assistance client prioritaire. |

| Formule Entreprise | $150-$500/utilisateur /mois | Observabilité complète des données, analytique prédictive et gestion de compte dédiée. |

FAQ sur les outils d’ingénierie des données

Voici quelques réponses aux questions fréquemment posées sur les outils d’ingénierie des données :

Quel outil est utilisé pour l’ingénierie des données ?

Les outils d’ingénierie des données varient selon vos besoins, mais les plus courants incluent Apache Spark, Hadoop et AWS pour le traitement du Big Data. Ces outils vous aident à traiter, stocker et analyser de grands ensembles de données de manière efficace. Votre choix doit dépendre de vos besoins spécifiques en matière de données et du u003ca href=u0022https://thectoclub.com/tools/best-big-data-software/u0022u003elogiciel Big Datau003c/au003e que vous utilisez déjà.

Quelles questions poser à un ingénieur data ?

Lors d’un entretien avec un ingénieur data, posez des questions sur son expérience avec les outils ETL, la modélisation des données et l’orchestration des données. Vous pouvez également vous renseigner sur sa maîtrise des plateformes cloud et sa capacité à gérer de grands ensembles de données. Ces questions vous aideront à évaluer ses compétences techniques et sa capacité à résoudre des problèmes.

Quelle plateforme choisir pour l’ingénierie des données ?

La meilleure plateforme dépend de vos besoins spécifiques, mais des choix populaires incluent Snowflake pour l’analytique cloud et Amazon Redshift pour l’entreposage de données. Ces deux solutions offrent de puissantes capacités pour traiter des données à grande échelle. Tenez compte de l’intégration avec vos systèmes existants et du coût lors du choix de la plateforme.

Que sont les outils ETL en ingénierie des données ?

Les u003ca href=u0022https://thectoclub.com/tools/best-etl-tools/u0022u003eoutils ETLu003c/au003e servent à extraire, transformer et charger les données provenant de différentes sources dans un entrepôt de données. Ce processus nettoie et organise les données brutes afin qu’elles soient prêtes pour l’analyse et l’apprentissage automatique. Les u003ca href=u0022https://thectoclub.com/tools/best-open-source-etl-tools/u0022u003eoutils ETLu003c/au003e courants incluent Informatica, Talend et Apache NiFi, chacun offrant ses propres spécificités.

Qu’est-ce que l’orchestration des données ?

L’orchestration des données consiste à automatiser les processus de collecte, de transformation et de chargement des données. Des outils comme Apache Airflow et Prefect aident à gérer et planifier ces tâches, assurant une circulation fluide des données dans les systèmes. Cela est crucial pour maintenir la cohérence et la fiabilité des données.

Comment choisir le bon outil d’ingénierie des données ?

Le choix du bon outil nécessite d’évaluer le volume de vos données, vos besoins en intégration et votre budget. Optez pour des outils offrant de la scalabilité et la prise en charge du traitement en temps réel si vos besoins en données sont importants et nécessitent de la rapidité. Évaluez la facilité d’utilisation et les options de support pour garantir l’adéquation avec les compétences de votre équipe.

Et ensuite :

Si vous êtes en train de rechercher des outils d’ingénierie de données , contactez un conseiller SoftwareSelect pour obtenir gratuitement des recommandations personnalisées.

Vous remplissez un formulaire et avez une conversation rapide au cours de laquelle ils approfondissent vos besoins spécifiques. Ensuite, vous recevrez une liste restreinte de logiciels à examiner. Ils vous accompagneront même tout au long du processus d'achat, y compris lors des négociations tarifaires.