Imaginez ceci : un défaut est détecté sur la ligne trois. Avant qu’il n’atteigne la station suivante, une alerte se déclenche, l’opérateur est averti, et la détection est enregistrée avec un horodatage, un score de confiance et un identifiant de caméra. Personne n’a eu besoin de surveiller. Le système l’a repéré.

Voilà à quoi ressemble l’IA de vision artificielle sur un atelier de production lorsqu’elle fonctionne réellement. Il ne s’agit pas seulement d’un modèle exécutant des inférences en arrière-plan, mais d’une couche opérationnelle vivante qui transforme ce que voient vos caméras en décisions, alertes et données sur lesquelles votre équipe peut agir.

La plupart des équipes se concentrent sur la création du modèle. Le défi le plus complexe—et celui qui détermine si le système apporte une véritable valeur—est de construire l’infrastructure autour : la bonne stratégie de données, la bonne architecture de déploiement, la bonne boucle de rétroaction. C’est ce qui transforme un prototype fonctionnel en un système sur lequel votre atelier peut compter.

Voici le plan pour y parvenir avec Roboflow.

Comment déployer l’IA de vision avec Roboflow

Une fois votre cas d’usage défini, l’étape suivante est le déploiement. C’est là qu’un modèle fonctionnel devient un système fiable dans des conditions réelles. La plateforme d’IA visuelle de Roboflow fournit une approche structurée pour passer du prototype à la production, en couvrant la configuration, les données et l’amélioration continue.

1. La physique du capteur

Votre caméra est l’API vers le monde réel. Tout ce qui suit—votre modèle, vos détections, vos mesures—n’est fiable que dans la mesure où ce qui passe par cet objectif l’est aussi. Dans un environnement d’usine, deux éléments peuvent discrètement compromettre votre système si vous ne les anticipez pas : la distorsion de l’objectif et l’éclairage irrégulier.

- Le piège de la distorsion de l’objectif : Les objectifs grand angle sont courants sur les lignes de production car ils capturent une plus grande portion de la scène. La contrepartie, c’est la distorsion fisheye : les lignes droites deviennent courbes, les grilles ne sont plus alignées, et votre système de coordonnées dérive. Au laboratoire, on l’oublie aisément. En production, cela transforme un modèle fiable en modèle instable.

- La correction industrielle (intrinsèque vs extrinsèque) : Roboflow Workflows permet d’intégrer la correction de distorsion directement dans votre pipeline d’inférence. Le bloc Calibration de Caméra redresse l’image avant que votre modèle ne la traite. Le bloc Correction de Perspective convertit ensuite la prise de vue inclinée de la caméra en une vue normalisée en plongée, avec des coordonnées corrigées qui sont transmises lors des étapes de mesure en aval.

- L’éclairage comme variable : L’éclairage d’usine varie au fil de la journée : changements d’équipe, soleil par les fenêtres, ombres nouvelles. Roboflow gère cela aux deux étapes : Réglage Automatique du Contraste normalise la lumière sur les images d’apprentissage, et le bloc d’Égalisation du Contraste dans Workflows la corrige lors de l’inférence, même si la scène est inégale et que certaines parties du cadre sont plus sombres.

Obtenir une entrée propre et cohérente est la base, mais un modèle fiable le premier jour doit encore pouvoir rester précis à mesure que les conditions réelles s’éloignent de celles sur lesquelles il a été entraîné.

2. Standardiser l’installation physique

Déployer un système de vision sur plusieurs lignes n’est pas qu’un problème logiciel. Si la caméra est montée à un mètre de la table avec un angle de 45° sur la première ligne, cette configuration exacte doit être documentée et reproduite à l’identique sur toutes les autres lignes. De petites variations physiques, faciles à compenser en laboratoire, deviennent de vraies sources d’erreur en production—et cela apparaîtra comme une chute de confiance inexpliquée sur votre tableau de bord Roboflow avant même que vous en trouviez la cause physique.

- Standardisez vos fixations et angles : Utilisez du matériel rigide, qualité industrielle, et définissez un angle et une hauteur fixes de montage. Même un léger déplacement de la caméra peut invalider la transformation de perspective configurée dans votre Workflow Roboflow, donc la normalisation de coordonnées qui fonctionnait sur la ligne un fournit maintenant une vue légèrement différente au modèle sur la ligne deux.

- Standardisez la distance, le champ de vision et le fond : Gardez la distance caméra-objet et la zone visible constantes d’une ligne à l’autre. Si la scène varie trop d’une ligne à l’autre, votre modèle rencontre des entrées pour lesquelles il n’a pas été entraîné et Le suivi du modèle de Roboflow le signalera par une diminution de la confiance moyenne par appareil.

- Standardisez votre installation d’éclairage : Maintenez la direction, l’intensité et le positionnement de la lumière aussi réguliers que possible. Le bloc d’Égalisation du Contraste de Roboflow peut gérer une variation lumineuse progressive lors de l’inférence, mais il sera bien plus performant si le niveau de base est déjà contrôlé physiquement. Plus votre éclairage est stable, moins le pipeline a de correction à fournir.

- Standardisez entre les sites avec Device Manager : Une fois votre installation physique documentée, Le gestionnaire d’appareils de Roboflow vous permet de déployer le même Workflow sur chaque appareil de votre parc depuis un unique tableau de bord, sans mise à jour manuelle site par site. Et avec les métadonnées personnalisées, chaque inférence peut être associée à un code emplacement comme`warehouse_a` ou`line_3`, ainsi, si un site sous-performe, vous pouvez l’isoler immédiatement dans Model Monitoring plutôt que devoir enquêter sur toute votre flotte.

Un montage physique documenté et reproductible réduit les variables que doit gérer votre modèle, mais ne les élimine pas complètement. Avec le temps, les conditions évoluent et votre système doit pouvoir le détecter.

3. Stratégie de données intelligente

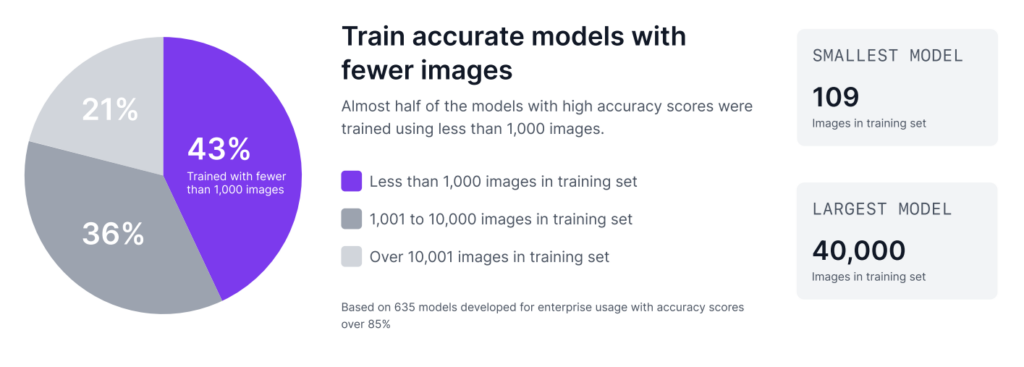

Comme le révèle le rapport de Roboflow sur les tendances de l’IA visuelle, l’IA visuelle personnalisée est souvent moins gourmande en données que beaucoup d’équipes ne l’imaginent. 43 % des modèles d’entreprise ayant obtenu les meilleurs scores de précision ont été entraînés avec moins de 1 000 images. De plus, de nombreux modèles d’entreprise performants sont construits avec seulement quelques centaines d’images.

Étape 1 : Créez une preuve de concept avec 50 images

Vous pouvez créer une première preuve de concept à l’aide d’environ 50 images grâce à Roboflow. Mais cela doit uniquement servir de vérification de faisabilité et non de modèle prêt pour la production. À ce stade, l’objectif est simplement de montrer que la vision artificielle peut résoudre le problème et de démontrer que le cas d’usage mérite d’être poursuivi.

Voici comment procéder dans Roboflow :

- Téléchargez et annotez vos 50 images dans votre projet Roboflow

- Allez dans Versions dans la barre latérale et cliquez sur Générer une nouvelle version

- Réglez votre partage train/valid/test et configurez vos étapes de prétraitement. Désactivez les augmentations à ce stade afin d’avoir une lecture claire de la performance de vos données seules

- Cliquez sur Générer, puis sur Entraînement personnalisé, sélectionnez une architecture de modèle et lancez l’entraînement

Le modèle obtenu ici n’est pas celui que vous déploierez. C’est un indicateur. S’il parvient à détecter votre cible avec seulement 50 images, le cas d’usage mérite d’être développé à plus grande échelle.

Étape 2 : Montez en puissance vers 500 images pour une validation en production

Une fois cette valeur prouvée, l’étape suivante consiste à monter progressivement vers 500 images. La raison est simple. En production, vous avez besoin d’un ensemble de test significatif pour vérifier si le modèle est suffisamment stable pour une utilisation réelle. Si environ 10 % des données sont réservées au test, alors 500 images vous donnent environ 50 images de test, ce qui offre une bien meilleure base pour valider le modèle. Tester sur seulement quelques images ne permet pas d’avoir une confiance suffisante dans les performances du modèle sur le terrain.

Les étapes dans Roboflow sont les mêmes, mais ce que vous configurez change :

- Téléchargez et annotez votre jeu de données élargi dans le même projet Roboflow

- Allez dans Versions → Générer une nouvelle version

- Cette fois-ci, définissez un partage train/valid/test délibéré, environ 70/20/10, afin d’obtenir environ 50 images de test pour une véritable validation

- Maintenant, les augmentations valent la peine d’être considérées : n’ajoutez que celles qui reflètent les conditions réelles sur votre site, rien de plus

- Cliquez sur Générer, puis Entraînement personnalisé pour lancer l’entraînement

Le jeu de données sur lequel vous entraînez votre modèle n’est qu’un point de départ, pas une limite. Les images qui rendront votre modèle le plus précis sont celles qu’il n’a pas encore vues, et elles sont déjà capturées sur votre chaîne de production.

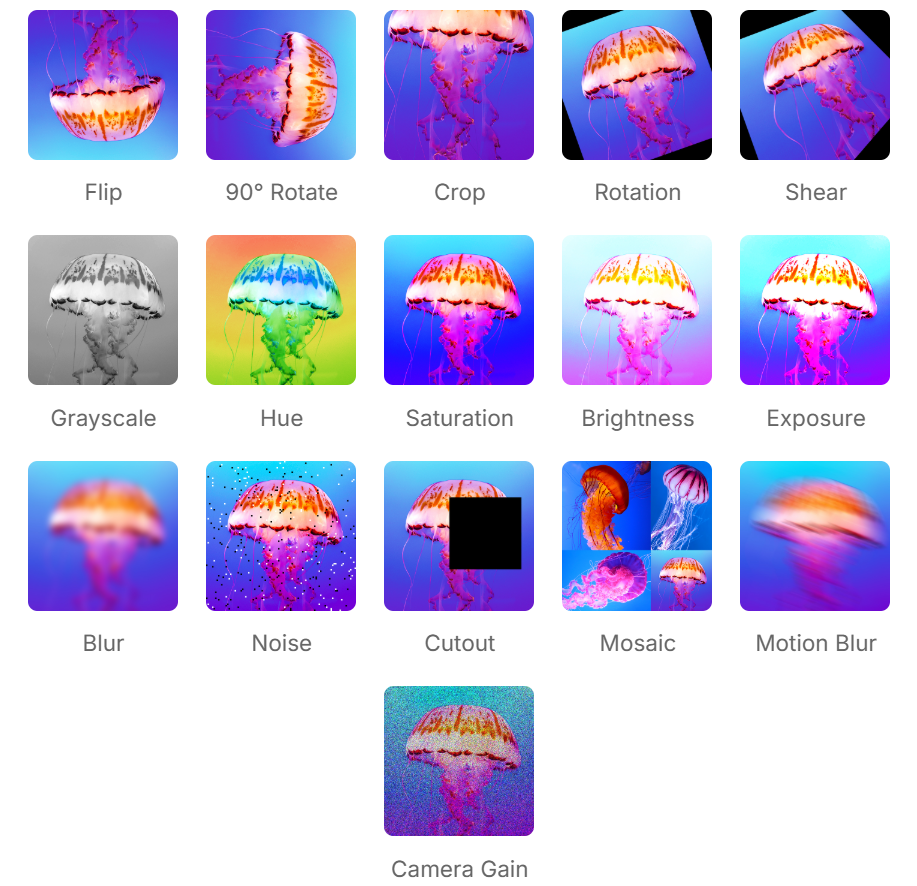

4. L’augmentation, c’est la simulation de l’environnement

Une erreur fréquente dans le développement de modèles est d’appliquer trop d’augmentations sans raison claire. Il est facile d’activer plusieurs options en pensant obtenir un modèle plus robuste, mais cela ajoute souvent du bruit inutile et réduit la performance.

Chaque augmentation doit représenter une condition réelle de votre environnement. Si elle ne reflète pas une variation concrète sur la chaîne, elle risque de troubler le modèle plutôt que de l’améliorer. L’objectif n’est pas de rendre le jeu de données plus complexe, mais de le rendre plus réaliste.

Ajouter des augmentations dans Roboflow se fait dans le même flux de création de version que précédemment, juste après le prétraitement lors de la génération d’une nouvelle version. Voici une explication de quand chaque augmentation mérite d’être incluse — et quand elle ne le mérite pas.

- Rotation : Si les produits peuvent apparaître dans différentes orientations sur un convoyeur, comme des rotations à 90 degrés, alors la rotation doit être incluse. Si le produit apparaît toujours de la même façon, ajouter des images tournées peut introduire des situations non réalistes et diminuer la précision.

- Luminosité et exposition : Les conditions d’éclairage changent souvent au fil de la journée. Par exemple, la lumière du soleil entrant par les fenêtres de l’usine ou la variation de l’éclairage artificiel peuvent affecter la façon dont les objets apparaissent. Simuler ces changements aide le modèle à mieux performer sous différentes conditions d’éclairage.

- Flou : Si la caméra ou l'objet peut subir de légers mouvements, une variation de la mise au point ou des vibrations pendant l'utilisation, une petite quantité d'augmentation par flou peut aider. Mais si la caméra est fixe et que l'image est toujours nette, ajouter du flou peut uniquement diminuer la qualité du modèle.

- Bruit ou Gain de Caméra : Si la caméra de production génère parfois des images granuleuses en raison d'une faible luminosité ou de limites du capteur, ajouter du bruit ou du gain de caméra peut rendre le modèle plus robuste. Si les images réelles sont déjà propres, cela doit être évité.

- Rogner ou Masquer : Ces techniques peuvent être utiles lorsque les objets peuvent être partiellement bloqués, coupés au bord de l'image, ou non toujours entièrement visibles. Si une visibilité totale est attendue dans chaque image de production, ces augmentations peuvent ne pas refléter la réalité.

- Cisaillement ou Variation de Perspective : Ceci est utile uniquement lorsque la vue de la caméra ou l'alignement de l'objet change légèrement en situation réelle. Si la configuration physique est standardisée et que l’angle de la caméra reste fixe, ces augmentations sont généralement inutiles.

- Retournement : Cette technique ne doit être utilisée que si le produit peut apparaître de façon réaliste dans une direction miroir. Si l’orientation gauche-droite a une signification spécifique, le retournement peut générer de faux exemples et tromper le modèle.

Les augmentations aident le modèle à anticiper les variations, mais celles-ci sont basées sur vos attentes. L'apprentissage actif est la manière de traiter ce que vous n'aviez pas prévu.

5. Infrastructure d'apprentissage actif

Dans des environnements de production réels, un modèle ne reste pas précis indéfiniment. Dès qu'une nouvelle référence produit (SKU) apparaît sur la ligne, qu'une lentille se salit ou que l’éclairage change, le modèle peut commencer à rencontrer une dérive des données. C'est pourquoi il ne faut pas considérer le système comme statique après le déploiement. Il doit être conçu pour s'améliorer au fil du temps. Roboflow facilite cela en aidant les équipes à utiliser les données de production pour renforcer continuellement le modèle.

- Boucle d'apprentissage actif : Ne vous arrêtez pas à l’inférence ; surveillez les résultats. Paramétrez un filtre dans Roboflow Workflows pour signaler automatiquement les détections à faible confiance. Un bon point de départ est 50 % de confiance. Toute valeur que le modèle retourne en dessous de ce seuil mérite d'être signalée pour révision. À mesure que votre modèle mûrit et que la confiance de base augmente, vous pouvez relever ce seuil à 60 % ou 70 %. Ce sont ces prédictions incertaines où le modèle vous indique qu’il a besoin de plus de données.

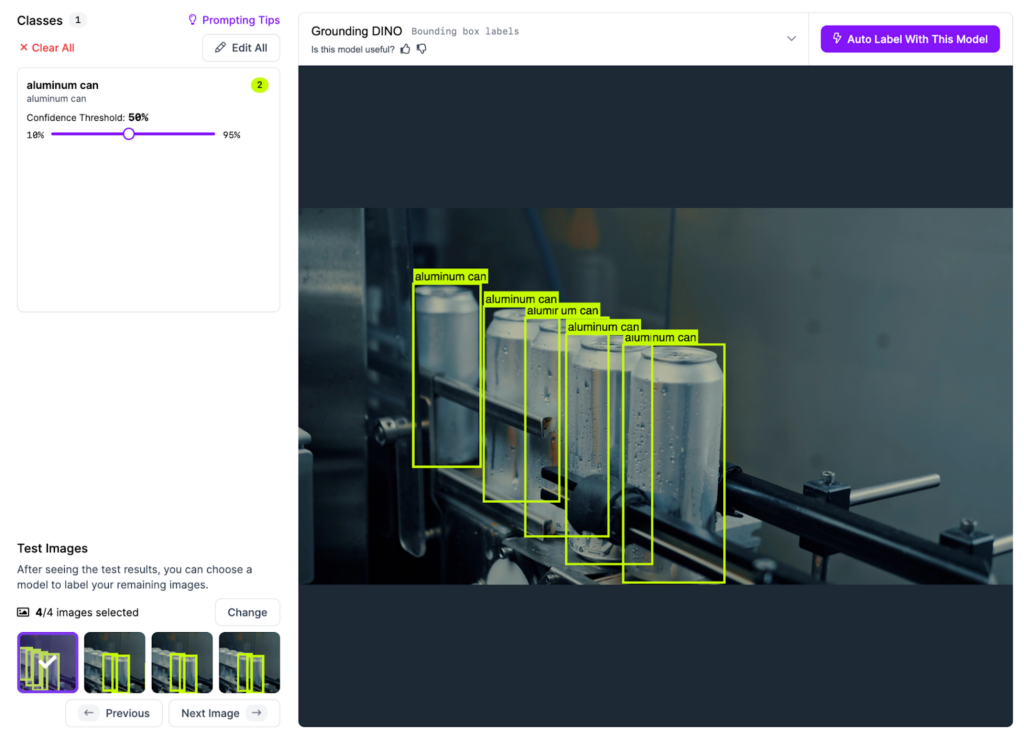

- Étiquetage automatique à grande échelle : Une fois ces images difficiles identifiées, elles peuvent être renvoyées dans le jeu de données Roboflow. Utilisez la fonctionnalité Auto-Label de Roboflow, un modèle de fondation ou votre meilleur modèle actuel pour générer des annotations automatiques. Un réviseur humain peut alors vérifier ces annotations dans l’outil Annotation Roboflow, en acceptant, rejetant ou corrigeant chaque étiquette en moins de 10 secondes par image au lieu de passer plusieurs minutes à dessiner des cadres de délimitation à partir de zéro.

- Réentraînement et validation avant mise en production : Une fois que les images signalées sont annotées et réintégrées dans le jeu de données, générez une nouvelle version du jeu de données dans Roboflow et lancez un nouvel entraînement. Quand le modèle est prêt, ne le déployez pas immédiatement. Utilisez l’évaluation du modèle dans Roboflow pour vérifier si la nouvelle version a réellement progressé. Comparez la précision, le rappel et les scores de confiance avec votre version précédente sur le même jeu de test. Si les résultats vont dans le bon sens, publiez-le. Sinon, les images signalées nécessitent peut-être une nouvelle vérification avant de relancer l’entraînement.

C’est ainsi que la boucle se ferme. Vous ne déployez pas seulement un modèle. Vous mettez en place une infrastructure capable de continuer à apprendre à partir de la réalité du terrain et de devenir plus fiable au fil du temps.

6. Infrastructure de déploiement

Un modèle disposant d’une boucle d'apprentissage actif n'est utile que si l'infrastructure le supportant est adéquate. Une fois que votre système s'améliore en continu, le défi suivant est de veiller à ce qu’il soit déployé de façon cohérente et fiable sur chaque ligne et chaque site où cela est nécessaire.

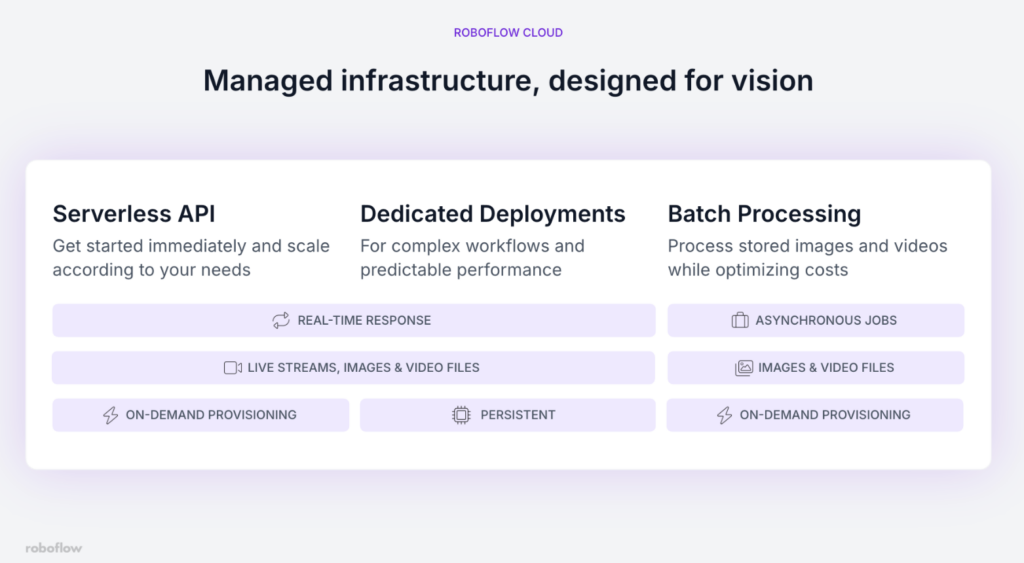

L'architecture de déploiement Roboflow appropriée dépend de la configuration spécifique de votre usine. Voici comment choisir :

- Vous validez encore ou effectuez des contrôles peu fréquents : Commencez avec l’API Serverless. Elle ne nécessite aucune mise en place d’infrastructure, s’adapte automatiquement à la charge et vous permet de démarrer en quelques minutes. Le compromis est qu’elle fonctionne sur un CPU, donc la latence est plus élevée – ce qui importe moins lorsque vous traitez des images à la demande plutôt qu’un flux en continu.

- Vous exploitez des lignes de production en direct nécessitant une inférence cohérente et à faible latence : Utilisez un(e) Déploiement dédié. Vous bénéficiez d’un serveur doté de GPU dédié, de ressources isolées, de performances prévisibles et du support pour des modèles plus complexes. C’est le bon choix lorsque la détection tardive signifie qu’une pièce défectueuse aura déjà franchi le point d’inspection.

- Votre site dispose d’une connexion Internet limitée ou peu fiable : Déployez sur l’appareil grâce à Roboflow Inference sur un appareil Edge tel qu’un NVIDIA Jetson. Le modèle fonctionne localement, l’inférence s’effectue sans connexion Internet et votre chaîne de production continue même en cas de coupure de connexion.

- Vous devez traiter des images stockées ou effectuer des audits sur des enregistrements historiques : Utilisez Traitement par lot. Il gère de grands volumes de données sans complexité de codage et est bien plus rentable qu’un déploiement dédié pour des tâches hors temps réel.

Une fois votre architecture de déploiement choisie, le Device Manager de Roboflow vous permet de déployer les mises à jour du workflow, de surveiller l’état des appareils et de gérer l’ensemble de votre flotte depuis un tableau de bord unique, sans avoir à intervenir sur chaque appareil individuellement.

Maîtrisez le déploiement de l’IA de vision avec Roboflow

Roboflow est conçu pour accompagner le déploiement grâce à des outils permettant de gérer l’intégralité du cycle de vie, de la première image capturée par la caméra jusqu’à l’inférence finale à la périphérie.

Que l’enjeu soit de compter des pièces sur un convoyeur ou de suivre des motifs visuels plus complexes, l’objectif reste identique : transformer des données visuelles en logique exploitable pour soutenir des opérations concrètes.

Le monde physique peut désormais être traité comme programmable. Discutez avec un expert en IA Roboflow pour en savoir plus.