Enterprise ETL-Tools Auswahlliste

Hier ist meine Auswahlliste an Enterprise ETL-Tools:

Enterprise ETL-Tools sind spezialisierte Softwareplattformen, die große Datenmengen aus komplexen Geschäftssystemen extrahieren, transformieren und laden. Wenn Sie nach den besten Enterprise ETL-Tools suchen, verwalten Sie vermutlich wachsende Datenpipelines, integrieren verschiedene Quellen oder unterstützen Analysen im großen Maßstab.

Die Wahl des richtigen Tools kann Ihrem Team helfen, Workflows zu automatisieren, die Datenqualität zu sichern und Compliance-Anforderungen zu erfüllen – und das alles, während Sie mit den sich verändernden Geschäftsanforderungen Schritt halten. In dieser Liste finden Sie einen klaren Vergleich der führenden Enterprise ETL-Lösungen für 2026, sodass Sie selbstbewusst beurteilen können, welche Plattform die technischen und betrieblichen Anforderungen Ihrer Organisation erfüllt.

Why Trust Our Software Reviews

Zusammenfassung der besten Enterprise ETL-Tools

Diese Vergleichstabelle fasst Preisdaten meiner wichtigsten Enterprise ETL-Tools zusammen, um Ihnen dabei zu helfen, das passende für Ihr Budget und Ihre geschäftlichen Anforderungen zu finden.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Am besten geeignet für schnelle Extraktion von SaaS-Daten | 14-tägige kostenlose Testphase verfügbar | Ab $100/Monat | Website | |

| 2 | Am besten für Open-Source-Erweiterbarkeit | 14-tägige kostenlose Testversion verfügbar | Preise auf Anfrage | Website | |

| 3 | Am besten geeignet für serverlose Datenumwandlung | Kostenloser Tarif verfügbar | Ab $0.44/DPU-Stunde | Website | |

| 4 | Am besten für hybride Cloud-Konnektivität | Kostenloser Tarif verfügbar | Ab $1/1.000 Pipeline-Ausführungen | Website | |

| 5 | Am besten geeignet für native Integration ins Oracle-Ökosystem | Kostenlose Demo verfügbar | Preis auf Anfrage | Website | |

| 6 | Am besten für automatisierte Schema-Migration | 14-tägige kostenlose Testversion verfügbar | Ab $5/Monat | Website | |

| 7 | Am besten geeignet für groß angelegte Datenverwaltung | 30-tägige kostenlose Testversion und kostenlose Demo verfügbar | Preise auf Anfrage | Website | |

| 8 | Am besten geeignet für die visuelle Datenorchestrierung | 30-tägige kostenlose Testversion + kostenlose Demo verfügbar | Preise auf Anfrage | Website | |

| 9 | Am besten geeignet für KI-gestütztes Pipeline-Design | Kostenlose Demo verfügbar | Preise auf Anfrage | Website | |

| 10 | Am besten für die Echtzeit-Stream-Verarbeitung | Kostenloser Tarif verfügbar | Ab $0,069/vCPU-Stunde (Streaming) | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Enterprise ETL-Tool-Reviews

Im Folgenden finden Sie meine ausführlichen Zusammenfassungen der Enterprise ETL-Tools, die es auf meine Auswahlliste geschafft haben. Meine Bewertungen bieten einen detaillierten Einblick in die Funktionen, Integrationen und besten Anwendungsfälle jeder Plattform, um Ihnen die Wahl des passenden Tools für Ihr Unternehmen zu erleichtern.

Stitch ist ein cloudbasiertes Datenintegrations-Tool, das sich darauf konzentriert, Daten schnell aus SaaS-Plattformen zu extrahieren und in Data Warehouses zu laden. Es eignet sich besonders für Teams, die eine schnelle und zuverlässige Datenaufnahme wünschen, ohne eigene Pipelines entwickeln und warten zu müssen. Stitch ist vor allem für Unternehmen nützlich, die Daten aus verschiedenen Geschäftsanwendungen für Analysen und Berichte zentralisieren möchten.

Warum Stitch eine gute Mixpanel-Alternative ist

Für Teams, die schnelle und zuverlässige Datenaufnahme priorisieren, bietet Stitch einen unkomplizierten Ansatz zur Extraktion und zum Laden von Daten aus SaaS-Anwendungen. Ich habe Stitch ausgewählt, weil es den Prozess der Datenverschiebung in Cloud-Data-Warehouses vereinfacht, sodass sich Teams auf die Analyse statt auf die Pipeline-Wartung konzentrieren können.

Die Plattform verwendet einen ELT-Ansatz, was bedeutet, dass Daten zuerst ins Warehouse geladen und anschließend mit den bevorzugten Tools transformiert werden. Das macht sie besonders geeignet für Unternehmen, die bereits auf moderne Data Stacks setzen und Flexibilität bei der Datenmodellierung und -analyse downstream wünschen.

Wichtige Stitch-Funktionen

Weitere nützliche Funktionen von Stitch für Enterprise-ETL-Workflows sind:

- Vorgefertigte Konnektoren: Zugang zu einer breiten Palette von Konnektoren für SaaS-Anwendungen, Datenbanken und Cloud-Dienste

- Automatisierte Datenreplikation: Planung und Synchronisation von Daten aus mehreren Quellen ohne manuellen Aufwand

- Inkrementelles Laden von Daten: Es werden nur aktualisierte Datensätze synchronisiert, um Ladezeiten und Ressourcenverbrauch zu minimieren

- Warehouse-First-Architektur: Laden von Rohdaten ins Data Warehouse für flexible Transformation downstream

Stitch-Integrationen

Zu den Integrationen zählen Salesforce, HubSpot, Google Analytics, Shopify, Stripe, Facebook Ads, Zendesk, Marketo, Snowflake und Amazon Redshift.

Pros and Cons

Pros:

- Schnelle Einrichtung für SaaS-Datenaufnahme

- Große Auswahl an vorgefertigten Konnektoren

- Automatisierte Replikation reduziert manuellen Aufwand bei der Pipeline-Verwaltung

Cons:

- Keine integrierten Möglichkeiten zur Datentransformation

- Eingeschränkte Unterstützung für lokale Datenquellen

Talend bietet einen Open-Source-Ansatz für Enterprise-ETL und ist damit besonders geeignet für Teams, die Flexibilität und Anpassungsfähigkeit in ihren Datenintegrations-Workflows wünschen. IT-Spezialisten und Dateningenieure, die unterschiedlichste Systeme verbinden oder individuell zugeschnittene Pipelines erstellen müssen, greifen oft aufgrund der Erweiterbarkeit und der umfangreichen Connector-Bibliothek zu Talend. Das modulare Design ermöglicht es Unternehmen, sich schnell an veränderte Datenanforderungen und Compliance-Standards anzupassen.

Warum ich Talend gewählt habe

Ich habe Talend aufgrund seiner Open-Source-Erweiterbarkeit ausgewählt, die besonders für Organisationen heraussticht, die ETL-Prozesse individuell anpassen und skalieren müssen. Die komponentenbasierte Architektur von Talend ermöglicht das Erstellen und Modifizieren von Konnektoren oder Transformationen für spezielle Unternehmensdatenumgebungen. Ich schätze, wie die Plattform Scripting und benutzerdefinierten Code unterstützt, sodass Teams komplexe Datenlogik oder Compliance-Anforderungen abdecken können. Die Open-Source-Basis fördert zudem Zusammenarbeit und eine schnelle Anpassung an sich verändernde Geschäftsanforderungen.

Wichtige Funktionen von Talend

Weitere nützliche Funktionen von Talend für Enterprise-ETL-Projekte sind unter anderem:

- Datenqualitäts-Tools: Integrierte Profilierungs-, Bereinigungs- und Anreicherungs-Tools sorgen für hohe Datenstandards in Ihren Pipelines.

- Job-Scheduling: Planen und automatisieren Sie ETL-Jobs direkt in der Plattform, um regelmäßige Datenaktualisierungen zu unterstützen.

- Metadaten-Management: Zentralisiertes Metadaten-Repository ermöglicht die Nachverfolgung von Datenherkunft und das Verwalten von Schemaänderungen.

- Cloud- und On-Premises-Bereitstellung: Flexible Bereitstellungsoptionen erlauben den Betrieb von Talend in Cloud-Umgebungen, vor Ort oder in hybriden Szenarien.

Talend-Integrationen

Zu den Integrationen gehören AWS, Google Cloud, Microsoft Azure, Snowflake, SAP, Databricks, Cloudera, Oracle, Salesforce und Adobe.

Pros and Cons

Pros:

- Open-Source-Flexibilität ermöglicht individuelle Datenworkflows

- Leistungsstarke Datenqualitäts-Tools verbessern die Datenzuverlässigkeit

- Umfangreiche Connector-Bibliothek unterstützt verschiedene Datenquellen

Cons:

- Die Benutzeroberfläche wirkt für moderne Teams veraltet

- Fortgeschrittene Funktionen erfordern hohe technische Fachkenntnisse

AWS Glue ist für Teams konzipiert, die Datenumwandlung automatisieren und skalieren möchten, ohne Server verwalten zu müssen. Es eignet sich besonders für Organisationen, die bereits stark in AWS investiert sind oder große und komplexe Datenpipelines über Cloud-Umgebungen hinweg betreiben. Mit seiner serverlosen Architektur ermöglicht AWS Glue Dateningenieuren, sich auf die Entwicklung und Orchestrierung von ETL-Workflows zu konzentrieren, anstatt auf das Infrastrukturmanagement.

Warum ich AWS Glue ausgewählt habe

Für Teams, die die Verwaltung von Infrastruktur vermeiden möchten, sticht AWS Glue mit seinem vollständig serverlosen Ansatz für die Datenumwandlung hervor. Die Plattform stellt die benötigten Rechenressourcen für ETL-Jobs automatisch bereit, skaliert und verwaltet sie, sodass Sie sich keine Gedanken über Kapazitätsplanung oder Serverwartung machen müssen.

Ich habe AWS Glue ausgewählt, weil es sowohl codebasierte als auch visuelle ETL-Entwicklung unterstützt. Sie können also wählen, ob Sie in Python/Scala programmieren oder eine Drag-and-Drop-Oberfläche verwenden. Diese Flexibilität, kombiniert mit automatisierter Job-Planung und Abhängigkeitsmanagement, macht es zu einer starken Wahl für ETL-Workflows im Unternehmensmaßstab.

Hauptfunktionen von AWS Glue

Weitere Merkmale, die AWS Glue für ETL-Teams in Unternehmen attraktiv machen, sind:

- Data Catalog Integration: Pflegen Sie ein zentrales Metadaten-Repository für all Ihre Datenbestände über AWS-Dienste hinweg.

- Automatische Schemenerkennung: Erkennen und katalogisieren Sie neue Datenquellen und -strukturen ohne manuelles Eingreifen.

- Integriertes Job-Monitoring: Verfolgen Sie ETL-Job-Status, Protokolle und Leistungsmetriken direkt aus der AWS-Konsole.

- Unterstützung für Streaming-ETL: Verarbeiten und transformieren Sie Streaming-Daten nahezu in Echtzeit mithilfe von Glue Streaming-Jobs.

AWS Glue Integrationen

Zu den Integrationen gehören Amazon S3, Amazon Redshift, Amazon RDS, Amazon Aurora, Amazon DynamoDB, Amazon Athena, Amazon EMR, Amazon SageMaker, AWS Lake Formation und Apache Hudi.

Pros and Cons

Pros:

- Serverlose Architektur beseitigt Infrastrukturmanagement

- Native Integration mit AWS-Datendiensten

- Automatische Schemenerkennung für neue Datenquellen

Cons:

- Eingeschränkte Unterstützung für nicht-AWS-Datenquellen

- Das Debugging komplexer ETL-Jobs kann schwierig sein

Azure Data Factory ist für Organisationen entwickelt, die Daten in lokalen Umgebungen und in der Cloud verbinden, transformieren und verschieben müssen. Es eignet sich besonders für IT-Teams, die hybride Infrastrukturen verwalten oder Datenintegration über mehrere Clouds hinweg unterstützen. Die verwalteten Konnektoren der Plattform und das flexible Pipeline-Design helfen dabei, komplexe Anforderungen an Datenbewegung und Compliance in Unternehmensumgebungen zu erfüllen.

Warum ich Azure Data Factory ausgewählt habe

Die hybride Cloud-Konnektivität stellt für viele unternehmensweite ETL-Teams eine große Herausforderung dar – Azure Data Factory begegnet dieser durch die umfassende Unterstützung sowohl lokaler als auch Cloud-Datenquellen. Ich habe Azure Data Factory gewählt, weil es verwaltete Integrations-Runtimes bietet, die eine sichere Datenbewegung zwischen privaten Netzwerken und öffentlichen Clouds gewährleisten.

Die integrierten Konnektoren des Tools decken eine Vielzahl von Unternehmenssystemen ab und erleichtern so die Orchestrierung komplexer Datenflüsse in hybriden Umgebungen. Dieser Ansatz unterstützt IT-Teams dabei, Compliance und Kontrolle zu bewahren, während sie ihre Dateninfrastruktur modernisieren.

Azure Data Factory – Zentrale Funktionen

Neben den Stärken in der hybriden Konnektivität habe ich noch weitere bemerkenswerte Funktionen entdeckt:

- Visueller Pipeline-Designer: Erstellen und verwalten Sie ETL-Arbeitsabläufe mithilfe einer Drag-and-drop-Oberfläche.

- Debugging von Datenflüssen: Testen und prüfen Sie Datenflüsse interaktiv vor dem Deployment.

- Unterstützung von Parametrisierung: Nutzen Sie Pipeline-Vorlagen mit dynamischen Parametern für flexible Einsätze erneut.

- Integration mit Azure Monitor: Überwachen Sie Pipeline-Aktivitäten und Leistung über native Monitoring-Tools.

Azure Data Factory – Integrationen

Integrationen umfassen Azure Synapse Analytics, Azure Databricks, Azure SQL Database, Azure Cosmos DB, Amazon Redshift, Google BigQuery, Oracle Exadata, Teradata, Salesforce und ServiceNow.

Pros and Cons

Pros:

- Unterstützt lokale und Multi-Cloud-Datenquellen

- Visueller Pipeline-Designer für die Workflow-Erstellung

- Integrierte Konnektoren für wichtige Unternehmensplattformen

Cons:

- Monitoring-Dashboards bieten keine erweiterte Anpassung

- Preismodell kann schwer kalkulierbar sein

Am besten geeignet für native Integration ins Oracle-Ökosystem

Oracle Data Integrator ist speziell für Unternehmen entwickelt, die in ihrer IT-Landschaft stark auf Oracle-Datenbanken und -Anwendungen setzen. Datenarchitekten und IT-Teams, die in Oracle-lastigen Umgebungen arbeiten, nutzen es, um komplexe Datenflüsse und -transformationen mit enger Integration in Oracle-Technologien zu orchestrieren. Die native Unterstützung für Oracle-Plattformen trägt dazu bei, Kompatibilitätsprobleme zu minimieren und die Leistung für ETL-Workloads im Enterprise-Maßstab zu optimieren.

Warum ich Oracle Data Integrator ausgewählt habe

Für Teams, die stark in Oracle-Infrastrukturen investiert sind, bietet Oracle Data Integrator eine native Integration, die nur schwer zu übertreffen ist. Die ELT-Architektur ist für Oracle-Datenbanken optimiert und ermöglicht es, komplexe Transformationen direkt auf die Datenbank-Engine auszulagern, um Leistung und Skalierbarkeit zu verbessern.

Ich habe dieses Tool ausgewählt, weil es Oracles Sicherheitsfunktionen, Metadatenverwaltung und Workflow-Orchestrierungsfunktionen nutzt, die für Unternehmensdatenumgebungen unerlässlich sind. Diese enge Abstimmung mit dem Oracle-Ökosystem verringert Reibungsverluste und sorgt für reibungslosere Abläufe in Unternehmen, die auf Oracle-Technologien standardisieren.

Oracle Data Integrator Hauptfunktionen

Weitere nützliche Funktionen für ETL-Teams im Unternehmen umfassen:

- Deklarativer Designansatz: Definition von Datenintegrationsprozessen über eine visuelle, modellbasierte Oberfläche.

- Knowledge Modules: Wiederverwendbare Vorlagen ermöglichen die Standardisierung und Automatisierung gängiger Datenintegrationsaufgaben.

- Change Data Capture (CDC): Erfassen und Verarbeiten nur geänderter Daten zur Optimierung der ETL-Leistung.

- Umfangreiche Konnektivität: Verbindung zu einer Vielzahl von Datenbanken, Anwendungen und Big-Data-Plattformen auch außerhalb von Oracle.

Oracle Data Integrator Integrationen

Integrationen umfassen Workday, Salesforce, SAP, Shopify, Snowflake und mehr.

Pros and Cons

Pros:

- Optimierte Leistung in Oracle-Umgebungen

- Unterstützt komplexe Transformationslogik im großen Maßstab

- Metadatenbasierte Gestaltung erhöht die Konsistenz

Cons:

- Begrenzte Flexibilität außerhalb des Oracle-Ökosystems

- Hohe Lernkurve für neue Anwender

Fivetran ist eine vollständig verwaltete Datenintegrationsplattform, die darauf ausgelegt ist, den Datenfluss von Quellsystemen in Cloud Data Warehouses zu automatisieren. Sie richtet sich an Teams, die zuverlässige, wartungsfreie Pipelines wünschen, ohne Infrastruktur überwachen oder pflegen zu müssen. Fivetran ist besonders nützlich für Organisationen, die ihre Datenoperationen skalieren und den Aufwand für die IT reduzieren möchten.

Warum Fivetran eine gute Wahl ist

Für Teams, die Wartung an Daten-Pipelines vermeiden wollen, hebt sich Fivetran durch den vollständig verwalteten Ansatz hervor. Ich habe Fivetran ausgewählt, weil es alles vom Connector-Setup über Schemaänderungen bis zu zuverlässigen Pipelines steuert, ohne laufende manuelle Eingriffe zu benötigen.

Die Plattform synchronisiert Daten kontinuierlich und passt sich automatisch an Schemaänderungen in Quellsystemen an, wodurch das Risiko unterbrochener Pipelines sinkt. Das ist ideal für Datenteams, die zuverlässige Pipelines im großen Maßstab benötigen und Ressourcen für Analyse und Modellierung freisetzen wollen.

Fivetran Hauptfunktionen

Weitere für den ETL-Einsatz im Unternehmen nützliche Funktionen von Fivetran sind:

- Verwaltete Connectoren: Zugriff auf eine große Bibliothek von Connectoren, die automatisch gepflegt und aktualisiert werden

- Automatische Schema-Evolution: Anpassung an Quellschema-Änderungen ohne manuelles Neu-Mapping

- Inkrementelle Datensynchronisierung: Es werden nur neue oder geänderte Daten effizient erfasst und geladen

- Pipeline-Überwachung: Überwachung von Synchronisierungsstatus und Performance über ein zentrales Dashboard

Fivetran Integrationen

Zu den Integrationen zählen Salesforce, NetSuite, Google Analytics, Amazon Redshift, Snowflake, Microsoft Azure Synapse Analytics, PostgreSQL, MySQL, Oracle und HubSpot.

Pros and Cons

Pros:

- Vollständig verwaltete Pipelines reduzieren Wartungsaufwand

- Automatische Schema-Updates verhindern Pipeline-Ausfälle

- Umfassende Connector-Abdeckung für SaaS und Datenbanken

Cons:

- Begrenzte Transformationsmöglichkeiten innerhalb der Plattform

- Weniger Flexibilität für kundenspezifische Pipeline-Logik

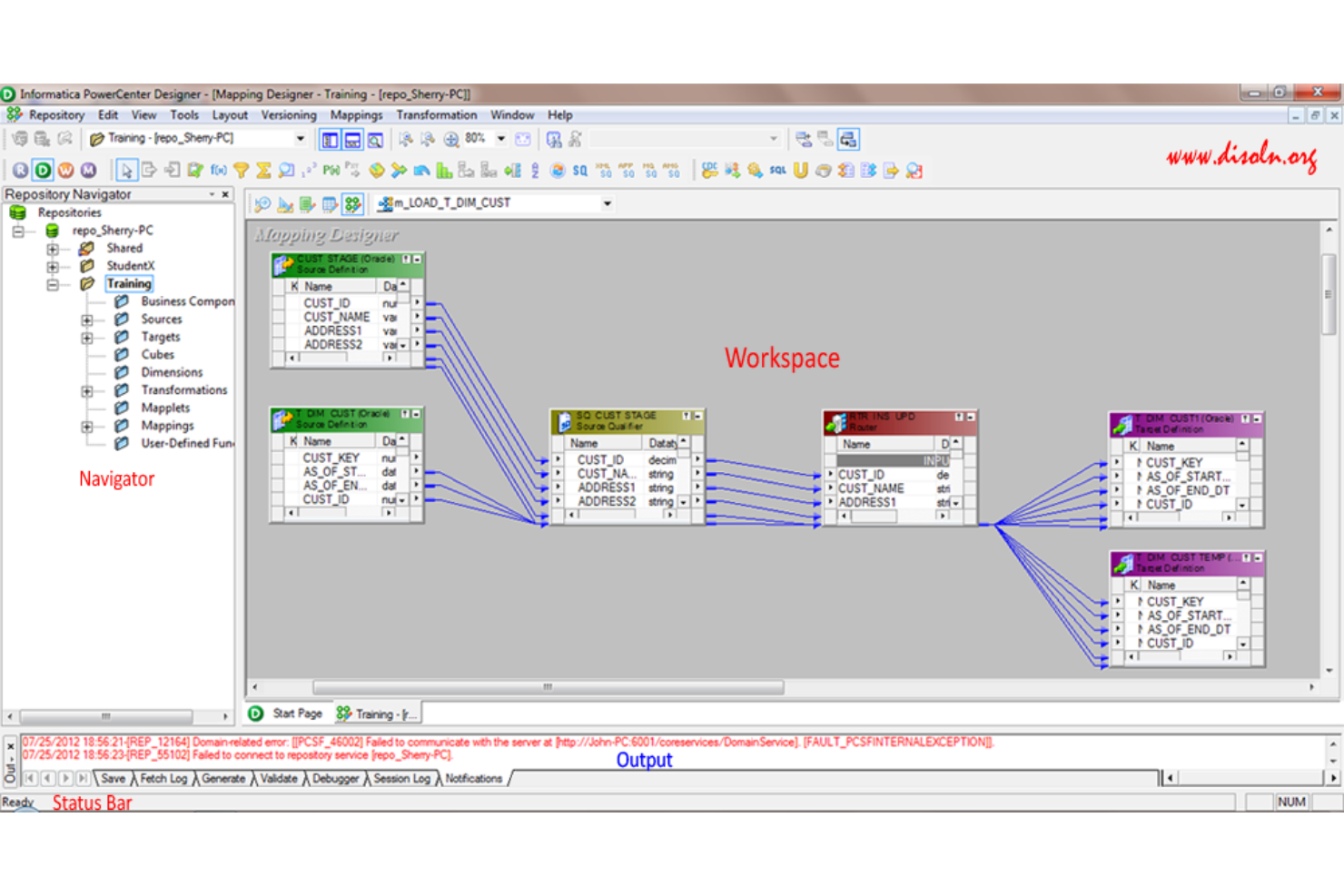

Informatica PowerCenter wurde für Organisationen entwickelt, die eine strenge Datenverwaltung in großem Maßstab benötigen. Es eignet sich besonders für Unternehmen in regulierten Branchen oder solche, die sensible, hochvolumige Daten in komplexen Umgebungen verwalten. Mit seinem Fokus auf Metadatenmanagement und vollständige Datenherkunft unterstützt PowerCenter Sie dabei, Kontrolle und Compliance während der gesamten ETL-Prozesse aufrechtzuerhalten.

Warum ich Informatica PowerCenter ausgewählt habe

Für ETL-Teams in Unternehmen, die eine priorisierte Datenverwaltung im großen Maßstab benötigen, zeichnet sich Informatica PowerCenter durch seinen starken Fokus auf Datenqualität und Compliance aus. Die metadatenbasierte Architektur der Plattform bietet Ihnen eine detaillierte Sicht auf die Datenherkunft, was die Nachverfolgung, Prüfung und Verwaltung sensibler Informationen in Ihrem Unternehmen erleichtert.

Ich habe PowerCenter ausgewählt, weil seine integrierten Data-Governance-Tools – wie automatisiertes Datenprofiling und Richtliniendurchsetzung – Unternehmen dabei helfen, regulatorische Anforderungen und interne Standards zu erfüllen. Diese Funktionen machen es zu einer starken Wahl für Betriebe, in denen Datenvertrauen und Verantwortlichkeit unverzichtbar sind.

Schlüsselfunktionen von Informatica PowerCenter

Weitere Funktionen, die Informatica PowerCenter für das unternehmerische ETL wertvoll machen, sind:

- Parallele Verarbeitung: Große Datenumwandlungen und -ladungen mit hoher Durchsatzrate ausführen.

- Umfassende Konnektivitätsbibliothek: Zugriff auf eine große Bandbreite an Connectoren für Datenbanken, Cloud-Plattformen und Unternehmensanwendungen.

- Workflow-Orchestrierung: Entwerfen, planen und überwachen Sie komplexe ETL-Workflows über eine zentrale Oberfläche.

- Fehlerbehandlung und Wiederherstellung: Konfigurieren Sie automatisierte Fehlererkennung, Protokollierung und Neustartfunktionen für widerstandsfähige Datenpipelines.

Informatica PowerCenter Integrationen

Zu den Integrationen gehören Salesforce, SAP, Oracle, Microsoft SQL Server, Amazon Redshift, Google BigQuery, Workday, NetSuite, Snowflake und IBM Db2.

Pros and Cons

Pros:

- Granulare Datenherkunft unterstützt regulatorische Compliance

- Integriertes Datenprofiling für Qualitätssicherung

- Skalierbare Architektur verarbeitet Arbeitslasten mit hohem Volumen

Cons:

- Upgrade-Prozesse können Produktionsumgebungen stören

- Ressourcenintensive Bereitstellungen erfordern erfahrene Administratoren

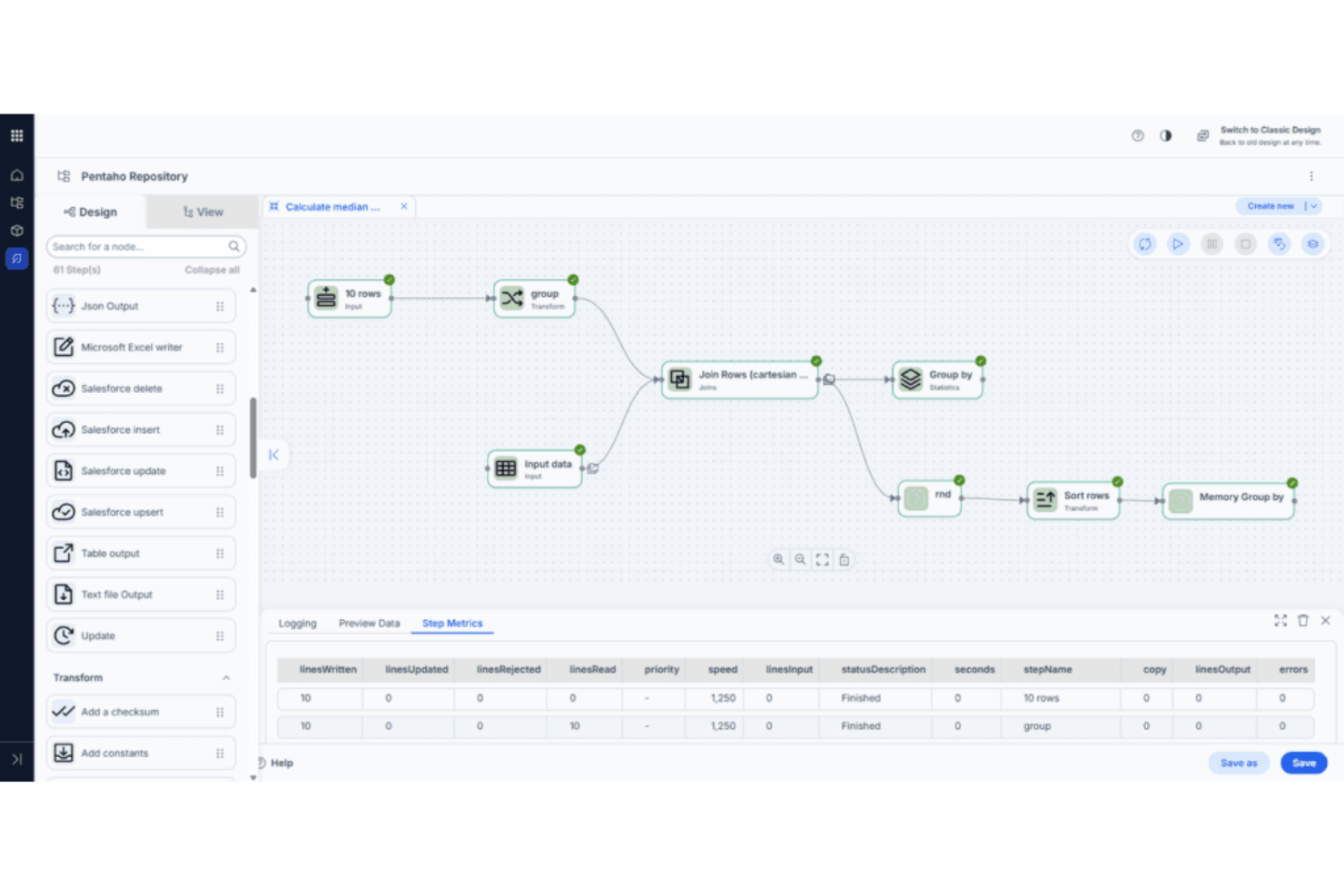

Pentaho Data Integration zeichnet sich für Teams aus, die komplexe Daten-Workflows visuell entwerfen, orchestrieren und verwalten möchten. Es ist besonders geeignet für IT-Abteilungen und Dateningenieure, die Datenbewegungen zwischen verschiedenen Quellen ohne umfangreiche Programmierung koordinieren müssen. Die Drag-and-Drop-Oberfläche und die breite Konnektivität helfen Unternehmen, die Datenvorbereitung und Integration im großen Maßstab zu optimieren.

Warum ich Pentaho Data Integration ausgewählt habe

Für Organisationen, die komplexe Datenflüsse visuell orchestrieren müssen, bietet Pentaho Data Integration eine einzigartige Drag-and-Drop-Oberfläche zum Erstellen und Verwalten von ETL-Pipelines. Ich habe Pentaho gewählt, weil der grafische Workflow-Designer es Teams ermöglicht, Daten-Transformationen, Joins und Aggregationen ohne Programmieraufwand zu entwerfen.

Das Tool unterstützt außerdem die Planung von Jobs und die Automatisierung von Workflows, wodurch mehrstufige Prozesse in unterschiedlichen Datenumgebungen koordiniert werden können. Dieser visuelle Ansatz erleichtert es IT-Teams, unternehmensweite ETL-Prozesse zu dokumentieren, zu pflegen und zu skalieren.

Wichtige Funktionen von Pentaho Data Integration

Weitere Funktionen, die Pentaho Data Integration für ETL-Teams in Unternehmen wertvoll machen, sind:

- Umfangreiche Konnektivitätsoptionen: Verbindung mit einer Vielzahl von Datenbanken, Flachdateien, Cloud-Diensten und Big-Data-Plattformen.

- Metadata Injection: Dynamisches Generieren und Modifizieren von ETL-Jobs zur Laufzeit mit metadatenbasierten Vorlagen.

- Integrierte Werkzeuge zur Datenqualität: Daten profilieren, bereinigen und validieren als Teil des ETL-Prozesses.

- Cluster- und Parallel-Ausführung: Transformationen und Jobs können auf mehrere Knoten verteilt ausgeführt werden, um Leistung und Skalierbarkeit zu verbessern.

Pentaho Data Integration Integrationen

Zu den Integrationen gehören SAP, Salesforce, ElasticSearch, Kafka, Google Analytics, Azure Event Hub, Microsoft Dynamics, SharePoint, Zendesk und Jira.

Pros and Cons

Pros:

- Visueller Workflow-Builder unterstützt komplexe Orchestrierung

- Umfangreiche Unterstützung für Big Data und Cloud-Quellen

- Metadata Injection ermöglicht dynamische Job-Erstellung

Cons:

- Die Benutzeroberfläche wirkt für Teams teilweise veraltet

- Dokumentation ist bei fortgeschrittenen Szenarien nicht ausreichend detailliert

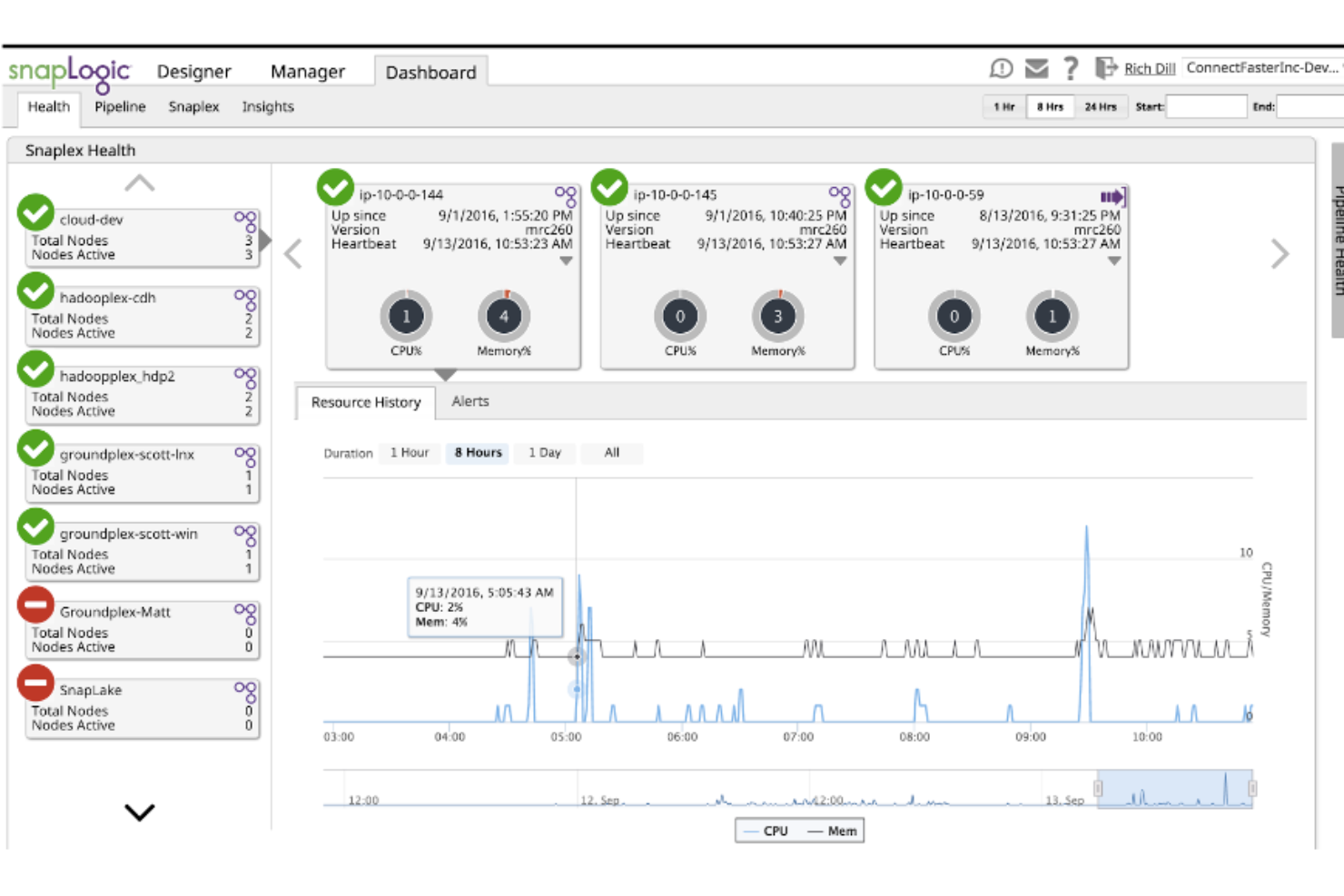

SnapLogic bringt KI-gestütztes Pipeline-Design in Teams, die komplexe ETL-Workflows beschleunigen und vereinfachen müssen. Besonders nützlich ist es für IT- und Data-Engineering-Teams in großen Unternehmen, die eine Datenintegration über Cloud, On-Premises und hybride Umgebungen hinweg automatisieren wollen. Mit seiner visuellen Benutzeroberfläche und intelligenten Empfehlungen hilft SnapLogic dabei, Datenpipelines mit weniger manuellem Aufwand zu erstellen, zu verwalten und zu optimieren.

Warum ich SnapLogic ausgewählt habe

Was mich an SnapLogic für Enterprise-ETL überzeugt hat, ist der Fokus auf das KI-gesteuerte Pipeline-Design, das die Komplexität beim Aufbau und der Wartung großskaliger Daten-Workflows adressiert. Die Iris-KI-Engine der Plattform schlägt Pipeline-Komponenten vor und automatisiert wiederkehrende Aufgaben, so dass Teams die Entwicklung beschleunigen und manuelle Fehler reduzieren können.

Ich schätze, wie der visuelle Designer von SnapLogic es ermöglicht, Datenflüsse mit Drag-and-drop-Werkzeugen zuzuordnen, zu transformieren und zu orchestrieren, und so die Verwaltung komplexer Integrationen erleichtert. Diese Funktionen machen SnapLogic zur idealen Lösung für Unternehmen, die ihre ETL-Prozesse mit intelligenter Automatisierung modernisieren möchten.

SnapLogic Hauptfunktionen

Weitere Funktionen, die SnapLogic für Enterprise-ETL-Teams wertvoll machen:

- Vorgefertigte Snap Packs: Wählen Sie aus einer großen Auswahl an Konnektoren für beliebte Unternehmensanwendungen und Datenquellen.

- Pipeline-Versionskontrolle: Verfolgen, vergleichen und setzen Sie Änderungen an Ihren Datenpipelines bei Bedarf zurück.

- Integrierte Datenqualitäts-Tools: Validieren, bereinigen und bereichern Sie Ihre Daten direkt in den ETL-Workflows.

- Rollenbasierte Zugriffsverwaltung: Weisen Sie Benutzern und Gruppen granulare Berechtigungen für eine sichere Zusammenarbeit zu.

SnapLogic-Integrationen

Zu den Integrationen zählen Salesforce, Workday, SAP, Oracle, Microsoft Dynamics 365, ServiceNow, Snowflake, Google BigQuery, Amazon Redshift und Slack.

Pros and Cons

Pros:

- KI-basierte Vorschläge beschleunigen die Pipeline-Entwicklung

- Visueller Pipeline-Builder unterstützt komplexe Datenflüsse

- Umfangreiche Snap-Pack-Bibliothek deckt wichtige Plattformen ab

Cons:

- Dokumentation bietet manchmal keine fortgeschrittenen Anwendungsfälle

- Optionen zur Performance-Optimierung nicht immer transparent

Google Cloud Dataflow ist für Teams konzipiert, die Datenströme in Echtzeit verarbeiten und analysieren müssen. Besonders nützlich ist es für IT-Spezialist:innen und Dateningenieur:innen in Branchen, in denen sofortige Erkenntnisse aus groß angelegten Daten erforderlich sind. Das einheitliche Modell der Plattform für Batch- und Streaming-Daten ermöglicht es Ihnen, ETL-Pipelines zu erstellen, die sowohl historische als auch Live-Daten mit minimalem Betriebsaufwand verarbeiten.

Warum ich Google Cloud Dataflow ausgewählt habe

Wenn die Echtzeit-Verarbeitung von Datenströmen höchste Priorität hat, überzeugt Google Cloud Dataflow durch seine Fähigkeit, sowohl Streaming- als auch Batch-Daten in einer einzigen Pipeline zu verarbeiten. Ich habe Dataflow ausgewählt, weil es das einheitliche Programmiermodell von Apache Beam verwendet. Damit können Teams ETL-Logik einmal schreiben und für Live- sowie historische Daten verwenden.

Die Autoskalierung und serverlose Architektur der Plattform ermöglichen die Verarbeitung schnelllebiger Datenströme, ohne dass Sie Infrastruktur verwalten müssen. Das macht sie zu einer starken Wahl für IT-Teams, die Analysen in Echtzeit und ereignisgesteuerte Workflows im Unternehmensmaßstab liefern müssen.

Google Cloud Dataflow – zentrale Funktionen

Weitere Funktionen, die Google Cloud Dataflow für ETL-Teams im Unternehmen wertvoll machen, sind:

- Data Loss Prevention Integration: Schutz sensibler Daten während der Übertragung mit integrierten DLP-Connectors.

- Flexible Zeitfenster und Trigger: Definieren Sie individuelle Zeitfenster und Ereignis-Trigger für präzise Datenaggregation.

- Native Unterstützung von Google Cloud Storage: Direktes Lesen und Schreiben in Google Cloud Storage Buckets innerhalb der Pipeline.

- Monitoring mit Cloud Dataflow-Metriken: Überwachung von Job-Status, Durchsatz und Latenz mit integrierten Monitoring-Dashboards.

Google Cloud Dataflow-Integrationen

Integrationen umfassen BigQuery, Google Cloud Storage, Pub/Sub, Spanner, Bigtable, Cloud SQL, Datadog, Splunk, Vertex AI und Managed Service for Apache Kafka.

Pros and Cons

Pros:

- Autoskalierung passt Ressourcen an Arbeitsspitzen an

- Unterstützung für Pipeline mit Batch- und Streaming-Daten

- Native Integration in das Google Cloud-Ökosystem

Cons:

- Begrenzte Unterstützung für nicht-Google-Cloud-Plattformen

- Das Debuggen komplexer Pipelines kann herausfordernd sein

Auswahlkriterien für Enterprise ETL-Tools

Bei der Auswahl der besten Enterprise ETL-Tools für diese Liste habe ich typische Käuferbedürfnisse und Herausforderungen wie das Management komplexer Datenpipelines über hybride Umgebungen hinweg und die Gewährleistung sicherer, skalierbarer Datenintegration berücksichtigt. Zudem habe ich das folgende Rahmenwerk genutzt, um meine Bewertung strukturiert und objektiv zu halten:

Kernfunktionen (25% der Gesamtbewertung)

Um in diese Liste aufgenommen zu werden, musste jede Lösung die folgenden gängigen Anwendungsfälle erfüllen:

- Daten aus mehreren Quellen extrahieren

- Daten mit konfigurierbaren Workflows transformieren

- Daten in Zielsysteme laden

- ETL-Jobs planen und automatisieren

- ETL-Prozesse überwachen und protokollieren

Zusätzliche besondere Funktionen (25% der Gesamtbewertung)

Um die Auswahl weiter einzuschränken, habe ich auch nach einzigartigen Merkmalen gesucht wie:

- Unterstützung für hybride Cloud- und On-Premises-Integration

- Integrierte Tools zur Datenqualität und -validierung

- Erweiterte Datenherkunft und Auswirkungen-Analyse

- Echtzeit- oder Streaming-Datenverarbeitung

- Nativ integrierte Konnektoren für branchenspezifische Plattformen

Benutzerfreundlichkeit (10% der Gesamtbewertung)

Um einen Eindruck von der Benutzerfreundlichkeit jedes Systems zu erhalten, habe ich Folgendes betrachtet:

- Intuitives Drag-and-Drop-Workflow-Design

- Übersichtliches und organisiertes Dashboard-Layout

- Anpassbare Benutzerrollen und Berechtigungen

- Reaktionsfähige Oberfläche für große Datenmengen

- Zugängliche Dokumentation und Hilfestellungen innerhalb der Anwendung

Onboarding (10% der Gesamtbewertung)

Um die Onboarding-Erfahrung jeder Plattform zu bewerten, habe ich Folgendes berücksichtigt:

- Verfügbarkeit von Schritt-für-Schritt-Anleitungen

- Zugang zu vorgefertigten Pipeline-Vorlagen

- Interaktive Produkttouren für neue Nutzer

- Umfassende Trainingsvideos und Webinare

- Unterstützung bei der Migration und Onboarding-Checklisten

Kundensupport (10% der Gesamtbewertung)

Um die Kundensupport-Dienste jedes Softwareanbieters zu bewerten, habe ich Folgendes berücksichtigt:

- 24/7 Support-Verfügbarkeit

- Mehrere Support-Kanäle, einschließlich Chat und Telefon

- Zugriff auf einen persönlichen Account Manager

- Aktive Nutzer-Community und Wissensdatenbank

- Schnelle Reaktionszeiten bei kritischen Problemen

Preis-Leistungs-Verhältnis (10% der Gesamtbewertung)

Um das Preis-Leistungs-Verhältnis jeder Plattform zu beurteilen, habe ich Folgendes berücksichtigt:

- Transparente und vorhersehbare Preisstruktur

- Flexible Tarife für unterschiedliche Unternehmensgrößen

- Keine versteckten Gebühren oder überraschenden Kosten

- Verfügbarkeit einer kostenlosen Testphase oder einer Demo

- In jeder Preiskategorie enthaltene Funktionen

Kundenbewertungen (10% der Gesamtbewertung)

Um einen Eindruck von der generellen Kundenzufriedenheit zu erhalten, habe ich bei der Auswertung von Kundenbewertungen Folgendes berücksichtigt:

- Stetige Zuverlässigkeits- und Verfügbarkeitsberichte

- Positives Feedback zu Integrationsmöglichkeiten

- Berichte über reaktionsschnellen Kundensupport

- Zufriedenheit der Nutzer mit Leistung und Geschwindigkeit

- Feedback zur Skalierbarkeit und Anpassungsfähigkeit

Wie wählt man Enterprise ETL-Tools aus?

Es ist leicht, sich in langen Funktionslisten und komplexen Preisstrukturen zu verlieren. Damit Sie im Auswahlprozess Ihrer einzigartigen Softwarelösung fokussiert bleiben, finden Sie hier eine Checkliste wichtiger Faktoren:

| Faktor | Worauf zu achten ist |

|---|---|

| Skalierbarkeit | Kann das Tool Ihre aktuellen und zukünftigen Datenmengen bewältigen? Fragen Sie nach Durchsatzlimits, Skalierungsmöglichkeiten pro Knoten und Multi-Region-Support. |

| Integrationen | Besteht eine direkte Anbindung an Ihre wichtigsten Datenquellen und -ziele? Prüfen Sie die Kompatibilität mit Altsystemen und Cloud-Plattformen. |

| Anpassbarkeit | Können Sie Workflows, Transformationsregeln und Zeitplanung an Ihre Unternehmenslogik anpassen? Achten Sie auf Skripting-Support und wiederverwendbare Vorlagen. |

| Benutzerfreundlichkeit | Benötigt Ihr Team umfangreiche Schulungen oder ist die Benutzeroberfläche intuitiv? Bewerten Sie die Lernkurve sowohl für technische als auch für nicht-technische Nutzer. |

| Implementierung und Onboarding | Wie lange dauert die Einführung und Migration bestehender Pipelines? Achten Sie auf Migrations-Tools, Onboarding-Ressourcen und Anbieterunterstützung. |

| Kosten | Sind die Preismodelle transparent und vorhersehbar? Berücksichtigen Sie Datenvolumen, Pipeline-Ausführungen und eventuelle Zusatzkosten für Konnektoren oder Support. |

| Sicherheitsvorkehrungen | Unterstützt das Tool Verschlüsselung, Zugangskontrollen und Audit-Logs? Stellen Sie sicher, dass es Ihre Sicherheits- und Compliance-Anforderungen erfüllt. |

| Supportverfügbarkeit | Welche Supportkanäle und Reaktionszeiten werden angeboten? Überlegen Sie, ob Sie einen 24/7-Support oder einen persönlichen Account Manager für kritische Fälle benötigen. |

Was sind Enterprise ETL-Tools?

Enterprise ETL-Tools sind unternehmensgerechte Softwareplattformen, die Daten aus komplexen Systemen und unterschiedlichen Quellen extrahieren, transformieren und laden. Diese Tools unterstützen das Datenmanagement, indem sie Teams helfen, Daten für Business Intelligence, Data-Lake-Umgebungen und Analyseprozesse bereitzustellen und zu bewegen.

Viele moderne ETL-Plattform-Lösungen sind cloud-nativ aufgebaut und darauf ausgelegt, sowohl Batch-Verarbeitung als auch Echtzeitdaten zu verarbeiten. Sie ermöglichen es Unternehmen, den wachsenden Anforderungen an Daten gerecht zu werden. Als einige der besten verfügbaren ETL-Tools unterstützen sie zudem Data-Intelligence-Initiativen, indem sie hochwertige Daten für Berichte, Machine-Learning-Anwendungen und operative Anwendungsfälle vorbereiten.

Funktionen von Enterprise ETL-Tools

Enterprise ETL-Tools bieten eine Vielzahl von Funktionen, die eine skalierbare Datenverwaltung und Integration unterstützen. Bei der Bewertung der besten ETL-Tools sollten Sie auf die folgenden Schlüsselfunktionen achten:

- Datenextraktion: Verbindung zu verschiedenen Datenquellen wie Datenbanken, SaaS-Plattformen und Data Lake-Speichersystemen, um Rohdaten aufzunehmen

- Datentransformation: Anwendung von Regeln und Logik, um Daten für Business Intelligence, Berichte und maschinelles Lernen vorzubereiten

- Workflow-Orchestrierung: Automatisierung und Verwaltung von Datenpipelines mit Unterstützung für Batch-Verarbeitung und Echtzeit-Datenflüsse

- Low-Code- und No-Code-Oberflächen: Ermöglichen es Teams, Datenpipelines über eine benutzerfreundliche Oberfläche zu erstellen und dennoch erweiterte Anpassungen zu unterstützen

- Skalierbarkeit: Unterstützung von Unternehmens-Workloads in Cloud-nativen Umgebungen mit großen Datenmengen

- Nachverfolgung der Datenherkunft: Ermöglicht Einblick darin, wie sich Daten über die ETL-Plattform hinweg bewegen und verändern

- Sicherheit und Compliance: Enthält Kontrollen zur Unterstützung von Standards wie HIPAA, sofern erforderlich

- Vorgefertigte Konnektoren: Vereinfachen die Anbindung an verschiedene Datenquellen und reduzieren den manuellen Entwicklungsaufwand

- Überwachung und Benachrichtigungen: Überwachen die Leistung der Pipelines und sorgen für zuverlässige Datenmanagement-Prozesse

Vorteile von Enterprise ETL-Tools

Die Implementierung von Enterprise ETL-Tools bringt zahlreiche Vorteile für Ihr Team und Ihr Unternehmen. Hier sind einige Vorteile, auf die Sie sich freuen können:

- Zentrale Datenintegration: Konsolidiert Daten aus verschiedenen Quellen in einer einzigen, einheitlichen Umgebung mithilfe automatisierter Extraktions- und Ladefunktionen.

- Verbesserte Datenqualität: Säubert, standardisiert und validiert Daten durch Transformations- und Fehlerbehandlungsfunktionen und reduziert Inkonsistenzen und Ungenauigkeiten.

- Erhöhte Skalierbarkeit: Bewältigt große und wachsende Datenmengen mit Skalierbarkeitskontrollen und Workflow-Orchestrierung zur Unterstützung von Unternehmenswachstum und Lastspitzen.

- Stärkere Sicherheit und Compliance: Schützt sensible Informationen durch rollenbasierte Zugriffskontrollen, Verschlüsselung und Nachverfolgung der Datenherkunft zur Einhaltung gesetzlicher Anforderungen.

- Betriebliche Effizienz: Automatisiert sich wiederholende Datenprozesse und bietet Überwachungs-Dashboards, sodass IT-Ressourcen für höherwertige Aufgaben frei werden.

- Schnellere Entscheidungsfindung: Liefert zuverlässige, zeitnahe Daten an Analyse- und Berichtssysteme, sodass Unternehmensleiter auf genaue Erkenntnisse reagieren können.

- Weniger Integrationskomplexität: Bietet vorgefertigte Konnektoren und native Integrationen, minimiert manuellen Programmieraufwand und vereinfacht Verbindungen zu Unternehmenssystemen.

Kosten und Preise von Enterprise ETL-Tools

Die Auswahl von Enterprise ETL-Tools setzt ein Verständnis der verschiedenen Preis- und Abonnementmodelle voraus. Die Kosten variieren je nach Funktionalität, Teamgröße, Erweiterungen und mehr. Die folgende Tabelle fasst gängige Pläne, ihre Durchschnittspreise und typische enthaltene Funktionen von Enterprise ETL-Lösungen zusammen:

Vergleichstabelle für Enterprise ETL-Tools

| Plan-Typ | Durchschnitt | Übliche Funktionen |

|---|---|---|

| Kostenloser Tarif | $0 | Grundlegende Datenextraktion, begrenzte Konnektoren, Einzelbenutzungszugang und Community-Support. |

| Persönlicher Tarif | $20-$50/Benutzer/Monat | Standard-Konnektoren, grundlegende Transformationstools, Workflow-Planung und E-Mail-Support. |

| Geschäftstarif | $100-$500/Monat | Mehrbenutzerzugang, erweiterte Transformation, Überwachungs-Dashboards, rollenbasierte Berechtigungen und API-Zugang. |

| Enterprise-Tarif | $1,000-$5,000/Monat | Unbegrenzte Konnektoren, hochvolumige Skalierbarkeit, kundenspezifische Integrationen, dedizierter Support und Compliance-Funktionen. |

Enterprise-ETL-Tools FAQ

Hier finden Sie Antworten auf häufig gestellte Fragen zu Enterprise-ETL-Tools:

Worin unterscheiden sich Enterprise-ETL-Tools von einfachen ETL-Tools?

Enterprise-ETL-Tools bieten erweiterte Funktionen wie Workflow-Orchestrierung, Nachverfolgung der Datenherkunft und rollenbasierte Zugriffskontrollen. Diese Fähigkeiten unterstützen größere Datenmengen, komplexe Integrationen und strengere Sicherheitsanforderungen im Vergleich zu einfachen ETL-Tools.

Können Enterprise-ETL-Tools sowohl Cloud- als auch lokale Datenquellen verarbeiten?

Ja, die meisten Enterprise-ETL-Tools unterstützen hybride Umgebungen. Sie bieten Konnektoren und Integrationsmöglichkeiten für sowohl cloudbasierte als auch lokale Systeme, sodass Sie Datenpipelines über verschiedene Infrastrukturen hinweg verwalten können.

Über welche Sicherheitsfunktionen sollten Enterprise-ETL-Tools verfügen?

Achten Sie auf Verschlüsselung im Ruhezustand und während der Übertragung, granulare Zugriffskontrollen, Protokollierung von Audits und Compliance-Zertifizierungen. Diese Funktionen helfen, sensible Daten zu schützen und sicherzustellen, dass Ihr Unternehmen regulatorische Anforderungen erfüllt.

Wie lange dauert die Implementierung eines Enterprise-ETL-Tools?

Die Implementierungsdauer variiert, aber die meisten Unternehmen können mit einem Zeitraum von einigen Wochen bis zu mehreren Monaten rechnen. Einflussfaktoren sind Datenkomplexität, Migrationsbedarf und die Verfügbarkeit von Ressourcen für die Einführung oder Unterstützung durch den Anbieter.

Benötigt man Programmierkenntnisse für die Nutzung von Enterprise-ETL-Tools?

Nein, viele Enterprise-ETL-Tools bieten visuelle Benutzeroberflächen und vorgefertigte Konnektoren, die den Programmieraufwand verringern. Für weitergehende Anpassungen oder komplexe Transformationen können jedoch Skript- oder Programmierkenntnisse erforderlich sein.