Beste Data Engineering Tools Kurzliste

Here's my pick of the 10 best software from the 5 tools reviewed.

Daten effizient zu verwalten ist eine Herausforderung, der Sie sich jeden Tag stellen. Sie benötigen Tools, die Ihnen helfen, Daten zu verarbeiten, zu analysieren und zu visualisieren, ohne dabei ins Schwitzen zu geraten. Data Engineering Tools können dabei Ihr Verbündeter sein, um diese Aufgaben zu meistern und Ihrer Arbeitsgruppe Zeit und Mühe zu sparen.

Ich habe unabhängig zahlreiche Softwarelösungen getestet und bewertet, um Ihnen die besten verfügbaren Optionen zu präsentieren. Mein Ziel ist es, Ihnen eine unvoreingenommene, gut recherchierte Bewertung der besten Lösungen zu bieten, die zu Ihren Anforderungen passen.

In diesem Artikel finden Sie detaillierte Einblicke in die Funktionen, Vorteile und mögliche Nachteile jedes Tools. Egal, ob Sie die Datenintegration vereinfachen oder das Pipeline-Monitoring verbessern möchten – hier finden Sie sicher eine passende Lösung. Tauchen wir ein und entdecken Sie die Tools, die Ihre Datenprozesse transformieren könnten.

Table of Contents

Why Trust Our Software Reviews

Zusammenfassung der besten Data Engineering Tools

Diese Vergleichstabelle fasst die Preisdetails meiner Top-Auswahl an Data Engineering Tools zusammen, damit Sie das beste Tool für Ihr Budget und Ihre geschäftlichen Anforderungen finden.

| Tool | Best For | Trial Info | Price | ||

|---|---|---|---|---|---|

| 1 | Am besten für No-Code-ETL-Workflows geeignet | Kostenlose Demo verfügbar | Preise auf Anfrage | Website | |

| 2 | Am besten geeignet für Datenvisualisierung | Kostenlose Demo verfügbar + kostenlose Testversion verfügbar | Ab $75/Nutzer/Monat (jährliche Abrechnung) | Website | |

| 3 | Am besten geeignet für einfache ETL-Prozesse | Kostenlose Testversion 14-tägige kostenlose Testphase + kostenlose Demo verfügbar | Ab $100/5 Nutzer/Monat | Website | |

| 4 | Am besten für die Zusammenarbeit im Team | Kostenlose Testversion verfügbar | Preise auf Anfrage | Website | |

| 5 | Am besten geeignet zur Überwachung von Datenpipelines | Kostenlose Demo verfügbar | Preise auf Anfrage | Website |

-

Site24x7

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6 -

GitHub Actions

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.8 -

Docker

Visit WebsiteThis is an aggregated rating for this tool including ratings from Crozdesk users and ratings from other sites.4.6

Bewertungen der besten Data Engineering Tools

Nachfolgend finden Sie meine detaillierten Zusammenfassungen der besten Data Engineering Tools, die es auf meine Shortlist geschafft haben. Meine Bewertungen bieten Ihnen einen genauen Überblick über die wichtigsten Funktionen, Vor- u0026amp; Nachteile, Integrationen und ideale Anwendungsfälle jedes Tools, damit Sie das richtige für sich finden.

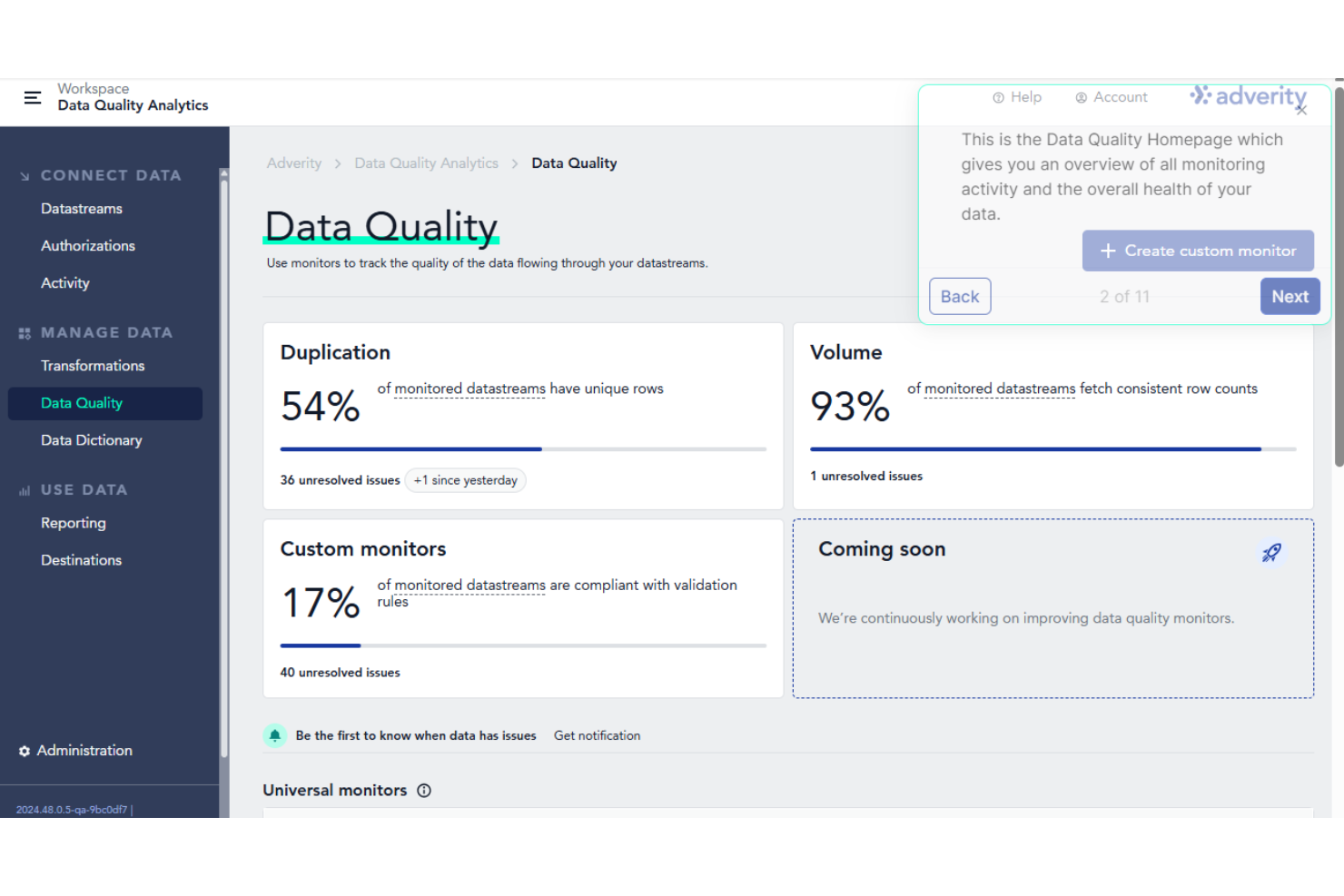

Adverity ist eine Datenplattform, die Teams dabei unterstützt, die Verbindung, Transformation und Verwaltung von Daten aus verschiedenen Quellen zu automatisieren. Sie wurde entwickelt, um Ihnen eine einheitliche und genaue Sicht auf Ihre Daten zu bieten, was die Analyse und Nutzung erleichtert.

Warum ich Adverity gewählt habe: Ich habe Adverity ausgewählt, weil es Ihrem Team ermöglicht, ETL-Workflows ohne Programmieraufwand zu automatisieren. Sie können Datenpipelines erstellen, die Daten aus über 600 Quellen abrufen, transformieren und laden. Funktionen wie intelligente Namenskonventionen und “Match & Map” erleichtern die Standardisierung und Bereinigung von Daten. Die Plattform unterstützt zudem berechnete Kennzahlen und fortgeschrittene Datenanreicherung, was entscheidend für die Aufbereitung zuverlässiger Datensätze ist. Diese Tools helfen Dateningenieuren, Datenkonsistenz sicherzustellen und manuellen Aufwand entlang der Pipeline zu reduzieren.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen Anomalieerkennung, die Sie auf Probleme wie Duplikate oder unerwartete Änderungen in Ihren Daten aufmerksam macht, sodass Sie diese beheben können, bevor sie Ihre Analyse beeinflussen. Die Plattform bietet außerdem ein gemeinsames Datenwörterbuch, das sicherstellt, dass Ihr gesamtes Team die verwendeten Datenfelder und Kennzahlen versteht.

Integrationen umfassen Google, Meta, TikTok, Google BigQuery, Looker Studio, Facebook Ads, Amazon Advertising, Hubspot, Salesforce, Amazon S3, Snowflake und Microsoft Azure.

Pros and Cons

Pros:

- Automatisierung des Datenabrufs aus zahlreichen Quellen möglich

- Beinhaltet Funktionen zum Überwachen von Datenqualität und Status

- Bietet anpassbare Möglichkeiten zur Datenumwandlung

Cons:

- Die Ersteinrichtung kann zeitaufwendig sein

- Bestimmte Konfigurationen können technisches Wissen erfordern

New Product Updates from Adverity

Adverity Introduces Brandwatch and Kakao Connectors

Adverity introduces the Brandwatch Measure and Kakao Moment connectors. These updates expand data integration capabilities, enabling more comprehensive social media and regional marketing analysis. For more information, visit Adverity’s official site.

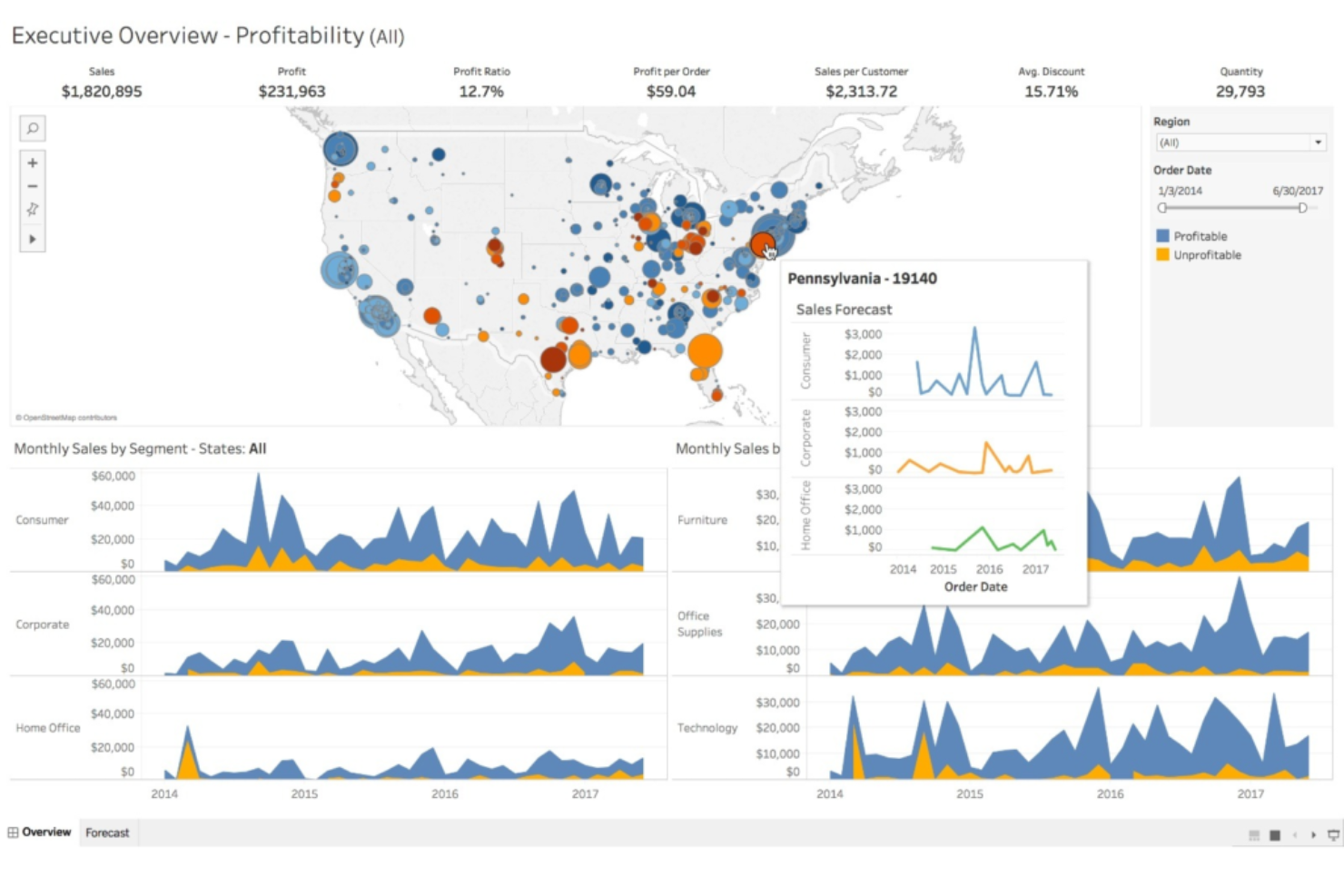

Tableau ist ein Business-Intelligence-Tool für die Datenvisualisierung, das vor allem Analysten, Data Scientists und Business-Anwender unterstützt. Es hilft Nutzern, interaktive und teilbare Dashboards zu erstellen, die Trends, Muster und Erkenntnisse aus Daten anschaulich darstellen.

Warum ich Tableau gewählt habe: Das Tool ist besonders für seine Fähigkeiten bei der Datenvisualisierung bekannt und somit ideal für Anwender, die Daten ansprechend präsentieren möchten. Die Drag-and-Drop-Oberfläche ermöglicht das Erstellen von Visualisierungen, ohne dass tiefgehende technische Kenntnisse erforderlich sind. Tableau unterstützt zahlreiche Datenquellen, sodass Sie Ihre Daten unabhängig vom Speicherort anbinden können. Die starke Community bietet eine Fülle von Ressourcen, um das volle Potenzial der Software auszuschöpfen.

Herausragende Funktionen & Integrationen:

Funktionen sind u.a. interaktive Dashboards, Datenzusammenführung und Echtzeitanalysen. Mit minimalem Aufwand können eindrucksvolle visuelle Geschichten erstellt werden. Die Fähigkeit, auch große Datenmengen effizient zu verarbeiten, unterscheidet Tableau deutlich von vielen Mitbewerbern.

Integrationen umfassen Salesforce, Google Analytics, Amazon Redshift, Microsoft Excel, SQL Server, Snowflake, Oracle, SAP Hana, Hadoop und Dropbox.

Pros and Cons

Pros:

- Echtzeit-Datenaktualisierung

- Anpassbare Visualisierungen

- Interaktive Datenexploration

Cons:

- Höhere Kosten für große Teams

- Hohe Lernkurve

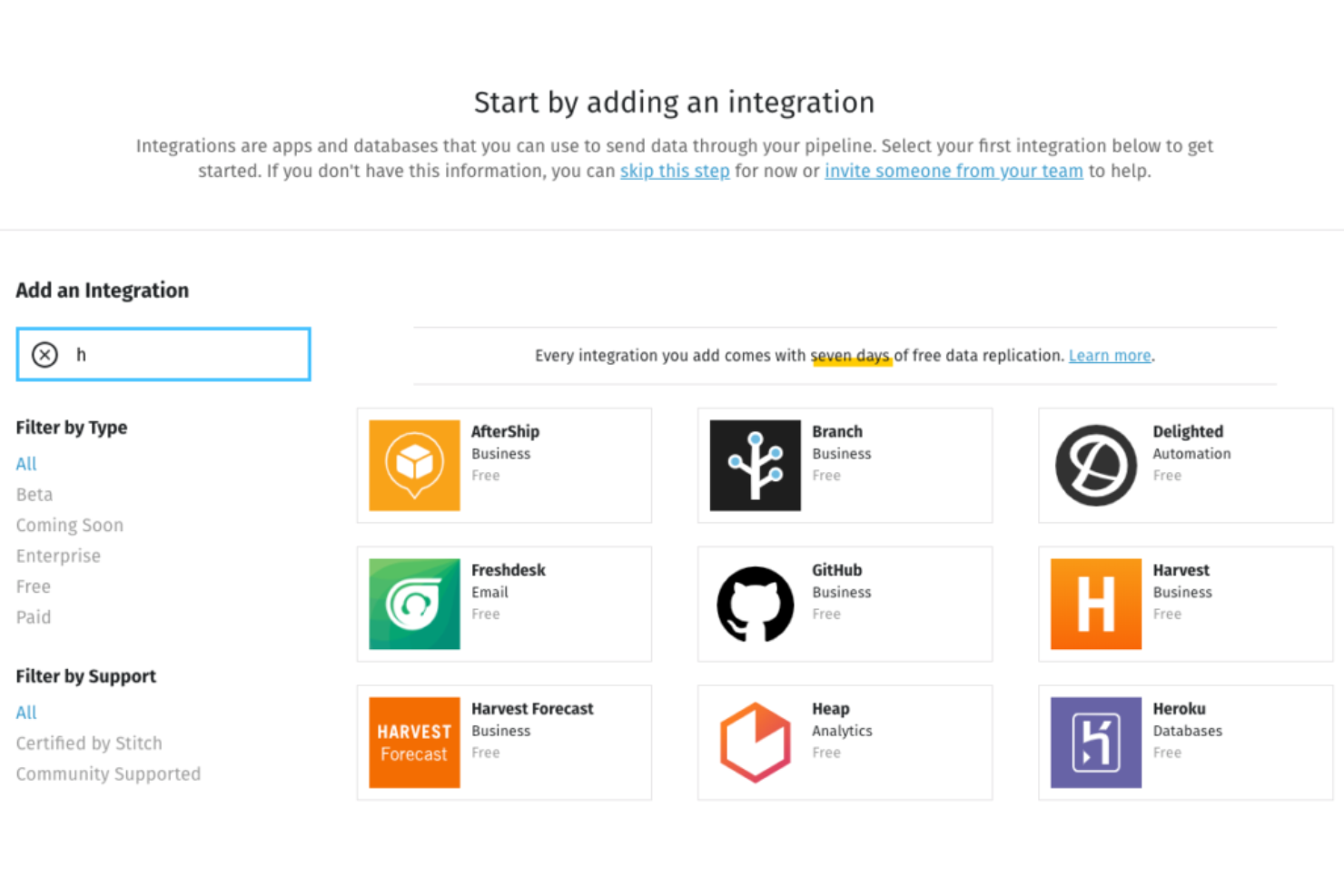

Stitch ist ein ETL-Tool, das für Data Engineers und Analysten entwickelt wurde, die Daten aus verschiedenen Quellen in ein Data Warehouse übertragen müssen. Es vereinfacht den Prozess der Datenpipeline und ermöglicht es den Nutzern, Daten effizient zu extrahieren, zu transformieren und zu laden.

Warum ich Stitch gewählt habe: Der unkomplizierte Ansatz beim ETL macht es ideal für Teams, die die Datenbewegung vereinfachen möchten. Mit Stitch können Sie Datenpipelines in wenigen Minuten einrichten und somit den Bedarf an komplexem Programmieren reduzieren. Es unterstützt eine breite Palette von Datenquellen und bietet Ihnen Flexibilität, woher Ihre Daten stammen. Die automatische Schemadetektion hilft dabei, die Datenintegrität ohne manuelles Eingreifen zu wahren.

Herausragende Funktionen & Integrationen:

Funktionen sind unter anderem automatische Datenaktualisierungen, die Ihre Daten ohne manuellen Aufwand aktuell halten. Die Echtzeit-Datenreplikation stellt sicher, dass Ihr Team stets auf dem neuesten Stand ist. Die benutzerfreundliche Oberfläche ermöglicht eine schnelle Konfiguration der Datenquellen.

Integrationen umfassen Salesforce, Google Analytics, MySQL, PostgreSQL, Amazon Redshift, Snowflake, Microsoft SQL Server, MongoDB, Facebook Ads und Shopify.

Pros and Cons

Pros:

- Automatische Schemadetektion

- Schneller Einrichtungsprozess

- Benutzerfreundliche Oberfläche

Cons:

- Keine integrierte Datenvisualisierung

- Begrenzte Anpassungsmöglichkeiten

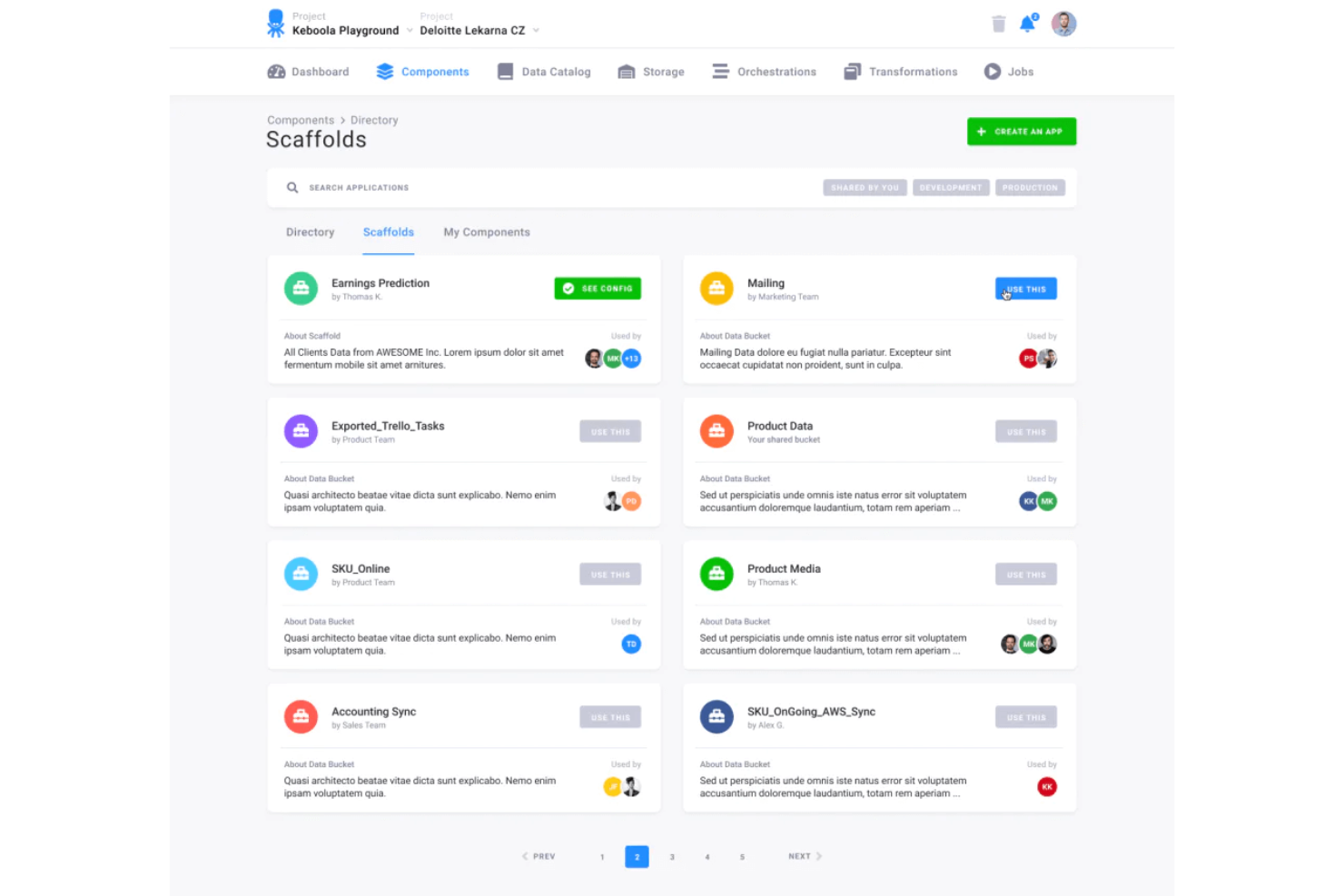

Keboola Connection ist eine Datenoperationsplattform, die sich an Datenteams und Business-Analysten richtet, die gemeinsam an Datenprojekten arbeiten möchten. Sie vereinfacht den Prozess der Datenorchestrierung und ermöglicht es Teams, einfacher zusammenzuarbeiten und Daten-Workflows zu verwalten.

Warum ich Keboola Connection ausgewählt habe: Die Plattform ist dafür konzipiert, die Zusammenarbeit im Team zu verbessern und mehreren Nutzern die gleichzeitige Arbeit an Datenprojekten zu ermöglichen. Durch die Bereitstellung von Daten in Echtzeit bleibt Ihr Team immer über die neuesten Veränderungen informiert. Sie bietet eine flexible Umgebung, in der Sie Datenprozesse ganz nach Bedarf anpassen können. Mit ihrer benutzerfreundlichen Oberfläche macht Keboola Connection komplexe Datenoperationen für jedes Teammitglied zugänglich.

Herausragende Funktionen & Integrationen:

Funktionen umfassen die Echtzeitverarbeitung von Daten, die sicherstellt, dass Ihr Team immer mit den aktuellsten Informationen arbeitet. Eingebaute Tools für Data Governance helfen dabei, Datenqualität und Compliance sicherzustellen. Die Automatisierungsfunktionen der Plattform verringern manuelle Aufgaben und verschaffen Ihrem Team mehr Zeit für strategische Arbeiten.

Integrationen umfassen Snowflake, Amazon Redshift, Google BigQuery, MySQL, PostgreSQL, Microsoft Azure, Salesforce, Google Analytics, HubSpot und Slack.

Pros and Cons

Pros:

- Integrierte Data-Governance-Tools

- Flexible Anpassungsmöglichkeiten

- Datenzusammenarbeit in Echtzeit

Cons:

- Erfordert technisches Fachwissen

- Höhere Lernkurve

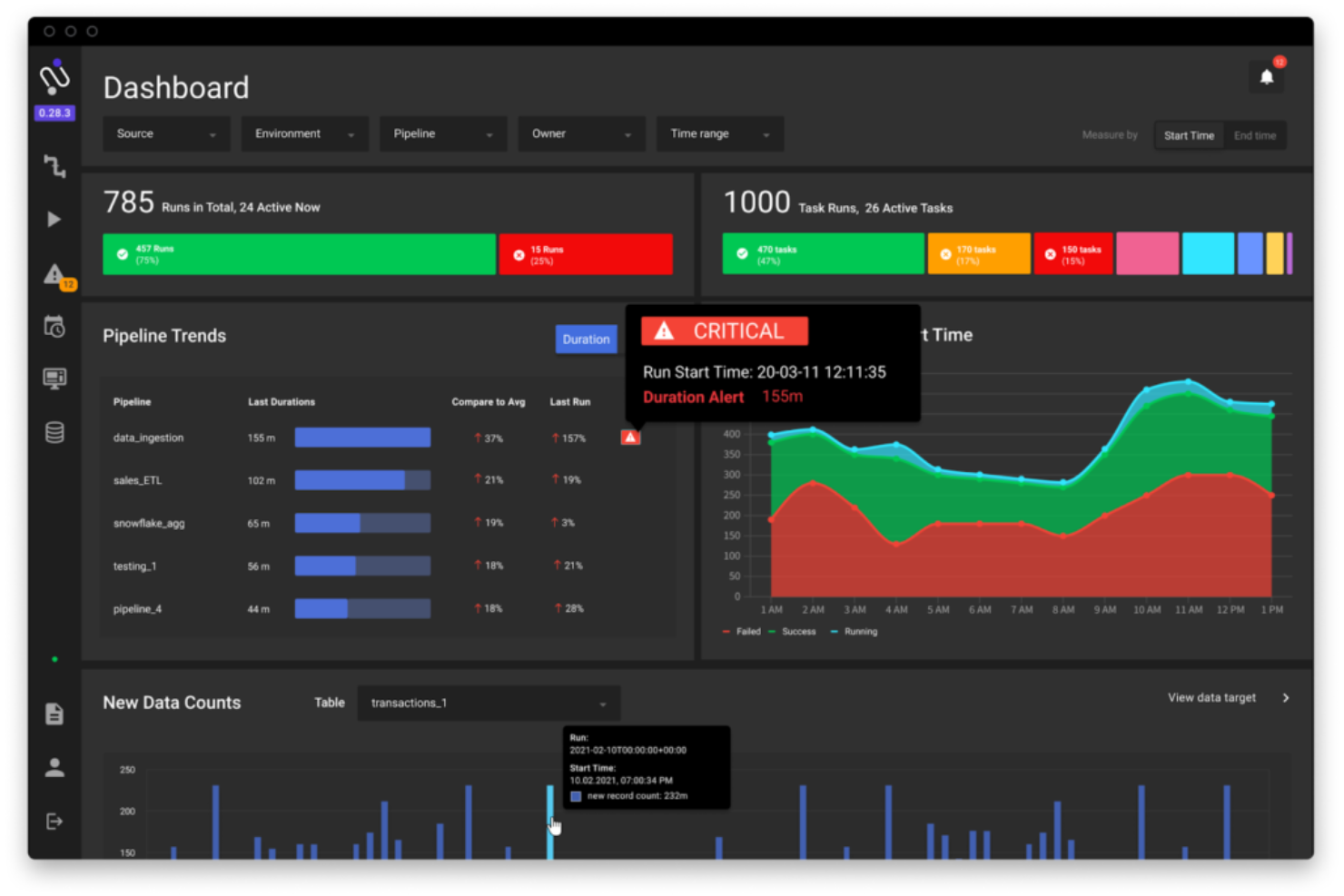

Databand ist eine Plattform für Datenüberwachbarkeit, die für Data Engineers und Betriebsteams entwickelt wurde, die Datenpipelines überwachen und verwalten müssen. Sie hilft Anwendern, Datenqualitätsprobleme zu erkennen, zu beheben und zu lösen, um einen reibungslosen Datenbetrieb zu gewährleisten.

Warum ich Databand gewählt habe: Es ist speziell auf die Überwachung von Datenpipelines ausgerichtet und daher unerlässlich für Teams, die Datenintegrität und -zuverlässigkeit wahren müssen. Databand bietet Echtzeit-Benachrichtigungen, sodass Ihr Team Probleme schnell angehen kann, sobald sie auftreten. Durch detaillierte Einblicke in den Datenfluss erkennen Sie einfach, wo Engpässe entstehen. Die benutzerfreundliche Oberfläche der Plattform ermöglicht es Ihnen, Datenprozesse mühelos zu visualisieren.

Hervorstechende Funktionen & Integrationen:

Funktionen umfassen Anomalieerkennung, mit der Sie unregelmäßige Datenmuster frühzeitig erkennen. Die Plattform bietet eine Nachverfolgung historischer Daten, sodass Sie die Performance vergangener Pipelines analysieren können. Die anpassbaren Dashboards geben Ihnen die Flexibilität, sich auf die Kennzahlen zu konzentrieren, die für Ihr Team wichtig sind.

Integrationen umfassen Apache Airflow, Apache Spark, Databricks, Google Cloud Platform, Amazon Web Services, Snowflake, Microsoft Azure, Kubernetes, Slack und PagerDuty.

Pros and Cons

Pros:

- Benutzerfreundliche Oberfläche

- Detaillierte Einblicke in Datenflüsse

- Echtzeit-Überwachungsfunktionen

Cons:

- Hohe Einarbeitungskurve

- Kann zusätzliche Ressourcen erfordern

Auswahlkriterien für Data Engineering Tools

Bei der Auswahl der besten Data Engineering Tools für diese Liste habe ich übliche Anforderungen und Pain Points wie Integrationskomplexität und Skalierbarkeit berücksichtigt. Zusätzlich habe ich einen strukturierten Bewertungsrahmen verwendet, um die Bewertung objektiv und fair zu gestalten:

Kernfunktionen (25 % der Gesamtbewertung)

Für die Aufnahme in diese Liste musste jede Lösung folgende gängige Anwendungsfälle abdecken:

- Datenintegration

- Datenumwandlung

- Automatisierung von Daten-Pipelines

- Datenvisualisierung

- Verwaltung der Datenspeicherung

Weitere herausragende Funktionen (25 % der Gesamtbewertung)

Um die Auswahl weiter zu verfeinern, habe ich außerdem auf besondere Funktionen geachtet, wie:

- Echtzeit-Datenverarbeitung

- Anomalieerkennung

- Prädiktive Analysen

- Anpassbare Workflows

- Erweiterte Sicherheitsfunktionen

Benutzerfreundlichkeit (10 % der Gesamtbewertung)

Um die Benutzerfreundlichkeit der einzelnen Systeme einzuschätzen, habe ich folgende Aspekte betrachtet:

- Intuitives Interface-Design

- Einfache Navigation

- Minimale Lernkurve

- Reaktionsfähigkeit des Systems

- Anpassungsmöglichkeiten

Onboarding (10 % der Gesamtbewertung)

Um die Onboarding-Erfahrung jeder Plattform zu bewerten, habe ich Folgendes berücksichtigt:

- Verfügbarkeit von Schulungsvideos

- Interaktive Produkttouren

- Zugriff auf Vorlagen

- Vorhandensein von Chatbots für Support

- Webinare für neue Nutzer

Kundensupport (10 % der Gesamtbewertung)

Um die Supportleistungen der einzelnen Softwareanbieter zu beurteilen, habe ich Folgendes berücksichtigt:

- Verfügbarkeit von 24/7-Support

- Reaktionsfähigkeit des Support-Teams

- Zugriff auf eine Wissensdatenbank

- Community-Foren für Nutzer

- Vielfalt der Support-Kanäle

Preis-Leistungs-Verhältnis (10 % der Gesamtbewertung)

Um das Preis-Leistungs-Verhältnis jeder Plattform zu bewerten, habe ich folgende Kriterien herangezogen:

- Wettbewerbsfähige Preisgestaltung

- Funktionsumfang zum angebotenen Preis

- Kosten für Zusatzoptionen oder Extras

- Flexibilität der Tarifmodelle

- Zufriedenheit mit dem Return on Investment

Kundenbewertungen (10 % der Gesamtbewertung)

Um ein Gefühl für die allgemeine Kundenzufriedenheit zu bekommen, habe ich beim Lesen von Kundenbewertungen Folgendes beachtet:

- Allgemeine Zufriedenheitsbewertungen

- Häufig genannte Stärken

- Konsistent berichtete Schwächen

- Feedback zum Kundensupport

- Nutzerempfehlungen

So wählen Sie Data-Engineering-Tools aus

Es ist leicht, sich in langen Funktionslisten und komplexen Preisstrukturen zu verlieren. Damit Sie sich bei Ihrem individuellen Software-Auswahlprozess auf das Wesentliche konzentrieren können, finden Sie hier eine Checkliste wichtiger Entscheidungsfaktoren:

| Faktor | Worauf achten? |

| Skalierbarkeit | Stellen Sie sicher, dass das Tool mit Ihren Datenanforderungen wächst. Berücksichtigen Sie zukünftig steigende Datenvolumina und ob das Tool auch große Datenmengen ohne Performance-Einbußen verarbeiten kann. |

| Integrationen | Suchen Sie nach Tools, die sich mit Ihrem bestehenden Software-Stack verbinden lassen, wie Data-Fabric-Software und Analyseplattformen, um den Datenfluss zu optimieren und Kompatibilitätsprobleme zu vermeiden. |

| Anpassbarkeit | Überprüfen Sie, ob das Tool individuelle Anpassungen an Ihre Datenprozesse erlaubt. Gegebenenfalls müssen Sie Arbeitsabläufe oder Datenverarbeitung an die Bedürfnisse Ihres Teams anpassen können. |

| Benutzerfreundlichkeit | Bewerten Sie die Benutzeroberfläche und den Lernaufwand. Ihr Team sollte das Tool ohne umfangreiche Schulungen oder technische Vorkenntnisse schnell nutzen können. |

| Budget | Prüfen Sie die Preispläne und stellen Sie sicher, dass diese zu Ihren finanziellen Rahmenbedingungen passen. Berücksichtigen Sie sowohl einmalige Kosten als auch eventuelle laufende Gebühren. |

| Sicherheitsmaßnahmen | Stellen Sie sicher, dass das Tool umfangreiche Sicherheitsfunktionen zum Schutz Ihrer Daten bietet. Achten Sie auf Verschlüsselung, Zugriffskontrollen und die Einhaltung von Branchenstandards. |

| Support | Berücksichtigen Sie Verfügbarkeit und Qualität des Kundensupports. Für Einrichtung oder Fehlerbehebung kann schnelle Unterstützung entscheidend sein. |

| Leistung | Bewerten Sie Leistungskennzahlen wie Verarbeitungsgeschwindigkeit und Zuverlässigkeit. Ihr Team benötigt ein effizient arbeitendes Tool, auch unter hoher Auslastung. |

Trends bei Data-Engineering-Tools

Für meine Recherche habe ich zahlreiche Produktneuheiten, Pressemitteilungen und Versionslogs verschiedener Anbieter von Data-Engineering-Tools ausgewertet. Hier sind einige der aufkommenden Trends, die ich derzeit beobachte:

- Echtzeit-Datenverarbeitung: Unternehmen verlangen schnellere Einblicke, was zu einem Anstieg der Echtzeit-Datenverarbeitungskapazitäten führt. Tools entwickeln sich weiter, um Datenströme zu verarbeiten und sofortige Analysen bereitzustellen, was Teams ermöglicht, schneller Entscheidungen zu treffen. Anbieter wie Apache Kafka sind in diesem Bereich führend.

- Demokratisierung von Daten: Immer mehr Tools konzentrieren sich darauf, Daten auch für nicht-technische Anwender zugänglich zu machen. Dieser Trend befähigt alle Teammitglieder, Datenerkenntnisse zu nutzen, ohne einen Data-Science-Hintergrund zu benötigen. Plattformen wie Tableau verbessern benutzerfreundliche Oberflächen, um diesen Wandel zu unterstützen.

- Daten-Observability: Die Sicherstellung von Datenqualität und -zuverlässigkeit wird immer wichtiger. Tools bieten jetzt Funktionen, um Datenanomalien zu überwachen und zu melden und helfen Teams, das Vertrauen in ihre Daten zu erhalten. Databand ist ein bekannter Anbieter, der starke Observability-Lösungen bereitstellt.

- Datenschutz und Compliance: Aufgrund zunehmender Regularien integrieren Tools Funktionen, um den Datenschutz sicherzustellen und die Einhaltung von Gesetzen wie der DSGVO zu gewährleisten. Dieser Trend ist für Unternehmen entscheidend, um rechtliche Fallstricke zu vermeiden. Anbieter wie Informatica bauen Compliance-Prüfungen ein.

- Cloud-native Architekturen: Es gibt eine wachsende Bewegung hin zu Cloud-nativen Data-Engineering-Tools, die bessere Skalierbarkeit und Flexibilität ermöglichen. Diese Tools sind für Cloud-Umgebungen optimiert und sorgen dafür, dass Unternehmen flexiblere Datenlösungen nutzen können. Snowflake ist ein Beispiel für diesen Trend mit seiner Cloud-First-Strategie.

Was sind Data-Engineering-Tools?

Data-Engineering-Tools sind Softwarelösungen, die entwickelt wurden, um Daten in einem Unternehmen zu verwalten, zu verarbeiten und zu transformieren. Diese Tools werden typischerweise von Data Engineers, Datenanalysten und IT-Fachleuten genutzt, die große Datenmengen effizient handhaben müssen.

Merkmale wie Datenintegration, Echtzeitverarbeitung und Daten-Observability helfen, die Datenqualität zu sichern, schnelle Einblicke zu ermöglichen und die Compliance zu gewährleisten. ETL-Testautomatisierungs-Tools spielen in diesem Prozess eine wichtige Rolle, indem sie Datentransformationen validieren. Insgesamt ermöglichen diese Tools Unternehmen, Rohdaten in wertvolle Erkenntnisse umzuwandeln, die fundierte Entscheidungen ermöglichen.

Funktionen von Data-Engineering-Tools

Bei der Auswahl von Data-Engineering-Tools sollten Sie auf folgende zentrale Funktionen achten:

- Datenintegrations-Tools: Mit dieser Funktion können Sie Daten aus mehreren Quellen verbinden und konsolidieren, was die Analyse und Gewinnung von Erkenntnissen erleichtert.

- Echtzeitverarbeitung: Ermöglicht die Bearbeitung von Daten unmittelbar beim Eintreffen und bietet sofortige Einblicke, um schnellere Entscheidungen zu unterstützen.

- Datenvisualisierung: Bietet Werkzeuge zur Erstellung von Diagrammen und Grafiken, damit Nutzer komplexe Datensätze leichter interpretieren können.

- Skalierbarkeit: Stellt sicher, dass das Tool mit wachsendem Datenvolumen umgehen kann, ohne die Leistung zu beeinträchtigen – entscheidend für wachsende Unternehmen.

- Anpassbare Workflows: Teams können Prozesse an spezifische Anforderungen der Datenverarbeitung anpassen und so die Effizienz steigern.

- Sicherheitsvorkehrungen: Enthält Verschlüsselung und Zugriffskontrollen, um sensible Daten zu schützen und gesetzliche Vorgaben einzuhalten.

- Prädiktive Analysen: Nutzt Modelle für maschinelles Lernen, um Trends und Ergebnisse vorherzusagen und eine proaktive Planung zu unterstützen.

- Automatisierungsfunktionen: Reduziert manuelle Aufgaben durch die Automatisierung repetitiver Prozesse und steigert so die Produktivität.

- Daten-Observability-Tools: Bietet Überwachungs- und Alarmierungsfunktionen, um eine dauerhaft hohe Datenqualität und -zuverlässigkeit zu gewährleisten.

- Benutzerfreundliche Oberfläche: Stellt sicher, dass das Tool einfach zu bedienen ist und die Einarbeitungszeit für neue Nutzer minimiert wird.

Vorteile von Data-Engineering-Tools

Die Implementierung von Data-Engineering-Tools bietet zahlreiche Vorteile für Ihr Team und Ihr Unternehmen, besonders in Kombination mit Workload-Automatisierungssoftware. Hier sind einige, auf die Sie sich freuen können:

- Schnellere Entscheidungsfindung: Echtzeitverarbeitung und sofortige Dateneinblicke helfen Ihrem Team, fundierte Entscheidungen schneller zu treffen.

- Höhere Effizienz: Automatisierungsmöglichkeiten beseitigen sich wiederholende Aufgaben und schaffen Freiräume für strategischere Tätigkeiten.

- Verbesserte Zusammenarbeit: Benutzerfreundliche Oberflächen und anpassbare Workflows unterstützen Teamarbeit, indem sie es allen ermöglichen, Daten einfach zu nutzen und zu bearbeiten.

- Skalierbarkeit: Die Fähigkeit, wachsende Datenmengen zu verarbeiten, stellt sicher, dass Ihre Tools mit Ihrem Unternehmen mitwachsen, ohne Leistungseinbußen.

- Höhere Datenqualität: Datenkatalog-Tools mit Überwachungsfunktionen gewährleisten, dass Ihre Daten genau und zuverlässig bleiben und Analysefehler reduziert werden.

- Bessere Einhaltung von Vorschriften: Sicherheitsmaßnahmen wie Verschlüsselung und Zugangskontrollen tragen dazu bei, dass Ihre Datenverwaltung den Branchenvorschriften entspricht.

- Proaktive Planung: Prädiktive Analysen liefern Prognosen, mit denen Ihr Team Trends frühzeitig erkennt und entsprechend planen kann.

Kosten und Preise von Data-Engineering-Tools

Die Auswahl von Data-Engineering-Tools erfordert ein Verständnis der verschiedenen Preismodelle und -pläne. Die Kosten variieren je nach Funktionen, Teamgröße, Zusatzoptionen und mehr. Die folgende Tabelle fasst gängige Pläne, deren durchschnittliche Preise und typische enthaltene Funktionen von Data-Engineering-Tools zusammen:

Vergleichstabelle für Data-Engineering-Tools

| Plan-Typ | Durchschnittspreis | Typische Funktionen |

| Kostenloser Plan | $0 | Grundlegende Datenintegration, begrenzte Datenspeicherung und Community-Support. |

| Persönlicher Plan | $10-$50 /Benutzer /Monat | Erweiterte Datenvisualisierung, Echtzeitverarbeitung und E-Mail-Support. |

| Business-Plan | $50-$150 /Benutzer /Monat | Anpassbare Workflows, erweiterte Sicherheitsfunktionen und bevorzugter Kundensupport. |

| Enterprise-Plan | $150-$500/Benuzer /Monat | Umfassende Datenüberwachung, prädiktive Analysen und persönliches Account-Management. |

FAQs zu Data-Engineering-Tools

Hier finden Sie Antworten auf häufig gestellte Fragen zu Data-Engineering-Tools:

Welches Tool wird für Data Engineering verwendet?

Data-Engineering-Tools variieren je nach Bedarf, aber gängige sind Apache Spark, Hadoop und AWS zur Verarbeitung großer Datenmengen. Diese Tools helfen Ihnen, umfangreiche Datensätze effizient zu verarbeiten, zu speichern und zu analysieren. Ihre Wahl sollte von Ihren spezifischen Datenanforderungen und bestehender u003ca href=u0022https://thectoclub.com/tools/best-big-data-software/u0022u003eBig-Data-Softwareu003c/au003e abhängen.

Welche Fragen sollte ich einem Data Engineer stellen?

Wenn Sie einen Data Engineer befragen, erkundigen Sie sich nach seiner Erfahrung mit ETL-Tools, Datenmodellierung und Datenorchestrierung. Von Interesse ist auch der Umgang mit Cloud-Plattformen und die Fähigkeit, große Datensätze zu bewältigen. Diese Fragen helfen, seine technischen Kompetenzen und Problemlösungsfähigkeiten zu beurteilen.

Welche Plattform ist am besten für Data Engineering geeignet?

Die beste Plattform hängt von Ihren spezifischen Anforderungen ab, aber beliebte Optionen sind etwa Snowflake für cloudbasierte Analysen und Amazon Redshift für Data Warehousing. Beide bieten leistungsstarke Möglichkeiten zur Datenverarbeitung im großen Maßstab. Berücksichtigen Sie bei der Auswahl die Integration in Ihre bestehenden Systeme sowie die Kosten.

Was sind ETL-Tools im Data Engineering?

u003ca href=u0022https://thectoclub.com/tools/best-etl-tools/u0022u003eETL-Toolsu003c/au003e werden verwendet, um Daten aus verschiedenen Quellen zu extrahieren, zu transformieren und in ein Data Warehouse zu laden. Dieser Prozess bereinigt und organisiert Rohdaten, damit sie für Analysen und Machine Learning vorbereitet sind. Gängige u003ca href=u0022https://thectoclub.com/tools/best-open-source-etl-tools/u0022u003eETL-Toolsu003c/au003e sind Informatica, Talend und Apache NiFi, jedes mit eigenen Stärken.

Was versteht man unter Datenorchestrierung?

Datenorchestrierung bedeutet, die Prozesse zur Datenerfassung, -transformation und -beladung zu automatisieren. Tools wie Apache Airflow und Prefect helfen, diese Workflows zu steuern und zu planen und sorgen für einen reibungslosen Datenfluss über Systeme hinweg. Das ist entscheidend für die Konsistenz und Zuverlässigkeit Ihrer Daten.

Wie wähle ich das richtige Data-Engineering-Tool aus?

Die richtige Wahl hängt von Ihrem Datenvolumen, Integrationsbedarf und Budget ab. Für große und schnelllebige Datenmengen sollten Sie auf Skalierbarkeit und Echtzeitverarbeitung achten. Bewerten Sie außerdem die Benutzerfreundlichkeit und den Support, um sicherzustellen, dass das Tool zu Ihrem Team passt.

Wie geht es weiter?

Wenn Sie gerade dabei sind, sich über Data-Engineering-Tools zu informieren, verbinden Sie sich mit einem SoftwareSelect-Berater für kostenlose Empfehlungen.

Sie füllen ein Formular aus und führen ein kurzes Gespräch, in dem Ihre spezifischen Anforderungen besprochen werden. Anschließend erhalten Sie eine Liste mit geeigneter Software zur Auswahl. Das Team unterstützt Sie sogar während des gesamten Kaufprozesses, einschließlich Preisverhandlungen.