Jedes Jahr investieren Unternehmen massiv in die digitale Transformation. Sie verbessern ERP-Systeme, Cloud-Plattformen und interne Software. Aber sobald ein Produkt die Fertigungshalle erreicht, ein Paket durch ein Lager bewegt wird oder ein Container auf das Betriebsgelände kommt, verschwindet diese digitale Sichtbarkeit oft. Ab diesem Punkt verlassen sich Teams häufig auf manuelle Kontrollen, verzögerte Updates, Vermutungen und menschliches Urteilsvermögen. Kurz gesagt: Es gibt immer noch zu viele Brüche zwischen Software-Systemen und den physischen Abläufen.

Roboflow ist die Plattform, die speziell dafür entwickelt wurde, diese Lücke zu schließen. Es ist der Computer-Vision-Stack, den über 1 Million Entwickler nutzen, um Pixel in die Produktion zu bringen: Roboflow Universe für forkbare Einstieg-Datensätze, Roboflow Workflows zum Aufbau von Inspektionspipelines ohne maßgeschneiderten ML-Code und Roboflow Inference zum Ausführen dieser Pipelines am Edge oder in der Cloud. Mit diesem End-to-End-Fundament stellt sich nicht mehr die Frage, ob Vision AI Ihre operative Transparenzlücke schließen kann. Die entscheidende Frage ist, für welchen Anwendungsfall Ihr Team sich zuerst entscheiden sollte, um messbaren Mehrwert zu erzielen – statt nur ein interessantes Demo.

Hier ist ein praxisorientierter Leitfaden zur Identifizierung dieses ersten Anwendungsfalls – idealerweise eines, der zu einem echten Einsatzplan passt und einen merklichen Einfluss auf Ihre Gewinn- und Verlustrechnung hat.

Bewährtes Vorgehen, um das Maximum aus KI herauszuholen

1. Katalogisieren Sie Ihre „Visuellen Geschäftseinheiten“

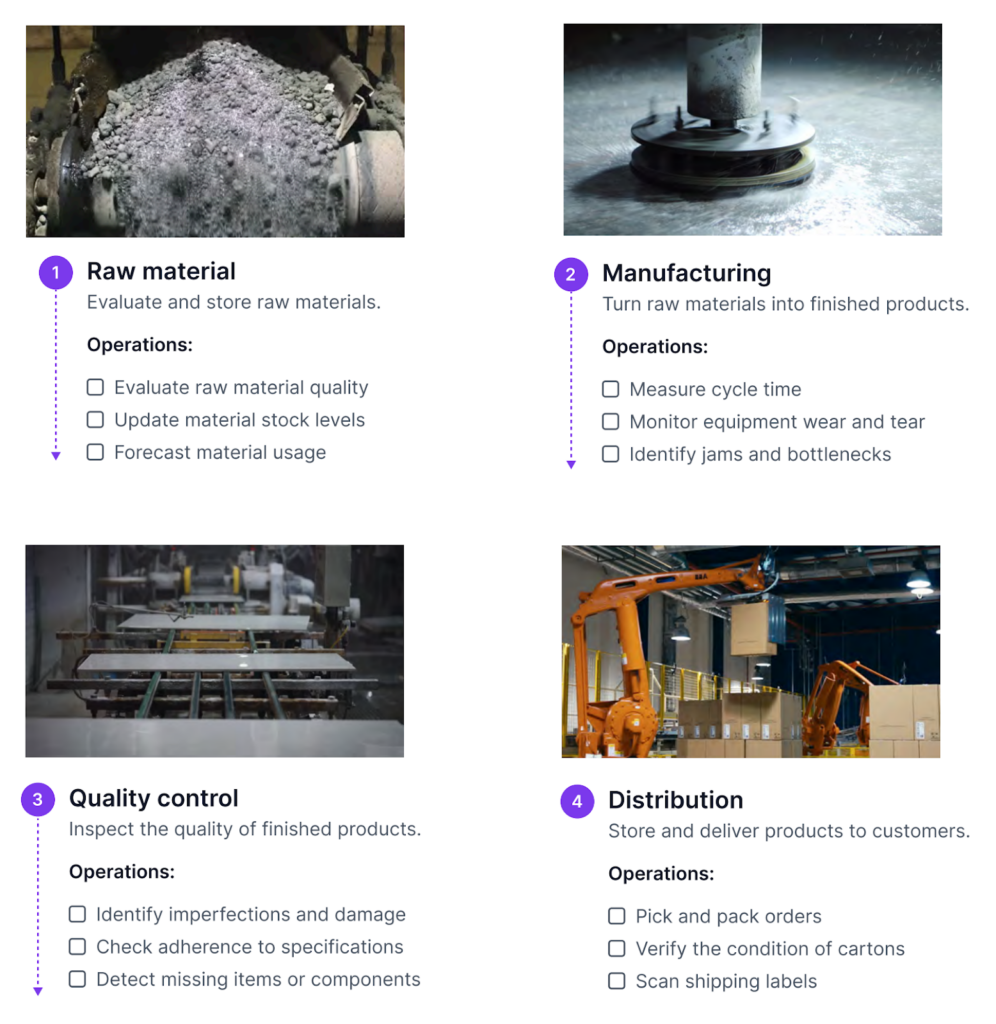

Der größte Fehler vieler Unternehmen besteht darin, nach einer einzigen KI-Lösung zu suchen, die alles abdeckt. Stattdessen sollten Sie Ihren Betriebsablauf in klare Stufen unterteilen – von den Rohstoffen bis zur Endverteilung – und die wichtigsten Funktionen bzw. Geschäftseinheiten jeder Stufe auflisten. So erkennen Sie, wo bereits visuelle Kontrollen stattfinden und wo Vision AI tatsächlich unterstützen kann.

Für ein Fertigungsunternehmen könnte das beispielsweise in vier operativen Bereichen so aussehen:

- Rohstoffe: Sind die eingehenden Materialien korrekt gekennzeichnet und innerhalb der Spezifikationen? In dieser Phase erfolgen Kontrollen oft per Hand. Ein Vision-System kann Etiketten prüfen und das Bestandssystem automatisch aktualisieren.

- Produktion: Verursacht der Brennofen während des Prozesses eine Echtzeitverformung des Tons? Ein Vision-System kann dies während der Produktion verfolgen und Prozessabweichungen oder Abnutzungserscheinungen von Maschinen erkennen, bevor es zu einem Ausfall kommt.

- Qualitätskontrolle: Gibt es kleine Oberflächenfehler, wie etwa einen 1 mm langen Kratzer, der bei manueller Kontrolle übersehen wird?

- Distribution: Werden die richtigen Artikel kommissioniert, befinden sich die Kartons in einwandfreiem Zustand und sind die Versandetiketten vor dem Versand korrekt?

Ziel in dieser Phase ist es, eine vollständige Aufstellung zu erhalten – noch keine Bewertung der Ideen. Laufen Sie durch die Hallen, sprechen Sie mit Bereichsleitern, und stellen Sie eine einfache Frage: „Welche visuelle Aufgabe verursacht am meisten Folgeschäden, wenn sie schiefgeht?“ Die Antwort ist oft der beste Startpunkt.

2. Der 4-Punkte-Eignungsfilter

Haben Sie eine Liste potenzieller Anwendungsfälle, ist der nächste Schritt, zu prüfen, welche davon wirklich für Computer Vision geeignet sind. Nicht jede visuelle Aufgabe profitiert von Automatisierung. Bei Roboflow achten wir auf vier Schlüsselkriterien, um zu beurteilen, ob ein Problem eine hohe Übereinstimmung mit Computer Vision aufweist. Diese Kriterien helfen dabei, jene Anwendungsfälle zu finden, bei denen Vision AI voraussichtlich konsistentere und skalierbarere Ergebnisse liefert als manuelle Prozesse.

- Umsetzbarkeit: Führt die visuelle Information zu einer klaren nächsten Aktion? Vision AI zahlt sich aus, wenn jede Erkennung zu einer Benachrichtigung, einer Datenbankaktualisierung oder einem Folgeprozess führt – nicht nur zu einem Dashboard. Roboflow Workflows verknüpft Erkennung, Logik und Ausgabeblöcke in einer Pipeline, die die Ergebnisse direkt an Slack, per Webhook oder ins Bestandssystem sendet.

- Volumen: Erfolgt diese Prüfung mit sehr hoher Frequenz, wie zum Beispiel 30.000 Mal am Tag? Menschen prüfen in der ersten Stunde sorgfältig und übersehen ab der fünften Stunde Dinge. Roboflow Inference schließt diese Lücke: Es läuft auf einer Roboflow-gehosteten GPU oder auf Ihrem eigenen Server und verarbeitet Tausende von Bildern pro Minute – ohne Ermüdungskurve.

- Machbarkeit: Erfordert die Aufgabe Kontrolle in einem 200°C heißen Brennofen, an einem fahrenden LKW oder in einem abgelegenen Bereich ohne stabile Verbindung? Roboflow Inference läuft direkt am Edge auf Geräten wie NVIDIA Jetson, sodass das Modell auf der Kamera selbst sitzt und auch bei Netzausfall weiterläuft.

- Subjektivität: Bewerten zwei Prüfer dasselbe Produkt an schlechten Tagen unterschiedlich? Die Schwankungen zwischen Schichten und Standorten sind die versteckte Steuer manueller Qualitätssicherung. Mit Roboflow Annotate kann Ihr Team einen einheitlichen Standard für die Kennzeichnung aufbauen, und das trainierte Modell wendet diesen Standard für jedes Bild, jede Schicht und an jedem Standort konsistent an.

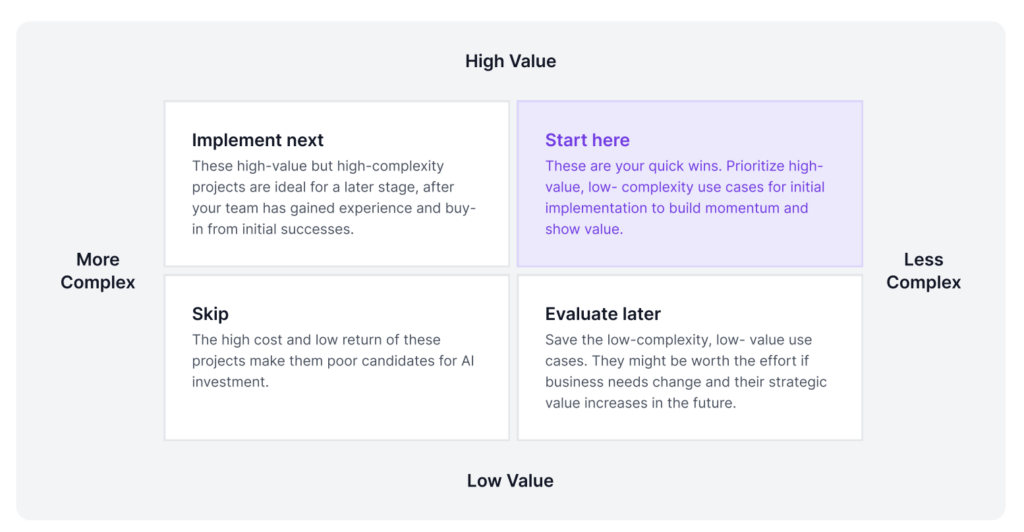

3. Das Quadrant Hochwert – Niedrige Komplexität

Nachdem Sie Ihre möglichen Anwendungsfälle anhand der vier Eignungskriterien gefiltert haben, besteht der nächste Schritt darin, diese nach Priorität zu gruppieren und herauszufinden, welche sich möglicherweise nicht lohnen. Dafür müssen Sie sowohl die Komplexität als auch den Wert jedes Anwendungsfalls bewerten.

Eine einfache Möglichkeit, dies zu veranschaulichen, ist ein 2x2-Raster, das in Quadranten unterteilt ist. Auf der X-Achse wird die Komplexität gemessen, also wie viele Hürden zwischen Idee und tatsächlicher Umsetzung bestehen. Auf der Y-Achse wird der Wert erfasst, also welche tatsächlichen Auswirkungen der Anwendungsfall auf das Unternehmen und die Gewinn- und Verlustrechnung hat.

Um jeden Anwendungsfall im richtigen Quadranten zu platzieren, müssen Sie die Schlüsselfaktoren betrachten, die beide Achsen beeinflussen.

Wert definieren:

- Direkt: Damit ist der unmittelbare und messbare geschäftliche Einfluss gemeint. Zum Beispiel die Senkung von Betriebskosten durch Automatisierung, die Reduzierung von Verschwendung oder Nacharbeit oder die Steigerung der Produktion. Diese Vorteile lassen sich in der Regel klar in Einsparungen oder Umsatz beziffern.

- Indirekt: Hierbei handelt es sich um Verbesserungen, die sich nicht sofort finanziell auswirken, aber dennoch über die Zeit einen Mehrwert bieten. Dazu zählen bessere Transparenz operativer Abläufe, optimierte Entscheidungsfindung, reibungslosere Prozesse oder eine höhere Kundenzufriedenheit.

- Strategisch: Dies fokussiert sich auf den langfristigen Wettbewerbsvorteil. Dazu gehören das Ermöglichen neuer Fähigkeiten, das Erschließen neuer Märkte oder das Lösen von Problemen, deren Überwachung zuvor zu teuer oder schwierig gewesen wäre.

Komplexität definieren:

- Infrastruktur: Haben Sie bereits die richtigen Kameras und ausreichend Rechenleistung vor Ort? Dazu gehört auch die Überprüfung, ob neue Kameras benötigt werden und ob die aktuelle Edge-Hardware die erforderliche Rechenlast bewältigen kann.

- Modellierung: Handelt es sich um ein Problem, das mit einem existierenden oder Basis-Modell gelöst werden kann, oder wird ein maßgeschneidertes Modell für eine hochspezialisierte industrielle Aufgabe benötigt?

- Datenverfügbarkeit: Dies ist häufig der wichtigste Faktor. Verfügen Sie über hochwertige Trainingsdaten, die wirklich Ihrer Produktionsumgebung entsprechen?

Beginnen Sie im rechten oberen Quadranten und suchen Sie nach schnellen Erfolgen – Anwendungsfälle, die einen hohen Wert und eine geringe Komplexität aufweisen. Diese eignen sich oft am besten für den Einstieg, da das Team zunächst praktische Erfahrungen bei der Implementierung sammeln sollte.

Nehmen Sie das klassische Beispiel: Die Erkennung von 80 % der Fehler auf einer Produktionslinie kann einem Hersteller jährlich rund 4 Millionen Dollar an Ersatzkosten sparen. Der Grund, warum ein solcher Anwendungsfall schnell von der Idee bis zur Produktion gelangen kann, liegt darin, dass Roboflow die drei üblichen Barrieren für Teams abbaut. Die Datenbarriere ist geringer, da Roboflow Universe bereits vorab gelabelte Datensätze bereitstellt, die Teams nutzen und weiterentwickeln können, ohne selbst tausende Bilder zu sammeln. Der Aufwand für die Kennzeichnung sinkt, da Roboflow Annotate es ermöglicht, eigene standortspezifische Bilder aufzunehmen und mit KI-gestützten Tools zu annotieren, statt einen kompletten Datensatz von Hand zu beschriften. Und das Hindernis bei der Implementierung reduziert sich, weil Roboflow Deploy den direkten Einsatz auf Edge-Hardware unterstützt, sodass das Modell direkt auf bereits vorhandener Ausrüstung laufen kann und keine neue Infrastruktur benötigt wird.

Diese frühen Erfolge sparen nicht nur Geld. Sie stärken auch das interne Vertrauen, fördern die Unterstützung für weitere Investitionen und erleichtern es, später komplexere Projekte anzugehen.

4. Auswahl Ihres Implementierungsplans

Nachdem Sie das passende Projekt identifiziert haben, besteht der nächste Schritt darin, die Architektur für die Implementierung zu wählen. Das bedeutet, zu entscheiden, wie das System im Betrieb laufen soll – je nach Anforderungen des Anwendungsfalls. Erfahren Sie mehr über das Deployment mit Roboflow hier.

| Implementierungsstrategie | Nutzen Sie diese Option, wenn... | Vorteil mit Roboflow |

|---|---|---|

| Edge | Sie benötigen eine Latenz von <10 ms für Hochgeschwindigkeitslinien (100+ FPS) oder haben keine Konnektivität vor Ort. | Der Roboflow Inference Server läuft auf gängiger Edge-Hardware wie NVIDIA Jetson, x86-Servern oder jedem Gerät, das Docker unterstützt. So können Inspektionsmodelle lokal auf der Produktionslinie mit geringer Latenz ausgeführt werden – ohne dass Bilder für die Verarbeitung in die Cloud gesendet werden müssen, was insbesondere für abgegrenzte (air-gapped) Anlagen erforderlich ist. |

| Cloud | Sie führen Batch-Verarbeitung oder eine zentrale Bestandsaufnahme über 50 Standorte hinweg durch. | Die Roboflow Hosted API bietet verwaltete Inferenz über einen serverlosen Cloud-Endpunkt. Teams, die große Batch-Jobs wie nächtliche Bestandsprüfungen über viele Standorte hinweg durchführen, können ihre Bilder an einen einzigen Endpunkt senden; Roboflow übernimmt im Hintergrund das GPU-Management. |

| Hybrid | Sie benötigen eine Echtzeit-Reaktion am Edge und gleichzeitig zentralisierte Analytik oder Verwaltung in der Cloud. | Roboflow Workflows erlaubt es Teams, eine einzige Inspektionspipeline zu definieren, die sowohl am Edge als auch über die Hosted API für Analysen in der Cloud laufen kann. Neue Modellversionen, die in Roboflow Train trainiert wurden, können dann über den gleichen Prozess auf die Edge-Knoten ausgerollt werden – so bleiben zentrale Steuerung und lokale Ausführung synchron. |

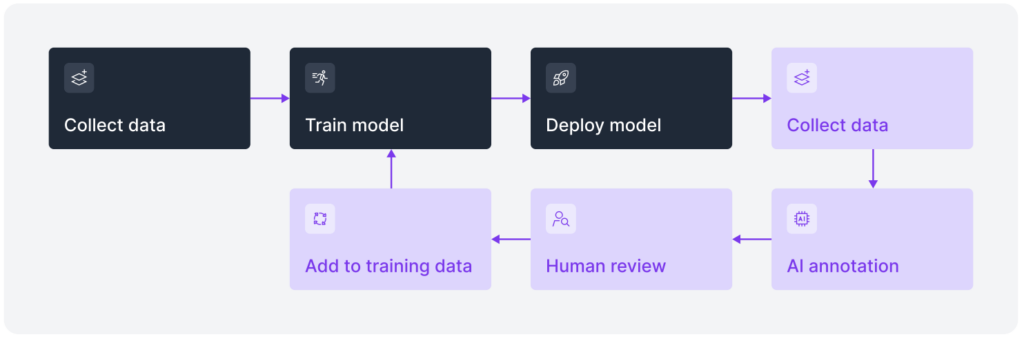

Die Welt programmierbar machen

Der Weg von einem funktionierenden Prototypen zur zuverlässigen, unternehmensweiten Produktion verläuft selten geradlinig. Echte Vision-Systeme arbeiten in einem Kreislauf: neue Beispiele aus dem Feld sammeln, das Modell neu trainieren, an den Rand (Edge) ausrollen und überwachen, was weiterhin durchkommt. Jede dieser Phasen entspricht einem bestimmten Teil der Roboflow-Plattform. Roboflow Annotate übernimmt das Sammeln und die Kennzeichnung. Roboflow Train baut das Modell mit dem aktualisierten Datensatz neu auf. Und Roboflow Inference oder die gehostete API bringt die neue Version wieder in Produktion – sowohl am Edge als auch in der Cloud.

Dies ist wichtig, weil reale Umgebungen nicht alle identisch sind. Jede Anlage, jede Produktionslinie und jeder Logistikhof hat eigene Betriebsbedingungen und technische Einschränkungen. An einem Ort kann das Problem schlechte Lichtverhältnisse sein. An einem anderen sind es vielleicht hohe Geschwindigkeiten, wechselnde Produktanordnungen oder strenge Anforderungen an die Datensouveränität. Ein System, das an einem Standort gut funktioniert, muss möglicherweise trotzdem noch angepasst werden, bevor es an einem anderen zuverlässig arbeitet.

Genau hier wird eine Plattform wie Roboflow wertvoll. All diese Phasen finden innerhalb eines einzigen Projekts statt, mit gemeinsamen Datensatzversionen und einem zentralen Modell-Register. Wenn an einem Standort ein neues Problem auftritt, kann das aktualisierte Modell an alle Einsätze in derselben Pipeline ausgerollt werden, ohne dass Daten in ein anderes Tool exportiert oder jedes Edge-Gerät einzeln aktualisiert werden muss.

Sprechen Sie noch heute mit einem Roboflow KI-Experten, um diese Priorisierungsprinzipien auf Ihre eigenen technischen Herausforderungen anzuwenden und den Grundstein für eine vision-native Zukunft zu legen.