Stellen Sie sich vor: Ein Defekt wird auf Linie drei erkannt. Noch bevor er die nächste Station erreicht, wird eine Warnung ausgelöst, der Bediener benachrichtigt und die Feststellung mit Zeitstempel, Vertrauenswert und Kamera-ID protokolliert. Niemand musste zuschauen. Das System hat es erkannt.

So sieht Vision KI auf dem Fabrikboden aus, wenn sie wirklich funktioniert. Nicht nur ein Modell, das im Hintergrund Inferenz durchführt, sondern eine aktive Betriebsschicht, die das, was Ihre Kameras sehen, in Entscheidungen, Alarme und Daten umwandelt, mit denen Ihr Team wirklich arbeiten kann.

Die meisten Teams konzentrieren sich auf den Modellbau. Die schwierigere Aufgabe – und die, die darüber entscheidet, ob das System echten Mehrwert liefert – ist das Schaffen der passenden Infrastruktur: die richtige Datenstrategie, die passende Bereitstellungsarchitektur, den richtigen Feedback-Loop. Das verwandelt einen funktionierenden Prototyp in ein System, auf das Ihr Shopfloor sich verlassen kann.

Hier ist die Blaupause, wie Sie das mit Roboflow erreichen.

Wie Sie Vision KI mit Roboflow bereitstellen

Nachdem der Anwendungsfall definiert wurde, folgt im nächsten Schritt die Implementierung. Jetzt wird aus einem funktionierenden Modell ein System, das zuverlässig unter realen Bedingungen läuft. Roboflow’s Visuelle KI-Plattform bietet einen strukturierten Ansatz, um von Prototyp zu Produktion zu gelangen – inklusive Einrichtung, Datenmanagement und der stetigen Verbesserung.

1. Die Physik des Sensors

Ihre Kamera ist die Schnittstelle zur realen Welt. Alles, was danach kommt – Ihr Modell, die Ergebnisse, die Messungen – ist nur so zuverlässig wie das, was durch dieses Objektiv aufgenommen wird. In einer echten Fabrikumgebung gibt es zwei Aspekte, die Ihr System unbemerkt aus dem Tritt bringen, wenn Sie sie nicht von Anfang an berücksichtigen: Linsenverzerrung und inkonsistente Beleuchtung.

- Die Tücke der Linsenverzerrung: Weitwinkelobjektive sind auf dem Fabrikboden beliebt, weil sie einen größeren Bereich erfassen. Die Kehrseite ist der Fischeye-Effekt: Gerade Linien biegen sich, Raster verzerren und Ihr Koordinatensystem verschiebt sich. Im Labor übersieht man das leicht. In der Produktion wird ein zuverlässiges Modell dadurch unzuverlässig.

- Die Produktionslösung (intrinsisch vs. extrinsisch): Roboflow Workflows ermöglicht es, Verzerrungskorrekturen direkt in Ihre Inferenzpipeline zu integrieren. Der Kamera-Kalibrierungs-Block entfernt die Verzerrung im Bild, bevor es zum Modell gelangt. Der Perspektiv-Korrektur-Block transformiert anschließend die schräge Kamerasicht in eine normalisierte Draufsicht, wobei korrigierte Koordinaten durch alle nachfolgenden Messschritte übernommen werden.

- Beleuchtung als Variable: Die Beleuchtung in der Fabrik verändert sich im Tagesverlauf: Schichtwechsel, Sonnenlicht durch Fenster und Schatten, die morgens nicht da waren. Roboflow begegnet dem an zwei Stellen: Auto-Adjust Contrast normalisiert das Licht in den Trainingsbildern, und der Contrast Equalization Block in den Workflows korrigiert Beleuchtungsunterschiede zur Laufzeit – auch in Szenen mit unregelmäßig ausgeleuchteten Bildbereichen.

Saubere, konsistente Eingaben sind das Fundament – aber ein Modell, das am ersten Tag funktioniert, muss dennoch auch dann noch akkurat bleiben, wenn sich die realen Bedingungen von den Trainingsdaten entfernen.

2. Das physische Setup standardisieren

Ein Visionsystem über mehrere Fertigungslinien hinweg zu skalieren, ist nicht nur ein Softwareproblem. Ist die Kamera auf Linie eins drei Fuß über dem Tisch in einem 45°-Winkel montiert, muss dieses Setup exakt dokumentiert und an jeder anderen Linie repliziert werden. Kleine Unterschiede in der Montage, die im Labor noch kompensiert werden können, führen in der Produktion zu realen Fehlerquellen – und zeigen sich in Ihrem Roboflow Monitoring Dashboard als unerklärlicher Vertrauensverlust, lange bevor Sie die physische Ursache herausfinden.

- Vereinheitlichen Sie Montage und Winkel: Verwenden Sie starre, industrietaugliche Halterungen und definieren Sie eine feste Montagehöhe und einen festen Winkel. Selbst kleinste Positionsänderungen der Kamera können die Perspektivtransformation aus Ihrem Roboflow Workflow brechen. Das heißt, die Koordinaten-Normalisierung, die an Linie eins tadellos lief, liefert dem Modell an Linie zwei eine leicht andere Ansicht.

- Standardisieren Sie Abstand, Sichtfeld und Hintergrund: Halten Sie Kameradistanz und sichtbaren Bildbereich bei allen Setups konstant. Wenn sich die Szene zwischen den Linien zu stark unterscheidet, sieht Ihr Modell in Wirklichkeit Eingaben, für die es nie trainiert wurde – und Roboflow's Model Monitoring wird dies als Abfall des durchschnittlichen Vertrauenswerts pro Gerät anzeigen.

- Beleuchtungskonstanten schaffen: Stellen Sie Lichtquelle, Intensität und Platzierung so einheitlich wie möglich ein. Roboflows Contrast Equalization Block kann langsame Lichtveränderungen zur Laufzeit abfangen, funktioniert aber am besten, wenn schon die physische Ausgangsbasis möglichst konstant ist. Je stabiler die Beleuchtung, desto weniger Korrekturaufwand hat die Pipeline.

- Standardisierung über Standorte hinweg mit Device Manager: Ist Ihr physisches Setup dokumentiert, können Sie mit Roboflow's Device Manager denselben Workflow fleetweit auf allen Edge Devices ausrollen – zentral vom Dashboard, ohne manuelle Updates pro Standort. Mithilfe benutzerdefinierter Metadaten können Sie jede Inferenz mit Standort-IDs wie `warehouse_a` oder `line_3` taggen. Sollte ein Standort schwächer performen, ist das im Model Monitoring sofort isolierbar – keine Diagnose an der gesamten Flotte nötig.

Ein dokumentiertes, wiederholbares physisches Setup reduziert die Variablen, mit denen das Modell umgehen muss – ganz vermeiden lassen sie sich jedoch nicht. Im Lauf der Zeit ändern sich die Bedingungen, das System muss Veränderungen erkennen können.

3. Intelligente Datenstrategie

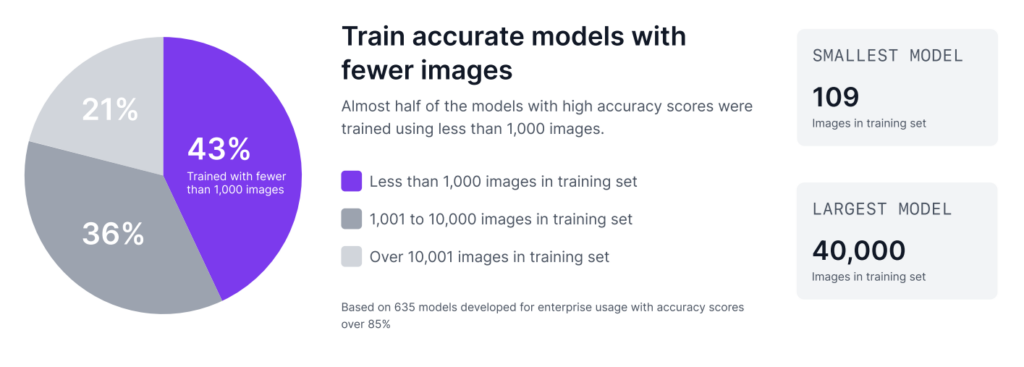

Wie der Trends-in-Visual-AI-Bericht von Roboflow zeigt, ist benutzerdefinierte visuelle KI oft weniger datenintensiv, als viele Teams annehmen. 43 % der Unternehmensmodelle mit höchsten Genauigkeitswerten wurden mit weniger als 1.000 Bildern trainiert. Zudem werden viele erfolgreiche Unternehmensmodelle mit nur ein paar hundert Bildern erstellt.

Schritt 1: Proof of Concept mit 50 Bildern entwickeln

Mit Roboflow können Sie einen ersten Proof of Concept (Machbarkeitsnachweis) mit etwa 50 Bildern erstellen. Dies sollte jedoch nur als Machbarkeitsprüfung dienen, nicht als produktionsreifes Modell. In diesem Stadium geht es lediglich darum, zu zeigen, dass Computer Vision das Problem lösen kann und der Anwendungsfall es wert ist, weiterverfolgt zu werden.

So funktioniert es in Roboflow:

- Laden Sie Ihre 50 Bilder in Ihr Roboflow-Projekt hoch und annotieren Sie diese

- Wechseln Sie in der Seitenleiste zu Versionen und klicken Sie auf Neue Version erstellen

- Legen Sie Ihr Training-/Validierungs-/Test-Split fest und konfigurieren Sie Ihre Vorverarbeitungs-Schritte. Verzichten Sie in diesem Schritt auf Augmentierungen, um eine unverfälschte Einschätzung der reinen Datenqualität zu erhalten

- Klicken Sie auf Erstellen, dann auf Benutzerdefiniertes Training, wählen Sie eine Modellarchitektur aus und starten Sie das Training

Das Modell, das Sie hier erhalten, ist nicht das Modell, das Sie später in Produktion bringen. Es ist ein Signal. Wenn Ihr Zielobjekt mit nur 50 Bildern überhaupt erkannt wird, lohnt es sich, den Anwendungsfall weiter auszubauen.

Schritt 2: Hochskalieren auf 500 Bilder für die Produktionsvalidierung

Ist der Mehrwert belegt, folgt der nächste Schritt: Hochskalieren auf etwa 500 Bilder. Der Grund ist einfach: Im Produktivbetrieb benötigen Sie eine aussagekräftige Testmenge, um zu prüfen, ob das Modell stabil genug für den Echtbetrieb ist. Wenn etwa 10 % der Daten für Tests reserviert werden, ergeben 500 Bilder ungefähr 50 Testbilder – eine viel bessere Basis zur Validierung. Tests mit nur wenigen Bildern liefern kein ausreichendes Vertrauen in die spätere Einsatzfähigkeit des Modells.

Die Schritte in Roboflow bleiben gleich, aber Sie konfigurieren nun Folgendes:

- Laden und annotieren Sie Ihren erweiterten Datensatz im selben Roboflow-Projekt

- Wechseln Sie zu Versionen → Neue Version erstellen

- Legen Sie diesmal gezielt ein Training/Validierung/Test-Split von etwa 70/20/10 fest, sodass Sie auf ca. 50 Testbilder für eine fundierte Validierung kommen

- Nun sind Augmentierungen sinnvoll: Fügen Sie nur das hinzu, was tatsächliche Bedingungen auf Ihrem Werksboden widerspiegelt — nicht mehr

- Klicken Sie auf Erstellen, dann Benutzerdefiniertes Training, um das Training zu starten

Der Datensatz, auf dem Sie trainieren, ist ein Ausgangspunkt, kein Limit. Die Bilder, die Ihr Modell am genauesten machen, sind diejenigen, die es noch nicht gesehen hat; sie werden bereits auf Ihrem Werksboden aufgenommen.

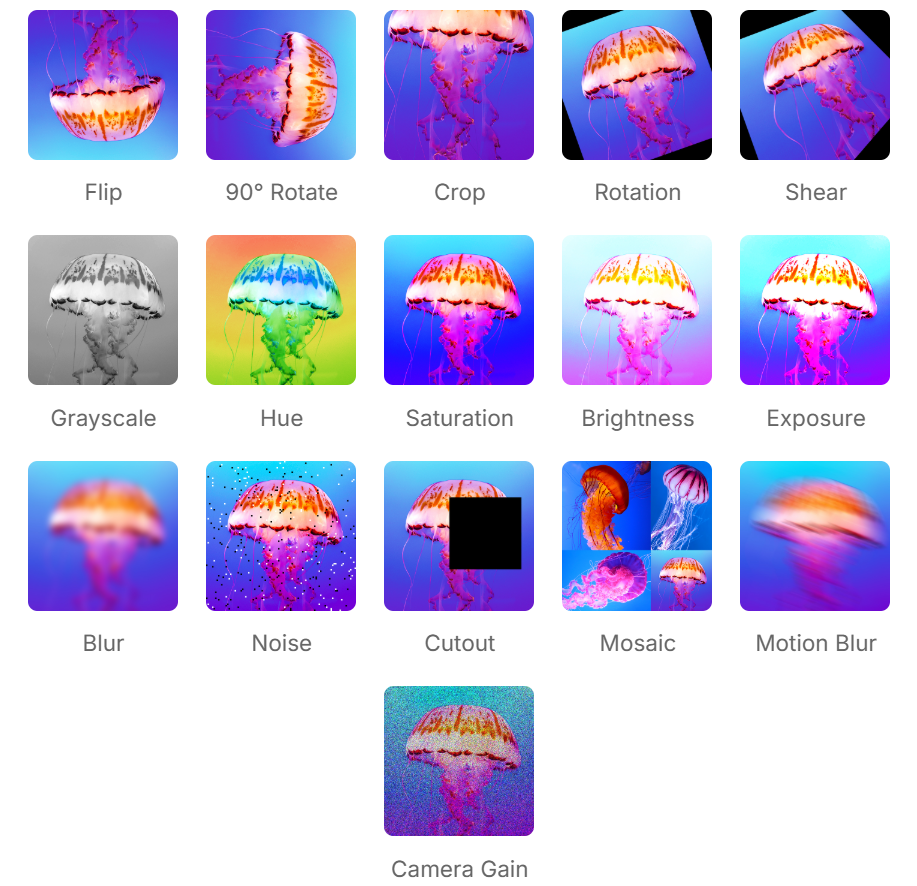

4. Augmentierung ist Umweltsimulation

Ein häufiger Fehler bei der Modellentwicklung ist das Anwenden zu vieler Augmentierungen ohne klaren Grund. Es ist leicht, mehrere Optionen zu aktivieren und sich ein robusteres Modell zu erhoffen, doch oft wird dadurch nur unnötiges Rauschen hinzugefügt und die Leistung verschlechtert.

Jede Augmentierung sollte eine reale Bedingung aus Ihrer Umgebung widerspiegeln. Widerspiegelt sie keine reale Variation auf dem Werksboden, kann sie das Modell eher verwirren als verbessern. Ziel ist nicht, den Datensatz komplexer zu machen, sondern realistischer.

Das Hinzufügen von Augmentierungen in Roboflow erfolgt im selben Ablauf zur Versionserstellung wie im vorherigen Schritt, direkt unterhalb der Vorverarbeitung, wenn Sie eine neue Version generieren. Hier eine Übersicht, wann sich die jeweilige Augmentierung wirklich lohnt — und wann nicht.

- Rotation: Wenn Produkte in unterschiedlichen Ausrichtungen wie z. B. 90°-Drehungen auf einem Förderband erscheinen können, sollte Rotation einbezogen werden. Wenn das Produkt jedoch stets gleich ausgerichtet ist, können gedrehte Bilder unrealistische Szenarien erzeugen und die Genauigkeit verringern.

- Helligkeit & Belichtung: Lichtbedingungen ändern sich oft im Tagesverlauf. Zum Beispiel kann Sonnenlicht durch Fabrikfenster oder eine Variation bei künstlichem Licht beeinflussen, wie Objekte erscheinen. Die Simulation solcher Veränderungen sorgt dafür, dass das Modell unter verschiedenen Lichtbedingungen zuverlässiger arbeitet.

- Unschärfe: Wenn die Kamera oder das Objekt während des Betriebs leichte Bewegungen, Fokusabweichungen oder Vibrationen erfahren kann, kann eine geringe Menge an Unschärfe-Augmentation helfen. Ist die Kamera jedoch fixiert und das Bild immer scharf, kann das Hinzufügen von Unschärfe die Modellqualität sogar verringern.

- Rauschen oder Kameraverstärkung: Wenn die Produktionskamera manchmal aufgrund von schwachem Licht oder Sensorbeschränkungen körnige Bilder erzeugt, kann das Hinzufügen von Rauschen oder Kameraverstärkung das Modell robuster machen. Sind die echten Bilder bereits sauber, sollte auf diese Augmentation verzichtet werden.

- Zuschnitt oder Ausschnitt: Diese sind hilfreich, wenn Objekte teilweise verdeckt, am Bildrand abgeschnitten oder nicht immer vollständig sichtbar sind. Wird jedoch für jedes Bild in der Produktion volle Sichtbarkeit erwartet, spiegeln diese Augmentationen die Realität nicht wider.

- Scherschnitt oder Perspektivenvariation: Diese sind nur sinnvoll, wenn sich der Kamerawinkel oder die Objektausrichtung im realen Betrieb leicht ändern können. Wenn der physische Aufbau standardisiert und der Kamerawinkel fix ist, sind diese Augmentationen in der Regel unnötig.

- Spiegelung: Dies sollte nur verwendet werden, wenn das Produkt tatsächlich in gespiegelter Richtung auftreten kann. Hat die Links-Rechts-Ausrichtung eine Bedeutung, kann das Spiegeln zu falschen Beispielen führen und das Modell verwirren.

Augmentationen helfen dem Modell, Variationen vorherzusehen, basieren aber darauf, was Sie erwarten. Aktives Lernen ist der Weg, mit dem Sie Unerwartetes bewältigen.

5. Infrastruktur für aktives Lernen

In echten Produktionsumgebungen bleibt ein Modell nicht dauerhaft präzise. Sobald eine neue Artikelnummer auf dem Band erscheint, eine Linse verschmutzt oder die Beleuchtung sich ändert, kann das Modell unter Datendrift leiden. Daher sollte das System nach der Bereitstellung nicht als statisch betrachtet werden, sondern darauf ausgelegt sein, sich im Laufe der Zeit zu verbessern. Roboflow unterstützt dies, indem Teams Produktionsdaten nutzen können, um das Modell kontinuierlich zu stärken.

- Die aktive Lernschleife: Hören Sie nicht bei der Inferenz auf, sondern überwachen Sie die Ergebnisse. Legen Sie in Roboflow Workflows einen Filter an, um automatisch Detektionen mit geringer Sicherheit zu kennzeichnen. Ein guter Startwert ist 50 % Konfidenz. Alles, was das Modell unterhalb dieses Schwellenwerts zurückgibt, sollte zur Überprüfung markiert werden. Wenn Ihr Modell reifer wird und die Grundkonfidenz steigt, kann der Schwellenwert auf 60 % oder 70 % angezogen werden. Diese unsicheren Vorhersagen zeigen Ihnen, wo das Modell mehr Daten benötigt.

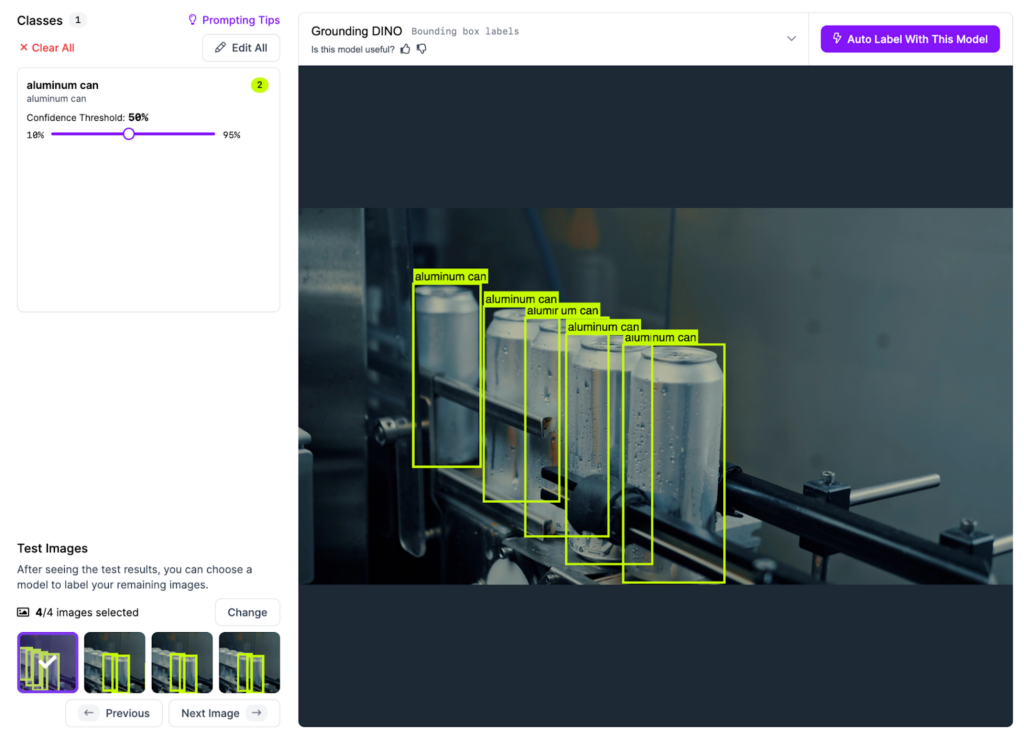

- Automatische Beschriftung im großen Maßstab: Sobald diese schwierigen Bilder identifiziert sind, können sie wieder in den Roboflow-Datensatz eingespeist werden. Nutzen Sie die Auto-Label-Funktion von Roboflow, ein Foundation Model oder Ihr aktuell bestes Modell zur automatischen Annotation. Eine menschliche Prüferin oder ein Prüfer kann diese Markierungen dann im Roboflow annotation-Tool innerhalb von weniger als 10 Sekunden pro Bild bestätigen, ablehnen oder korrigieren, statt mehrere Minuten mit dem Zeichnen von Begrenzungsrahmen zu verbringen.

- Vor erneuter Bereitstellung trainieren und validieren: Sobald die markierten Bilder beschriftet und dem Datensatz hinzugefügt wurden, erstellen Sie in Roboflow eine neue Datensatzversion und starten Sie einen neuen Trainingslauf. Wenn das neue Modell fertig ist, setzen Sie es nicht direkt ein. Verwenden Sie die Modellevaluierung von Roboflow, um zu prüfen, ob die neue Version tatsächlich verbessert ist. Vergleichen Sie Präzisions-, Recall- und Konfidenzwerte mit Ihrer vorherigen Version anhand desselben Testsatzes. Zeigen die Zahlen nach oben, setzen Sie das Modell ein. Falls nicht, sollten die markierten Bilder eventuell nochmal überprüft werden, bevor neu trainiert wird.

So wird der Kreis geschlossen. Sie setzen nicht bloß ein Modell ein, sondern eine Infrastruktur, die am Ort der Fertigung weiterlernen und langfristig zuverlässiger werden kann.

6. Bereitstellungsinfrastruktur

Ein Modell mit einer aktiven Lernschleife ist nur so nützlich wie die Infrastruktur, auf der es läuft. Sobald Ihr System sich kontinuierlich verbessert, besteht die nächste Herausforderung darin, die konsistente und zuverlässige Bereitstellung an allen erforderlichen Linien und Standorten sicherzustellen.

Die passende Roboflow-Bereitstellungsarchitektur hängt von Ihrem spezifischen Fabrikszenario ab. So treffen Sie die richtige Wahl:

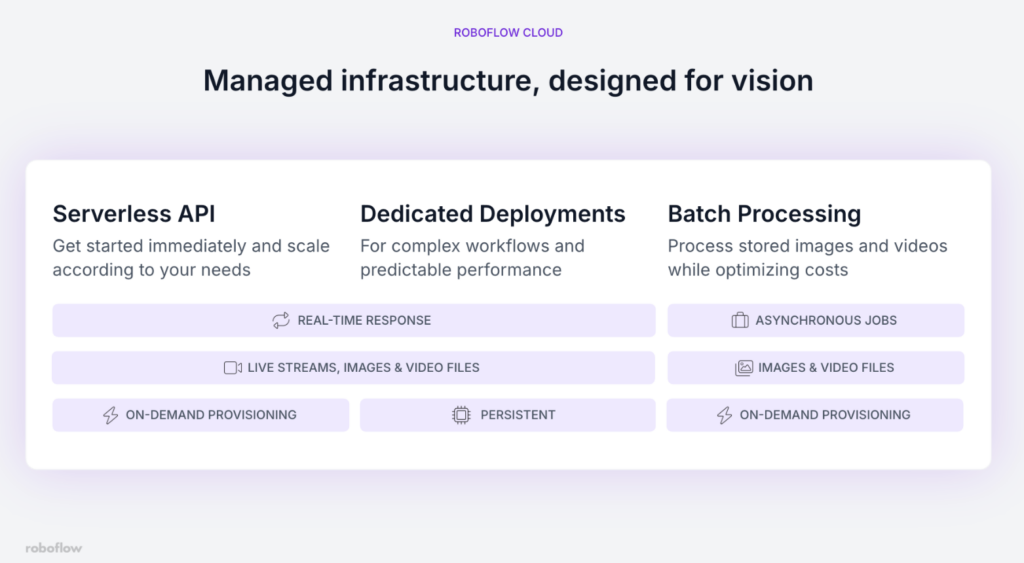

- Sie validieren noch oder führen Niedrigfrequenz-Inspektionen durch: Starten Sie mit der Serverless API. Es ist keine Einrichtung von Infrastruktur erforderlich, skaliert automatisch und Sie sind in wenigen Minuten einsatzbereit. Der Kompromiss ist, dass sie auf der CPU läuft, daher ist die Latenz höher – was weniger ins Gewicht fällt, wenn Sie Bilder auf Abruf verarbeiten und keinen kontinuierlichen Livestream.

- Sie betreiben Live-Produktionslinien, die eine konstante, niedrige Latenz für Inferenz benötigen: Nutzen Sie ein Dediziertes Deployment. Sie erhalten einen GPU-gestützten Server mit isolierten Ressourcen, vorhersehbarer Leistung und Unterstützung für größere Modelle. Das ist die richtige Wahl, wenn eine verzögerte Erkennung bedeutet, dass ein fehlerhaftes Teil bereits den Inspektionspunkt passiert hat.

- Ihre Einrichtung verfügt über eingeschränkte oder unzuverlässige Internetverbindung: Setzen Sie auf lokales Deployment mit Roboflow Inference auf einem Edge-Gerät wie einem NVIDIA Jetson. Das Modell läuft lokal, die Inferenz erfolgt ohne Internetverbindung, und Ihre Produktionslinie bleibt selbst bei Ausfall der Verbindung in Betrieb.

- Sie müssen gespeicherte Bilder verarbeiten oder Audits von historischem Filmmaterial durchführen: Verwenden Sie Batch Processing. Es verarbeitet große Datenmengen ohne Programmieraufwand und ist wesentlich kosteneffizienter als ein dediziertes Deployment für nicht-echtzeitbasierte Aufgaben.

Sobald Sie Ihre Bereitstellungsarchitektur ausgewählt haben, ermöglicht Ihnen der Device Manager von Roboflow, Workflow-Updates zu pushen, den Gerätezustand zu überwachen und Ihre gesamte Flotte von einem einzigen Dashboard aus zu verwalten, ohne jedes Gerät einzeln anfassen zu müssen.

Vision AI-Bereitstellung mit Roboflow meistern

Roboflow wurde entwickelt, um die Bereitstellung zu unterstützen, indem es Werkzeuge bietet, mit denen der gesamte Lebenszyklus verwaltet werden kann – vom ersten vom Kamera erfassten Bild bis zur finalen Inferenz am Edge.

Ob Anwendungsfall das Zählen von Teilen auf einem Förderband ist oder die Erkennung komplexerer visueller Muster – das Ziel bleibt, Bilddaten in umsetzbare Logik zu verwandeln, die echte Abläufe unterstützt.

Die physische Welt kann jetzt als programmierbar betrachtet werden. Sprechen Sie mit einem Roboflow KI-Experten, um mehr zu erfahren.