Wir befinden uns im Zeitalter der vision-nativen Infrastruktur. Aufbauend auf mehr als 200.000 Projekten, 1 Milliarde Trainingsbildern, 250.000 feinabgestimmten Modellen und 55 Milliarden Vorhersagen pro Jahr zeigt Roboflows 2026 Visual AI Trends Report, dass die erfolgreichsten Teams Computer Vision nicht als einmaliges Projekt behandeln – sie integrieren es fast wie CI/CD für die physische Welt.

Sie integrieren Computer Vision in ihren gesamten operativen Tech-Stack und verbinden Modellausgaben direkt mit Steuerungen in der Produktionslinie, Bestandsverwaltung, Instandhaltungs-Workflows und Qualitätsprozessen. Diese Integration ist der Grund für messbare Ergebnisse wie reduzierte Ausfallzeiten, gleichbleibend hohe Qualität, geringeres Betriebsrisiko und schnellere Reaktionen auf Probleme vor Ort.

Wenn Sie nach einem Vorzeigeprojekt suchen, das sofortigen und messbaren ROI liefert, während es sich in einen modernen, skalierbaren Technologie-Stack einfügt, dann ist dies der Weg, wie die weltweit führenden Fertigungsteams heute Vision AI im großen Maßstab einsetzen.

Wie führende Branchen Roboflows Vision AI nutzen

In der Fertigung, Logistik und Konsumgüterindustrie folgen die Vision-AI-Einsätze mit dem stärksten langfristigen Nutzen meist demselben Muster. Modelle führen Inferenz direkt am Edge durch, sodass das System schnell reagieren und Echtzeit-Anforderungen erfüllen kann. Die Ausgaben werden direkt an nachgelagerte Steuerungssysteme angebunden, sodass Erkennungen zu Aktionen – und nicht nur zu Warnhinweisen – führen. Teams implementieren zudem aktive Lernschleifen, indem sie neue Produktionsdaten zurück in den Trainingsprozess einspeisen, sodass das Modell sich kontinuierlich mit wechselnden Bedingungen verbessert. Dieses Muster zeigt sich deutlich in realen Einsätzen von Unternehmen wie USG Corporation, Almond und BNSF Railway.

1. Industrielle Fertigung: Das visuelle System als Referenz

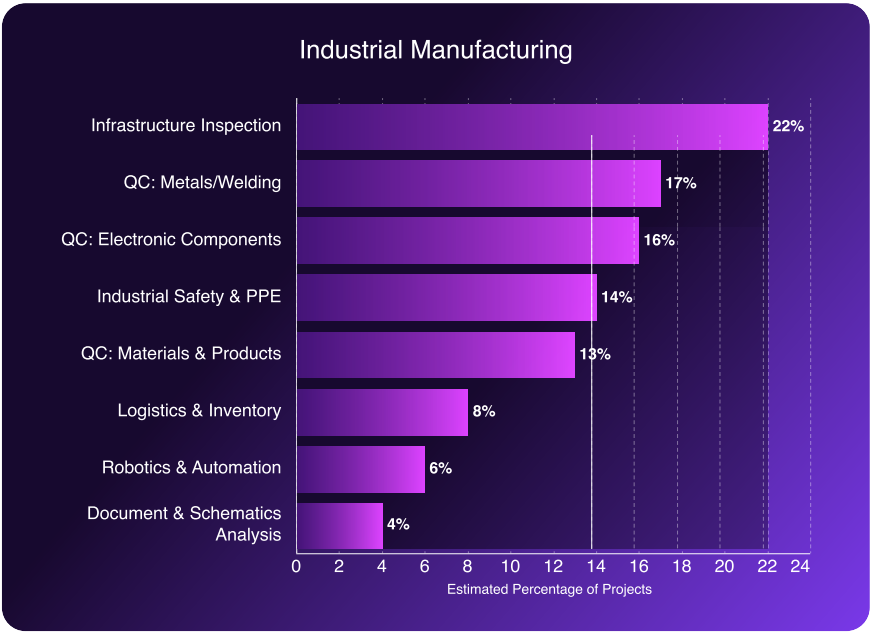

In der industriellen Fertigung machen Fehlererkennung und Qualitätsinspektion etwa 68 % der Vision-Einsätze aus. Das technische Ziel ist dabei meist nicht nur, Fehler für die menschliche Überprüfung zu kennzeichnen, sondern auch den Kreislauf zwischen Erkennung und Reaktion zu schließen. Erkennt ein Modell eine Anomalie, löst das System eine deterministische Aktion aus, etwa das Umlenken eines Produkts, das Anhalten einer Linie oder die Benachrichtigung einer SPS.

Ein visuelles System, das lediglich Warnmeldungen für eine Qualitätsleitung generiert, dient vorwiegend als Überwachungstool. Ein System, das Signale direkt an eine SPS sendet und Produkte automatisch umleitet, wird zum Teil der Betriebstechnologie. Diese beiden Architekturen erzielen sehr unterschiedliche ROI-Ergebnisse, und die Differenz wird mit zunehmender Skalierung der Einsätze über Produktionslinien hinweg noch größer.

Die strategischen Prioritäten:

- Qualitätskontrolle (46 %): Digitalisierung und Standardisierung von Inspektionskriterien an mehreren globalen Standorten, um Variabilität durch subjektive Urteile einzelner Bediener zu vermeiden.

- Infrastrukturinspektion (22 %): Automatisierte Erkennung von Rissen, Lecks und mechanischem Verschleiß an Anlagen, bevor sie ungeplante Stillstände verursachen – ermöglicht einen Wandel von planmäßiger zu prädiktiver Instandhaltung.

- Sicherheit und Compliance (14 %): Echtzeitüberwachung der Arbeitsumgebung, um die Einhaltung betrieblicher Regeln und Sicherheitsstandards zu gewährleisten, zum Beispiel durch die Erkennung von PSA-Verstößen oder das Erfassen von Personen in Sperrzonen mit automatischen Warnungen oder Zugangskontrollen.

Praxisbeispiel: KI reduziert Subjektivität bei Qualitätsprüfungen bei USG

Die USG Corporation, Nordamerikas größter Gipskartonplattenhersteller, benötigte eine konsistente Qualitätsinspektion an 50 Produktionsstandorten. Der frühere Prozess verließ sich auf subjektive Bewertungen einzelner Werksmitarbeiter. Die Prüfergebnisse variierten je nach Standort und Schicht, sodass es schwer war, unternehmensweit einen einheitlichen Qualitätsstandard durchzusetzen.

USG setzte ein einziges versioniertes Modell an allen 50 Standorten mit Roboflow Inference ein und eliminierte damit die Notwendigkeit, für jede Anlage eigene Pipelines zu entwickeln und zu pflegen. Erkennt das Modell eine Plattenfehlstellung, die wahrscheinlich einen nachgelagerten Stau verursacht, sendet es ein latenzarmes Signal direkt an die SPS der Anlage, um das Produkt automatisch umzuleiten. Die Entscheidung erfolgt mit Maschinengeschwindigkeit – ohne auf eine Überprüfung durch Menschen warten zu müssen.

Das Resultat ist ein Qualitätsprozess, der an jedem Standort und in jeder Schicht denselben Standard anlegt. Inspektionsergebnisse hängen nicht mehr davon ab, welcher Bediener im Dienst ist. Das Modell steuert eine physische Aktion und hebt so ein produktionsreifes Vision-System von einem reinen Monitoring-Tool ab.

2. Konsumgüter: Bereitstellungsgeschwindigkeit und Edge-Autonomie

Produktionsstraßen in der Konsumgüterindustrie laufen mit Geschwindigkeiten, bei denen Inferenz in der Cloud keine praktikable Option ist. Wenn Produkte mit über 100 FPS verarbeitet werden, bringt eine Rückfrage an einen Remoteserver eine Latenz, durch die Echtzeit-Fehlererkennung unmöglich wird. Bevor eine Antwort aus der Cloud überhaupt ankommt, hat das betreffende Produkt längst mehrere nachgelagerte Stationen durchlaufen. In diesem Kontext ist Edge-Deployment kein Nice-to-have, sondern eine zwingende Voraussetzung.

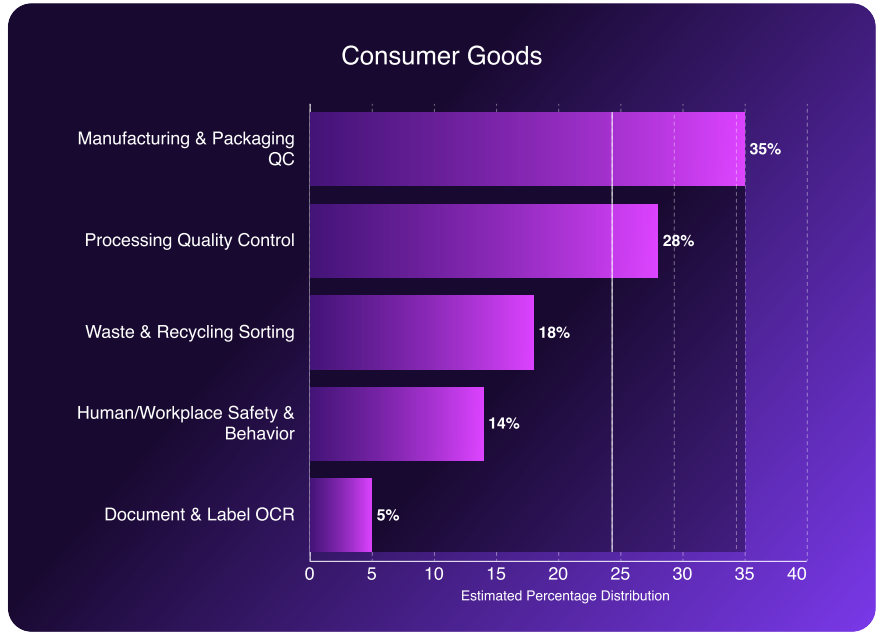

Herstellung, Verpackung und Qualitätskontrolle in der Verarbeitung machen zusammen 63 % der Vision-Einsätze im Konsumgüterbereich aus. Erfolgreiche Teams setzen Modelle direkt auf Edge-Geräten ein, halten die Inferenzlatenz im Sub-Millisekunden-Bereich und eliminieren jegliche Abhängigkeit von der Netzwerkverfügbarkeit.

Die strategischen Prioritäten:

- Verpackungs-QS (35%): Echtzeit-Überprüfung von Etikettenplatzierung, Druckqualität und Siegel-Integrität mit Produktionsgeschwindigkeit, bevor Produkte verpackt und versandt werden

- Prozessqualität (28%): Automatisierte Inspektion von Textilien, Lebensmitteln und anderen verarbeiteten Gütern auf Oberflächenfehler oder Kontaminationen, während sich die Produkte bewegen

- Automatisierte Sortierung (18%): Hochdurchsatz-Klassifizierung und Trennung von Materialien in Recycling- und Abfallströmen, Ersatz manueller Sortierprozesse, die nicht auf Produktionsvolumen skalieren können

Ein Beispiel: Almond

Traditionelle Industrieroboter funktionieren gut in festen, großvolumigen Umgebungen, bei denen Produkttyp und Position konstant sind. Wenn die Produktvielfalt steigt, wie bei High-Mix-Kommissionieroperationen, geraten herkömmliche Roboter an ihre Grenzen, da ihnen das visuelle Verständnis fehlt, um sich an wechselnde Eingaben anzupassen. Almond entwickelte ein visionsgesteuertes, robotisches Kommissioniersystem, das gezielt auf diese Variabilität ausgelegt ist.

Der Wechsel zu RF-DETR, einer Transformer-basierten Objekterkennungs-Architektur, die für Echtzeit-Performance am Edge optimiert ist, erhöhte Almonds Kommissioniergenauigkeit von 67% auf 81%. Diese Verbesserung macht das System weit über Randbereiche hinaus kommerziell einsetzbar und deckt ein viel breiteres Produktspektrum ab.

Das System läuft vollständig vor Ort über den Roboflow Inference Server. Die Inferenz erfolgt lokal, wodurch Antwortzeiten deterministisch und nicht durch Netzwerkvariabilität beeinflusst sind. Videodaten bleiben in der Einrichtung, was Anforderungen an Datensouveränität erfüllt, die oft bei der Beschaffung in Industrieumgebungen ein Hindernis darstellen.

3. Logistik und Robotik: Das MLOps-Schwungrad

Eine häufige Herausforderung bei der Implementierung von Logistik- und Robotik-Lösungen ist eine nachlassende Modellleistung nach dem Rollout. Ein Modell, das während des Trainings und der Validierung gut abschneidet, wird in der Produktion zwangsläufig mit neuen Bedingungen konfrontiert, die nicht Teil der ursprünglichen Trainingsdaten waren. Beispielsweise können sich Produktverpackungen ändern oder die Lagerlayouts werden aktualisiert. Wenn diese Änderungen nicht zurück in das Modell eingespeist werden, sinkt die Leistung langsam ab – oft bleibt das Problem unbemerkt, bis es betriebliche Auswirkungen zeigt.

Hier handelt es sich meist nicht um mangelnde Modellqualität, sondern um ein Problem der Systemarchitektur. Die praktikable Lösung ist, die Einführung von Anfang an mit dem Gedanken an kontinuierliches Retraining zu gestalten, anstatt das Nachtrainieren als reine Wartungsmaßnahme abzutun. Systeme, die alle paar Monate ein großes manuelles Retraining benötigen, werden teuer im Betrieb und schwer skalierbar.

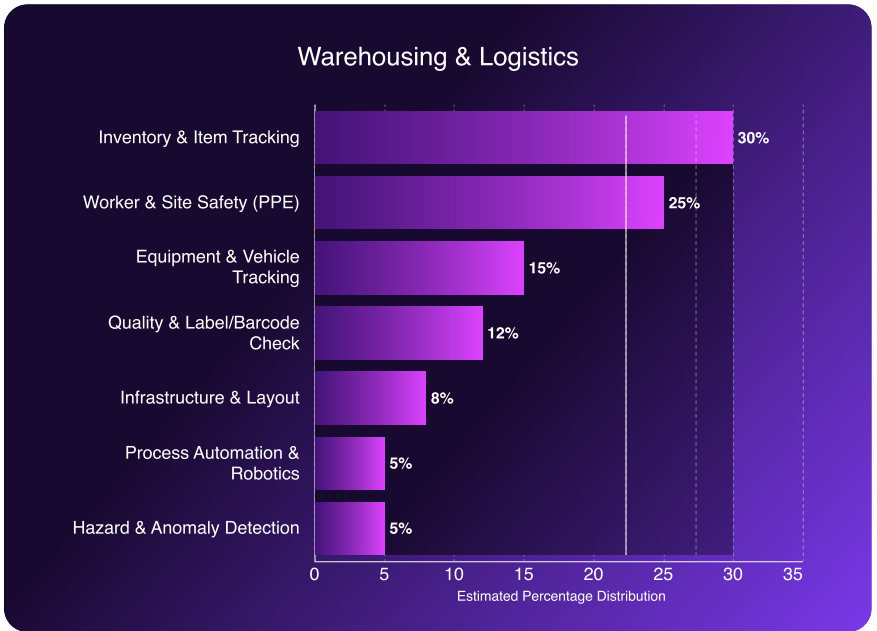

Im Lagerbereich machen Bestands- und Artikelverfolgung den größten Anwendungsfall mit etwa 30% aus, gefolgt von Arbeitssicherheit und Überwachung der PSA (persönliche Schutzausrüstung) mit rund 25%. Viele dieser Systeme nutzen die bestehende Kamerainfrastruktur an der Decke, sodass zusätzliche Hardwareinvestitionen relativ gering ausfallen. Die Hauptbetriebsherausforderung ist, die Modellgenauigkeit aufrechtzuerhalten, da sich die Lagerumgebung mit der Zeit schrittweise verändert.

Die strategischen Prioritäten:

- Autonome Bestandsverfolgung (30%): Durchgehende Zählung auf SKU-Ebene mittels vorhandener Decken-Kameras, wodurch periodische manuelle Zählungen durch Echtzeit-Bestandsübersicht ersetzt werden.

- Schematische Verifikation (12%): Automatischer Abgleich physischer Palettenaufbauten und Montagekonfigurationen mit digitalen Vorgaben, um Abweichungen zu erkennen, bevor Produkte das Lager verlassen.

Ein Beispiel: BNSF Railway

BNSF, eine Tochtergesellschaft von Berkshire Hathaway, betreibt eines der größten Eisenbahnfrachtnetze Nordamerikas. Die Verwaltung eines rund 52.300 Kilometer umfassenden Netzes macht eine großflächige manuelle Inspektion äußerst schwierig. Das Unternehmen nutzt mit Roboflow entwickelte Computer Vision, um die Bestandsverfolgung in Intermodal-Terminals zu automatisieren und Zugräder an wichtigen Punkten des Streckennetzes zu inspizieren.

Wie Asim Ghanchi, AVP of Technology bei BNSF, erklärt: „Im Labor mit KI positive Ergebnisse zu erzielen, ist einfach. Die wahre Herausforderung liegt darin, die Lösung in einem Netzwerk wie unserem auszurollen, ohne den täglichen Betrieb zu stören.“

Zur Entwicklung und Implementierung dieser Systeme stellt Roboflow Funktionen wie Labeling und Datenoptimierung, gehostetes Modelltraining und Edge AI-Inferenz bereit, sodass Modelle dort laufen, wo die Inspektionen stattfinden. Zudem werden "Human-in-the-Loop"-Workflows eingesetzt, um Datensätze fortlaufend zu verbessern. Wenn das Modell einen neuartigen Sonderfall erkennt oder eine Unsicherheitsdetektion erfolgt, kann das System diese Daten automatisch herausgreifen und zur menschlichen Überprüfung weiterleiten. Nach dem Labeln werden diese Beispiele dem Trainingsdatensatz hinzugefügt, damit sich das Modell an veränderte Realbedingungen anpasst.

Der Einsatz von Visionssystemen in solchen Umgebungen erfordert Modelle, die über verschiedene Standorte und wechselnde Bedingungen zuverlässig funktionieren. Die Beleuchtung schwankt mit Regionen und Jahreszeiten, Kamerainstallationen unterscheiden sich zwischen den Standorten, und die Witterungsverhältnisse reichen von extremer Hitze bis zu Minustemperaturen. Die eigentliche Herausforderung besteht nicht nur darin, ein Modell zu entwickeln, das im Test gut funktioniert, sondern ein System zu implementieren, das über ein großes und komplexes Betriebsnetz hinweg dauerhaft zuverlässig arbeitet.

Durch die Automatisierung von Aufgaben wie der Inspektion von Anlagen und der Überwachung des Lagerbestands per Computer Vision verbessert das Unternehmen die Transparenz in den Betriebsabläufen und erkennt potenzielle Probleme in seiner Schieneninfrastruktur früher.

Vision als Ihr KI-Wettbewerbsvorteil

Im Jahr 2026 besteht der Wettbewerbsvorsprung nicht mehr einfach zwischen Unternehmen, die KI einsetzen, und solchen, die es nicht tun. Der entscheidende Unterschied liegt vielmehr darin, ob Organisationen ein kleines, isoliertes KI-Projekt betreiben oder voll funktionsfähige und zuverlässige Computer Vision fest in ihre operativen Systeme integrieren.

Die erfolgreichsten Implementierungen sind als vollständige Systeme realisiert und nicht als eigenständige Modelle. Die Inferenz erfolgt am Edge, sodass Entscheidungen in Echtzeit getroffen werden können. Mensch-in-der-Schleife-Workflows ermöglichen es Teams, unsichere Fälle zu prüfen und neue Daten in den Trainingsdatensatz einzuspeisen. Die Integration mit nachgelagerten Systemen sorgt dafür, dass Erkennungen Aktionen wie Benachrichtigungen, Prozessanpassungen oder Steuersignale auslösen.

Das Ziel ist es, ein Vision-System zu schaffen, das auch unter veränderten realen Bedingungen zuverlässig arbeitet. Lichtverhältnisse ändern sich, Produkte entwickeln sich weiter, Kamerahardware variiert je nach Standort und Produktionsumgebungen bleiben selten konstant. Ein Produktivbetrieb muss mit diesen Veränderungen umgehen und über mehrere Standorte hinweg skalieren können, ohne ständige manuelle Wartung zu erfordern.

Deshalb ist Roboflow zum Branchenstandard geworden. Ob Sie nun RF-DETR an der Edge einsetzen, um Fehler mit über 100 FPS zu erkennen, oder ein Active Learning Flywheel über dreißigtausend Meilen Schiene steuern – die Vision-KI-Plattform von Roboflow ist das Fundament, das es heute mehr als der Hälfte der Fortune 100 ermöglicht.

Die physische Welt ist bereit, digitalisiert zu werden. Gestalten Sie die Zukunft mit Roboflow.